- mysql 内积_Python如何计算两行数据内积

Python计算两行数据内积的方法:首先使用【mat()】方法;然后将每组数据分别放到方法里转换为矩阵;再使两矩阵相乘;最后进行转换即可。>>>a=mat([[1],[2],[3]]);>>>b=mat([[0],[2],[3]]);>>>amatrix([[1],[2],[3]])>>>bmatrix([[0],[2],[3]])>>>a.T*bmatrix([[13]])上面为两个列向量的内积

- python 求向量间内积 和外积

#内积可以描述向量间的投影关系,大小为|a||b|cos⟨a,b⟩:python向量内积求向量长度:importnumpyasnpa=np.asarray([1,1,1])print(np.sqrt(a.dot(a

- python内积 卷积

AI算法网奇

python基础python开发语言

内积就是点乘,卷积先取反。importnumpyasnpbb=[1,2]cc=[2,3]aa=np.dot(bb,cc)print(aa)dd=np.convolve([2,1],cc,'valid')print(dd)dd=np.convolve(bb,cc,'same')print(dd)dd=np.convolve(bb,cc,'full')print(dd)结果:8[8][27][276]

- 线性代数向量内积_向量的点积| 使用Python的线性代数

cumubi7453

python线性代数机器学习numpy算法

线性代数向量内积Prerequisite:LinearAlgebra|DefiningaVector先决条件:线性代数|定义向量Linearalgebraisthebranchofmathematicsconcerninglinearequationsbyusingvectorspacesandthroughmatrices.Inotherwords,avectorisamatrixinn-dim

- Python的变量与数据类型

新人码农11111

python开发语言

文章目录文章目录前言一、python的变量1.python的基本变量2.python的命名规则:二、python的数据类型1.2.整型(int)2.浮点型(float)3.字符串(str)4.布尔值(bool)5.空值(None)6.类型检测(type())三、python的数据类型转换1.整型转换(int())2.浮点型转换(float())3.字符串转换(str())4.布尔值转换(bool(

- python 安装win32com.client库

FreeLikeTheWind.

Qt问题qt开发语言经验分享c++python

win32com.client是Python中用于操作WindowsCOM对象的强大模块,特别适合与MicrosoftOffice应用程序(如Word、Excel、Outlook等)进行交互。1.安装win32com.client需要安装pywin32库:pipinstallpywin32如果安装失败或速度慢,可以使用国内镜像源:pipinstallpywin32-ihttps://pypi.tu

- A股的未来在哪里?

财云量化

python炒股自动化量化交易程序化交易a股未来发展宏观经济政策引导股票量化接口股票API接口

炒股自动化:申请官方API接口,散户也可以python炒股自动化(0),申请券商API接口python炒股自动化(1),量化交易接口区别Python炒股自动化(2):获取股票实时数据和历史数据Python炒股自动化(3):分析取回的实时数据和历史数据Python炒股自动化(4):通过接口向交易所发送订单Python炒股自动化(5):通过接口查询订单,查询账户资产股票量化,Python炒股,CSDN

- 最新最全的阿里云服务器部署Django项目教程(2021)

阿里云Linux服务器以Nginx+uWSGI部署Django项目教程前言:本教程适用于以Windows和Linux系统环境开发Django项目的初学者,帮助其将第一个Django项目部署上线,同时包含了一部分的DeBug方案,供其参考。-作者本地环境是Django2.0+Python3.8.3+Sqlite,以virtualenv在本地建立的虚拟环境。-作者Web代理服务器使用的是uWSGI,反

- 股市是否会持续下跌?

股票程序化交易接口

量化交易股票API接口Python股票量化交易股市下跌趋势影响因素投资者情绪股票量化接口股票API接口

Python股票接口实现查询账户,提交订单,自动交易(1)Python股票程序交易接口查账,提交订单,自动交易(2)股票量化,Python炒股,CSDN交流社区>>>经济形势对股市的影响宏观经济数据的作用宏观经济数据能反映整体经济的健康状况。像GDP增长率,如果持续走低,企业盈利可能受到影响,从而影响股票价格。例如在经济衰退期,企业营收减少,成本相对增加,利润空间被压缩。这会使投资者对企业前景担忧

- docker搭建靶场

无名小猴

HTB靶场练习学习

一、dockerfile使用Dockerfile是用来构建Docker镜像的配置脚本,定义了:用哪个基础镜像(如python:3.10)安装哪些依赖(如pipinstall)拷贝哪些文件(如本地代码、配置)设置运行入口(如CMD[“python3”,“main.py”])写好dockerfile构建镜像dockerbuild-f/Dockerfile-tmy_image_name/dockerpa

- 安装Python3.12报错:HTTP 429 TOO MANY REQUESTS for url <https://mirrors.ustc.edu.cn/anaconda/pkgs/free/li

安装Python3.12报错(base)[xxx@hadoop104python_shell]$condacreate--namepythonThirteenpython=3.12报错如下:Retrievingnotices:…working…ERRORconda.notices.fetch:get_channel_notice_response(63):Requesterrorforchanne

- 金蝶api对接沙箱环境python代码调试

Python大数据分析

python

根据官网文档加密规则importtimeimportrandomimporthmacimporthashlibimportbase64importrequestsimporturllib.parse#基础参数method="GET"path="/jdy/v2/scm/pur_order"base_url="https://api.kingdee.com"full_url=base_url+path

- 前端前置知识(笔记)

codecat_yu

html+css前端

文章目录1.常见浏览器内核2.W3C标准2.2为什么要遵循WEB标准2.2Web标准的好处3.`SEO`优化1.常见浏览器内核浏览器内核css兼容性写法IE、360、百度trident-ms-firefoxGecko-moz-Safariwebkit-webkit-chromewebkit–>blink-webkit-Operablink-o-2.W3C标准万维网联盟(外语缩写:W3C)标准不是某

- RobotFramework打不开谷歌浏览器问题

当你装好了RobotFramework后,准备大干一场,如果你已正确把chromedriver放到python目录或者system32文件夹下,运行打开谷歌浏览器时,可以正常打开浏览器,如下图但是不能输入网址,发现RobotFramework运行日志中报以下错误,那可能是你的chromedriver版本和浏览器版本不兼容造成,更换一下相对应的版本就可以就可以正常运行,目前chromedriver已

- Python-Appium 2.19.0---详细指南:安装Appium

渡己(Sorin)

pythonappium开发语言

引言最近要写个安卓自动化项目,想用Appium来实现,版本已经来到了2.19.0,搜了一圈,发现文档比较少,至少7年没有用过了,有点陌生,打算重新研究下,写成文章分享给有需要的人。作为最流行的移动端自动化测试框架之一,其2.x版本有许多重要的改进和新特性。这篇文章将详细介绍如何在Windows和macOS系统上安装Appium2.19.0版本,并配置Python环境进行自动化测试开发。第一部分:环

- Python 中 BeautifulSoup 的异常处理方法

Python编程之道

pythonbeautifulsoup网络ai

Python中BeautifulSoup的异常处理方法关键词:Python,BeautifulSoup,异常处理,Web解析,HTML解析,XML解析,错误处理摘要:本文深入探讨了Python中BeautifulSoup库在进行HTML和XML解析时的异常处理方法。首先介绍了BeautifulSoup的基本背景和相关概念,接着详细阐述了可能出现的各类异常及其产生原因,通过具体的Python代码示例

- Python 开发:Conda 环境的远程访问配置

Python编程之道

pythonconda开发语言ai

Python开发:Conda环境的远程访问配置关键词:Python、Conda、远程访问、环境管理、SSH、JupyterNotebook、服务器配置摘要:本文详细介绍了如何在远程服务器上配置和管理Conda环境,实现高效的远程Python开发。我们将从基础概念入手,逐步讲解SSH连接、端口转发、JupyterNotebook远程访问等关键技术,并提供完整的配置方案和实战代码示例。文章还涵盖了安全

- Python pip:包的云计算部署

Pythonpip:包的云计算部署关键词:Pythonpip、云计算部署、包管理、虚拟环境、云平台摘要:本文围绕Pythonpip进行包的云计算部署展开深入探讨。首先介绍了Pythonpip在包管理中的重要性以及云计算部署的背景和意义。接着详细阐述了pip的核心概念和工作原理,包括其与Python生态系统的紧密联系。通过具体的Python代码示例,讲解了pip包管理的核心算法原理和操作步骤。同时,

- Python pip配置全局镜像源

Python编程之道

Python人工智能与大数据Python编程之道pythonpip网络ai

Pythonpip配置全局镜像源关键词:Python、pip、全局镜像源、配置、国内镜像摘要:本文详细介绍了Python中pip配置全局镜像源的相关内容。首先阐述了配置全局镜像源的背景和目的,接着解释了核心概念,包括pip和镜像源的原理。然后详细说明了配置全局镜像源的具体操作步骤,包括不同操作系统下的配置方法,并给出了相应的Python代码示例。同时,还讲解了相关的数学模型(虽然在本主题中数学模型

- 60天python训练计划----day51

尘浮728

python开发语言

DAY51复习日作业:day43的时候我们安排大家对自己找的数据集用简单cnn训练,现在可以尝试下借助这几天的知识来实现精度的进一步提高importosimporttorchimporttorch.nnasnnimporttorch.optimasoptimimporttorch.nn.functionalasFimporttorchvisionimporttorchvision.transfor

- 余数定理问题和余数类问题的解法

wangychf

python抽象代数

一、引言Python里面有一个重要的求模运算符号“%”,作为一个小白,实验了好多次求模的运算,发现这个算法不同于一般的四则运算,其运算效率简直可以用神奇来形容。例如以当今知道的最大质数——梅森素数为例,进行求模计算,速度快得惊人。当前知道的最大的梅森素数是第51个梅森素数,也是迄今为止知道的最大的素数。它的表示为:2^82589933–1,如果用十进制打开,这个数有24862048位,是2018年

- python训练60天挑战-day51

DAY51复习日作业:day43的时候我们安排大家对自己找的数据集用简单cnn训练,现在可以尝试下借助这几天的知识来实现精度的进一步提高kaggl的一个图像数据集;数据集地址:LungNoduleMalignancy肺结核良恶性判断三层卷积CNN做到的精度63%,现在需要实现提高。importosimportpandasaspdimportnumpyasnpfromsklearn.model_se

- 【python实用小脚本-126】基于 Python 的 Google Meet 和 Zoom 自动化工具:实现会议自动化加入

引言在远程工作和在线学习日益普及的今天,GoogleMeet和Zoom成为了最常用的视频会议工具。然而,频繁地手动加入会议可能会浪费时间和精力。本文将介绍一个基于Python的自动化工具,能够自动加入GoogleMeet和Zoom会议。该工具主要利用了Python的schedule、webbrowser、pyautogui和pyperclip库,结合了任务调度、网页自动化和屏幕操作技术,为用户提供

- 【python实用小脚本-127】基于 Python 的 Google 图片爬取工具:实现高效图片数据收集

Kyln.Wu

Pythonpython开发语言

引言在数据科学、机器学习和多媒体应用中,图片数据的收集是一个常见且重要的任务。Google图片是一个丰富的图片资源库,能够为各种项目提供大量的图片数据。本文将介绍一个基于Python的Google图片爬取工具,它能够自动化地从Google图片搜索结果中下载图片。该工具主要利用了Python的selenium、BeautifulSoup、urllib和argparse库,结合了网页自动化和数据解析技

- 【python深度学习】DAY 51 复习日

抽风的雨610

【打卡】Python训练营python深度学习开发语言

作业:day43的时候我们安排大家对自己找的数据集用简单cnn训练,现在可以尝试下借助这几天的知识来实现精度的进一步提高1.读取数据使用CIFAR-10图像数据importtorchfromtorchvisionimportdatasets,transforms#数据预处理transform=transforms.Compose([transforms.ToTensor(),transforms.

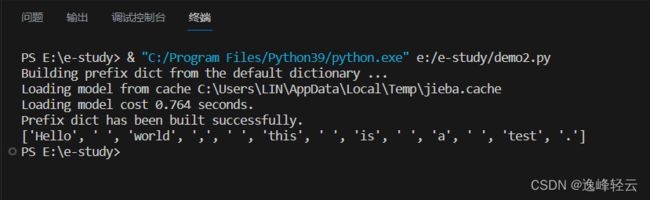

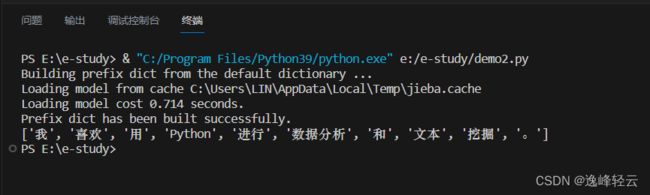

- 使用Python爬虫与自然语言处理技术抓取并分析网页内容

Python爬虫项目

python爬虫自然语言处理javascript数据分析人工智能

1.引言在如今数据驱动的时代,网页爬虫(WebScraping)和自然语言处理(NLP)已成为处理大量网页数据的重要工具。利用Python爬虫抓取网页内容,结合NLP技术进行文本分析和信息抽取,能够从大量网页中提取有价值的信息。无论是新闻文章的情感分析、社交媒体的舆情分析,还是电商网站的商品评论挖掘,这些技术都发挥着至关重要的作用。本文将介绍如何利用Python爬虫与自然语言处理技术抓取并分析网页

- 用Python解锁图像处理之力:从基础到智能应用的深度探索

熊猫钓鱼>_>

python图像处理开发语言

在像素构成的数字世界里,Python已成为解码图像奥秘的核心引擎。一、为何选择Python处理图像?超越工具的本质思考当人们谈论图像处理时,往往会陷入工具对比的漩涡(PythonvsMATLABvsC++)。但Python的真正价值在于其构建的完整生态闭环:科学计算基石:NumPy的ndarray结构完美对应图像的多维矩阵本质算法实现自由:从传统算子到深度学习模型的无缝衔接可视化即战力:Matpl

- vscode添加源文件_VSCode源码自定义笔记-VSCode启动流程分析

weixin_39559079

vscode添加源文件

从开始到窗口加载与所有的Electron应用一样,入口点在package.json文件中定义。"main":"./out/main",说明了入口文件在out/main.js.这个是编译出来的文件,源文件在src/main.js。注意对于TS文件,由于有sourcemap的映射,我们在ts中打断点就可以跳转过来。这里的js应该是编译时候直接拷贝到out目录下的,我们在src下面的文件打断点无效,应该

- VSCode Python 扩展项目教程

翟苹星Trustworthy

VSCodePython扩展项目教程vscode-pythonPythonextensionforVisualStudioCode项目地址:https://gitcode.com/gh_mirrors/vs/vscode-python1.项目的目录结构及介绍VSCodePython扩展项目的目录结构如下:vscode-python/├──config/├──devcontainer/├──gith

- 【Python爬虫进阶】从网页抓取到数据清洗与存储——完整实战教程

Python爬虫项目

python爬虫开发语言javascript自然语言处理selenium

1.为什么网页抓取后需要数据清洗?在实际项目中,抓取的原始数据往往是杂乱的、不完整的、格式各异的。如果不清洗,直接用来建模、分析,会导致:脏数据干扰(如乱码、重复数据)异常值影响结果(如薪资异常高)格式不统一(比如地点有中文名和英文名混杂)所以,抓取数据后,必须进行系统清洗与标准化,才能用于后续的:数据分析可视化展示机器学习建模2.项目概览:从抓取到存储的完整流程本项目流程如下:确定抓取目标(某招

- 分享100个最新免费的高匿HTTP代理IP

mcj8089

代理IP代理服务器匿名代理免费代理IP最新代理IP

推荐两个代理IP网站:

1. 全网代理IP:http://proxy.goubanjia.com/

2. 敲代码免费IP:http://ip.qiaodm.com/

120.198.243.130:80,中国/广东省

58.251.78.71:8088,中国/广东省

183.207.228.22:83,中国/

- mysql高级特性之数据分区

annan211

java数据结构mongodb分区mysql

mysql高级特性

1 以存储引擎的角度分析,分区表和物理表没有区别。是按照一定的规则将数据分别存储的逻辑设计。器底层是由多个物理字表组成。

2 分区的原理

分区表由多个相关的底层表实现,这些底层表也是由句柄对象表示,所以我们可以直接访问各个分区。存储引擎管理分区的各个底层

表和管理普通表一样(所有底层表都必须使用相同的存储引擎),分区表的索引只是

- JS采用正则表达式简单获取URL地址栏参数

chiangfai

js地址栏参数获取

GetUrlParam:function GetUrlParam(param){

var reg = new RegExp("(^|&)"+ param +"=([^&]*)(&|$)");

var r = window.location.search.substr(1).match(reg);

if(r!=null

- 怎样将数据表拷贝到powerdesigner (本地数据库表)

Array_06

powerDesigner

==================================================

1、打开PowerDesigner12,在菜单中按照如下方式进行操作

file->Reverse Engineer->DataBase

点击后,弹出 New Physical Data Model 的对话框

2、在General选项卡中

Model name:模板名字,自

- logbackのhelloworld

飞翔的马甲

日志logback

一、概述

1.日志是啥?

当我是个逗比的时候我是这么理解的:log.debug()代替了system.out.print();

当我项目工作时,以为是一堆得.log文件。

这两天项目发布新版本,比较轻松,决定好好地研究下日志以及logback。

传送门1:日志的作用与方法:

http://www.infoq.com/cn/articles/why-and-how-log

上面的作

- 新浪微博爬虫模拟登陆

随意而生

新浪微博

转载自:http://hi.baidu.com/erliang20088/item/251db4b040b8ce58ba0e1235

近来由于毕设需要,重新修改了新浪微博爬虫废了不少劲,希望下边的总结能够帮助后来的同学们。

现行版的模拟登陆与以前相比,最大的改动在于cookie获取时候的模拟url的请求

- synchronized

香水浓

javathread

Java语言的关键字,可用来给对象和方法或者代码块加锁,当它锁定一个方法或者一个代码块的时候,同一时刻最多只有一个线程执行这段代码。当两个并发线程访问同一个对象object中的这个加锁同步代码块时,一个时间内只能有一个线程得到执行。另一个线程必须等待当前线程执行完这个代码块以后才能执行该代码块。然而,当一个线程访问object的一个加锁代码块时,另一个线程仍然

- maven 简单实用教程

AdyZhang

maven

1. Maven介绍 1.1. 简介 java编写的用于构建系统的自动化工具。目前版本是2.0.9,注意maven2和maven1有很大区别,阅读第三方文档时需要区分版本。 1.2. Maven资源 见官方网站;The 5 minute test,官方简易入门文档;Getting Started Tutorial,官方入门文档;Build Coo

- Android 通过 intent传值获得null

aijuans

android

我在通过intent 获得传递兑现过的时候报错,空指针,我是getMap方法进行传值,代码如下 1 2 3 4 5 6 7 8 9

public

void

getMap(View view){

Intent i =

- apache 做代理 报如下错误:The proxy server received an invalid response from an upstream

baalwolf

response

网站配置是apache+tomcat,tomcat没有报错,apache报错是:

The proxy server received an invalid response from an upstream server. The proxy server could not handle the request GET /. Reason: Error reading fr

- Tomcat6 内存和线程配置

BigBird2012

tomcat6

1、修改启动时内存参数、并指定JVM时区 (在windows server 2008 下时间少了8个小时)

在Tomcat上运行j2ee项目代码时,经常会出现内存溢出的情况,解决办法是在系统参数中增加系统参数:

window下, 在catalina.bat最前面

set JAVA_OPTS=-XX:PermSize=64M -XX:MaxPermSize=128m -Xms5

- Karam与TDD

bijian1013

KaramTDD

一.TDD

测试驱动开发(Test-Driven Development,TDD)是一种敏捷(AGILE)开发方法论,它把开发流程倒转了过来,在进行代码实现之前,首先保证编写测试用例,从而用测试来驱动开发(而不是把测试作为一项验证工具来使用)。

TDD的原则很简单:

a.只有当某个

- [Zookeeper学习笔记之七]Zookeeper源代码分析之Zookeeper.States

bit1129

zookeeper

public enum States {

CONNECTING, //Zookeeper服务器不可用,客户端处于尝试链接状态

ASSOCIATING, //???

CONNECTED, //链接建立,可以与Zookeeper服务器正常通信

CONNECTEDREADONLY, //处于只读状态的链接状态,只读模式可以在

- 【Scala十四】Scala核心八:闭包

bit1129

scala

Free variable A free variable of an expression is a variable that’s used inside the expression but not defined inside the expression. For instance, in the function literal expression (x: Int) => (x

- android发送json并解析返回json

ronin47

android

package com.http.test;

import org.apache.http.HttpResponse;

import org.apache.http.HttpStatus;

import org.apache.http.client.HttpClient;

import org.apache.http.client.methods.HttpGet;

import

- 一份IT实习生的总结

brotherlamp

PHPphp资料php教程php培训php视频

今天突然发现在不知不觉中自己已经实习了 3 个月了,现在可能不算是真正意义上的实习吧,因为现在自己才大三,在这边撸代码的同时还要考虑到学校的功课跟期末考试。让我震惊的是,我完全想不到在这 3 个月里我到底学到了什么,这是一件多么悲催的事情啊。同时我对我应该 get 到什么新技能也很迷茫。所以今晚还是总结下把,让自己在接下来的实习生活有更加明确的方向。最后感谢工作室给我们几个人这个机会让我们提前出来

- 据说是2012年10月人人网校招的一道笔试题-给出一个重物重量为X,另外提供的小砝码重量分别为1,3,9。。。3^N。 将重物放到天平左侧,问在两边如何添加砝码

bylijinnan

java

public class ScalesBalance {

/**

* 题目:

* 给出一个重物重量为X,另外提供的小砝码重量分别为1,3,9。。。3^N。 (假设N无限大,但一种重量的砝码只有一个)

* 将重物放到天平左侧,问在两边如何添加砝码使两边平衡

*

* 分析:

* 三进制

* 我们约定括号表示里面的数是三进制,例如 47=(1202

- dom4j最常用最简单的方法

chiangfai

dom4j

要使用dom4j读写XML文档,需要先下载dom4j包,dom4j官方网站在 http://www.dom4j.org/目前最新dom4j包下载地址:http://nchc.dl.sourceforge.net/sourceforge/dom4j/dom4j-1.6.1.zip

解开后有两个包,仅操作XML文档的话把dom4j-1.6.1.jar加入工程就可以了,如果需要使用XPath的话还需要

- 简单HBase笔记

chenchao051

hbase

一、Client-side write buffer 客户端缓存请求 描述:可以缓存客户端的请求,以此来减少RPC的次数,但是缓存只是被存在一个ArrayList中,所以多线程访问时不安全的。 可以使用getWriteBuffer()方法来取得客户端缓存中的数据。 默认关闭。 二、Scan的Caching 描述: next( )方法请求一行就要使用一次RPC,即使

- mysqldump导出时出现when doing LOCK TABLES

daizj

mysqlmysqdump导数据

执行 mysqldump -uxxx -pxxx -hxxx -Pxxxx database tablename > tablename.sql

导出表时,会报

mysqldump: Got error: 1044: Access denied for user 'xxx'@'xxx' to database 'xxx' when doing LOCK TABLES

解决

- CSS渲染原理

dcj3sjt126com

Web

从事Web前端开发的人都与CSS打交道很多,有的人也许不知道css是怎么去工作的,写出来的css浏览器是怎么样去解析的呢?当这个成为我们提高css水平的一个瓶颈时,是否应该多了解一下呢?

一、浏览器的发展与CSS

- 《阿甘正传》台词

dcj3sjt126com

Part Ⅰ:

《阿甘正传》Forrest Gump经典中英文对白

Forrest: Hello! My names Forrest. Forrest Gump. You wanna Chocolate? I could eat about a million and a half othese. My momma always said life was like a box ochocol

- Java处理JSON

dyy_gusi

json

Json在数据传输中很好用,原因是JSON 比 XML 更小、更快,更易解析。

在Java程序中,如何使用处理JSON,现在有很多工具可以处理,比较流行常用的是google的gson和alibaba的fastjson,具体使用如下:

1、读取json然后处理

class ReadJSON

{

public static void main(String[] args)

- win7下nginx和php的配置

geeksun

nginx

1. 安装包准备

nginx : 从nginx.org下载nginx-1.8.0.zip

php: 从php.net下载php-5.6.10-Win32-VC11-x64.zip, php是免安装文件。

RunHiddenConsole: 用于隐藏命令行窗口

2. 配置

# java用8080端口做应用服务器,nginx反向代理到这个端口即可

p

- 基于2.8版本redis配置文件中文解释

hongtoushizi

redis

转载自: http://wangwei007.blog.51cto.com/68019/1548167

在Redis中直接启动redis-server服务时, 采用的是默认的配置文件。采用redis-server xxx.conf 这样的方式可以按照指定的配置文件来运行Redis服务。下面是Redis2.8.9的配置文

- 第五章 常用Lua开发库3-模板渲染

jinnianshilongnian

nginxlua

动态web网页开发是Web开发中一个常见的场景,比如像京东商品详情页,其页面逻辑是非常复杂的,需要使用模板技术来实现。而Lua中也有许多模板引擎,如目前我在使用的lua-resty-template,可以渲染很复杂的页面,借助LuaJIT其性能也是可以接受的。

如果学习过JavaEE中的servlet和JSP的话,应该知道JSP模板最终会被翻译成Servlet来执行;而lua-r

- JZSearch大数据搜索引擎

颠覆者

JavaScript

系统简介:

大数据的特点有四个层面:第一,数据体量巨大。从TB级别,跃升到PB级别;第二,数据类型繁多。网络日志、视频、图片、地理位置信息等等。第三,价值密度低。以视频为例,连续不间断监控过程中,可能有用的数据仅仅有一两秒。第四,处理速度快。最后这一点也是和传统的数据挖掘技术有着本质的不同。业界将其归纳为4个“V”——Volume,Variety,Value,Velocity。大数据搜索引

- 10招让你成为杰出的Java程序员

pda158

java编程框架

如果你是一个热衷于技术的

Java 程序员, 那么下面的 10 个要点可以让你在众多 Java 开发人员中脱颖而出。

1. 拥有扎实的基础和深刻理解 OO 原则 对于 Java 程序员,深刻理解 Object Oriented Programming(面向对象编程)这一概念是必须的。没有 OOPS 的坚实基础,就领会不了像 Java 这些面向对象编程语言

- tomcat之oracle连接池配置

小网客

oracle

tomcat版本7.0

配置oracle连接池方式:

修改tomcat的server.xml配置文件:

<GlobalNamingResources>

<Resource name="utermdatasource" auth="Container"

type="javax.sql.DataSou

- Oracle 分页算法汇总

vipbooks

oraclesql算法.net

这是我找到的一些关于Oracle分页的算法,大家那里还有没有其他好的算法没?我们大家一起分享一下!

-- Oracle 分页算法一

select * from (

select page.*,rownum rn from (select * from help) page

-- 20 = (currentPag