第二十八章:索引优化与优化查询

第二十八章:索引优化与优化查询

哪些维度可以进行数据库调优

- 索引失效、没有充分利用到索引 —— 索引建立

- 关联查询太多

JOIN(设计缺陷或不得已的需求) ——SQL优化 - 服务器调优及各个参数设置(缓冲、线程数等) —— 调整

my.cnf - 数据过多 —— 分库分表

虽然SQL查询优化的技术有很多,但是大方向上完全可以分成物理查询优化和逻辑查询优化两大块:

- 物理查询优化是通过索引和表连接方式等技术来进行优化,这里重点需要掌握索引的使用。

- 逻辑查询优化就是通过**

SQL等价变换**提升查询效率,直白一点就是说,换一种查询写法执行效率可能更高。

28.1:数据准备

-

建表

CREATE TABLE `class` ( `id` INT(11) NOT NULL AUTO_INCREMENT, `className` VARCHAR(30) DEFAULT NULL, `address` VARCHAR(40) DEFAULT NULL, `monitor` INT NULL , PRIMARY KEY (`id`) ) ENGINE=INNODB AUTO_INCREMENT=1 DEFAULT CHARSET=utf8; CREATE TABLE `student` ( `id` INT(11) NOT NULL AUTO_INCREMENT, `stuno` INT NOT NULL , `name` VARCHAR(20) DEFAULT NULL, `age` INT(3) DEFAULT NULL, `classId` INT(11) DEFAULT NULL, PRIMARY KEY (`id`) ) ENGINE=INNODB AUTO_INCREMENT=1 DEFAULT CHARSET=utf8; -

防止创建存储函数报错

SET GLOBAL log_bin_trust_function_creators=1; -

创建存储函数

#随机产生字符串 DELIMITER // CREATE FUNCTION rand_string(n INT) RETURNS VARCHAR(255) BEGIN DECLARE chars_str VARCHAR(100) DEFAULT 'abcdefghijklmnopqrstuvwxyzABCDEFJHIJKLMNOPQRSTUVWXYZ'; DECLARE return_str VARCHAR(255) DEFAULT ''; DECLARE i INT DEFAULT 0; WHILE i < n DO SET return_str =CONCAT(return_str,SUBSTRING(chars_str,FLOOR(1+RAND()*52),1)); SET i = i + 1; END WHILE; RETURN return_str; END // DELIMITER ; #用于随机产生多少到多少的编号 DELIMITER // CREATE FUNCTION rand_num (from_num INT ,to_num INT) RETURNS INT(11) BEGIN DECLARE i INT DEFAULT 0; SET i = FLOOR(from_num +RAND()*(to_num - from_num+1)); RETURN i; END // DELIMITER ; -

创建存储过程

#创建往stu表中插入数据的存储过程 DELIMITER // CREATE PROCEDURE insert_stu( START INT , max_num INT ) BEGIN DECLARE i INT DEFAULT 0; SET autocommit = 0; #设置手动提交事务 REPEAT #循环 SET i = i + 1; #赋值 INSERT INTO student (stuno, NAME, age, classId ) VALUES ((START+i), rand_string(6), rand_num(1,50), rand_num(1,1000)); UNTIL i = max_num END REPEAT; COMMIT; #提交事务 END // DELIMITER ; #执行存储过程,往class表添加随机数据 DELIMITER // CREATE PROCEDURE `insert_class`( max_num INT ) BEGIN DECLARE i INT DEFAULT 0; SET autocommit = 0; REPEAT SET i = i + 1; INSERT INTO class ( classname,address,monitor ) VALUES (rand_string(8),rand_string(10),rand_num(1,100000)); UNTIL i = max_num END REPEAT; COMMIT; END // DELIMITER ; -

执行存储过程

#执行存储过程,往class表添加1万条数据 CALL insert_class(10000); #执行存储过程,往stu表添加50万条数据 CALL insert_stu(100000,500000);

28.2:索引失效案例

MySQL中提高性能的一个最有效的方式是对数据表设计合理的索引。索引提供了高效访问数据的方法,并且加快查询的速度,因此索引对查询的速度有着至关重要的影响。

- 使用索引可以快速地定位表中的某条记录,从而提高数据库查询的速度,提高数据库的性能。

- 如果查询时没有使用索引,查询语句就会扫描表中的所有记录。在数据量大的情况下,这样查询的速度会很慢。

其实,用不用索引,最终都是优化器说了算。优化器是基于什么的优化器?基于cost开销(CostBaseOptimizer),它不是基于规则(Rule-BasedOptimizer),也不是基于语义。怎么样开销小就怎么来。另外,SQL语句是否使用索引,跟数据库版本、数据量、数据选择度都有关系。

-

全值匹配我最爱

# 没有索引时运行与下面的创建索引后运行会发现执行时间的变化 EXPLAIN SELECT SQL_NO_CACHE * FROM student WHERE age=30; EXPLAIN SELECT SQL_NO_CACHE * FROM student WHERE age=30 AND classId=4; EXPLAIN SELECT SQL_NO_CACHE * FROM student WHERE age=30 AND classId=4 AND NAME = 'abcd'; # 创建索引 CREATE INDEX idx_age ON student(age); CREATE INDEX idx_age_classid ON student(age,classId); CREATE INDEX idx_age_classid_name ON student(age,classId,NAME); -

最佳左前缀法则

在

MySQL建立联合索引时会遵守最佳左前缀匹配原则,即最左优先,在检索数据时从联合索引的最左边开始匹配。# 删除全值匹配建立的索引 DROP INDEX idx_age ON student; DROP INDEX idx_age_classid ON student; # 只有第三条sql才能使用索引 EXPLAIN SELECT SQL_NO_CACHE * FROM student WHERE student.age=30 AND student.name = 'abcd' ; EXPLAIN SELECT SQL_NO_CACHE * FROM student WHERE student.classid=1 AND student.name = 'abcd'; EXPLAIN SELECT SQL_NO_CACHE * FROM student WHERE classid=4 AND student.age=30 AND student.name = 'abcd'; -

主键插入顺序

对于一个使用

InnoDB存储引擎的表来说,在我们没有显式的创建索引时,表中的数据实际上都是存储在聚簇索引的叶子节点的。而记录又是存储在数据页中的,数据页和记录又是按照记录主键值从小到大的顺序进行排序,所以如果我们插入的记录的主键值是依次增大的话,那我们每插满一个数据页就换到下一个数据页继续插,而如果我们插入的主键值忽大忽小的话,就比较麻烦了,假设某个数据页存储的记录已经满了,它存储的主键值在1~100之间:

如果此时再插入一条主键值为9的记录,那它插入的位置就如下图:

可这个数据页已经满了,再插进来咋办呢?我们需要把当前页面分裂成两个页面,把本页中的一些记录移动到新创建的这个页中。页面分裂和记录移位意味着什么?意味着:性能损耗!所以如果我们想尽量避免这样无谓的性能损耗,最好让插入的记录的主键值依次递增,这样就不会发生这样的性能损耗了。所以我们建议:让主键具有

AUTO_INCREMENT,让存储引擎自己为表生成主键,而不是我们手动插入。 -

计算、函数、类型转换(自动或手动)导致索引失效

# 创建索引 CREATE INDEX idx_name ON student(NAME); # 第一条sql能使用idx_name索引,第二条sql不行 EXPLAIN SELECT SQL_NO_CACHE * FROM student WHERE student.name LIKE 'abc%'; EXPLAIN SELECT SQL_NO_CACHE * FROM student WHERE LEFT(student.name,3) = 'abc'; # 创建索引 CREATE INDEX idx_sno ON student(stuno); # 第二条sql能使用idx_sno索引,第一条sql不行 EXPLAIN SELECT SQL_NO_CACHE id, stuno, NAME FROM student WHERE stuno+1 = 900001; EXPLAIN SELECT SQL_NO_CACHE id, stuno, NAME FROM student WHERE stuno = 900000; # 不能使用索引 EXPLAIN SELECT id, stuno, NAME FROM student WHERE SUBSTRING(NAME, 1,3)='abc'; -

类型转换导致索引失效

# 第二条sql能使用idx_name索引,第一条sql不行 EXPLAIN SELECT SQL_NO_CACHE * FROM student WHERE NAME = 123; EXPLAIN SELECT SQL_NO_CACHE * FROM student WHERE NAME = '123'; -

范围条件右边的列索引失效

# 删除可能对下面sql产生干扰的索引 ALTER TABLE student DROP INDEX idx_name; # 使用idx_age_classid_name索引的len为10,而使用idx_age_name_cid索引的len为63 EXPLAIN SELECT SQL_NO_CACHE * FROM student WHERE student.age=30 AND student.classId>20 AND student.name = 'abc' ; # 新建索引 CREATE INDEX idx_age_name_cid ON student(age,NAME,classId); -

不等于

(!= 或者 <>)索引失效# 新建索引 CREATE INDEX idx_name ON student(NAME); # 下面两条sql都无法使用索引 EXPLAIN SELECT SQL_NO_CACHE * FROM student WHERE student.name <> 'abc' ; EXPLAIN SELECT SQL_NO_CACHE * FROM student WHERE student.name != 'abc' ; -

is null可以使用使用索引,is not null无法使用索引# 可以使用索引 EXPLAIN SELECT SQL_NO_CACHE * FROM student WHERE age IS NULL; # 不能使用索引 EXPLAIN SELECT SQL_NO_CACHE * FROM student WHERE age IS NOT NULL; -

like以通配符%开头索引失效# 可以使用索引 EXPLAIN SELECT SQL_NO_CACHE * FROM student WHERE NAME LIKE 'ab%'; # 不能使用索引 EXPLAIN SELECT SQL_NO_CACHE * FROM student WHERE NAME LIKE '%ab%'; -

OR前后存在非索引的列,索引失效 在

WHERE子句中,如果在OR前的条件列进行了索引,而在OR后的条件列没有进行索引,那么索引也会失效。也就是说,OR前后的两个条件中的列都是索引时,查询中才能使用索引。# 只建立一个索引 CREATE INDEX idx_age ON student(age); # 无法使用索引,只有建立下面的一个索引,才能使用索引 EXPLAIN SELECT SQL_NO_CACHE * FROM student WHERE age = 10 OR classid = 100; CREATE INDEX idx_cid ON student(classid); -

数据库和表的字符集统一使用

utf8mb4 统一使用

uft8mb4(5.5.3版本以上支持)兼容性更好,统一字符集可以避免由于字符集转换产生的乱码。不同的字符集进行比较前需要进行转换会造成索引失效。

28.3:关联查询优化

-

数据准备

#分类 CREATE TABLE IF NOT EXISTS `type` ( `id` INT(10) UNSIGNED NOT NULL AUTO_INCREMENT, `card` INT(10) UNSIGNED NOT NULL, PRIMARY KEY (`id`) ); #图书 CREATE TABLE IF NOT EXISTS `book` ( `bookid` INT(10) UNSIGNED NOT NULL AUTO_INCREMENT, `card` INT(10) UNSIGNED NOT NULL, PRIMARY KEY (`bookid`) ); #向分类表中添加20条记录 INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); #向图书表中添加20条记录 INSERT INTO book(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO book(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO book(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO book(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO book(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO book(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO book(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO book(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO book(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO book(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO book(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO book(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO book(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO book(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO book(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO book(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO book(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO book(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO book(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO book(card) VALUES(FLOOR(1 + (RAND() * 20))); -

采用左外连接

EXPLAIN SELECT SQL_NO_CACHE * FROM `type` LEFT JOIN book ON type.card = book.card; #添加索引 CREATE INDEX Y ON book(card); EXPLAIN SELECT SQL_NO_CACHE * FROM `type` LEFT JOIN book ON type.card = book.card; CREATE INDEX X ON `type`(card); EXPLAIN SELECT SQL_NO_CACHE * FROM `type` LEFT JOIN book ON type.card = book.card; DROP INDEX Y ON book; EXPLAIN SELECT SQL_NO_CACHE * FROM `type` LEFT JOIN book ON type.card = book.card; -

采用内连接

DROP INDEX X ON `type`; EXPLAIN SELECT SQL_NO_CACHE * FROM `type` INNER JOIN book ON type.card = book.card; #添加索引 CREATE INDEX Y ON book(card); EXPLAIN SELECT SQL_NO_CACHE * FROM `type` INNER JOIN book ON type.card = book.card; CREATE INDEX X ON `type`(card); #结论:对于内连接来说,查询优化器可以决定谁作为驱动表,谁作为被驱动表出现的 EXPLAIN SELECT SQL_NO_CACHE * FROM `type` INNER JOIN book ON type.card = book.card; #删除索引 DROP INDEX Y ON book; #结论:对于内连接来讲,如果表的连接条件中只能有一个字段有索引,则有索引的字段所在的表会被作为被驱动表出现。 EXPLAIN SELECT SQL_NO_CACHE * FROM `type` INNER JOIN book ON type.card = book.card; CREATE INDEX Y ON book(card); EXPLAIN SELECT SQL_NO_CACHE * FROM `type` INNER JOIN book ON type.card = book.card; #向type表中添加数据(20条数据) INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); INSERT INTO `type`(card) VALUES(FLOOR(1 + (RAND() * 20))); #结论:对于内连接来说,在两个表的连接条件都存在索引的情况下,会选择小表作为驱动表。“小表驱动大表” EXPLAIN SELECT SQL_NO_CACHE * FROM `type` INNER JOIN book ON type.card = book.card; -

join语句原理

join方式连接多个表,本质就是各个表之间数据的循环匹配。MySQL5.5版本之前,MySQL只支持一种表间关联方式,就是嵌套循环(Nested Loop Join)。如果关联表的数据量很大,则join关联的执行时间会非常长。在MySQL5.5以后的版本中,MySQL通过引入BNLJ算法来优化嵌套执行。-

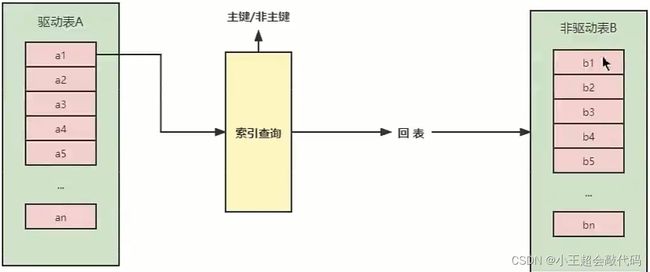

驱动表和被驱动表:上边是驱动表、下边是被驱动表。驱动表是主表,被驱动表就是从表、非驱动表。

# 对于外连接和内连接来说,谁是驱动表,谁是被驱动表示优化器说了算的,并不是按照sql书写表名的先后顺序 # 建表 CREATE TABLE a(f1 INT, f2 INT, INDEX(f1))ENGINE=INNODB; CREATE TABLE b(f1 INT, f2 INT)ENGINE=INNODB; # 插入数据 INSERT INTO a VALUES(1,1),(2,2),(3,3),(4,4),(5,5),(6,6); INSERT INTO b VALUES(3,3),(4,4),(5,5),(6,6),(7,7),(8,8); #测试1 EXPLAIN SELECT * FROM a LEFT JOIN b ON(a.f1=b.f1) WHERE (a.f2=b.f2); #测试2 EXPLAIN SELECT * FROM a LEFT JOIN b ON(a.f1=b.f1) AND (a.f2=b.f2); #测试3 EXPLAIN SELECT * FROM a JOIN b ON(a.f1=b.f1) WHERE (a.f2=b.f2); -

简单嵌套循环连接(

Simple Nested-Loop Join) 算法相当简单,从表

A中取出一条数据1,遍历表B,将匹配到的数据放到result...以此类推,驱动表A中的每一条记录与被驱动表B的记录进行判断。

可以看到这种方式效率是非常低的,以上述表

A数据100条,表B数据1000条计算,则A * B=10万次。开销统计如下:开销统计 SNLJ 外表扫描次数 1 内标扫描次数 A 读取记录数 A + B * AJOIN比较次数A * B回表读取记录次数 0 -

索引嵌套循环连接(

Index Nested-Loop Join)

Index Nested-Loop Join其优化器的思路主要是为了减少内层表数据的匹配次数,所以要求被驱动表上必须有索引才行。通过外层匹配条件直接与内层索引进行匹配,避免和内层表的每条记录去进行比较,这样极大的减少了对内层的匹配次数。

驱动表中的每条记录通过被驱动表的索引进行访问,因为索引查询的成本是比较固定的,故

MySQL优化器都倾向于使用记录数少的表作为驱动表(外表)。开销统计 SNLJ INLJ 外表扫描次数 1 1 内表扫描次数 A 0 读取记录数 A + B * AA + B(match)JOIN比较次数B * AA * Index(Height)回表读取记录次数 0 B(match) (if possible) -

块嵌套循环连接(

Block Nested-Loop Join) 如果存在索引,那么会使用

index的方式进行join,如果join的列没有索引,被驱动表要扫描的次数太多了。每次访问被驱动表,其表中的记录都会被加载到内存中,然后再从驱动表中取一条与其匹配,匹配结束后清除内存,然后再从驱动表中加载一条记录,然后把被驱动表的记录在加载到内存匹配,这样周而复始,大大增加了IO的次数。为了减少被驱动表的IO次数,就出现了Block Nested-Loop Join的方式。 不再是逐条获取驱动表的数据,而是一块一块的获取,引入了

join buffer缓冲区,将驱动表join相关的部分数据列(大小受join buffer的限制)缓存到join buffer中,然后全表扫描被驱动表,被驱动表的每一条记录一次性和join buffer中的所有驱动表记录进行匹配(内存中操作),将简单嵌套循环中的多次比较合并成一次,降低了被驱动表的访问频率。

-

| 开销统计 | SNLJ | INLJ | BNLJ |

|---|---|---|---|

| 外表扫描次数 | 1 | 1 | 1 |

| 内表扫描次数 | A | 0 | A * used_column_size / join_buffer_size + 1 |

| 读取记录数 | A + B * A |

A + B(match) |

A + B * (A * used_column_size / join_buffer_size) |

JOIN比较次数 |

B * A |

A * Index(Height) |

B * A |

| 回表读取记录次数 | 0 | B(match)(if possible) |

0 |

参数设置

-

block_nested_loop通过

show variables like '%optimizer_switch%'查看block_nested_loop状态。默认是开启的。 -

join_buffer_size 驱动表能不能一次加载完,要看

join buffer能不能存储所有的数据,默认情况下join_buffer_size=256K。

join_buffer_size的最大值在32位系统可以申请4G,而在64位操作系统下可以申请大于4G的Join Buffer空间。(64位Windows除外,其大值会被截断为4GB并发出警告)。-

Hash Join从

MySQL的8.0.20版本开始将废弃BNLJ,因为从MySQL8.0.18版本开始就加入了hash join默认都会使用hash join。-

Nested Loop:对于被连接的数据子集较小的情况,Nested Loop是个较好的选择。 -

Hash Join,是做大数据集连接时的常用方式,优化器使用两个表中较小(相对较小)的表利用Join Key在内存中建立散列表,然后扫描较大的表并探测散列表,找出与Hash表匹配的行。- 这种方式适用于较小的表完全可以放于内存中的情况,这样总成本就是访问两个表的成本之和。

- 在表很大的情况下并不能完全放入内存,这时优化器会将它分割成若干不同的分区,不能放入内存的部分就把该分区写入磁盘的临时段,此时要求有较大的临时段从而尽量提高

IO的性能。 - 它能够很好的工作于没有索引的大表和并行查询的环境中,并提供最好的性能。大多数人都说它是

Join的重型升降机。Hash Join,只能应用于等值连接(如WHERE A.COL1 = B.COL2),这是由Hash的特点决定的。

类别 Nested Loop Hash Join 使用条件 任何条件 等值连接(=) 相关资源 CPU、磁盘IO内存、临时空间 相关资源 当有高选择性索引或进行限制性搜索时效率比较高,能够快速返回第一次的搜索结果 当缺乏索引或者索引条件模糊时, Hash Join比Nested Loop有效。在数据仓库环境下,如果表的记录数多,效率高。缺点 当索引丢失或者查询条件限制不够时,效率很低,当表的记录数多时,效率低。 为建立哈希表,需要大量内存。第一次的结果返回较慢。

-

-

28.4:子查询优化

MySQL从4.1版本开始支持子查询,使用子查询可以进行SELECT语句的嵌套查询,即一个SELECT查询的结果作为另一个SELECT语句的条件。子查询可以一次性完成很多逻辑上需要步骤才能完成的SQL操作。

**子查询是MySQL的一项重要的功能,可以帮助我们通过一个SQL语句实现比较复杂的查询。但是,子查询的执行效率不高。**原因:

- 执行子查询时,

MySQL需要为内层查询语句的查询结果建立一个临时表,然后外层查询语句从临时表中查询记录。查询完毕后,在撤销这些临时表。这样会消耗过多的CPU和IO资源,产生大量的慢查询。 - 子查询的结果集存储的临时表,不论是内存临时表还是磁盘临时表都不会存在索引,所以查询性能会受到一定的影响。

- 对于返回结果集比较大的子查询,其对查询性能的影响也就越大。

在MySQL中,可以使用连接JOIN查询来替代子查询。连接查询不需要建立临时表,其速度比子查询要快,如果查询中使用索引的话,性能就会更好。

28.5:排序优化

-

排序优化

在

MySQL中,支持两种排序方式,分别是FileSort和Index排序。Index排序中,索引可以保证数据的有序性,不需要再进行排序,效率更高。FileSort排序则一般在内存中进行排序,占用CPU较多。如果待排结果较大,会产生临时文件I/O到磁盘进行排序的情况,效率较低。

优化建议:

SQL中,可以在WHERE子句和ORDER BY子句中使用索引,目的是在WHERE子句中避免全表扫描,在ORDER BY子句避免使用FileSort排序。当前,某些情况下全表扫描,或者FileSort排序不一定比索引慢。但总的来说,我们还是要避免,以提高查询效率。- 尽量使用

Index完成ORDER BY排序。如果WHERE和ORDER BY后面是相同的列就是用单索引列,如果不同就是用联合索引。 - 无法使用

Index时,需要对FileSort方式进行调优。

#删除student和class表中的非主键索引 DROP INDEX idx_cid ON student; DROP INDEX idx_age ON student; DROP INDEX idx_name ON student; DROP INDEX idx_age_name_cid ON student; DROP INDEX idx_sno ON student; DROP INDEX idx_age_classid_name ON student; DROP INDEX idx_monitor ON class; SHOW INDEX FROM student; SHOW INDEX FROM class; #过程一:没有索引,不使用索引 EXPLAIN SELECT SQL_NO_CACHE * FROM student ORDER BY age,classid; EXPLAIN SELECT SQL_NO_CACHE * FROM student ORDER BY age,classid LIMIT 10; #过程二:order by时不limit,索引失效 #创建索引 CREATE INDEX idx_age_classid_name ON student (age,classid,NAME); #不限制,索引失效 EXPLAIN SELECT SQL_NO_CACHE * FROM student ORDER BY age,classid; #增加limit过滤条件,使用上索引了。 EXPLAIN SELECT SQL_NO_CACHE * FROM student ORDER BY age,classid LIMIT 10; #过程三:order by时顺序错误,索引失效 #创建索引age,classid,stuno CREATE INDEX idx_age_classid_stuno ON student (age,classid,stuno); # 第三条和第四条sql使用了索引 EXPLAIN SELECT * FROM student ORDER BY classid LIMIT 10; EXPLAIN SELECT * FROM student ORDER BY classid,NAME LIMIT 10; EXPLAIN SELECT * FROM student ORDER BY age,classid,stuno LIMIT 10; EXPLAIN SELECT * FROM student ORDER BY age,classid LIMIT 10; EXPLAIN SELECT * FROM student ORDER BY age LIMIT 10; #过程四:order by时规则不一致, 索引失效 (顺序错,不索引;方向反,不索引) # 第4条sql使用了索引 EXPLAIN SELECT * FROM student ORDER BY age DESC, classid ASC LIMIT 10; EXPLAIN SELECT * FROM student ORDER BY classid DESC, NAME DESC LIMIT 10; EXPLAIN SELECT * FROM student ORDER BY age ASC,classid DESC LIMIT 10; EXPLAIN SELECT * FROM student ORDER BY age DESC, classid DESC LIMIT 10; #过程五:无过滤,不索引 # 第一条、第二条、第三条都使用了索引 EXPLAIN SELECT * FROM student WHERE age=45 ORDER BY classid; EXPLAIN SELECT * FROM student WHERE age=45 ORDER BY classid,NAME; EXPLAIN SELECT * FROM student WHERE classid=45 ORDER BY age; EXPLAIN SELECT * FROM student WHERE classid=45 ORDER BY age LIMIT 10; # 总结 INDEX a_b_c(a,b,c) #order by 能使用索引最左前缀 - ORDER BY a - ORDER BY a,b - ORDER BY a,b,c - ORDER BY a DESC,b DESC,c DESC # 如果WHERE使用索引的最左前缀定义为常量,则order by 能使用索引 - WHERE a = const ORDER BY b,c - WHERE a = const AND b = const ORDER BY c - WHERE a = const ORDER BY b,c - WHERE a = const AND b > const ORDER BY b,c # 不能使用索引进行排序 - ORDER BY a ASC,b DESC,c DESC /* 排序不一致 */ - WHERE g = const ORDER BY b,c /*丢失a索引*/ - WHERE a = const ORDER BY c /*丢失b索引*/ - WHERE a = const ORDER BY a,d /*d不是索引的一部分*/ - WHERE a in (...) ORDER BY b,c /*对于排序来说,多个相等条件也是范围查询*/ -

案例实战

#实战:测试filesort和index排序 DROP INDEX idx_age_classid_name ON student; DROP INDEX idx_age_classid_stuno ON student; EXPLAIN SELECT SQL_NO_CACHE * FROM student WHERE age = 30 AND stuno <101000 ORDER BY NAME ; #方案一: 为了去掉filesort我们可以把索引建成 CREATE INDEX idx_age_name ON student(age,NAME); EXPLAIN SELECT SQL_NO_CACHE * FROM student WHERE age = 30 AND stuno <101000 ORDER BY NAME ; #方案二: CREATE INDEX idx_age_stuno_name ON student(age,stuno,NAME); EXPLAIN SELECT SQL_NO_CACHE * FROM student WHERE age = 30 AND stuno <101000 ORDER BY NAME ;- 两个索引同时存在,

mysql自动选择最优的方案。但是,随着数据量的变化,选择的索引也会随之变化的。 - 当【范围条件】和【

group by或者order by】的字段出现二选一时,优先观察条件字段的过滤数量,如果过滤的数据足够多,而需要排序的数据并不多时,优先把索引放在范围字段上。反之,亦然。

- 两个索引同时存在,

-

filesort算法:双路排序和单路排序排序的字段若如果不在索引列上,则

filesorts会有两种算法:双路排序和单路排序。-

双路排序(慢)

MySQL4.1之前是使用双路排序,字面意思就是两次扫描磁盘,最终得到数据,读取行指针和order by列,对他们进行排序,然后扫描已经排序好的列表,按照列表中的值重新从列表中读取对应的数据输出。- 从磁盘取排序字段,在

buffer进行排序,再从磁盘取其他字段。

取一批数据,要对磁盘进行两次扫描,众所周知,

IO是很耗时的,所以在mysql4.1之后,出现了第二种改进的算法,就是单路排序。 -

单路排序(快)

- 从磁盘读取查询需要的所有列,按照

order by列在buffer对它们进行排序,然后扫描排序后的列表进行输出,它的效率更快一些,避免了第二次读取数据。并且把随机IO变成了顺序IO,但是它会使用更多的空间,因为它把每一行都保存在内存中了。

- 从磁盘读取查询需要的所有列,按照

-

结论及引申出的问题

- 由于单路是后出的,总体而言好过双路

- 但是用单路有问题

- 在

sort_buffer中,单路比多路要多占用很多空间,因为单路是把所有字段都取出,所以有可能取出的数据的

总大小超出了sort_buffer的容量,导致每次只能取sort_buffer容量大小的数据,进行排序(创建tmp文

件,多路合并),排完再取sort_buffer容量大小,再排……从而多次IO。 - 单路本来想省一次

IO操作,反而导致了大量的I/O操作,反而得不偿失。

- 在

-

优化策略

-

尝试提高

sort_buffer_size不管用哪种算法,提高这个参数都会提高效率,要根据系统的能力去提高,因为这个参数是针对每个进程(

connection)的1M-8M之间调整。MySQL5.7 InnoDB存储引擎默认值是1048576字节,1MB。SHOW VARIABLES LIKE '%sort_buffer_size%'; -

尝试提高

max_length_for_sort_data提高这个参数,会增加用改进算法的概率。

SHOW VARIABLES LIKE '%max_length_for_sort_data%'; #默认1024字节 但是如果设的太高,数据总容量超出

sort_buffer_size的概率就增大,明显症状是高的磁盘IO活动和低的处理器使用率。如果需要返回的列的总长度大于max_length_for_sort_data,使用双路算法,否则使用单路算法。1024-8192字节之间调整。 -

Order by时select *是一个大忌。最好只Query需要的字段。原因- 当

Query的字段大小总和小于max_length_for_sort_data,而且排序字段不是TEXT | BLOB类型时,会用改进后的算法——单路排序,否则用老算法——多路排序。 - 两种算法的数据都有可能超出

sort_buffer_size的容量,超出之后,会创建tmp文件进行合并排序,导致多次I/O,但是用单路排序算法的风险会更大一些,所以要提高sort_buffer_size。

- 当

-

-

28.6:BROUP BY优化

group by使用索引的原则几乎跟order by一致,group by即使没有使用过滤条件用到索引,也可以直接使用索引。group by先排序再分组,遵照索引建的最佳左前缀法则。- 当无法使用索引列,增大

max_length_for_sort_data和sort_buffer_size参数的设置。 where效率高于having,能写在where限定的条件就不要写在having中了。- 减少使用

order by,和业务沟通能不排序就不排序,或将排序放到程序端去做。Order by、group by、distince这些语句较为耗费CPU,数据库的CPU资源是及其宝贵的。 - 包含了

order by、group by、distinct这些查询的语句,where条件过滤出来的结果集请保持在1000行以内,否则SQL会很慢。

28.7:优化分页查询

一般分页查询时,通过创建覆盖索引能够比较好地提高性能。一个常见又非常头疼的问题就是limit 2000000, 10,此时需要MySQL排序前2000010记录,仅仅返回2000000-2000010的记录,其他记录丢弃,查询排序的代价非常大。

EXPLAIN SELECT * FROM student LIMIT 2000000, 10;

-

优化思路一

在索引上完成排序分页操作,最后根据主键关联回原表查询所需要的其他列内容。

EXPLAIN SELECT * FROM student t, (SELECT id FROM student ORDER BY id LIMIT 2000000, 10) a WHERE t.id = a.id; -

优化思路二

该方案适用于主键自增的表,可以把

LIMIT查询转换成某个位置的查询。EXPLAIN SELECT * FROM student WHERE id > 2000000 LIMIT 10;

28.8:优先考虑覆盖索引

-

什么是覆盖索引

-

理解方式一:

索引是高效找到行的一个方法,但是一般数据库也能使用索引找到一个列的数据,因此它不必读取整个行。毕竟索引叶子节点存储他们索引的数据,当能通过读取索引就可以得到想要的数据,那就不需要读取行了。一个索引包含了满足查询结果的数据叫做覆盖索引。

-

理解方式二:

非聚簇复合索引的一种形式,它包括在查询里的

SELECT、JOIN和WHERE子句用到的所有列(即建索引的字段正好是覆盖查询条件中所涉及的字段)。

简单说就是,索引列+主键包含

SELECT到FROM之间查询的列。#删除之前的索引 DROP INDEX idx_age_name ON student; DROP INDEX idx_age_stuno_name ON student; # 创建索引 CREATE INDEX idx_age_name ON student (age,NAME); #举例1:第一条sql没有用到索引,第二条sql用到索引 EXPLAIN SELECT * FROM student WHERE age <> 20; EXPLAIN SELECT age,NAME FROM student WHERE age <> 20; #举例2:第一条sql没有用到索引,第二条sql用到索引 EXPLAIN SELECT * FROM student WHERE NAME LIKE '%abc'; EXPLAIN SELECT id,age FROM student WHERE NAME LIKE '%abc'; -

-

覆盖索引的利弊

-

好处

-

避免

Innodb表进行索引的二次查询(回表)

Innodb是以聚集索引的顺序来存储的,对于Innodb来说,二级索引在叶子节点中所保存的是行的主键信息,如果使用二级索引查询数据,在查找到相应的键值后,还需要通过主键进行二次查询才能获取我们真实所需要的数据。 在覆盖索引中,二级索引的键值中可以获取所要的数据,避免了对主键的二次查询,减少了

IO操作,提升了查询效率。 -

可以把随机

IO变成顺序IO加快查询效率 由于覆盖索引是按键值的顺序存储的,对于

IO密集型的范围查找来说,对比随机从磁盘读取每一行的数据IO要少的多,因此利用覆盖索引在访问时也可以把磁盘的随机读取的IO转变成索引查找的顺序IO。 由于覆盖索引可以减少树的搜索次数,显著提升查询性能,所以使用覆盖索引是一个常用的性能优化手段。

-

-

弊端

索引字段的维护总是有代价的。因此,在建立冗余索引来支持覆盖索引时就需要权衡考虑了。

-

28.9:索引下推

-

使用前后对比

Index Condition Pushdown(ICP)是MySQL 5.6中新特性,是一种在存储引擎层使用索引过滤数据的优化方式。-

如果没有

ICP,存储引擎会遍历索引以定位基表中的行,并将他们返回给MySQL服务器,由MySQL服务器评估WHERE后面的条件是否保留行。 -

启动

ICP后,如果部分WHERE条件可以仅使用索引中的列进行筛选,则MySQL服务器会把这部分WHERE条件放到存储引擎筛选。然后,存储引擎通过使用索引条目来筛选数据,并且只有在满足这一条件时才从表中读取行。 好处:

ICP可以减少存储引擎必须访问基表的次数和MySQL服务器必须访问存储引擎的次数。但是,ICP的加速效果取决于在存储引擎内通过**ICP筛选**掉的数据的比例。

-

-

ICP的开启、关闭默认情况下启动索引条件下推。可以通过设置系统变量

optimizer_switch控制:index_condition_pushdown# 关闭索引下推 SET optimizer_switch = 'index_condition_pushdown=off'; # 打开索引下推 SET optimizer_switch = 'index_condition_pushdown=on'; -

代码测试

use atguigu1; # 举例1:使用了索引下推 EXPLAIN SELECT * FROM s1 WHERE key1 > 'z' AND key1 LIKE '%a'; #举例2: CREATE TABLE `people` ( `id` INT NOT NULL AUTO_INCREMENT, `zipcode` VARCHAR(20) COLLATE utf8_bin DEFAULT NULL, `firstname` VARCHAR(20) COLLATE utf8_bin DEFAULT NULL, `lastname` VARCHAR(20) COLLATE utf8_bin DEFAULT NULL, `address` VARCHAR(50) COLLATE utf8_bin DEFAULT NULL, PRIMARY KEY (`id`), KEY `zip_last_first` (`zipcode`,`lastname`,`firstname`) ) ENGINE=INNODB AUTO_INCREMENT=5 DEFAULT CHARSET=utf8mb3 COLLATE=utf8_bin; INSERT INTO `people` VALUES ('1', '000001', '三', '张', '北京市'), ('2', '000002', '四', '李', '南京市'), ('3', '000003', '五', '王', '上海市'), ('4', '000001', '六', '赵', '天津市'); # 使用了索引下推 EXPLAIN SELECT * FROM people WHERE zipcode='000001' AND lastname LIKE '%张%' AND address LIKE '%北京市%'; #使用索引下推和不使用索引下推的对比 #创建存储过程 DELIMITER // CREATE PROCEDURE insert_people( max_num INT ) BEGIN DECLARE i INT DEFAULT 0; SET autocommit = 0; REPEAT SET i = i + 1; INSERT INTO people (zipcode, firstname, lastname, address) VALUES ('000001', '六', '赵', '天津市'); UNTIL i = max_num END REPEAT; COMMIT; END // DELIMITER ; # 调用存储过程 CALL insert_people(1000000); # 使用索引下推时执行时间为259ms SELECT * FROM people WHERE zipcode='000001' AND lastname LIKE '%张%'; # 关闭索引下推 SET optimizer_switch = 'index_condition_pushdown=on'; # 不使用索引下推时执行时间为2940ms SELECT * FROM people WHERE zipcode='000001' AND lastname LIKE '%张%'; -

ICP的使用条件- 如果访问的类型为

range、ref、eq_ref和ref_or_null可以使用ICP。 ICP可以用于InnoDB和MyISAM表,包括分区表InnoDB和MyISAM表。- 对于

InnoDB表,ICP仅用于二级索引。ICP的目标是减少全行读取次数,从而减少I/O操作。 - 当

SQL使用覆盖索引时,不支持ICP。因为这种情况下使用ICP不会减少I/O。 - 相关子查询的条件不能使用

ICP。

- 如果访问的类型为

28.10:其他查询优化策略

-

EXISTS和IN的区分索引是个前提,其实选择与否还是要看表的大小。你可以将选择的标准理解为小表驱动大表。在这种方式下效率是最高的。

# B小于A时使用 SELECT * FROM A WHERE cc IN (SELECT cc FROM B); # A小于B时使用 SELECT * FROM A WHERE EXISTS (SELECT cc FROM B WHERE B.cc = A.cc); -

COUNT(*)与COUNT(具体字段)效率 在MySQL中统计数据表的行数,可以使用三种方式:

SELECT COUNT(*)、SELECT COUNT(1)和SELECTCOUNT(具体字段),使用这三者之间的查询效率是怎样的?COUNT(*)和C0UNT(1)都是对所有结果进行COUNT,COUNT(*)和COUNT(1)本质上并没有区别。如果有WHERE子句,则是对所有符合筛选条件的数据行进行统计;如果没有WHERE子句,则是对数据表的数据行数进行统计。- 如果是

MyISAM存储引擎,统计数据表的行数只需要o(1)的复杂度,这是因为每张MylSAM的数据表都有一个meta信息存储了row_count值,而一致性则由表级锁来保证。 - 如果是

InnoDB存储引擎,因为InnoDB支持事务,采用行级锁和MVCC机制,所以无法像MyISAM一样,维护个row_count变量,因此需要采用扫描全表,o(n)复杂度,进行循环+计数的方式来完成统计。 - 在

InnoDB引擎中,如果采用COUNT(具体字段)来统计数据行数,要尽量采用二级索引。因为主键采用的索引是聚簇索引,聚簇索引包含的信息多,明显会大于二级索引(非聚簇索引)。对于C0UNT(*)和C0UNT(1)来说,它们不需要查找具体的行,只是统计行数,系统会自动采用占用空间更小的二级索引来进行统计。

如果有多个二级索引,会使用

key_len小的二级索引进行扫描。当没有二级索引的时候,才会采用主键索引来进行统计。 -

关于

SELECT(*)在表查询中,建议明确字段,不要使用

*作为查询的字段列表,推荐使用SELECT <字段列表>查询。原因:MySQL在解析的过程中,会通过查询数据字典将*按序转换成所有列名,这会大大的耗费资源和时间。- 无法使用覆盖索引。

-

LIMIT 1对优化的影响 针对的是会扫描全表的

SQL语句,如果你可以确定结果集只有一条,那么加上LIMIT 1的时候,当找到一条结果的时候就不会继续扫描了,这样会加快查询速度。 如果数据表已经对字段建立了唯一索引,那么可以通过索引进行查询,不会全表扫描的话,就不需要加上

LIMIT 1了。 -

多使用

COMMIT只要有可能,在程序中尽量多使用

COMMIT,这样程序的性能得到提高,需求也会因为COMMIT所释放的资源而减少。COMMIT所释放的资源:- 回滚段上用于恢复数据的信息。

- 被程序语句获得的所。

redo / undo log buffer中的空间。- 管理上述3中资源的内部花费。