zookeeper学习笔记

zookeeper

- Zookeeper 入门

-

- 概述

- Zookeeper工作机制

- 特点

- 数据结构

- 应用场景

-

- 统一命名服务

- 统一配置管理

- 统一集群管理

- 服务器动态上下线

- 软负载均衡

- zookeeper安装

-

- 本地模式安装

- 配置参数解读

- Zookeeper 集群操作

-

- 集群操作

-

-

- 集群安装

-

- 选举机制

- 节点类型

- 客户端命令行操作

-

- 命令语法

- znode 节点数据信息

- 查看当前节点详细数据

- 节点类型(持久/短暂/有序号/无序号)

- 修改节点数据值

- java Api

- 监听器原理

- 客户端向服务端写数据流程

- 服务器动态上下线监听案例

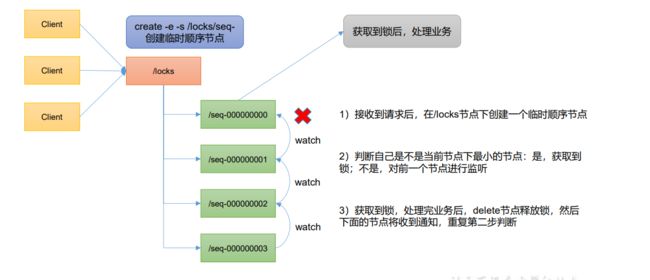

- ZooKeeper 分布式锁

-

- 原生zookeeper分布式锁

- Curator 框架实现分布式锁

- 企业面试真题

-

- 选举机制

- 生产集群安装多少 zk 合适?

- zookeeper源码分析

-

- 拜占庭将军问题

- Paxos算法

- ZAB 协议

-

- 什么是 ZAB 算法

- Zab 协议内容

Zookeeper 入门

概述

Zookeeper 是一个开源的分布式的,为分布式框架提供协调服务的 Apache 项目。

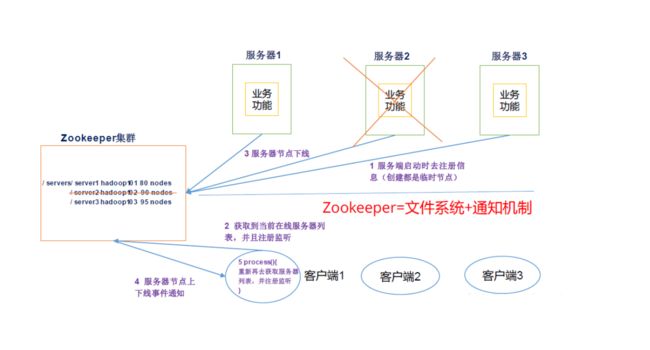

Zookeeper工作机制

Zookeeper从设计模式角度来理解:是一个基 于观察者模式设计的分布式服务管理框架,它负 责 存储和管理大家都关心的数据,然 后接受观察者的 注 册,一旦这些数据的状态发生变化,Zookeeper 就 将负责通知已经在Zookeeper上注册的那些观察 者做出相应的反应。

特点

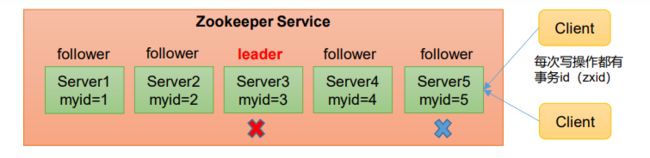

- Zookeeper:一个领导者(Leader),多个跟随者(Follower)组成的集群。

- 集群中只要有半数以上节点存活,Zookeeper集群就能正常服务。所以Zookeeper适合安装奇数台服务器。

- 全局数据一致:每个Server保存一份相同的数据副本,Client无论连接到哪个Server,数据都是一致的。

- 更新请求顺序执行,来自同一个Client的更新请求按其发送顺序依次执行。

- 数据更新原子性,一次数据更新要么成功,要么失败。

- 实时性,在一定时间范围内,Client能读到最新数据。

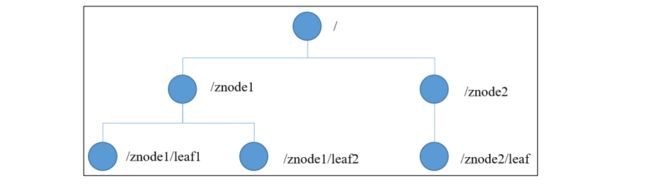

数据结构

ZooKeeper 数据模型的结构与 Unix 文件系统很类似,整体上可以看作是一棵树,每个 节点称做一个 ZNode。每一个 ZNode 默认能够存储 1MB 的数据,每个ZNode 都可以通过其路径唯一标识。

应用场景

提供的服务包括:统一命名服务、统一配置管理、统一集群管理、服务器节点动态上下 线、软负载均衡等

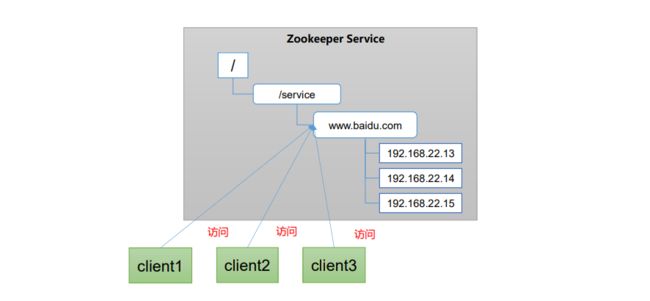

统一命名服务

在分布式环境下,经常需要对应用/服 务进行统一命名,便于识别。 例如:IP不容易记住,而域名容易记住。

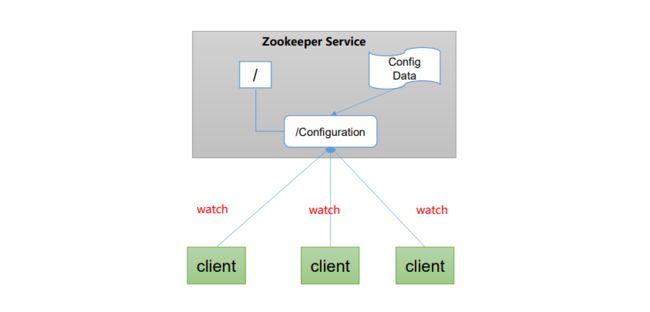

统一配置管理

- 分布式环境下,配置文件同步非常常见。

- 配置管理可交由ZooKeeper实现。

- 各个客户端服务器监听这个Znode。

- 一 旦Znode中的数据被修改,ZooKeeper将通知各个客户端服务器。

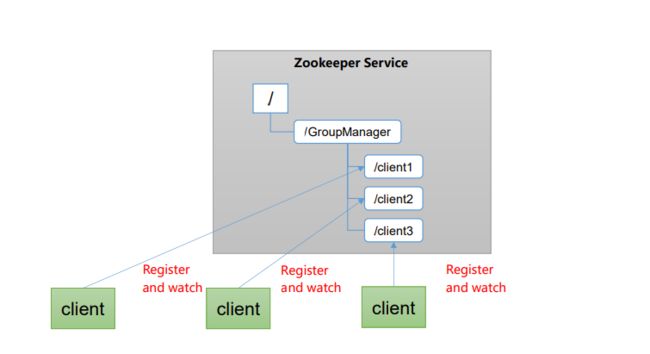

统一集群管理

- 分布式环境中,实时掌握每个节点的状态是必要的。

- 可根据节点实时状态做出一些调整。

- ZooKeeper可以实现实时监控节点状态变化

-

可将节点信息写入ZooKeeper上的一个ZNode。 -

监听这个ZNode可获取它的实时状态变化。

-

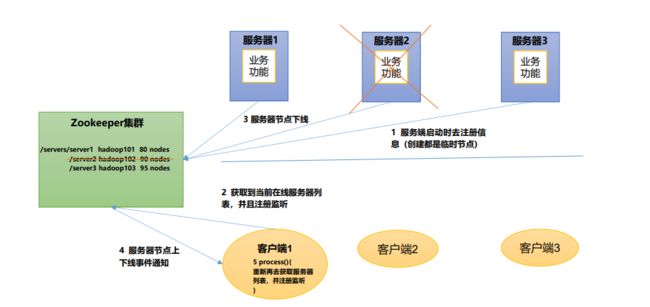

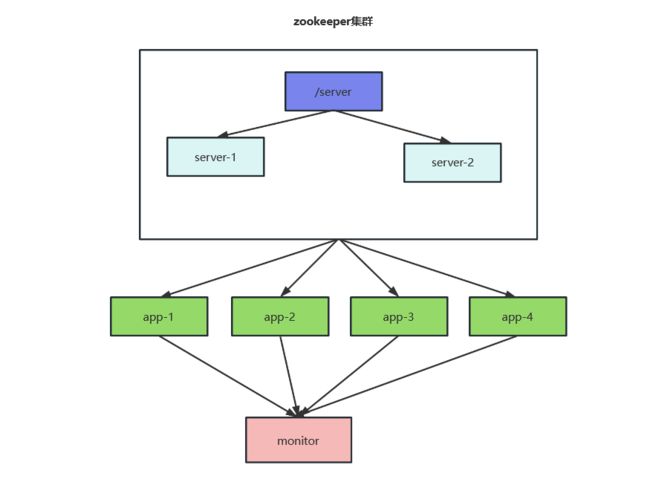

服务器动态上下线

客户端能实时洞察到服务 器上下线的变化

软负载均衡

在Zookeeper中记录每台服务器的访问数,让访问数最少的服务器去处理最新的客户端请求

zookeeper安装

本地模式安装

下载地址:https://zookeeper.apache.org/

下载完毕后上传到linux服务器 使用 tar -zxvf 压缩包名称 进行解压

前提是需要安装jdk环境,这里不再进行赘述

配置修改:

创建一个你自己觉得合适的 zookeeper数据保存目录,然后在 zoo_sample.cfg中的dataDir属性替换即可

启动zookeeper服务端: 在zookeeper的bin目录下使用zkServer.sh进行启动

./zkServer.sh start

验证是否启动成功:使用 jps,即可看到多出一个 QuorumPeerMain 进程

启动zookeeper客户端: 在bin目录下找到 zkCli.sh ,直接 ./ zkCli.sh 回车即可

使用 ls / 即可查看到有一个zookeeper节点

**退出:**使用 quit

查看zookeeper的健康状态: ./zkServer.sh status

停止zookeeper服务端:./zkServer.sh stop

配置参数解读

Zookeeper中的配置文件zoo.cfg中参数含义解读如下:

tickTime = 2000:通信心跳时间,Zookeeper服务器与客户端心跳时间,单位毫秒

initLimit = 10:LF初始通信时限(在第一次初始化的时候,主机和从机建立连接的时间不能超过 tickTime *initLimit )

syncLimit = 5:LF同步通信时限(在主机和从机建立连接之后的通信时间 不能超过 tickTime*syncLimit )

dataDir:保存Zookeeper中的数据(注意:默认的tmp目录,容易被Linux系统定期删除,所以一般不用默认的tmp目录。)

clientPort = 2181:客户端连接端口,通常不做修改。

Zookeeper 集群操作

集群操作

集群安装

在 hadoop102、hadoop103 和 hadoop104 三个节点上都部署 Zookeeper。

解压安装:

(1)在 hadoop102 解压 Zookeeper 安装包到/opt/module/目录下

[root@hadoop102 software]$ tar -zxvf apache-zookeeper-3.5.7-

bin.tar.gz -C /opt/module/

(2)修改 apache-zookeeper-3.5.7-bin 名称为 zookeeper-3.5.7

[root@hadoop102 module]$ mv apache-zookeeper-3.5.7-bin/ zookeeper-3.5.7

配置服务器编号:

(1)在/opt/module/zookeeper-3.5.7/这个目录下创建 zkData

[root@hadoop102 zookeeper-3.5.7]$ mkdir zkData

(2)在/opt/module/zookeeper-3.5.7/zkData 目录下创建一个 myid 的文件

[root@hadoop102 zkData]$ vi myid

在文件中添加与 server 对应的编号(注意:上下不要有空行,左右不要有空格)

2

注意:添加 myid 文件,一定要在 Linux 里面创建,在 notepad++里面很可能乱码

(3)拷贝配置好的 zookeeper 到其他机器上

并分别在 hadoop103、hadoop104 上修改 myid 文件中内容为 3、4

配置zoo.cfg文件:

(1)重命名/opt/module/zookeeper-3.5.7/conf 这个目录下的 zoo_sample.cfg 为 zoo.cfg

mv zoo_sample.cfg zoo.cfg

(2)打开 zoo.cfg 文件

#修改数据存储路径配置

dataDir=/opt/module/zookeeper-3.5.7/zkData

#增加如下配置

#######################cluster##########################

server.2=hadoop102:2888:3888

server.3=hadoop103:2888:3888

server.4=hadoop104:2888:3888

(3)配置参数解读 : server.A=B:C:D

- A 是一个数字,表示这个是第几号服务器;集群模式下配置一个文件 myid,这个文件在 dataDir 目录下,这个文件里面有一个数据就是 A 的值,Zookeeper 启动时读取此文件,拿到里面的数据与 zoo.cfg 里面的配置信息比较从而判断到底是哪个 server。

- B 是这个服务器的地址;

- C 是这个服务器 Follower 与集群中的 Leader 服务器交换信息的端口;

- D 是万一集群中的 Leader 服务器挂了,需要一个端口来重新进行选举,选出一个新的Leader,而这个端口就是用来执行选举时服务器相互通信的端口。

(4)同步 zoo.cfg 配置文件

**集群操作: **

(1)分别启动 Zookeeper [atguigu@hadoop102 zookeeper-3.5.7]$ bin/zkServer.sh start

[root@hadoop102 zookeeper-3.5.7]$ bin/zkServer.sh start

[root@hadoop103 zookeeper-3.5.7]$ bin/zkServer.sh start

[root@hadoop104 zookeeper-3.5.7]$ bin/zkServer.sh start

(2)查看状态

[root@hadoop102 zookeeper-3.5.7]# bin/zkServer.sh status

JMX enabled by default

Using config: /opt/module/zookeeper-3.5.7/bin/../conf/zoo.cfg

Mode: follower

[root@hadoop103 zookeeper-3.5.7]# bin/zkServer.sh status

JMX enabled by default

Using config: /opt/module/zookeeper-3.5.7/bin/../conf/zoo.cfg

Mode: leader

[root@hadoop104 zookeeper-3.4.5]# bin/zkServer.sh status

JMX enabled by default

Using config: /opt/module/zookeeper-3.5.7/bin/../conf/zoo.cfg

Mode: follower

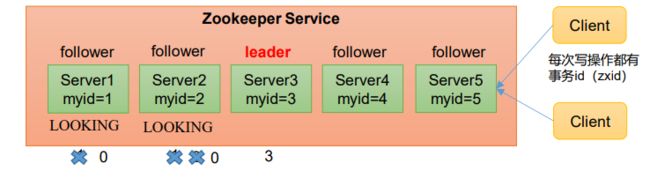

选举机制

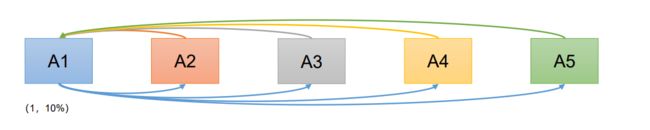

Zookeeper选举机制——第一次启动:

-

SID:服务器ID。用来唯一标识一台ZooKeeper集群中的机器,每台机器不能重复,和myid一致。

-

ZXID:事务ID。ZXID是一个事务ID,用来标识一次服务器状态的变更。在某一时刻,集群中的每台机器的ZXID值不一定完全一致,这和ZooKeeper服务器对于客户端“更新请求”的处理逻辑有关。

-

Epoch:每个Leader任期的代号。没有Leader时同一轮投票过程中的逻辑时钟值是相同的。每投完一次票这个数据就会增加

- 服务器1启 动,发起一次选举。服务器1投自己一票。此时服务器1票数一票,不够半数以上(3票),选举无法完成,服务器1状态保持为LOOKING;

- 服务器2启动,再发起一次选举。服务器1和2分别投自己一票并交换选票信息:此时服务器1发现服务器2的myid比自己目前投票推举的(服务器1)

大,更改选票为推举服务器2。此时服务器1票数0票,服务器2票数2票,没有半数以上结果,选举无法完成,服务器1,2状态保持LOOKING - 服务器3启动,发起一次选举。此时服务器1和2都会更改选票为服务器3。此次投票结果:服务器1为0票,服务器2为0票,服务器3为3票。此时服务器3的票数已经超过半数,服务器3当选Leader。服务器1,2更改状态为FOLLOWING,服务器3更改状态LEADING;

- 服务器4启动,发起一次选举。此时服务器1,2,3已经不是LOOKING状态,不会更改选票信息。交换选票信息结果:服务器3为3票,服务器4为

1票。此时服务器4服从多数,更改选票信息为服务器3,并更改状态为FOLLOWING; - 服务器5启动,同4一样当小弟。

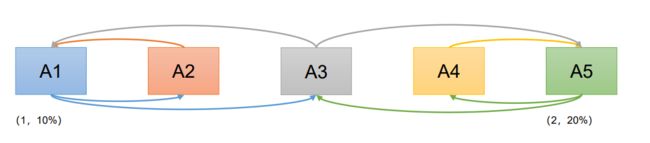

Zookeeper选举机制——非第一次启动:

-

SID:服务器ID。用来唯一标识一台ZooKeeper集群中的机器,每台机器不能重复,和myid一致。

-

ZXID:事务ID。ZXID是一个事务ID,用来标识一次服务器状态的变更。在某一时刻,集群中的每台机器的ZXID值不一定完全一致,这和ZooKeeper服务器对于客户端“更新请求”的处理逻辑有关。

-

Epoch:每个Leader任期的代号。没有Leader时同一轮投票过程中的逻辑时钟值是相同的。每投完一次票这个数据就会增加

- 当ZooKeeper集群中的一台服务器出现以下两种情况之一时,就会开始进入Leader选举:

- 服务器初始化启动。

- 服务器运行期间无法和Leader保持连接。

- 而当一台机器进入Leader选举流程时,当前集群也可能会处于以下两种状态:

- 集群中本来就已经存在一个Leader。 对于第一种已经存在Leader的情况,机器试图去选举Leader时,会被告知当前服务器的Leader信息,对于该机器来说,仅仅需要和Leader机器建立连 接,并进行状态同步即可。

- 集群中确实不存在Leader。

假设ZooKeeper由5台服务器组成,SID分别为1、2、3、4、5,ZXID分别为8、8、8、7、7,并且此时SID为3的服务器是Leader。某一时刻, 3和5服务器出现故障,因此开始进行Leader选举。

节点类型

- 持久(Persistent):客户端和服务器端断开连接后,创建的节点不删除

- 短暂(Ephemeral):客户端和服务器端断开连接后,创建的节点自己删除

- 说明:创建znode时设置顺序标识,znode名称后会附加一个值,顺序号是一个单调递增的计数器,由父节点维护

- 注意:在分布式系统中,顺序号可以被用于为所有的事件进行全局排序,这样客户端可以通过顺序号推断事件的顺序

(1)持久化目录节点客户端与Zookeeper断开连接后,该节点依旧存在

(2)持久化顺序编号目录节点客户端与Zookeeper断开连接后,该节点依旧存在,只是Zookeeper给该节点名称进行顺序编号

(3)临时目录节点客户端与Zookeeper断开连接后,该节点被删除

(4)临时顺序编号目录节点客户端与 Zookeeper 断开连接后 , 该节点 被 删 除 , 只 是Zookeeper给该节点名称进行顺序编号。

(5) 待永久节点带序号和不带序号的区别:带序号的节点不可以重复创建,而且这个序号自增,不带序号的可以重复创建

客户端命令行操作

命令语法

| 命令基本语法 | 功能描述 |

|---|---|

| help | 显示所有操作命令 |

| ls path | 使用 ls 命令来查看当前 znode 的子节点 [可监听] -w 监听子节点变化 -s 附加次级信息 |

| create | 普通创建, -s 含有序列 , -e 临时(重启或者超时消失) |

| get path | 获得节点的值 [可监听], -w 监听节点内容变化, -s 附加次级信息 |

| set | 设置节点的具体值 |

| stat | 查看节点状态 |

| delete | 删除节点 |

| deleteall | 递归删除节点 |

znode 节点数据信息

ls /

查看当前节点详细数据

[zk: localhost:2181(CONNECTED) 7] ls / -s

[zookeeper]cZxid = 0x0

ctime = Thu Jan 01 08:00:00 CST 1970

mZxid = 0x0

mtime = Thu Jan 01 08:00:00 CST 1970

pZxid = 0x0

cversion = -1

dataVersion = 0

aclVersion = 0

ephemeralOwner = 0x0

dataLength = 0

numChildren = 1

(1)czxid:创建节点的事务 zxid每次修改 ZooKeeper 状态都会产生一个 ZooKeeper 事务 ID。事务 ID 是 ZooKeeper 中所有修改总的次序。每次修改都有唯一的 zxid,如果 zxid1 小于 zxid2,那么 zxid1 在 zxid2 之前发生。

(2)ctime:znode 被创建的毫秒数(从 1970 年开始)

(3)mzxid:znode 最后更新的事务 zxid

(4)mtime:znode 最后修改的毫秒数(从 1970 年开始)

(5)pZxid:znode 最后更新的子节点 zxid

(6)cversion:znode 子节点变化号,znode 子节点修改次数

(7)dataversion:znode 数据变化号

(8)aclVersion:znode 访问控制列表的变化号

(9)ephemeralOwner:如果是临时节点,这个是 znode 拥有者的 session id。如果不是临时节点则是 0。

(10)dataLength:znode 的数据长度

(11)numChildren:znode 子节点数量

节点类型(持久/短暂/有序号/无序号)

创建普通节点(永久节点+不带序号)

# 创建节点

create /节点路径 "节点附带数据"

# 获得节点的值:

get -s /节点路径

创建带序号的节点(永久节点 + 带序号)

# 创建节点 如果原来没有序号节点,序号从 0 开始依次递增。如果原节点下已有 2 个节点,则再排序时从 2 开始,以此类推。

create -s /节点路径 "节点附带数据"

# 获得节点的值:

get -s /节点路径

创建短暂节点(短暂节点 + 不带序号 )

# 创建节点

create -e /节点路径 "节点附带数据"

# 获得节点的值:

get -s /节点路径

创建短暂节点(短暂节点 + 带序号 )

# 创建节点 如果原来没有序号节点,序号从 0 开始依次递增。如果原节点下已有 2 个节点,则再排序时从 2 开始,以此类推。

create -e -s /节点路径 "节点附带数据"

# 获得节点的值:

get -s /节点路径

修改节点数据值

set /节点路径 "节点附带数据"

java Api

1.创建一个maven工程:

2.引入如下依赖:

<dependencies>

<dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>RELEASE</version>

</dependency>

<dependency>

<groupId>org.apache.logging.log4j</groupId>

<artifactId>log4j-core</artifactId>

<version>2.8.2</version>

</dependency>

<dependency>

<groupId>org.apache.zookeeper</groupId>

<artifactId>zookeeper</artifactId>

<version>3.5.7</version>

</dependency>

</dependencies>

3.在resources目录下新建log4j.properties,内容如下:

log4j.rootLogger=INFO, stdout

log4j.appender.stdout=org.apache.log4j.ConsoleAppender

log4j.appender.stdout.layout=org.apache.log4j.PatternLayout

log4j.appender.stdout.layout.ConversionPattern=%d %p [%c]- %m%n

log4j.appender.logfile=org.apache.log4j.FileAppender

log4j.appender.logfile.File=target/spring.log

log4j.appender.logfile.layout=org.apache.log4j.PatternLayout

log4j.appender.logfile.layout.ConversionPattern=%d %p [%c]- %m%n

4.zookeeper操作客户端类封装:

import org.apache.zookeeper.*;

import org.apache.zookeeper.data.Stat;

import java.util.List;

import java.util.concurrent.CountDownLatch;

/**

* zookeeper操作客户端类

* 单机: private static final String host = "127.0.0.1:2181";

* 集群: private static final String host = "180.76.113.12:2181,127.0.0.1:2181,180.76.114.15:2181";

* @author HuYu

* @date 2023-05-27

* @since 1.0

**/

public class ZookeeperClient implements Watcher {

private static final int SESSION_TIME_OUT_DEFAULT = 500000;

private static final String HOST_DEFAULT = "127.0.0.1:2181";

private ZooKeeper zookeeper;

private int sessionTimeOut;

private String host;

private static final CountDownLatch countDownLatch = new CountDownLatch(1);

public ZookeeperClient(int sessionTimeOut,String host) {

this.sessionTimeOut = sessionTimeOut;

this.host = host;

}

public ZookeeperClient(int sessionTimeOut ) {

this.sessionTimeOut = sessionTimeOut;

}

public ZookeeperClient(String host) {

this.host = host;

}

public ZookeeperClient() {

this.sessionTimeOut = SESSION_TIME_OUT_DEFAULT;

this.host = HOST_DEFAULT;

}

public void process(WatchedEvent event) {

System.out.println(event);

if (event.getState() == Event.KeeperState.SyncConnected) {

countDownLatch.countDown();

}

}

/**

* 连接zookeeper

* @param host 主键名称

* @return void

* @author HuYu

* @date 2023/5/27 22:01

* @since 1.0.0

**/

public void connectZookeeper(String host) throws Exception{

zookeeper = new ZooKeeper(host, sessionTimeOut, this);

countDownLatch.await();

System.out.println("zookeeper connection success");

}

/**

* 连接zookeeper

* @return void

* @author HuYu

* @date 2023/5/27 22:01

* @since 1.0.0

**/

public void connectZookeeper( ) throws Exception{

zookeeper = new ZooKeeper(this.host, sessionTimeOut, this);

countDownLatch.await();

System.out.println("zookeeper connection success");

}

/**

* 创建节点

* @param path 节点路径

* @param data 节点数据

* @param nodeType 请参考:org.apache.zookeeper.CreateMode

* @return java.lang.String

* @author HuYu

* @date 2023/5/27 22:03

* @since 1.0.0

**/

public String createNode(String path,String data,CreateMode nodeType) throws Exception{

return this.zookeeper.create(path, data.getBytes(), ZooDefs.Ids.OPEN_ACL_UNSAFE, nodeType);

}

/**

* 获取路径下所有子节点

* @param path 路径

* @return List

* @author HuYu

* @date 2023/5/27 22:04

* @since 1.0.0

**/

public List<String> getChildren(String path) throws KeeperException, InterruptedException{

List<String> children = zookeeper.getChildren(path, false);

return children;

}

/**

* 监听某个节点

* @param path 路径

* @return List

* @author HuYu

* @date 2023/5/27 22:04

* @since 1.0.0

**/

public List<String> watchNode(String path) throws KeeperException, InterruptedException{

List<String> children = zookeeper.getChildren(path, true);

return children;

}

/**

* 获取节点上面的数据

* @param path 路径

* @return java.lang.String

* @author HuYu

* @date 2023/5/27 22:04

* @since 1.0.0

**/

public String getData(String path) throws KeeperException, InterruptedException{

byte[] data = zookeeper.getData(path, false, null);

if (data == null) {

return "";

}

return new String(data);

}

/**

* 设置节点信息

* @param path 路径

* @param data 数据

* @return org.apache.zookeeper.data.Stat

* @author HuYu

* @date 2023/5/27 22:05

* @since 1.0.0

**/

public Stat setData(String path, String data) throws KeeperException, InterruptedException{

Stat stat = zookeeper.setData(path, data.getBytes(), -1);

return stat;

}

/**

* 删除节点

* @param path 路径

* @return java.lang.Boolean

* @author HuYu

* @date 2023/5/27 22:06

* @since 1.0.0

**/

public Boolean deleteNode(String path) throws InterruptedException, KeeperException{

try {

zookeeper.delete(path, -1);

}catch (Exception e){

e.printStackTrace();

return false;

}

return true;

}

/**

* 获取创建时间

* @param path 路径

* @return java.lang.String

* @author HuYu

* @date 2023/5/27 22:07

* @since 1.0.0

**/

public String getCTime(String path) throws KeeperException, InterruptedException{

Stat stat = zookeeper.exists(path, false);

return String.valueOf(stat.getCtime());

}

/**

* 获取某个路径下孩子的数量

* @param path 路径

* @return java.lang.Integer

* @author HuYu

* @date 2023/5/27 22:07

* @since 1.0.0

**/

public Integer getChildrenNum(String path) throws KeeperException, InterruptedException{

int childrenNum= zookeeper.getChildren(path, false).size();

return childrenNum;

}

/**

* 关闭连接

* @return void

* @author HuYu

* @date 2023/5/27 22:07

* @since 1.0.0

**/

public void closeConnection() throws InterruptedException{

if (zookeeper != null) {

zookeeper.close();

}

}

/**

* 判断节点是否存在

* @param path 路径

* @param watch 是否开启监听

* @return java.lang.Boolean

* @author HuYu

* @date 2023/5/27 22:32

* @since 1.0.0

**/

public Boolean exist(String path,Boolean watch){

Stat exists = null;

try {

exists = zookeeper.exists(path, watch);

} catch (KeeperException | InterruptedException e) {

e.printStackTrace();

}

return exists!=null;

}

public ZooKeeper getZookeeper() {

return zookeeper;

}

public void setZookeeper(ZooKeeper zookeeper) {

this.zookeeper = zookeeper;

}

}

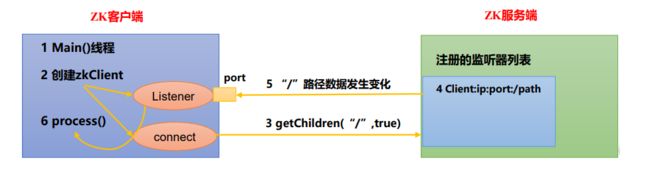

监听器原理

1、监听原理详解 2、常见的监听

1)首先要有一个main()线程

2)在main线程中创建Zookeeper客户端,这时就会创建两个线程,一个负责网络连接通信(connet),一个负责监听(listener)。

3)通过connect线程将注册的监听事件发送给Zookeeper。

4)在Zookeeper的注册监听器列表中将注册的监听事件添加到列表中。

5)Zookeeper监听到有数据或路径变化,就会将这个消息发送给listener线程。

6)listener线程内部调用了process()方法。

2、常见的监听

1)监听节点数据的变化 get path [watch]

2)监听子节点增减的变化 ls path [watch]

注意:只能监听一次。想再次监听,需要再次注册。

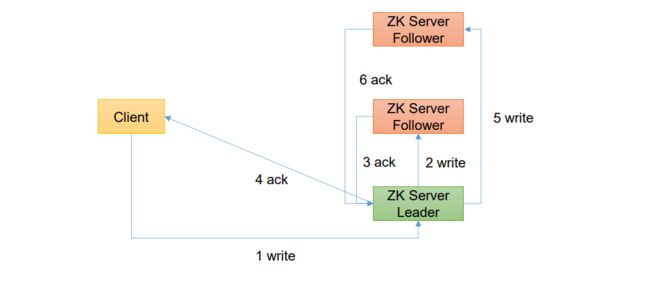

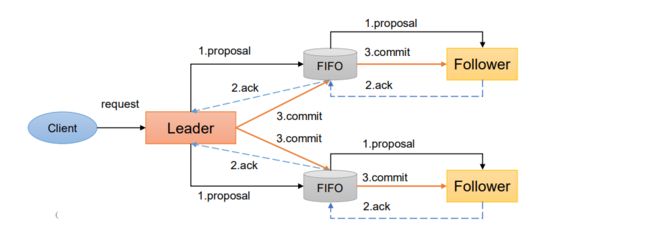

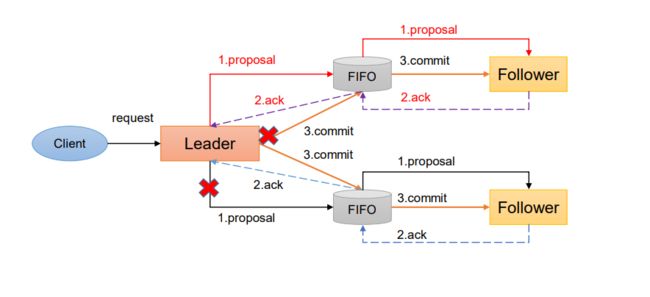

客户端向服务端写数据流程

写流程之写入请求直接发送给Leader节点

- 客户端写入数据到Leader节点,Leader节点会把数据通过ack机制同步给follower节点

- 只要有超过半数的follower节点应答,那么整个数据写入流程就完毕了

写流程之写入请求发送给follower节点

- 首先客户端发起写入数据请求到follower节点,follower节点会将请求转发给Leader节点,Leader节点先自己写一份

- 然后Leader节点会发起写命令给其他follower节点,其他follower节点写完后会给Leader节点一个应答,当Leader节点统计到写入超过半数时,会将写入成功的消息发送给此次接收到请求的follower节点,最终由他去响应整个写入流程完毕。

服务器动态上下线监听案例

- 首先我们需要创建的节点类型是,带序号的临时节点

- 我们java客户端可以是每一个应用,在应用启动的时候我们就在zookeeper上创建一个节点,表示我们这个应用上线,如果断开连接,那么我们就认为是下线,而且zookeeper上也会删除掉对应的节点

- 我们写一个DistributeClient来监听zookeeper上的节点变化,我们就可以关注那些应用在什么时候上线,什么时候下线,这跟微服务的注册中心是一个道理

DistributeClient:监听类

import org.apache.zookeeper.*;

import java.io.IOException;

import java.util.ArrayList;

import java.util.List;

/**

* 监听所有的服务上线和下线

* @author HuYu

* @date 2023-05-27

* @since 1.0

**/

public class DistributeClient {

private static final String connectString = "127.0.0.1:2181";

private static final int sessionTimeout = 500000;

private static final String parentNode = "/servers";

private ZooKeeper zk = null;

// 创建到 zk 的客户端连接

public void getConnect() throws IOException {

zk = new ZooKeeper(connectString, sessionTimeout, event -> {

// 再次启动监听

try {

getServerList();

} catch (Exception e) {

e.printStackTrace();

}

});

}

// 获取服务器列表信息

public void getServerList() throws Exception {

// 1 获取服务器子节点信息,并且对父节点进行监听

List<String> children = zk.getChildren(parentNode, true);

// 2 存储服务器信息列表

List<String> servers = new ArrayList<>();

// 3 遍历所有节点,获取节点中的主机名称信息

for (String child : children) {

byte[] data = zk.getData(parentNode + "/" + child, false, null);

servers.add(new String(data));

}

// 4 打印服务器列表信息

System.out.println(servers);

}

// 业务功能

public void business() throws Exception {

System.out.println("client is working ...");

Thread.sleep(Long.MAX_VALUE);

}

public static void main(String[] args) throws Exception {

// 1 获取 zk 连接

DistributeClient client = new DistributeClient();

client.getConnect();

// 2 获取 servers 的子节点信息,从中获取服务器信息列表

client.getServerList();

// 3 业务进程启动

client.business();

}

}

DistributeServer:应用类

/**

* 监听所有的服务上线和下线

* @author HuYu

* @date 2023-05-27

* @since 1.0

**/

public class DistributeClient {

private static final String connectString = "127.0.0.1:2181";

private static final int sessionTimeout = 500000;

private static final String parentNode = "/servers";

private ZooKeeper zk = null;

// 创建到 zk 的客户端连接

public void getConnect() throws IOException {

zk = new ZooKeeper(connectString, sessionTimeout, event -> {

// 再次启动监听

try {

getServerList();

} catch (Exception e) {

e.printStackTrace();

}

});

}

// 获取服务器列表信息

public void getServerList() throws Exception {

// 1 获取服务器子节点信息,并且对父节点进行监听

List<String> children = zk.getChildren(parentNode, true);

// 2 存储服务器信息列表

List<String> servers = new ArrayList<>();

// 3 遍历所有节点,获取节点中的主机名称信息

for (String child : children) {

byte[] data = zk.getData(parentNode + "/" + child, false, null);

servers.add(new String(data));

}

// 4 打印服务器列表信息

System.out.println(servers);

}

// 业务功能

public void business() throws Exception {

System.out.println("client is working ...");

Thread.sleep(Long.MAX_VALUE);

}

public static void main(String[] args) throws Exception {

// 1 获取 zk 连接

DistributeClient client = new DistributeClient();

client.getConnect();

// 2 获取 servers 的子节点信息,从中获取服务器信息列表

client.getServerList();

// 3 业务进程启动

client.business();

}

}

注意:记得在运行时添加参数,表示服务名称

ZooKeeper 分布式锁

原生zookeeper分布式锁

什么叫做分布式锁呢? 比如说"进程 1"在使用该资源的时候,会先去获得锁,"进程 1"获得锁以后会对该资源保持独占,这样其他进程就无法访问该资源,"进程 1"用完该资源以后就将锁释放掉,让其 他进程来获得锁,那么通过这个锁机制,我们就能保证了分布式系统中多个进程能够有序的 访问该临界资源。那么我们把这个分布式环境下的这个锁叫作分布式锁。

分布式锁代码:

import org.apache.zookeeper.*;

import org.apache.zookeeper.data.Stat;

import java.io.IOException;

import java.util.Collections;

import java.util.List;

import java.util.concurrent.CountDownLatch;

public class DistributedLock {

// zookeeper server 列表

private static String HOST = "127.0.0.1:2181";

// 超时时间

private static final int SESSION_TIMEOUT = 500000;

private final ZooKeeper zk;

private static final String rootNode = "locks";

private static final String subNode = "seq-";

// 当前 client 等待的子节点

private String waitPath;

//ZooKeeper 连接

private final CountDownLatch connectLatch = new CountDownLatch(1);

//ZooKeeper 节点等待

private final CountDownLatch waitLatch = new CountDownLatch(1);

// 当前 client 创建的子节点

private String currentNode;

// 和 zk 服务建立连接,并创建根节点

public DistributedLock() throws IOException, InterruptedException, KeeperException {

zk = new ZooKeeper(HOST, SESSION_TIMEOUT, event -> {

// 连接建立时, 打开 latch, 唤醒 wait 在该 latch 上的线程

if (event.getState() == Watcher.Event.KeeperState.SyncConnected) {

connectLatch.countDown();

}

// 发生了 waitPath 的删除事件

if (event.getType() == Watcher.Event.EventType.NodeDeleted && event.getPath().equals(waitPath)) {

waitLatch.countDown();

}

});

// 等待连接建立

connectLatch.await();

//获取根节点状态

Stat stat = zk.exists("/" + rootNode, false);

//如果根节点不存在,则创建根节点,根节点类型为永久节点

if (stat == null) {

System.out.println("根节点不存在");

zk.create("/" + rootNode, new byte[0], ZooDefs.Ids.OPEN_ACL_UNSAFE, CreateMode.PERSISTENT);

}

}

// 加锁方法

public void lock() {

try {

//在根节点下创建临时顺序节点,返回值为创建的节点路径

currentNode = zk.create("/" + rootNode + "/" + subNode, null, ZooDefs.Ids.OPEN_ACL_UNSAFE, CreateMode.EPHEMERAL_SEQUENTIAL);

// wait 一小会, 让结果更清晰一些

Thread.sleep(10);

// 注意, 没有必要监听"/locks"的子节点的变化情况

List<String> childrenNodes = zk.getChildren("/" + rootNode, false);

// 列表中只有一个子节点, 那肯定就是 currentNode , 说明 client 获得锁

if (childrenNodes.size() == 1) {

return;

} else {

//对根节点下的所有临时顺序节点进行从小到大排序

Collections.sort(childrenNodes);

//当前节点名称

String thisNode = currentNode.substring(("/" + rootNode + "/").length());

//获取当前节点的位置

int index = childrenNodes.indexOf(thisNode);

if (index == -1) {

System.out.println("数据异常");

} else if (index == 0) {

// index == 0, 说明 thisNode 在列表中最小, 当前 client 获得锁

return;

} else {

// 获得排名比 currentNode 前 1 位的节点

this.waitPath = "/" + rootNode + "/" +

childrenNodes.get(index - 1);

// 在 waitPath 上注册监听器, 当 waitPath 被删除时, zookeeper 会回调监听器的 process 方法

zk.getData(waitPath, true, new Stat());

//进入等待锁状态

waitLatch.await();

}

}

} catch (KeeperException | InterruptedException e) {

e.printStackTrace();

}

}

// 解锁方法

public void unLock() {

try {

zk.delete(this.currentNode, -1);

} catch (InterruptedException | KeeperException e) {

e.printStackTrace();

}

}

}

分布式锁测试代码:

import com.compass.zoo.utils.DistributedLock;

import org.apache.zookeeper.KeeperException;

import java.io.IOException;

public class DistributedLockTest {

public static void main(String[] args) throws InterruptedException, IOException, KeeperException {

// 创建分布式锁 1

final DistributedLock lock1 = new DistributedLock();

// 创建分布式锁 2

final DistributedLock lock2 = new DistributedLock();

new Thread(() -> {

// 获取锁对象

try {

lock1.lock();

System.out.println("线程 1 获取锁");

Thread.sleep(5 * 1000);

lock1.unLock();

System.out.println("线程 1 释放锁");

} catch (Exception e) {

e.printStackTrace();

}

}).start();

new Thread(() -> {

// 获取锁对象

try {

lock2.lock();

System.out.println("线程 2 获取锁");

Thread.sleep(5 * 1000);

lock2.unLock();

System.out.println("线程 2 释放锁");

} catch (Exception e) {

e.printStackTrace();

}

}).start();

}

}

Curator 框架实现分布式锁

- 原生的 Java API 开发存在的问题

- 会话连接是异步的,需要自己去处理。比如使用 CountDownLatch

- Watch 需要重复注册,不然就不能生效

- 开发的复杂性还是比较高的

- 不支持多节点删除和创建。需要自己去递归

- Curator 是一个专门解决分布式锁的框架,解决了原生 JavaAPI 开发分布式遇到的问题。

详情请查看官方文档:https://curator.apache.org/index.html

添加maven依赖

<dependency>

<groupId>org.apache.curatorgroupId>

<artifactId>curator-frameworkartifactId>

<version>4.3.0version>

dependency>

<dependency>

<groupId>org.apache.curatorgroupId>

<artifactId>curator-recipesartifactId>

<version>4.3.0version>

dependency>

<dependency>

<groupId>org.apache.curatorgroupId>

<artifactId>curator-clientartifactId>

<version>4.3.0version>

dependency>

代码实现

import org.apache.curator.RetryPolicy;

import org.apache.curator.framework.CuratorFramework;

import org.apache.curator.framework.CuratorFrameworkFactory;

import org.apache.curator.framework.recipes.locks.InterProcessLock;

import org.apache.curator.framework.recipes.locks.InterProcessMutex;

import org.apache.curator.retry.ExponentialBackoffRetry;

public class CuratorLockTest {

private String rootNode = "/locks";

// zookeeper server 列表

private String connectString = "127.0.0.1:2181";

// connection 超时时间

private int connectionTimeout = 500000;

// session 超时时间

private int sessionTimeout = 500000;

public static void main(String[] args) {

new CuratorLockTest().test();

}

// 测试

private void test() {

// 创建分布式锁 1

final InterProcessLock lock1 = new InterProcessMutex(getCuratorFramework(), rootNode);

// 创建分布式锁 2

final InterProcessLock lock2 = new InterProcessMutex(getCuratorFramework(), rootNode);

new Thread(new Runnable() {

@Override

public void run() {

// 获取锁对象

try {

lock1.acquire();

System.out.println("线程 1 获取锁");

// 测试锁重入

lock1.acquire();

System.out.println("线程 1 再次获取锁");

Thread.sleep(5 * 1000);

lock1.release();

System.out.println("线程 1 释放锁");

lock1.release();

System.out.println("线程 1 再次释放锁");

} catch (Exception e) {

e.printStackTrace();

}

}

}).start();

new Thread(new Runnable() {

@Override

public void run() {

// 获取锁对象

try {

lock2.acquire();

System.out.println("线程 2 获取锁");

// 测试锁重入

lock2.acquire();

System.out.println("线程 2 再次获取锁");

Thread.sleep(5 * 1000);

lock2.release();

System.out.println("线程 2 释放锁");

lock2.release();

System.out.println("线程 2 再次释放锁");

} catch (Exception e) {

e.printStackTrace();

}

}

}).start();

}

// 分布式锁初始化

public CuratorFramework getCuratorFramework (){

//重试策略,初试时间 3 秒,重试 3 次

RetryPolicy policy = new ExponentialBackoffRetry(3000, 3);

//通过工厂创建 Curator

CuratorFramework client = CuratorFrameworkFactory.builder()

.connectString(connectString)

.connectionTimeoutMs(connectionTimeout)

.sessionTimeoutMs(sessionTimeout)

.retryPolicy(policy).build();

//开启连接

client.start();

System.out.println("zookeeper 初始化完成...");

return client;

}

}

企业面试真题

选举机制

半数机制,超过半数的投票通过,即通过。

(1)第一次启动选举规则:

投票过半数时,服务器 id 大的胜出

(2)第二次启动选举规则:

①EPOCH 大的直接胜出

②EPOCH 相同,事务 id 大的胜出

③事务 id 相同,服务器 id 大的胜出

生产集群安装多少 zk 合适?

安装奇数台。

生产经验:

- 10 台服务器:3 台 zk;

- 20 台服务器:5 台 zk;

- 100 台服务器:11 台 zk;

- 200 台服务器:11 台 zk

- 服务器台数多:好处,提高可靠性;坏处:提高通信延时

zookeeper源码分析

拜占庭将军问题

拜占庭将军问题是一个协议问题,拜占庭帝国军队的将军们必须全体一致的决定是否攻击某一支敌军。问题是这些将军在地理上是分隔开来的,并且将 军中存在叛徒。叛徒可以任意行动以达到以下目标:欺骗某些将军采取进攻行动;促成一个不是所有将军都同意的决定,如当将军们不希望进攻时促成进攻 行动;或者迷惑某些将军,使他们无法做出决定。如果叛徒达到了这些目的之一,则任何攻击行动的结果都是注定要失败的,只有完全达成一致的努力才能 获得胜利。

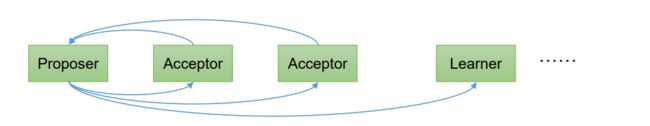

Paxos算法

Paxos算法:一种基于消息传递且具有高度容错特性的一致性算法。

机器宕机 网络异常(延迟、重复、丢失) Paxos算法解决的问题:就是如何快速正确的在一个分布式系统中对某个数据值达成一致,并且保证不论发生任何异常, 都不会破坏整个系统的一致性。

Paxos算法描述:

- 在一个Paxos系统中,首先将所有节点划分为Proposer(提议者),Acceptor(接受者),和Learner(学习者)。(注意:每个节点都可以身兼数职)。

- 一个完整的Paxos算法流程分为三个阶段:

- Prepare准备阶段

- Proposer向多个Acceptor发出Propose请求Promise(承诺)

- Acceptor针对收到的Propose请求进行Promise(承诺)

- Accept接受阶段

- Proposer收到多数Acceptor承诺的Promise后,向Acceptor发出Propose请求

- Acceptor针对收到的Propose请求进行Accept处理

- Learn学习阶段:Proposer将形成的决议发送给所有Learners

Paxos算法流程:

- Prepare: Proposer生成全局唯一且递增的Proposal ID,向所有Acceptor发送Propose请求,这里无需携带提案内容,只携带Proposal ID即可。

- Promise: Acceptor收到Propose请求后,做出“两个承诺,一个应答”。

- 不再接受Proposal ID小于等于(注意:这里是<= )当前请求的Propose请求。

- 不再接受Proposal ID小于(注意:这里是< )当前请求的Accept请求。

- 不违背以前做出的承诺下,回复已经Accept过的提案中Proposal ID最大的那个提案的Value和Proposal ID,没有则返回空值。

- Propose: Proposer收到多数Acceptor的Promise应答后,从应答中选择Proposal ID最大的提案的Value,作为本次要发起的提案。如果所有应答的提案Value均为空值,则可以自己随意决定提案Value。然后携带当前Proposal ID,向所有Acceptor发送Propose请求。

- Accept: Acceptor收到Propose请求后,在不违背自己之前做出的承诺下,接受并持久化当前Proposal ID和提案Value。

- Learn: Proposer收到多数Acceptor的Accept后,决议形成,将形成的决议发送给所有Learner。

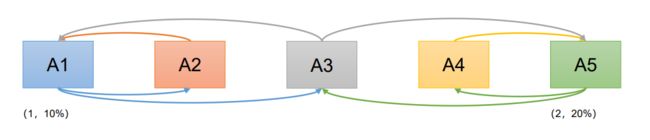

情况1:

有A1, A2, A3, A4, A5 5位议员,就税率问题进行决议。

- A1发起1号Proposal的Propose,等待Promise承诺;

- A2-A5回应Promise;

- A1在收到两份回复时就会发起税率10%的Proposal;

- A2-A5回应Accept;

- 通过Proposal,税率10%。

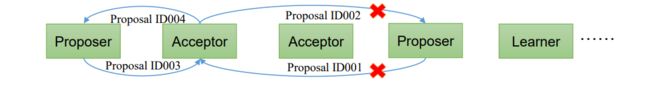

情况2:

现在我们假设在A1提出提案的同时, A5决定将税率定为20%

- A1,A5同时发起Propose(序号分别为1,2)

- A2承诺A1,A4承诺A5,A3行为成为关键

- 情况1:A3先收到A1消息,承诺A1。

- A1发起Proposal(1,10%),A2,A3接受。

- 之后A3又收到A5消息,回复A1:(1,10%),并承诺A5。

- A5发起Proposal(2,20%),A3,A4接受。之后A1,A5同时广播决议。

情况3:

现在我们假设在A1提出提案的同时, A5决定将税率定为20%

- A1,A5同时发起Propose(序号分别为1,2)

- A2承诺A1,A4承诺A5,A3行为成为关键

- 情况2:A3先收到A1消息,承诺A1。之后立刻收到A5消息,承诺A5。

- A1发起Proposal(1,10%),无足够响应,A1重新Propose (序号3),A3再次承诺A1。

- A5发起Proposal(2,20%),无足够相应。 A5重新Propose (序号4),A3再次承诺A5。

造成这种情况的原因是系统中有一个以上的 Proposer,多个 Proposers 相互争夺 Acceptor,造成迟迟无法达成一致的情况。针对这种情况,一种改进的 Paxos 算法被提出:从系统中选出一个节点作为 Leader,只有 Leader 能够发起提案。这样,一次 Paxos 流程中只有一个Proposer,不会出现活锁的情况,此时只会出现例子中第一种情况。

ZAB 协议

什么是 ZAB 算法

Zab 借鉴了 Paxos 算法,是特别为 Zookeeper 设计的支持崩溃恢复的原子广播协议。基于该协议,Zookeeper 设计为只有一台客户端(Leader)负责处理外部的写事务请求,然后Leader 客户端将数据同步到其他 Follower 节点。即 Zookeeper 只有一个 Leader 可以发起提案。

Zab 协议内容

Zab 协议包括两种基本的模式:消息广播、崩溃恢复

消息广播:

(1)客户端发起一个写操作请求。

(2)Leader服务器将客户端的请求转化为事务Proposal 提案,同时为每个Proposal 分配一个全局的ID,即zxid。

(3)Leader服务器为每个Follower服务器分配一个单独的队列,然后将需要广播的 Proposal依次放到队列中去,并且根据FIFO策略进行消息发送。

(4)Follower接收到Proposal后,会首先将其以事务日志的方式写入本地磁盘中,写入成功后向Leader反馈一个Ack响应消息。

(5)Leader接收到超过半数以上Follower的Ack响应消息后,即认为消息发送成功,可以发送commit消息。

(6)Leader向所有Follower广播commit消息,同时自身也会完成事务提交。Follower 接收到commit消息后,会将上一条事务提交。

(7)Zookeeper采用Zab协议的核心,就是只要有一台服务器提交了Proposal,就要确保所有的服务器最终都能正确提交Proposal。

ZAB协议针对事务请求的处理过程类似于一个两阶段提交过程

(1)广播事务阶段

(2)广播提交操作

这两阶段提交模型如下,有可能因为Leader宕机带来数据不一致,比如

( 1 ) Leader 发 起 一 个 事 务Proposal1 后 就 宕 机 , Follower 都 没 有Proposal1

(2)Leader收到半数ACK宕 机,没来得及向Follower发送Commit怎么解决呢?ZAB引入了崩溃恢复模式。

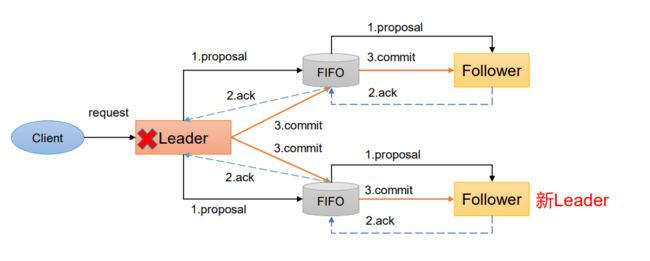

崩溃恢复:

一旦Leader服务器出现崩溃或者由于网络原因导致Leader服务器失去了与过半 Follower的联系,那么就会进入崩溃恢复模式。

- 假设两种服务器异常情况:

- 假设一个事务在Leader提出之后,Leader挂了。

- Zab协议崩溃恢复要求满足以下两个要求:

- 确保已经被Leader提交的提案Proposal,必须最终被所有的Follower服务器提交。 (已经产生的提案,Follower必须执行)

- 确保丢弃已经被Leader提出的,但是没有被提交的Proposal。(丢弃胎死腹中的提案)

Leader选举:

崩溃恢复主要包括两部分:Leader选举和数据恢复。

Leader选举:根据上述要求,Zab协议需要保证选举出来的Leader需要满足以下条件:

(1)新选举出来的Leader不能包含未提交的Proposal。即新Leader必须都是已经提交了Proposal的Follower服务器节点。

(2)新选举的Leader节点中含有最大的zxid。这样做的好处是可以避免Leader服务器检查Proposal的提交和丢弃工作。

数据恢复:

Zab如何数据同步:

(1)完成Leader选举后,在正式开始工作之前(接收事务请求,然后提出新的Proposal),Leader服务器会首先确认事务日志中的所有的Proposal 是否已经被集群中过半的服务器Commit。

(2)Leader服务器需要确保所有的Follower服务器能够接收到每一条事务的Proposal,并且能将所有已经提交的事务Proposal应用到内存数据中。等到Follower将所有尚未同步的事务Proposal都从Leader服务器上同步过,并且应用到内存数据中以后,Leader才会把该Follower加入到真正可用的Follower列表中。