Python 爬虫快速入门 requests库

前言

Requests是一个功能强大且简洁的Python第三方库,用于发送HTTP请求。它提供了一种简单和直观的方式来与Web服务进行通信,并处理响应数据。

在学习之前你应该掌握Python的基本语法,了解网页的组成,大概能看懂HTML。

Requests是Python的第三方库,所以在使用前要先下载,最简单的是通过pip下载。

常用的使用方法

1.发送GET请求

使用requests.get(url, params=None, **kwargs)方法发送GET请求。

- url:请求的URL地址。

- params(可选):用于传递查询字符串参数。

- **kwargs(可选):用于传递其他关键字参数,如headers、cookies等。

示例代码:

import requests

url='https://api.example.com/data'

response = requests.get(url=url, params={'key': 'value'})

print(response.status_code) # 打印响应状态码

print(response.text) # 打印响应内容2.发送POST请求

使用requests.post(url, data=None, json=None, **kwargs)方法发送POST请求。

- url:请求的URL地址。

- data(可选):用于发送表单数据。

- json(可选):用于发送JSON数据。

- **kwargs(可选):用于传递其他关键字参数,如headers、cookies等。

示例代码:

import requests

payload = {'username': 'my_username', 'password': 'my_password'}

response = requests.post('https://api.example.com/login', data=payload)

print(response.status_code) # 打印响应状态码

print(response.json()) # 解析响应内容为JSON格式3.设置请求头(headers)

在发送请求时,可以使用headers参数设置请求头,以便在请求中包含特定的信息,如User-Agent、Authorization等。

示例代码:

import requests

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.3'}

response = requests.get('https://api.example.com/data', headers=headers)为什么要设置请求头呢?

这涉及到了反爬技术,请求头检测是一种常见的反爬技术之一。服务器可以通过分析HTTP请求中的请求头部信息来判断是否符合常规浏览器的标准,如果不符合,则可能被视为机器人或爬虫程序。

请求头部信息包含了客户端发起请求时的一些元数据,其中最常见的就是User-Agent头部,它用于标识客户端的设备和浏览器信息。通过检查User-Agent,服务器可以大致了解请求来自什么类型的设备和浏览器,例如PC、移动设备、不同的操作系统以及常见的浏览器类型和版本。

我们可以通过修改请求的User-Agent信息来模拟其他设备或浏览器的行为,以达到隐藏真实身份或绕过某些限制的目的。通过修改User-Agent,可以让服务器错误地认为请求来自其他设备或浏览器,从而获取不同的响应或绕过针对特定设备或浏览器的限制。

4.处理响应

Response对象提供了多个属性和方法来处理响应数据,如status_code获取响应状态码、text获取响应文本、json()解析响应为JSON格式等。

示例代码:

import requests

response = requests.get('https://api.example.com/data')

print(response.status_code) # 打印响应状态码

print(response.text) # 打印响应内容

print(response.json()) # 解析响应内容为JSON格式需要注意的是json()解析只能用于json格式的对象,不然会报错。

5.处理异常

在实际应用中,可能会出现各种异常情况,如网络连接问题、请求超时等。可以使用try-except语句来捕获和处理这些异常。

示例代码:

import requests

try:

response = requests.get('https://api.example.com/data')

response.raise_for_status() # 如果请求不成功,抛出异常

except requests.exceptions.HTTPError as err:

print(f"HTTP error occurred: {err}")

except requests.exceptions.RequestException as err:

print(f"An error occurred: {err}")案例1:使用GET请求获取豆瓣分类排行榜

我用的是edge浏览器,不同的浏览器抓包工具会不太一样,得好好熟悉下。

先了解下XHR和Ajax交互:

- 在浏览器抓包工具中,XHR代表XMLHttpRequest(XML HTTP Request)对象。XMLHttpRequest是一种在客户端浏览器和服务器之间进行数据传输的API,它提供了通过HTTP协议发送异步请求并获取服务器响应的功能。

- XHR常用于实现AJAX交互,通过在网页中使用JavaScript创建XHR对象,可以实现动态更新网页内容、获取数据、提交表单等功能。XHR还支持设置请求头、发送表单数据、处理响应状态、异步回调等功能,使得客户端与服务器之间的交互更加灵活和高效。

- Ajax(Asynchronous JavaScript and XML)是一种用于创建交互式网页应用程序的技术。它允许在不刷新整个页面的情况下,通过异步方式与服务器进行通信和交互。

在网页中如果没有通过刷新整个网页来更新内容,很明显是使用了Ajax交互技术。

打开抓包工具,选择网络,选择XHR,点击一个请求,找到URL地址、请求方法、User-Agent等。

如下图所示:

params参数可在下图所示中找到

将这些数据复制到代码中

import requests

url='https://movie.douban.com/j/chart/top_list'

headers={'User-Agent':"Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/114.0.0.0 Safari/537.36 Edg/114.0.1823.67"}

params={

'type': '17',

'interval_id': '100:90',

'action': '',

'start': '0', #第几部电影

'limit': '20', #抓取个数

}

response=requests.get(url=url,params=params,headers=headers)

top_list=response.json()

print(top_list)运行查看输出结果

可见我们成功抓取到了排行榜电影的信息,但是看着还是太复杂了,我们可以只提取想要的信息 。分析数据知,这是一个列表类型,列表的每个元素是字典类型,字典里rank对应着电影排名,title对应着电影名称,如果我们只想要这两个信息,那么可以通过for循环实现。

我们修改下输出:

import requests

url='https://movie.douban.com/j/chart/top_list'

headers={'User-Agent':"Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/114.0.0.0 Safari/537.36 Edg/114.0.1823.67"}

params={

'type': '17',

'interval_id': '100:90',

'action': '',

'start': '0', #第几部电影

'limit': '20', #抓取个数

}

response=requests.get(url=url,params=params,headers=headers)

top_list=response.json()

# 输出结果

for i in top_list:

print(f"rank:{i['rank']} title:{i['title']}")运行测试下:

这样我们就得到了排名前20的电影,如果我们想要获取其他电影 ,可以通过修改params里的参数实现。

案例2:使用POST请求破解翻译

打开抓包工具,选择网络,XHR

请求是空的,输入一个单词试试

点击那些请求,在预览里可以知道哪个目标请求,如下图所示该请求是目标请求

复制url地址啥的数据到代码里

import requests

url='https://fanyi.sogou.com/reventondc/suggV3'

headers={'Uer-Agent':"Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/94.0.4606.71 Safari/537.36 Core/1.94.200.400 QQBrowser/11.8.5310.400"}

# 用循环实现连续翻译

while 1:

word=input("enter a word:") #输入要翻译的单词

data={

'from': 'auto',

'to': 'zh-CHS',

'client':'web',

'text': word,

'uuid': 'ff1cb485-cc90-4153-8337-93400c3f0ff5',

'pid': 'sogou-dict-vr',

'addSugg': 'on'

}

response=requests.post(url=url,data=data,headers=headers)

# response.encoding='utf-8'

result=response.json()

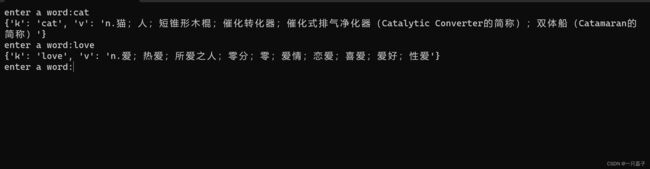

print(result)运行看看

输出的内容跟抓包工具内预览内容一样,但是多出其他相似单词的翻译,我们只想要这一个单词的翻译。对数据分析下,这是个字典类型,其中单词的翻译都在键为‘sugg’对应的值里,该值是个列表,列表元素是字典类型,那么我们只保留列表第一个元素就好了。

修改下输出:

import requests

url='https://fanyi.sogou.com/reventondc/suggV3'

headers={'Uer-Agent':"Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/94.0.4606.71 Safari/537.36 Core/1.94.200.400 QQBrowser/11.8.5310.400"}

# 用循环实现连续翻译

while 1:

word=input("enter a word:") #输入要翻译的单词

data={

'from': 'auto',

'to': 'zh-CHS',

'client':'web',

'text': word,

'uuid': 'ff1cb485-cc90-4153-8337-93400c3f0ff5',

'pid': 'sogou-dict-vr',

'addSugg': 'on'

}

response=requests.post(url=url,data=data,headers=headers)

result=response.json()

if 'sugg' in result:

if result['sugg']:

print(result['sugg'][0])运行:

这样我们就得到了想要的结果。

总结

以上只是requests库的简单运用,也是最基础的,初学者很容易轻松上手。

本文有些地方并没有详细解说,因为那些都是基础的东西。