基于YOLOv7的密集场景行人检测识别分析系统

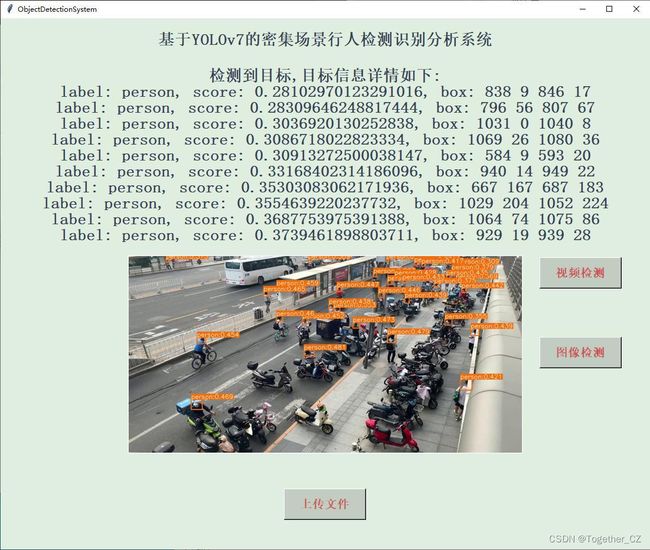

密集场景下YOLO系列模型的精度如何?本文的主要目的就是想要基于密集场景基于YOLOv7模型开发构建人流计数系统,简单看下效果图:

这里实验部分使用到的数据集为VSCrowd数据集。

实例数据如下所示:

下载到本地解压缩后如下所示:

annotations/目录下存放的是标注数据文件如下所示:

单个标注文件内容截图如下所示:

videos/目录存放的是图像数据文件,如下所示:

二者相结合不难发现单个txt标注对应单个子文件夹下面的内容数据:

之后就可以对应解析处理数据集了,这里就不再赘述了,可以参考readme即可。

本文使用到的模型是YOLOv7x模型,模型配置文件如下所示:

# parameters

nc: 1 # number of classes

depth_multiple: 1.0 # model depth multiple

width_multiple: 1.0 # layer channel multiple

# anchors

anchors:

- [12,16, 19,36, 40,28] # P3/8

- [36,75, 76,55, 72,146] # P4/16

- [142,110, 192,243, 459,401] # P5/32

# yolov7 backbone

backbone:

# [from, number, module, args]

[[-1, 1, Conv, [40, 3, 1]], # 0

[-1, 1, Conv, [80, 3, 2]], # 1-P1/2

[-1, 1, Conv, [80, 3, 1]],

[-1, 1, Conv, [160, 3, 2]], # 3-P2/4

[-1, 1, Conv, [64, 1, 1]],

[-2, 1, Conv, [64, 1, 1]],

[-1, 1, Conv, [64, 3, 1]],

[-1, 1, Conv, [64, 3, 1]],

[-1, 1, Conv, [64, 3, 1]],

[-1, 1, Conv, [64, 3, 1]],

[-1, 1, Conv, [64, 3, 1]],

[-1, 1, Conv, [64, 3, 1]],

[[-1, -3, -5, -7, -8], 1, Concat, [1]],

[-1, 1, Conv, [320, 1, 1]], # 13

[-1, 1, MP, []],

[-1, 1, Conv, [160, 1, 1]],

[-3, 1, Conv, [160, 1, 1]],

[-1, 1, Conv, [160, 3, 2]],

[[-1, -3], 1, Concat, [1]], # 18-P3/8

[-1, 1, Conv, [128, 1, 1]],

[-2, 1, Conv, [128, 1, 1]],

[-1, 1, Conv, [128, 3, 1]],

[-1, 1, Conv, [128, 3, 1]],

[-1, 1, Conv, [128, 3, 1]],

[-1, 1, Conv, [128, 3, 1]],

[-1, 1, Conv, [128, 3, 1]],

[-1, 1, Conv, [128, 3, 1]],

[[-1, -3, -5, -7, -8], 1, Concat, [1]],

[-1, 1, Conv, [640, 1, 1]], # 28

[-1, 1, MP, []],

[-1, 1, Conv, [320, 1, 1]],

[-3, 1, Conv, [320, 1, 1]],

[-1, 1, Conv, [320, 3, 2]],

[[-1, -3], 1, Concat, [1]], # 33-P4/16

[-1, 1, Conv, [256, 1, 1]],

[-2, 1, Conv, [256, 1, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[[-1, -3, -5, -7, -8], 1, Concat, [1]],

[-1, 1, Conv, [1280, 1, 1]], # 43

[-1, 1, MP, []],

[-1, 1, Conv, [640, 1, 1]],

[-3, 1, Conv, [640, 1, 1]],

[-1, 1, Conv, [640, 3, 2]],

[[-1, -3], 1, Concat, [1]], # 48-P5/32

[-1, 1, Conv, [256, 1, 1]],

[-2, 1, Conv, [256, 1, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[[-1, -3, -5, -7, -8], 1, Concat, [1]],

[-1, 1, Conv, [1280, 1, 1]], # 58

]

# yolov7 head

head:

[[-1, 1, SPPCSPC, [640]], # 59

[-1, 1, Conv, [320, 1, 1]],

[-1, 1, nn.Upsample, [None, 2, 'nearest']],

[43, 1, Conv, [320, 1, 1]], # route backbone P4

[[-1, -2], 1, Concat, [1]],

[-1, 1, Conv, [256, 1, 1]],

[-2, 1, Conv, [256, 1, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[[-1, -3, -5, -7, -8], 1, Concat, [1]],

[-1, 1, Conv, [320, 1, 1]], # 73

[-1, 1, Conv, [160, 1, 1]],

[-1, 1, nn.Upsample, [None, 2, 'nearest']],

[28, 1, Conv, [160, 1, 1]], # route backbone P3

[[-1, -2], 1, Concat, [1]],

[-1, 1, Conv, [128, 1, 1]],

[-2, 1, Conv, [128, 1, 1]],

[-1, 1, Conv, [128, 3, 1]],

[-1, 1, Conv, [128, 3, 1]],

[-1, 1, Conv, [128, 3, 1]],

[-1, 1, Conv, [128, 3, 1]],

[-1, 1, Conv, [128, 3, 1]],

[-1, 1, Conv, [128, 3, 1]],

[[-1, -3, -5, -7, -8], 1, Concat, [1]],

[-1, 1, Conv, [160, 1, 1]], # 87

[-1, 1, MP, []],

[-1, 1, Conv, [160, 1, 1]],

[-3, 1, Conv, [160, 1, 1]],

[-1, 1, Conv, [160, 3, 2]],

[[-1, -3, 73], 1, Concat, [1]],

[-1, 1, Conv, [256, 1, 1]],

[-2, 1, Conv, [256, 1, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[-1, 1, Conv, [256, 3, 1]],

[[-1, -3, -5, -7, -8], 1, Concat, [1]],

[-1, 1, Conv, [320, 1, 1]], # 102

[-1, 1, MP, []],

[-1, 1, Conv, [320, 1, 1]],

[-3, 1, Conv, [320, 1, 1]],

[-1, 1, Conv, [320, 3, 2]],

[[-1, -3, 59], 1, Concat, [1]],

[-1, 1, Conv, [512, 1, 1]],

[-2, 1, Conv, [512, 1, 1]],

[-1, 1, Conv, [512, 3, 1]],

[-1, 1, Conv, [512, 3, 1]],

[-1, 1, Conv, [512, 3, 1]],

[-1, 1, Conv, [512, 3, 1]],

[-1, 1, Conv, [512, 3, 1]],

[-1, 1, Conv, [512, 3, 1]],

[[-1, -3, -5, -7, -8], 1, Concat, [1]],

[-1, 1, Conv, [640, 1, 1]], # 117

[87, 1, Conv, [320, 3, 1]],

[102, 1, Conv, [640, 3, 1]],

[117, 1, Conv, [1280, 3, 1]],

[[118,119,120], 1, IDetect, [nc, anchors]], # Detect(P3, P4, P5)

]

训练数据配置如下所示:

# txt path

train: ./dataset/images/train

val: ./dataset/images/test

test: ./dataset/images/test

# number of classes

nc: 1

# class names

names: ['person']

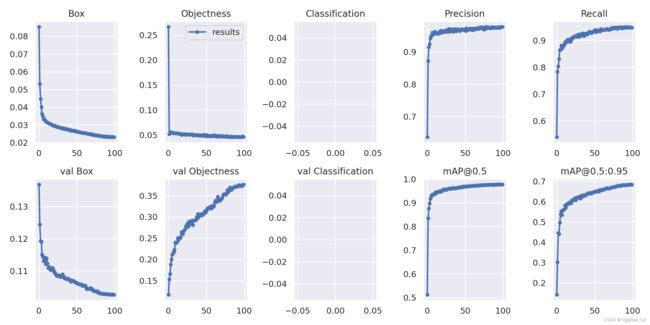

默认100次epoch的迭代计算,等待训练完成后,我们直接来看结果数据如下所示:

【精确率曲线】

精确率曲线(Precision-Recall Curve)是一种用于评估二分类模型在不同阈值下的精确率性能的可视化工具。它通过绘制不同阈值下的精确率和召回率之间的关系图来帮助我们了解模型在不同阈值下的表现。

精确率(Precision)是指被正确预测为正例的样本数占所有预测为正例的样本数的比例。召回率(Recall)是指被正确预测为正例的样本数占所有实际为正例的样本数的比例。

绘制精确率曲线的步骤如下:

使用不同的阈值将预测概率转换为二进制类别标签。通常,当预测概率大于阈值时,样本被分类为正例,否则分类为负例。

对于每个阈值,计算相应的精确率和召回率。

将每个阈值下的精确率和召回率绘制在同一个图表上,形成精确率曲线。

根据精确率曲线的形状和变化趋势,可以选择适当的阈值以达到所需的性能要求。

通过观察精确率曲线,我们可以根据需求确定最佳的阈值,以平衡精确率和召回率。较高的精确率意味着较少的误报,而较高的召回率则表示较少的漏报。根据具体的业务需求和成本权衡,可以在曲线上选择合适的操作点或阈值。

精确率曲线通常与召回率曲线(Recall Curve)一起使用,以提供更全面的分类器性能分析,并帮助评估和比较不同模型的性能。

【Recall曲线】

召回率曲线(Recall Curve)是一种用于评估二分类模型在不同阈值下的召回率性能的可视化工具。它通过绘制不同阈值下的召回率和对应的精确率之间的关系图来帮助我们了解模型在不同阈值下的表现。

召回率(Recall)是指被正确预测为正例的样本数占所有实际为正例的样本数的比例。召回率也被称为灵敏度(Sensitivity)或真正例率(True Positive Rate)。

绘制召回率曲线的步骤如下:

使用不同的阈值将预测概率转换为二进制类别标签。通常,当预测概率大于阈值时,样本被分类为正例,否则分类为负例。

对于每个阈值,计算相应的召回率和对应的精确率。

将每个阈值下的召回率和精确率绘制在同一个图表上,形成召回率曲线。

根据召回率曲线的形状和变化趋势,可以选择适当的阈值以达到所需的性能要求。

通过观察召回率曲线,我们可以根据需求确定最佳的阈值,以平衡召回率和精确率。较高的召回率表示较少的漏报,而较高的精确率意味着较少的误报。根据具体的业务需求和成本权衡,可以在曲线上选择合适的操作点或阈值。

召回率曲线通常与精确率曲线(Precision Curve)一起使用,以提供更全面的分类器性能分析,并帮助评估和比较不同模型的性能。

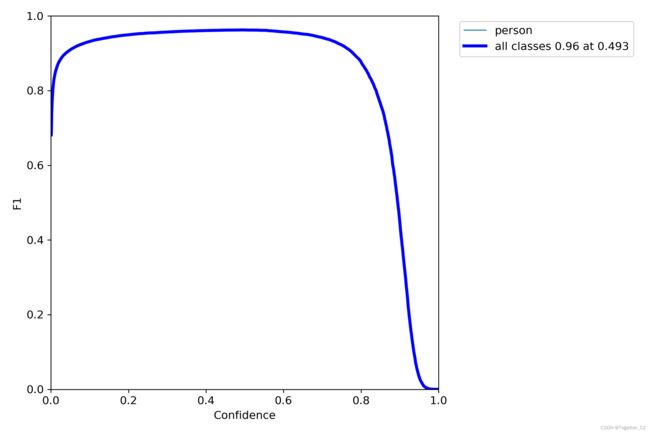

【F1值曲线】

F1值曲线是一种用于评估二分类模型在不同阈值下的性能的可视化工具。它通过绘制不同阈值下的精确率(Precision)、召回率(Recall)和F1分数的关系图来帮助我们理解模型的整体性能。

F1分数是精确率和召回率的调和平均值,它综合考虑了两者的性能指标。F1值曲线可以帮助我们确定在不同精确率和召回率之间找到一个平衡点,以选择最佳的阈值。

绘制F1值曲线的步骤如下:

使用不同的阈值将预测概率转换为二进制类别标签。通常,当预测概率大于阈值时,样本被分类为正例,否则分类为负例。

对于每个阈值,计算相应的精确率、召回率和F1分数。

将每个阈值下的精确率、召回率和F1分数绘制在同一个图表上,形成F1值曲线。

根据F1值曲线的形状和变化趋势,可以选择适当的阈值以达到所需的性能要求。

F1值曲线通常与接收者操作特征曲线(ROC曲线)一起使用,以帮助评估和比较不同模型的性能。它们提供了更全面的分类器性能分析,可以根据具体应用场景来选择合适的模型和阈值设置。

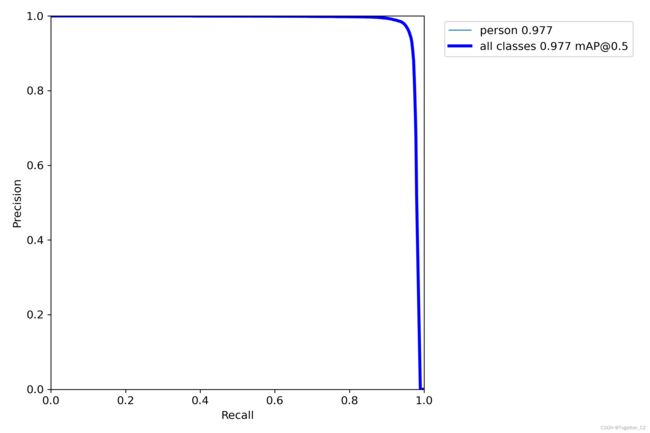

【PR曲线】

精确率-召回率曲线(Precision-Recall Curve)是一种用于评估二分类模型性能的可视化工具。它通过绘制不同阈值下的精确率(Precision)和召回率(Recall)之间的关系图来帮助我们了解模型在不同阈值下的表现。

精确率是指被正确预测为正例的样本数占所有预测为正例的样本数的比例。召回率是指被正确预测为正例的样本数占所有实际为正例的样本数的比例。

绘制精确率-召回率曲线的步骤如下:

使用不同的阈值将预测概率转换为二进制类别标签。通常,当预测概率大于阈值时,样本被分类为正例,否则分类为负例。

对于每个阈值,计算相应的精确率和召回率。

将每个阈值下的精确率和召回率绘制在同一个图表上,形成精确率-召回率曲线。

根据曲线的形状和变化趋势,可以选择适当的阈值以达到所需的性能要求。

精确率-召回率曲线提供了更全面的模型性能分析,特别适用于处理不平衡数据集和关注正例预测的场景。曲线下面积(Area Under the Curve, AUC)可以作为评估模型性能的指标,AUC值越高表示模型的性能越好。

通过观察精确率-召回率曲线,我们可以根据需求选择合适的阈值来权衡精确率和召回率之间的平衡点。根据具体的业务需求和成本权衡,可以在曲线上选择合适的操作点或阈值。

【训练过程可视化】

【batch计算实例】

从训练评估效果来看检测的效果还是很不错的,在这批数据集中,目标大多是偏小目标的类型,且密度相对较高。

【可视化推理实例—图像推理计算】

【可视化推理实例—视频推理计算】

后续有时间可以考虑基于YOLOv7-tiny这一轻量级的网络模型来尝试开发构建密集数据场景下的目标检测模型,来对比分析。