elasticsearch从入门到精通

es从入门到深入

ElasticSearch概述

Elaticsearch,简称为es ,es是一个开源的高扩展的分布式全文检索引擎,它可以近乎实时的存储、检索数据;本身扩展性很好,可以扩展到上百台服务器,处理PB级别的数据。es也使用ava开发并使用Lucene作为其核心来实现所有索引和搜索的功能,但是它的目的是通过简单的RESTful API来隐藏Lucene的复杂性,从而让全文搜索变得简单。

据国际权威的数据库产品评测机构DB Engines的统计,在2016年1月,ElasticSearch已超过Solr等,成为排名第一的搜索引擎类应用。

ElasticSearch与Solr对比

Elasticsearch简介

Elasticsearch是一个实时分布式搜索和分析引擎。 它让你以前所未有的速度处理大数据成为可能。

它用于全文搜索、结构化搜索、分析以及将这三者混合使用:

维基百科使用Elasticsearch提供全文搜索并高亮关键字,以及输入实时搜索(search-asyou-type)和搜索纠错(did-you-mean)等搜索建议功能。

英国卫报使用Elasticsearch结合用户日志和社交网络数据提供给他们的编辑以实时的反馈,以便及时了解公众对新发表的文章的回StackOverflow结合全文搜索与地理位置查询,以及more-like-this功能来找到相关的问题和答案。

Github使用Elasticsearch检索1300亿行的代码。

但是Elasticsearch不仅用于大型企业,它还让像DataDog以及Klout这样的创业公司将最初的想法变成可扩展的解决方案。

Elasticsearch可以在你的笔记本上运行,也可以在数以百计的服务器上处理PB级别的数据。

Elasticsearch是一个基于Apache Lucene™的开源搜索引擎。无论在开源还是专有领域, Lucene可以被认为是迄今为止最先进、性能最好的、功能最全的搜索引擎库。

但是, Lucene只是一个库。 想要使用它,你必须使用Java来作为开发语言并将其直接集成到你的应用中,更糟糕的是, Lucene非常复杂,你需要深入了解检索的相关知识来理解它是如何工作的。

Elasticsearch也使用Java开发并使用Lucene作为其核心来实现所有索引和搜索的功能,但是它的目的是通过简单的RESTful API来隐藏Lucene的复杂性,从而让全文搜索变得简单。

Solr简介

Solr是Apache下的一个顶级开源项目,采用Java开发,它是基于Lucene的全文搜索服务器。Solr提供了比Lucene更为丰富的查询语言,同时实现了可配置、可扩展,并对索引、搜索性能进行了优化。

Solr可以独立运行,运行在Jetty、 Tomcat等这些Servlet容器中, Solr索弓|的实现方法很简单,用POST方法向Solr服务器发送一个描述Field及其内容的XML文档, Solr根据xml文档添加、删除、更新索引。Solr搜索只需要发送HTTP GET请求,然后对Solr返回Xml、json等格式的查询结果进行解析,组织页面布局。Solr不提供构建UI的功能, Solr提供了-一个管理界面,通过管理界面可以查询Solr的配置和运行情况。

solr是基于lucene开发企业级搜索服务器,实际上就是封装了lucene。

Solr是一 个独立的企业级搜索应用服务器,它对外提供类似于Web-service的API接口。 用户可以通过http请求,向搜索引擎服务器提交一定格式的文件,生成索引;也可以通过提出查找请求,并得到返回结果。

Lucene简介

Lucene是apache软件基金会4 jakarta项目组的一个子项目,是一个开放源代码的全文检索引擎工具包,但它不是一一个完整的全文检索引擎,而是一个全文检索弓|擎的架构,提供了完整的查询引擎和索引引擎,部分文本分析引擎(英文与德文两种西方语言)。

Lucene的目的是为软件开发人员提供一个简单易用的工具包,以方便的在目标系统中实现全文检索的功能,或者是以此为基础建立起完整的全文检索弓|擎。Lucene是套一用于全文检索和搜寻的开源程式库,由Apache软件基金会支持和提供。Lucene提供了一个简单却强大的应用程式接口,能够做全文索引和搜寻。在Java开发环境里Lucene是一个成熟的免费开源工具。就其本身而言,Lucene是当前以及最近几年最受欢迎的免费Java信息检索程序库。人们经常提到信息检索程序库,虽然与搜索引擎有关,但不应该将信息检索程序库与搜索引擎相混淆。

Lucene是一一个全文检索引擎的架构。那什么是全文搜索引擎?

全文搜索引擎是名副其实的搜索引擎,国外具代表性的有Google、Fast/AllTheWeb、 AltaVista、 Inktomi、 Teoma、 WiseNut等,国内著名的有百度( Baidu)。它们都是通过从互联网上提取的各个网站的信息(以网页文字为主)而建立的数据库中,检索与用户查询条件匹配的相关记录,然后按一定的排列顺序将结果返回给用户,因此他们是真正的搜索引擎。从搜索结果来源的角度,全文搜索引擎又可细分为两种,一种是拥有自己的检索程序( Indexer ) , 俗称"蜘蛛”( Spider )程序或"机器人”( Robot )程序,并自建网页数据库,搜索结果直接从自身的数据库中调用,如上面提到的7家引擎;另一种则是租用其他弓|擎的数据库,并按自定的格式排列搜索结果,如Lycos引擎。

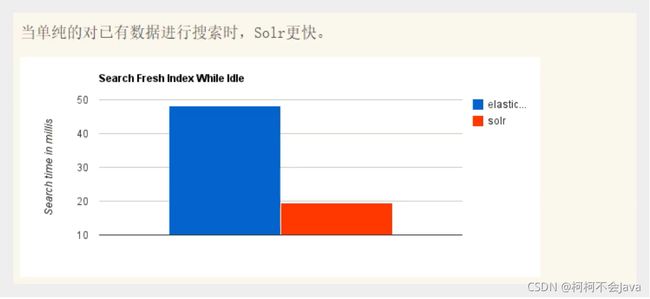

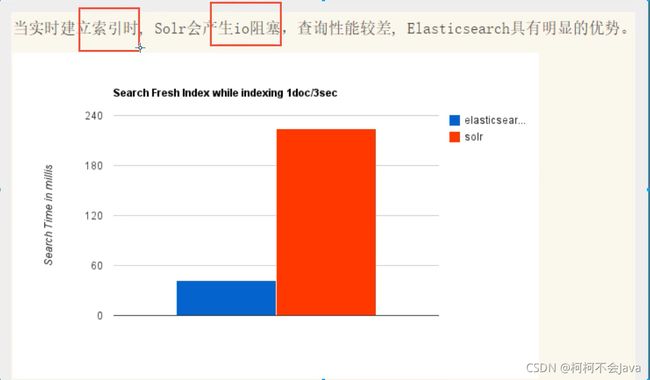

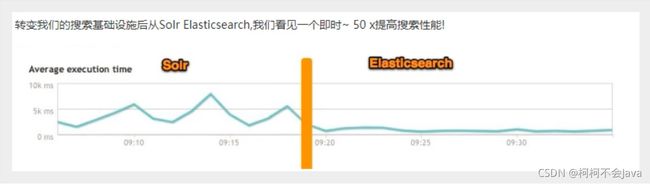

ElasticSearch vs Solr比较

ElasticSearch vs Solr总结

1、es基本是开箱即用(解压就可以用! ) ,非常简单。Solr安装略微复杂一丢丢!

2、Solr 利用Zookeeper进行分布式管理,而Elasticsearch自身带有分布式协调管理功能。

3、Solr 支持更多格式的数据,比如SON、XML、CSV ,而Elasticsearch仅支持json文件格式。

4、Solr 官方提供的功能更多,而Elasticsearch本身更注重于核心功能,高级功能多有第三方插件提供,例如图形化界面需要kibana友好支撑!

5、Solr 查询快,但更新索弓时慢(即插入删除慢) , 用于电商等查询多的应用;

-

ES建立索引快(即查询慢) ,即实时性查询快,用于facebook新浪等搜索。

-

Solr 是传统搜索应用的有力解决方案,但Elasticsearch更适用于新兴的实时搜索应用。

6、Solr比较成熟,有一个更大,更成熟的用户、开发和贡献者社区,而Elasticsearch相对开发维护者较少,更新太快,学习使用,成本较高。

ElasticSearch的安装

要求

jdk1.8最低

下载地址

https://www.elastic.co/cn/downloads/elasticsearch

安装

ELK三剑客,解压即用

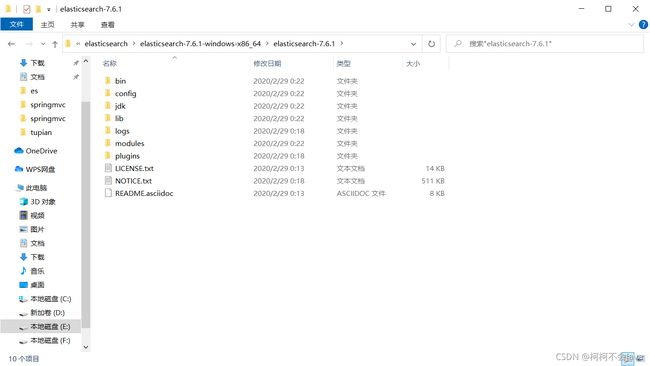

熟悉目录

bin 启动文件

config 配置文件

- log4j2.properties 日志配置文件

- jvm.options java虚拟机相关配置

- elasticsearch.yml elasticsearch配置文件 默认9200端口 可以配置跨域问题

jdk 环境

lib 相关jar包

logs 日志

modules 功能模块

plugins 插件,如ik分词器

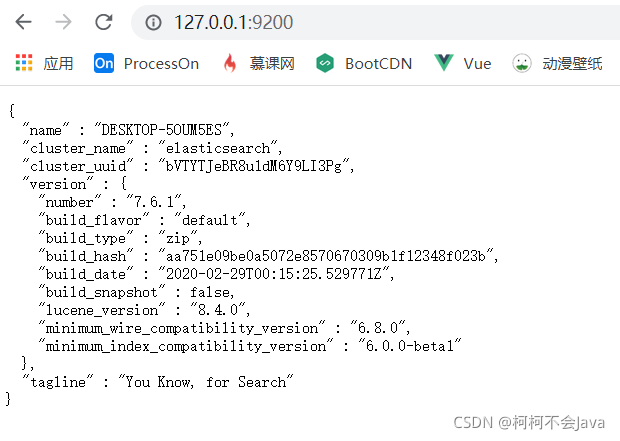

启动

访问

可视化

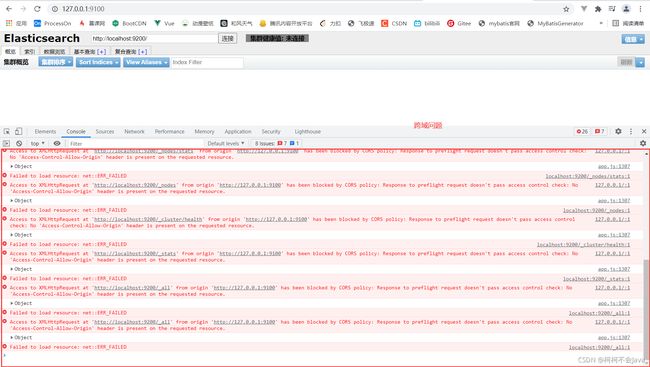

安装可视化界面es head插件

下载地址

http://github.com/mobz/elasticsearch-head/

要求

npm、node.js

启动

cnpm install

npm run start

解决跨域问题

在elasticsearch.yml 文件中配置后重启elasticsearch

http.cors.enabled: true

http.cors.allow-origin: "*"

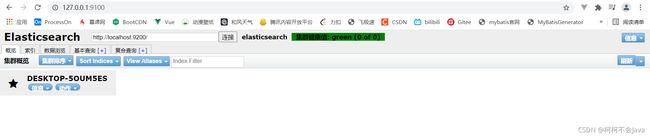

重新访问

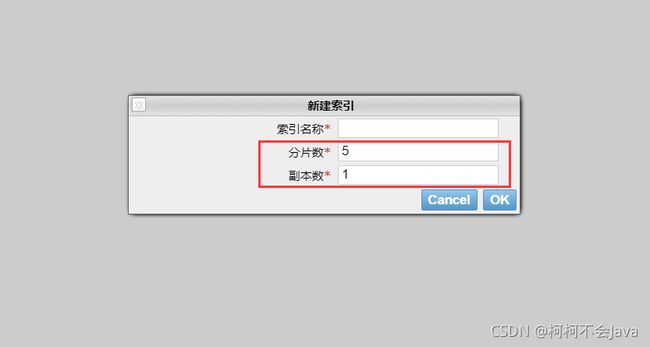

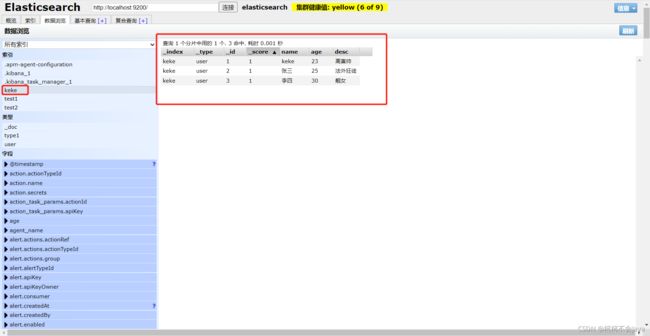

创建索引

初学可以将es当成一个数据库,索引即库,文档即库中的数据

ELK

ELK简介

ELK是Elasticsearch、Logstash、Kibana三大开源框架首字母大写简称。市面上也被成为Elastic Stack。其中Elasticsearch是一个基于Lucene、分布式、通过Restful方式进行交互的近实时搜索平台框架。像类似百度、谷歌这种大数据全文搜索引擎的场景都可以使用Elasticsearch作为底层支持框架,可见Elasticsearch提供的搜索能力确实强大,市面上很多时候我们简称Elasticsearch为es。Logstash是ELK的中央数据流引擎,用于从不同目标(文件/数据存储/MQ)收集的不同格式数据,经过过滤后支持输出到不同目的地(文件/MQ/redis/elasticsearch/kafka等 )。Kibana可以将elasticsearch的数据通过友好的页面展示出来,提供实时分析的功能。

市面上很多开发只要提到ELK能够一致说出它是一个日志分析架构技术栈总称,但实际上ELK不仅仅适用于日志分析,它还可以支持其它任何数据分析和收集的场景,日志分析和收集只是更具有代表性。并非唯一性。

Kibana简介

Kibana是一个针对Elasticsearch的开源分析及可视化平台,用来搜索、查看交互存储在Elasticsearch索引中的数据。使用Kibana ,可以通过各种图表进行高级数据分析及展示。Kibana让海量数据更容易理解。它操作简单,基于浏览器的用户界面可以快速创建仪表板( dashboard )实时显示Elasticsearch查询动态。设置Kibana非常简单。无需编码或者额外的基础架构,几分钟内就可以完成Kibana安装并启动Elasticsearch索引监测。

官网

https://www.elastic.co/cn/kibana

注意:Kibana的版本要和es一致!

安装

解压即可

启动

访问

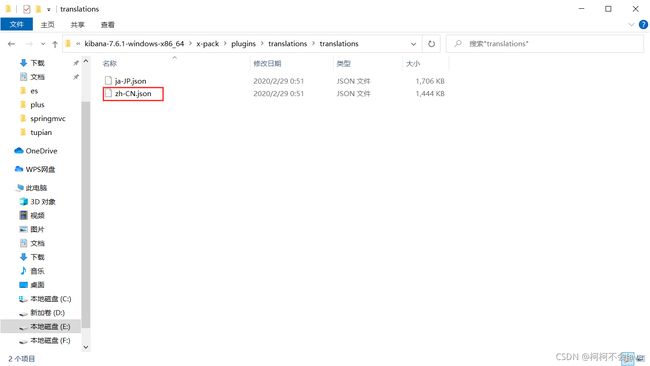

开发工具

汉化

在kibana.yml修改为i18n.locale: "zh-CN"

重启

ES的核心概念

概述

在前面的学习中,我们已经掌握了es是什么,同时也把es的服务已经安装启动,那么es是如何去存储数据,数据结构是什么,又是如何实现搜索的呢?我们先来聊聊ElasticSearch的相关概念吧!

集群,节点,索引,类型,文档,分片,映射是什么?

elasticsearch是面向文档,关系行数据库和elasticsearch客观的对比! elasticsearch存储数据都是json

elasticsearch(集群)中可以包含多个索引(数据库),每个索引中可以包含多个类型(表),每个类型下又包含多个文档(行),每个文档中又包含多个字段(列)。

物理设计

elasticsearch在后台把每个索引划分成多个分片,每分分片可以在集群中的不同服务器间迁移

一个人就是一个集群! 默认的集群名称是elasticsearch

逻辑设计

一个索引类型中,包含多个文档,比如说文档1,文档2。当我们索引一篇文档时,可以通过这样的一个顺序找到它:索引->类型->文档ID,通过这个组合我们就能索引到某个具体的文档。注意:ID不必是整数,实际上它是个字符串。

文档

之前说elasticsearch是面向文档的,那么就意味着索引和搜索数据的最小单位是文档,elasticsearch中,文档有几个重要属性:

- 自我包含,一篇文档同时包含字段和对应的值,也就是同时包含key:value !

- 可以是层次型的,一个文档中包含自文档,复杂的逻辑实体就是这么来的 ! 就是一个json对象,fastjson可以进行自动转换

- 灵活的结构,文档不依赖预先定义的模式,我们知道关系型数据库中,要提前定义字段才能使用,在elasticsearch中,对于字

段是非常灵活的,有时候,我们可以忽略该字段,或者动态的添加一个新的字段。

尽管我们可以随意的新增或者忽略某个字段,但是,每个字段的类型非常重要,比如一个年龄字段类型,可以是字符串也可以是整形。因为elasticsearch会保存字段和类型之间的映射及其他的设置。这种映射具体到每个映射的每种类型,这也是为什么在elasticsearch中,类型有时候也称为映射类型。

类型

类型是文档的逻辑容器,就像关系型数据库一样,表格是行的容器。类型中对于字段的定义称为映身,比如name映射为字符串类型。我们说文档是无模式的,它们不需要拥有映射中所定义的所有字段,比如新增一个字段,那么elasticsearch是怎么做的呢?elasticsearch会自动的将新字段加入映射,但是这个字段的不确定它是什么类型,elasticsearch就开始猜,如果这个值是18,那么elasticsearch会认为它是整形。但是elasticsearch也可能猜不对,所以最安全的方式就是提前定义好所需要的映射,这点跟关系型数据库殊途同归了,先定义好字段,然后再使用,别整什么幺蛾子。

索引

索引是映射类型的容器,elasticsearch中的索引是一个非常大的文档集合。索引存储了映射类型的字段和其他设置。然后它们被存储到了各个分片上了。我们来研究下分片是如何工作的。

物理设计︰节点和分片如何工作

一个集群至少有一个节点,而一个节点就是一个elasticsearch进程,节点可以有多个索引默认的,如果你创建索引,那么索引将会有个5个分片( primary shard ,又称主分片)构成的,每一个主分片会有一个副本( replica shard ,又称复制分片)

上图是一个有3个节点的集群,可以看到主分片和对应的复制分片都不会在同一个节点内,这样有利于某个节点挂掉了,数据也不至于丢失。实际上,一个分片是一个Lucene索引,一个包含倒排索引的文件目录,倒排索引的结构使得elasticsearch在不扫描全部文档的情况下,就能告诉你哪些文档包含特定的关键字。不过,等等,倒排索引是什么鬼?

倒排索引

简介

elasticsearch使用的是一种称为倒排索引的结构,采用Lucene倒排索作为底层。这种结构适用于快速的全文搜索,一个索引由文档中所有不重复的列表构成,对于每一个词,都有一个包含它的文档列表。例如,现在有两个文档,每个文裆包含如下内容:

study every day,good good up to forever # 文档1包含的内容

To forever,study every day,good good up #文档2包含的内容

为了创建倒排索引,我们首先要将每个文档拆分成独立的词(或称为词条或者tokens),然后创建一个包含所有不重复的词条的排序列表,然后列出每个词条出现在哪个文档:

现在我们尝试搜索 to forever,只需要查看包含每个词条的文档

例子

两个文档都匹配,但是第一个文档比第二个匹配程度更高。如果没有别的条件,现在,这两个包含关键字的文档都将返回。再来看一个示例,比如我们通过博客标签来搜索博客文章。那么倒排索引列表就是这样的一个结构:

如果要搜索含有python标签的文章,那相对于查找所有原始数据而言,查找倒排索引后的数据将会快的多。只需要查看标签这一栏,然后获取相关的文章ID即可。完全过滤掉所有的无关数据,提高效率!

elasticsearch的索引和Lucene的索引对比

在elasticsearch中,索引这个词被频繁使用,这就是术语的使用。在elasticsearch中,索引被分为多个分片,每份分片是一个Lucene的索引。所以一个elasticsearch索引是由多个Lucene索引组成的。别问为什么,谁让elasticsearch使用Lucene作为底层呢!如无特指,说起索引都是指elasticsearch的索引。

接下来的一切操作都在kibana中Dev Tools下的Console里完成。基础操作!

IK分词器插件

概念

分词:即把一段中文或者别的划分成一个个的关键字,我们在搜索时候会把自己的信息进行分词,会把数据库中或者索引库中的数据进行分词,然后进行一个匹配操作,默认的中文分词是将每个字看成一个词,比如“我爱狂神"会被分为"我"“爱”“狂” “神”,这显然是不符合要求的,所以我们需要安装中文分词器ik来解决这个问题。

如果要使用中文,建议使用ik分词器!

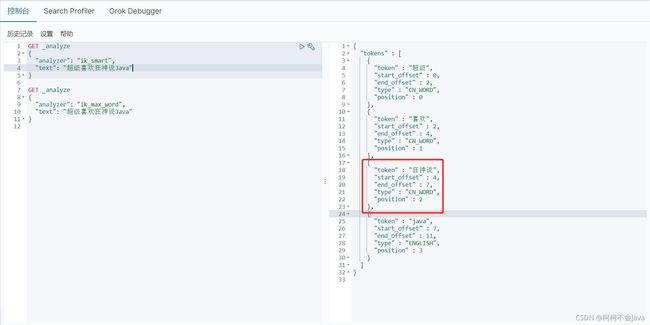

IK提供了两个分词算法:ik_smart和ik_max_word,其中ik_smart为最少切分,ik_max_word为最细粒度划分!一会我们测试!

安装

下载地址

https://github.com/medcl/elasticsearch-analysis-ik

安装

下载完毕之后,放入到我们的elasticsearch插件即可!

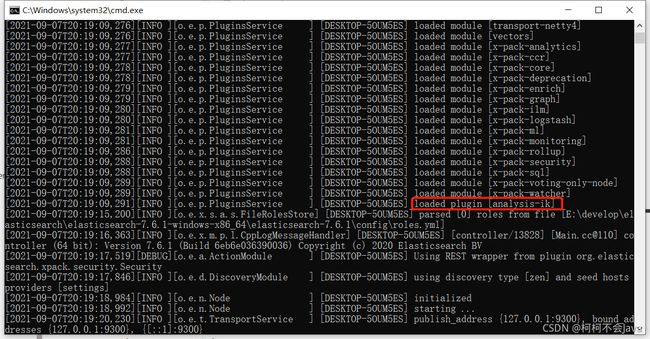

重启elasticsearch

可以看到ik分词器被加载了

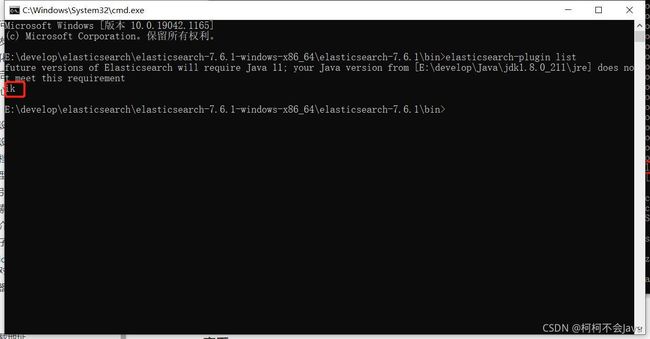

查看

elasticsearch-plugin list

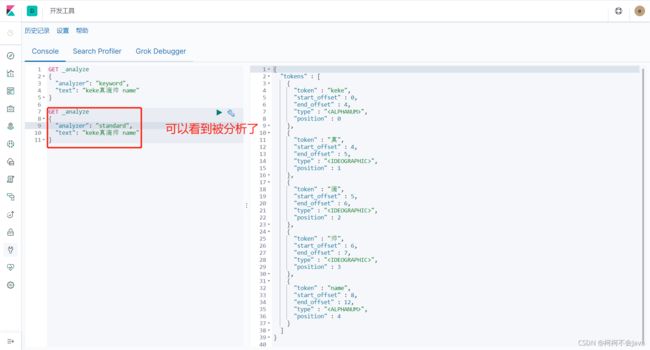

使用Kibana测试

查看不同的分词效果

ik_smart为最少切分!

ik_max_word为最细粒度划分!穷尽词库的可能!字典!

问题

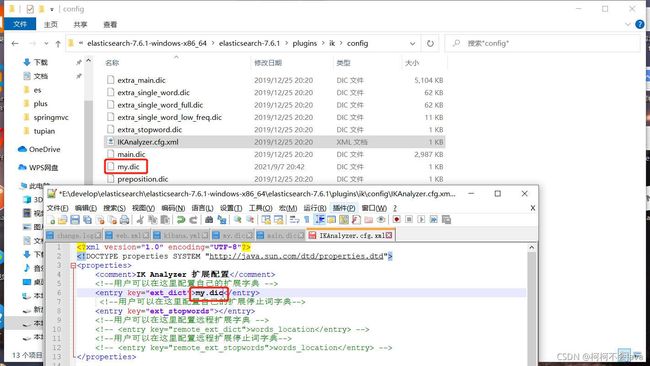

输入超级喜欢狂神说Java,发现狂神说被拆开了

解决

这种自己需要的词需要自己加到分词器的字典中

1、在ik分词器中增加自己的配置

2、重启elasticsearch,看日志

3、再次测试狂神说,看效果

以后要有自己配置的分词的话,就在自己定义的字典中配置即可!

Rest风格说明

一种软件架构风格,而不是标准,只是提供了一组设计原则和约束条件。它主要用于客户端和服务器交互类的软件。基于这个风格设计的软件可以更简洁,更有层次,更易于实现缓存等机制。

基本Rest命令说明︰

关于索引的基础操作

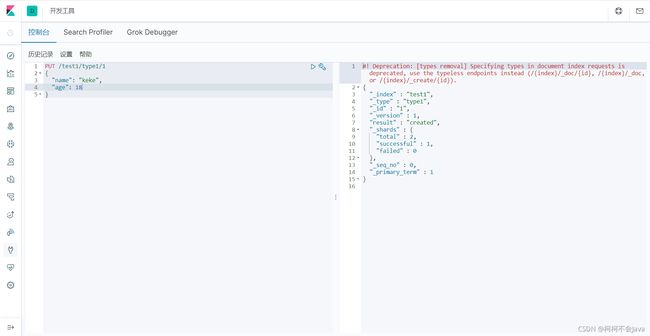

创建索引

PUT /索引名/~类型名~/文档id

{请求体}

完成了自动增加索引,数据也成功添加了,这就是初期可以将它当做数据库学习的原因

那么name这个字段用不用指定类型呢。毕竟我们关系型数据库是需要指定类型的啊!

指定类型

-

字符串类型

text ,keyword

-

数值类型

long, integer, short, byte, double, float, half float, scaled float

-

日期类型

date

-

te布尔值类型

boolean

-

二进制类型

binary

等等…

指定字段的类型

获取规则

可以通过GET请求获取具体的信息

查看默认信息

创建索引

注意:类型名慢慢会被弃用,默认为_doc

如果自己的文档字段没有指定,那么es就会给我们默认配置字段类型

扩展

通过命令elasticsearch索引情况!通过GET _cat/ 可以获得es当前的很多信息

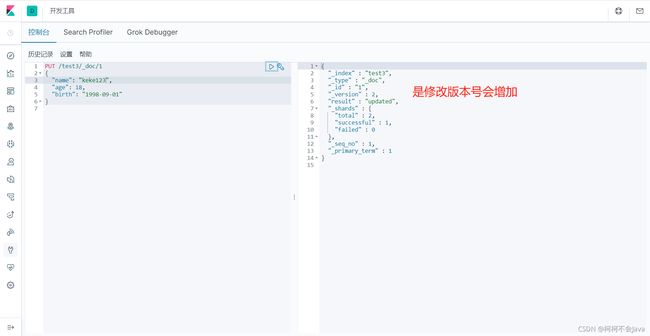

修改索引

曾经的方法:还是使用PUT即可,进行覆盖!

现在的方法

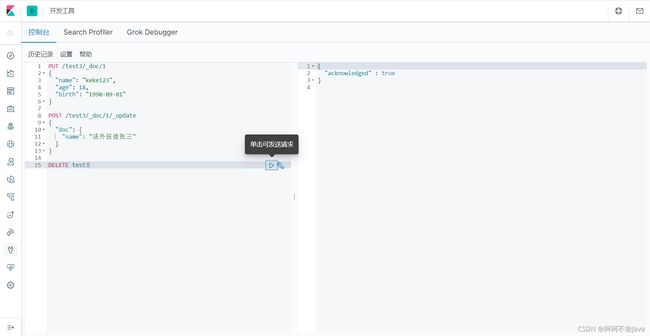

删除索引

通过DELETE命令实现删除,根据你的请求来判断是删除索引还是删除文档

使用Restful风格是es推荐大家使用的!

关于文档的基础操作

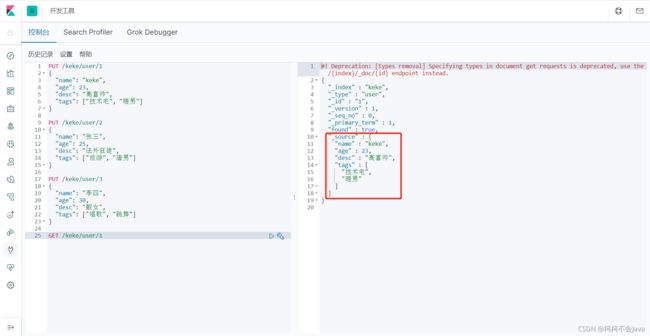

创建文档

//创建一个索引keke,该索引下创建一个类型user,该类型下创建一个文档1

PUT /keke/user/1

{

"name": "keke",

"age": 23,

"desc": "高富帅",

"tags": ["技术宅", "暖男"]

}

PUT /keke/user/2

{

"name": "张三",

"age": 25,

"desc": "法外狂徒",

"tags": ["旅游", "渣男"]

}

PUT /keke/user/3

{

"name": "李四",

"age": 30,

"desc": "靓女",

"tags": ["唱歌", "跳舞"]

}

修改文档

PUT /keke/user/3

{

"name": "李四2333",

"age": 30,

"desc": "靓女",

"tags": ["唱歌", "跳舞"]

}

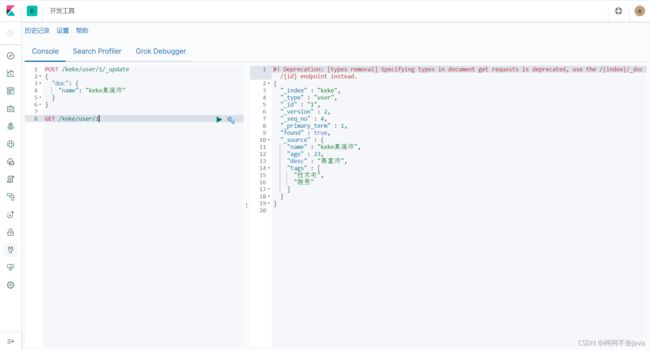

修改文档PLUS

Put,如果有的字段不传递数据的话,就会被覆盖为空

Post _update,推荐使用这种更新方式,好处:精确修改,只改动需要修改的字段

POST /keke/user/1/_update

{

"doc": {

"name": "keke真滴帅"

}

}

简单查询

GET /keke/user/1

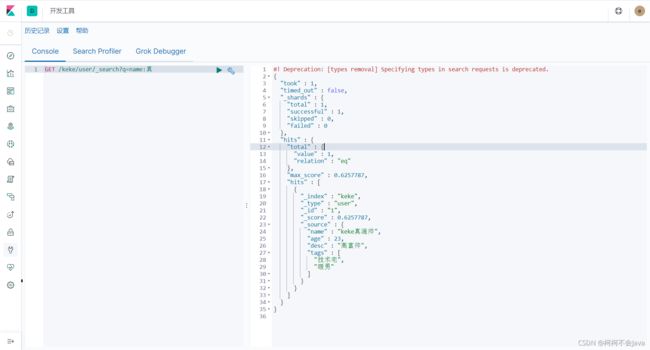

简单条件查询

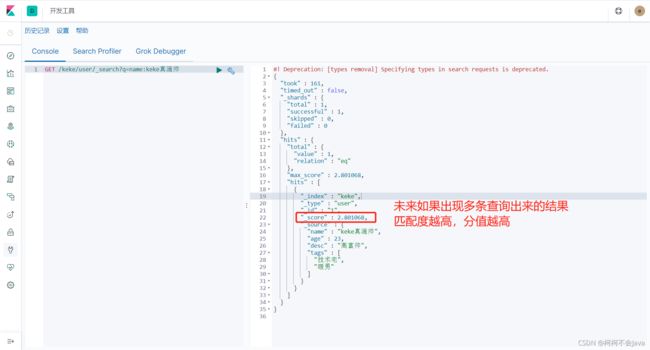

GET /keke/user/_search?q=name:真

GET /keke/user/_search?q=name:keke真滴帅

复杂查询

例如:排序、分页、高亮、模糊查询、精准查询

模糊查询

//查询的参数体使用json构建

GET /keke/user/_search

{

"query": {

"match": {

"name": "keke"

}

}

}

match:会使用分词器解析,(先分析文档,然后再通过分析的文档进行查询!)

过滤字段

GET /keke/user/_search

{

"query": {

"match": {

"name": "keke"

}

},

"_source": ["name", "desc"]

}

注意:我们以后使用Java操作es,所有的方法和对象就是这里的key

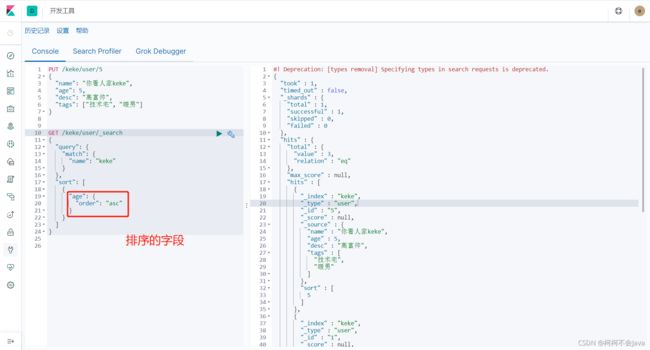

排序

GET /keke/user/_search

{

"query": {

"match": {

"name": "keke"

}

},

"sort": [

{

"age": {

"order": "asc"

}

}

]

}

根据age升序

分页

GET /keke/user/_search

{

"query": {

"match": {

"name": "keke"

}

},

"sort": [

{

"age": {

"order": "asc"

}

}

],

"from": 0,

"size": 1

}

数据下标还是从0开始,和其他所学的数据结构是一样的

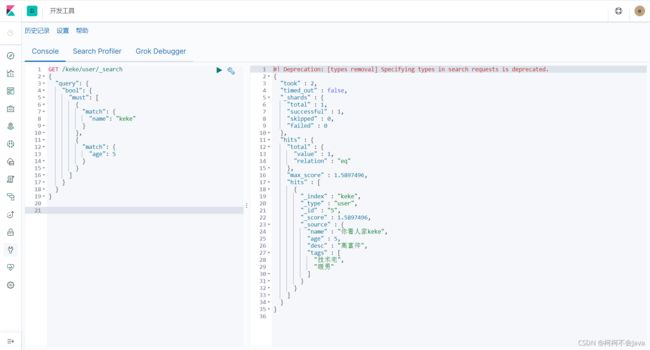

布尔值查询

must

must(and),所有的条件都要符合,相当于mysql的语句:where id = 1 and name = xxx,但是这里的匹配不是精确匹配,也不是mysql那种模糊匹配,是分词匹配

GET /keke/user/_search

{

"query": {

"bool": {

"must": [

{

"match": {

"name": "keke"

}

},

{

"match": {

"age": 5

}

}

]

}

}

}

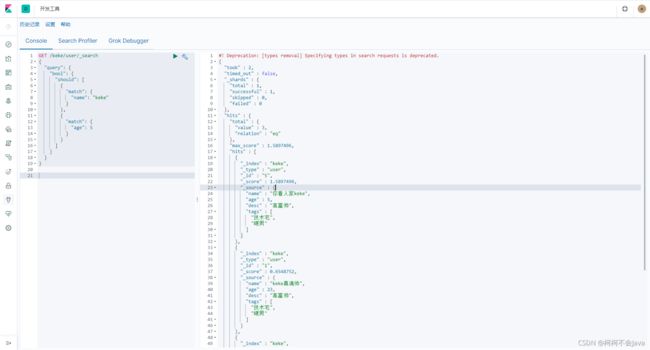

should

should(or),所有的条件都要符合,相当于mysql的语句:where id = 1 or name = xxx

GET /keke/user/_search

{

"query": {

"bool": {

"should": [

{

"match": {

"name": "keke"

}

},

{

"match": {

"age": 5

}

}

]

}

}

}

must_not

must_not(not),相当于mysql里面的不等于!=

GET /keke/user/_search

{

"query": {

"bool": {

"must_not": [

{

"match": {

"age": 5

}

}

]

}

}

}

过滤器 filter

GET /keke/user/_search

{

"query": {

"bool": {

"must": [

{

"match": {

"name": "keke"

}

}

],

"filter": {

"range": {

"age": {

"gte": 10,

"lte": 30

}

}

}

}

}

}

- gt 大于

- gte 大于等于

- lt 小于

- lte 小于等于

多条件查询

GET /keke/user/_search

{

"query": {

"match": {

"tags": "男 技术"

}

}

}

精确查询

term查询是直接通过倒排索引指定的词条进行精确的查找

关于分词

-

match:模糊匹配,需要指定字段名,但是输入会进行分词,比如"hello world"会进行拆分为hello和world,然后匹配,如果字段中包含hello或者world,或者都包含的结果都会被查询出来,也就是说match是一个部分匹配的模糊查询。查询条件相对来说比较宽松。

-

term:当索引中数据字段类型是text,这种字段会根据分词器分词,比如该字段数据为hello world,elasticsearch会对字段内容进行分词,"hello world"会被分成hello和world,此时我们查询单个的词hello,也会被查询出来;但是输入hello world,不会被查询出来。

当索引中数据字段类型是keyword,这种字段不会根据分词器分词,比如该字段数据为hello world,elasticsearch不会对字段内容进行分词,"hello world"就是hello world,此时我们查询单个的词hello,不会被查询出来;但是输入hello world,会被查询出来。

两个类型

text

-

会进行分词,分词后建立索引。比如:对于‘佟永硕’,ik分词器的smart分词会自动将其分成佟、永、硕三个字符进行建立索引,所以单字符搜索可以搜索到,而比如‘永硕’则搜索不到。

-

支持模糊查询,支持准确查询。

-

不支持聚合查询。

keyword

-

不分词,直接建立索引。据此特点,可以使用keyword类型+wildcardQuery(通配查询)实现类似sql的like查询(模糊搜索)

-

支持模糊查询,支持准确查询。

-

支持聚合查询。

GET _analyze

{

"analyzer": "keyword",

"text": "keke真滴帅 name"

}

GET _analyze

{

"analyzer": "standard",

"text": "keke真滴帅 name"

}

创建索引测试

//创建

PUT testdb

{

"mappings": {

"properties": {

"name": {

"type": "text"

},

"desc": {

"type": "keyword"

}

}

}

}

PUT testdb/_doc/1

{

"name": "keke真滴帅 name",

"desc": "keke真滴帅 desc"

}

PUT testdb/_doc/2

{

"name": "keke真滴帅 name",

"desc": "keke真滴帅 desc2"

}

//查询

//文档1、2都可以查询出来

GET testdb/_search

{

"query": {

"term": {

"name": "真"

}

}

}

//文档1、2都不可以查询出来

GET testdb/_search

{

"query": {

"term": {

"name": "keke真滴帅 name"

}

}

}

//文档1、2都不可以查询出来

GET testdb/_search

{

"query": {

"term": {

"desc": "真"

}

}

}

//文档1可以查询出来

GET testdb/_search

{

"query": {

"term": {

"desc": "keke真滴帅 desc"

}

}

}

多个值匹配精确查询

//创建

PUT testdb/_doc/3

{

"t1": "22",

"t2": "2020-4-6"

}

PUT testdb/_doc/4

{

"t1": "33",

"t2": "2020-4-7"

}

//查询

GET testdb/_search

{

"query": {

"bool": {

"should": [

{

"term": {

"t1": "22"

}

},

{

"term": {

"t1": "33"

}

}

]

}

}

}

高亮查询

GET keke/user/_search

{

"query": {

"match": {

"name": "keke"

}

},

"highlight": {

"fields": {

"name": {}

}

}

}

自定义高亮条件

GET keke/user/_search

{

"query": {

"match": {

"name": "keke"

}

},

"highlight": {

"pre_tags": ""

,

"post_tags": "",

"fields": {

"name": {}

}

}

}

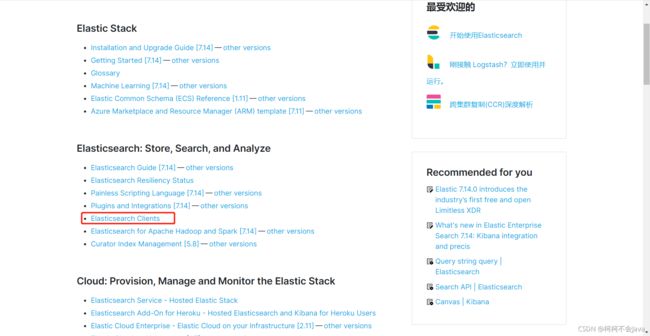

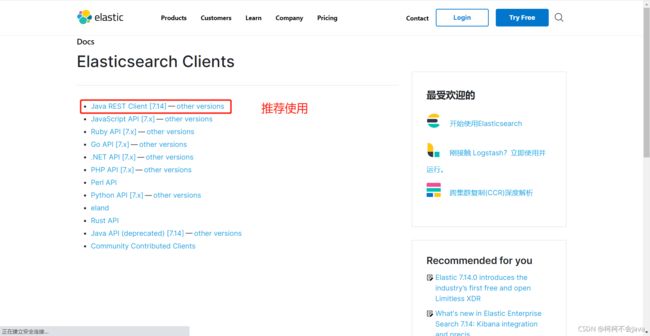

集成springboot

找官方文档

官网:https://www.elastic.co/guide/index.html

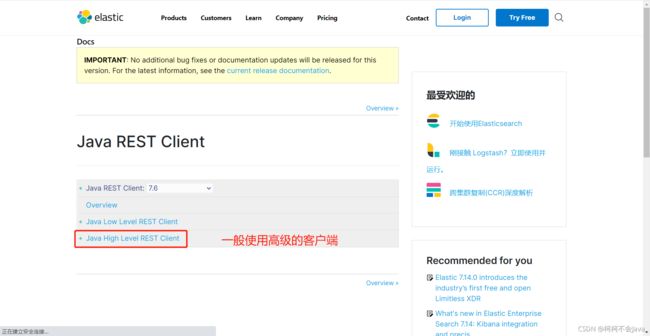

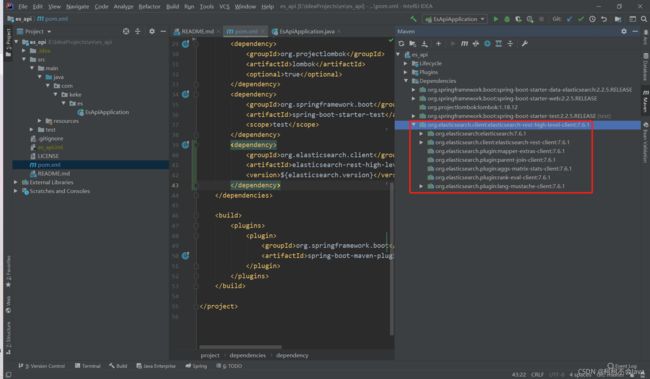

找原生的依赖

<dependency>

<groupId>org.elasticsearch.clientgroupId>

<artifactId>elasticsearch-rest-high-level-clientartifactId>

<version>7.6.2version>

dependency>

找对象

分析这个对象的方法

配置基本的项目

注意:一定要保证导入的依赖和我们的版本一致

源码中提供的对象

虽然这里导入了三个类,但都是静态内部类,核心类就一个RestClientConfigurations

//

// Source code recreated from a .class file by IntelliJ IDEA

// (powered by Fernflower decompiler)

//

package org.springframework.boot.autoconfigure.elasticsearch.rest;

import java.time.Duration;

import org.apache.http.HttpHost;

import org.apache.http.auth.AuthScope;

import org.apache.http.auth.Credentials;

import org.apache.http.auth.UsernamePasswordCredentials;

import org.apache.http.client.CredentialsProvider;

import org.apache.http.impl.client.BasicCredentialsProvider;

import org.elasticsearch.client.RestClient;

import org.elasticsearch.client.RestClientBuilder;

import org.elasticsearch.client.RestHighLevelClient;

import org.springframework.beans.factory.ObjectProvider;

import org.springframework.boot.autoconfigure.condition.ConditionalOnClass;

import org.springframework.boot.autoconfigure.condition.ConditionalOnMissingBean;

import org.springframework.boot.context.properties.PropertyMapper;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

class RestClientConfigurations {

RestClientConfigurations() {

}

@Configuration(

proxyBeanMethods = false

)

static class RestClientFallbackConfiguration {

RestClientFallbackConfiguration() {

}

@Bean

@ConditionalOnMissingBean

RestClient elasticsearchRestClient(RestClientBuilder builder) {

return builder.build();

}

}

@Configuration(

proxyBeanMethods = false

)

@ConditionalOnClass({RestHighLevelClient.class})

static class RestHighLevelClientConfiguration {

RestHighLevelClientConfiguration() {

}

//RestHighLevelClient 高级客户端,也是这里要讲的

@Bean

@ConditionalOnMissingBean

RestHighLevelClient elasticsearchRestHighLevelClient(RestClientBuilder restClientBuilder) {

return new RestHighLevelClient(restClientBuilder);

}

//RestClient 普通客户端

@Bean

@ConditionalOnMissingBean

RestClient elasticsearchRestClient(RestClientBuilder builder, ObjectProvider<RestHighLevelClient> restHighLevelClient) {

RestHighLevelClient client = (RestHighLevelClient)restHighLevelClient.getIfUnique();

return client != null ? client.getLowLevelClient() : builder.build();

}

}

@Configuration(

proxyBeanMethods = false

)

static class RestClientBuilderConfiguration {

RestClientBuilderConfiguration() {

}

//RestClientBuilder

@Bean

@ConditionalOnMissingBean

RestClientBuilder elasticsearchRestClientBuilder(RestClientProperties properties, ObjectProvider<RestClientBuilderCustomizer> builderCustomizers) {

HttpHost[] hosts = (HttpHost[])properties.getUris().stream().map(HttpHost::create).toArray((x$0) -> {

return new HttpHost[x$0];

});

RestClientBuilder builder = RestClient.builder(hosts);

PropertyMapper map = PropertyMapper.get();

map.from(properties::getUsername).whenHasText().to((username) -> {

CredentialsProvider credentialsProvider = new BasicCredentialsProvider();

Credentials credentials = new UsernamePasswordCredentials(properties.getUsername(), properties.getPassword());

credentialsProvider.setCredentials(AuthScope.ANY, credentials);

builder.setHttpClientConfigCallback((httpClientBuilder) -> {

return httpClientBuilder.setDefaultCredentialsProvider(credentialsProvider);

});

});

builder.setRequestConfigCallback((requestConfigBuilder) -> {

properties.getClass();

map.from(properties::getConnectionTimeout).whenNonNull().asInt(Duration::toMillis).to(requestConfigBuilder::setConnectTimeout);

properties.getClass();

map.from(properties::getReadTimeout).whenNonNull().asInt(Duration::toMillis).to(requestConfigBuilder::setSocketTimeout);

return requestConfigBuilder;

});

builderCustomizers.orderedStream().forEach((customizer) -> {

customizer.customize(builder);

});

return builder;

}

}

}

具体的API操作

关于索引的API操作

1、创建索引

2、判断索引是否存在

3、删除索引

关于文档的API操作

1、添加文档

2、判断文档是否存在

3、获取文档的信息

4、更新文档的信息

5、删除文档的记录

6、批量添加文档

7、查询文档

实战

使用爬虫技术将京东页面数据爬取下来,并模仿京东的页面进行展示!

爬虫

数据问题

数据库获取、消息队列中获取、爬虫(本处使用)!

项目功能

1、爬取京东页面数据存入es

2、搜索数据

3、搜索数据高亮显示

项目地址

集成spring boot和实战项目地址:https://gitee.com/chiyutoBeBest/es_api