监督学习和非监督学习, 半监督学习和增强学习

监督学习

给机器的训练数据拥有“标记”或者“答案”, 也就是又有x、又有y

监督的意思是说我们针对给机器的数据进行了正确答案的划分, 这个正确的答案的本身就被称为监督的信息

比如:

生活中很多学习的过程都是监督学习的过程, 比如:

- 图像已经拥有了标定信息

- 银行已经积累了一定的客户信息和他们信用卡的信用情况

- 医院已经积累了一定的病人信息和他们最终确诊是否患病的情况

- 市场积累了房屋的基本信息和最终成交的金额

我们这个专栏中学习的大部分算法, 都属于监督学习算法, 之所以这样是因为我们主要把精力放在分类和回归这两大类任务, 而监督学习的算法主要处理这两类任务的, 而非监督学习算法的核心是辅助监督学习的进行

非监督学习

在生活中的很多场景都可以使用聚类分析的, 比如我们每一位顾客去访问电商网站, 在这个电商网站上留下的各种购买信息留下不同的数据, 初始时候电商网站对我们是同等对待的, 没有这些标记的, 而随着浏览信息的增多, 电商网站开始对这些用户群体进行分类。

非监督学习的意义

非监督学习可以完成的另外一个重要的工作就是对数据进行降维处理, 对数据进行降维处理主要包含两部分内容, 第一部分就是特征提取

特征提取是一项相对简单的任务。当我们处理一个数据集时,数据通常包含各种各样的特征。有时候,我们可以根据自己的经验或深入的分析来判断某些特征对我们最终的预测或计算结果是否有贡献。举个简单的例子,如果我们需要预测明天的天气,我们可能会考虑诸如温度、湿度、风速等特征,但不考虑今天的日期等无关紧要的特征, 所以我们就把这些特征扔掉, 这就叫特征提取。特征提取的目标是从数据中选择和提取出与问题或任务相关的特征,以便进行进一步的分析或建模。

- 特征提取:比如信用卡的信用评级和人的胖瘦无关?

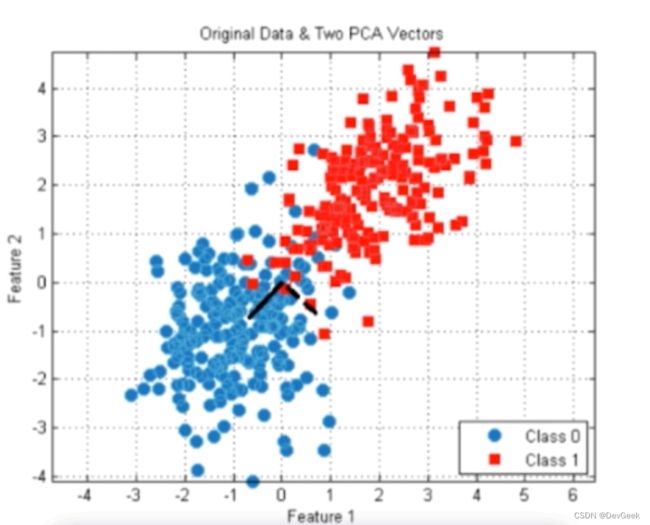

- 特征压缩:PCA

特征压缩是一项重要的工作,它的目标是在尽量减少信息损失的情况下,将高维特征向量压缩成低维特征向量。这可以大幅提高机器学习算法的效率,尤其在处理高维数据时非常有用。

一个简单的例子是在二维特征平面上,当数据点分布呈直线状时,可以通过将这些点映射到一条倾斜的直线上,从而将二维数据压缩成一维数据,而几乎不损失信息。这种思想可以应用于更高维度的数据。

对于像手写数字识别这样的任务,原始数据可能是28x28像素的图像,拥有784个特征。但通过特征压缩,可以用更少的特征来表达同样的信息,从而提高算法的效率。主成分分析(PCA)是特征压缩的一种主要工具,它可以帮助找到最能代表数据分布的主要特征。

为什么要降维?

降维的意义:方便可视化

降维在数据分析和可视化中的重要性无法忽视。降维的一个主要目的是为了方便数据的可视化,因为对于人类来说,理解高维度空间的信息非常困难甚至不可能。

当我们将高维数据降维到三维或二维时,虽然会丢失一些信息,但这是出于可视化的需要。通过将数据映射到较低维度的空间,我们可以更容易地创建散点图、3D图表或二维图表来展示数据的分布和关系。这使得我们能够更直观地理解数据的结构、模式和异常情况。

降维可视化对于探索性数据分析(EDA)、数据挖掘和机器学习模型的解释性都非常有帮助。例如,主成分分析(PCA)可以将高维数据降维到低维,并且通常用于数据可视化和特征选择。其他降维技术如 t-SNE(t-distributed stochastic neighbor embedding)也用于可视化高维数据。

尽管在降维过程中可能会损失一些信息,但这种损失通常可以接受,因为它带来了更好的可视化和理解能力,有助于更好地解释数据和模型的行为。因此,降维是数据分析中非常有用的工具之一。

非监督学习除了可以完成降维的任务以外还可以完成异常检测

非监督学习在数据分析中的应用还包括异常检测,这是一项非常重要的任务。异常检测的目标是识别在数据中具有明显异常或异常特性的数据点。这些异常点可能是数据集中的噪声、错误、或者是代表罕见事件的数据。

在上面的例子中,二维特征空间中的两个红点被认为是异常点,因为它们与蓝点相比,具有明显不同的特性或分布。异常点通常不能很好地表示数据集的一般特征,那么对于这种特殊的点,让我们的算法发现这种一般性的规律

很有可能是没有帮助的,因此在某些情况下,将它们从数据中剔除是有益的。

在高维数据集中,异常点的识别更加复杂,因为人类难以直观地观察到高维空间中的数据分布。因此,非监督学习算法在这方面发挥了重要作用。一些常用于异常检测的非监督学习技术包括:

-

基于聚类的方法:将数据点分成群集,异常点通常不属于任何群集或是单独的群集。

-

基于密度的方法:检测稀疏区域中的异常点,这些区域可能表示异常情况。

-

基于统计的方法:使用统计模型来估计数据的分布,并识别与该分布明显不符的数据点。

-

降维方法:将数据降维后,异常点可能更容易被观察到,例如,通过PCA等降维技术。

异常检测在许多领域都有应用,包括金融领域的欺诈检测、工业制造中的设备故障检测以及网络安全中的入侵检测等。通过非监督学习,可以帮助自动识别和处理这些异常情况,提高数据质量和安全性。

半监督学习

一部分数据有“标记”或者“答案”,另一部分数据没有

更常见:各种原因产生的标记缺失

通常都先使用无监督学习手段对数据做处理,之后使用监督学习手段做模型的训练和预测->相当与无监督学习和监督学习的结合

增强学习

根据周围环境的情况,采取行动,根据采取行动的结果,学习行动方式。

Agent代表机器学习的一些算法;reward代表使用奖赏的机制来进行反馈

Agent得到了反馈之后就会相应的改进自己的行为模式, 之后根据改进的算法做出相应的action, 然后继续反馈, Agent是在反馈循环中逐渐的来增强自己的智能

增强学习非常适用于机器人等这样的任务, AlphaGo就是增强学习的应用, AlphaGo在与人类对弈或与自己对弈的过程中,每一次下棋都是与环境进行互动的一次。在这个互动之后,AlphaGo需要考虑刚才的落子是否明智,对手的反应如何,以及下一步是否需要改进策略。这种学习过程是通过与环境的交互和反馈来实现的。

实际上,最先进的技术,无论是用于无人驾驶汽车还是用于具有强人工智能特性的机器人,都需要使用增强学习这个领域的知识。增强学习允许这些系统通过与环境的互动来学习,并根据不同的情况进行决策,以达到最优的目标。这种学习方式在许多领域都有广泛的应用,包括游戏、自动化控制、金融等。

增强学习是一种重要的机器学习方法,它涉及到智能体与环境的交互,通过试错来学习和优化策略,以最大化某种目标函数的值。它在实现复杂任务和决策中发挥了关键作用。

在增强学习领域, 监督学习和半监督学习是基础