【ElM分类】基于遗传算法优化ElM神经网络实现数据分类附matlab代码

✅作者简介:热爱科研的Matlab仿真开发者,修心和技术同步精进,matlab项目合作可私信。

个人主页:Matlab科研工作室

个人信条:格物致知。

更多Matlab完整代码及仿真定制内容点击

智能优化算法 神经网络预测 雷达通信 无线传感器 电力系统

信号处理 图像处理 路径规划 元胞自动机 无人机

⛄ 内容介绍

在当今数据驱动的世界中,数据分类是一项至关重要的任务。通过对数据进行分类,我们可以从中获取有价值的信息和见解,从而做出更明智的决策。在机器学习领域,有许多不同的算法和技术可用于数据分类,其中包括神经网络。

神经网络是一种模仿人脑神经系统的计算模型,它由多个神经元组成,这些神经元通过连接来传递信息。神经网络已经在各个领域取得了显著的成功,尤其是在图像和语音识别方面。然而,传统的神经网络在训练过程中需要大量的计算资源和时间,并且容易陷入局部最优解。

为了克服这些问题,近年来出现了一种新的神经网络算法,即极限学习机(Extreme Learning Machine,简称ElM)。ElM是一种单层前馈神经网络,其隐藏层的权重和偏差是随机初始化的,而输出层的权重则通过最小二乘法进行计算。相比传统的神经网络,ElM具有更快的训练速度和更好的泛化能力。

然而,ElM在处理复杂数据分类问题时仍然存在一些挑战。为了进一步提高ElM的性能,我们可以使用遗传算法对ElM进行优化。遗传算法是一种模拟自然进化过程的优化算法,通过遗传操作(如选择、交叉和变异)来搜索最优解。通过将遗传算法与ElM相结合,我们可以找到更好的权重和偏差配置,从而提高ElM的分类准确性。

优化ElM神经网络的过程可以分为以下几个步骤:

-

数据准备:首先,我们需要准备用于训练和测试的数据集。数据集应该包含已标记的样本,并且应该经过预处理以消除噪声和不必要的特征。

-

ElM模型构建:接下来,我们需要构建ElM神经网络模型。ElM包括输入层、隐藏层和输出层。隐藏层的神经元数量可以根据问题的复杂性进行调整。

-

遗传算法优化:然后,我们使用遗传算法对ElM进行优化。遗传算法的参数设置和操作选择将对优化结果产生重要影响。我们可以通过交叉验证等技术来选择最佳参数和操作。

-

训练和测试:接下来,我们使用优化后的ElM模型对训练数据进行训练,并使用测试数据进行评估。通过比较预测结果和实际标签,我们可以计算分类准确性和其他评估指标。

通过以上步骤,我们可以实现基于遗传算法优化的ElM神经网络的数据分类。这种方法在处理复杂数据集时具有较好的性能,并且可以提供高准确性的分类结果。

总结起来,ElM是一种有效的神经网络算法,它通过随机初始化隐藏层权重和偏差,通过最小二乘法计算输出层权重。然而,为了进一步提高ElM的性能,我们可以使用遗传算法进行优化。通过将遗传算法与ElM相结合,我们可以找到更优的权重和偏差配置,从而提高ElM的分类准确性。这种基于遗传算法优化的ElM神经网络方法在数据分类中具有广泛的应用前景,可以帮助我们从数据中获得更准确和有用的信息。

⛄ 部分代码

% BS2RV.m - Binary string to real vector%% This function decodes binary chromosomes into vectors of reals. The% chromosomes are seen as the concatenation of binary strings of given% length, and decoded into real numbers in a specified interval using% either standard binary or Gray decoding.%% Syntax: Phen = bs2rv(Chrom,FieldD)%% Input parameters:%% Chrom - Matrix containing the chromosomes of the current% population. Each line corresponds to one% individual's concatenated binary string% representation. Leftmost bits are MSb and% rightmost are LSb.%% FieldD - Matrix describing the length and how to decode% each substring in the chromosome. It has the% following structure:%% [len; (num)% lb; (num)% ub; (num)% code; (0=binary | 1=gray)% scale; (0=arithmetic | 1=logarithmic)% lbin; (0=excluded | 1=included)% ubin]; (0=excluded | 1=included)%% where% len - row vector containing the length of% each substring in Chrom. sum(len)% should equal the individual length.% lb,% ub - Lower and upper bounds for each% variable.% code - binary row vector indicating how each% substring is to be decoded.% scale - binary row vector indicating where to% use arithmetic and/or logarithmic% scaling.% lbin,% ubin - binary row vectors indicating whether% or not to include each bound in the% representation range%% Output parameter:%% Phen - Real matrix containing the population phenotypes.%% Author: Carlos Fonseca, Updated: Andrew Chipperfield% Date: 08/06/93, Date: 26-Jan-94function Phen = bs2rv(Chrom,FieldD)% Identify the population size (Nind)% and the chromosome length (Lind)[Nind,Lind] = size(Chrom);% Identify the number of decision variables (Nvar)[seven,Nvar] = size(FieldD);if seven ~= 7error('FieldD must have 7 rows.');end% Get substring propertieslen = FieldD(1,:);lb = FieldD(2,:);ub = FieldD(3,:);code = ~(~FieldD(4,:));scale = ~(~FieldD(5,:));lin = ~(~FieldD(6,:));uin = ~(~FieldD(7,:));% Check substring properties for consistencyif sum(len) ~= Lind,error('Data in FieldD must agree with chromosome length');endif ~all(lb(scale).*ub(scale)>0)error('Log-scaled variables must not include 0 in their range');end% Decode chromosomesPhen = zeros(Nind,Nvar);lf = cumsum(len);li = cumsum([1 len]);Prec = .5 .^ len;logsgn = sign(lb(scale));lb(scale) = log( abs(lb(scale)) );ub(scale) = log( abs(ub(scale)) );delta = ub - lb;Prec = .5 .^ len;num = (~lin) .* Prec;den = (lin + uin - 1) .* Prec;for i = 1:Nvar,idx = li(i):lf(i);if code(i) % Gray decodingChrom(:,idx)=rem(cumsum(Chrom(:,idx)')',2);endPhen(:,i) = Chrom(:,idx) * [ (.5).^(1:len(i))' ];Phen(:,i) = lb(i) + delta(i) * (Phen(:,i) + num(i)) ./ (1 - den(i));endexpand = ones(Nind,1);if any(scale)Phen(:,scale) = logsgn(expand,:) .* exp(Phen(:,scale));end

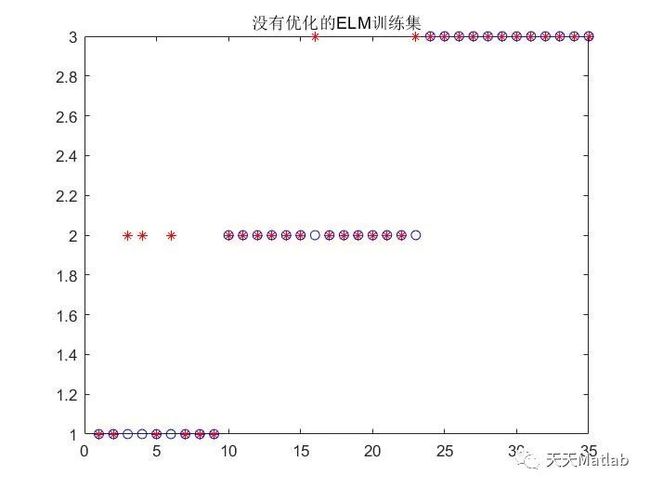

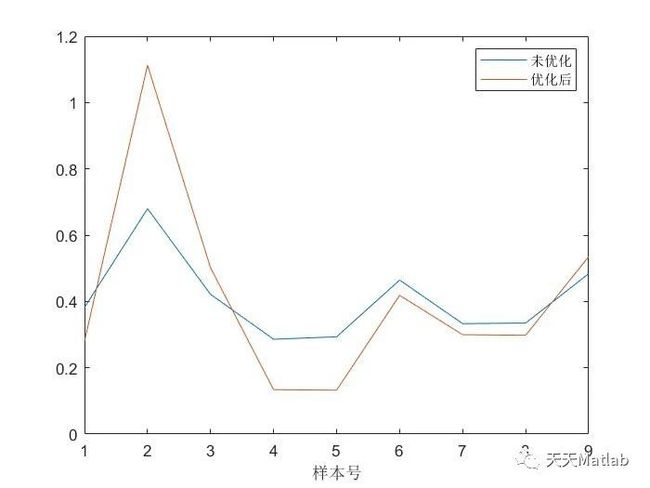

⛄ 运行结果

⛄ 参考文献

[1] 刘子诺.基于秃鹰搜索算法和极限学习机的股票价格预测模型[J].中国管理信息化, 2022, 25(22):157-160.

[2] 徐翠.改进极限学习机亚健康识别算法研究[D].辽宁大学,2016.

[3] 秦岭,王东星,史明泉,等.基于遗传算法优化ELM神经网络的室内可见光定位系统[J].中国激光, 2022, 49(21):10.DOI:10.3788/CJL202249.2106001.

[4] 姚鹏.基于遗传算法的加权ELM分类模型中权重学习[D].深圳大学,2018.