人工神经网络模型发展及应用综述

摘要:机器学习这一词不断的出现在网络上,也是近几年受欢迎的热词,而机器学习的基础算法就是人工神经网络,人工神经网络的研究是当下各种网络的基础,也越来越受人们的关注,现在人工神经网络的发展在当下不管是理论、方法以及应用都获得了巨大的成果。本文介绍的人工神经网络的基本理论、模型以及特征特点、优势与劣势,与BP、CNN、RNN、LSTM对比以及简要概括了他的发展空间与发展前景并且给予了之后发展建议。

关键词:ANN 机器学习 神经网络

Overview of the development and application of artificial neural network models

Liu Xin

(School of Information Engineering, Hebei University of Technology, Tianjin 300401,China)

Abstract:

The machine learning continues to appear on the Internet, and it is also a popular word in recent years. The basic algorithm of machine learning is artificial neural network. The research of artificial neural network is the foundation of various networks at present, and it is becoming more and more popular. By people's attention, the current development of artificial neural networks has achieved great results in both theories, methods and applications. The basic theories, models, characteristics, advantages and disadvantages of the artificial neural network are introduced in this article. And artificial neural network are compared with BP, CNN, RNN, and LSTM, and its development space and prospects are briefly summarized and recommendations for its future development are given.

Keywords: ANN Machine Learning Artificial Neural Network

1 前言

近几年,人工智能一词备受欢迎,而机器学习便是一种实现人工智能的方法,机器学习避免不了会有各种算法,人工神经网络是早期机器学习中一种重要的算法,之后随着层数的增加,便是加入了“深度”,由此深度学习也越来越受到关注。

人工神经网络(ANN)的发展历程可谓是曲折多变,经过了低谷期之后才不断地被人们发现并进行发展,第三部分会具体概述。

人工神经网络之后会广泛的应用确实是存在了许多优势,任何精度逼近任意连接非线性函数(NL系统的统一描述)对复杂不确定问题具有自适应、学习能力;除此之后是并行机制,解决实时计算问题,具有冗余性容错能力还可以进行信息融合,应用于多媒体技术,具有较好的自学习能力,联想存储、高速地去寻找优化解的能力。

为此,人工神经网络是基本且令人兴奋的研究领域,它有很大的发展潜力。

2 方法原理(或算法及改进)

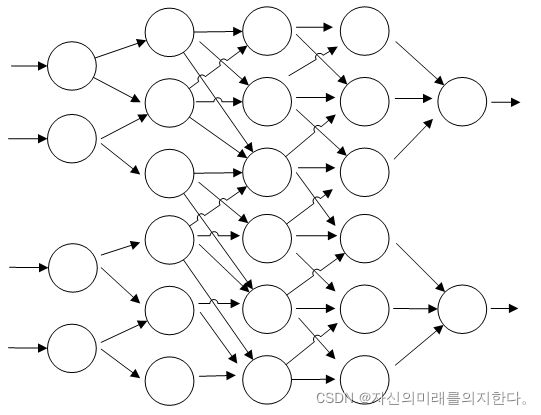

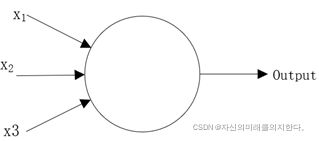

神经元是人工神经网络最小的单元,也是最重要、最基本的,神经元相互连接并且有着强大的处理能力,就像是生物神经系统一样,ANNs总是要试着去模拟人脑神经元的结构,基本结构如图所示:

图 1 ANN模拟人神经元结构

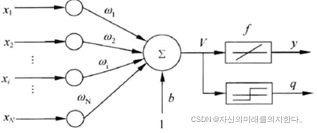

每个神经元都有输入连接和输出连接。这些连接模拟了大脑中突触的行为。与大脑中突触传递信号的方式相同——信号从一个神经元传递到另一个神经元,这些连接也在人造神经元之间传递信息。每一个连接都有权重,这意味着发送到每个连接的值要乘以这个因子。再次强调,这种模式是从大脑突触得到的启发,权重实际上模拟了生物神经元之间传递的神经递质的数量。所以,如果某个连接重要,那么它将具有比那些不重要的连接更大的权重值。由于可能有许多值进入一个神经元,每个神经元便有一个所谓的输入函数。通常,连接的输入值都会被加权求和。然后该值被传递给激活函数,激活函数的作用是计算出是否将一些信号发送到该神经元的输出,也就是选择出有用的部分留下来。在每个ANN 中有多层神经元,如图所示:

图 2 多层神经元

人工神经系统首先要说的就是神经元的计算,神经元和感知机本质是一样的,只不过两者的激活函数不同,感知机的激活函数是阶跃函数,神经元的激活函数是sigmoid函数或者tanh函数。

激活函数非常重要,最简单的结构是没有激活函数,但是如果没有激活函数,那么输入输出就只有呈现线性关系,加入激活函数就是加入了非线性元素,解决了一些线性模型无法解决的问题,计算激活函数的梯度,反向传播的误差信号以此来更新优化参数。

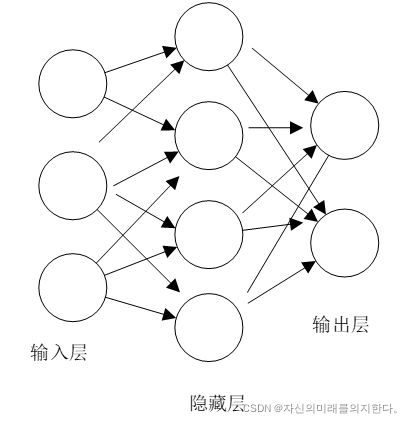

常见的普通的一些神经网络是一个全连接层。下图为一个普通的全连接网络,层与层之间完全是连接的,同一个层内神经元之间没有连接也就是层之内的神经元没有关系。当我们说N层神经网络时,通常除去了第一层的输入层,因此单层神经网络就是没有隐层的神经网络(输入到输出,也就是只算输出层)。下图为一个2层的神经网络,隐藏层由4个神经元组成,输出由2个神经元组成,如图所示:

图 3 2层神经网络

计算神经元的方法也可以从图中看出来,对输入求加权和:

y=f( W1*x1+W2*x2+ ……Wn*xn)=f(ΣWi*xi)(1)

其中f为激活函数

神经网络的学习也称为训练,主要使用有指导的学习,根据给定的训练样本,调整参数以使得网络接近已知样本的类标记。神经网络的训练主要包括两个部分:正向传播和反向传播两个过程。正向传播得到损失值(loss),反向传播得到梯度。最后通过梯度值完成权值更新。所谓梯度其实就是一个偏导数向量,但是我们经常说的仍是‘x的梯度’而不是‘x的偏导数’。前向传播并不在意中间输出是什么,而是在意最后输出层的输出结果是什么。也就是先求出来加权和,举个例子也就是:这里是输入层到隐藏层的输出:

aj =gj(aiwij+bj)

Zj1=i1*w1+i2*w2+1*0.4

=0.05*0.15+0.1*0.2+0.45=0.4775 ⑵

然后神经元j1的输出值(也就是输出层的输入值)也就是:

aj1=gjzj1=sigmoid0.4775=0.617 ⑶

这里的sigmoid也可以是别的函数(tanh...)看你如何选择,一般大多数选择sigmoid。然后进行隐藏层到输出层的(也就是求出来的j1输入到输出层)

zk1=j1*w7+j2*w8+j3*w9+1*0.85

=0.617*0.5+0.621*0.55+0.624*0.6+0.85 =1.87445 ⑷

神经元k1的最后在输出层的输出值为

ak1=gkzk1=sigmoid1.87445=0.867

于是得到了一路的输出也就是得到神经网络的输出值为0.867和实际值0.01相差甚远,可以计算k1的误差

Ek1=12(0.867-0.01)2=0.367 ⑸

总的误差也就是所有路的误差之和。接下来训练就会进行反向传播,反向传播就是通过求梯度来进行权值更新,最后完成训练。

提到人工神经网络那就不得不提到一些经典的网络结构模型,BP(反向传播)、CNN(卷积神经网络)、RNN(循环神经网络)、LSTM(RNN的拓展):长短时记忆网络。

对于BP神经网络,误差反向传播算法简称为反向传播算法(BP算法)。使用反向传播算法的多层感知器又称为BP神经网络。BP算法是一个迭代算法,它的基本思想为:

(1)先计算每一层的状态和激活值,直到最后一层(即信号是前向传播的);

(2)计算每一层的误差,误差的计算过程是从最后一层向前推进的(这就是反向传播算法名字的由来);

(3)更新参数(目标是误差变小)。迭代前面两个步骤,直到满足停止准则(比如相邻两次迭代的误差的差别很小)。

于是就有了反向传播先进行输出层的权重参数更新,再进行隐藏层的权重参数传播,还有隐藏层和输出层的偏置权重更新。它的结构图如图所示

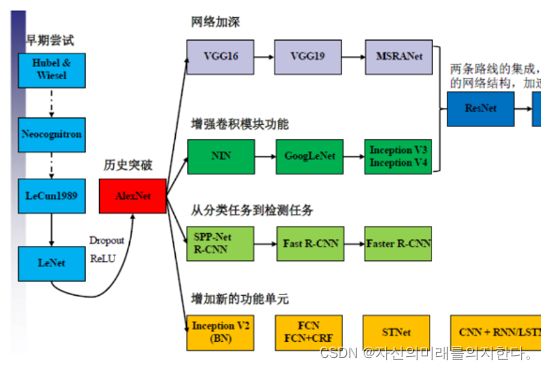

CNN的网络结构发展最多,最适用于图像分类,也是最经典的用处。CNN发展历程如图所示:

图 4 CNN发展历程

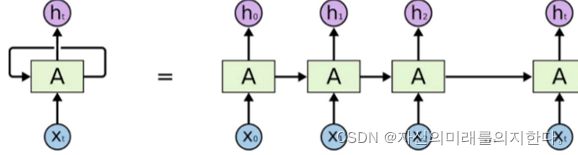

RNN作为循环神经网络,在如今发展速度持续上升,RNN是包含循环的网络,可以把信息从上一步传递到下一步,RNN的循环展开之后其实就是同一个网络复制多份,次序连接进行信息传递,RNN的结构图如图所示:

图 5 RNN结构图

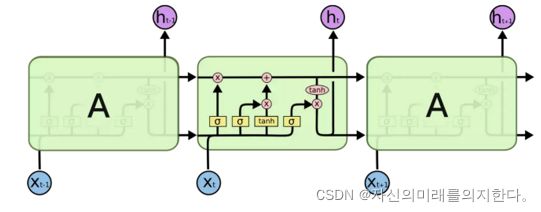

同样的道理,LSTM的网络架构大体上与RNN相似,但是他中A的结构较为复杂,毕竟LSTM是RNN的延伸,LSTM的结构图如图所示:

图 6 LSTM结构图

LSTM重复结构的A中有四层,LSTM最重要的核心思想也就是cell state,贯穿每个重复结构的上边这条flow,如图所示:

图 7 cell state

这条flow,每当流经一个重复结构A的时候就会有相应的操作来舍弃什么旧的信息以及添加什么新的信息,这一个小块也就是有三个门,分别是遗忘门、输入门、输出门。

这部分是遗忘门,是用来决定从cell state舍弃什么信息。

图 8 遗忘门

人工神经网络优势有许多,任何精度逼近任意连接非线性函数(NL系统的统一描述),对复杂不确定问题具有自适应、学习能力;并行机制,解决实时计算问题,具有冗余性容错能力,具有自学习能力,联想存储功能、高速寻找优化解能力。以下为这些网络对比总结,如表1:

表 1 多种网络对比

| 名称 |

机制 |

优点 |

缺点 |

适用场景 |

| MLP(多层神经网络/多层感知机/人工神经网络) |

各层神经元全连接 |

非线性映射、并行性高、全局优化 |

泛化能力差、处理多维数据差 |

可以处理回归任务,应用于模式识别、优化计算,不建立做复杂问题 |

| BP |

梯度下降局部优化 |

非线性映射、自适应能力 |

易出现局部最优、预测精度低、收敛慢 |

结合粒子群、退火算法等优化算法应用于模式识别控制、数据建模 |

| CNN(卷积神经网络) |

卷积核特征提取,降采样保留信息 |

稀疏连接、权值共享 |

计算量大,输入图像尺寸固定 |

适合用于空间数据,应用与图像语义分割等 |

| RNN(循环神经网络) |

隐藏层节点输出取决于当前节点输入和上个节点值 |

提取时序特征能力强、泛化能力相对好 |

输入输出序列不同、处理长期依赖精度下降 |

用于处理时序数据,具有记忆功能,应用于语音识别、自然语言理解 |

| LSTM(RNN的拓展),长短时记忆网络 |

细胞状态(类似传送带),只有少量的线性交互 |

在序列建模问题上有一定优势,具有长时记忆功能。 |

并行处理上存在劣势。与一些最新的网络相对效果一般。 |

适用于学习时间序列 |

人工神经网络是令人兴奋的研究领域,它有很大的发展潜力,但也同时遭受到一些尚未克服的困难。其可列举如下:

1.可处理噪声:一个人工神经网络补训练完成后,即使输入的数据中有部分遗失,它仍然有能力辨认样本。

2.不易损坏:因为人工神经网络以分布式的方法来表示数据,所以当某些单元损坏时,它依然可以正常地工作。

3.可以平行处理。

4.可以学习新的观念。

5.为智能机器提供了一个较合理的模式。

6.已经被成功地运用在某些以一般传统方法很难解决的问题上,如某些视觉问题。

7.有希望实现联合内存。

8.它提供了一个工具,来模拟并探讨人脑的功能。

3 发展现状以及应用

从40年代开始世间万物最小的是分子,构成原子。到2009年就有了30多种人工神经网络模型被开发。

人工神经网络的发展历程可以分为三个阶段:萌芽期、发展期、低谷期、复兴期、高潮期。在萌芽期有了M-P模型,M-P模型是1943年心理学家和数学家提出了神经元模型理论,开创了神经科学理论和ANN 研究的时代,当时的结构想法如图所示

图 9 神经元模型理论

随后,1949年Hebb出版了《行为的构成》一本书,第一次阐述了神经元连接权值的Hebb调整规则。到了之后的发展期,1957年Frank Rosenblatt发明了感知机以及相关学习算法,是ANN的第一个实际应用,展示了这一网络的模式识别能力。随后,1960年Widrow和Hoff提出了一种新的学习算法用于训练自适应线性网络,这种网络在结构和能力上都类似的感知机,结构如图所示

图 10 感知机结构

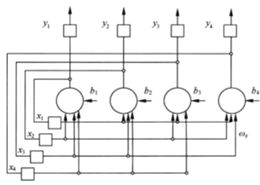

之后到达了低谷期,1969年Minsky和Papert出版了一本《perception》的书他们发信ANN 无法解决非线性问题,比如:XOR(异或问题)无法解决。但是好在Hopfield网络的提出,用能量函数的思想提出了一种新的计算方法,让ANN 重新复兴起来,结构如图所示:

图 11 离散Hopfield结构图

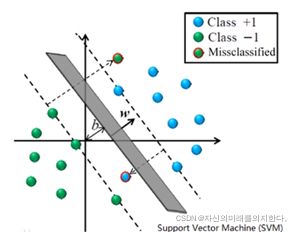

在这个复兴期间,仍然不断的发展改进,1986年误差反向网络(BP)由Rumelhant和Mcllelland提出的,解决了多层神经网络的学习问题并且证明了具有很强的学习能力。20世纪90年代早期,Vapnik等人提出了具有强大模式识别能力的网络,成为支持向量机(SVM)。支持向量机的结构如图所示:

图 12 SVM

后来深度神经网络(DNN)将ANN推向了高潮时期,Hinton等人于2006年提出。深度学习本质上是构建含有多隐层的机器学习架构模型,深度学习中最著名的CNN,是在原来多层神经网络的基础上加入了特征学习部分,卷积神经网络(CNN)最早追溯与日本学者提出的neocognitron模型,第一个卷积神经网络是1987年由Alexander Waibel提出的时间延迟网络(TDNN),完整的发展历程如图所示:

图 13 神经网络发展历程

现如今的发展让ANN有了许多广泛的应用,ANN通过模仿人类大脑的结构和功能,并借鉴生物神经科学的研究成果,实现对信息的处理,是一种新兴的交叉学科,不但推动了智能化计算的应用和发展,同时也为信息科学和神经生物学的研究方法带来革命性的变化,现已成功应用于脑科学,认知科学,模式识别,智能控制,计算机科学等多个领域。ANN的应用主要是分为,信息处理和模式分类、预测分析、控制和优化。分类问题的应用,比如使用石油勘探来去定地下油气藏的位置;预测方面,比如心电图的输出波来预测心脏病的概率,在信用风险上的估计等;优化方面也就是用于处理旅行推销员问题,制造业的工作调度以及车辆或者电信的高效路线问题。

目前ANN不断的发展到各种意想不到的领域,尤其是在预测方面,近两年在各个领域都有发展应用,比如在农业领域与贝叶斯相结合【17】,准确预测剩余货架期,降低水果过长时间的储存风险的【18】,为提高预测近海短期风速的精度【19】,还有在国土规划双评价情景【20】。除此之外,ANN对人类的心理学领域也有着大的应用,对于研究人类的社会认知,记忆,学习有着巨大的促进作用。

人类将人工神经网络推向了更高的境界,今天的世界早已经充满了人工神经网络的身影,像google的搜索引擎、股票价格预测、机器人学习、围棋、家庭助手,从金融到仿生样样都能运用,但是仍然有一个问题,计算机的神经网络和人脑的神经网络是否一样呢,人的神经网络900亿的神经网络组成了今天复杂的神经网络系统,这个数量可以和宇宙中的星球数相比较,如果仅仅靠单个的神经网络元是永远没办法像今天一眼完成各种任务,各种复杂的功能。应用不仅有模式识别与分类,自动能够控制,信号处理和滤波,系统优化,也可以应用于工程、金融、经济、社会等各类系统,比如:英文字母识别、肌电信号实时辨识;像用于神经计算,比如用于优化、矩阵求逆、解方程等计算,易于VLSI、光学IC、计算机虚拟实现NN(神经网络)

4 结论

本文主要介绍了人工神经网络的方法原理、存在的优势以及人工神经网络的发展历程和应用,并将人工神经网络与加以改进并且在近几年热门发展的网络结构模型进行了对比。

当然,随着人工神经网络的深入改进与发展,近些年逐渐将发展重点与重心放在了深度学习。所以近两年深度学习飞快进步,接下来的理论重点应该放在迁移学习、强化学习以及非监督学习层面,而且GANs(对抗神经网络)近两年的出现大大提高的性能,也越来越受欢迎。人工神经网络是每个神经网络发展的基础,也被逐渐的改进与提升,大大地应用在现实生活中的方方面面,并且对我们的生活质量有了的很大的提升。

参考文献

[1]刘俊一.基于人工神经网络的深度学习算法综述[J].中国新通信,2018,20(06):193-194.

[2]王广.人工神经网络发展现状综述[J].中小企业管理与科技(下旬刊),2017(02):165-167.

[3]陈格.人工神经网络技术发展综述[J].中国科技信息,2009(17):88-89.

[4]张驰,郭媛,黎明.人工神经网络模型发展及应用综述[J].计算机工程与应用,2021,57(11):57-69.

[5]张承畅,余洒,徐余,罗元.人工神经网络在调制识别中的应用综述[J/OL].重庆邮电大学学报(自然科学版):1-14[2021-12-18].

[6] Liu H , Tian H Q , Li Y F , et al. Comparison of four Adaboost algorithm based artificial neural networks in wind speed predictions[J]. Energy Conversion & Management, 2015, 92(mar.):67-81.

[7] Sang B . Application of genetic algorithm and BP neural network in supply chain finance under information sharing[J]. Journal of Computational and Applied Mathematics, 2020, 384.

[8] Mosavi A , Samadianfard S , Darbandi S , et al. Predicting soil electrical conductivity using multi-layer perceptron integrated with Grey Wolf Optimizer[J]. Journal of Geochemical Exploration, 2021:106639.

[9] Xin Y . Evolving artificial neural networks[J]. Proceedings of the IEEE, 1999, 87(9):1423-1447.

[10] Katz W T , Snell J W , Merickel M B . Artificial neural networks[J]. Methods Enzymol, 1992, 210(210):610-636.

[11] A I A B , B M H . Artificial neural networks: fundamentals, computing, design, and application[J]. Journal of Microbiological Methods, 2000, 43( 1):3-31.

[12]I.A, Basheer, and, et al. Artificial neural networks: fundamentals, computing, design, and application[J]. Journal of Microbiological Methods, 2000.

[13] Xin Y . Evolving artificial neural networks[J]. Proceedings of the IEEE, 1999, 87(9):1423-1447.

[14] Zhang G , Patuwo B E , Hu M Y . Forecasting With Artificial Neural Networks: The State of the Art[J]. International Journal of Forecasting, 1998, 14(1):35-62.

[15]Khan, Javed, Wei, et al. Classification and diagnostic prediction of cancers using gene expression profiling and artificial neural networks.[J]. Nature Medicine, 2001.

[16]张鑫,姚庆安,赵健,金镇君,冯云丛.全卷积神经网络图像语义分割方法综述[J/OL].计算机工程与应用:1-16[2021-12-22].

[17]刘海军,赵文锋,刘韵锋,陈侨,刘小玲,刘玉涛.基于ANN和贝叶斯优化算法的香蕉成熟度检测模型研究[J].现代农业装备,2021,42(05):42-46.

[18]马惠玲,曹梦柯,王栋,邱凌雨,任小林.苹果货架期GAN-BP-ANN预测模型研究[J].农业机械学报,2021,52(11):367-375.

[19]张建平,于新建,陈栋,纪海鹏.随机算法改进的RCSA-ANN模型及近海短期风速预测[J/OL].空气动力学学报:1-7[2021-12-12].

[20]田清,詹晨宇,冯佳欣,邵威.基于ANN-CA模型的国土空间规划双评价情景分析[J].农村经济与科技,2021,32(19):39-41.