- 2018年10月检视

呼和浩特张勇

2018年10月检视10月月度检视2018年11月呼和浩特市1101张勇没有反思的人生不值得过-苏格拉底【2018年10月目标及检视完成情况】罗列年度目标及完成进度10/12一,家庭和睦夫妻恩爱(同频共情的沟通与高质量的陪伴。)二,子女成为对社会有用之人(全家人正在养成物品归位和整洁的习惯,科学的学习习惯,生活习惯和高效使用优质的教育资源)三,做一个不惧困难,有能力面对各种问题的人(学习易效能,善

- 每个孩子都是一朵花,我们要做的就是静待花开

雅静_1790

每个孩子都是一朵花,只是花期不同,我们要做的就是静待花开。女儿自从上小学以来,数学一直学的很吃力,我带她看书、做题、做游戏、找辅导老师……用各种方法都收效甚微。孩子曾经在一年级学期末的素质报册中【我对自己说】一栏中是这样写的:“我要好好学习,天天向上,我要爱上数学,张老师说过,她不在我们的卷子上比我们的数学好不好,她看见我在进步了,我也感觉我在进步,希望我的数学能更好,加油!”一年级孩子的素质报告

- 德语学习 | 德语版小王子经典语句,一起学习背诵起来吧~

whisper29

▽一说到书名,大家都不陌生,但是它的作者可能很多人都说不出名字,是不是因为这位法国作家的名字太长?作者安托万·圣埃克苏佩里本身是一个热爱飞行热爱自由的人,或许书中的飞行员“我”是作者自己,同时小王子也是作者内心的另一个自己。通过两个自我的对话交流,内心敏感“我”不断寻找感情的寄托,爱情、友情。比如爱情,在遥远的家乡,他有一个玫瑰一样美丽而骄傲的爱人。但是他又躁动不安,向往诗和远方。在远方,他遇见了

- 每天学习点销售技巧:潜水艇销售法

V叔能量圈

文/巍巍昆仑日更D11每个人都离开销售技巧,即使你不从事销售工作,因为我们平台工作与生活,都要与人打交道,销售就是让人与人沟通更顺畅,彼此达到双赢多赢合作。潜水艇销售法一、建立与客户亲和信任客户成交的前提是建立彼此信任,信任从几个方面入手,对公司信任,对产品信任,对销售人员信任,成交就是成功交换价值,客户提供金钱,我们提供产品和服务,客户对我们产品和服务满意,就会重复购买,同时介绍一些其他客户进行

- 《梦界》何时何地

爱梦的我

何时何地。夏日炎炎,多数人在这种时刻都是昏昏欲睡的。有些许的无聊,于是跑到学生的教室里和他们一起待着,孩子的精气神总是和年龄相关的。我趴在桌子上假装思考问题,大屏幕突然出现视频。内容看上去有些许的熟悉啊,这不就是我之前在教研室和老师们一起学习探讨的视频吗,怎么在这里。若是正常的研讨视频我也就不在意了,爱吃的我完全在视频里是从头吃到尾啊。若不是孩子们早知我的属性,怕是要笑话我吧,不过他们依旧是笑了。

- 亲子日记第七十一天

田坤爸爸

星期六阴早起三点起来,去上了四百斤豌豆荚子,二百斤甜瓜,然后风风火火来到早市,来的算早的!全部摆开,一切就绪!这几天感觉买卖有点不好做了,竞争力太强,需要改变方法,豌豆荚子已经卖了二十多天了,现在到处都是卖豌豆荚的,想赚钱已很难。想办法卖其它的东西,卖别人没有的东西,价格不透明的,还能忽悠着多赚点!要跑在别人的前面,跟在他们的后面就不赚钱!孩子学习也是这样,也要改变思路,寻找自己适合的方法,发挥自

- Java与机器学习的邂逅:Weka框架入门指南

墨夶

Java学习资料1java机器学习数据挖掘

在这个数据驱动的时代,机器学习已经成为各行业创新和优化的关键技术。而Java,作为一门成熟且广泛应用的编程语言,在企业级应用开发中占据着重要地位。将二者结合起来,利用Java实现机器学习算法,不仅可以充分发挥其强大的生态系统优势,还能为开发者提供一个高效、稳定的开发环境。今天,我们将带您走进Java与机器学习的世界,探索如何使用Weka这一著名的机器学习库来开启您的智能之旅。Weka简介及其优势什

- Flutter:Text Widget 文本组件的使用

风一样的code

Flutter学习咒语:"Flutter一切皆组件!"新语言第一个程序当然是'Helloworld'看一下最基础的HelloWold代码import'package:flutter/material.dart';voidmain()=>runApp(MyApp());classMyAppextendsStatelessWidget{@overrideWidgetbuild(BuildContext

- 机器学习基础:从数据到智能的入门指南

一、何谓机器学习在我们的日常生活中,机器学习的身影无处不在。当你打开购物软件,它总能精准推荐你可能喜欢的商品;当你解锁手机,人脸识别瞬间完成;当你使用语音助手,它能准确理解你的指令。这些背后,都离不开机器学习的支撑。机器学习是一门让计算机能够从数据中学习并改进的学科。随着传感器技术的飞速发展,我们身边充满了各种传感器,如手机中的摄像头、麦克风,交通监控中的传感器等,它们收集了海量的数据。这些数据就

- Sequential Thinking:AI深度思考的新范式及其与CoT、ReAct的对比分析

码字的字节

人工智能SequentialCoTReAct

引言:AI深度思考的演进与SequentialThinking的崛起在人工智能技术快速发展的今天,AI模型的思考能力正经历着从简单应答到深度推理的革命性转变。这一演进过程不仅反映了技术本身的进步,更体现了人类对机器智能认知边界的持续探索。早期的大语言模型虽然能够生成流畅的文本,但在处理复杂问题时往往表现出"浅思考"的局限性——答案可能看似合理,却缺乏严谨的推理过程和系统性考量。例如,2022年的一

- 【k8s学习】Kubernetes新手学习,4小时视频笔记总结

伊丽莎白2015

【学习视频地址】KubernetesTutorialforBeginnersFULLCOURSEin4Hours视频不一定打得开,不过我笔记也很详细了。【笔记内容】1-【k8s学习】Kubernetes学习——核心组件和架构2-【k8s学习】minikube、kubectl、yaml配置文件的介绍3-【k8s学习】在minikube上布署MongoDB和MongoExpress4-【k8s学习】k

- 纸板制造学习3·DOE实验(如正交试验)优化压力组合

xinzheng新政

制造学习

·DOE实验(如正交试验)优化压力组合DOE(DesignofExperiments,实验设计)是一种通过科学规划实验方案,系统分析多因素对结果影响的方法,正交试验是其核心工具之一。在纸板生产中,DOE可通过少量实验快速找到气缸压力、原纸克重等变量的最优组合,提升效率与质量。以下是简要科普:一、DOE的核心目标识别关键因素:确定哪些变量(如热板压力、原纸克重)对结果(如纸板厚度、粘合强度)影响最大

- 你真的会阅读吗-如何阅读更高效?

sherri_方_0215

——关于阅读方法的主题阅读学习力是元能力。即一切认知思想行动的基础。现代社会,我们学习的渠道包括人、网、事和书。读书是我们重要的一种阅读方式,比其他方式跟简单、成本更低,而且系统化程度更高。阅读,指从文字或符号获得知识或信息的方法,可以是阅读文章或书籍。根据目的可将阅读分为娱乐类和致用类。这里主要指致用类阅读,是一种需要方法的阅读。前者目的在于消磨时间,只要看得舒服就行。阅读一本书,就像参加一门老

- 一元线性回归模型与最小二乘法

liuzx32

监督学习中,如果预测的变量是离散的,我们称其为分类(如决策树,支持向量机等),如果预测的变量是连续的,我们称其为回归。回归分析中,如果只包括一个自变量和一个因变量,且二者的关系可用一条直线近似表示,这种回归分析称为一元线性回归分析。如果回归分析中包括两个或两个以上的自变量,且因变量和自变量之间是线性关系,则称为多元线性回归分析。对于二维空间线性是一条直线;对于三维空间线性是一个平面,对于多维空间线

- 接口测试框架3之httprunnerV3入门以及HttpRunner安装详解

吃喝玩乐秀起来

#接口测试接口

这里写目录标题一、HttpRunner简介二、HtttpRunner安装详解1.环境准备2.脚手架生成项目三、幕布登录的演练1.抓包2.脚本生成一、HttpRunner简介参考文案:https://mubu.com/doc/2vXRWPx5i3c密码:hogwarts1.为什么要开发HttpRunner(1).工具多而且杂接口测试工具,性能测试工具(2).学习成本高(3).团队协作难风格迥异,整合

- Python接地气入门。

欢迎来到"鑫哆哆"编程角世界上最好的语言PYTHON?鑫哆哆跟python的机缘为什么选择python合理的设计学习计划,有助于攻略的成功合理驯服自己脑子合理骗过自己脑子合理安排反馈鑫哆哆的学习python计划基础语法缩进语句规则控制语句规则表达式规则函数规则对象规则类型规则数学运算直接觉醒!鑫哆哆的课程选取迈出第一步恭喜大家成功入门python!总结世界上最好的语言PYTHON?新的一年祝大家心

- 发现课堂

雨甜笔记

我是特殊教育学校的老师,曾担任培智三年级的音乐课教学工作,这个班的学生都是中度或重度智力障碍。我上音乐课的时候,首先是教唱新歌曲,因为学生注意力集中时间短,所以要抓住上课开始的几分钟教唱新歌,学习几分钟之后学生唱歌的声音就越来越小了,我知道学生已经不耐烦了。于是就进入复习阶段,我把学生会唱的歌都收在一个小播放器里,我打开播放器,学生听到熟悉的歌曲,马上又热情高涨,都跟着播放器唱起来,唱了一首又一首

- 2011.2.26晚间日记

苦之竹

90天践行活动,从早起开始起床:5:50就寝:10:40天气:小雨心情:啊这纪念日:无今天早起慢跑被雨赶回家了,不过在家多转几圈也能完成目标啊(笑)年度目标及关键点:提升能力加把小肚子减了本月重要成果:加入福建爱的今天最大的印象就是开会!!开会!!开卷有益-学习/读书喜马拉雅APP听叶武滨老师的时间管理100讲以及家慧库APP有关家庭的学习

- 我的2035

5a5e523094b5

时光转瞬而逝,2035年,我又回到了矿大。随着科技的进步,许许多多的东西也随之发生了改变。首先便是课堂教育了,这个时代,课堂叫做网课课堂。网络课堂是一种新颖的学习课堂,课堂内拥有小学到大学各种的教学资料,课堂由网络设计教师上课。还有就是用5D教学电影,吸引孩子们的眼球,让孩子们身心放松,全心全意的投入到学习当中来。学习上真正体现了寓教娱乐的作用。孩子们可以通过超音速传感装置,把作业传送到教师的办公

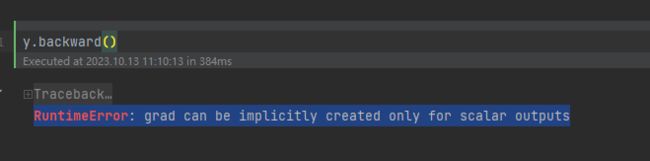

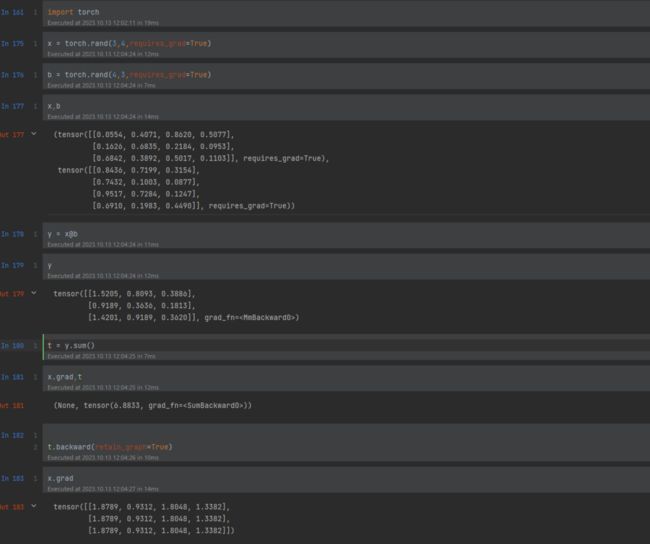

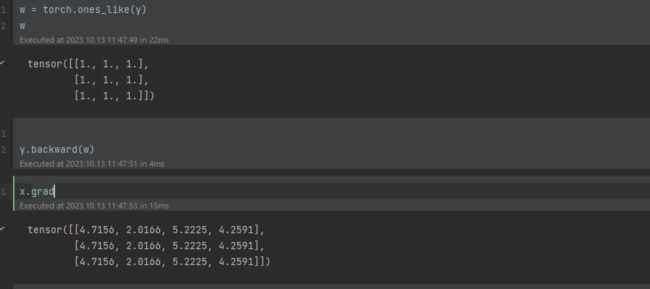

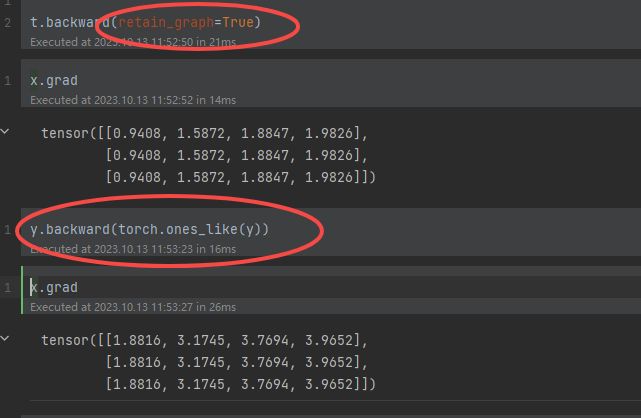

- Datawhale X 魔塔 Ai夏令营 --深度学习基础

一、局部极小值与全局极小值全局极小值:在损失函数的整个定义域内,损失值最小的点。这是我们在训练深度学习模型时希望找到的点,因为它代表着模型的最佳性能。局部极小值:在损失函数的一个局部区域内,损失值达到最小,但在整个函数定义域内可能不是最小的。当优化算法陷入局部极小值时,它可能会误以为已经找到了全局最优解,从而停止搜索。局部极小值的检测两种直观的方法来检测局部极小值:可视化方法:对于低维问题,我们可

- 【科学专栏】什么是科学(6)

opcc

从前几章的学习来看,科学知识的特征就是在于它是从事实中推导出来的。那么今天我们就来学习一下演绎推理和归纳推理。书中内容概括1.初级逻辑例11.所有哲学书都是令人厌烦的。2.这本书是一本哲学书。3.这本书是令人厌烦的。在这个论证中,(1)和(2)是前提,而(3)是结论。在我看来,这很明显:如果(1)和(2)是真的,那么(3)也一定是真的。一旦已知(1)和(2)是真的,(3)不可能是假的。断言(1)和

- 学做包子

腊梅涵香

孩子同学的母亲给我发信息说,今天她一个人在家,她今天想做馒头包子,约我去她家玩耍。我一听她今天做馒头包子,心中甚喜,我对蒸馒头包子一窍不通,这正是我学习的好机会,跟着就给她回了信息,告诉她,我马上就到。到她家时,她已经把面粉泡水揉好了,开始在发酵,趁着空闲,让我陪着她去超市一趟,她想买点肉沫和香葱。从超市回来,我们就分工操作,我负责清洗香菇胡萝卜,切碎,调馅儿。她负责面团揉捏排气,擀皮。我先把肉沫

- 2021-7-27晨间日记

一岁

今天是什么日子起床:6:30就寝:10:30天气:晴心情:开心舒畅纪念日:七夕叫我起床的不是闹钟是梦想年度目标及关键点:挣到自己今年第一桶金本月重要成果:完成策划方案今日三只青蛙/番茄钟成功日志-记录三五件有收获的事务财务检视人际的投入:有了两名商业上的伙伴开卷有益-学习/读书/听书读了《人性的弱点》健康与饮食今日步数:35270今日锻炼:户外跑今日饮食:米饭好习惯打卡吃了早餐,骑单车上班

- 2021-01-12

丛培国

【日精进打卡第1092天】【知~学习】《六项精进》0遍共61遍《大学》0遍共60遍【读书】1、《清单革命》1902、《马云内部讲话》1383、《利润的秘密》4、《我的第一本思维导图》5、《老板轻松管财务》6、《总经理财务一本通》OK7、《经营者养成笔记》8、《第一次当经理》OK9、《可复制的领导力》OK10、《论语与算盘》OK【经典名言】【行~实践】一、修身:1、俯卧撑50二、齐家:三、建功:{积

- 【0304读书清单】修炼硬本领

飞扬读书

今天分享的书是《人生效率手册》001学会自虐成功人士在获得成功之前,都有一段自虐的过程,严格要求自己提升技能,才能获得大成功。002学会“敢”,克服恐惧每个人内心都会有恐惧,尤其是面对未知的事情。要想修炼硬本领,就必须要克服恐惧。003学会判断,找平台①是否与目标相关②是否具备可持续发展的能力③平台的资源基础004调整自己学会挑战,学会坚持,学会反馈,及时调整自己以适应新的学习。005建立评价体系

- nuc10黑苹果无法wifi上网

家里小书房重新整理了下,也想放一台mac台式机用来工作学习,可惜公司已经有一台macmini,手头又有macpro,实在不好意思再购一台mac台式机。就打算重新把nuc10安装黑苹果。具体的nuc10黑苹果安装参考https://zhuanlan.zhihu.com/p/146191643安装好了后,一切都正常,就是没有wifi。这里记录下解决方案:下载wifi驱动https://github.c

- 借助AI学习开源代码git0.7之二核心概念和总结

余很多之很多

源码学习git学习

借助AI学习开源代码git0.7之二核心概念和总结核心概念:对象数据库(ObjectDatabase):内容寻址:所有数据都通过其内容的SHA1哈希值来唯一标识和存储。这意味着任何内容的更改都会导致其SHA1哈希值的变化,从而生成一个新的对象。不可变性:一旦对象被创建并存储,它就是不可变的。这种设计保证了数据的完整性和历史的可靠性。对象类型:Blob(二进制大对象):存储文件的实际内容。它是最基本

- Unet源码实现(pytorch)

wyn20001128

pytorch人工智能python

U-Net是一种用于生物医学图像分割的卷积神经网络架构。它通过引入一种新颖的网络结构和训练策略解决了传统方法在数据量不足时面临的挑战。U-Net的主要思想是利用数据增强技术来高效利用有限的标注样本,并通过独特的网络设计来提高分割精度。主要贡献U-Net的主要贡献包括:1、数据增强策略:使用随机弹性变形和其他形式的数据增强来增加训练数据的多样性,从而在有限的数据集上训练出更强大的模型。2、U形网络结

- pytorch的学习笔记

wyn20001128

算法

一cuda 2006年,NVIDIA公司发布了CUDA(ComputeUnifiedDeviceArchitecture),是一种新的操作GPU计算的硬件和软件架构,是建立在NVIDIA的GPUs上的一个通用并行计算平台和编程模型,它提供了GPU编程的简易接口,基于CUDA编程可以构建基于GPU计算的应用程序。 CPU是用于负责逻辑性比较强的计算,GPU专注于执行高度线程化的并行处理任务。所以

- 学习心得

Amanda的生命故事

#写作初心#报名秋叶大叔的写作营是在年初的时候,但是写作营开营适逢刚知道自己怀孕,遭遇孕吐最痛苦的时间,无奈之下跟宝二哥请假,于是课程延迟到了现在,可以说是对秋叶大叔的课程期盼已久。自己对于写作从小就有恐写症,大概是源于父母曾经急迫想提高我的写作水平,给我报名了多个写作辅导的原因,这些“小灶”反而导致我越来越不自信,提笔就恐慌,对于自己写的东西,从不欣赏,更不自信。2018年5月,因为不出局平台的

- redis学习笔记——不仅仅是存取数据

Everyday都不同

returnSourceexpire/delincr/lpush数据库分区redis

最近项目中用到比较多redis,感觉之前对它一直局限于get/set数据的层面。其实作为一个强大的NoSql数据库产品,如果好好利用它,会带来很多意想不到的效果。(因为我搞java,所以就从jedis的角度来补充一点东西吧。PS:不一定全,只是个人理解,不喜勿喷)

1、关于JedisPool.returnSource(Jedis jeids)

这个方法是从red

- SQL性能优化-持续更新中。。。。。。

atongyeye

oraclesql

1 通过ROWID访问表--索引

你可以采用基于ROWID的访问方式情况,提高访问表的效率, , ROWID包含了表中记录的物理位置信息..ORACLE采用索引(INDEX)实现了数据和存放数据的物理位置(ROWID)之间的联系. 通常索引提供了快速访问ROWID的方法,因此那些基于索引列的查询就可以得到性能上的提高.

2 共享SQL语句--相同的sql放入缓存

3 选择最有效率的表

- [JAVA语言]JAVA虚拟机对底层硬件的操控还不完善

comsci

JAVA虚拟机

如果我们用汇编语言编写一个直接读写CPU寄存器的代码段,然后利用这个代码段去控制被操作系统屏蔽的硬件资源,这对于JVM虚拟机显然是不合法的,对操作系统来讲,这样也是不合法的,但是如果是一个工程项目的确需要这样做,合同已经签了,我们又不能够这样做,怎么办呢? 那么一个精通汇编语言的那种X客,是否在这个时候就会发生某种至关重要的作用呢?

&n

- lvs- real

男人50

LVS

#!/bin/bash

#

# Script to start LVS DR real server.

# description: LVS DR real server

#

#. /etc/rc.d/init.d/functions

VIP=10.10.6.252

host='/bin/hostname'

case "$1" in

sta

- 生成公钥和私钥

oloz

DSA安全加密

package com.msserver.core.util;

import java.security.KeyPair;

import java.security.PrivateKey;

import java.security.PublicKey;

import java.security.SecureRandom;

public class SecurityUtil {

- UIView 中加入的cocos2d,背景透明

374016526

cocos2dglClearColor

要点是首先pixelFormat:kEAGLColorFormatRGBA8,必须有alpha层才能透明。然后view设置为透明glView.opaque = NO;[director setOpenGLView:glView];[self.viewController.view setBackgroundColor:[UIColor clearColor]];[self.viewControll

- mysql常用命令

香水浓

mysql

连接数据库

mysql -u troy -ptroy

备份表

mysqldump -u troy -ptroy mm_database mm_user_tbl > user.sql

恢复表(与恢复数据库命令相同)

mysql -u troy -ptroy mm_database < user.sql

备份数据库

mysqldump -u troy -ptroy

- 我的架构经验系列文章 - 后端架构 - 系统层面

agevs

JavaScriptjquerycsshtml5

系统层面:

高可用性

所谓高可用性也就是通过避免单独故障加上快速故障转移实现一旦某台物理服务器出现故障能实现故障快速恢复。一般来说,可以采用两种方式,如果可以做业务可以做负载均衡则通过负载均衡实现集群,然后针对每一台服务器进行监控,一旦发生故障则从集群中移除;如果业务只能有单点入口那么可以通过实现Standby机加上虚拟IP机制,实现Active机在出现故障之后虚拟IP转移到Standby的快速

- 利用ant进行远程tomcat部署

aijuans

tomcat

在javaEE项目中,需要将工程部署到远程服务器上,如果部署的频率比较高,手动部署的方式就比较麻烦,可以利用Ant工具实现快捷的部署。这篇博文详细介绍了ant配置的步骤(http://www.cnblogs.com/GloriousOnion/archive/2012/12/18/2822817.html),但是在tomcat7以上不适用,需要修改配置,具体如下:

1.配置tomcat的用户角色

- 获取复利总收入

baalwolf

获取

public static void main(String args[]){

int money=200;

int year=1;

double rate=0.1;

&

- eclipse.ini解释

BigBird2012

eclipse

大多数java开发者使用的都是eclipse,今天感兴趣去eclipse官网搜了一下eclipse.ini的配置,供大家参考,我会把关键的部分给大家用中文解释一下。还是推荐有问题不会直接搜谷歌,看官方文档,这样我们会知道问题的真面目是什么,对问题也有一个全面清晰的认识。

Overview

1、Eclipse.ini的作用

Eclipse startup is controlled by th

- AngularJS实现分页功能

bijian1013

JavaScriptAngularJS分页

对于大多数web应用来说显示项目列表是一种很常见的任务。通常情况下,我们的数据会比较多,无法很好地显示在单个页面中。在这种情况下,我们需要把数据以页的方式来展示,同时带有转到上一页和下一页的功能。既然在整个应用中这是一种很常见的需求,那么把这一功能抽象成一个通用的、可复用的分页(Paginator)服务是很有意义的。

&nbs

- [Maven学习笔记三]Maven archetype

bit1129

ArcheType

archetype的英文意思是原型,Maven archetype表示创建Maven模块的模版,比如创建web项目,创建Spring项目等等.

mvn archetype提供了一种命令行交互式创建Maven项目或者模块的方式,

mvn archetype

1.在LearnMaven-ch03目录下,执行命令mvn archetype:gener

- 【Java命令三】jps

bit1129

Java命令

jps很简单,用于显示当前运行的Java进程,也可以连接到远程服务器去查看

[hadoop@hadoop bin]$ jps -help

usage: jps [-help]

jps [-q] [-mlvV] [<hostid>]

Definitions:

<hostid>: <hostname>[:

- ZABBIX2.2 2.4 等各版本之间的兼容性

ronin47

zabbix更新很快,从2009年到现在已经更新多个版本,为了使用更多zabbix的新特性,随之而来的便是升级版本,zabbix版本兼容性是必须优先考虑的一点 客户端AGENT兼容

zabbix1.x到zabbix2.x的所有agent都兼容zabbix server2.4:如果你升级zabbix server,客户端是可以不做任何改变,除非你想使用agent的一些新特性。 Zabbix代理(p

- unity 3d还是cocos2dx哪个适合游戏?

brotherlamp

unity自学unity教程unity视频unity资料unity

unity 3d还是cocos2dx哪个适合游戏?

问:unity 3d还是cocos2dx哪个适合游戏?

答:首先目前来看unity视频教程因为是3d引擎,目前对2d支持并不完善,unity 3d 目前做2d普遍两种思路,一种是正交相机,3d画面2d视角,另一种是通过一些插件,动态创建mesh来绘制图形单元目前用的较多的是2d toolkit,ex2d,smooth moves,sm2,

- 百度笔试题:一个已经排序好的很大的数组,现在给它划分成m段,每段长度不定,段长最长为k,然后段内打乱顺序,请设计一个算法对其进行重新排序

bylijinnan

java算法面试百度招聘

import java.util.Arrays;

/**

* 最早是在陈利人老师的微博看到这道题:

* #面试题#An array with n elements which is K most sorted,就是每个element的初始位置和它最终的排序后的位置的距离不超过常数K

* 设计一个排序算法。It should be faster than O(n*lgn)。

- 获取checkbox复选框的值

chiangfai

checkbox

<title>CheckBox</title>

<script type = "text/javascript">

doGetVal: function doGetVal()

{

//var fruitName = document.getElementById("apple").value;//根据

- MySQLdb用户指南

chenchao051

mysqldb

原网页被墙,放这里备用。 MySQLdb User's Guide

Contents

Introduction

Installation

_mysql

MySQL C API translation

MySQL C API function mapping

Some _mysql examples

MySQLdb

- HIVE 窗口及分析函数

daizj

hive窗口函数分析函数

窗口函数应用场景:

(1)用于分区排序

(2)动态Group By

(3)Top N

(4)累计计算

(5)层次查询

一、分析函数

用于等级、百分点、n分片等。

函数 说明

RANK() &nbs

- PHP ZipArchive 实现压缩解压Zip文件

dcj3sjt126com

PHPzip

PHP ZipArchive 是PHP自带的扩展类,可以轻松实现ZIP文件的压缩和解压,使用前首先要确保PHP ZIP 扩展已经开启,具体开启方法就不说了,不同的平台开启PHP扩增的方法网上都有,如有疑问欢迎交流。这里整理一下常用的示例供参考。

一、解压缩zip文件 01 02 03 04 05 06 07 08 09 10 11

- 精彩英语贺词

dcj3sjt126com

英语

I'm always here

我会一直在这里支持你

&nb

- 基于Java注解的Spring的IoC功能

e200702084

javaspringbeanIOCOffice

- java模拟post请求

geeksun

java

一般API接收客户端(比如网页、APP或其他应用服务)的请求,但在测试时需要模拟来自外界的请求,经探索,使用HttpComponentshttpClient可模拟Post提交请求。 此处用HttpComponents的httpclient来完成使命。

import org.apache.http.HttpEntity ;

import org.apache.http.HttpRespon

- Swift语法之 ---- ?和!区别

hongtoushizi

?swift!

转载自: http://blog.sina.com.cn/s/blog_71715bf80102ux3v.html

Swift语言使用var定义变量,但和别的语言不同,Swift里不会自动给变量赋初始值,也就是说变量不会有默认值,所以要求使用变量之前必须要对其初始化。如果在使用变量之前不进行初始化就会报错:

var stringValue : String

//

- centos7安装jdk1.7

jisonami

jdkcentos

安装JDK1.7

步骤1、解压tar包在当前目录

[root@localhost usr]#tar -xzvf jdk-7u75-linux-x64.tar.gz

步骤2:配置环境变量

在etc/profile文件下添加

export JAVA_HOME=/usr/java/jdk1.7.0_75

export CLASSPATH=/usr/java/jdk1.7.0_75/lib

- 数据源架构模式之数据映射器

home198979

PHP架构数据映射器datamapper

前面分别介绍了数据源架构模式之表数据入口、数据源架构模式之行和数据入口数据源架构模式之活动记录,相较于这三种数据源架构模式,数据映射器显得更加“高大上”。

一、概念

数据映射器(Data Mapper):在保持对象和数据库(以及映射器本身)彼此独立的情况下,在二者之间移动数据的一个映射器层。概念永远都是抽象的,简单的说,数据映射器就是一个负责将数据映射到对象的类数据。

&nb

- 在Python中使用MYSQL

pda158

mysqlpython

缘由 近期在折腾一个小东西须要抓取网上的页面。然后进行解析。将结果放到

数据库中。 了解到

Python在这方面有优势,便选用之。 由于我有台

server上面安装有

mysql,自然使用之。在进行数据库的这个操作过程中遇到了不少问题,这里

记录一下,大家共勉。

python中mysql的调用

百度之后能够通过MySQLdb进行数据库操作。

- 单例模式

hxl1988_0311

java单例设计模式单件

package com.sosop.designpattern.singleton;

/*

* 单件模式:保证一个类必须只有一个实例,并提供全局的访问点

*

* 所以单例模式必须有私有的构造器,没有私有构造器根本不用谈单件

*

* 必须考虑到并发情况下创建了多个实例对象

* */

/**

* 虽然有锁,但是只在第一次创建对象的时候加锁,并发时不会存在效率

- 27种迹象显示你应该辞掉程序员的工作

vipshichg

工作

1、你仍然在等待老板在2010年答应的要提拔你的暗示。 2、你的上级近10年没有开发过任何代码。 3、老板假装懂你说的这些技术,但实际上他完全不知道你在说什么。 4、你干完的项目6个月后才部署到现场服务器上。 5、时不时的,老板在检查你刚刚完成的工作时,要求按新想法重新开发。 6、而最终这个软件只有12个用户。 7、时间全浪费在办公室政治中,而不是用在开发好的软件上。 8、部署前5分钟才开始测试。