如何解除hadoop安全模式问题

hadoop安全模式无法关闭问题问题描述:

今天在hadoop上传递数据时,由于数据文件太大,运行到一半突然复制中断,导致出现了安全模式,报“name node is in safe mode ”的错误提示。安全模式导致的结果就是无法上传数据到hdfs以及删除hdfs的数据,简单来说,数据都变为了只读模式,只能看,不能操作,挺麻烦的一件事情。

简单介绍一下安全模式:

1.安全模式时hadoop集群的一个安全保障方式。

2.hadoop的NameNode在重启时会进入安全模式。

3.磁盘爆掉也会进入安全模式【亲试】。

问题解决:

1.第一种方法:

(1)hdfs dfsadmin -safemode get:查看当前的安全模式状态 显示:Safe mode is ON

(2)hdfs dfsadmin -safemode leave:强制当前的安全模式

(3)再次检查:hdfs dfsadmin -safemode get 如果显示:Safe mode is OFF,则成功。【我的还是ON,所以继续寻找原因】

2.第二种方法:

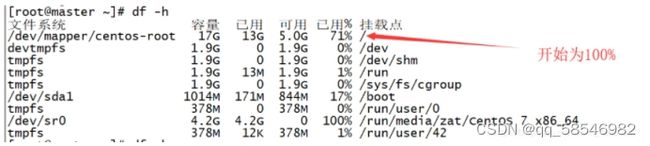

经过长时间的寻找,终于发现这种情况对应的原因:linux下输入df -h查看系统的磁盘信息情况:

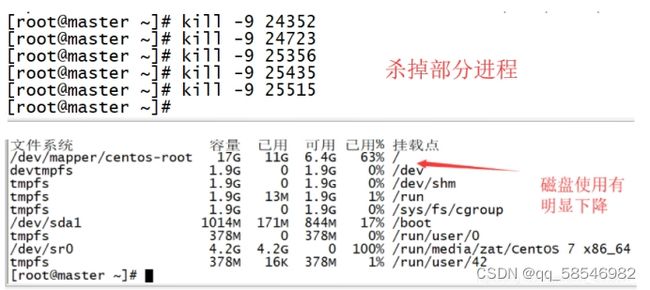

发现:磁盘被占用100%【图示为已经清除部分内容】,所以,问题就出现在这个地方,经查发现,因为系统有文件被删除,但是进程还存活着,所以导致了空间被占用的现象,所以只需要杀死这些进程即可。 (1) 使用lsof |grep delete查看对应的进程号;

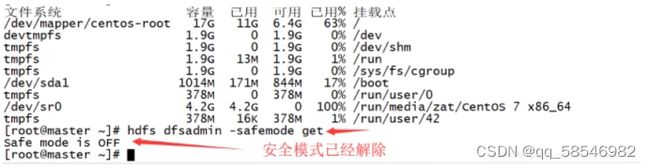

(2)另外输入top,查看后台所有进程,然后找到无用进程,杀死这部分进程。 (3)使用kill -9进程号,杀掉对应进程即可。 (2) 再次重启hadoop集群,会发现安全模式已经解除。(3)

输入:hdfs dfsadmin -safemode get->>查看当前的安全模式状态

结果测试: 可以删除hdfs上的数据,空间得到进一步释放。

根本原因:

linux下的磁盘太小,而传输的文件太大,导致磁盘爆掉,所以hadoop集群进入了安全模式。此处仅尝试了关掉无用进程,然后删除hdfs上的部分数据,所以磁盘空间得到释放,因此解除了安全模式。猜想,如果扩充了磁盘,使之能够承载所传输的文件大小,也应该可以保证hadoop解除安全模式。