Spark Standalone 伪分布模式安装

伪分布模式是基于Standalone模式来实现的,所以也叫Standalone伪分布模式。Spark在生产环节中,主要部署在安装linux系统的集群中。在linux系统中安装Spark需要先安装JDK,Scala等所需的依赖。

目录

一、前期准备

二、Scala的安装

三、Spark的安装

一、前期准备

下载地址链接: https://pan.baidu.com/s/1mzIWCzozmSfgV3meUn1acQ?pwd=rrkx

提取码: rrkx

1. Jdk1.8.0_171

如果jdk没有配置好的可以参考这篇博客 http:// https://editor.csdn.net/md/?articleId=126587725

2.Hadoop伪分布模式部署

如果Hadoop伪分布没有配置好的可以参考这篇博客

https://blog.csdn.net/qq_58476985/article/details/126755160?spm=1001.2014.3001.5502

3.Scala-2.11.8

4.Spark-2.4.8

注:以上文件我是在linux上创建了一个hadooptest用户,在该用户下创建了一个software目录,并把上边提到的文件上传到了software目录下。

二、Scala的安装

1.将scala-2.11.8.tgz 解压

[hadoop@hadooptest software]$ tar -zxvf scala_2.11.8.tgz3. 配置环境变量。在/etc/profile文件添加如下代码

export SCALA_HOME=/home/hadoop/software/scala-2.11.8

export PATH=${SCALA_HOME}/bin:$PATH

#这里的/home/hadoop/software/scala-2.11.8是你scala解压之后的路径4. 使profile文件生效

[hadoop@hadooptest software]$ source /etc/profile5. 之后分别在每一台主机上都执行 scala -version 查看版本信息,出现版本信息,则表示scala安装成功

三、Spark的安装

1.解压spark-2.4.8-bin-hadoop2.7.tgz

[hadoop@hadooptest software]$ tar -zxvf spark-2.4.8-bin-hadoop2.7.tgz2. 备份spark-env.sh.tempalte, slaves.template

1.进入到spark-2.4.8-bin-hadoop2.7/conf

[hadoop@hadooptest software]$ cd spark-2.4.8-bin-hadoop2.7/conf

[hadoop@hadooptest conf]$ ll

总用量 36

-rw-r--r--. 1 hadoop hadoop 996 5月 8 2021 docker.properties.template

-rw-r--r--. 1 hadoop hadoop 1105 5月 8 2021 fairscheduler.xml.template

-rw-r--r--. 1 hadoop hadoop 2025 5月 8 2021 log4j.properties.template

-rw-r--r--. 1 hadoop hadoop 7801 5月 8 2021 metrics.properties.template

-rw-r--r--. 1 hadoop hadoop 865 5月 8 2021 slaves.template

-rw-r--r--. 1 hadoop hadoop 1292 5月 8 2021 spark-defaults.conf.template

-rwxr-xr-x. 1 hadoop hadoop 4221 5月 8 2021 spark-env.sh.template

2.备份文件

[hadoop@hadooptest conf]$ cp spark-env.sh.template spark-env.sh

[hadoop@hadooptest conf]$ cp slaves.template slaves

#复制 spark-env.sh.tempalte文件并重命名为 spark-env.sh

#复制 slaves.tempalte文件并重命名为slaves3.修改saprk-env.sh 文件

[hadoop@hadooptest conf]$ vi spark-env.sh

#在文件下添加如下内容,路径换成自己的文件路径即可

export SCALA_HOME=/home/hadoop/software/scala-2.11.8

export HADOOP_INSTALL=/home/hadoop/software/hadoop-3.3.0

export HADOOP_CONF_DIR=$Hadoop_INSTALL/etc/hadoop

export SPARK_LOCAL_DIRS=/home/hadoop/software/spark-2.4.8-bin-hadoop2.7

export JAVA_HOME=/home/hadoop/software/jdk1.8.0_171

export SPARK_MASTER_IP=hadooptest #(这里写的是主机名,此处为hadooptest)

export SPARK_MASTER_PORT=70774. 修改slaves文件

[hadoop@hadooptest conf]$ vi slaves

在文件中将localhost替换成自己的主机名5. 配置环境变量

这里应为我是在hadoop用户下,没有权限修改 profile文件,所以切换了root用户

[hadoop@hadooptest software]$ su

密码:

[root@hadooptest software]# vi /etc/profile

在文件中添加如下内容

export SPARK_HOME=/home/hadoop/software/spark-2.4.8-bin-hadoop2.7

export PATH=$SPARK_HOME/bin:$PATH

添加好之后保存退出6. 使profile文件生效

[root@hadooptest software]# su hadoop

[hadoop@hadooptest software]$ source /etc/profile7. 启动spark集群(注在启动之前要先启动好hadoop集群)

[hadoop@hadooptest spark-2.4.8-bin-hadoop2.7]$ sbin/start-all.sh

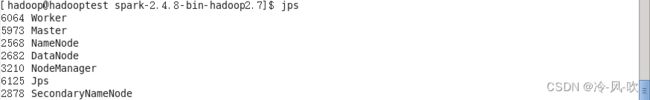

#注意这里要在spark-2.4.8-bin-hadoop2.7的路径下启动8. jps 查看进程

9. 访问8080端口:http://ip:8080 (这里是192.168.254.172:8080)

到这里spark伪分布部署就完成啦

本篇文章就到这里了,这些都是自己平时遇到的问题或者自己用到的东西,然后就整理了一下,能帮助到你,若有不对或这描述不清楚的地方请指正。✌✌