- 如何禁止Linux内核打印,一种更为合理的Linux内核打印机制

虎斑爱读书

如何禁止Linux内核打印

2020-04-26关键字:printk_ratelimit、printk_ratelimited在Linux内核开发中,几乎所有的日志、信息的打印都是通过printk()函数实现的。printk首先会将所有来自程序的信息都放到一个缓冲区中,然后各个“监控程序”再根据自己的需要将这些信息读取出来。如console会将日志信息直接显示在屏幕上等。Linux内核中的日志缓冲区本质上就是一个环形FIFO

- IAR加入Zephyr项目成为银牌会员,强化对开源协作的承诺

电子科技圈

IAR开源嵌入式硬件物联网mcuiot智能家居设计模式

全球领先的嵌入式系统开发软件解决方案供应商IAR宣布,正式加入Zephyr项目,成为银牌会员。Zephyr是由Linux基金会托管并广泛应用于嵌入式行业的开源实时操作系统(RTOS),已得到众多嵌入式领域的重要企业支持。此次合作充分彰显了IAR对开源社区的深度承诺,致力于为开发者提供专业级工具和解决方案,同时助力ZephyrRTOS在嵌入式开发领域的持续发展。Zephyr是一款轻量级的开源实时操作

- early_printk函数

川渝小神丢

Linux系统

分析Linux内核启动流程时可以知道,在调用setup_arch函数之前就已经调用过printk函数了,但是这个时候的printk函数只是将打印信息放在缓存区中,并没有打印到控制台上,因为这个时候控制台还没有被初始化。只有在start_kernel函数中的console_init函数被调用后,控制台才会被注册、初始化,printk函数打印的内容才会被真正地输出到屏幕上。如果想在console_in

- 树莓派部署syncthing实现私有云 | 树莓派小无相系列

TuTuTu_

树莓派树莓派

手机上存着不少照片,自己又时常折腾手机,总有数据丢失的问题,又对市面上的云盘不怎么放心,所以打算在家里利用树莓派搭建一个私有云。一番查找之后,发现了syncthing。Syncthing是一个跨平台,开源且免费的基于P2P的文件同步解决方案,支持Windows,Mac,Linux,Android,syncthing官方暂不支持iOS平台,但在AppStore有可用的第三方客户端。安装syncthi

- 嵌入式LINUX驱动开发(三)-设备树驱动led

Lllongroad

linux驱动开发运维

1)添加pinctrl节点使用开发板自带的LED灯进行操作,打开dts文件,在iomuxc_snvs下创建一个“pinctrl_led的子节点”```pinctrl_leds:ledgrp{fsl,pins=;};```2)添加LED设备节点在根节点"/"创建LED灯节点,节点名称为**"gpioled"**,节点内容如下:```gpioled{#address-cells=;#size-cell

- Ollama 服务配置-常用环境变量

zhangxiangweide

ollama

在Linux上设置环境变量1.通过调用systemctleditollama.service编辑systemd服务。这将打开一个编辑器。这边可以直接通过vim/etc/systemd/system/ollama.service,打开编辑。2.对于每个环境变量,在[Service]部分下添加一行Environment:vim/etc/systemd/system/ollama.serviceEnvi

- 最稳定的linux服务器选择

凌武贰玖

服务器linux运维

redhat>centos>ubuntu。最好用的是redhat,其次是centos。ubuntu做后台服务器经常会自己莫名崩溃。

- ARM平台嵌入式Linux下使用3G/4G 模块

coolboywjun

3G/4G

简介随着工业发展,嵌入式设备接入网络的需求日益增多,在没有有线或者无线以太网的环境下,直接通过3G/4GModem连接运营商网络来接入互联网不失为一个好方法,本文就着重介绍基于ARM平台的嵌入式设备在EmbeddedLinux下使用3G/4GModem的方法。目前市面上的3G/4Gmodem和主机的连接方式主要有串口、USB和mini-PCIE,串口模块比较传统且使用比较简单,而mini-PCIE

- Linux 权限提升神器:sudo 命令详解

码农技术栈

linux服务器运维centos

在Linux系统中,sudo是一个非常重要且常用的命令,全称为“superuserdo”,其主要作用是让普通用户在执行某些需要超级用户(root用户)权限的命令时,临时获得相应的权限,而无需切换到root用户身份。以下从多个方面详细介绍sudo:基本功能在Linux系统里,root用户拥有最高的系统权限,可以对系统进行各种操作,包括修改系统配置、安装软件等。但为了系统的安全性和稳定性,不建议长期以

- Android系统架构与四大组件

Tyssen

Android开发系列教程android开发系统架构

本篇博文主要讲解Android的系统架构。对于Android开发者来说,有必要了解一下Android应用程序是如何运行的。Android是一个移动操作系统,它大致分为四层,即Linux内核层,库和运行时,Framework层和应用层。Android的体系架构鼓励系统组件重用,共享组件数据,并且定义组件的访问控制权限。可以说,这些层次结构即是相互独立,又是相互关联的。一Android系统架构1.Li

- 一个完全免费、私有且本地运行的搜索聚合器-FreeAskInternet

星霜笔记

开源关注简介免费源码笔记

什么是FreeAskInternetFreeAskInternet是一个完全免费、私有且本地运行的搜索聚合器,使用LLM生成答案,无需GPU。用户可以提出一个问题,系统将使用searxng进行多引擎搜索,并将搜索结果组合到ChatGPT3.5LLM中,并根据搜索结果生成答案。所有进程都在本地运行,不需要GPU或OpenAI或GoogleAPI密钥。特征️完全免费(不需要任何API密钥)完全本地化(

- Linux系统管理员常用命令汇总与实用指南

咖啡虫

服务器相关配置及概念linux

本备忘单提供了一系列命令行可执行文件,开发人员在运行Linux操作系统的计算机上经常使用这些命令。命令按类别组织。应用程序管理命令这些命令适用于处理计算机的应用程序和可执行文件。which描述计算机文件系统中应用程序的位置。如果计算机上未安装应用程序,并且其父目录不在系统的$PATH中,which将报告错误。用法示例:which$whichclear/usr/bin/clearyumFedora、

- 什么是“脚本”?

moqiyong666

Linux

脚本(Script),是使用一种特定的描述性语言,依据一定的格式编写的可执行文件。SQL脚本,是包含一到多个sql命令的sql语句,我们可以将这些sql脚本放在一个文本文件中(我们称之为“sql脚本文件”),然后通过相关的命令执行这个sql脚本文件。Shell、Linux命令的区别:shell翻译成壳的意思,它是包裹在linux内核外层的、一个可通过一系列的linux命令对操作系统发出相关指令的人

- 大模型入门指南:非常详细,从零基础到精通,收藏这一篇就够了!

程序员辣条

人工智能语言模型大模型学习AI大模型入门AI大模型

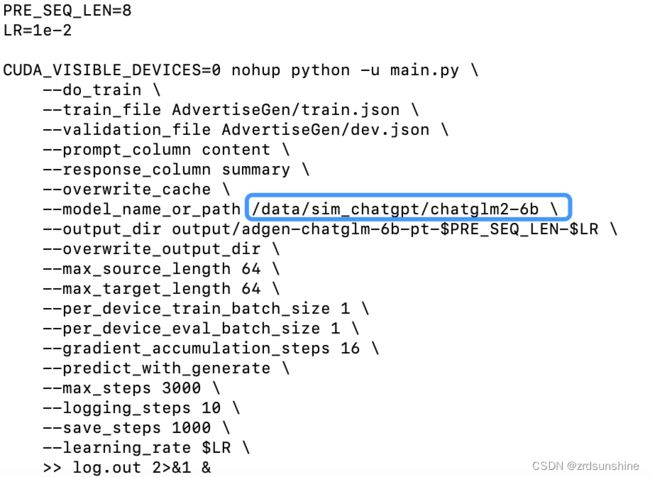

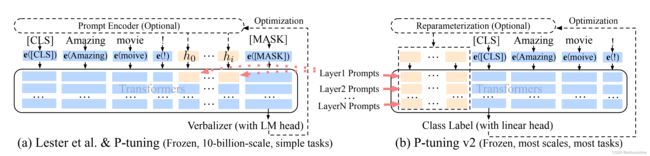

前言随着ChatGPT的到来,大模型[1](LargeLanguageModel,简称LLM)成了新时代的buzzword,各种GPT产品百花齐放。大多数人直接用现有产品就可以了,但对于喜欢刨根问底的程序员来说,能够在本地运行会更有意思。但由于没有相关背景,笔者一开始在接触时,很多GitHub上的搭建教程看得是云里雾里,而且这方面的介绍文章要不就是太晦涩难懂,要不就是太大众小白,于是就有了这篇文章

- 【Rust】——使用Drop Trait 运行清理代码和Rc<T> 引用计数智能指针

Y小夜

Rust(官方文档重点总结)rust开发语言后端

博主现有专栏:C51单片机(STC89C516),c语言,c++,离散数学,算法设计与分析,数据结构,Python,Java基础,MySQL,linux,基于HTML5的网页设计及应用,Rust(官方文档重点总结),jQuery,前端vue.js,Javaweb开发,Python机器学习等主页链接:Y小夜-CSDN博客目录使用DropTrait运行清理代码通过std::mem::drop提早丢弃值

- Python:实现 PyTorch 中训练自定义卷积神经网络模型(CNN)并导出模型为 ONNX 格式,同时使用 ONNX Runtime 进行推理

煤炭里de黑猫

pythonpytorchcnn

本文将介绍如何使用PyTorch训练一个简单的卷积神经网络(CNN)模型,并将训练好的模型导出为ONNX格式,之后使用ONNXRuntime在Python中加载并进行推理。在开始使用模型前,需要安装以下Python库。为了提高下载速度,我们将使用国内镜像源进行安装。以下是各个库的安装步骤。1.安装onnxruntimeonnxruntime是用于加载和运行ONNX模型的库。可以通过以下命令使用国内

- Linux下V4L2实时显示摄像头捕捉画面(完整QT+C++代码)

Ivy_belief

LinuxlinuxV4L2qt

目录一、V4L21、简介2、编程与应用二、示例演示1、例子说明:2、关键的代码演示3、完整的例子的代码一、V4L21、简介V4L2,即VideoforLinuxTwo,是Linux下关于视频设备的内核驱动框架,为驱动和应用程序提供了一套统一的接口规范。在Linux中,视频设备被视为设备文件,通常位于/dev/video目录下。如果只有一个视频设备,它通常是/dev/video0。2、编程与应用(1

- Linux终端+桌面组合使用Primary和Clipboard提高工作效率

程序员

什么是Primary日常工作中,Linux作为服务器环境的情况较多,但其实作为桌面系统也有一些特有的高效姿势,比如PrimarySelection(主选择,或者习惯上叫中键剪贴板)。在绝大多数支持选中的情形下,选中的内容就会自动保存在这里,只要再按鼠标中键就能粘贴出来,过程中并没有涉及到传统的Ctrl+C,Ctrl+V操作的剪贴板。这可带来很多便利,最明显的就是在连续使用鼠标操作,进行多次复制粘贴

- Github 2025-02-19C开源项目日报 Top9

老孙正经胡说

github开源Github趋势分析开源项目PythonGolang

根据GithubTrendings的统计,今日(2025-02-19统计)共有9个项目上榜。根据开发语言中项目的数量,汇总情况如下:开发语言项目数量C项目9OpenWrt项目:针对嵌入式设备的定制Linux操作系统创建周期:3215天开发语言:C协议类型:OtherStar数量:19413个Fork数量:10174次关注人数:19413人贡献人数:387人OpenIssues数量:2829个Git

- 嵌入式 Linux 设备树中的标准属性详解

忧虑的乌龟蛋

嵌入式Linuxlinux服务器标准属性设备树dtsdtsidtb

文章目录前言一、设备树简介二、设备树的标准属性2.1compatible2.2reg2.3interrupts2.4clocks2.5status2.6phandle总结前言在嵌入式Linux系统中,设备树(DeviceTree)是一种描述硬件资源的数据结构,用于将硬件信息从内核代码中分离出来。设备树的引入极大地简化了嵌入式Linux系统的移植和维护工作。本文将详细介绍设备树中的标准属性。一、设备

- 【C/C++】C语言signal信号|软中断信号|程序捕获Ctrl+C 信号

bdview

内核linuxjava嵌入式操作系统

目录程序捕获Ctrl+C信号软中断信号signal(SIGCHLD,SIG_IGN)SIGCHLD信号SIG_ING使用signal(SIGCHLD,SIG_IGN)处理僵尸进程程序捕获Ctrl+C信号在Linux下面写一个程序,如果程序中出现死循环的话,我们就应该在键盘上按Ctrl+C来终止我们的程序,那么我们也可以取捕获这个信号,然后执行我们自己的信号处理程序,输出一些有用的信息来帮助我们调试

- Linux-C/C++《C/9、信号:基础》(基本概念、信号分类、信号传递等)

YH_DevJourney

Linux-C/C++学习专栏linuxc语言c++

本章将讨论信号,虽然信号的基本概念比较简单,但是其所涉及到的细节内容比较多,所以本章篇幅也会相对比较长。事实上,在很多应用程序当中,都会存在处理异步事件这种需求,而信号提供了一种处理异步事件的方法,所以信号机制在Linux早期版本中就已经提供了支持,随着Linux内核版本的更新迭代,其对信号机制的支持更加完善。本章将会讨论如下主题内容。信号的基本概念;信号的分类、Linux提供的各种不同的信号

- 2025年普通人转向人工智能运维(AIOps)学习建议(附最新技术实践与资源)

emmm形成中

人工智能运维学习

2025年普通人转向人工智能运维(AIOps)学习建议(附最新技术实践与资源)一、学习路径规划:分阶段掌握核心技能1.基础能力构建(3-6个月)传统运维技能Linux与Shell脚本:掌握Linux系统管理、性能调优及常用命令(如awk、sed处理日志)。监控工具:学习Prometheus、Zabbix等工具,理解指标采集与告警规则配置。自动化运维:熟悉Ansible、Jenkins等工具,编写自

- LVGL移植到AM335x+Linux系统

aiprtem

lvglAM335x嵌入式Linuxlinuxc++物联网

LVGL移植到AM335x+Linux系统1.概述本文档详细介绍如何将LVGL8.3版本移植到基于AM335x处理器的Linux系统中,包括LVGL库的配置、tslib触摸驱动的移植以及示例应用的编译运行。整个项目使用CMake作为构建系统。1.1开发环境硬件平台:AM335x处理器操作系统:LinuxLVGL版本:8.3构建工具:CMake3.16+交叉编译工具链:arm-arago-linux

- MLC-LLM框架的安卓应用部署实战(1)

优秀后端工程师

2024年程序员学习android

虚拟机识别不了USB接口(这个在后面在手机上调试的时候很关键):参考我这篇博文:关于Ubuntu虚拟机识别不了USB设备的解决方案虚拟机突然上不了网了:关于Ubuntu虚拟机突然上不了网的问题ClashforLinux:如果要gitclone需要,方案如下:使用文档root密码不正确:这个问题一般是新机才会有,而且准确来说也不是bug,具体来说就是root密码会随着每次启动进行随机更新,只有自己设

- Linux 权限系统和软件安装(一):用户与用户组管理

Aphelios380

Linuxlinux算法数据库github经验分享vim

在Linux的世界里,权限管理是保障系统安全与高效运行的关键环节。对于学习Java全栈开发的同学而言,深入理解Linux权限系统不仅有助于日常开发环境的搭建与维护,在未来企业级开发中,面对多用户协作的服务器环境,更是不可或缺的技能。今天,让我们一同开启Linux权限系统和软件安装系列学习的第一站——Linux用户与用户组管理。一、Linux用户&用户组基础认知Linux作为一款强大的操作系统,支持

- Linux 下 VIM 编辑器学习记录:从基础到进阶(中)

Aphelios380

Linuxlinux前端数据库

在Linux系统的学习与实践过程中,对文件内容的查看是一项极为基础且高频的操作。熟练掌握各类内容查看命令,不仅能提升我们在Linux环境下的工作效率,对于学习Java全栈开发的同学来说,在处理项目相关的配置文件、日志文件时也能更加得心应手。接下来,我将详细介绍一些常用的文件内容查看命令。一、内容查看命令1.Cat作用:cat命令用于一次性输出文件中的所有内容。cat文件名称:按正序从头开始输出文件

- linux监控指定进程

在Linux系统中,监控指定进程是系统管理中常见的任务,尤其在需要追踪进程的性能表现、资源消耗或者故障排查时。可以使用多种工具和命令来完成这一任务,其中ps、top、htop是最常用的。下面将详细介绍如何使用这些工具来监控进程,并对每个步骤进行详细解释。1.获取进程ID(PID)首先,监控进程需要获取该进程的进程ID(PID)。PID是Linux系统中每个进程的唯一标识符。要获取指定进程的PID,

- 二进制部署ETCD单机版

神奇的海马体

#ETCDetcd数据库

文章目录一、签发etcd证书二、搭建etcd单机版三、测试ETCD服务一、签发etcd证书注意:在操作签发证书操作时一定要检查服务器时间、时区是否一致,会导致证书不可用!!1、创建etcd目录mkdir/etc/etcd/{ssl,data}-p2、安装签发证书工具wgethttps://pkg.cfssl.org/R1.2/cfssl_linux-amd64wgethttps://pkg.cfs

- apk文件放到Linux服务器 nginx不支持apk ipa文件下载设置

云上上云

服务器linuxnginx

修改/usr/local/nginx/conf目录下的mime.types增加如下配置,重启nginx生效application/vnd.android.package-archiveapk;//安卓application/iphonepxlipa;//ios

- 基本数据类型和引用类型的初始值

3213213333332132

java基础

package com.array;

/**

* @Description 测试初始值

* @author FuJianyong

* 2015-1-22上午10:31:53

*/

public class ArrayTest {

ArrayTest at;

String str;

byte bt;

short s;

int i;

long

- 摘抄笔记--《编写高质量代码:改善Java程序的151个建议》

白糖_

高质量代码

记得3年前刚到公司,同桌同事见我无事可做就借我看《编写高质量代码:改善Java程序的151个建议》这本书,当时看了几页没上心就没研究了。到上个月在公司偶然看到,于是乎又找来看看,我的天,真是非常多的干货,对于我这种静不下心的人真是帮助莫大呀。

看完整本书,也记了不少笔记

- 【备忘】Django 常用命令及最佳实践

dongwei_6688

django

注意:本文基于 Django 1.8.2 版本

生成数据库迁移脚本(python 脚本)

python manage.py makemigrations polls

说明:polls 是你的应用名字,运行该命令时需要根据你的应用名字进行调整

查看该次迁移需要执行的 SQL 语句(只查看语句,并不应用到数据库上):

python manage.p

- 阶乘算法之一N! 末尾有多少个零

周凡杨

java算法阶乘面试效率

&n

- spring注入servlet

g21121

Spring注入

传统的配置方法是无法将bean或属性直接注入到servlet中的,配置代理servlet亦比较麻烦,这里其实有比较简单的方法,其实就是在servlet的init()方法中加入要注入的内容:

ServletContext application = getServletContext();

WebApplicationContext wac = WebApplicationContextUtil

- Jenkins 命令行操作说明文档

510888780

centos

假设Jenkins的URL为http://22.11.140.38:9080/jenkins/

基本的格式为

java

基本的格式为

java -jar jenkins-cli.jar [-s JENKINS_URL] command [options][args]

下面具体介绍各个命令的作用及基本使用方法

1. &nb

- UnicodeBlock检测中文用法

布衣凌宇

UnicodeBlock

/** * 判断输入的是汉字 */ public static boolean isChinese(char c) { Character.UnicodeBlock ub = Character.UnicodeBlock.of(c);

- java下实现调用oracle的存储过程和函数

aijuans

javaorale

1.创建表:STOCK_PRICES

2.插入测试数据:

3.建立一个返回游标:

PKG_PUB_UTILS

4.创建和存储过程:P_GET_PRICE

5.创建函数:

6.JAVA调用存储过程返回结果集

JDBCoracle10G_INVO

- Velocity Toolbox

antlove

模板toolboxvelocity

velocity.VelocityUtil

package velocity;

import org.apache.velocity.Template;

import org.apache.velocity.app.Velocity;

import org.apache.velocity.app.VelocityEngine;

import org.apache.velocity.c

- JAVA正则表达式匹配基础

百合不是茶

java正则表达式的匹配

正则表达式;提高程序的性能,简化代码,提高代码的可读性,简化对字符串的操作

正则表达式的用途;

字符串的匹配

字符串的分割

字符串的查找

字符串的替换

正则表达式的验证语法

[a] //[]表示这个字符只出现一次 ,[a] 表示a只出现一

- 是否使用EL表达式的配置

bijian1013

jspweb.xmlELEasyTemplate

今天在开发过程中发现一个细节问题,由于前端采用EasyTemplate模板方法实现数据展示,但老是不能正常显示出来。后来发现竟是EL将我的EasyTemplate的${...}解释执行了,导致我的模板不能正常展示后台数据。

网

- 精通Oracle10编程SQL(1-3)PLSQL基础

bijian1013

oracle数据库plsql

--只包含执行部分的PL/SQL块

--set serveroutput off

begin

dbms_output.put_line('Hello,everyone!');

end;

select * from emp;

--包含定义部分和执行部分的PL/SQL块

declare

v_ename varchar2(5);

begin

select

- 【Nginx三】Nginx作为反向代理服务器

bit1129

nginx

Nginx一个常用的功能是作为代理服务器。代理服务器通常完成如下的功能:

接受客户端请求

将请求转发给被代理的服务器

从被代理的服务器获得响应结果

把响应结果返回给客户端

实例

本文把Nginx配置成一个简单的代理服务器

对于静态的html和图片,直接从Nginx获取

对于动态的页面,例如JSP或者Servlet,Nginx则将请求转发给Res

- Plugin execution not covered by lifecycle configuration: org.apache.maven.plugin

blackproof

maven报错

转:http://stackoverflow.com/questions/6352208/how-to-solve-plugin-execution-not-covered-by-lifecycle-configuration-for-sprin

maven报错:

Plugin execution not covered by lifecycle configuration:

- 发布docker程序到marathon

ronin47

docker 发布应用

1 发布docker程序到marathon 1.1 搭建私有docker registry 1.1.1 安装docker regisry

docker pull docker-registry

docker run -t -p 5000:5000 docker-registry

下载docker镜像并发布到私有registry

docker pull consol/tomcat-8.0

- java-57-用两个栈实现队列&&用两个队列实现一个栈

bylijinnan

java

import java.util.ArrayList;

import java.util.List;

import java.util.Stack;

/*

* Q 57 用两个栈实现队列

*/

public class QueueImplementByTwoStacks {

private Stack<Integer> stack1;

pr

- Nginx配置性能优化

cfyme

nginx

转载地址:http://blog.csdn.net/xifeijian/article/details/20956605

大多数的Nginx安装指南告诉你如下基础知识——通过apt-get安装,修改这里或那里的几行配置,好了,你已经有了一个Web服务器了。而且,在大多数情况下,一个常规安装的nginx对你的网站来说已经能很好地工作了。然而,如果你真的想挤压出Nginx的性能,你必

- [JAVA图形图像]JAVA体系需要稳扎稳打,逐步推进图像图形处理技术

comsci

java

对图形图像进行精确处理,需要大量的数学工具,即使是从底层硬件模拟层开始设计,也离不开大量的数学工具包,因为我认为,JAVA语言体系在图形图像处理模块上面的研发工作,需要从开发一些基础的,类似实时数学函数构造器和解析器的软件包入手,而不是急于利用第三方代码工具来实现一个不严格的图形图像处理软件......

&nb

- MonkeyRunner的使用

dai_lm

androidMonkeyRunner

要使用MonkeyRunner,就要学习使用Python,哎

先抄一段官方doc里的代码

作用是启动一个程序(应该是启动程序默认的Activity),然后按MENU键,并截屏

# Imports the monkeyrunner modules used by this program

from com.android.monkeyrunner import MonkeyRun

- Hadoop-- 海量文件的分布式计算处理方案

datamachine

mapreducehadoop分布式计算

csdn的一个关于hadoop的分布式处理方案,存档。

原帖:http://blog.csdn.net/calvinxiu/article/details/1506112。

Hadoop 是Google MapReduce的一个Java实现。MapReduce是一种简化的分布式编程模式,让程序自动分布到一个由普通机器组成的超大集群上并发执行。就如同ja

- 以資料庫驗證登入

dcj3sjt126com

yii

以資料庫驗證登入

由於 Yii 內定的原始框架程式, 採用綁定在UserIdentity.php 的 demo 與 admin 帳號密碼: public function authenticate() { $users=array( &nbs

- github做webhooks:[2]php版本自动触发更新

dcj3sjt126com

githubgitwebhooks

上次已经说过了如何在github控制面板做查看url的返回信息了。这次就到了直接贴钩子代码的时候了。

工具/原料

git

github

方法/步骤

在github的setting里面的webhooks里把我们的url地址填进去。

钩子更新的代码如下: error_reportin

- Eos开发常用表达式

蕃薯耀

Eos开发Eos入门Eos开发常用表达式

Eos开发常用表达式

>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>

蕃薯耀 2014年8月18日 15:03:35 星期一

&

- SpringSecurity3.X--SpEL 表达式

hanqunfeng

SpringSecurity

使用 Spring 表达式语言配置访问控制,要实现这一功能的直接方式是在<http>配置元素上添加 use-expressions 属性:

<http auto-config="true" use-expressions="true">

这样就会在投票器中自动增加一个投票器:org.springframework

- Redis vs Memcache

IXHONG

redis

1. Redis中,并不是所有的数据都一直存储在内存中的,这是和Memcached相比一个最大的区别。

2. Redis不仅仅支持简单的k/v类型的数据,同时还提供list,set,hash等数据结构的存储。

3. Redis支持数据的备份,即master-slave模式的数据备份。

4. Redis支持数据的持久化,可以将内存中的数据保持在磁盘中,重启的时候可以再次加载进行使用。

Red

- Python - 装饰器使用过程中的误区解读

kvhur

JavaScriptjqueryhtml5css

大家都知道装饰器是一个很著名的设计模式,经常被用于AOP(面向切面编程)的场景,较为经典的有插入日志,性能测试,事务处理,Web权限校验, Cache等。

原文链接:http://www.gbtags.com/gb/share/5563.htm

Python语言本身提供了装饰器语法(@),典型的装饰器实现如下:

@function_wrapper

de

- 架构师之mybatis-----update 带case when 针对多种情况更新

nannan408

case when

1.前言.

如题.

2. 代码.

<update id="batchUpdate" parameterType="java.util.List">

<foreach collection="list" item="list" index=&

- Algorithm算法视频教程

栏目记者

Algorithm算法

课程:Algorithm算法视频教程

百度网盘下载地址: http://pan.baidu.com/s/1qWFjjQW 密码: 2mji

程序写的好不好,还得看算法屌不屌!Algorithm算法博大精深。

一、课程内容:

课时1、算法的基本概念 + Sequential search

课时2、Binary search

课时3、Hash table

课时4、Algor

- C语言算法之冒泡排序

qiufeihu

c算法

任意输入10个数字由小到大进行排序。

代码:

#include <stdio.h>

int main()

{

int i,j,t,a[11]; /*定义变量及数组为基本类型*/

for(i = 1;i < 11;i++){

scanf("%d",&a[i]); /*从键盘中输入10个数*/

}

for

- JSP异常处理

wyzuomumu

Webjsp

1.在可能发生异常的网页中通过指令将HTTP请求转发给另一个专门处理异常的网页中:

<%@ page errorPage="errors.jsp"%>

2.在处理异常的网页中做如下声明:

errors.jsp:

<%@ page isErrorPage="true"%>,这样设置完后就可以在网页中直接访问exc

![]()