Kubernetes简介与部署

一、Kubernetes 简介

1、概念:

Kubernetes 又称 k8s,是一个可移植、可扩展的开源平台,用于管理容器化应用和服务,通过 Kubernetes 能够进行应用的自动化部署和扩缩容。(k8s不是容器,而是一套容器编排系统)

官网:Kubernetes

2、k8s作用:

(1) 部署方式的变更:

① 传统部署时代:在同一台物理服务器上运行多个应用程序,会导致资源分配出现问题 ;每个应用程序都运行在不同的物理服务器上,当某个应用程序资源利用率不高时,剩余资源无法被分配给其他应用程序,且维护物理服务器的成本很高。

② 虚拟化部署时代:虚拟化技术允许在单个物理服务器的 CPU 上运行多台虚拟机(VM),使应用程序在不同 VM 之间被彼此隔离。每个 VM 是一台完整的计算机,在虚拟化硬件之上运行所有组件,包括其自己的操作系统。

③ 容器部署时代:每个容器都具有自己的文件系统、CPU、内存、进程空间等,由于它们与基础架构分离,因此可以跨云和 OS 发行版本进行移植。容器解决了应用和基础环境异构的问题,让应用做到一次构建,多次部署。

(2) k8s能做什么:

k8s 提供了一个框架或平台,能够支持和管理分布式系统的弹性运行:

① 服务发现和负载均衡:k8s提供内置的服务发现机制和负载均衡功能,可以分配网络流量,使部署稳定。

② 存储编排:k8s支持多种存储解决方案,包括本地存储、网络存储和云存储,为应用程序提供持久性存储选项。

③ 自动部署和回滚:k8s支持自动化的回滚机制,能够在应用程序更新失败或出现问题时自动恢复先前的状态 ;同时也支持滚动更新,使得应用程序能够平滑地进行版本更新。

④ 自动装箱:k8s可以基于容器对应用运行环境的资源配置要求自动部署应用容器;

⑤ 自我修复:当所部署的 Node 节点有问题时,会对容器进行重新部署和重新调度;当容器未通过监控检查时,会关闭此容器直到容器正常运行时,才会对外提供服务。

⑥ 密钥和配置管理:k8s 提供了一套机制来管理敏感信息、密钥和配置数据,使得应用程序能够安全地访问这些信息。

(3) k8s与docker compose的区别:

① Kubernetes 适用于大规模、复杂的容器编排和管理,它设计用于在多节点集群中部署、管理和扩展容器化应用程序,具备高度的可扩展性和弹性。

② Docker Compose 适用于单主机上的开发和测试环境,它允许在单个主机上定义和运行多个容器,并配置这些容器之间的关联性,但通常不适用于在生产环境中管理大规模的集群。

二、Kubernetes组件和架构

1、集群组件

(1) 集群介绍:

① 集群:将同一个软件的多台服务器组织到一起,共同为系统提供服务,称为该软件的集群。

② k8s集群的角色:

control plane:控制节点(主节点) ;work node:工作节点 ;pod:应用程序容器

k8s集群中,一组工作的集群,称为工作节点,每个集群里至少有一个工作节点,工作节点里托管着Pod,控制节点管理集群中的工作节点和Pod。

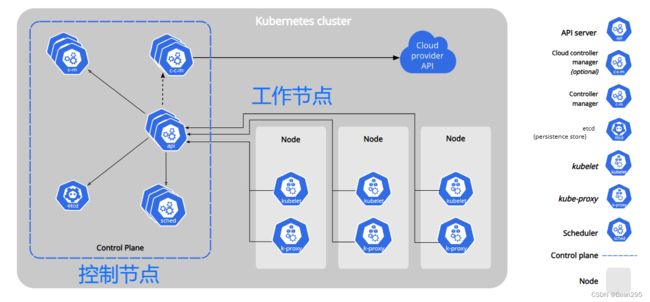

(2) 控制平面组件(Control Plane Components)

控制平面组件会为集群做出全局决策,比如资源的调度,以及检测和响应集群事件。

① kube-apiserver:所有命令请求的入口,可以运行多个 kube-apiserver 实例进行水平扩缩;

② etcd:数据存储,高可用的键值存储,用作 Kubernetes 所有集群数据的后台数据库;

③ kube-scheduler:资源调度和分配,负责监视新创建的、未指定运行节点的 Pods, 并选择节点来让 Pod 在上面运行;

④ kube-controller-manager:调度 Pod 的控制进程。

(3) Node组件:

在每个工作节点上运行,负责维护运行的 Pod 并提供 Kubernetes 运行环境。

① kubelet:master节点派遣到node节点的代表,负责管理容器的运行;

② kube-proxy:kube-proxy 是集群中每个工作节点上所运行的网络代理;

③ 容器运行时 (Container Runtime):负责管理 Kubernetes 环境中容器的执行和生命周期,使 Kubernetes 能够有效运行容器,如 containerd、CRI-O 等。

三、k8s搭建:

1、配置要求:

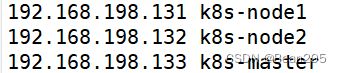

三台虚拟机,硬件配置:2GB 或更多 RAM,2 个 CPU 或更多 CPU,硬盘 30GB 或更多;

集群中所有机器之间网络互通;

可以访问外网,需要拉取镜像。

2、系统配置:

● 配置主机名和域名解析:

● 关闭防火墙和SELinux;

● 关闭 swap 交换分区:swapoff -a !& sed -ri 's/.*swap.*/#&/' /etc/fstab

● 设置时间同步:

yum install -y ntpdate

ntpdate time.windows.com

3、安装 containerd:

Containerd 是一个开源的容器运行时工具,它提供了容器的核心功能 ;Docker 构建在 containerd 之上,并提供了更多的功能和工具。

① 安装 yum-config-manager 相关依赖:

yum install -y yum-utils device-mapper-persistent-data lvm2

② 添加 containerd yum 源:

yum-config-manager --add-repo http://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

③ 安装 containerd:

yum install -y containerd.io cri-tools

④ 编写 containerd 配置文件:

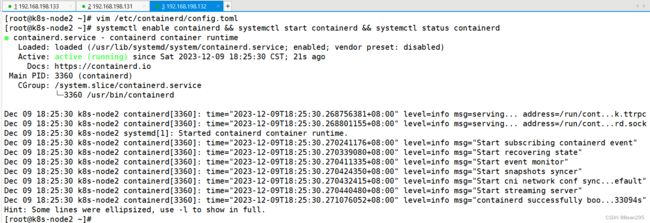

cat > /etc/containerd/config.toml <⑤ 启动 containerd 服务并配置开机自启动:

systemctl enable containerd && systemctl start containerd && systemctl status containerd

⑥ 添加 containerd 配置:

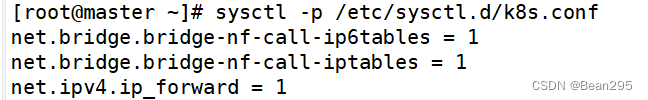

cat > /etc/modules-load.d/containerd.conf <⑦ 配置 k8s 网络配置:

cat > /etc/sysctl.d/k8s.conf <⑧ 加载 overlay br_netfilter 模块并查看当前配置是否生效:

modprobe overlay

modprobe br_netfilter

sysctl -p /etc/sysctl.d/k8s.conf

4、搭建k8s集群:

① 添加 k8s yum 源:

cat < kubernetes.repo

[kubernetes]

name=Kubernetes

baseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64

enabled=1

gpgcheck=0

repo_gpgcheck=0

gpgkey=https://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg

https://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

EOF mv kubernetes.repo /etc/yum.repos.d/

② 安装k8s并启动 kubelet:

yum install -y kubelet kubeadm kubectl

systemctl enable kubelet &&systemctl start kubelet && systemctl status kubelet

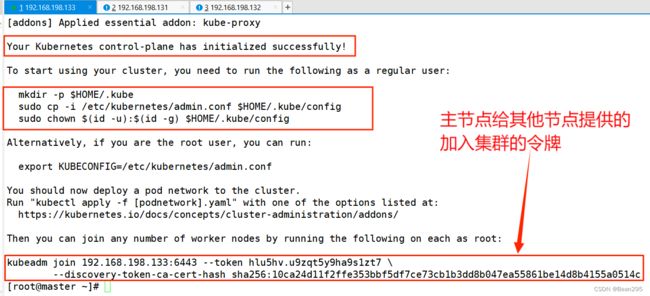

5、初始化集群(在master节点操作):

kubeadm init \

--apiserver-advertise-address=192.168.198.133 \

--pod-network-cidr=10.244.0.0/16 \

--image-repository registry.aliyuncs.com/google_containers \

--cri-socket=unix:///var/run/containerd/containerd.sock① 在使用集群前执行以下命令:

mkdir -p $HOME/.kube

sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

sudo chown $(id -u):$(id -g) $HOME/.kube/config

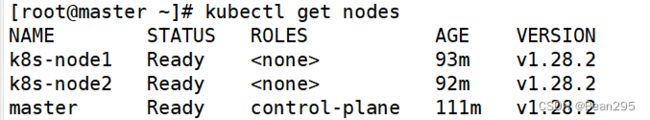

② 添加新节点:

将主节点的令牌信息复制给节点1、2

③ 配置集群网络:

在主节点创建 kube-flannel.yml

---

kind: Namespace

apiVersion: v1

metadata:

name: kube-flannel

labels:

pod-security.kubernetes.io/enforce: privileged

---

kind: ClusterRole

apiVersion: rbac.authorization.k8s.io/v1

metadata:

name: flannel

rules:

- apiGroups:

- ""

resources:

- pods

verbs:

- get

- apiGroups:

- ""

resources:

- nodes

verbs:

- get

- list

- watch

- apiGroups:

- ""

resources:

- nodes/status

verbs:

- patch

---

kind: ClusterRoleBinding

apiVersion: rbac.authorization.k8s.io/v1

metadata:

name: flannel

roleRef:

apiGroup: rbac.authorization.k8s.io

kind: ClusterRole

name: flannel

subjects:

- kind: ServiceAccount

name: flannel

namespace: kube-flannel

---

apiVersion: v1

kind: ServiceAccount

metadata:

name: flannel

namespace: kube-flannel

---

kind: ConfigMap

apiVersion: v1

metadata:

name: kube-flannel-cfg

namespace: kube-flannel

labels:

tier: node

app: flannel

data:

cni-conf.json: |

{

"name": "cbr0",

"cniVersion": "0.3.1",

"plugins": [

{

"type": "flannel",

"delegate": {

"hairpinMode": true,

"isDefaultGateway": true

}

},

{

"type": "portmap",

"capabilities": {

"portMappings": true

}

}

]

}

net-conf.json: |

{

"Network": "10.244.0.0/16",

"Backend": {

"Type": "vxlan"

}

}

---

apiVersion: apps/v1

kind: DaemonSet

metadata:

name: kube-flannel-ds

namespace: kube-flannel

labels:

tier: node

app: flannel

spec:

selector:

matchLabels:

app: flannel

template:

metadata:

labels:

tier: node

app: flannel

spec:

affinity:

nodeAffinity:

requiredDuringSchedulingIgnoredDuringExecution:

nodeSelectorTerms:

- matchExpressions:

- key: kubernetes.io/os

operator: In

values:

- linux

hostNetwork: true

priorityClassName: system-node-critical

tolerations:

- operator: Exists

effect: NoSchedule

serviceAccountName: flannel

initContainers:

- name: install-cni-plugin

image: docker.io/rancher/mirrored-flannelcni-flannel-cni-plugin:v1.1.0

command:

- cp

args:

- -f

- /flannel

- /opt/cni/bin/flannel

volumeMounts:

- name: cni-plugin

mountPath: /opt/cni/bin

- name: install-cni

image: docker.io/rancher/mirrored-flannelcni-flannel:v0.20.2

command:

- cp

args:

- -f

- /etc/kube-flannel/cni-conf.json

- /etc/cni/net.d/10-flannel.conflist

volumeMounts:

- name: cni

mountPath: /etc/cni/net.d

- name: flannel-cfg

mountPath: /etc/kube-flannel/

containers:

- name: kube-flannel

image: docker.io/rancher/mirrored-flannelcni-flannel:v0.20.2

command:

- /opt/bin/flanneld

args:

- --ip-masq

- --kube-subnet-mgr

resources:

requests:

cpu: "100m"

memory: "50Mi"

limits:

cpu: "100m"

memory: "50Mi"

securityContext:

privileged: false

capabilities:

add: ["NET_ADMIN", "NET_RAW"]

env:

- name: POD_NAME

valueFrom:

fieldRef:

fieldPath: metadata.name

- name: POD_NAMESPACE

valueFrom:

fieldRef:

fieldPath: metadata.namespace

- name: EVENT_QUEUE_DEPTH

value: "5000"

volumeMounts:

- name: run

mountPath: /run/flannel

- name: flannel-cfg

mountPath: /etc/kube-flannel/

- name: xtables-lock

mountPath: /run/xtables.lock

volumes:

- name: run

hostPath:

path: /run/flannel

- name: cni-plugin

hostPath:

path: /opt/cni/bin

- name: cni

hostPath:

path: /etc/cni/net.d

- name: flannel-cfg

configMap:

name: kube-flannel-cfg

- name: xtables-lock

hostPath:

path: /run/xtables.lock

type: FileOrCreate执行命令:kubectl apply -f kube-flannel.yml

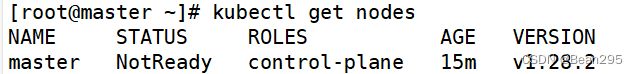

④ 查看集群状态和pods运行情况: