简介支持向量机热门(认识SVM三位置)

作者: July 。致谢: pluskid、白石、J erryLead。支持向量机通俗导论(理解SVM的三层境地)

出处:结构之法算法之道 blog。

前言

动笔写这个支持向量机(support vector machine)是费了不少劲和困难的,原因非常简单,一者这个东西本身就并不好懂,要深入学习和研究下去需花费不少时间和精力,二者这个东西也不好讲清楚。尽管网上已经有朋友写得不错了(见文末參考链接),但在描写叙述数学公式的时候还是显得不够。得益于同学白石的数学证明,我还是想尝试写一下。希望本文在兼顾通俗易懂的基础上,真真正正能足以成为一篇完整概括和介绍支持向量机的导论性的文章。

本文在写的过程中。參考了不少资料,包含《支持向量机导论》、《统计学习方法》及网友pluskid的支持向量机系列等等。于此。还是一篇学习笔记。仅仅是增加了自己的理解和总结。有不论什么不妥之处。还望海涵。全文宏观上总体认识支持向量机的概念和用处,微观上深究部分定理的来龙去脉,证明及原理细节,力保逻辑清楚 & 通俗易懂。

同一时候,阅读本文时建议大家尽量使用chrome等浏览器,如此公式才干更好的显示,再者,阅读时可拿张纸和笔出来,把本文全部定理.公式都亲自推导一遍或者直接打印下来(可直接打印网页版或本文文末附的PDF,享受随时随地思考、演算的极致快感)。在文稿上演算。

Ok。还是那句原话,有不论什么问题。欢迎不论什么人随时不吝指正 & 赐教,感谢。

第一层、了解SVM

支持向量机,因其英文名为support vector machine,故一般简称SVM,通俗来讲。它是一种二类分类模型。其基本模型定义为特征空间上的间隔最大的线性分类器,其学习策略便是间隔最大化。终于可转化为一个凸二次规划问题的求解。

1.1、分类标准的起源:Logistic回归

理解SVM,咱们必须先弄清楚一个概念:线性分类器。

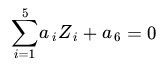

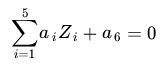

给定一些数据点,它们分别属于两个不同的类,如今要找到一个线性分类器把这些数据分成两类。假设用x表示数据点。用y表示类别(y能够取1或者-1。分别代表两个不同的类),一个线性分类器的学习目标便是要在n维的数据空间中找到一个超平面(hyper plane),这个超平面的方程能够表示为( wT中的T代表转置):

![]()

可能有读者对类别取1或-1有疑问,事实上,这个1或-1的分类标准起源于logistic回归。

Logistic回归目的是从特征学习出一个0/1分类模型。而这个模型是将特性的线性组合作为自变量,由于自变量的取值范围是负无穷到正无穷。

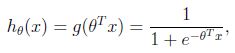

因此。使用logistic函数(或称作sigmoid函数)将自变量映射到(0,1)上,映射后的值被觉得是属于y=1的概率。

假设函数

从而,当我们要判别一个新来的特征属于哪个类时,仅仅需求![]() 就可以。若

就可以。若![]() 大于0.5就是y=1的类。反之属于y=0类。

大于0.5就是y=1的类。反之属于y=0类。

此外,![]() 仅仅和

仅仅和![]() 有关,

有关,![]() >0,那么

>0,那么![]() ,而g(z)仅仅是用来映射,真实的类别决定权还是在于

,而g(z)仅仅是用来映射,真实的类别决定权还是在于![]() 。

。

再者。当![]() 时,

时,![]() =1,反之

=1,反之![]() =0。假设我们仅仅从

=0。假设我们仅仅从![]() 出发,希望模型达到的目标就是让训练数据中y=1的特征

出发,希望模型达到的目标就是让训练数据中y=1的特征![]() ,而是y=0的特征

,而是y=0的特征![]() 。Logistic回归就是要学习得到

。Logistic回归就是要学习得到![]() ,使得正例的特征远大于0。负例的特征远小于0。并且要在全部训练实例上达到这个目标。

,使得正例的特征远大于0。负例的特征远小于0。并且要在全部训练实例上达到这个目标。

接下来,尝试把logistic回归做个变形。首先,将使用的结果标签y = 0和y = 1替换为y = -1,y = 1,然后将![]() (

(![]() )中的

)中的![]() 替换为b,最后将后面的

替换为b,最后将后面的![]() 替换为

替换为![]() (即

(即![]() )。如此,则有了

)。如此,则有了![]() 。也就是说除了y由y=0变为y=-1外,线性分类函数跟logistic回归的形式化表示

。也就是说除了y由y=0变为y=-1外,线性分类函数跟logistic回归的形式化表示![]() 没差别。

没差别。

进一步,能够将假设函数![]() 中的g(z)做一个简化。将其简单映射到y=-1和y=1上。映射关系例如以下:

中的g(z)做一个简化。将其简单映射到y=-1和y=1上。映射关系例如以下:

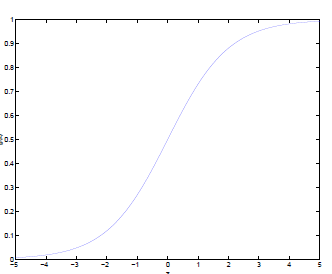

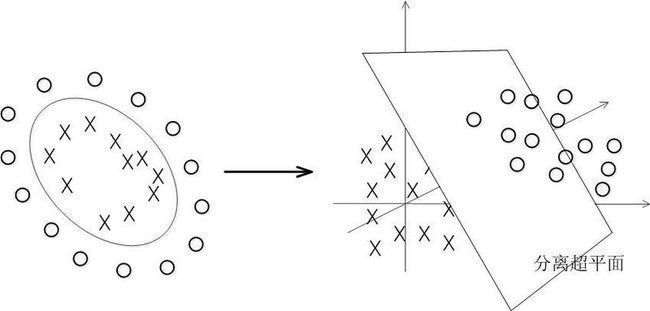

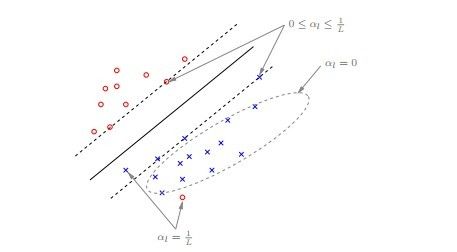

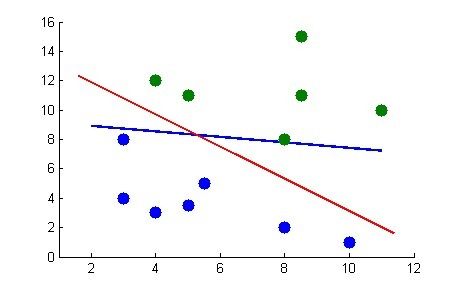

1.2、线性分类的一个样例

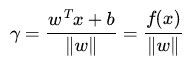

下面举个简单的样例,例如以下图所看到的,如今有一个二维平面,平面上有两种不同的数据,分别用圈和叉表示。由于这些数据是线性可分的,所以能够用一条直线将这两类数据分开,这条直线就相当于一个超平面,超平面一边的数据点所相应的y全是 -1 ,还有一边所相应的y全是1。

这个超平面能够用分类函数![]() 表示,当f(x) 等于0的时候。x便是位于超平面上的点。而f(x)大于0的点相应 y=1 的数据点。f(x)小于0的点相应y=-1的点,例如以下图所看到的:

表示,当f(x) 等于0的时候。x便是位于超平面上的点。而f(x)大于0的点相应 y=1 的数据点。f(x)小于0的点相应y=-1的点,例如以下图所看到的:

注:有的资料上定义特征到结果的输出函数

的时候。为了求解方便,会把yf(x)令为1。即yf(x)是y(w^x + b),还是y(w^x - b),对我们要优化的式子max1/||w||已无影响。

的时候。为了求解方便,会把yf(x)令为1。即yf(x)是y(w^x + b),还是y(w^x - b),对我们要优化的式子max1/||w||已无影响。 (有一朋友飞狗来自Mare_Desiderii。看了上面的定义之后。问道:请教一下SVM functional margin 为![]() =y(wTx+b)=yf(x)中的Y是仅仅取1和-1 吗?y的唯一作用就是确保functional margin的非负性?真是这样的么?当然不是。详情请见本文评论下第43楼)

=y(wTx+b)=yf(x)中的Y是仅仅取1和-1 吗?y的唯一作用就是确保functional margin的非负性?真是这样的么?当然不是。详情请见本文评论下第43楼)

换言之,在进行分类的时候。遇到一个新的数据点x。将x代入f(x) 中,假设f(x)小于0则将x的类别赋为-1,假设f(x)大于0则将x的类别赋为1。

接下来的问题是,怎样确定这个超平面呢?从直观上而言,这个超平面应该是最适合分开两类数据的直线。而判定“最适合”的标准就是这条直线离直线两边的数据的间隔最大。所以,得寻找有着最大间隔的超平面。

1.3、函数间隔Functional margin与几何间隔Geometrical margin

在超平面w*x+b=0确定的情况下,|w*x+b|能够表示点x到距离超平面的远近,而通过观察w*x+b的符号与类标记y的符号是否一致可推断分类是否正确。所以。能够用(y*(w*x+b))的正负性来判定或表示分类的正确性。于此,我们便引出了函数间隔(functional margin)的概念。

定义函数间隔(用![]() 表示)为:

表示)为:

![]()

而超平面(w。b)关于T中全部样本点(xi,yi)的函数间隔最小值(当中,x是特征,y是结果标签,i表示第i个样本),便为超平面(w, b)关于训练数据集T的函数间隔:

= min

i (i=1,...n)

但这样定义的函数间隔有问题。即假设成比例的改变w和b(如将它们改成2w和2b),则函数间隔的值f(x)却变成了原来的2倍(尽管此时超平面没有改变),所以仅仅有函数间隔还远远不够。

事实上,我们能够对法向量w加些约束条件,从而引出真正定义点到超平面的距离--几何间隔(geometrical margin)的概念。

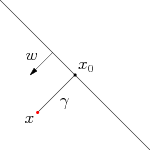

假定对于一个点 x ,令其垂直投影到超平面上的相应点为 x0 。w 是垂直于超平面的一个向量,![]() 为样本x到分类间隔的距离。例如以下图所看到的:

为样本x到分类间隔的距离。例如以下图所看到的:

又由于

![]() 就可以算出:

就可以算出:

(有的书上会写成把||w|| 分开相除的形式。如本文參考文献及推荐阅读条目11。当中,||w||为w的二阶泛数)

为了得到![]() 的绝对值,令

的绝对值,令![]() 乘上相应的类别 y。就可以得出几何间隔(用

乘上相应的类别 y。就可以得出几何间隔(用![]() 表示)的定义:

表示)的定义:

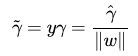

从上述函数间隔和几何间隔的定义能够看出:几何间隔就是函数间隔除以||w||,并且函数间隔y*(wx+b) = y*f(x)实际上就是|f(x)|,仅仅是人为定义的一个间隔度量,而几何间隔|f(x)|/||w||才是直观上的点到超平面的距离。

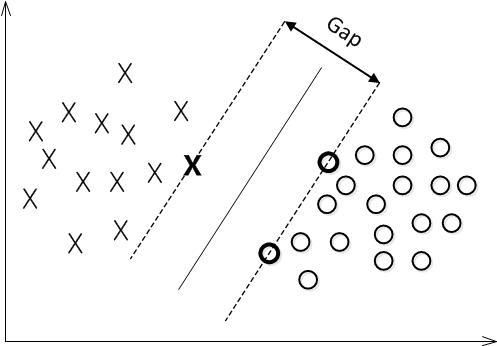

1.4、最大间隔分类器Maximum Margin Classifier的定义

对一个数据点进行分类,当超平面离数据点的“间隔”越大。分类的确信度(confidence)也越大。

所以,为了使得分类的确信度尽量高,须要让所选择的超平面能够最大化这个“间隔”值。这个间隔例如以下图中的gap / 2所看到的。

通过由前面的分析可知:函数间隔不适合用来最大化间隔值,由于在超平面固定以后,能够等比例地缩放w的长度和b的值。这样能够使得![]() 的值随意大,亦即函数间隔

的值随意大,亦即函数间隔![]() 能够在超平面保持不变的情况下被取得随意大。但几何间隔由于除上了

能够在超平面保持不变的情况下被取得随意大。但几何间隔由于除上了![]() ,使得在缩放w和b的时候几何间隔

,使得在缩放w和b的时候几何间隔![]() 的值是不会改变的,它仅仅随着超平面的变动而变动,因此,这是更加合适的一个间隔。所以,这里要找的最大间隔分类超平面中的“间隔”指的是几何间隔。

的值是不会改变的,它仅仅随着超平面的变动而变动,因此,这是更加合适的一个间隔。所以,这里要找的最大间隔分类超平面中的“间隔”指的是几何间隔。

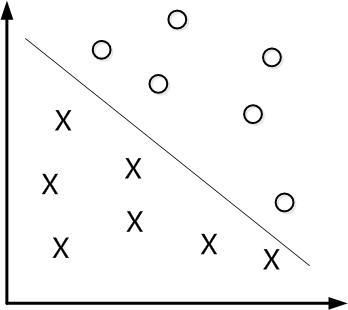

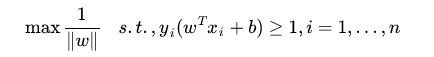

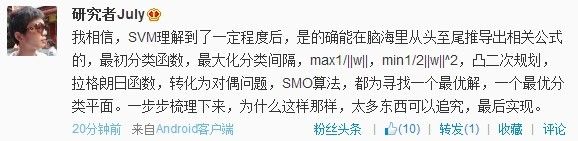

于是最大间隔分类器(maximum margin classifier)的目标函数能够定义为:

同一时候需满足一些条件。依据间隔的定义,有

当中,s.t.,即subject to的意思,它导出的是约束条件。

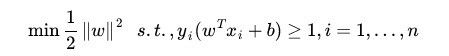

回想下几何间隔的定义 可知:假设令函数间隔

可知:假设令函数间隔![]() 等于1(之所以令

等于1(之所以令![]() 等于1,是为了方便推导和优化。且这样做对目标函数的优化没有影响,至于为什么,请见本文评论下第42楼回复)。则有

等于1,是为了方便推导和优化。且这样做对目标函数的优化没有影响,至于为什么,请见本文评论下第42楼回复)。则有![]() = 1 / ||w||且

= 1 / ||w||且![]() ,从而上述目标函数转化成了

,从而上述目标函数转化成了

这个目标函数便是在相应的约束条件![]() 下,最大化这个1/||w||值,而1/||w||便是几何间隔

下,最大化这个1/||w||值,而1/||w||便是几何间隔![]() 。

。

例如以下图所看到的,中间的实线便是寻找到的最优超平面(Optimal Hyper Plane)。其到两条虚线的距离相等,这个距离便是几何间隔![]() 。两条虚线之间的距离等于2

。两条虚线之间的距离等于2![]() ,而虚线上的点则是支持向量。由于这些支持向量刚好在边界上,所以它们满足

,而虚线上的点则是支持向量。由于这些支持向量刚好在边界上,所以它们满足![]() (还记得我们把 functional margin 定为 1 了吗?上节中:处于方便推导和优化的目的。我们能够令

(还记得我们把 functional margin 定为 1 了吗?上节中:处于方便推导和优化的目的。我们能够令![]() =1)。而对于全部不是支持向量的点,则显然有

=1)。而对于全部不是支持向量的点,则显然有![]() 。

。

OK。到此为止,算是了解到了SVM的第一层,对于那些仅仅关心怎么用SVM的朋友便已足够。不必再更进一层深究其更深的原理。

第二层、深入SVM

2.1、从线性可分到线性不可分

2.1.1、从原始问题到对偶问题的求解

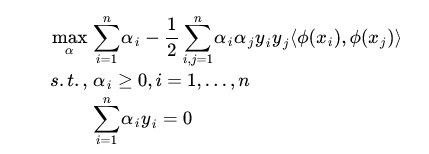

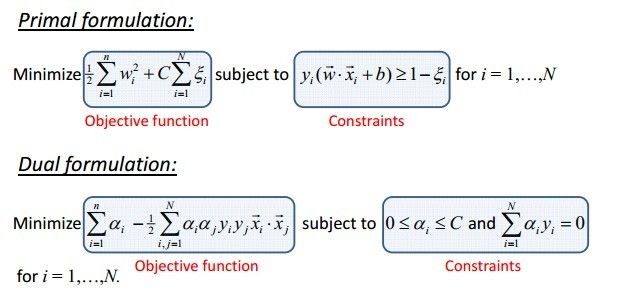

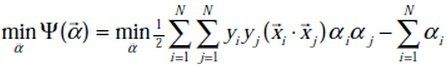

接着考虑之前得到的目标函数:

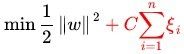

由于如今的目标函数是二次的,约束条件是线性的。所以它是一个凸二次规划问题。这个问题能够用现成的QP (Quadratic Programming) 优化包进行求解。一言以蔽之:在一定的约束条件下,目标最优,损失最小。

此外,由于这个问题的特殊结构。还能够通过拉格朗日对偶性(Lagrange Duality)变换到对偶变量 (dual variable) 的优化问题,即通过求解与原问题等价的对偶问题(dual problem)得到原始问题的最优解,这就是线性可分条件下支持向量机的对偶算法,这样做的长处在于:一者对偶问题往往更easy求解;二者能够自然的引入核函数。进而推广到非线性分类问题。

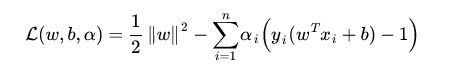

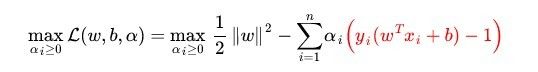

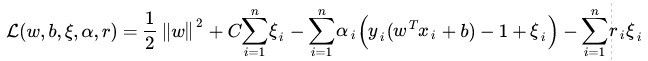

那什么是拉格朗日对偶性呢?简单来讲,通过给每个约束条件加上一个拉格朗日乘子(Lagrange multiplier)![]() ,定义拉格朗日函数(通过拉格朗日函数将约束条件融合到目标函数里去,从而仅仅用一个函数表达式便能清楚的表达出我们的问题):

,定义拉格朗日函数(通过拉格朗日函数将约束条件融合到目标函数里去,从而仅仅用一个函数表达式便能清楚的表达出我们的问题):

然后令

easy验证,当某个约束条件不满足时,比如![]() 。那么显然有

。那么显然有![]() (仅仅要令

(仅仅要令![]() 就可以)。而当全部约束条件都满足时,则最优值为

就可以)。而当全部约束条件都满足时,则最优值为![]() ,亦即最初要最小化的量。

,亦即最初要最小化的量。

因此,在要求约束条件得到满足的情况下最小化![]() ,实际上等价于直接最小化

,实际上等价于直接最小化![]() (当然,这里也有约束条件,就是

(当然,这里也有约束条件,就是![]()

![]() 会等于无穷大。自然不会是我们所要求的最小值。

会等于无穷大。自然不会是我们所要求的最小值。

详细写出来,目标函数变成了:

这里用![]() 表示这个问题的最优值。且和最初的问题是等价的。

表示这个问题的最优值。且和最初的问题是等价的。

假设直接求解,那么一上来便得面对w和b两个參数,而![]() 又是不等式约束,这个求解过程不好做。

又是不等式约束,这个求解过程不好做。

最好还是把最小和最大的位置交换一下,变成:

交换以后的新问题是原始问题的对偶问题,这个新问题的最优值用![]() 来表示。并且有

来表示。并且有![]() ≤

≤![]() ,在满足某些条件的情况下,这两者相等。这个时候就能够通过求解对偶问题来间接地求解原始问题。

,在满足某些条件的情况下,这两者相等。这个时候就能够通过求解对偶问题来间接地求解原始问题。

换言之,之所以从minmax的原始问题![]() ,转化为maxmin的对偶问题

,转化为maxmin的对偶问题![]() 。一者由于

。一者由于![]() 是

是![]() 的近似解,二者,转化为对偶问题后,更easy求解。

的近似解,二者,转化为对偶问题后,更easy求解。

下面能够先求L 对w、b的极小。再求L 对![]() 的极大。

的极大。

2.1.2、KKT条件

上文中提到“![]() ≤

≤![]() 在满足某些条件的情况下,两者等价”。这所谓的“满足某些条件”就是要满足KKT条件。

在满足某些条件的情况下,两者等价”。这所谓的“满足某些条件”就是要满足KKT条件。

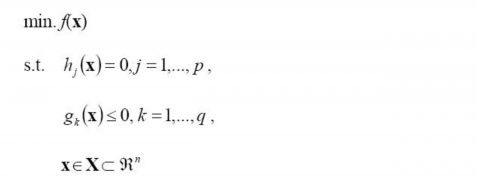

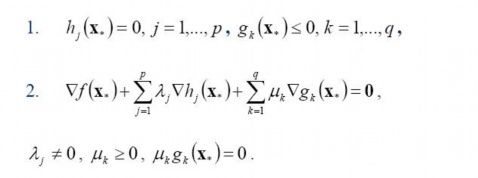

一般地。一个最优化数学模型能够表示成下列标准形式:

当中。f(x)是须要最小化的函数。h(x)是等式约束,g(x)是不等式约束。p和q分别为等式约束和不等式约束的数量。

同一时候,得明确下面两点:

- 凸优化的概念: 为一凸集。 为一凸函数。凸优化就是要找出一点 ,使得每一 满足 。

- KKT条件的意义:它是一个非线性规划(Nonlinear Programming)问题能有最优化解法的必要和充分条件。

而KKT条件就是指上面最优化数学模型的标准形式中的最小点 x* 必须满足下面的条件:

经过论证,我们这里的问题是满足 KKT 条件的(首先已经满足Slater condition,再者f和gi也都是可微的,即L对w和b都可导),因此如今我们便转化为求解第二个问题。

也就是说,原始问题通过满足KKT条件,已经转化成了对偶问题。

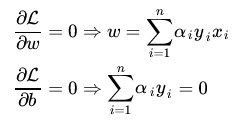

而求解这个对偶学习问题,分为3个步骤:首先要让L(w,b,a) 关于 w 和 b 最小化,然后求对![]() 的极大,最后利用SMO算法求解对偶问题中的拉格朗日乘子。

的极大,最后利用SMO算法求解对偶问题中的拉格朗日乘子。

2.1.3、对偶问题求解的3个步骤

(1)、首先固定![]() ,要让

,要让

将以上结果代入之前的L

得到:

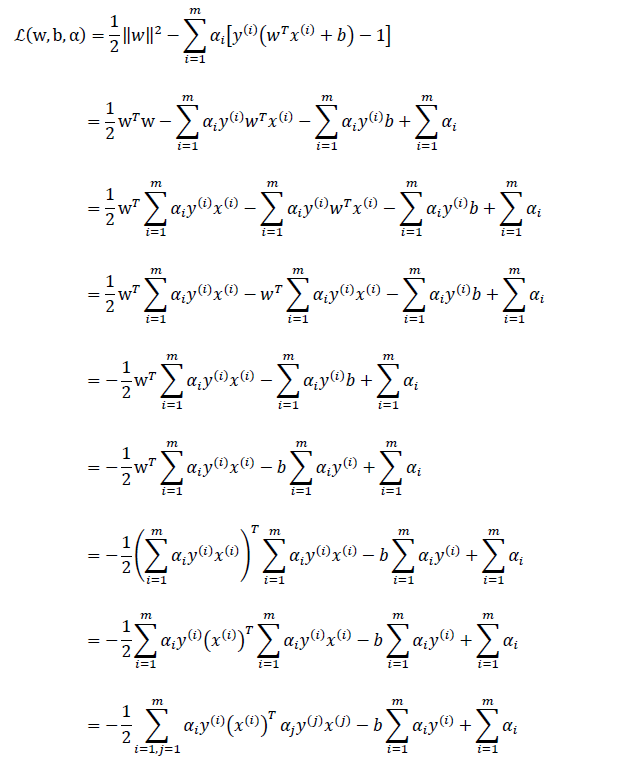

提醒:有读者可能会问上述推导过程怎样而来?说实话。其详细推导过程是比較复杂的,例如以下图所看到的:

最后。得到:

如 jerrylead所说:“倒数第4步”推导到“倒数第3步”使用了线性代数的转置运算,由于ai和yi都是实数,因此转置后与自身一样。

“倒数第3步”推导到“倒数第2步”使用了(a+b+c+…)(a+b+c+…)=aa+ab+ac+ba+bb+bc+…的乘法运算法则。最后一步是上一步的顺序调整。

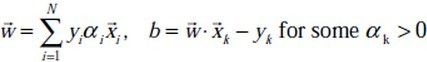

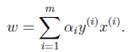

从上面的最后一个式子。我们能够看出,此时的拉格朗日函数仅仅包含了一个变量。那就是![]() (求出了

(求出了![]() 便能求出w,和b,由此可见,上文第1.2节提出来的核心问题:分类函数

便能求出w,和b,由此可见,上文第1.2节提出来的核心问题:分类函数![]() 也就能够轻而易举的求出来了)。

也就能够轻而易举的求出来了)。

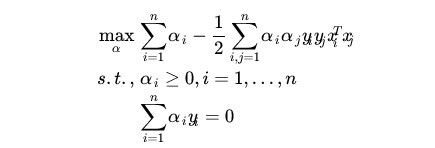

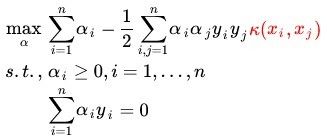

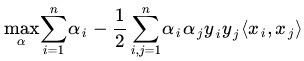

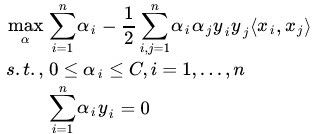

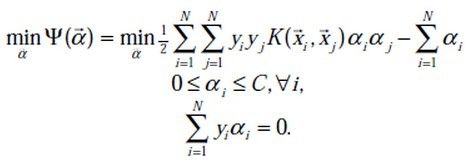

(2)、求对![]() 的极大。即是关于对偶问题的最优化问题。经过上面第一个步骤的求w和b,得到的拉格朗日函数式子已经没有了变量w,b。仅仅有

的极大。即是关于对偶问题的最优化问题。经过上面第一个步骤的求w和b,得到的拉格朗日函数式子已经没有了变量w,b。仅仅有![]() 。从上面的式子得到:

。从上面的式子得到:

这样。求出了

。

。 (3)在求得L(w, b, a) 关于 w 和 b 最小化,以及对![]() 的极大之后,最后一步便是利用SMO算法求解对偶问题中的拉格朗日乘子

的极大之后,最后一步便是利用SMO算法求解对偶问题中的拉格朗日乘子![]() 。

。

要了解这个SMO算法是怎样推导的,请跳到下文第3.5节、SMO算法。

2.1.5、线性不可分的情况

OK。为过渡到下节2.2节所介绍的核函数。让我们再来看看上述推导过程中得到的一些有趣的形式。

首先就是关于我们的 hyper plane ,对于一个数据点

![]() 算出结果然后依据其正负号来进行类别划分的。而前面的推导中我们得到

算出结果然后依据其正负号来进行类别划分的。而前面的推导中我们得到

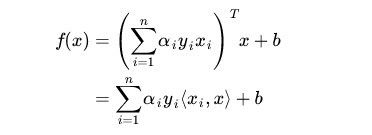

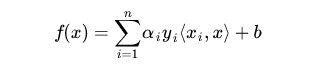

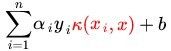

因此分类函数为:

这里的形式的有趣之处在于,对于新点 x的预測,仅仅须要计算它与训练数据点的内积就可以(![]() 表示向量内积)。这一点至关重要,是之后使用 Kernel 进行非线性推广的基本前提。

表示向量内积)。这一点至关重要,是之后使用 Kernel 进行非线性推广的基本前提。

此外,所谓 Supporting Vector 也在这里显示出来——事实上。全部非Supporting Vector 所相应的系数![]() 都是等于零的,因此对于新点的内积计算实际上仅仅要针对少量的“支持向量”而不是全部的训练数据就可以。

都是等于零的,因此对于新点的内积计算实际上仅仅要针对少量的“支持向量”而不是全部的训练数据就可以。

为什么非支持向量相应的![]() 等于零呢?直观上来理解的话。就是这些“后方”的点——正如我们之前分析过的一样。对超平面是没有影响的,由于分类全然有超平面决定。所以这些无关的点并不会參与分类问题的计算,因而也就不会产生不论什么影响了。

等于零呢?直观上来理解的话。就是这些“后方”的点——正如我们之前分析过的一样。对超平面是没有影响的,由于分类全然有超平面决定。所以这些无关的点并不会參与分类问题的计算,因而也就不会产生不论什么影响了。

回想一下我们2.1.1节中通过 Lagrange multiplier得到的目标函数:

注意到假设

![]() 又是非负的,为了满足最大化,

又是非负的,为了满足最大化,![]() 必须等于 0 。这也就是这些非Supporting Vector 的点的局限性。

必须等于 0 。这也就是这些非Supporting Vector 的点的局限性。

从1.5节到上述全部这些东西,便得到了一个maximum margin hyper plane classifier,这就是所谓的支持向量机(Support Vector Machine)。当然,到眼下为止,我们的 SVM 还比較弱,仅仅能处理线性的情况,只是,在得到了对偶dual 形式之后。通过 Kernel 推广到非线性的情况就变成了一件非常easy的事情了(相信,你还记得本节开头所说的:“通过求解对偶问题得到最优解,这就是线性可分条件下支持向量机的对偶算法。这样做的长处在于:一者对偶问题往往更easy求解;二者能够自然的引入核函数。进而推广到非线性分类问题”)。

2.2、核函数Kernel

2.2.1、特征空间的隐式映射:核函数

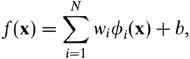

咱们首先给出核函数的来头:在上文中,我们已经了解到了SVM处理线性可分的情况,而对于非线性的情况,SVM 的处理方法是选择一个核函数 κ(⋅,⋅) 。通过将数据映射到高维空间。来解决在原始空间中线性不可分的问题。

此外,由于训练样例通常是不会独立出现的,它们总是以成对样例的内积形式出现。而用对偶形式表示学习器的优势在为在该表示中可调參数的个数不依赖输入属性的个数,通过使用恰当的核函数来替代内积,能够隐式得将非线性的训练数据映射到高维空间,而不增加可调參数的个数(当然。前提是核函数能够计算相应着两个输入特征向量的内积)。

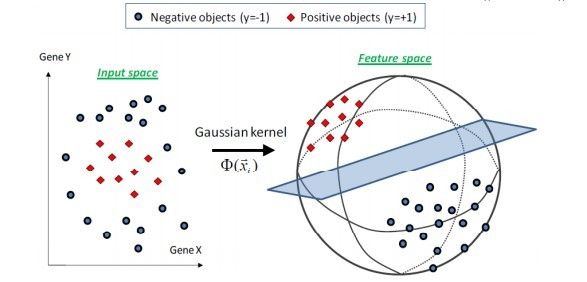

在线性不可分的情况下,支持向量机首先在低维空间中完毕计算。然后通过核函数将输入空间映射到高维特征空间,终于在高维特征空间中构造出最优分离超平面,从而把平面上本身不好分的非线性数据分开。如图7-7所看到的,一堆数据在二维空间无法划分。从而映射到三维空间里划分:

- 首先使用一个非线性映射将数据变换到一个特征空间F,

- 然后在特征空间使用线性学习器分类。

2.2.2、核函数:怎样处理非线性数据

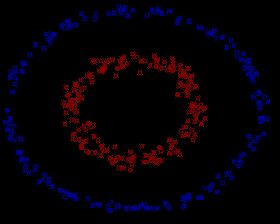

来看个核函数的样例。例如以下图所看到的的两类数据,分别分布为两个圆圈的形状。这样的数据本身就是线性不可分的,此时咱们该怎样把这两类数据分开呢(下文将会有一个相应的三维空间图)?

事实上。上图所述的这个数据集。是用两个半径不同的圆圈加上了少量的噪音生成得到的,所以。一个理想的分界应该是一个“圆圈”而不是一条线(超平面)。假设用

注意上面的形式,假设我们构造另外一个五维的空间。当中五个坐标的值分别为

关于新的坐标

再进一步描写叙述 Kernel 的细节之前。最好还是再来看看这个样例映射过后的直观样例。当然,你我可能无法把 5 维空间画出来,只是由于我这里生成数据的时候就是用了特殊的情形,详细来说,我这里的超平面实际的方程是这个样子(圆心在

因此我仅仅须要把它映射到

核函数相当于把原来的分类函数:

映射成:

而当中的![]() 能够通过求解例如以下 dual 问题而得到的:

能够通过求解例如以下 dual 问题而得到的:

这样一来问题就攻克了吗?似乎是的:拿到非线性数据,就找一个映射

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

所以就须要 Kernel 出马了。

最好还是还是从最開始的简单样例出发。设两个向量![]() 和

和![]() ,而

,而![]() 即是到前面说的五维空间的映射。因此映射过后的内积为:

即是到前面说的五维空间的映射。因此映射过后的内积为:

(公式说明:上面的这两个推导过程中。所说的前面的五维空间的映射。这里说的前面便是文中2.2.1节的所述的映射方式,回想下之前的映射规则,再看那第一个推导。事实上就是计算x1,x2各自的内积,然后相乘相加就可以,第二个推导则是直接平方,去掉括号,也非常easy推出来)

另外,我们又注意到:

二者有非常多类似的地方,实际上,我们仅仅要把某几个维度线性缩放一下。然后再加上一个常数维度,详细来说,上面这个式子的计算结果实际上和映射

之后的内积![]() 的结果是相等的。那么差别在于什么地方呢?

的结果是相等的。那么差别在于什么地方呢?

- 一个是映射到高维空间中,然后再依据内积的公式进行计算;

- 而还有一个则直接在原来的低维空间中进行计算,而不须要显式地写出映射后的结果。

(公式说明:上面之中,最后的两个式子。第一个算式。是带内积的全然平方式。能够拆开,然后,通过凑一个得到,第二个算式,也是依据第一个算式凑出来的)

回想刚才提到的映射的维度爆炸,在前一种方法已经无法计算的情况下,后一种方法却依然能从容处理,甚至是无穷维度的情况也没有问题。

我们把这里的计算两个向量在隐式映射过后的空间中的内积的函数叫做核函数 (Kernel Function) ,比如,在刚才的样例中,我们的核函数为:

核函数能简化映射空间中的内积运算——刚好“碰巧”的是,在我们的 SVM 里须要计算的地方数据向量总是以内积的形式出现的。对照刚才我们上面写出来的式子,如今我们的分类函数为:

当中

![]()

这样一来计算的问题就算攻克了,避开了直接在高维空间中进行计算。而结果却是等价的!当然,由于我们这里的样例非常简单,所以我能够手工构造出相应于![]() 的核函数出来,假设对于随意一个映射,想要构造出相应的核函数就非常困难了。

的核函数出来,假设对于随意一个映射,想要构造出相应的核函数就非常困难了。

2.2.3、几个核函数

通常人们会从一些经常使用的核函数中选择(依据问题和数据的不同,选择不同的參数。实际上就是得到了不同的核函数),比如:

- 多项式核

,显然刚才我们举的样例是这里多项式核的一个特例(R = 1。d = 2)。尽管比較麻烦,并且没有必要。只是这个核所相应的映射实际上是能够写出来的,该空间的维度是

,当中

,当中

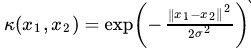

- 高斯核

,这个核就是最開始提到过的会将原始空间映射为无穷维空间的那个家伙。只是。假设

,这个核就是最開始提到过的会将原始空间映射为无穷维空间的那个家伙。只是。假设 选得非常大的话。高次特征上的权重实际上衰减得非常快。所以实际上(数值上近似一下)相当于一个低维的子空间;反过来。假设

选得非常大的话。高次特征上的权重实际上衰减得非常快。所以实际上(数值上近似一下)相当于一个低维的子空间;反过来。假设 选得非常小,则能够将随意的数据映射为线性可分——当然,这并不一定是好事。由于随之而来的可能是非常严重的过拟合问题。

选得非常小,则能够将随意的数据映射为线性可分——当然,这并不一定是好事。由于随之而来的可能是非常严重的过拟合问题。只是,总的来说,通过调控參数

,高斯核实际上具有相当高的灵活性,也是使用最广泛的核函数之中的一个。下图所看到的的样例便是把低维线性不可分的数据通过高斯核函数映射到了高维空间:

,高斯核实际上具有相当高的灵活性,也是使用最广泛的核函数之中的一个。下图所看到的的样例便是把低维线性不可分的数据通过高斯核函数映射到了高维空间:

- 线性核

,这实际上就是原始空间中的内积。这个核存在的主要目的是使得“映射后空间中的问题”和“映射前空间中的问题”两者在形式上统一起来了(意思是说,咱们有的时候,写代码,或写公式的时候。仅仅要写个模板或通用表达式,然后再代入不同的核。便能够了。于此,便在形式上统一了起来,不用再分别写一个线性的,和一个非线性的)。

,这实际上就是原始空间中的内积。这个核存在的主要目的是使得“映射后空间中的问题”和“映射前空间中的问题”两者在形式上统一起来了(意思是说,咱们有的时候,写代码,或写公式的时候。仅仅要写个模板或通用表达式,然后再代入不同的核。便能够了。于此,便在形式上统一了起来,不用再分别写一个线性的,和一个非线性的)。

2.2.4、核函数的本质

- 实际中,我们会经常遇到线性不可分的样例,此时,我们的经常使用做法是把样例特征映射到高维空间中去(如上文2.2节最開始的那幅图所看到的,映射到高维空间后,相关特征便被分开了。也就达到了分类的目的)。

- 但进一步,假设凡是遇到线性不可分的样例。一律映射到高维空间,那么这个维度大小是会高到可怕的(如上文中19维乃至无穷维的样例)。那咋办呢?

- 此时,核函数就隆重登场了。核函数的价值在于它尽管也是讲特征进行从低维到高维的转换,但核函数绝就绝在它事先在低维上进行计算。而将实质上的分类效果表如今了高维上,也就如上文所说的避免了直接在高维空间中的复杂计算。

2.3、使用松弛变量处理 outliers 方法

在本文第一节最開始讨论支持向量机的时候。我们就假定。数据是线性可分的,亦即我们能够找到一个可行的超平面将数据全然分开。后来为了处理非线性数据,在上文2.2节使用 Kernel 方法对原来的线性 SVM 进行了推广。使得非线性的的情况也能处理。尽管通过映射

![]()

![]()

![]()

![]()

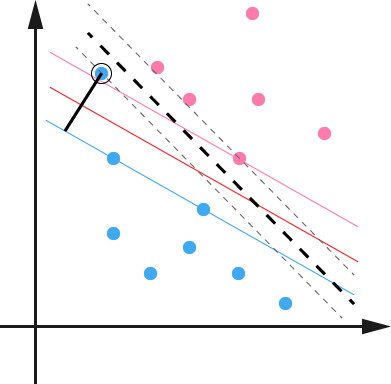

比如可能并非由于数据本身是非线性结构的,而仅仅是由于数据有噪音。对于这样的偏离正常位置非常远的数据点,我们称之为 outlier 。在我们原来的 SVM 模型里,outlier 的存在有可能造成非常大的影响,由于超平面本身就是仅仅有少数几个 support vector 组成的。假设这些 support vector 里又存在 outlier 的话。其影响就非常大了。比例如以下图:

用黑圈圈起来的那个蓝点是一个 outlier ,它偏离了自己原本所应该在的那个半空间,假设直接忽略掉它的话。原来的分隔超平面还是挺好的,可是由于这个 outlier 的出现,导致分隔超平面不得不被挤歪了,变成途中黑色虚线所看到的(这仅仅是一个示意图,并没有严格计算精确坐标)。同一时候 margin 也相应变小了。

当然。更严重的情况是,假设这个 outlier 再往右上移动一些距离的话。我们将无法构造出能将数据分开的超平面来。

为了处理这样的情况。SVM 同意数据点在一定程度上偏离一下超平面。

比如上图中,黑色实线所相应的距离,就是该 outlier 偏离的距离,假设把它移动回来,就刚好落在原来的超平面上,而不会使得超平面发生变形了。

插播下一位读者@Copper_PKU的理解:“换言之,在有松弛的情况下outline点也属于支持向量SV。同一时候。对于不同的支持向量,拉格朗日參数的值也不同,如此篇论文《Large Scale Machine Learning》中的下图所看到的:

对于远离分类平面的点值为0;对于边缘上的点值在[0, 1/L]之间,当中,L为训练数据集个数,即数据集大小;对于outline数据和内部的数据值为1/L。

很多其他请參看本文文末參考条目第51条。”

OK,继续回到咱们的问题。我们。原来的约束条件为:

如今考虑到outlier问题,约束条件变成了:

当中![]() 称为松弛变量 (slack variable) ,相应数据点

称为松弛变量 (slack variable) ,相应数据点![]() 同意偏离的 functional margin 的量。当然。假设我们执行

同意偏离的 functional margin 的量。当然。假设我们执行![]() 随意大的话,那随意的超平面都是符合条件的了。

随意大的话,那随意的超平面都是符合条件的了。

所以。我们在原来的目标函数后面加上一项,使得这些![]() 的总和也要最小:

的总和也要最小:

当中

![]()

![]()

![]()

完整地写出来是这个样子:

分析方法和前面一样,转换为还有一个问题之后,我们先让![]() 针对

针对![]() 、

、

![]() 和

和![]() 最小化:

最小化:

将

![]()

![]()

只是。由于我们得到![]() 而又有

而又有![]() (作为 Lagrange multiplier 的条件),因此有

(作为 Lagrange multiplier 的条件),因此有![]() ,所以整个 dual 问题如今写作:

,所以整个 dual 问题如今写作:

把前后的结果对照一下(错误修正:图中的Dual formulation中的Minimize应为maxmize):

能够看到唯一的差别就是如今 dual variable

行文至此,能够做个小结,不准确的说。SVM它本质上即是一个分类方法,用w^T+b定义分类函数,于是求w、b。为寻最大间隔,引出1/2||w||^2。继而引入拉格朗日因子,化为对拉格朗日乘子a的求解(求解过程中会涉及到一系列最优化或凸二次规划等问题),如此。求w.b与求a等价。而a的求解能够用一种高速学习算法SMO。至于核函数,是为处理非线性情况,若直接映射到高维计算恐维度爆炸,故在低维计算。等效高维表现。

OK,理解到这第二层,已经能满足绝大部分人一窥SVM原理的好奇心,然对于那些想在证明层面理解SVM的则还非常不够。但进入第三层理解境地之前,你必须要有比較好的数理基础和逻辑证明能力,不然你会跟我一样,吃不少苦头的。

第三层、证明SVM

说实话。凡是涉及到要证明的东西.理论,便一般不是怎么好惹的东西。

绝大部分时候,看懂一个东西不难,但证明一个东西则须要点数学功底。进一步。证明一个东西也不是特别难,难的是从零開始发明创造这个东西的时候,则显艰难(由于不论什么时代,大部分人的研究所得都只是是基于前人的研究成果,前人所做的是开创性工作,而这往往是最艰难最有价值的,他们被称为真正的先驱。

牛顿也曾说过。他只是是站在巨人的肩上。

你。我则更是如此)。

正如陈希孺院士在他的著作《数理统计学简史》的第4章、最小二乘法中所讲:在科研上诸多观念的革新和突破是有着非常多的不易的。也许某个定理在某个时期由某个人点破了,如今的我们看来一切都是理所当然,但在一切没有发现之前,可能许很多多的顶级学者毕其功于一役,耗尽一生,努力了几十年终于也是无功而返。

话休絮烦,要证明一个东西先要弄清楚它的根基在哪,即构成它的基础是哪些理论。OK。下面内容基本是上文中未讲到的一些定理的证明。包含其背后的逻辑、来源背景等东西,还是读书笔记。

本部分导述

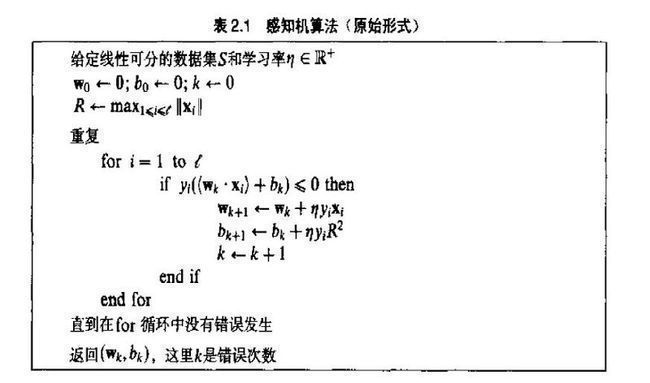

- 3.1节线性学习器中,主要阐述感知机算法;

- 3.2节非线性学习器中,主要阐述mercer定理;

- 3.3节、损失函数;

- 3.4节、最小二乘法;

- 3.5节、SMO算法;

- 3.6节、简略谈谈SVM的应用;

3.1、线性学习器

3.1.1、感知机算法

3.2、非线性学习器

3.2.1、Mercer定理

3.3、损失函数

在本文1.0节有这么一句话“支持向量机(SVM)是90年代中期发展起来的基于统计学习理论的一种机器学习方法,通过寻求结构化风险最小来提高学习机泛化能力,实现经验风险和置信范围的最小化,从而达到在统计样本量较少的情况下,亦能获得良好统计规律的目的。”但初次看到的读者可能并不了解什么是结构化风险,什么又是经验风险。

要了解这两个所谓的“风险”。还得又从监督学习说起。

监督学习实际上就是一个经验风险或者结构风险函数的最优化问题。

风险函数度量平均意义下模型预測的好坏,模型每一次预測的好坏用损失函数来度量。它从假设空间F中选择模型f作为决策函数,对于给定的输入X,由f(X)给出相应的输出Y,这个输出的预測值f(X)与真实值Y可能一致也可能不一致,用一个损失函数来度量预測错误的程度。损失函数记为L(Y, f(X))。

经常使用的损失函数有下面几种(基本引用自《统计学习方法》):

如此,SVM有另外一种理解,即最优化+损失最小。或如@夏粉_百度所说“可从损失函数和优化算法角度看SVM,boosting。LR等算法。可能会有不同收获”。

OK。关于很多其他统计学习方法的问题,请參看此文。

关于损失函数,例如以下文读者评论中所述:能够看看张潼的这篇《Statistical behavior and consistency of classification methods based on convex risk minimization》。各种算法中经常使用的损失函数基本都具有fisher一致性。优化这些损失函数得到的分类器能够看作是后验概率的“代理”。此外。张潼还有另外一篇论文《Statistical analysis of some multi-category large margin classification methods》,在多分类情况下margin loss的分析,这两篇对Boosting和SVM使用的损失函数分析的非常透彻。

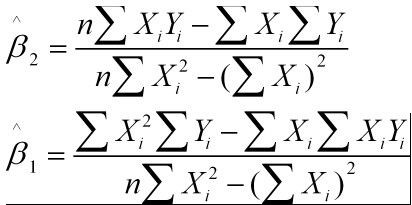

3.4、最小二乘法

3.4.1、什么是最小二乘法?

既然本节開始之前提到了最小二乘法,那么下面引用《正态分布的前世今生》里的内容略微简单阐述下。

我们口头中经常说:一般来说,平均来说。如平均来说,不吸烟的健康优于吸烟者。之所以要加“平均”二字。是由于凡事皆有例外。总存在某个特别的人他吸烟但由于经常锻炼所以他的健康状况可能会优于他身边不吸烟的朋友。而最小二乘法的一个最简单的样例便是算术平均。

最小二乘法(又称最小平方法)是一种数学优化技术。它通过最小化误差的平方和寻找数据的最佳函数匹配。

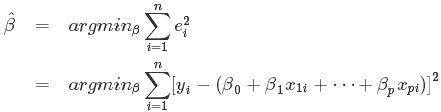

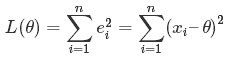

利用最小二乘法能够简便地求得未知的数据,并使得这些求得的数据与实际数据之间误差的平方和为最小。用函数表示为:

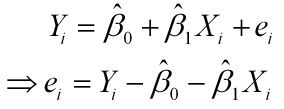

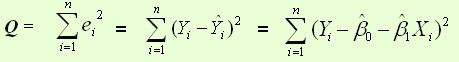

使误差「所谓误差,当然是观察值与实际真实值的差量」平方和达到最小以寻求预计值的方法,就叫做最小二乘法。用最小二乘法得到的预计。叫做最小二乘预计。当然,取平方和作为目标函数仅仅是众多可取的方法之中的一个。

最小二乘法的一般形式可表示为:

有效的最小二乘法是勒让德在 1805 年发表的。基本思想就是觉得測量中有误差,所以全部方程的累积误差为

我们求解出导致累积误差最小的參数就可以:

勒让德在论文中对最小二乘法的优良性做了几点说明:

- 最小二乘使得误差平方和最小。并在各个方程的误差之间建立了一种平衡,从而防止某一个极端误差取得支配地位

- 计算中仅仅要求偏导后求解线性方程组,计算过程明确便捷

- 最小二乘能够导出算术平均值作为预计值

对于最后一点。从统计学的角度来看是非常重要的一个性质。推理例如以下:假设真值为

由于算术平均是一个历经考验的方法,而以上的推理说明。算术平均是最小二乘的一个特例。所以从还有一个角度说明了最小二乘方法的优良性,使我们对最小二乘法更加有信心。

最小二乘法发表之后非常快得到了大家的认可接受,并迅速的在数据分析实践中被广泛使用。只是历史上又有人把最小二乘法的发明归功于高斯,这又是怎么一回事呢。高斯在1809年也发表了最小二乘法。并且声称自己已经使用这种方法多年。高斯发明了小行星定位的数学方法。并在数据分析中使用最小二乘方法进行计算。准确的预測了谷神星的位置。

说了这么多,貌似跟本文的主题SVM没啥关系呀,别急,请让我继续阐述。

本质上说。最小二乘法即是一种參数预计方法,说到參数预计,咱们得从一元线性模型说起。

3.4.2、最小二乘法的解法

- 监督学习中,假设预測的变量是离散的,我们称其为分类(如决策树,支持向量机等),假设预測的变量是连续的,我们称其为回归。

- 回归分析中,假设仅仅包含一个自变量和一个因变量,且二者的关系可用一条直线近似表示,这样的回归分析称为一元线性回归分析。

- 假设回归分析中包含两个或两个以上的自变量。且因变量和自变量之间是线性关系。则称为多元线性回归分析。

- 对于二维空间线性是一条直线;对于三维空间线性是一个平面,对于多维空间线性是一个超平面...

对于平面中的这n个点,能够使用无数条曲线来拟合。要求样本回归函数尽可能好地拟合这组值。

综合起来看,这条直线处于样本数据的中心位置最合理。

有下面三个标准能够选择:

- 用“残差和最小”确定直线位置是一个途径。

但非常快发现计算“残差和”存在相互抵消的问题。

- 用“残差绝对值和最小”确定直线位置也是一个途径。

但绝对值的计算比較麻烦。

- 最小二乘法的原则是以“残差平方和最小”确定直线位置。用最小二乘法除了计算比較方便外。得到的预计量还具有优良特性。这样的方法对异常值非常敏感。

OK。很多其他请參看陈希孺院士的《数理统计学简史》的第4章、最小二乘法。

3.5、SMO算法

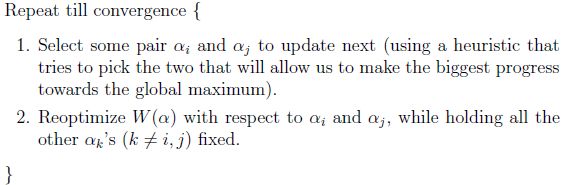

在上文中。我们提到了求解对偶问题的序列最小最优化SMO算法,但并未提到其详细解法。首先看下最后悬而未决的问题:

等价于求解:

1998年。Microsoft Research的John C. Platt在论文《Sequential Minimal Optimization:A Fast Algorithm for Training Support Vector Machines》中提出针对上述问题的解法:SMO算法,它非常快便成为最快的二次规划优化算法,特别是在针对线性SVM和数据稀疏时性能更优。

接下来,咱们便參考John C. Platt的这篇文章来看看SMO的解法是怎样的。

3.5.1、SMO算法的推导

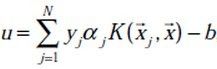

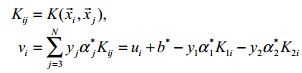

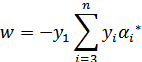

咱们首先来定义特征到结果的输出函数:

注:这个u与我们之前定义的![]() 实质是一样的。

实质是一样的。

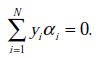

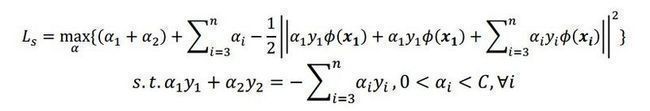

接着,又一次定义下咱们原始的优化问题,权当又一次回想,例如以下:

求导得到:

从而终于我们的问题变为:

下面要解决的问题是:在![]() 上求上述目标函数的最小值。

上求上述目标函数的最小值。

为了求解这些乘子,每次从中随意抽取两个乘子![]() 和

和![]() 。然后固定

。然后固定![]() 和

和![]() 以外的其他乘子

以外的其他乘子![]() 。使得目标函数仅仅是关于

。使得目标函数仅仅是关于![]() 和

和![]() 的函数。这样,不断的从一堆乘子中随意抽取两个求解,不断的迭代求解子问题。终于达到求解原问题的目的。

的函数。这样,不断的从一堆乘子中随意抽取两个求解,不断的迭代求解子问题。终于达到求解原问题的目的。

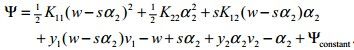

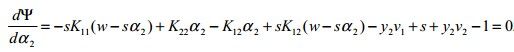

而原对偶问题的子问题的目标函数能够表达为:

当中

为了解决这个子问题,首要问题便是每次怎样选取![]() 和

和![]() 。实际上。当中一个乘子是违法KKT条件最严重的,另外一个乘子则由还有一个约束条件选取。

。实际上。当中一个乘子是违法KKT条件最严重的,另外一个乘子则由还有一个约束条件选取。

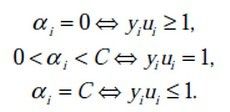

依据KKT条件能够得出目标函数中![]() 取值的意义:

取值的意义:

- 对于第1种情况,表明

是正常分类。在边界内部(我们知道正确分类的点

是正常分类。在边界内部(我们知道正确分类的点 );

); - 对于第2种情况,表明了

是支持向量。在边界上;

是支持向量。在边界上; - 对于第3种情况,表明了

是在两条边界之间;

是在两条边界之间;

<=1可是

<=1可是 <C则是不满足的,而原本

<C则是不满足的,而原本 =C

=C >=1可是

>=1可是 >0则是不满足的,而原本

>0则是不满足的,而原本 =0

=0 =1可是

=1可是 =0或者

=0或者 =C则表明不满足的,而原本应该是0<

=C则表明不满足的,而原本应该是0< <C

<C

此外,更新的同一时候还要受到第二个约束条件的限制,即。

当中,

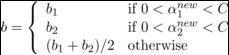

为了求解![]() ,得先确定

,得先确定![]() 的取值范围。假设它的上下边界分别为H和L。那么有:

的取值范围。假设它的上下边界分别为H和L。那么有:

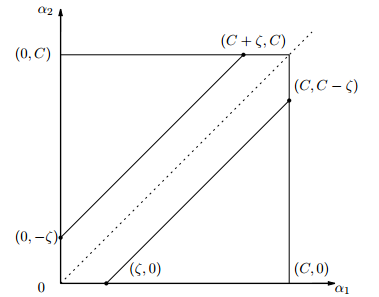

当y1 != y2时,依据![]() 可得

可得![]() ,所以有

,所以有![]() ,

,![]() ,例如以下图所看到的:

,例如以下图所看到的:

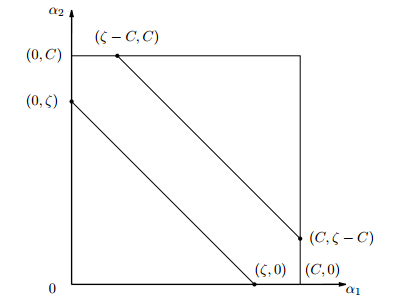

当y1 = y2时,相同依据![]() 可得:

可得:![]() 。所以有

。所以有![]() 。

。![]() ,例如以下图所看到的:

,例如以下图所看到的:

化简下:

- 对于

,即第一个乘子。能够通过刚刚说的那3种不满足KKT的条件来找;

,即第一个乘子。能够通过刚刚说的那3种不满足KKT的条件来找; - 而对于第二个乘子

能够寻找满足条件 :

能够寻找满足条件 : 的乘子。

的乘子。

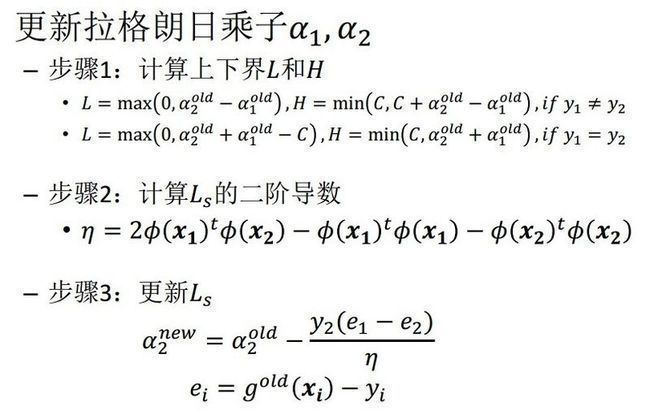

3.5.2、SMO算法的步骤

知道了怎样更新乘子,那么选取哪些乘子进行更新呢?详细选择方法有下面两个步骤:

- 步骤1:先“扫描”全部乘子,把第一个违反KKT条件的作为更新对象,令为a2;

- 步骤2:在全部不违反KKT条件的乘子中。选择使|E1 −E2|最大的a1进行更新。使得能最大限度增大目标函数的值(类似于梯度下降。此外

,而

,而 ,求出来的E代表函数ui对输入xi的预測值与真实输出类标记yi之差)。

,求出来的E代表函数ui对输入xi的预測值与真实输出类标记yi之差)。

综上,SMO算法的基本思想是将Vapnik在1982年提出的Chunking方法推到极致,SMO算法每次迭代仅仅选出两个分量ai和aj进行调整,其他分量则保持固定不变,在得到解ai和aj之后,再用ai和aj改进其他分量。与通常的分解算法比較,尽管它可能须要很多其他的迭代次数,但每次迭代的计算量比較小,所以该算法表现出整理的高速收敛性,且不须要存储核矩阵,也没有矩阵运算。

3.5.3、SMO算法的实现

行文至此,我相信,SVM理解到了一定程度后。是的确能在脑海里从头至尾推导出相关公式的,最初分类函数,最大化分类间隔,max1/||w||。min1/2||w||^2,凸二次规划,拉格朗日函数,转化为对偶问题,SMO算法,都为寻找一个最优解,一个最优分类平面。一步步梳理下来,为什么这样那样,太多东西能够追究。最后实现。

例如以下图所看到的:

至于下文中将阐述的核函数则为是为了更好的处理非线性可分的情况,而松弛变量则是为了纠正或约束少量“不安分”或脱离集体不好归类的因子。

台湾的林智仁教授写了一个封装SVM算法的libsvm库,大家能够看看,此外这里还有一份libsvm的凝视文档。

除了在这篇论文《fast training of support vector machines using sequential minimal optimization》中platt给出了SMO算法的逻辑代码之外,这里也有一份SMO的实现代码,大家能够看下。

3.6、SVM的应用

也许我们已经听到过,SVM在非常多诸如文本分类,图像分类。生物序列分析和生物数据挖掘,手写字符识别等领域有非常多的应用,但也许你并没强烈的意识到,SVM能够成功应用的领域远远超出如今已经在开发应用了的领域。

3.6.1、文本分类

一个文本分类系统不仅是一个自然语言处理系统,也是一个典型的模式识别系统,系统的输入是须要进行分类处理的文本,系统的输出则是与文本关联的类别。由于篇幅所限。其他更详细内容本文将不再详述。

OK,本节虽取标题为证明SVM。但聪明的读者们想必早已看出,事实上本部分并无多少证明部分(特此致歉),怎么办呢?能够參阅《支持向量机导论》一书。此书精简而有趣。本节完。

读者评论

- “压力”陡增的评论→//@藏了个锋:我是看着July大神的博文长大的啊//@zlkysl:就是看了最后那一篇才决定自己的研究方向为SVM的。--http://weibo.com/1580904460/zraWk0u6u?mod=weibotime。

- @张金辉:“SVM的三重境地,不得不转的一篇。事实上Coursera的课堂上Andrew Ng讲过支持向量机,但显然他没有把这作为重点。加上Ng讲支持向量机的方法我一时半会难以全然消化,所以听的也是一知半解。真正開始了解支持向量机就是看的这篇“三重境地”,之后才对这个算法有了大概的概念,以至怎样去使用,再到当中的原理为何。再到支持向量机的证明等。总之,这篇文章开启了我长达数月的研究支持向量机阶段。直到今日。

- @孤独之守望者:"最后,推出svm的cost function 是hinge loss,然后对照其他的方法的cost function。说明事实上他们的目标函数非常像。那么问题是svm为什么这么popular呢?您能够再加些VC dimension跟一些error bound的数学,点一下。提供一个思路和方向"。--http://weibo.com/1580904460/AiohoyDwq?mod=weibotime。

- @夏粉_百度:“在面试时。考察SVM可考察机器学习各方面能力:目标函数,优化过程,并行方法,算法收敛性,样本复杂度。适用场景,调參经验,只是个人觉得考察boosting和LR也还不错啊。此外,随着统计机器学习不断进步。SVM仅仅被当成使用了一个替代01损失hinge研究,更通用的方法被提出。损失函数研究替代损失与贝叶斯损失关系,算法稳定性研究替代损失与推广性能关系,凸优化研究怎样求解凸目标函数,SVM,boosting等算法仅仅是这些通用方法的一个详细组建而已。

”

- @居里猴姐:关于SVM损失函数的问题。能够看看张潼老师的这篇《Statistical behavior and consistency of classification methods based on convex risk minimization》。

各种算法中经常使用的损失函数基本都具有fisher一致性。优化这些损失函数得到的分类器能够看作是后验概率的“代理”。

此外,张潼老师还有另外一篇论文《Statistical analysis of some multi-category large margin classification methods》,在多分类情况下margin loss的分析,这两篇对Boosting和SVM使用的损失函数分析的非常透彻。

- @夏粉_百度:SVM用了hinge损失,hinge损失不可导,不如其他替代损失方便优化并且转换概率麻烦。

核函数也不太用,如今是大数据时代。样本非常大,无法想象一个n^2的核矩阵怎样存储和计算。

并且。如今如今非线性一般靠深度学习了。//@Copper_PKU:请教svm在工业界的应用典型的有哪些?工业界怎样选取核函数,经验的方法?svm的训练过程怎样优化?

- @Copper_PKU:July的svm tutorial 我个人觉得还能够增加和改动例如以下部分:(1) 对于支持向量解释,能够结合图和拉格朗日參数来表达。松弛中sv没有写出来. (2) SMO算法部分,增加Joachims论文中提到的算法。以及SMO算法选取workset的方法,包含SMO算法的收敛推断,还有之前共轭梯度求解方法,尽管是较早的算法。可是对于理解SMO算法有非常好的效果。模型的优化和求解都是迭代的过程,增加历史算法增强立体感。

- //@廖临川: 之所以sgd对大训练集的效果更好,1.由于SGD优化每次迭代使用样本子集,比使用训练全集(尤其是百万数量级)要快得多;2.假设目标函数是凸的或者伪凸的,SGD差点儿必定能够收敛到全局最优。否则。则收敛到局部最优;3.SGD一般不须要收敛到全局最优,仅仅要得到足够好的解。就能够马上停止。//@Copper_PKU:sgd的核心思想:是迭代训练。每拿到一个样本就算出基于当前w(t) 的loss function,t代表训练第t次,然后进行下一w(t+1)的更新。w(t+1)=w(t)-(learning rate) * loss function的梯度,这个类比神经网络中bp中的參数训练方法。 sample by sample就是每次仅处理一个样本 而不是一个batch。

- //@Copper_PKU:从损失函数角度说:primal问题能够理解为正则化项+lossfunction,求解目标是在两个中间取平衡 假设强调loss function最小则会overfitting。所以有C參数。 //@研究者July:SVM还真就是在一定限定条件下。即约束条件下求目标函数的最优值问题,同一时候,为降低误判率,尽量让损失最小。

- ...

參考文献及推荐阅读

- 《支持向量机导论》,[美] Nello Cristianini / John Shawe-Taylor 著;

- 支持向量机导论一书的支持站点:http://www.support-vector.net/;

- 《数据挖掘导论》,[美] Pang-Ning Tan / Michael Steinbach / Vipin Kumar 著;

- 《数据挖掘:概念与技术》,(加)Jiawei Han;Micheline Kamber 著;

- 《数据挖掘中的新方法:支持向量机》,邓乃扬 田英杰 著;

- 《支持向量机--理论、算法和扩展》,邓乃扬 田英杰 著;

- 支持向量机系列。pluskid:http://blog.pluskid.org/?

- http://www.360doc.com/content/07/0716/23/11966_615252.shtml。

- 数据挖掘十大经典算法初探;

- 《模式识别支持向量机指南》,C.J.C Burges 著;

- 《统计学习方法》,李航著;

- 《统计自然语言处理》,宗成庆编著,第十二章、文本分类;

- SVM入门系列,Jasper:http://www.blogjava.net/zhenandaci/category/31868.html。

- 近期邻决策和SVM数字识别的实现和比較,作者不详;

- 斯坦福大学机器学习课程原始讲义:http://www.cnblogs.com/jerrylead/archive/2012/05/08/2489725.html。

- 斯坦福机器学习课程笔记:http://www.cnblogs.com/jerrylead/tag/Machine%20Learning/。

- http://www.cnblogs.com/jerrylead/archive/2011/03/13/1982639.html;

- SMO算法的数学推导:http://www.cnblogs.com/jerrylead/archive/2011/03/18/1988419.html;

- 数据挖掘掘中所需的概率论与数理统计知识、上;

- 关于机器学习方面的文章。能够读读:http://www.cnblogs.com/vivounicorn/category/289453.html;

- 数学系教材推荐:http://blog.sina.com.cn/s/blog_5e638d950100dswh.html。

- 《神经网络与机器学习(原书第三版)》,[加] Simon Haykin 著。

- 正态分布的前世今生:http://t.cn/zlH3Ygc;

- 《数理统计学简史》,陈希孺院士著;

- 《最优化理论与算法(第2版)》,陈宝林编著;

- A Gentle Introduction to Support Vector Machines in Biomedicine:http://www.nyuinformatics.org/downloads/supplements/SVM_Tutorial_2010/Final_WB.pdf,此PPT非常赞,除了对引入拉格朗日对偶变量后的凸二次规划问题的深入度不够之外,其他都挺好,配图非常精彩。本文有几张图便引自此PPT中;

- 来自卡内基梅隆大学carnegie mellon university(CMU)的解说SVM的PPT:http://www.autonlab.org/tutorials/svm15.pdf;

- 发明libsvm的台湾林智仁教授06年的机器学习讲义SVM:http://wenku.baidu.com/link?url=PWTGMYNb4HGUrUQUZwTH2B4r8pIMgLMiWIK1ymVORrds_11VOkHwp-JWab7IALDiors64JW_6mD93dtuWHwFWxsAk6p0rzchR8Qh5_4jWHC;

- http://staff.ustc.edu.cn/~ketang/PPT/PRLec5.pdf;

- Introduction to Support Vector Machines (SVM),By Debprakash Patnai M.E (SSA)。https://www.google.com.hk/url?sa=t&rct=j&q=&esrc=s&source=web&cd=1&ved=0CCwQFjAA&url=http%3a%2f%2fwww%2epws%2estu%2eedu%2etw%2fccfang%2findex%2efiles%2fAI%2fAI%26ML-Support%2520Vector%2520Machine-1%2eppt&ei=JRR6UqT5C-iyiQfWyIDgCg&usg=AFQjCNGw1fTbpH4ltQjjmx1d25ZqbCN9nA。

- 多人推荐过的libsvm:http://www.csie.ntu.edu.tw/~cjlin/libsvm/;

- 《machine learning in action》,中文版为《机器学习实战》;

- SMO算法的提出:Sequential Minimal Optimization A Fast Algorithm for Training Support Vector Machines:http://research.microsoft.com/en-us/um/people/jplatt/smoTR.pdf。

- 《统计学习理论的本质》,[美] Vladimir N. Vapnik著,非常晦涩,不做过多推荐;

- 张兆翔。机器学习第五讲之支持向量机http://irip.buaa.edu.cn/~zxzhang/courses/MachineLearning/5.pdf;

- VC维的理论解释:http://www.svms.org/vc-dimension/,中文VC维解释http://xiaoxia001.iteye.com/blog/1163338;

- 来自NEC Labs America的Jason Weston关于SVM的讲义http://www.cs.columbia.edu/~kathy/cs4701/documents/jason_svm_tutorial.pdf;

- 来自MIT的SVM讲义:http://www.mit.edu/~9.520/spring11/slides/class06-svm.pdf。

- PAC问题:http://www.cs.huji.ac.il/~shashua/papers/class11-PAC2.pdf。

- 百度张潼老师的两篇论文:《Statistical behavior and consistency of classification methods based on convex risk minimization》http://home.olemiss.edu/~xdang/676/Consistency_of_Classification_Convex_Risk_Minimization.pdf,《Statistical analysis of some multi-category large margin classification methods》;

- http://jacoxu.com/?p=39;

- 《矩阵分析与应用》,清华张贤达著。

- SMO算法的实现:http://blog.csdn.net/techq/article/details/6171688;

- 常见面试之机器学习算法思想简单梳理:http://www.cnblogs.com/tornadomeet/p/3395593.html;

- 矩阵的wikipedia页面:http://zh.wikipedia.org/wiki/%E7%9F%A9%E9%98%B5。

- 最小二乘法及事实上现:http://blog.csdn.net/qll125596718/article/details/8248249。

- 统计学习方法概论:http://blog.csdn.net/qll125596718/article/details/8351337;

- http://www.csdn.net/article/2012-12-28/2813275-Support-Vector-Machine;

- A Tutorial on Support Vector Regression:http://alex.smola.org/papers/2003/SmoSch03b.pdf。SVR简明版:http://www.cmlab.csie.ntu.edu.tw/~cyy/learning/tutorials/SVR.pdf。

- SVM Org:http://www.support-vector-machines.org/;

- R. Collobert. Large Scale Machine Learning. Université Paris VI phd thesis. 2004:http://ronan.collobert.com/pub/matos/2004_phdthesis_lip6.pdf。

- Making Large-Scale SVM Learning Practical:http://www.cs.cornell.edu/people/tj/publications/joachims_99a.pdf;

- 文本分类与SVM:http://blog.csdn.net/zhzhl202/article/details/8197109;

- Working Set Selection Using Second Order Information

for Training Support Vector Machines:http://www.csie.ntu.edu.tw/~cjlin/papers/quadworkset.pdf。 - SVM Optimization: Inverse Dependence on Training Set Size:http://icml2008.cs.helsinki.fi/papers/266.pdf。

- Large-Scale Support Vector Machines: Algorithms and Theory:http://cseweb.ucsd.edu/~akmenon/ResearchExam.pdf;

- 凸优化的概念:http://cs229.stanford.edu/section/cs229-cvxopt.pdf。

- 《凸优化》,作者: Stephen Boyd / Lieven Vandenberghe,原作名: Convex Optimization。

- Large-scale Non-linear Classification: Algorithms and Evaluations,Zhuang Wang。讲了非常多SVM算法的新进展:http://ijcai13.org/files/tutorial_slides/te2.pdf;

- 基于SMO算法实现SVM:http://www.cs.iastate.edu/~honavar/smo-svm.pdf;

- copper推荐的一些SVM相关的论文(当然,当中不少论文在上面的条目中都已经提到):http://c.blog.sina.com.cn/profile.php?

后记

有不论什么问题,敬请广大读者随时不吝批评指正。感谢。

- 13年11月25日,用chrome浏览器打开文章,右键打印,弹出打印框,把左上角的目标更改为“另存为PDF”,成第一个PDF:http://vdisk.weibo.com/s/zrFL6OXKghu5V。

- 13年12月7日,朋友吴新隆用“印象笔记”提取出博客正文。放到office内编辑成此PDF:http://vdisk.weibo.com/s/zrFL6OXKgQHm8,较上一版本号增加了完整的书签。

- 14年 2月18日。朋友邬书哲用Latex全部重排了本文全部公式,并且给全部公式和图片全部做了标记,Latex版PDF下载地址为:http://vdisk.weibo.com/s/zrFL6OXKgnlcp。

- 15年1月8日,朋友陈笙再为本SVM一文弄了最新的第二个LaTeX版本号。下载地址为:http://pan.baidu.com/s/1eQrgiOU。

本文会一直不断翻新,再者,上述 4 个PDF的阅读体验也还不是最好的,假设有朋友制作了更好的PDF,欢迎分享给我:http://weibo.com/julyweibo,谢谢。

July、2015年4月22日文章N变化(N > 100)。