Hive on Tez配置过程

没包的可以私信我,一次性发给你

①hive 官网地址:http://hive.apache.org/

一、部署 MySQL

部署hive前要先把MySQL部署好,首先检测当前系统是否安装过MySQL

rpm -qa|grep mariadb如果显示: mariadb-libs-5.5.56-2.el7.x86_64

则按如下命令卸载:

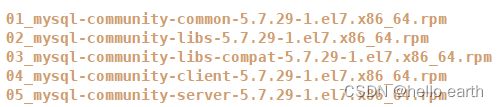

sudo rpm -e --nodeps mariadb-libs卸载完成后一次安装如下5个包

sudo rpm -ivh 01_mysql-community-common-5.7.29-1.el7.x86_64.rpm

sudo rpm -ivh 02_mysql-community-libs-5.7.29-1.el7.x86_64.rpm

sudo rpm -ivh 03_mysql-community-libs-compat-5.7.29-1.el7.x86_64.rpm

sudo rpm -ivh 04_mysql-community-client-5.7.29-1.el7.x86_64.rpm

sudo rpm -ivh 05_mysql-community-server-5.7.29-1.el7.x86_64.rpm安装后启动MySQL

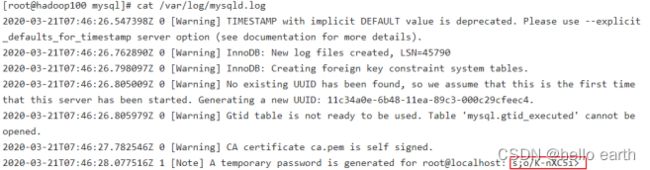

sudo systemctl start mysqld然后查看其启动时生成的临时密码

sudo cat /var/log/mysqld.log | grep password如图即为临时密码

用刚刚查到的密码进入mysql(如果报错,给密码加单引号)

mysql -uroot -p’password’因为MySQL的密码策略,需要设置一个比较复杂的密码(此处先随便设置一个复杂的密码)

set password=password("oiadslhkgfa");更改密码策略:

set global validate_password_length=4;

set global validate_password_policy=0;设置自己的密码

set password=password("自己的密码");进入MySQL数据库

use mysql

修改mysql库下的user表中的root用户允许任意ip连接

update user set host="%" where user="root";

flush privileges;二、部署HIVE

把本地的apache-hive-3.1.2-bin.tar.gz上传到linux

解压tar包:

tar -zxvf /opt/soft/apache-hive-3.1.2-bin.tar.gz -C /opt/module/修改apache-hive-3.1.2-bin.tar.gz的名称为hive

mv /opt/module/apache-hive-3.1.2-bin/ /opt/module/hive为hive添加环境变量,编辑自己的环境变量文件:

sudo vim /etc/profile.d/my_env.sh添加如下内容:

#HIVE_HOME

export HIVE_HOME=/opt/module/hive

export PATH=$PATH:$HIVE_HOME/bin配置完一定要source,或者重启一下让环境变量生效。

解决jar包冲突:

mv $HIVE_HOME/lib/log4j-slf4j-impl-2.10.0.jar $HIVE_HOME/lib/log4j-slf4j-impl-2.10.0.bak也可以直接把log4j-slf4j-impl-2.10.0.jar 删了,我就是这么搞的,也没有问题。

将MySQL的JDBC驱动拷贝到Hive的lib目录下:

cp /opt/software/mysql-connector-java-5.1.48.jar $HIVE_HOME/lib将元数据MetaStore配置到MySQL

vim $HIVE_HOME/conf/hive-site.xml写入一下内容:

javax.jdo.option.ConnectionURL

jdbc:mysql://hadoop102:3306/metastore?useSSL=false

javax.jdo.option.ConnectionDriverName

com.mysql.jdbc.Driver

javax.jdo.option.ConnectionUserName

root

javax.jdo.option.ConnectionPassword

这里是刚刚自己配的mysql密码

hive.metastore.warehouse.dir

/user/hive/warehouse

hive.metastore.schema.verification

false

hive.metastore.event.db.notification.api.auth

false

初始化元数据库:

mysql -uroot -p你配置的密码新建hive的元数据库

create database metastore;

quit;初始化元数据库:

schematool 时hive的bin目录下的一个可执行文件

schematool -initSchema -dbType mysql -verbose为hive配置元数据访问端口:在hive-site.xml中添加如下内容

vim $HIVE_HOME/conf/hive-site.xml

hive.metastore.uris

thrift://hadoop102:9083

hive.server2.thrift.bind.host

hadoop102

hive.server2.thrift.port

10000

此时的hive已经配置完成,可以使用mapreduce引擎进行操作,前提是集群的hdfs,yarn开启,并且启动hive前,要先启动metastore和hiveserver2这两个服务。

nohup hive --service metastore 2>&1 &

nohup hive --service hiveserver2 2>&1 &以上命令启动后会在后台运行,启动之后jps所在的shell命令行,会显示两个runjar,即为启动成功

同时我们也可以配置hive的日志目录,让日志存储在我们指定的目录,一边产生错误时查看:

mv $HIVE_HOME/conf/hive-log4j2.properties.template hive-log4j2.propertiesvim $HIVE_HOME/conf/hive-log4j2.properties会显示如下页面:

修改红色圈住的地方,配置日志存储目录。

三、部署TEZ

1)将tez安装包拷贝到集群,并解压tar包

mkdir /opt/module/tez

tar -zxvf /opt/software/tez-0.10.1-SNAPSHOT-minimal.tar.gz -C /opt/module/tez2)上传tez依赖到HDFS

hadoop fs -mkdir /tez

hadoop fs -put /opt/software/tez-0.10.1-SNAPSHOT.tar.gz /tez注意:解压的包和上传的依赖不一样

3)新建tez-site.xml(是在hadoop的目录下创建)

vim $HADOOP_HOME/etc/hadoop/tez-site.xml添加如下内容:

tez.lib.uris

${fs.defaultFS}/tez/tez-0.10.1-SNAPSHOT.tar.gz

tez.use.cluster.hadoop-libs

true

tez.am.resource.memory.mb

1024

tez.am.resource.cpu.vcores

1

tez.container.max.java.heap.fraction

0.4

tez.task.resource.memory.mb

1024

tez.task.resource.cpu.vcores

1

4)修改Hadoop环境变量

vim $HADOOP_HOME/etc/hadoop/shellprofile.d/tez.sh添加Tez的Jar包相关信息

hadoop_add_profile tez

function _tez_hadoop_classpath

{

hadoop_add_classpath "$HADOOP_HOME/etc/hadoop" after

hadoop_add_classpath "/opt/module/tez/*" after

hadoop_add_classpath "/opt/module/tez/lib/*" after

}5)修改Hive的计算引擎

vim $HIVE_HOME/conf/hive-site.xml添加如下内容:

hive.execution.engine

tez

hive.tez.container.size

1024

6)解决日志Jar包冲突

rm /opt/module/tez/lib/slf4j-log4j12-1.7.10.jar到此为止,就将tez引擎配置到hive了。