- 【vLLM 学习】Encoder Decoder Multimodal

HyperAI超神经

vLLMvLLMKV缓存大语言模型推理加速内存管理开源项目在线教程

vLLM是一款专为大语言模型推理加速而设计的框架,实现了KV缓存内存几乎零浪费,解决了内存管理瓶颈问题。更多vLLM中文文档及教程可访问→https://vllm.hyper.ai/*在线运行vLLM入门教程:零基础分步指南源码examples/offline_inference/encoder_decoder_multimodal.py#SPDX-License-Identifier:Apach

- LLM系统性学习完全指南(初学者必看系列)

GA琥珀

LLM学习人工智能语言模型

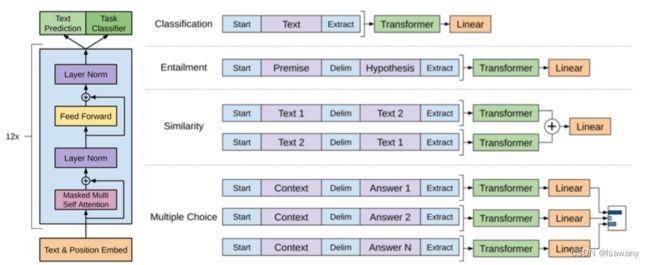

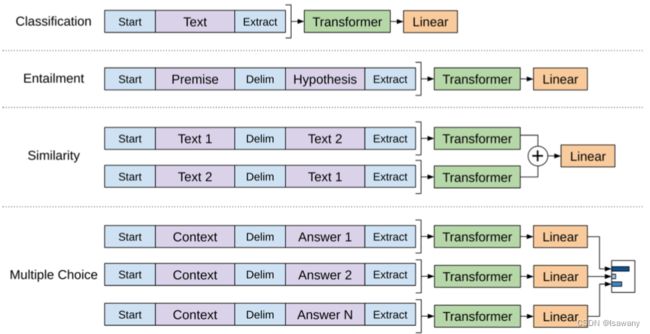

前言这篇文章将系统性的讲解LLM(LargeLanguageModels,LLM)的知识和应用。我们将从支撑整个领域的数学与机器学习基石出发,逐步剖析自然语言处理(NLP)的经典范式,深入探究引发革命的Transformer架构,并按时间顺序追溯从BERT、GPT-2到GPT-4、Llama及Gemini等里程碑式模型的演进。随后,我们将探讨如何将这些强大的基础模型转化为实用、安全的应用,涵盖对齐

- Synergizing RAG and Reasoning: A Systematic Review-RAG与推理能力深度结合-新方向

数据分析能量站

机器学习人工智能

欢迎关v:数据分析能量站0论文小结一、研究背景与核心问题大语言模型(LLM)在处理复杂任务时面临两大瓶颈:知识局限性:纯LLM存在“知识幻觉”(编造事实)和“领域知识缺口”;推理浅度:传统检索增强生成(RAG)仅通过关键词匹配获取信息,无法处理多跳推理、语义歧义等复杂需求。核心主张:RAG与推理的深度整合(RAG+Reasoning)是突破上述瓶颈的关键,通过“检索提供实时知识,推理赋予逻辑能力”

- AI数字人系统开发上线全攻略:从0到1全流程解析

v_qutudy

人工智能AI系统开发AI数字人开发

一、需求分析:定义数字人核心能力1.1功能规划矩阵模块基础功能进阶功能形象生成2D/3D建模实时表情捕捉与驱动语音交互TTS语音合成情感识别与应激反应动作系统预设动作库骨骼动画与物理引擎智能决策规则引擎强化学习驱动决策多模态交互文本/语音输入AR/VR空间交互1.2非功能性指标实时性:唇形同步延迟B[语音识别]A-->C[姿态检测]A-->D[文本理解]B-->E[NLP引擎]C-->F[动作解析

- CPO:对比偏好优化—突破大型语言模型在机器翻译中的性能边界

AI专题精讲

强化学习人工智能强化学习AI技术应用

温馨提示:本篇文章已同步至"AI专题精讲"CPO:对比偏好优化—突破大型语言模型在机器翻译中的性能边界摘要中等规模的大型语言模型(LLMs),如参数量为7B或13B的模型,在机器翻译(MT)任务中展现出良好性能。然而,它们仍未能达到最先进的传统编码器-解码器翻译模型,或是如GPT-4(OpenAI,2023)等更大规模LLM的表现。在本研究中,我们致力于弥合这一性能差距。我们首先评估了在机器翻译任

- 大型语言模型的智能本质是什么

ZhangJiQun&MXP

教学2021论文2024大模型以及算力语言模型人工智能自然语言处理

大型语言模型的智能本质是什么基于海量数据的统计模式识别与生成系统,数据驱动的语言模拟系统,其价值在于高效处理文本任务(如写作、翻译、代码生成),而非真正的理解与创造大型语言模型(如GPT-4、Claude等)的智能本质可概括为基于海量数据的统计模式识别与生成系统,其核心能力源于对语言规律的深度学习,但缺乏真正的理解与意识。以下从本质特征、技术机制、典型案例及争议点展开分析:一、智能本质的核心特征统

- AI+Python赋能!长时序植被遥感动态分析全攻略:从物候提取到生态评估

梦想的初衷~

土壤植被遥感人工智能遥感植被土壤

在遥感技术与人工智能深度融合的2025年,AI大模型正重塑长时序植被遥感数据分析范式。从Landsat/Sentinel卫星数据的智能化去云处理,到MODIS植被产品的AI辅助质量控制,以ChatGPT、DeepSeeK为代表的大模型技术已成为提升遥感数据处理效率与精度的核心工具——尤其在长时序植被动态监测、物候期精准提取、时空变异归因分析及生态环境质量评估等领域,展现出传统方法难以企及的技术优势

- 飞算JavaAI

一、产品简介飞算JavaAI是专为Java开发者打造的智能开发助手,深度适配Java技术栈。通过大语言模型(LLM)实现自然语言到代码的转换,覆盖需求分析、接口设计、表结构设计、业务逻辑生成、代码生成与合并等全流程开发环节。其核心优势在于:全流程自动化:从需求输入到完整工程代码生成,单日可完成传统数周的开发任务。代码质量保障:生成的代码符合阿里巴巴Java开发规范,支持静态代码分析工具自动检测安全

- AI 人工智能与 Copilot 的融合发展策略

AI天才研究院

AI人工智能与大数据人工智能copilotai

AI人工智能与Copilot的融合发展策略关键词:人工智能、Copilot、代码生成、人机协作、机器学习、自然语言处理、软件开发摘要:本文探讨了人工智能与Copilot技术的融合发展策略。我们将从技术原理、实现方法、应用场景等多个维度深入分析,提出一套完整的融合框架和发展路径。文章首先介绍背景和核心概念,然后详细讲解关键技术,包括自然语言处理、代码生成算法等,接着通过实际案例展示应用效果,最后讨论

- ColQwen-Omni:RAG全模态检索来了,支持【文本|图像|视频|音频】四种模态!

致Great

音视频

还记得ColPali、ColQwen和DSE吗?这些模型开创了视觉文档检索的新范式:无需费力地从文档中提取文本进行处理,只需将文档页面视为一系列图像(屏幕截图),然后训练视觉语言模型(VLM)直接将其内容表示为向量。ColPali的实践表明,这种策略通常比其他替代方法更快、更简单,并且能带来更好的检索性能。自发布一年以来,ColPali和ColQwen系列模型已被下载数百万次,被誉为“2024年顶

- 如何增强LLM(大语言模型)的“置信度”和“自信心” :LLM的“自信”不是“什么都能答”,而是“该答的答得准,不该答的敢说不”。

ZhangJiQun&MXP

教学2021AIpython2024大模型以及算力语言模型人工智能自然语言处理深度学习transformer机器学习

如何增强LLM(大语言模型)的“置信度”和“自信心”Pleaseprovideafirmanswer,andforthosewhodon’tknow,pleasereply‘unknown’LLM(大语言模型)的“置信度”(对输出内容的准确性判断)和“自信心”(稳定输出可靠信息的能力),核心逻辑与传统模型相通——让模型在“已知且可靠的知识范围内输出”,同时避免“强行回答陌生问题”。但LLM因生成式

- vLLM快速入门:开启高效推理与部署之旅

在如今这个人工智能飞速发展的时代,语言模型的应用已经深入到我们生活的方方面面,从智能聊天机器人到文本生成工具,都离不开强大的语言模型技术支持。而vLLM作为一个专注于高效推理和部署的开源项目,正在为研究人员和开发人员提供一种全新的解决方案,让语言模型的使用变得更加便捷、高效。初识vLLM:背景与意义vLLM(VeryLargeLanguageModelInference)是一个专注于大型语言模型推

- 深入解析 vLLM 分布式推理与部署策略

在当今人工智能快速发展的时代,大型语言模型(LLM)的推理和部署面临着诸多挑战,尤其是当模型规模日益庞大时,如何高效地利用硬件资源成为关键问题。vLLM作为一种强大的工具,为分布式推理和部署提供了多种策略,本文将详细探讨其相关技术和应用场景,希望能对您提供有价值的参考。分布式推理策略的选择在开始分布式推理和部署之前,明确何时采用分布式推理以及可选的策略至关重要。1.单GPU推理:如果模型能够在单个

- AI Agent从零到精通:深度解析Workflow、Prompt、Multi-Agent Systems和RL Training

爱看烟花的码农

AIGCNLP人工智能prompt

1.AI智能体简介:从概念到应用1.1什么是AI智能体?AI智能体是一种自主智能体,能够根据用户输入的目标,自主规划、执行和优化任务,最终生成结果。它不同于传统聊天模型(如ChatGPT)的单次回答能力,而是能处理多步骤、工具依赖、动态调整的复杂任务。例如:任务:用户要求“撰写一篇关于AI伦理的文章”。智能体行为:搜索资料、整理信息、撰写草稿、校对优化,全程无需用户干预。制造业场景(ManuS):

- Java NLP炼金术:从词袋到深度学习,构建AI时代的语言魔方

墨夶

Java学习资料人工智能java自然语言处理

一、JavaNLP的“三剑客”:框架与工具链1.1ApacheOpenNLP:传统NLP的“瑞士军刀”目标:用词袋模型实现文本分类与实体识别代码实战:文档分类器的“炼成术”//OpenNLP文档分类器(基于词袋模型)importopennlp.tools.doccat.*;importopennlp.tools.util.*;publicclassDocumentClassifier{//训练模型

- 高效批量单词翻译工具的设计与应用

本文还有配套的精品资源,点击获取简介:在信息技术飞速发展的今天,批量单词翻译工具通过计算机的数据处理能力,大大提高了语言学习和文字处理的效率。用户通过简单输入单词列表到一个文本文件,并运行翻译程序,即可获得翻译结果并保存至指定文件。该工具集成了内置或外部翻译引擎,利用自然语言处理技术实现快速准确的翻译,并可能提供词性识别等附加功能。尽管机器翻译无法完全取代人工校对,但它为用户提供了一种高效的翻译解

- LLM中 最后一个词语的表征(隐藏状态)通常会融合前面所有词语的信息吗?

ZhangJiQun&MXP

教学2024大模型以及算力2021AIpython机器学习算法深度学习人工智能

LLM中最后一个词语的表征(隐藏状态)通常会融合前面所有词语的信息吗?在大语言模型(LLM)中,最后一个词语的表征(隐藏状态)通常会融合前面所有词语的信息,这是由LLM的核心架构(以Transformer为基础)决定的,具体可以从以下角度理解:1.核心机制:自注意力(Self-Attention)的作用现代LLM(如GPT系列、Qwen等)均基于Transformer架构,其核心是自注意力机制。在

- 深度学习模型表征提取全解析

ZhangJiQun&MXP

教学2024大模型以及算力2021AIpython深度学习人工智能pythonembedding语言模型

模型内部进行表征提取的方法在自然语言处理(NLP)中,“表征(Representation)”指将文本(词、短语、句子、文档等)转化为计算机可理解的数值形式(如向量、矩阵),核心目标是捕捉语言的语义、语法、上下文依赖等信息。自然语言表征技术可按“静态/动态”“有无上下文”“是否融入知识”等维度划分一、传统静态表征(无上下文,词级为主)这类方法为每个词分配固定向量,不考虑其在具体语境中的含义(无法解

- Xcode 26 现已发布,并支持代码智能 它与基于 Cursor 和 AI Agent 的工作流程相比如何?

知识大胖

SwiftUI源码大全xcodemacoside

简介Xcode26昨天发布了!惊喜的是,它支持macOS15,但要使用新的ChatGPT助手,你需要macOS26Tahoe。所以我把我的M3MaxMacBookPro升级到了Tahoe。我不是说你应该升级,但我这么做是为了测试Xcode的新功能并与大家分享!值得注意的是,这是迄今为止最小的Xcode版本(下载大小)!正如Apple在Xcode新功能会话视频(我建议您观看)中所说的那样,这是一项巨

- AI MCP教程之 什么是 MCP?利用本地 LLM 、MCP、DeepSeek 集成构建您自己的 AI 驱动工具

知识大胖

NVIDIAGPU和大语言模型开发教程人工智能mcpdeepseek

介绍利用模型上下文协议(MCP)的工具吸引了我们的注意力—将AI变成触手可及的生产力引擎。它们巧妙、高效,让人难以抗拒。但如果您可以将这样的功能添加到自己的工具中,会怎么样呢?在本指南中,我将引导您构建一个具有本地运行的大型语言模型(LLM)和MCP集成的AI工具-让您以类似的方式自动执行利用MCP的工具您喜欢的任务。推荐文章《AnythingLLM教程系列之12AnythingLLM上的Olla

- 12 个强大的 DeepSeek AI 提示将彻底改变您的日常生活

知识大胖

NVIDIAGPU和大语言模型开发教程人工智能deepseek

内容写作的最佳提示让我们从写作开始吧。无论您是博主、学生还是社交媒体创作者,这些提示都将帮助您创作出精彩的内容。提示1:“扮演专业文案撰稿人,为[产品/服务]撰写引人注目的广告文案。文案应引人入胜、具有说服力,且字数不得超过100个字。”这使得ChatGPT的响应结构就像真实的广告文案一样。提示2:“以更具吸引力和说服力的方式重写此段落,同时保持含义不变:[插入文本]。”推荐文章《Neo4j上使用

- 24GB GPU 中的 DeepSeek R1:Unsloth AI 针对 671B 参数模型进行动态量化

知识大胖

NVIDIAGPU和大语言模型开发教程人工智能deepseekollama

简介最初的DeepSeekR1是一个拥有6710亿个参数的语言模型,UnslothAI团队对其进行了动态量化,将模型大小减少了80%(从720GB减少到131GB),同时保持了强大的性能。当添加模型卸载功能时,该模型可以在24GBVRAM下以低令牌/秒的推理速度运行。推荐文章《本地构建AI智能分析助手之01快速安装,使用PandasAI和Ollama进行数据分析,用自然语言向你公司的数据提问为决策

- 在 Obsidian 中本地使用 DeepSeek — 无需互联网!

知识大胖

NVIDIAGPU和大语言模型开发教程人工智能deepseek

简介您是否想在Obsidian内免费使用类似于ChatGPT的本地LLM?如果是,那么本指南适合您!我将引导您完成在Obsidian中安装和使用DeepSeek-R1模型的确切步骤,这样您就可以在笔记中拥有一个由AI驱动的第二大脑。推荐文章《24GBGPU中的DeepSeekR1:UnslothAI针对671B参数模型进行动态量化》权重1,DeepSeek类《在RaspberryPi上运行语音识别

- Llama-Omni会说话的人工智能“语音到语音LLM” 利用低延迟、高质量语音转语音 AI 彻底改变对话方式(教程含源码)

知识大胖

NVIDIAGPU和大语言模型开发教程llama人工智能nvidiallm

介绍“单靠技术是不够的——技术与文科、人文学科的结合,才能产生让我们心花怒放的成果。”——史蒂夫·乔布斯近年来,人机交互领域发生了重大变化,尤其是随着ChatGPT、GPT-4等大型语言模型(LLM)的出现。虽然这些模型主要基于文本,但人们对语音交互的兴趣日益浓厚,以使人机对话更加无缝和自然。然而,实现语音交互而不受语音转文本处理中常见的延迟和错误的影响仍然是一个挑战。关键字:Llama-Omni

- AnythingLLM教程系列之 09 AnythingLLM 支持自定义音频转录提供程序

知识大胖

NVIDIAGPU和大语言模型开发教程llama3anythingllmllm

什么是AnythingLLM?AnythingLLM是最易于使用的一体化AI应用程序,可以执行RAG、AI代理等操作,且无需任何代码或基础设施难题。您需要为您的企业或组织提供一款完全可定制、私有且一体化的AI应用程序,该应用程序基本上是一个具有许可的完整ChatGPT,但具有任何LLM、嵌入模型或矢量数据库。如何安装《无需任何代码构建自己的大模型知识库:AnythingLLM最易于使用的一体化AI

- AnythingLLM教程系列之 04 AnythingLLM 允许您以正确的格式导出聊天日志,以构建 GPT-3.5 和 OpenAI 上其他可用模型的微调模型(教程含安装步骤)

知识大胖

NVIDIAGPU和大语言模型开发教程llama3aianythinllmllama

什么是AnythingLLM?AnythingLLM是最易于使用的一体化AI应用程序,可以执行RAG、AI代理等操作,且无需任何代码或基础设施难题。您需要为您的企业或组织提供一款完全可定制、私有且一体化的AI应用程序,该应用程序基本上是一个具有许可的完整ChatGPT,但具有任何LLM、嵌入模型或矢量数据库。如何安装《无需任何代码构建自己的大模型知识库:AnythingLLM最易于使用的一体化AI

- 【AI大模型】LLM模型架构深度解析:BERT vs. GPT vs. T5

我爱一条柴ya

学习AI记录ai人工智能AI编程python

引言Transformer架构的诞生(Vaswanietal.,2017)彻底改变了自然语言处理(NLP)。在其基础上,BERT、GPT和T5分别代表了三种不同的模型范式,主导了预训练语言模型的演进。理解它们的差异是LLM开发和学习的基石。一、核心架构对比特性BERT(BidirectionalEncoder)GPT(GenerativePre-trainedTransformer)T5(Text

- [论文阅读]Distilling Step-by-Step! Outperforming Larger Language Models with Less Training Data and Smal

0x211

论文阅读语言模型人工智能自然语言处理

中文译名:逐步蒸馏!以较少的训练数据和较小的模型规模超越较大的语言模型发布链接:http://arxiv.org/abs/2305.02301AcceptedtoFindingsofACL2023阅读原因:近期任务需要用到蒸馏操作,了解相关知识核心思想:改变视角。原来的视角:把LLMs视为噪声标签的来源。现在的视角:把LLMs视为能够推理的代理。方法好在哪?需要的数据量少,得到的结果好。文章的方法

- GPT实操——利用GPT创建一个应用

狗木马

深度学习gpt-3gpt

功能描述信息查询:用户可以询问各种问题,如天气、新闻、股票等,机器人会返回相关信息。任务执行:用户可以要求机器人执行一些简单的任务,如设置提醒、发送邮件等。情感支持:机器人可以与用户进行情感交流,提供安慰和支持。个性化设置:用户可以自定义机器人的回复风格和偏好。技术栈前端:React.js后端:Node.js+Express数据库:MongoDB自然语言处理:OpenAIGPT-3API其他工具:

- 【实战AI】macbook M1 本地ollama运行deepseek

东方鲤鱼

chatAImacosaillamaAIGCchatgpt

由于deepseek官网或者Aapi调用会有网络延迟或不响应的情况,故在本地搭建部署;前提条件1.由于需要拉取开源镜像,受网络限制,部分资源在前提中会下载的更快!请自行;2.设备macbookM132G下载ollamaOllama是一款跨平台推理框架客户端(MacOS、Windows、Linux),专为无缝部署大型语言模型(LLM)(如Llama2、Mistral、Llava等)而设计。通过一键式

- ASM系列五 利用TreeApi 解析生成Class

lijingyao8206

ASM字节码动态生成ClassNodeTreeAPI

前面CoreApi的介绍部分基本涵盖了ASMCore包下面的主要API及功能,其中还有一部分关于MetaData的解析和生成就不再赘述。这篇开始介绍ASM另一部分主要的Api。TreeApi。这一部分源码是关联的asm-tree-5.0.4的版本。

在介绍前,先要知道一点, Tree工程的接口基本可以完

- 链表树——复合数据结构应用实例

bardo

数据结构树型结构表结构设计链表菜单排序

我们清楚:数据库设计中,表结构设计的好坏,直接影响程序的复杂度。所以,本文就无限级分类(目录)树与链表的复合在表设计中的应用进行探讨。当然,什么是树,什么是链表,这里不作介绍。有兴趣可以去看相关的教材。

需求简介:

经常遇到这样的需求,我们希望能将保存在数据库中的树结构能够按确定的顺序读出来。比如,多级菜单、组织结构、商品分类。更具体的,我们希望某个二级菜单在这一级别中就是第一个。虽然它是最后

- 为啥要用位运算代替取模呢

chenchao051

位运算哈希汇编

在hash中查找key的时候,经常会发现用&取代%,先看两段代码吧,

JDK6中的HashMap中的indexFor方法:

/**

* Returns index for hash code h.

*/

static int indexFor(int h, int length) {

- 最近的情况

麦田的设计者

生活感悟计划软考想

今天是2015年4月27号

整理一下最近的思绪以及要完成的任务

1、最近在驾校科目二练车,每周四天,练三周。其实做什么都要用心,追求合理的途径解决。为

- PHP去掉字符串中最后一个字符的方法

IT独行者

PHP字符串

今天在PHP项目开发中遇到一个需求,去掉字符串中的最后一个字符 原字符串1,2,3,4,5,6, 去掉最后一个字符",",最终结果为1,2,3,4,5,6 代码如下:

$str = "1,2,3,4,5,6,";

$newstr = substr($str,0,strlen($str)-1);

echo $newstr;

- hadoop在linux上单机安装过程

_wy_

linuxhadoop

1、安装JDK

jdk版本最好是1.6以上,可以使用执行命令java -version查看当前JAVA版本号,如果报命令不存在或版本比较低,则需要安装一个高版本的JDK,并在/etc/profile的文件末尾,根据本机JDK实际的安装位置加上以下几行:

export JAVA_HOME=/usr/java/jdk1.7.0_25

- JAVA进阶----分布式事务的一种简单处理方法

无量

多系统交互分布式事务

每个方法都是原子操作:

提供第三方服务的系统,要同时提供执行方法和对应的回滚方法

A系统调用B,C,D系统完成分布式事务

=========执行开始========

A.aa();

try {

B.bb();

} catch(Exception e) {

A.rollbackAa();

}

try {

C.cc();

} catch(Excep

- 安墨移动广 告:移动DSP厚积薄发 引领未来广 告业发展命脉

矮蛋蛋

hadoop互联网

“谁掌握了强大的DSP技术,谁将引领未来的广 告行业发展命脉。”2014年,移动广 告行业的热点非移动DSP莫属。各个圈子都在纷纷谈论,认为移动DSP是行业突破点,一时间许多移动广 告联盟风起云涌,竞相推出专属移动DSP产品。

到底什么是移动DSP呢?

DSP(Demand-SidePlatform),就是需求方平台,为解决广 告主投放的各种需求,真正实现人群定位的精准广

- myelipse设置

alafqq

IP

在一个项目的完整的生命周期中,其维护费用,往往是其开发费用的数倍。因此项目的可维护性、可复用性是衡量一个项目好坏的关键。而注释则是可维护性中必不可少的一环。

注释模板导入步骤

安装方法:

打开eclipse/myeclipse

选择 window-->Preferences-->JAVA-->Code-->Code

- java数组

百合不是茶

java数组

java数组的 声明 创建 初始化; java支持C语言

数组中的每个数都有唯一的一个下标

一维数组的定义 声明: int[] a = new int[3];声明数组中有三个数int[3]

int[] a 中有三个数,下标从0开始,可以同过for来遍历数组中的数

- javascript读取表单数据

bijian1013

JavaScript

利用javascript读取表单数据,可以利用以下三种方法获取:

1、通过表单ID属性:var a = document.getElementByIdx_x_x("id");

2、通过表单名称属性:var b = document.getElementsByName("name");

3、直接通过表单名字获取:var c = form.content.

- 探索JUnit4扩展:使用Theory

bijian1013

javaJUnitTheory

理论机制(Theory)

一.为什么要引用理论机制(Theory)

当今软件开发中,测试驱动开发(TDD — Test-driven development)越发流行。为什么 TDD 会如此流行呢?因为它确实拥有很多优点,它允许开发人员通过简单的例子来指定和表明他们代码的行为意图。

TDD 的优点:

&nb

- [Spring Data Mongo一]Spring Mongo Template操作MongoDB

bit1129

template

什么是Spring Data Mongo

Spring Data MongoDB项目对访问MongoDB的Java客户端API进行了封装,这种封装类似于Spring封装Hibernate和JDBC而提供的HibernateTemplate和JDBCTemplate,主要能力包括

1. 封装客户端跟MongoDB的链接管理

2. 文档-对象映射,通过注解:@Document(collectio

- 【Kafka八】Zookeeper上关于Kafka的配置信息

bit1129

zookeeper

问题:

1. Kafka的哪些信息记录在Zookeeper中 2. Consumer Group消费的每个Partition的Offset信息存放在什么位置

3. Topic的每个Partition存放在哪个Broker上的信息存放在哪里

4. Producer跟Zookeeper究竟有没有关系?没有关系!!!

//consumers、config、brokers、cont

- java OOM内存异常的四种类型及异常与解决方案

ronin47

java OOM 内存异常

OOM异常的四种类型:

一: StackOverflowError :通常因为递归函数引起(死递归,递归太深)。-Xss 128k 一般够用。

二: out Of memory: PermGen Space:通常是动态类大多,比如web 服务器自动更新部署时引起。-Xmx

- java-实现链表反转-递归和非递归实现

bylijinnan

java

20120422更新:

对链表中部分节点进行反转操作,这些节点相隔k个:

0->1->2->3->4->5->6->7->8->9

k=2

8->1->6->3->4->5->2->7->0->9

注意1 3 5 7 9 位置是不变的。

解法:

将链表拆成两部分:

a.0-&

- Netty源码学习-DelimiterBasedFrameDecoder

bylijinnan

javanetty

看DelimiterBasedFrameDecoder的API,有举例:

接收到的ChannelBuffer如下:

+--------------+

| ABC\nDEF\r\n |

+--------------+

经过DelimiterBasedFrameDecoder(Delimiters.lineDelimiter())之后,得到:

+-----+----

- linux的一些命令 -查看cc攻击-网口ip统计等

hotsunshine

linux

Linux判断CC攻击命令详解

2011年12月23日 ⁄ 安全 ⁄ 暂无评论

查看所有80端口的连接数

netstat -nat|grep -i '80'|wc -l

对连接的IP按连接数量进行排序

netstat -ntu | awk '{print $5}' | cut -d: -f1 | sort | uniq -c | sort -n

查看TCP连接状态

n

- Spring获取SessionFactory

ctrain

sessionFactory

String sql = "select sysdate from dual";

WebApplicationContext wac = ContextLoader.getCurrentWebApplicationContext();

String[] names = wac.getBeanDefinitionNames();

for(int i=0; i&

- Hive几种导出数据方式

daizj

hive数据导出

Hive几种导出数据方式

1.拷贝文件

如果数据文件恰好是用户需要的格式,那么只需要拷贝文件或文件夹就可以。

hadoop fs –cp source_path target_path

2.导出到本地文件系统

--不能使用insert into local directory来导出数据,会报错

--只能使用

- 编程之美

dcj3sjt126com

编程PHP重构

我个人的 PHP 编程经验中,递归调用常常与静态变量使用。静态变量的含义可以参考 PHP 手册。希望下面的代码,会更有利于对递归以及静态变量的理解

header("Content-type: text/plain");

function static_function () {

static $i = 0;

if ($i++ < 1

- Android保存用户名和密码

dcj3sjt126com

android

转自:http://www.2cto.com/kf/201401/272336.html

我们不管在开发一个项目或者使用别人的项目,都有用户登录功能,为了让用户的体验效果更好,我们通常会做一个功能,叫做保存用户,这样做的目地就是为了让用户下一次再使用该程序不会重新输入用户名和密码,这里我使用3种方式来存储用户名和密码

1、通过普通 的txt文本存储

2、通过properties属性文件进行存

- Oracle 复习笔记之同义词

eksliang

Oracle 同义词Oracle synonym

转载请出自出处:http://eksliang.iteye.com/blog/2098861

1.什么是同义词

同义词是现有模式对象的一个别名。

概念性的东西,什么是模式呢?创建一个用户,就相应的创建了 一个模式。模式是指数据库对象,是对用户所创建的数据对象的总称。模式对象包括表、视图、索引、同义词、序列、过

- Ajax案例

gongmeitao

Ajaxjsp

数据库采用Sql Server2005

项目名称为:Ajax_Demo

1.com.demo.conn包

package com.demo.conn;

import java.sql.Connection;import java.sql.DriverManager;import java.sql.SQLException;

//获取数据库连接的类public class DBConnec

- ASP.NET中Request.RawUrl、Request.Url的区别

hvt

.netWebC#asp.nethovertree

如果访问的地址是:http://h.keleyi.com/guestbook/addmessage.aspx?key=hovertree%3C&n=myslider#zonemenu那么Request.Url.ToString() 的值是:http://h.keleyi.com/guestbook/addmessage.aspx?key=hovertree<&

- SVG 教程 (七)SVG 实例,SVG 参考手册

天梯梦

svg

SVG 实例 在线实例

下面的例子是把SVG代码直接嵌入到HTML代码中。

谷歌Chrome,火狐,Internet Explorer9,和Safari都支持。

注意:下面的例子将不会在Opera运行,即使Opera支持SVG - 它也不支持SVG在HTML代码中直接使用。 SVG 实例

SVG基本形状

一个圆

矩形

不透明矩形

一个矩形不透明2

一个带圆角矩

- 事务管理

luyulong

javaspring编程事务

事物管理

spring事物的好处

为不同的事物API提供了一致的编程模型

支持声明式事务管理

提供比大多数事务API更简单更易于使用的编程式事务管理API

整合spring的各种数据访问抽象

TransactionDefinition

定义了事务策略

int getIsolationLevel()得到当前事务的隔离级别

READ_COMMITTED

- 基础数据结构和算法十一:Red-black binary search tree

sunwinner

AlgorithmRed-black

The insertion algorithm for 2-3 trees just described is not difficult to understand; now, we will see that it is also not difficult to implement. We will consider a simple representation known

- centos同步时间

stunizhengjia

linux集群同步时间

做了集群,时间的同步就显得非常必要了。 以下是查到的如何做时间同步。 在CentOS 5不再区分客户端和服务器,只要配置了NTP,它就会提供NTP服务。 1)确认已经ntp程序包: # yum install ntp 2)配置时间源(默认就行,不需要修改) # vi /etc/ntp.conf server pool.ntp.o

- ITeye 9月技术图书有奖试读获奖名单公布

ITeye管理员

ITeye

ITeye携手博文视点举办的9月技术图书有奖试读活动已圆满结束,非常感谢广大用户对本次活动的关注与参与。 9月试读活动回顾:http://webmaster.iteye.com/blog/2118112本次技术图书试读活动的优秀奖获奖名单及相应作品如下(优秀文章有很多,但名额有限,没获奖并不代表不优秀):

《NFC:Arduino、Andro