【附资源】LLM大模型学习,这本书不可或缺:《大语言模型 基础与前沿》

哈喽大家好!很久都没有更新大模型这块的书了,今天给大家说一下这本:《大语言模型:基础与前沿》,本书深入阐述了大语言模型的基本概念和算法、研究前沿以及应用,涵盖大语言模型的广泛主题,从基础到前沿,从方法到应用,涉及从方法论到应用场景方方面面的内容。

作者简介

熊涛,美国明尼苏达大学双城分校电子与计算机工程博士。曾在多家中美知名高科技公司担任高级管理职位和首席科学家,在人工智能的多个领域,包括大语言模型、图神经网络等从事研发和管理工作多年。

适宜人群

本书内容全面、系统性强,适合高年级本科生和研究生、博士后研究人员、讲师以及行业从业者阅读与参考。

书评

这本书是这个领域截至目前比较全的文献综述,给出了从大语言模型的基本原理,到训练大语言模型的分词,大语言模型的调优,到大语言模型的微调,大语言模型的上下文ICL提示词工程,大语言模型重点应用的增强检索,大语言模型的对齐,减毒,并行计算硬件架构,甚至能源和碳轨迹领域的前沿关键研究论文,基本算法的优劣,价值和演进方向都给出了简评,将近30页的参考文献,可见作者是下了功夫的。

我现在讲的这些还是很有限,如果你对大模型感兴趣,那建议你把这本书看完并吃透它,这本书的pdf版本我已经帮你打包好了

朋友们如果有需要的话,可以V扫描下方二维码联系领取~

![]()

书籍目录:

第 1章 大语言模型:辩论、争议与未来发展方向 1

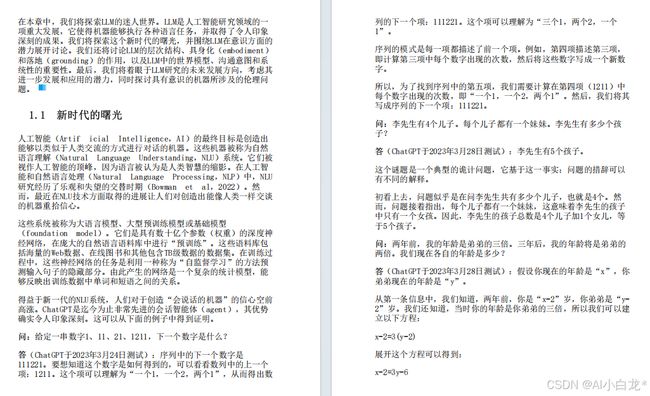

1.1 新时代的曙光 1

1.2 LLM有意识吗 3

1.3 未来发展方向 10

1.4 小结 13

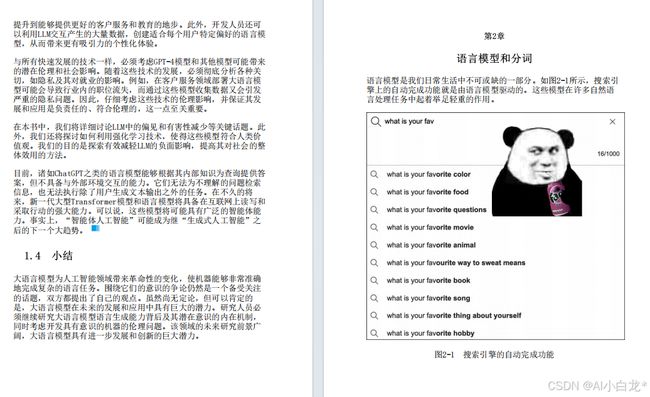

第 2章 语言模型和分词 15

2.1 语言建模的挑战 16

2.2 统计语言建模 16

2.3 神经语言模型 18

2.4 评估语言模型 19

2.5 分词 19

2.6 小结 27

第3章 Transformer 29

3.1 Transformer编码器模块 29

3.2 编码器-解码器架构 31

3.3 位置嵌入 32

3.4 更长的上下文 38

3.5 外部记忆 42

3.6 更快、更小的Transformer 45

3.7 推理优化 49

3.8 小结 56

第4章 预训练目标和解码策略 57

4.1 模型架构 57

4.2 预训练目标 60

4.3 具有代表性的语言模型 62

4.4 解码策略 67

4.5 小结 72

第5章 上下文学习和轻量级微调 73

5.1 上下文学习 74

5.2 提示语言模型的校准 94

5.3 轻量级微调 97

5.4 小结 104

第6章 训练更大的模型 107

6.1 扩大尺度法则 107

6.2 涌现能力 113

6.3 人工智能加速器 115

6.4 并行 117

6.5 混合训练和低精度训练 133

6.6 其他节省内存的设计 136

6.7 小结 137

第7章 稀疏专家模型 139

7.1 为什么采用稀疏专家模型 139

7.2 路由算法 142

7.3 其他改进措施 152

7.4 小结 156

第8章 检索增强型语言模型 157

8.1 预训练检索增强型语言模型 158

8.2 词元级检索 161

8.3 通过高效和精简检索进行问答和多跳推理 163

8.4 检索增强型Transformer 166

8.5 检索增强型黑盒语言模型 168

8.6 视觉增强语言建模 169

8.7 小结 170

第9章 对齐语言模型与人类偏好 171

9.1 基于人类反馈进行微调 172

9.2 基于语言反馈进行微调 183

9.3 基于监督学习进行微调 184

9.4 基于人工智能反馈的强化学习 185

9.5 基于自我反馈进行迭代优化 188

9.6 基于人类偏好进行预训练 190

9.7 小结 193

第 10章 减少偏见和有害性 195

10.1 偏见 196

10.2 有害性 199

10.3 偏见和有害性的检测与减少 200

10.4 小结 206

第 11章 视觉语言模型 207

11.1 语言处理的多模态落地 207

11.2 不需要额外训练即可利用预训练模型 208

11.3 轻量级适配 213

11.4 图文联合训练 219

11.5 检索增强视觉语言模型 222

11.6 视觉指令调整 225

11.7 小结 227

第 12章 环境影响 229

12.1 能源消耗和温室气体排放 229

12.2 估算训练模型的排放量 230

12.3 小结 231

参考文献 232

书籍内容

无论如何,如果准备all in 大模型,这本书是必看,除了掌握扎实的基础,我觉得这本书重点告诉了我们对待未知领域如何报以科学的态度去学习和认知,而不能总像外行一样看热闹,而看门道的内行,必须以科学的态度,大语言模型,这本书可以作为看门道的指南。

朋友们如果有需要的话,可以V扫描下方二维码联系领取~

![]()