- 怎么样查看Linux的GPIO子系统中已经被占用的GPIO口的状态?

昊虹AI笔记

嵌入式_LinuxGPIO子系统

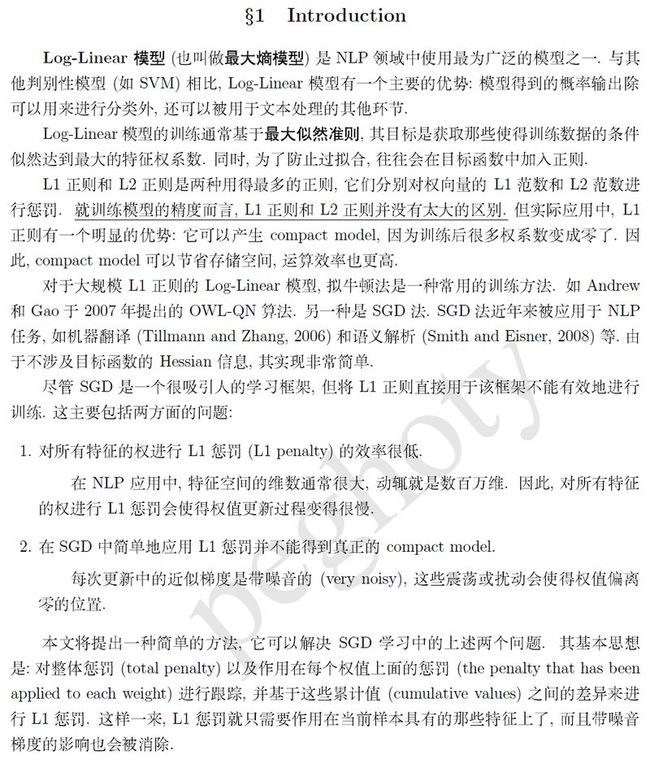

可以用下面的命令查看Linux的GPIO子系统中已经被占用的GPIO口的状态:cat/sys/kernel/debug/gpio关于上面截图中GPIO的编号意义,请参考我的另一篇博文https://blog.csdn.net/wenhao_ir/article/details/145444452【搜索“gpiochip0对应于IMX6ULL的GPIO1”】

- Linux的内核配置界面的使用示例累积

昊虹AI笔记

嵌入式_LinuxKernel

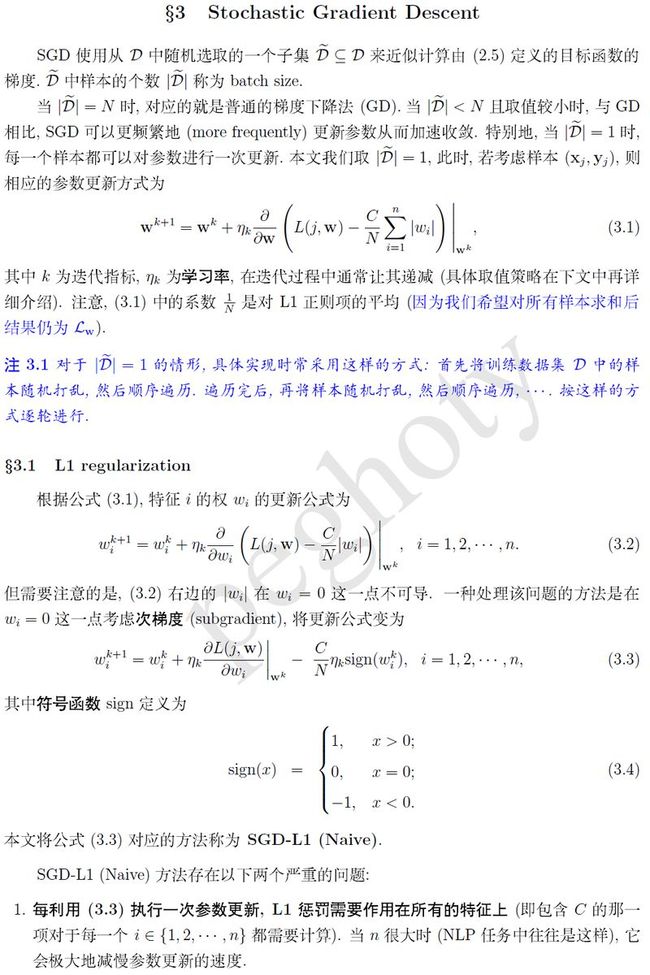

第1个https://blog.csdn.net/wenhao_ir/article/details/145822475【搜索“触摸屏驱动移植适配”、“配置内核,使蓝牙驱动变成ko模块”、“某些项配置为M状态”】第2个https://blog.csdn.net/wenhao_ir/article/details/146455604【搜索“配置并编译内核模块”】

- Linux的I2C总线的原理和结构详解

昊虹AI笔记

嵌入式_LinuxLinux系统linux

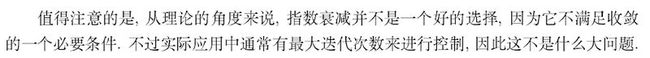

Linux的I2C总线的原理和结构讲解我前面基本已经吃透了Platform总线,关于Platform总线的原理和结构,详情见下面三篇博文:https://blog.csdn.net/wenhao_ir/article/details/145023181https://blog.csdn.net/wenhao_ir/article/details/145018442https://blog.csdn

- java会被rust替代吗_后端程序员一定要看的语言大比拼:Java vs. Go vs. Rust

杜晓斑

java会被rust替代吗

本文转载自https://blog.csdn.net/chen801090/article/details/105865467/这里只呈现最终比拼结果三种语言的比较在得出任何结论之前,我想指出这三种语言之间的关系。Java和Go都是支持垃圾回收的语言,但是Java会提前编译为在JVM上运行的字节码。启动Java应用程序时,JIT编译器会被调用以通过将字节码编译为本地代码来优化字节码,以提高应用程序

- PCB设计中专业英译术语之设计讲解--一牛网

szx940213

PCBPCBPCB设计

PCB设计中专业英译术语之设计分析:1.原理图:shematicdiagram2.逻辑图:logicdiagram3.印制线路布设:printedwirelayout4.布设总图:masterdrawing5.可制造性设计:design-for-manufacturability6.计算机辅助设计:computer-aideddesign.(CAD)7.计算机辅助制造:computer-aided

- phpstudy用composer安装thinkphp5.1

dnpao

thinkphp5.1linuxphp

参考文章https://www.cnblogs.com/finalanddistance/p/8932042.html下载composer.phar下载地址:https://getcomposer.org/download/我是下载最新的路径phpstudy所使用是php7.2本地路径是D:\ProgramFiles\phpStudy\PHPTutorial\php\php-7.2.1-nts\p

- Linux Shell脚本自动化编程实战【1.4 shell特性 Login Nologin】

wallacegen

linux自动化运维

loginshellsu-alice/etc/profile/etc/bashrc~/.bash_profile~/.bashrcnologinshellsualice/etc/bashrc~/.bashrcshell是用户执行的第一个程序1.!!#再次执行上一条命令2.!$代表了上一条命令的最后一个参数3.!2044#2044是执行history的第n条命令4.alias查看当前shell的别名

- PyTorch->ONNX->TensorRT,TensorRT官方插件使用demo

pytorchtensorrt

课程说明课程目标:讲解PyTorch->ONNX->TensorRT,模型导出时,TensorRT官方插件如何使用。软件版本说明:TensorRT:8.6.1.6Python:3.8下面练习用到的输入数据与输出数据:链接:https://pan.baidu.com/s/14NQaxeTIXRi9YAbdSWNNtQ?pwd=y0jm提取码:y0jm导出原理[1]https://blog.csdn.

- mybatis如何打印出完整sql语句

大猫子的技术日记

mybatissql数据库

分两步:1.在application.properties配置中添加配置项:mybatis-plus.configuration.log-impl=org.apache.ibatis.logging.stdout.StdOutImpllogging.level.mapper文件的包路径=DEBUG(示例:logging.level.com.test.biztest.service.dal=DEBU

- Android系统编译

niepengpeng333

android系统编译androidmakefileshellcommandbuildinclude

摘自:http://blog.csdn.net/chen_chun_guang/article/details/6078314Android编译系统分析之返璞归真自Android开源以来,引起了嵌入式行业一股热潮,很多嵌入式开发者表示对Android有很强的兴趣,并下载Android源码进行编译和移植。Android源码的巨大(repo下来,大概2G)给人以Android相当复杂的错觉。本文从An

- vue路由中的next()

奔跑的蜗牛2004

JavaScript前端Vuevue.js前端javascript

在路由守卫中有三个参数;beforeEach((to,from,next)=>{to//要去的路由from//当前路由next()//放行的意思}其实在路由守卫中,只有next()是放行,其他的诸如:next('/logon')、next(to)或者next({...to,replace:true})都不是放行,而是:中断当前导航,执行新的导航在这里就要说到next有参数和无参数的区别了next(

- 如何直观理解交叉熵及其优势?

Zebul博

以下对数符号有误,见原文链接:https://blog.csdn.net/cherrylvlei/article/details/53038603导语在统计学中,损失函数是一种衡量系统错误程度的函数。而在有监督学习模型里,损失函数则是衡量模型对样本预测值与样本真实标签之间差异程度的方法。最近用到了交叉熵,觉得有必要弄明白交叉熵到底是什么原理及优势,因此查了查资料,并结合个人理解在这里做一下讲解,如

- 动态规划——编辑距离

皮蛋瘦肉没有肉

经典算法动态规划算法

参考博客:https://blog.csdn.net/ghsau/article/details/78903076题目编辑距离又称Leveinshtein距离,是由俄罗斯科学家VladimirLevenshtein在1965年提出。编辑距离是计算两个文本相似度的算法之一,以字符串为例,字符串a和字符串b的编辑距离是将a转换成b的最小操作次数,这里的操作包括三种:插入一个字符删除一个字符替换一个字符

- vue中this指针获取不到函数或数据

vener__

JavaScriptvue.js前端javascript

在进行luckysheet钩子函数配置的时候,使用以下代码无法获取对应的data和methodthis.options.hook={workbookCreateAfter:function(){console.log(this.gridkey);this.auto();},}使用箭头函数即可解决,箭头函数本身没有自己的this,它会继承定义时所在的外层作用域的this指向。这样就能保证this指向

- #VCS# 关于 +incdir+xxx 编译选项的注意点

那么菜

VCS杂记VCS

前段时间,工作中遇到百思不得其解的坑。按照以往的理解,没有找到任何可能问题点。今天总结下来。学习目标:+incdir+是VCS编译器中用于指定包含文件(includefiles)搜索路径的重要选项,主要用于指定`include指令的搜索目录。一基本功能作用:添加Verilog/SystemVerilog`include文件的搜索路径语法:+incdir+特点:可以指定多个路径,路径之间用+分隔二使

- FPGA学习记录 第一天

Hanying_5

fpga开发vscode

为了锐捷网络杯B组赛题,进行FPGA的学习,并最终完成基于FPGA的温控风扇的实现。第一天首先是vscode中verilog开发环境的搭建:环境配置下载:https://pan.baidu.com/s/14GYb4Cm1revUFfAR3OHdPw提取码:3ler搭建开发环境参考b站教程(BV1S541147GB)然后进行FPGA开发的学习参考b站野火_firege的教程(BV17z411i7er

- 在IDEA中快速注释所有console.log

weixin_42220130

IDEAintellij-ideajavaideconsole

在IDEA中快速注释所有console.log在前端IDEA中,快速注释所有console.log语句可以通过以下步骤实现2:打开要修改的文件。使用快捷键Ctrl+F打开搜索框。点击打开使用正则搜索的开关或者通过Alt+R快捷键来打开。在搜索框输入[]*console.log[]*,就能够搜索到所有带有console.log的行了,直接替换为空格或者替换为Replace就可以实现一次性将整个文件中

- Python练习之抽奖界面

三生暮雨渡瀟瀟

Pythonpython开发语言

前言一、代码整体架构分析1、数据层(Model)2、控制层(Controller)3、视图层(View)二、核心功能实现详解1、文件导入功能1.1、实现逻辑1.2、代码涉及知识点讲解1.2.1、wildcard1.2.2、wx.FileDialog1.2.3、dlg.ShowModal()2、抽奖动画控制1.1、实现逻辑1.2、代码涉及知识点讲解1.3、关键技术点详解1.4、代码示例场景1.5、关

- Celery 报错 Windows11 :ValueError: not enough values to unpack (expected 3, got 0)

云浮万里_1

pythondjangocondawindowspycharm

解决方案:1.安装eventletpipinstalleventleteventlet是一种基于协程的并发库,适合I/O密集型任务(如网络请求、数据库操作等)。使用eventlet可以提高并发性能,尤其是在处理大量I/O操作时。2.打开Celery的命令行启动celerycelery-A项目名worker--loglevel=info-Peventlet当运行tasks.py时命令行不打印logg

- Django自带的Admin后台中如何获取当前登录用户

qr9j42233

djangosqlite数据库

在Django的Admin后台中,可以通过request.user来获取当前登录的用户对象。下面是获取当前登录用户的方法:在你的Admin后台的自定义视图或方法中,首先导入fromdjango.contrib.auth.decoratorsimportlogin_required和fromdjango.contrib.admin.views.decoratorsimportstaff_member

- 霸王茶姬小程序(2025年1月版)任务脚本

点云-激光雷达-Slam-三维牙齿

其他小程序

脚本用于自动执行微信小程序霸王茶姬的日常签到和积分管理任务。脚本概述脚本设置了定时任务(cron),每天运行两次,主要用于自动签到以获取积分,积分可以用来换取优惠券。核心方法constructor:构造函数,用于初始化网络请求的配置,设置了基础的HTTP请求头等。login:登录方法,通过发送用户的Token验证身份。signIn:签到方法,执行签到操作,并可能返回签到结果,如成功或失败的信息。g

- C#TCP通讯封装服务器工具类

风,停下

C#网络协议c#tcp/ip服务器

C#TCP通讯封装服务器工具类1使用说明2封装1使用说明添加接受数据回调函数事件方式1:通过有参构造函数添加方式2:调用:publicEventHandlerAddEventToDataReceived添加输出日志回调函数事件方式1:通过有参构造函数添加方式2:调用:publicActionAddEventToOutLog监听客户端发送数据线程和向其他客户端转发消息的数据如何输出日志信息方式:设置

- 正则表达式-万能表达式

活跃家族

正则表达式

1、正则正则表达式是一组由字母和符号组成的特殊文本,它可以用来从文本中找出满足你想要的格式的句子.{“basketId”:0,“count”:1,“prodId”:#prodId#,“shopId”:1,“skuId”:#skuId#}===#prodId#re相关的文章:https://www.cnblogs.com/Simple-Small/p/9150947.htmlregular表达式学习

- QuantaLogic + DeepSeek,一分钟优化你的工作流!

大模型教程.

langchain架构产品经理人工智能算法大模型deepseek

作为一个程序员,我必须承认,看到QuantaLogic+DeepSeek这个组合,我的第一反应是:又来了!又一个AI工具!毕竟,现在的AI工具就像是npm包,动不动就冒出一个新框架,让人一边抱怨“怎么又要学新东西”,一边忍不住去试试。那今天,我们就一起研究一下,如何用QuantaLogic玩转DeepSeek,看看它到底是不是“智商税”!QuantaLogic是个啥?QuantaLogic,听起来

- 【MySQL】mysql日志文件

2302_79952574

mysql数据库

目录日志文件特征错误日志(Errorlog)常规查询日志(Generalquerylog)慢速查询日志(Slowquerylog)审计日志(Auditlog)二进制日志(Binarylog)日志文件轮转MySQL使用多种类型的日志来记录有关服务器活动的信息。日志文件特征可能会占用大量磁盘空间;可以存储在文件中;可以存储在表中(仅限常规查询和慢速查询日志);以文本格式书写(二进制日志除外)。错误日志

- node-ddk,electron,文件目录选择对话框,dialog

eli960

electronjavascript前端

node-ddk,electron,文件目录选择对话框,dialoghttps://blog.csdn.net/eli960/article/details/146207062也可以下载demo直接演示http://linuxmail.cn/go#node-ddk渲染进程操作importrenderer,{NODEDDK}from"node-ddk/renderer"选择一个文件(不指定类型)le

- 【从零实现Json-Rpc框架】- 项目实现 - 零碎功能接口篇

JhonKI

jsonrpc网络协议

博客主页:https://blog.csdn.net/2301_779549673博客仓库:https://gitee.com/JohnKingW/linux_test/tree/master/lesson欢迎点赞收藏⭐留言如有错误敬请指正!本文由JohnKi原创,首发于CSDN未来很长,值得我们全力奔赴更美好的生活✨文章目录前言️一、简单日志宏实现1.1意义:快速定位程序运行逻辑出错的位置。1

- 【C++】set详解

JhonKI

c++开发语言

博客主页:https://blog.csdn.net/2301_779549673欢迎点赞收藏⭐留言如有错误敬请指正!本文由JohnKi原创,首发于CSDN未来很长,值得我们全力奔赴更美好的生活✨文章目录前言️一、set类的介绍️二、set的构造和迭代器️三、set的增删查️四、insert和迭代器遍历使用样例总结前言Set是C++标准模板库(STL)中的一种关联容器,主要用于存储不重复且

- 个人文章管理备忘

rock_joker

其它linuxudptcp/ip

个人备忘个人文章管理备忘网络TCP/IPTCP协议疑难杂症全景解析UDP协议疑难杂症全景解析TCP的快速重传机制TCP-IP详解:超时重传机制[为什么TCP协议有TIME_WAIT状态](https://draveness.me/whys-the-design-tcp-time-wait/)[TCP/IP序列号回绕](https://blog.csdn.net/xiaoting451292510/

- 机器学习都有哪些算法?

不加冰的红茶要热的

机器学习算法人工智能

机器学习有很多种算法,通常可以根据任务类型(监督学习、无监督学习、强化学习)以及算法的特性进行分类。以下是一些常见的机器学习算法:1.监督学习算法(SupervisedLearning)监督学习是指模型在已标注的数据集上进行训练,目标是学习输入与输出之间的映射关系。常见算法:线性回归(LinearRegression):用于回归任务,预测连续值。逻辑回归(LogisticRegression):用

- Hadoop(一)

朱辉辉33

hadooplinux

今天在诺基亚第一天开始培训大数据,因为之前没接触过Linux,所以这次一起学了,任务量还是蛮大的。

首先下载安装了Xshell软件,然后公司给了账号密码连接上了河南郑州那边的服务器,接下来开始按照给的资料学习,全英文的,头也不讲解,说锻炼我们的学习能力,然后就开始跌跌撞撞的自学。这里写部分已经运行成功的代码吧.

在hdfs下,运行hadoop fs -mkdir /u

- maven An error occurred while filtering resources

blackproof

maven报错

转:http://stackoverflow.com/questions/18145774/eclipse-an-error-occurred-while-filtering-resources

maven报错:

maven An error occurred while filtering resources

Maven -> Update Proje

- jdk常用故障排查命令

daysinsun

jvm

linux下常见定位命令:

1、jps 输出Java进程

-q 只输出进程ID的名称,省略主类的名称;

-m 输出进程启动时传递给main函数的参数;

&nb

- java 位移运算与乘法运算

周凡杨

java位移运算乘法

对于 JAVA 编程中,适当的采用位移运算,会减少代码的运行时间,提高项目的运行效率。这个可以从一道面试题说起:

问题:

用最有效率的方法算出2 乘以8 等於几?”

答案:2 << 3

由此就引发了我的思考,为什么位移运算会比乘法运算更快呢?其实简单的想想,计算机的内存是用由 0 和 1 组成的二

- java中的枚举(enmu)

g21121

java

从jdk1.5开始,java增加了enum(枚举)这个类型,但是大家在平时运用中还是比较少用到枚举的,而且很多人和我一样对枚举一知半解,下面就跟大家一起学习下enmu枚举。先看一个最简单的枚举类型,一个返回类型的枚举:

public enum ResultType {

/**

* 成功

*/

SUCCESS,

/**

* 失败

*/

FAIL,

- MQ初级学习

510888780

activemq

1.下载ActiveMQ

去官方网站下载:http://activemq.apache.org/

2.运行ActiveMQ

解压缩apache-activemq-5.9.0-bin.zip到C盘,然后双击apache-activemq-5.9.0-\bin\activemq-admin.bat运行ActiveMQ程序。

启动ActiveMQ以后,登陆:http://localhos

- Spring_Transactional_Propagation

布衣凌宇

springtransactional

//事务传播属性

@Transactional(propagation=Propagation.REQUIRED)//如果有事务,那么加入事务,没有的话新创建一个

@Transactional(propagation=Propagation.NOT_SUPPORTED)//这个方法不开启事务

@Transactional(propagation=Propagation.REQUIREDS_N

- 我的spring学习笔记12-idref与ref的区别

aijuans

spring

idref用来将容器内其他bean的id传给<constructor-arg>/<property>元素,同时提供错误验证功能。例如:

<bean id ="theTargetBean" class="..." />

<bean id ="theClientBean" class=&quo

- Jqplot之折线图

antlove

jsjqueryWebtimeseriesjqplot

timeseriesChart.html

<script type="text/javascript" src="jslib/jquery.min.js"></script>

<script type="text/javascript" src="jslib/excanvas.min.js&

- JDBC中事务处理应用

百合不是茶

javaJDBC编程事务控制语句

解释事务的概念; 事务控制是sql语句中的核心之一;事务控制的作用就是保证数据的正常执行与异常之后可以恢复

事务常用命令:

Commit提交

- [转]ConcurrentHashMap Collections.synchronizedMap和Hashtable讨论

bijian1013

java多线程线程安全HashMap

在Java类库中出现的第一个关联的集合类是Hashtable,它是JDK1.0的一部分。 Hashtable提供了一种易于使用的、线程安全的、关联的map功能,这当然也是方便的。然而,线程安全性是凭代价换来的――Hashtable的所有方法都是同步的。此时,无竞争的同步会导致可观的性能代价。Hashtable的后继者HashMap是作为JDK1.2中的集合框架的一部分出现的,它通过提供一个不同步的

- ng-if与ng-show、ng-hide指令的区别和注意事项

bijian1013

JavaScriptAngularJS

angularJS中的ng-show、ng-hide、ng-if指令都可以用来控制dom元素的显示或隐藏。ng-show和ng-hide根据所给表达式的值来显示或隐藏HTML元素。当赋值给ng-show指令的值为false时元素会被隐藏,值为true时元素会显示。ng-hide功能类似,使用方式相反。元素的显示或

- 【持久化框架MyBatis3七】MyBatis3定义typeHandler

bit1129

TypeHandler

什么是typeHandler?

typeHandler用于将某个类型的数据映射到表的某一列上,以完成MyBatis列跟某个属性的映射

内置typeHandler

MyBatis内置了很多typeHandler,这写typeHandler通过org.apache.ibatis.type.TypeHandlerRegistry进行注册,比如对于日期型数据的typeHandler,

- 上传下载文件rz,sz命令

bitcarter

linux命令rz

刚开始使用rz上传和sz下载命令:

因为我们是通过secureCRT终端工具进行使用的所以会有上传下载这样的需求:

我遇到的问题:

sz下载A文件10M左右,没有问题

但是将这个文件A再传到另一天服务器上时就出现传不上去,甚至出现乱码,死掉现象,具体问题

解决方法:

上传命令改为;rz -ybe

下载命令改为:sz -be filename

如果还是有问题:

那就是文

- 通过ngx-lua来统计nginx上的虚拟主机性能数据

ronin47

ngx-lua 统计 解禁ip

介绍

以前我们为nginx做统计,都是通过对日志的分析来完成.比较麻烦,现在基于ngx_lua插件,开发了实时统计站点状态的脚本,解放生产力.项目主页: https://github.com/skyeydemon/ngx-lua-stats 功能

支持分不同虚拟主机统计, 同一个虚拟主机下可以分不同的location统计.

可以统计与query-times request-time

- java-68-把数组排成最小的数。一个正整数数组,将它们连接起来排成一个数,输出能排出的所有数字中最小的。例如输入数组{32, 321},则输出32132

bylijinnan

java

import java.util.Arrays;

import java.util.Comparator;

public class MinNumFromIntArray {

/**

* Q68输入一个正整数数组,将它们连接起来排成一个数,输出能排出的所有数字中最小的一个。

* 例如输入数组{32, 321},则输出这两个能排成的最小数字32132。请给出解决问题

- Oracle基本操作

ccii

Oracle SQL总结Oracle SQL语法Oracle基本操作Oracle SQL

一、表操作

1. 常用数据类型

NUMBER(p,s):可变长度的数字。p表示整数加小数的最大位数,s为最大小数位数。支持最大精度为38位

NVARCHAR2(size):变长字符串,最大长度为4000字节(以字符数为单位)

VARCHAR2(size):变长字符串,最大长度为4000字节(以字节数为单位)

CHAR(size):定长字符串,最大长度为2000字节,最小为1字节,默认

- [强人工智能]实现强人工智能的路线图

comsci

人工智能

1:创建一个用于记录拓扑网络连接的矩阵数据表

2:自动构造或者人工复制一个包含10万个连接(1000*1000)的流程图

3:将这个流程图导入到矩阵数据表中

4:在矩阵的每个有意义的节点中嵌入一段简单的

- 给Tomcat,Apache配置gzip压缩(HTTP压缩)功能

cwqcwqmax9

apache

背景:

HTTP 压缩可以大大提高浏览网站的速度,它的原理是,在客户端请求网页后,从服务器端将网页文件压缩,再下载到客户端,由客户端的浏览器负责解压缩并浏览。相对于普通的浏览过程HTML ,CSS,Javascript , Text ,它可以节省40%左右的流量。更为重要的是,它可以对动态生成的,包括CGI、PHP , JSP , ASP , Servlet,SHTML等输出的网页也能进行压缩,

- SpringMVC and Struts2

dashuaifu

struts2springMVC

SpringMVC VS Struts2

1:

spring3开发效率高于struts

2:

spring3 mvc可以认为已经100%零配置

3:

struts2是类级别的拦截, 一个类对应一个request上下文,

springmvc是方法级别的拦截,一个方法对应一个request上下文,而方法同时又跟一个url对应

所以说从架构本身上 spring3 mvc就容易实现r

- windows常用命令行命令

dcj3sjt126com

windowscmdcommand

在windows系统中,点击开始-运行,可以直接输入命令行,快速打开一些原本需要多次点击图标才能打开的界面,如常用的输入cmd打开dos命令行,输入taskmgr打开任务管理器。此处列出了网上搜集到的一些常用命令。winver 检查windows版本 wmimgmt.msc 打开windows管理体系结构(wmi) wupdmgr windows更新程序 wscrip

- 再看知名应用背后的第三方开源项目

dcj3sjt126com

ios

知名应用程序的设计和技术一直都是开发者需要学习的,同样这些应用所使用的开源框架也是不可忽视的一部分。此前《

iOS第三方开源库的吐槽和备忘》中作者ibireme列举了国内多款知名应用所使用的开源框架,并对其中一些框架进行了分析,同样国外开发者

@iOSCowboy也在博客中给我们列出了国外多款知名应用使用的开源框架。另外txx's blog中详细介绍了

Facebook Paper使用的第三

- Objective-c单例模式的正确写法

jsntghf

单例iosiPhone

一般情况下,可能我们写的单例模式是这样的:

#import <Foundation/Foundation.h>

@interface Downloader : NSObject

+ (instancetype)sharedDownloader;

@end

#import "Downloader.h"

@implementation

- jquery easyui datagrid 加载成功,选中某一行

hae

jqueryeasyuidatagrid数据加载

1.首先你需要设置datagrid的onLoadSuccess

$(

'#dg'

).datagrid({onLoadSuccess :

function

(data){

$(

'#dg'

).datagrid(

'selectRow'

,3);

}});

2.onL

- jQuery用户数字打分评价效果

ini

JavaScripthtmljqueryWebcss

效果体验:http://hovertree.com/texiao/jquery/5.htmHTML文件代码:

<!DOCTYPE html>

<html xmlns="http://www.w3.org/1999/xhtml">

<head>

<title>jQuery用户数字打分评分代码 - HoverTree</

- mybatis的paramType

kerryg

DAOsql

MyBatis传多个参数:

1、采用#{0},#{1}获得参数:

Dao层函数方法:

public User selectUser(String name,String area);

对应的Mapper.xml

<select id="selectUser" result

- centos 7安装mysql5.5

MrLee23

centos

首先centos7 已经不支持mysql,因为收费了你懂得,所以内部集成了mariadb,而安装mysql的话会和mariadb的文件冲突,所以需要先卸载掉mariadb,以下为卸载mariadb,安装mysql的步骤。

#列出所有被安装的rpm package rpm -qa | grep mariadb

#卸载

rpm -e mariadb-libs-5.

- 利用thrift来实现消息群发

qifeifei

thrift

Thrift项目一般用来做内部项目接偶用的,还有能跨不同语言的功能,非常方便,一般前端系统和后台server线上都是3个节点,然后前端通过获取client来访问后台server,那么如果是多太server,就是有一个负载均衡的方法,然后最后访问其中一个节点。那么换个思路,能不能发送给所有节点的server呢,如果能就

- 实现一个sizeof获取Java对象大小

teasp

javaHotSpot内存对象大小sizeof

由于Java的设计者不想让程序员管理和了解内存的使用,我们想要知道一个对象在内存中的大小变得比较困难了。本文提供了可以获取对象的大小的方法,但是由于各个虚拟机在内存使用上可能存在不同,因此该方法不能在各虚拟机上都适用,而是仅在hotspot 32位虚拟机上,或者其它内存管理方式与hotspot 32位虚拟机相同的虚拟机上 适用。

- SVN错误及处理

xiangqian0505

SVN提交文件时服务器强行关闭

在SVN服务控制台打开资源库“SVN无法读取current” ---摘自网络 写道 SVN无法读取current修复方法 Can't read file : End of file found

文件:repository/db/txn_current、repository/db/current

其中current记录当前最新版本号,txn_current记录版本库中版本