- 浅谈人群扩展(lookalike)模型

eso1983

算法

Lookalike主要用于广告或者推荐系统中,找到与种子用户相似的人群。常用的算法应该包括协同过滤、基于标签的相似度计算,还有一些机器学习模型,比如逻辑回归、随机森林,以及深度学习的模型,比如DNN或者Embedding方法。这里简单介绍一下Lookalike人群扩展(相似人群扩展)中常用算法模型的解析,涵盖原理、数学公式、实现步骤、优缺点及适用场景。1.基于标签的相似度匹配原理通过用户标签(兴趣

- Python 深度学习实战:生成对抗网络

AI天才研究院

深度学习实战AI实战AI大模型企业级应用开发实战大数据人工智能语言模型AILLMJavaPython架构设计AgentRPA

1.背景介绍生成对抗网络(GenerativeAdversarialNetwork,GAN)是近年来较火热的深度学习模型之一,其在图像合成、视频生成、文本数据生成等领域均取得了不俗的效果。与传统的机器学习模型不同,GAN可以生成真实有效的数据,无需人工标注数据。它由两部分组成:生成器(Generator)和判别器(Discriminator)。生成器通过学习,根据噪声或随机变量(latentvar

- 【Lora微调】提高模型效率的创新方法

@fishv

人工智能大模型微调Lora

前言在自然语言处理(NLP)和机器学习的研究和应用中,随着模型规模的不断扩大,模型训练的计算成本和存储需求也不断攀升。大型预训练模型,如GPT、BERT等,虽然在许多任务上表现出色,但它们的训练和微调通常需要巨大的计算资源,这使得许多研究者和开发者无法充分利用这些模型进行个性化或领域特定的调整。为了在保持模型性能的同时减少计算开销,**Lora(Low-RankAdaptation)**应运而生。

- [Python从零到壹] 七十七.图像识别及经典案例篇之目标检测入门普及和ImageAI对象检测详解

Eastmount

Python从零到壹python目标检测ImageAI图像是被基础系列

欢迎大家来到“Python从零到壹”,在这里我将分享约200篇Python系列文章,带大家一起去学习和玩耍,看看Python这个有趣的世界。所有文章都将结合案例、代码和作者的经验讲解,真心想把自己近十年的编程经验分享给大家,希望对您有所帮助,文章中不足之处也请海涵。Python系列整体框架包括基础语法10篇、网络爬虫30篇、可视化分析10篇、机器学习20篇、大数据分析20篇、图像识别30篇、人工智

- PAT乙级真题 — 1063 计算谱半径(java)

黄昏岭

python算法开发语言

在数学中,矩阵的“谱半径”是指其特征值的模集合的上确界。换言之,对于给定的n个复数空间的特征值{a1+b1i,⋯,an+bni},它们的模为实部与虚部的平方和的开方,而“谱半径”就是最大模。现在给定一些复数空间的特征值,请你计算并输出这些特征值的谱半径。输入格式:输入第一行给出正整数N(≤10000)是输入的特征值的个数。随后N行,每行给出1个特征值的实部和虚部,其间以空格分隔。注意:题目保证实部

- kaggle上面有哪些适合机器学习新手的比赛和项目

xiamu_CDA

机器学习人工智能

Kaggle上面有哪些适合机器学习新手的比赛和项目?在当今数据驱动的时代,机器学习已经成为一门炙手可热的技能。Kaggle作为全球最大的数据科学竞赛平台,不仅汇聚了众多顶尖的数据科学家和机器学习工程师,也为初学者提供了丰富的学习资源和实战机会。对于机器学习新手来说,选择合适的比赛和项目是至关重要的第一步。本文将为你推荐一些适合新手的Kaggle比赛和项目,并提供一些实用的建议,帮助你在机器学习的道

- python鸢尾花数据集knn_【python+机器学习1】python 实现 KNN

weixin_39629269

python鸢尾花数据集knn

欢迎关注哈希大数据微信公众号【哈希大数据】1KNN算法基本介绍K-NearestNeighbor(k最邻近分类算法),简称KNN,是最简单的一种有监督的机器学习算法。也是一种懒惰学习算法,即开始训练仅仅是保存所有样本集的信息,直到测试样本到达才开始进行分类决策。KNN算法的核心思想:要想确定测试样本属于哪一类,就先寻找所有训练样本中与该测试样本“距离”最近的前K个样本,然后判断这K个样本中大部分所

- 【机器学习】使用scikit-learn中的KNN包实现对鸢尾花数据集或者自定义数据集的的预测

加德霍克

机器学习人工智能python学习作业

一、KNN算法概念K最近邻(K-NearestNeighbor,KNN)分类算法是数据挖掘分类技术中最简单的方法之一,是著名的模式识别统计学方法,在机器学习分类算法中占有相当大的地位。它是一个理论上比较成熟的方法。既是最简单的机器学习算法之一,也是基于实例的学习方法中最基本的,又是最好的文本分类算法之一。二、对鸢尾花数据集进行预测1、代码示例:fromsklearn.datasetsimportl

- Julia语言的计算机基础

Code侠客行

包罗万象golang开发语言后端

Julia语言的计算机基础引言随着数据科学、机器学习和高性能计算的快速发展,对编程语言的需求也日益增加。在众多编程语言中,Julia语言因其独特的设计理念和高性能而迅速崛起。本文将详细探讨Julia语言的基础知识,包括其历史背景、安装与环境配置、基本语法、数据结构、函数与模块、以及性能优化等方面,旨在为对Julia感兴趣的读者提供一份全面的入门指南。一、Julia语言简介1.1历史背景Julia是

- 想转行到人工智能领域,我该学什么,怎么学?

张登杰踩

人工智能python

转行到人工智能(AI)领域需要系统的学习和实践,以下是详细的路径建议,涵盖基础知识、技能学习、项目实践和求职准备:一、明确目标和领域方向人工智能领域广泛,建议先了解细分方向(如机器学习、深度学习、计算机视觉、自然语言处理、强化学习等),结合兴趣和职业规划选择切入点。二、构建基础知识1.数学基础线性代数:矩阵运算、特征值、向量空间。微积分:导数、梯度、优化理论。概率与统计:贝叶斯定理、分布、假设检验

- 机器学习问题:AttributeError: ‘NoneType‘ object has no attribute ‘split‘ 解决办法

零零鲎

机器学习人工智能

参考博客:本次博客参考http://t.csdnimg.cn/8E7eH。写下来主要是为了整理自己在学习过程中遇到的问题并把解决办法列出来。学习内容:如果运行出现:AttributeError:‘NoneType’objecthasnoattribute'split’这样的问题。网上有很多解决办法是降级numpy到1.21.4。然后上面博客给出的解决方案是升级threadpoolctl。可以使用命

- AI Agent:一场智能革命的开始

机器人openai区块链

在当今科技日新月异的时代,AI(人工智能)技术正以前所未有的速度改变着我们的生活和工作方式。其中,AIAgent作为AI领域的一个新兴分支,正逐渐展现出其巨大的潜力和价值。本文将深入探讨AIAgent的发展现状、核心优势以及未来的发展方向,带您领略这一前沿技术的无限魅力。一、AIAgent的发展现状:技术突破与广泛应用近年来,随着大数据、云计算和机器学习等技术的飞速发展,AIAgent的技术水平得

- 【杂谈】-为什么Python是AI的首选语言

视觉与物联智能

杂谈python人工智能开发语言深度学习机器学习

为什么Python是AI的首选语言文章目录为什么Python是AI的首选语言1、为何Python引领人工智能发展1.1可用性和生态系统1.2用户群和用例1.3效率辅助2、AI项目对Python开发人员的要求3、如何开启你的AI学习之旅人工智能的广泛应用正在软件工程领域引发范式转变。Python凭借其易用性、成熟的生态系统以及满足人工智能和机器学习(ML)工作流数据驱动需求的能力,迅速成为人工智能开

- 新质生产力与核心竞争力提升

AI大模型应用之禅

计算机软件编程原理与应用实践javapythonjavascriptkotlingolang架构人工智能

新质生产力、人工智能、机器学习、深度学习、算法优化、数据驱动、核心竞争力、数字化转型1.背景介绍在当今数字化时代,科技创新正以惊人的速度推动着社会发展。人工智能(AI)作为科技发展的重要驱动力,正在深刻地改变着生产方式和生活方式。从自动驾驶汽车到智能语音助手,从个性化推荐系统到医疗诊断辅助,AI技术的应用场景日益广泛,为人类社会带来了前所未有的机遇。然而,AI技术的应用并非一帆风顺。如何有效地利用

- 智能工单分配在技术支持中的应用

AI大模型应用之禅

计算机软件编程原理与应用实践javapythonjavascriptkotlingolang架构人工智能

智能工单分配,技术支持,机器学习,算法优化,效率提升,客户满意度1.背景介绍在当今数字化时代,技术支持部门扮演着至关重要的角色,为用户提供及时有效的技术帮助,确保业务的正常运行。然而,随着用户数量和技术需求的不断增长,传统的人工工单分配方式面临着诸多挑战:分配效率低下:人工分配工单需要耗费大量时间和人力,且难以做到精准匹配,导致工单处理效率低下。资源分配不均衡:经验丰富的技术人员可能承担过多的工作

- 计算广告(一)

爱学习的菜鸟罢了

搜广推人工智能

计算广告学是一个十分庞大的学科,里面涵盖了自然语言处理、机器学习、推荐系统等众多研究方向。而且广告作为互联网行业的三大盈利模式(广告、电商、游戏)之一,也是这三大模式中最有技术含量的,计算广告学一直都吸引着无数学术界/工业界的精英投入其中(ps:计算广告学也是机器学习在商业界最成功的应用之一)。行业分类例子盈利搜索引擎Google百度广告社交网络腾讯facebook广告增值服务游戏电商网站亚马逊阿

- 如何从Oracle Autonomous Database加载文档

fGVBSAbe

数据库oraclepython

OracleAutonomousDatabase是一种云数据库,利用机器学习来自动化数据库调优、安全性、备份、更新以及其他传统由数据库管理员(DBAs)执行的例行管理任务。在本文中,我们将演示如何从OracleAutonomousDatabase加载文档。我们将使用连接字符串或TNS配置来进行连接。技术背景介绍OracleAutonomousDatabase通过自动化的方式极大地简化了数据库管理的

- 基于数据可视化+SpringBoot+Vue的医院综合管理平台设计和实现(源码+论文+部署讲解等)

java李杨勇

Java精品毕设实战案例Java毕业设计实战案例信息可视化springbootvue.js医院综合管理平台Java毕业设计

博主介绍:✌全网粉丝50W+,csdn特邀作者、博客专家、CSDN新星计划导师、Java领域优质创作者,博客之星、掘金/华为云/阿里云/InfoQ等平台优质作者、专注于Java技术领域和学生毕业项目实战,高校老师/讲师/同行前辈交流✌技术范围:SpringBoot、Vue、SSM、HLMT、Jsp、PHP、Nodejs、Python、爬虫、数据可视化、小程序、安卓app、大数据、物联网、机器学习等

- 自动检测和机器审核系统实现

╰つ゛木槿

javaeasyuijavascriptpythonjava自然语言处理

目录一、自动检测和机器审核实现步骤1.文本预处理步骤细节:2.关键词检测步骤细节:3.情感分析与情境理解步骤细节:4.机器学习模型训练步骤细节:5.深度学习模型步骤细节:6.多模态审查步骤细节:7.用户行为分析与违规预测步骤细节:总结二、常用的分词工具1.jieba2.THULAC3.HanLP4.SnowNLP5.LAC(LexicalAnalysisofChinese)6.PyLDAvis(结

- 【CV】25.1.7 arxiv更新速递

hinmer

arxivCV每日更新python人工智能计算机视觉chatgpt目标检测aiAIGC

—第1篇----关键词:手势识别,计算机视觉,低光照条件,机器学习,RaspberryPi,OpenCV论文链接-摘要:手势识别是一种基于计算机视觉技术的感知用户界面,允许计算机将人类动作解释为命令,使用户无需使用手与计算机交流,从而使鼠标和键盘变得多余。手势识别的主要弱点是光线条件,因为手势控制依赖于摄像头。摄像头用于在2D和3D中解释手势,因此提取的信息可能因光源而异。系统的限制是无法在黑暗环

- AI需要的基础数学知识

大囚长

机器学习大模型人工智能

AI(人工智能)涉及多个数学领域,以下是主要的基础数学知识:1.线性代数矩阵与向量:用于表示数据和模型参数。矩阵乘法:用于神经网络的前向传播。特征值与特征向量:用于降维和主成分分析(PCA)。奇异值分解(SVD):用于数据压缩和降维。2.微积分导数与偏导数:用于优化算法(如梯度下降)。链式法则:用于反向传播算法。积分:在概率和统计中有应用。3.概率与统计概率分布:如高斯分布、伯努利分布等。贝叶斯定

- 【包邮送书】你好!Python

Mindtechnist

粉丝福利python网络开发语言机器学习

欢迎关注博主Mindtechnist或加入【智能科技社区】一起学习和分享Linux、C、C++、Python、Matlab,机器人运动控制、多机器人协作,智能优化算法,滤波估计、多传感器信息融合,机器学习,人工智能等相关领域的知识和技术。关注公粽号《机器和智能》回复关键词“python项目实战”即可获取美哆商城视频资源!博主介绍:CSDN博客专家,CSDN优质创作者,CSDN实力新星,CSDN内容

- 基于遗传算法的城市旅行问题(TSP)求解

NovakG_

深度学习python算法深度学习神经网络

1.遗传算法背景介绍遗传算法是一种基于生物进化论中的自然选择和遗传机制的优化算法,模拟了生物进化过程以搜索最优解。通过仿真染色体的交叉、变异等操作,遗传算法将求解过程转换为类似生物进化的迭代运算。该算法在解决复杂的组合优化问题时,通常比常规优化算法更高效,且具有广泛应用,包括组合优化、机器学习、信号处理、自适应控制和人工生命等领域2.遗传算法基本解题思路遗传算法的设计思路主要受到大自然中生物体进化

- 【2025 ODA teigha .NET系列开发教程 第五章】给CAD实体添加附属数据XDATA,包括源码

三好学生~张旺

ODATeigha.NET开发教程.net

系列文章目录提示:这里可以添加系列文章的所有文章的目录,目录需要自己手动添加例如:第一章Python机器学习入门之pandas的使用提示:写完文章后,目录可以自动生成,如何生成可参考右边的帮助文档2025ODAteigha.NET系列开发教程系列文章目录AutoCADXData扩展数据开发指南什么是XData?XData的两种存储方式1.全局字典存储(XRecord)2.实体附加存储步骤1:注册应

- 【数据挖掘实战】 房价预测

机器学习司猫白

数据挖掘人工智能python机器学习

本次对kaggle中的入门级数据集,房价回归数据集进行数据挖掘,预测房屋价格。本人主页:机器学习司猫白机器学习专栏:机器学习实战PyTorch入门专栏:PyTorch入门深度学习实战:深度学习ok,话不多说,我们进入正题吧概述本次竞赛有79个解释变量(几乎)描述了爱荷华州艾姆斯住宅的各个方面,需要预测每套住宅的最终价格。数据集描述本次数据集已经上传,大家可以自行下载尝试文件说明train.csv-

- 【AI日志分析】基于机器学习的异常检测:告别传统规则的智能进阶

网罗开发

AI大模型人工智能机器学习

网罗开发(小红书、快手、视频号同名) 大家好,我是展菲,目前在上市企业从事人工智能项目研发管理工作,平时热衷于分享各种编程领域的软硬技能知识以及前沿技术,包括iOS、前端、HarmonyOS、Java、Python等方向。在移动端开发、鸿蒙开发、物联网、嵌入式、云原生、开源等领域有深厚造诣。图书作者:《ESP32-C3物联网工程开发实战》图书作者:《SwiftUI入门,进阶与实战》超级个体:CO

- Copilot 概述

计算机萍萍学姐

copilotcopilot人工智能机器学习

Copilot是什么?它有什么用途?Copilot是由人工智能公司和GitHub合作开发的一个基于人工智能的代码提示工具,它可以利用机器学习技术和大量训练数据生成高质量的代码。Copilot的目标是在保持代码质量和可读性的前提下,提高开发者的编码效率,使得编码工作更为高效和便捷。Copilot的出现是解决编程过程中可能遇到的一些难点和瓶颈问题,特别是在快速迭代的敏捷开发场景中,提高编码效率和减少编

- 让旅游更智能:基于AR的旅游导览应用解析

Echo_Wish

Python笔记Python算法旅游arrestful

友友们好!我的新专栏《Python进阶》正式启动啦!这是一个专为那些渴望提升Python技能的朋友们量身打造的专栏,无论你是已经有一定基础的开发者,还是希望深入挖掘Python潜力的爱好者,这里都将是你不可错过的宝藏。在这个专栏中,你将会找到:●深入解析:每一篇文章都将深入剖析Python的高级概念和应用,包括但不限于数据分析、机器学习、Web开发等。●实战案例:通过丰富的实战案例,带你一步步实现

- 【AI日志分析】基于机器学习的异常检测:告别传统规则的智能进阶

人工智能机器学习深度学习

摘要随着系统规模的扩大和复杂性增加,传统基于规则的日志分析方法难以识别隐藏的复杂异常模式。本文将介绍基于机器学习的日志异常检测技术,包括模型选择、特征工程及实现步骤。通过具体的代码示例与图表,展示如何高效检测异常日志,并提供应用场景与优化策略。引言日志是系统运行状态的关键数据来源,但面对海量日志数据,传统规则式分析显得力不从心。机器学习能够根据日志的历史数据和行为模式,通过训练模型检测异常情况,不

- 【Python】已完美解决:ERROR: Could not find a version that satisfies the requirement re

屿小夏

python开发语言

个人简介:某不知名博主,致力于全栈领域的优质博客分享|用最优质的内容带来最舒适的阅读体验!文末获取免费IT学习资料!文末获取更多信息精彩专栏推荐订阅收藏专栏系列直达链接相关介绍书籍分享点我跳转书籍作为获取知识的重要途径,对于IT从业者来说更是不可或缺的资源。不定期更新IT图书,并在评论区抽取随机粉丝,书籍免费包邮到家AI前沿点我跳转探讨人工智能技术领域的最新发展和创新,涵盖机器学习、深度学习、自然

- Hadoop(一)

朱辉辉33

hadooplinux

今天在诺基亚第一天开始培训大数据,因为之前没接触过Linux,所以这次一起学了,任务量还是蛮大的。

首先下载安装了Xshell软件,然后公司给了账号密码连接上了河南郑州那边的服务器,接下来开始按照给的资料学习,全英文的,头也不讲解,说锻炼我们的学习能力,然后就开始跌跌撞撞的自学。这里写部分已经运行成功的代码吧.

在hdfs下,运行hadoop fs -mkdir /u

- maven An error occurred while filtering resources

blackproof

maven报错

转:http://stackoverflow.com/questions/18145774/eclipse-an-error-occurred-while-filtering-resources

maven报错:

maven An error occurred while filtering resources

Maven -> Update Proje

- jdk常用故障排查命令

daysinsun

jvm

linux下常见定位命令:

1、jps 输出Java进程

-q 只输出进程ID的名称,省略主类的名称;

-m 输出进程启动时传递给main函数的参数;

&nb

- java 位移运算与乘法运算

周凡杨

java位移运算乘法

对于 JAVA 编程中,适当的采用位移运算,会减少代码的运行时间,提高项目的运行效率。这个可以从一道面试题说起:

问题:

用最有效率的方法算出2 乘以8 等於几?”

答案:2 << 3

由此就引发了我的思考,为什么位移运算会比乘法运算更快呢?其实简单的想想,计算机的内存是用由 0 和 1 组成的二

- java中的枚举(enmu)

g21121

java

从jdk1.5开始,java增加了enum(枚举)这个类型,但是大家在平时运用中还是比较少用到枚举的,而且很多人和我一样对枚举一知半解,下面就跟大家一起学习下enmu枚举。先看一个最简单的枚举类型,一个返回类型的枚举:

public enum ResultType {

/**

* 成功

*/

SUCCESS,

/**

* 失败

*/

FAIL,

- MQ初级学习

510888780

activemq

1.下载ActiveMQ

去官方网站下载:http://activemq.apache.org/

2.运行ActiveMQ

解压缩apache-activemq-5.9.0-bin.zip到C盘,然后双击apache-activemq-5.9.0-\bin\activemq-admin.bat运行ActiveMQ程序。

启动ActiveMQ以后,登陆:http://localhos

- Spring_Transactional_Propagation

布衣凌宇

springtransactional

//事务传播属性

@Transactional(propagation=Propagation.REQUIRED)//如果有事务,那么加入事务,没有的话新创建一个

@Transactional(propagation=Propagation.NOT_SUPPORTED)//这个方法不开启事务

@Transactional(propagation=Propagation.REQUIREDS_N

- 我的spring学习笔记12-idref与ref的区别

aijuans

spring

idref用来将容器内其他bean的id传给<constructor-arg>/<property>元素,同时提供错误验证功能。例如:

<bean id ="theTargetBean" class="..." />

<bean id ="theClientBean" class=&quo

- Jqplot之折线图

antlove

jsjqueryWebtimeseriesjqplot

timeseriesChart.html

<script type="text/javascript" src="jslib/jquery.min.js"></script>

<script type="text/javascript" src="jslib/excanvas.min.js&

- JDBC中事务处理应用

百合不是茶

javaJDBC编程事务控制语句

解释事务的概念; 事务控制是sql语句中的核心之一;事务控制的作用就是保证数据的正常执行与异常之后可以恢复

事务常用命令:

Commit提交

- [转]ConcurrentHashMap Collections.synchronizedMap和Hashtable讨论

bijian1013

java多线程线程安全HashMap

在Java类库中出现的第一个关联的集合类是Hashtable,它是JDK1.0的一部分。 Hashtable提供了一种易于使用的、线程安全的、关联的map功能,这当然也是方便的。然而,线程安全性是凭代价换来的――Hashtable的所有方法都是同步的。此时,无竞争的同步会导致可观的性能代价。Hashtable的后继者HashMap是作为JDK1.2中的集合框架的一部分出现的,它通过提供一个不同步的

- ng-if与ng-show、ng-hide指令的区别和注意事项

bijian1013

JavaScriptAngularJS

angularJS中的ng-show、ng-hide、ng-if指令都可以用来控制dom元素的显示或隐藏。ng-show和ng-hide根据所给表达式的值来显示或隐藏HTML元素。当赋值给ng-show指令的值为false时元素会被隐藏,值为true时元素会显示。ng-hide功能类似,使用方式相反。元素的显示或

- 【持久化框架MyBatis3七】MyBatis3定义typeHandler

bit1129

TypeHandler

什么是typeHandler?

typeHandler用于将某个类型的数据映射到表的某一列上,以完成MyBatis列跟某个属性的映射

内置typeHandler

MyBatis内置了很多typeHandler,这写typeHandler通过org.apache.ibatis.type.TypeHandlerRegistry进行注册,比如对于日期型数据的typeHandler,

- 上传下载文件rz,sz命令

bitcarter

linux命令rz

刚开始使用rz上传和sz下载命令:

因为我们是通过secureCRT终端工具进行使用的所以会有上传下载这样的需求:

我遇到的问题:

sz下载A文件10M左右,没有问题

但是将这个文件A再传到另一天服务器上时就出现传不上去,甚至出现乱码,死掉现象,具体问题

解决方法:

上传命令改为;rz -ybe

下载命令改为:sz -be filename

如果还是有问题:

那就是文

- 通过ngx-lua来统计nginx上的虚拟主机性能数据

ronin47

ngx-lua 统计 解禁ip

介绍

以前我们为nginx做统计,都是通过对日志的分析来完成.比较麻烦,现在基于ngx_lua插件,开发了实时统计站点状态的脚本,解放生产力.项目主页: https://github.com/skyeydemon/ngx-lua-stats 功能

支持分不同虚拟主机统计, 同一个虚拟主机下可以分不同的location统计.

可以统计与query-times request-time

- java-68-把数组排成最小的数。一个正整数数组,将它们连接起来排成一个数,输出能排出的所有数字中最小的。例如输入数组{32, 321},则输出32132

bylijinnan

java

import java.util.Arrays;

import java.util.Comparator;

public class MinNumFromIntArray {

/**

* Q68输入一个正整数数组,将它们连接起来排成一个数,输出能排出的所有数字中最小的一个。

* 例如输入数组{32, 321},则输出这两个能排成的最小数字32132。请给出解决问题

- Oracle基本操作

ccii

Oracle SQL总结Oracle SQL语法Oracle基本操作Oracle SQL

一、表操作

1. 常用数据类型

NUMBER(p,s):可变长度的数字。p表示整数加小数的最大位数,s为最大小数位数。支持最大精度为38位

NVARCHAR2(size):变长字符串,最大长度为4000字节(以字符数为单位)

VARCHAR2(size):变长字符串,最大长度为4000字节(以字节数为单位)

CHAR(size):定长字符串,最大长度为2000字节,最小为1字节,默认

- [强人工智能]实现强人工智能的路线图

comsci

人工智能

1:创建一个用于记录拓扑网络连接的矩阵数据表

2:自动构造或者人工复制一个包含10万个连接(1000*1000)的流程图

3:将这个流程图导入到矩阵数据表中

4:在矩阵的每个有意义的节点中嵌入一段简单的

- 给Tomcat,Apache配置gzip压缩(HTTP压缩)功能

cwqcwqmax9

apache

背景:

HTTP 压缩可以大大提高浏览网站的速度,它的原理是,在客户端请求网页后,从服务器端将网页文件压缩,再下载到客户端,由客户端的浏览器负责解压缩并浏览。相对于普通的浏览过程HTML ,CSS,Javascript , Text ,它可以节省40%左右的流量。更为重要的是,它可以对动态生成的,包括CGI、PHP , JSP , ASP , Servlet,SHTML等输出的网页也能进行压缩,

- SpringMVC and Struts2

dashuaifu

struts2springMVC

SpringMVC VS Struts2

1:

spring3开发效率高于struts

2:

spring3 mvc可以认为已经100%零配置

3:

struts2是类级别的拦截, 一个类对应一个request上下文,

springmvc是方法级别的拦截,一个方法对应一个request上下文,而方法同时又跟一个url对应

所以说从架构本身上 spring3 mvc就容易实现r

- windows常用命令行命令

dcj3sjt126com

windowscmdcommand

在windows系统中,点击开始-运行,可以直接输入命令行,快速打开一些原本需要多次点击图标才能打开的界面,如常用的输入cmd打开dos命令行,输入taskmgr打开任务管理器。此处列出了网上搜集到的一些常用命令。winver 检查windows版本 wmimgmt.msc 打开windows管理体系结构(wmi) wupdmgr windows更新程序 wscrip

- 再看知名应用背后的第三方开源项目

dcj3sjt126com

ios

知名应用程序的设计和技术一直都是开发者需要学习的,同样这些应用所使用的开源框架也是不可忽视的一部分。此前《

iOS第三方开源库的吐槽和备忘》中作者ibireme列举了国内多款知名应用所使用的开源框架,并对其中一些框架进行了分析,同样国外开发者

@iOSCowboy也在博客中给我们列出了国外多款知名应用使用的开源框架。另外txx's blog中详细介绍了

Facebook Paper使用的第三

- Objective-c单例模式的正确写法

jsntghf

单例iosiPhone

一般情况下,可能我们写的单例模式是这样的:

#import <Foundation/Foundation.h>

@interface Downloader : NSObject

+ (instancetype)sharedDownloader;

@end

#import "Downloader.h"

@implementation

- jquery easyui datagrid 加载成功,选中某一行

hae

jqueryeasyuidatagrid数据加载

1.首先你需要设置datagrid的onLoadSuccess

$(

'#dg'

).datagrid({onLoadSuccess :

function

(data){

$(

'#dg'

).datagrid(

'selectRow'

,3);

}});

2.onL

- jQuery用户数字打分评价效果

ini

JavaScripthtmljqueryWebcss

效果体验:http://hovertree.com/texiao/jquery/5.htmHTML文件代码:

<!DOCTYPE html>

<html xmlns="http://www.w3.org/1999/xhtml">

<head>

<title>jQuery用户数字打分评分代码 - HoverTree</

- mybatis的paramType

kerryg

DAOsql

MyBatis传多个参数:

1、采用#{0},#{1}获得参数:

Dao层函数方法:

public User selectUser(String name,String area);

对应的Mapper.xml

<select id="selectUser" result

- centos 7安装mysql5.5

MrLee23

centos

首先centos7 已经不支持mysql,因为收费了你懂得,所以内部集成了mariadb,而安装mysql的话会和mariadb的文件冲突,所以需要先卸载掉mariadb,以下为卸载mariadb,安装mysql的步骤。

#列出所有被安装的rpm package rpm -qa | grep mariadb

#卸载

rpm -e mariadb-libs-5.

- 利用thrift来实现消息群发

qifeifei

thrift

Thrift项目一般用来做内部项目接偶用的,还有能跨不同语言的功能,非常方便,一般前端系统和后台server线上都是3个节点,然后前端通过获取client来访问后台server,那么如果是多太server,就是有一个负载均衡的方法,然后最后访问其中一个节点。那么换个思路,能不能发送给所有节点的server呢,如果能就

- 实现一个sizeof获取Java对象大小

teasp

javaHotSpot内存对象大小sizeof

由于Java的设计者不想让程序员管理和了解内存的使用,我们想要知道一个对象在内存中的大小变得比较困难了。本文提供了可以获取对象的大小的方法,但是由于各个虚拟机在内存使用上可能存在不同,因此该方法不能在各虚拟机上都适用,而是仅在hotspot 32位虚拟机上,或者其它内存管理方式与hotspot 32位虚拟机相同的虚拟机上 适用。

- SVN错误及处理

xiangqian0505

SVN提交文件时服务器强行关闭

在SVN服务控制台打开资源库“SVN无法读取current” ---摘自网络 写道 SVN无法读取current修复方法 Can't read file : End of file found

文件:repository/db/txn_current、repository/db/current

其中current记录当前最新版本号,txn_current记录版本库中版本

![]() 是

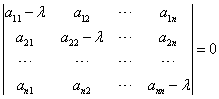

是![]() 阶方阵,若有数

阶方阵,若有数![]() 和非零向量

和非零向量![]() ,使得

,使得 ![]()

![]() 是

是![]() 的特征值,非零向量

的特征值,非零向量![]() 是

是![]() 对应于特征值

对应于特征值![]() 的特征向量。

的特征向量。 ![]() ,有

,有![]() 及向量

及向量![]() ,使得

,使得![]() ,这说明

,这说明![]() 是

是![]() 的特征值,

的特征值,![]() 是

是![]() 对应于

对应于![]() 的特征向量。

的特征向量。 ![]() 得

得![]() ,并且由于

,并且由于![]() 是非零向量,故行列式

是非零向量,故行列式![]() ,即

,即 ![]() 的特征方程)

的特征方程) ![]() 个根

个根![]() (在复数范围内),这就是

(在复数范围内),这就是![]() 的所有特征值。

的所有特征值。 ![]() ,由线性方程组

,由线性方程组![]() 解出非零解

解出非零解![]() ,这就是

,这就是![]() 对应于特征值

对应于特征值![]() 的特征向量。

的特征向量。 ![]() ,解得

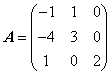

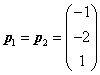

,解得![]() ;

; ![]() ,解得

,解得![]() ;

; ![]() ,

, ![]()

![]() 是

是![]() 的特征向量,则对

的特征向量,则对![]() ,

,![]() 也是

也是![]() 的特征向量。

的特征向量。 ![]() 是

是![]() 的特征值,则

的特征值,则![]() 是

是![]() 的特征值,从而

的特征值,从而![]() 是

是![]() 的特征值。

的特征值。 ![]() 是

是![]() 的个特征值,

的个特征值,![]() 为依次对应的特征向量,若

为依次对应的特征向量,若![]() 各不相同,则

各不相同,则![]() 线性无关。

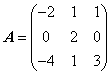

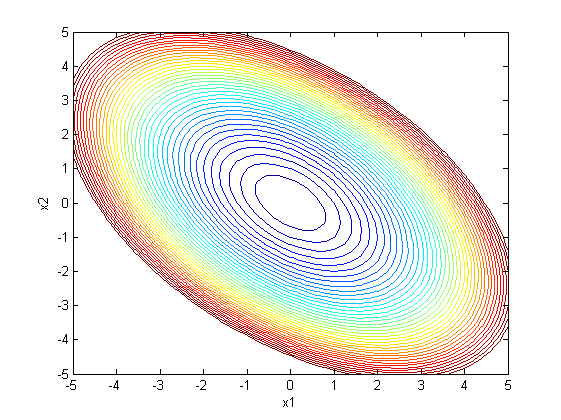

线性无关。 ![]() ,其中R是已知的二阶矩阵,R=[1,0.5;0.5,1],x是二维列向量,x=[x1;x2],求y的最小值。

,其中R是已知的二阶矩阵,R=[1,0.5;0.5,1],x是二维列向量,x=[x1;x2],求y的最小值。![]() ,C是13行13列的矩阵,对C进行特征分解,对角化

,C是13行13列的矩阵,对C进行特征分解,对角化![]() ,其中U是特征向量组成的矩阵,D是特征值组成的对角矩阵,并按由大到小排列。然后,令

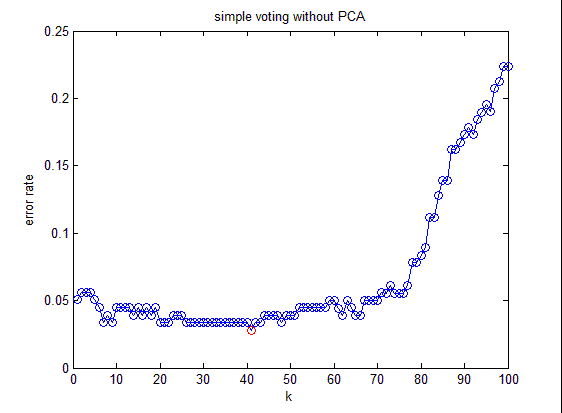

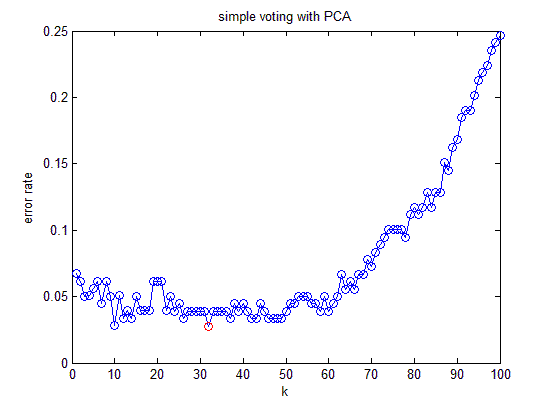

,其中U是特征向量组成的矩阵,D是特征值组成的对角矩阵,并按由大到小排列。然后,令![]() ,就实现了数据集在特征向量这组正交基上的投影。嗯,重点来了,R’中的数据列是按照对应特征值的大小排列的,后面的列对应小特征值,去掉以后对整个数据集的影响比较小。比如,现在我们直接去掉后面的7列,只保留前6列,就完成了降维。这个降维方法叫PCA(Principal Component Analysis,主成分分析)。

,就实现了数据集在特征向量这组正交基上的投影。嗯,重点来了,R’中的数据列是按照对应特征值的大小排列的,后面的列对应小特征值,去掉以后对整个数据集的影响比较小。比如,现在我们直接去掉后面的7列,只保留前6列,就完成了降维。这个降维方法叫PCA(Principal Component Analysis,主成分分析)。