hadoop单机版搭建图文详解

前置条件:

1、ubuntu10.10安装成功(个人认为不必要花太多时间在系统安装上, 我们不是为了装机而装机的)

2、jdk安装成功(jdk1.6.0_23for linux版本,图解安装过程http://freewxy.iteye.com/blog/882784 )

3、下载 hhadoop0.21.0.tar.gz(http://apache.etoak.com//hadoop/core/hadoop-0.21.0/ )

安装hadoop

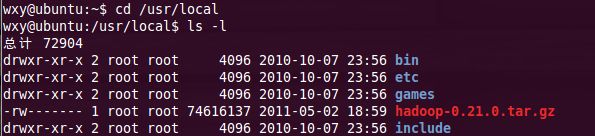

1、首先将hadoop0.21.0.tar.gz复制到usr下的local 文件夹内,(sudo cp hadoop路径 /usr/local)如图1

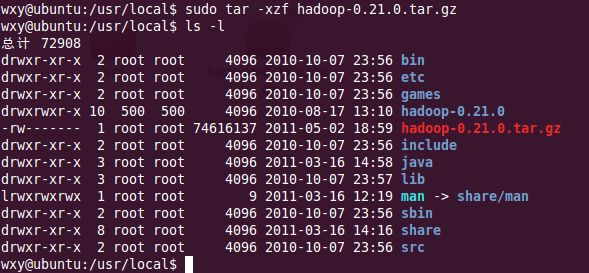

2、进入到local目录下,解压hadoop0.21.0.tar.gz,如 图2

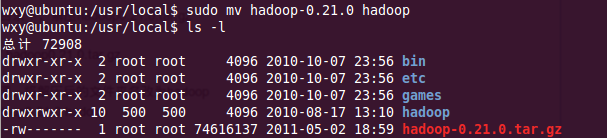

3、为方便管理和hadoop版本升级,将解压后的文件夹改名为hadoop, 如图3

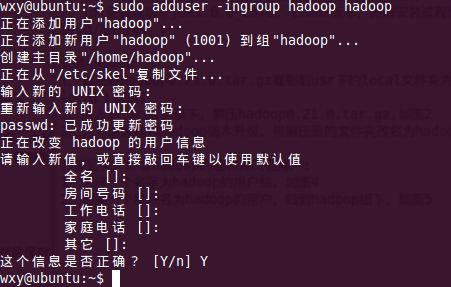

方便起见,新增hadoop的组和其同名用户:

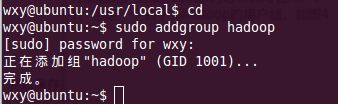

1、创建一个名字为hadoop的用户组,如图4

2、创建一个用户名为hadoop的用户,归到hadoop组下,如图5(一些 信息可以不填写,直接按enter键即可)如图5

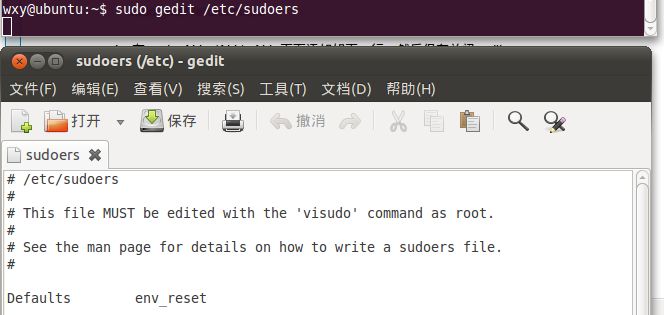

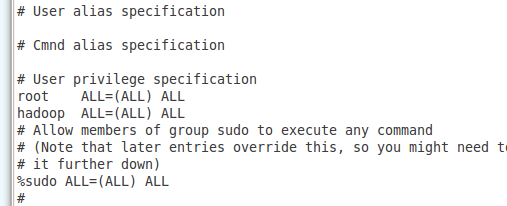

3、(1)添加用户权限:打开etc下的sudoers文件,添加如下(2)命 令,如图6

--------------------------------------------------------------------------------------------------------------------------------

(另一种方法是先切换到root用户下,然后修改sudoers的权限,但 这样操作一定要小心谨慎,修改权限后要将文件改回只读,否则悲剧啦啦啦,我们一票人死在这点上好多次)

(2)在root ALL =(ALL) ALL 下面添加如下文字:

hadoop ALL = (ALL) ALL

如图7

-----------------------------------------------------------------------------

----------------------------------------------------------------------------------------------

(/etc/sudoers文件是用于sudo命令执行时审核执行权限用的)

执行命令:$:sudo chown hadoop /usr/local/hadoop(将hadoop文件夹的权限赋给hadoop用户)

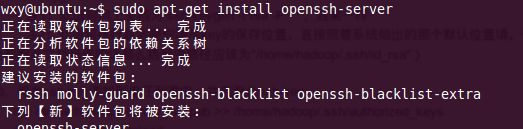

安装ssh (需联网):(了解ssh:http://freewxy.iteye.com/blog/910820)

1、安装openssh_server:如图8

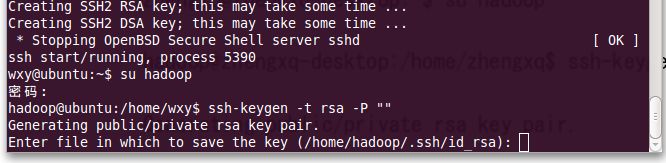

2、创建ssh-key,为rsa,如图9

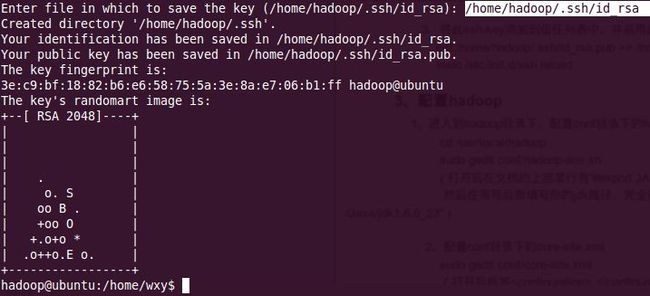

填写key的保存路径,如图10填写

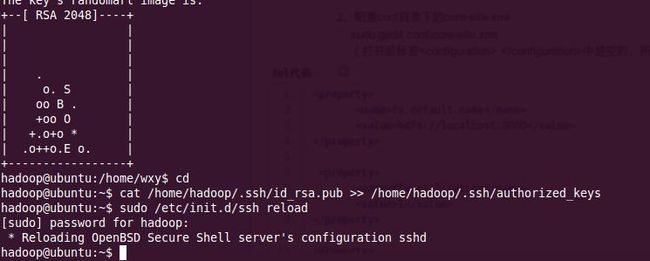

3、添加ssh-key到受信列表,并启用此ssh-key,如图11

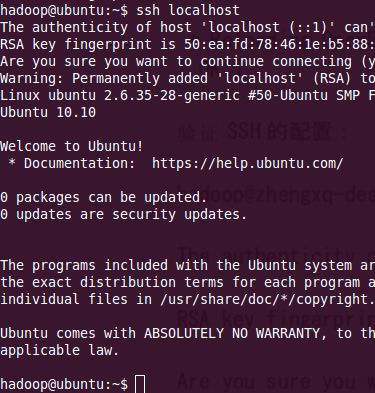

4、验证ssh的配置,如图12

配置hadoop

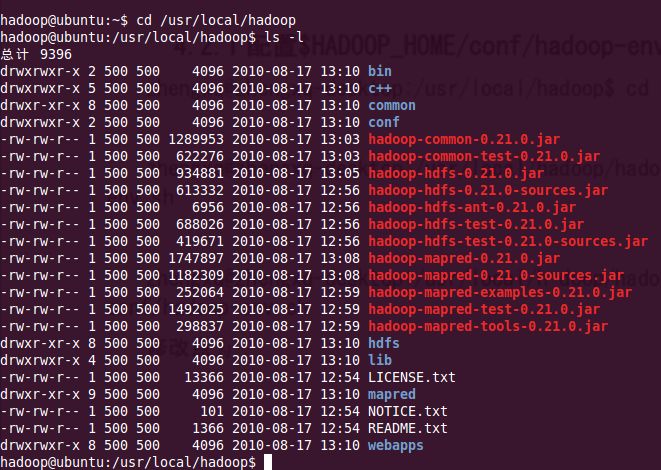

0、浏览hadoop文件下都有些什么东西,如图13

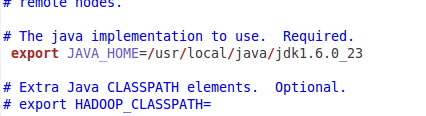

1、打开conf/hadoop-env.sh,如图14

配置conf/hadoop-env.sh(找到#export JAVA_HOME=...,去掉#,然后加上本机jdk的路径,可以从/etc/profile中找到,本机的为/usr/lib/jvm/java-6-sun),如图15

---------------------------------------------------------------------------------------------

--------------------------------------------------------------------------------------

2、打开conf/core-site.xml

配置,如下内容:

- <configuration>

- <property>

- <name>fs.default .name</name>

- <value>hdfs://localhost:9000</value>

- </property>

- <property>

- <name>dfs.replication</name>

- <value>1 </value>

- </property>

- <property>

- <name>hadoop.tmp.dir</name>

- <value>/home/hadoop/tmp</value>

- </property>

- </configuration>

<configuration> <property> <name>fs.default.name</name> <value>hdfs://localhost:9000</value> </property> <property> <name>dfs.replication</name> <value>1</value> </property> <property> <name>hadoop.tmp.dir</name> <value>/home/hadoop/tmp</value> </property> </configuration>

3、打开conf目录下的mapred-site.xml

配置如下内容:

- <configuration>

- <property>

- <name>mapred.job.tracker</name>

- <value>localhost:9001 </value>

- </property>

- </configuration>

<configuration> <property> <name>mapred.job.tracker</name> <value>localhost:9001</value> </property> </configuration>

运行测试 :

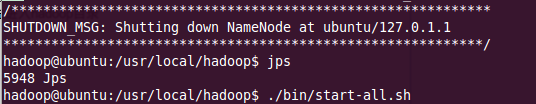

1、改变用户,格式化namenode,如图18

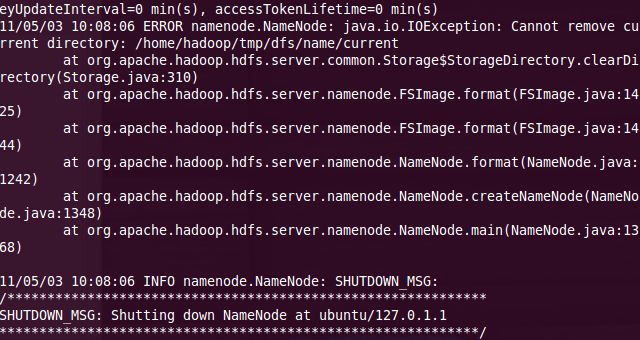

可能遇到如下错误(倒腾这个过程次数多了),如图19

执行如图20,再次执行如图18

![]()

2、启动hadoop,如图21

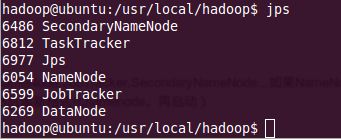

3、验证hadoop是否成功启动,如图22

运行自带wordcount例 子(jidong啊)

1、准备需要进行wordcount的文件,如图23(在test.txt中随 便输入字符串,保存并退出)

-------------------------------------------------------------------------------------------

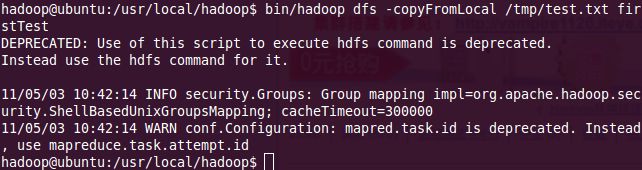

2、将上一步中的测试文件上传到dfs文件系统中的firstTest目录下, 如图24(如果dfs下不包含firstTest目录的话自动创建一个同名目录,使用命令:bin/hadoop dfs -ls查看dfs文件系统中已有的目录)

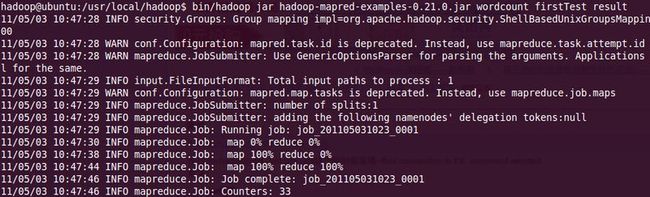

3、执行wordcount,如图25(对firstest下的所有文件执行 wordcount,将统计结果输出到result文件夹中,若result文件夹不存在则自动创建)

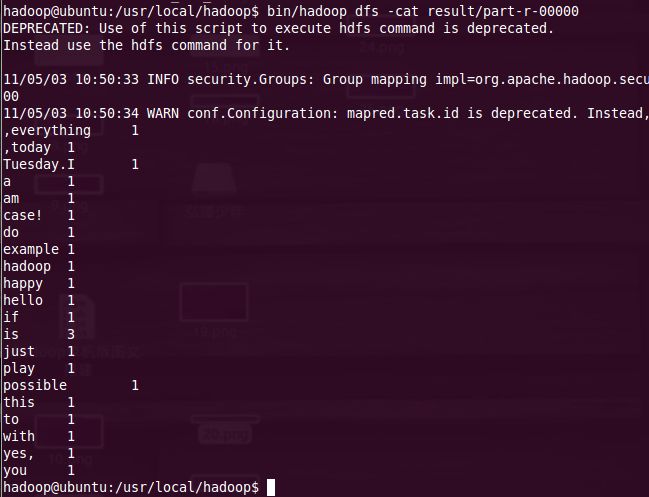

4、查看结果,如图26

关闭服务:

bin/stop-all.sh

单机版搞定~~