- 探索OpenAI和LangChain的适配器集成:轻松切换模型提供商

nseejrukjhad

langchaineasyui前端python

#探索OpenAI和LangChain的适配器集成:轻松切换模型提供商##引言在人工智能和自然语言处理的世界中,OpenAI的模型提供了强大的能力。然而,随着技术的发展,许多人开始探索其他模型以满足特定需求。LangChain作为一个强大的工具,集成了多种模型提供商,通过提供适配器,简化了不同模型之间的转换。本篇文章将介绍如何使用LangChain的适配器与OpenAI集成,以便轻松切换模型提供商

- 使用Apify加载Twitter消息以进行微调的完整指南

nseejrukjhad

twittereasyui前端python

#使用Apify加载Twitter消息以进行微调的完整指南##引言在自然语言处理领域,微调模型以适应特定任务是提升模型性能的常见方法。本文将介绍如何使用Apify从Twitter导出聊天信息,以便进一步进行微调。##主要内容###使用Apify导出推文首先,我们需要从Twitter导出推文。Apify可以帮助我们做到这一点。通过Apify的强大功能,我们可以批量抓取和导出数据,适用于各类应用场景。

- 深入理解 MultiQueryRetriever:提升向量数据库检索效果的强大工具

nseejrukjhad

数据库python

深入理解MultiQueryRetriever:提升向量数据库检索效果的强大工具引言在人工智能和自然语言处理领域,高效准确的信息检索一直是一个关键挑战。传统的基于距离的向量数据库检索方法虽然广泛应用,但仍存在一些局限性。本文将介绍一种创新的解决方案:MultiQueryRetriever,它通过自动生成多个查询视角来增强检索效果,提高结果的相关性和多样性。MultiQueryRetriever的工

- 自然语言处理_tf-idf

_feivirus_

算法机器学习和数学自然语言处理tf-idf逆文档频率词频

importpandasaspdimportmath1.数据预处理docA="Thecatsatonmyface"docB="Thedogsatonmybed"wordsA=docA.split("")wordsB=docB.split("")wordsSet=set(wordsA).union(set(wordsB))print(wordsSet){'on','my','face','sat',

- 免费的GPT可在线直接使用(一键收藏)

kkai人工智能

gpt

1、LuminAI(https://kk.zlrxjh.top)LuminAI标志着一款融合了星辰大数据模型与文脉深度模型的先进知识增强型语言处理系统,旨在自然语言处理(NLP)的技术开发领域发光发热。此系统展现了卓越的语义把握与内容生成能力,轻松驾驭多样化的自然语言处理任务。VisionAI在NLP界的应用领域广泛,能够胜任从机器翻译、文本概要撰写、情绪分析到问答等众多任务。通过对大量文本数据的

- 推荐3家毕业AI论文可五分钟一键生成!文末附免费教程!

小猪包333

写论文人工智能AI写作深度学习计算机视觉

在当前的学术研究和写作领域,AI论文生成器已经成为许多研究人员和学生的重要工具。这些工具不仅能够帮助用户快速生成高质量的论文内容,还能进行内容优化、查重和排版等操作。以下是三款值得推荐的AI论文生成器:千笔-AIPassPaper、懒人论文以及AIPaperPass。千笔-AIPassPaper千笔-AIPassPaper是一款基于深度学习和自然语言处理技术的AI写作助手,旨在帮助用户快速生成高质

- AI论文题目生成器怎么用?9款论文写作网站简单3步搞定

小猪包333

写论文人工智能深度学习计算机视觉

在当今信息爆炸的时代,AI写作工具的出现极大地提高了写作效率和质量。本文将详细介绍9款优秀的论文写作网站,并重点推荐千笔-AIPassPaper。一、千笔-AIPassPaper千笔-AIPassPaper是一款功能强大的AI论文生成器,基于最新的自然语言处理技术,能够一键生成高质量的毕业论文、开题报告等文本内容。它不仅提供智能选题、文献推荐和论文润色等功能,还具有较高的用户评价。其文献综述生成功

- AI大模型的架构演进与最新发展

季风泯灭的季节

AI大模型应用技术二人工智能架构

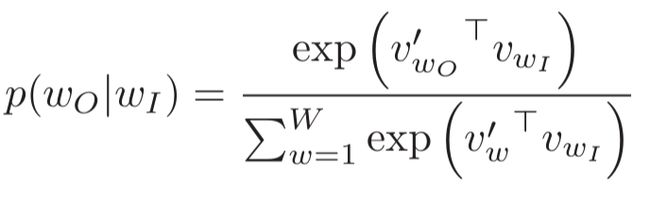

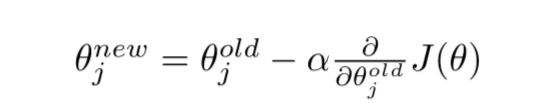

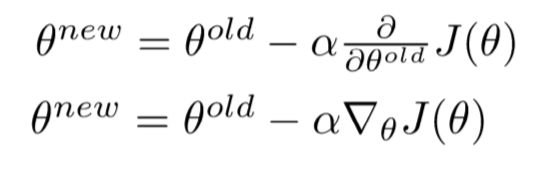

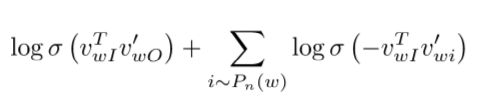

随着深度学习的发展,AI大模型(LargeLanguageModels,LLMs)在自然语言处理、计算机视觉等领域取得了革命性的进展。本文将详细探讨AI大模型的架构演进,包括从Transformer的提出到GPT、BERT、T5等模型的历史演变,并探讨这些模型的技术细节及其在现代人工智能中的核心作用。一、基础模型介绍:Transformer的核心原理Transformer架构的背景在Transfo

- FlagEmbedding

吉小雨

python库python

FlagEmbedding教程FlagEmbedding是一个用于生成文本嵌入(textembeddings)的库,适合处理自然语言处理(NLP)中的各种任务。嵌入(embeddings)是将文本表示为连续向量,能够捕捉语义上的相似性,常用于文本分类、聚类、信息检索等场景。官方文档链接:FlagEmbedding官方GitHub一、FlagEmbedding库概述1.1什么是FlagEmbeddi

- 【NumPy】深入解析numpy.zeros()函数

二七830

numpy

欢迎莅临我的个人主页这里是我深耕Python编程、机器学习和自然语言处理(NLP)领域,并乐于分享知识与经验的小天地!博主简介:我是二七830,一名对技术充满热情的探索者。多年的Python编程和机器学习实践,使我深入理解了这些技术的核心原理,并能够在实际项目中灵活应用。尤其是在NLP领域,我积累了丰富的经验,能够处理各种复杂的自然语言任务。技术专长:我熟练掌握Python编程语言,并深入研究了机

- Humanize 项目教程

尤嫒冰

Humanize项目教程humanizeAJSlibraryforaddinga“humantouch”todata.项目地址:https://gitcode.com/gh_mirrors/humani/humanize项目介绍Humanize是一个开源项目,旨在将机器生成的文本转换为更加自然、人性化的文本。该项目通过先进的算法和自然语言处理技术,使得AI生成的内容更加贴近人类的表达方式,从而提高

- 全自动解密解码神器 — Ciphey

K'illCode

python_模块pythonvscode

Ciphey是一个使用自然语言处理和人工智能的全自动解密/解码/破解工具。简单地来讲,你只需要输入加密文本,它就能给你返回解密文本。就是这么牛逼。有了Ciphey,你根本不需要知道你的密文是哪种类型的加密,你只知道它是加密的,那么Ciphey就能在3秒甚至更短的时间内给你解密,返回你想要的大部分密文的答案。下面就给大家介绍Ciphey的实战使用教程。1.准备开始之前,你要确保Python和pip已

- CV、NLP、数据控掘推荐、量化

海的那边-

AI算法自然语言处理人工智能

下面是对CV(计算机视觉)、NLP(自然语言处理)、数据挖掘推荐和量化的简要概述及其应用领域的介绍:1.CV(计算机视觉,ComputerVision)定义:计算机视觉是一门让计算机能够从图像或视频中提取有用信息,并做出决策的学科。它通过模拟人类的视觉系统来识别、处理和理解视觉信息。主要任务:图像分类:识别图像中的物体并分类,比如猫、狗、车等。目标检测:在图像或视频中定位并识别多个对象,如人脸检测

- 深度解析:如何使用输出解析器将大型语言模型(LLM)的响应解析为结构化JSON格式

m0_57781768

语言模型json人工智能

深度解析:如何使用输出解析器将大型语言模型(LLM)的响应解析为结构化JSON格式在现代自然语言处理(NLP)的应用中,大型语言模型(LLM)已经成为了重要的工具。这些模型能够生成丰富的自然语言文本,适用于各种应用场景。然而,在某些应用中,开发者不仅仅需要生成文本,还需要将这些生成的文本转换为结构化的数据格式,例如JSON。这种结构化的数据格式在数据传输、存储以及进一步处理时具有显著优势。本文将深

- 深入探讨:如何在Python中通过LangChain技术精准追踪大型语言模型(LLM)的Token使用情况

m0_57781768

pythonlangchain语言模型

深入探讨:如何在Python中通过LangChain技术精准追踪大型语言模型(LLM)的Token使用情况在现代的人工智能开发中,大型语言模型(LLM)已经成为了不可或缺的工具,无论是用于自然语言处理、对话生成,还是其他复杂的文本生成任务。然而,随着这些模型的广泛应用,开发者面临的一个重要挑战是如何有效地追踪和管理Token的使用情况,特别是在生产环境中,Token的使用直接影响着API调用的成本

- 使用最大边际相关性(MMR)选择示例:提高AI模型的多样性和相关性

aehrutktrjk

人工智能easyui前端python

使用最大边际相关性(MMR)选择示例:提高AI模型的多样性和相关性引言在机器学习和自然语言处理领域,选择合适的训练示例对模型性能至关重要。最大边际相关性(MaximalMarginalRelevance,MMR)是一种优秀的示例选择方法,它不仅考虑了示例与输入的相关性,还注重保持所选示例之间的多样性。本文将深入探讨如何使用MMR来选择示例,以提高AI模型的性能和泛化能力。什么是最大边际相关性(MM

- 使用LangChain和OpenAI实现高效文本标注

aehrutktrjk

langchainpython

使用LangChain和OpenAI实现高效文本标注引言在自然语言处理(NLP)领域,文本标注是一项重要且常见的任务。它涉及为文本分配标签,如情感、语言、风格等。本文将介绍如何使用LangChain和OpenAI的API来实现高效的文本标注系统。我们将探讨如何设置环境、定义标注模式,以及如何使用OpenAI的模型来执行标注任务。环境准备首先,我们需要安装必要的库并设置API密钥:%pipinsta

- 基于深度学习的文本引导的图像编辑

SEU-WYL

深度学习dnn深度学习人工智能

基于深度学习的文本引导的图像编辑(Text-GuidedImageEditing)是一种通过自然语言文本指令对图像进行编辑或修改的技术。它结合了图像生成和自然语言处理(NLP)的最新进展,使用户能够通过描述性文本对图像内容进行精确的调整和操控。1.文本引导的图像编辑的挑战文本和图像之间的对齐:如何将文本中的语义信息准确地映射到图像中的特定区域或元素是一个关键挑战。这涉及到多模态数据的对齐和理解。编

- 多模态Transformer之文本与图像联合建模 - Transformer教程

shandianfk_com

ChatGPTTransformertransformer深度学习人工智能

大家好,今天我们来聊聊一个既前沿又有趣的话题——多模态Transformer,特别是文本与图像的联合建模。对于很多小伙伴来说,Transformer这个词已经不陌生了,但它不仅仅应用于自然语言处理,还能在图像处理、甚至是多模态数据的处理上大显身手。接下来,我会带大家深入了解什么是多模态Transformer,以及它是如何实现文本与图像的联合建模的。Transformer简介首先,我们简单回顾一下T

- 什么是AIGC?有哪些免费工具?

chent_某位

AIGC

AIGC(AIGeneratedContent),即“人工智能生成内容”,是指通过人工智能技术自动生成各种类型的数字内容。AIGC让机器能够根据输入的信息或数据生成符合人类需求的文本、图像、音频、视频等内容,极大提高了内容创作的效率。AIGC的背景与起源随着深度学习和自然语言处理技术的快速发展,人工智能已经不再局限于简单的任务,如分类、预测和数据分析,而是具备了生成内容的能力。生成式AI模型,如O

- transformer架构(Transformer Architecture)原理与代码实战案例讲解

AI架构设计之禅

大数据AI人工智能Python入门实战计算科学神经计算深度学习神经网络大数据人工智能大型语言模型AIAGILLMJavaPython架构设计AgentRPA

transformer架构(TransformerArchitecture)原理与代码实战案例讲解关键词:Transformer,自注意力机制,编码器-解码器,预训练,微调,NLP,机器翻译作者:禅与计算机程序设计艺术/ZenandtheArtofComputerProgramming1.背景介绍1.1问题的由来自然语言处理(NLP)领域的发展经历了从规则驱动到统计驱动再到深度学习驱动的三个阶段。

- 英伟达(NVIDIA)B200架构解读

weixin_41205263

芯际争霸GPGPU架构gpu算力人工智能硬件架构

H100芯片是一款高性能AI芯片,其中的TransformerEngine是专门用于加速Transformer模型计算的核心部件。Transformer模型是一种自然语言处理(NLP)模型,广泛应用于机器翻译、文本生成等任务。TransformerEngine的电路设计原理主要包括以下几个方面:

- 使用LangChain与Together AI模型交互:深入探讨和实践指南

llzwxh888

langchain人工智能交互python

使用LangChain与TogetherAI模型交互:深入探讨和实践指南1.引言在人工智能和自然语言处理领域,TogetherAI已经成为一个强大的平台,提供了对50多个领先开源模型的访问。本文将深入探讨如何使用LangChain与TogetherAI模型进行交互,为开发者提供实用的知识和见解,同时解决可能遇到的常见问题。2.TogetherAI简介TogetherAI是一个强大的API平台,允许

- OpenLM: 一个灵活的开源大语言模型接口工具

llzwxh888

语言模型人工智能自然语言处理python

OpenLM:一个灵活的开源大语言模型接口工具引言在人工智能和自然语言处理快速发展的今天,大语言模型(LLM)已经成为许多应用的核心。然而,不同的LLM提供商往往有着各自的API和使用方式,这给开发者带来了一定的挑战。本文将介绍OpenLM,这是一个零依赖、兼容OpenAIAPI的LLM提供者接口,它可以直接通过HTTP调用不同的推理端点。我们将深入探讨OpenLM的特性、使用方法,以及如何将其与

- 使用中专API实现AI模型调用与部署

llzwxh888

人工智能easyui前端python

在AI技术领域,如何调用和部署大语言模型(LLM)是一个常见的需求。本文将详细介绍如何通过中专API地址http://api.wlai.vip,实现对OpenAI大模型的调用与部署,并提供一个详细的demo代码示例。引言随着人工智能技术的飞速发展,大语言模型在自然语言处理任务中的表现尤为突出。然而,由于国内访问海外API存在一定限制,本文将使用中专API地址来解决这一问题,并展示如何在本地环境中配

- 深度学习入门篇:PyTorch实现手写数字识别

AI_Guru人工智能

深度学习pytorch人工智能

深度学习作为机器学习的一个分支,近年来在图像识别、自然语言处理等领域取得了显著的成就。在众多的深度学习框架中,PyTorch以其动态计算图、易用性强和灵活度高等特点,受到了广泛的喜爱。本篇文章将带领大家使用PyTorch框架,实现一个手写数字识别的基础模型。手写数字识别简介手写数字识别是计算机视觉领域的一个经典问题,目的是让计算机能够识别并理解手写数字图像。这个问题通常作为深度学习入门的练习,因为

- 基于人工智能的智能语音助手

人工智能发烧友

人工智能

语音助手的自然语言处理模块是语音助手系统的关键组成部分。通过这个模块,系统能够识别用户的意图并做出相应的回应。我们可以使用NLP技术来解析文本输入,并将其转换为系统可以理解的命令或指令。在本项目中,我们将结合语音识别、自然语言处理和语音合成技术,构建一个功能简化的语音助手。一、项目背景与需求分析1.1项目目标本项目旨在创建一个语音助手系统,它可以:1.语音识别:从用户的语音输入中提取文本信息。2.

- 深入掌握大模型精髓:《实战AI大模型》带你全面理解大模型开发!

努力的光头强

人工智能langchainprompttransformer深度学习

今天,人工智能技术的快速发展和广泛应用已经引起了大众的关注和兴趣,它不仅成为技术发展的核心驱动力,更是推动着社会生活的全方位变革。特别是作为AI重要分支的深度学习,通过不断刷新的表现力已引领并定义了一场科技革命。大型深度学习模型(简称AI大模型)以其强大的表征能力和卓越的性能,在自然语言处理、计算机视觉、推荐系统等领域均取得了突破性的进展。尤其随着AI大模型的广泛应用,无数领域因此受益。AI大模型

- 安装jina,并使用jina的向量化和重排序的功能

MonkeyKing.sun

milvusnumpy

为了在Python的FastAPI项目中使用Jina进行向量化和重排序,您需要按照以下步骤安装和使用Jina。1.安装Jina首先,确保您已经安装了Jina。可以使用pip来安装。pipinstalljina如果需要特定的功能模块,例如自然语言处理相关的向量化模型,可以通过JinaHub获取。pipinstalljina[hub]2.在FastAPI项目中集成Jina接下来,我们将Jina集成到F

- Matlab,Python,Java,C++的比较

Codefengfeng

pythonjavac++

Matlabmatlab是一个大型计算机,擅长矩阵计算与科学计算,适合构建模型;然而,编译软件的运行效率低,不适合大型软件开发。Pythonpython的优势是简单,入门快。适合做数据挖掘、数据分析、机器学习、人工智能、自然语言处理、爬虫、批量文件处理等,此外,Python开源免费,有很多的库,开发环境开发社区都比较友好;不过,Python是动态型的语言,需要更多的测试,并且错误仅仅是在运行的时候

- 书其实只有三类

西蜀石兰

类

一个人一辈子其实只读三种书,知识类、技能类、修心类。

知识类的书可以让我们活得更明白。类似十万个为什么这种书籍,我一直不太乐意去读,因为单纯的知识是没法做事的,就像知道地球转速是多少一样(我肯定不知道),这种所谓的知识,除非用到,普通人掌握了完全是一种负担,维基百科能找到的东西,为什么去记忆?

知识类的书,每个方面都涉及些,让自己显得不那么没文化,仅此而已。社会认为的学识渊博,肯定不是站在

- 《TCP/IP 详解,卷1:协议》学习笔记、吐槽及其他

bylijinnan

tcp

《TCP/IP 详解,卷1:协议》是经典,但不适合初学者。它更像是一本字典,适合学过网络的人温习和查阅一些记不清的概念。

这本书,我看的版本是机械工业出版社、范建华等译的。这本书在我看来,翻译得一般,甚至有明显的错误。如果英文熟练,看原版更好:

http://pcvr.nl/tcpip/

下面是我的一些笔记,包括我看书时有疑问的地方,也有对该书的吐槽,有不对的地方请指正:

1.

- Linux—— 静态IP跟动态IP设置

eksliang

linuxIP

一.在终端输入

vi /etc/sysconfig/network-scripts/ifcfg-eth0

静态ip模板如下:

DEVICE="eth0" #网卡名称

BOOTPROTO="static" #静态IP(必须)

HWADDR="00:0C:29:B5:65:CA" #网卡mac地址

IPV6INIT=&q

- Informatica update strategy transformation

18289753290

更新策略组件: 标记你的数据进入target里面做什么操作,一般会和lookup配合使用,有时候用0,1,1代表 forward rejected rows被选中,rejected row是输出在错误文件里,不想看到reject输出,将错误输出到文件,因为有时候数据库原因导致某些column不能update,reject就会output到错误文件里面供查看,在workflow的

- 使用Scrapy时出现虽然队列里有很多Request但是却不下载,造成假死状态

酷的飞上天空

request

现象就是:

程序运行一段时间,可能是几十分钟或者几个小时,然后后台日志里面就不出现下载页面的信息,一直显示上一分钟抓取了0个网页的信息。

刚开始已经猜到是某些下载线程没有正常执行回调方法引起程序一直以为线程还未下载完成,但是水平有限研究源码未果。

经过不停的google终于发现一个有价值的信息,是给twisted提出的一个bugfix

连接地址如下http://twistedmatrix.

- 利用预测分析技术来进行辅助医疗

蓝儿唯美

医疗

2014年,克利夫兰诊所(Cleveland Clinic)想要更有效地控制其手术中心做膝关节置换手术的费用。整个系统每年大约进行2600例此类手术,所以,即使降低很少一部分成本,都可以为诊 所和病人节约大量的资金。为了找到适合的解决方案,供应商将视野投向了预测分析技术和工具,但其分析团队还必须花时间向医生解释基于数据的治疗方案意味着 什么。

克利夫兰诊所负责企业信息管理和分析的医疗

- java 线程(一):基础篇

DavidIsOK

java多线程线程

&nbs

- Tomcat服务器框架之Servlet开发分析

aijuans

servlet

最近使用Tomcat做web服务器,使用Servlet技术做开发时,对Tomcat的框架的简易分析:

疑问: 为什么我们在继承HttpServlet类之后,覆盖doGet(HttpServletRequest req, HttpServetResponse rep)方法后,该方法会自动被Tomcat服务器调用,doGet方法的参数有谁传递过来?怎样传递?

分析之我见: doGet方法的

- 揭秘玖富的粉丝营销之谜 与小米粉丝社区类似

aoyouzi

揭秘玖富的粉丝营销之谜

玖富旗下悟空理财凭借着一个微信公众号上线当天成交量即破百万,第七天成交量单日破了1000万;第23天时,累计成交量超1个亿……至今成立不到10个月,粉丝已经超过500万,月交易额突破10亿,而玖富平台目前的总用户数也已经超过了1800万,位居P2P平台第一位。很多互联网金融创业者慕名前来学习效仿,但是却鲜有成功者,玖富的粉丝营销对外至今仍然是个谜。

近日,一直坚持微信粉丝营销

- Java web的会话跟踪技术

百合不是茶

url会话Cookie会话Seession会话Java Web隐藏域会话

会话跟踪主要是用在用户页面点击不同的页面时,需要用到的技术点

会话:多次请求与响应的过程

1,url地址传递参数,实现页面跟踪技术

格式:传一个参数的

url?名=值

传两个参数的

url?名=值 &名=值

关键代码

- web.xml之Servlet配置

bijian1013

javaweb.xmlServlet配置

定义:

<servlet>

<servlet-name>myservlet</servlet-name>

<servlet-class>com.myapp.controller.MyFirstServlet</servlet-class>

<init-param>

<param-name>

- 利用svnsync实现SVN同步备份

sunjing

SVN同步E000022svnsync镜像

1. 在备份SVN服务器上建立版本库

svnadmin create test

2. 创建pre-revprop-change文件

cd test/hooks/

cp pre-revprop-change.tmpl pre-revprop-change

3. 修改pre-revprop-

- 【分布式数据一致性三】MongoDB读写一致性

bit1129

mongodb

本系列文章结合MongoDB,探讨分布式数据库的数据一致性,这个系列文章包括:

数据一致性概述与CAP

最终一致性(Eventually Consistency)

网络分裂(Network Partition)问题

多数据中心(Multi Data Center)

多个写者(Multi Writer)最终一致性

一致性图表(Consistency Chart)

数据

- Anychart图表组件-Flash图转IMG普通图的方法

白糖_

Flash

问题背景:项目使用的是Anychart图表组件,渲染出来的图是Flash的,往往一个页面有时候会有多个flash图,而需求是让我们做一个打印预览和打印功能,让多个Flash图在一个页面上打印出来。

那么我们打印预览的思路是获取页面的body元素,然后在打印预览界面通过$("body").append(html)的形式显示预览效果,结果让人大跌眼镜:Flash是

- Window 80端口被占用 WHY?

bozch

端口占用window

平时在启动一些可能使用80端口软件的时候,会提示80端口已经被其他软件占用,那一般又会有那些软件占用这些端口呢?

下面坐下总结:

1、web服务器是最经常见的占用80端口的,例如:tomcat , apache , IIS , Php等等;

2

- 编程之美-数组的最大值和最小值-分治法(两种形式)

bylijinnan

编程之美

import java.util.Arrays;

public class MinMaxInArray {

/**

* 编程之美 数组的最大值和最小值 分治法

* 两种形式

*/

public static void main(String[] args) {

int[] t={11,23,34,4,6,7,8,1,2,23};

int[]

- Perl正则表达式

chenbowen00

正则表达式perl

首先我们应该知道 Perl 程序中,正则表达式有三种存在形式,他们分别是:

匹配:m/<regexp>;/ (还可以简写为 /<regexp>;/ ,略去 m)

替换:s/<pattern>;/<replacement>;/

转化:tr/<pattern>;/<replacemnt>;

- [宇宙与天文]行星议会是否具有本行星大气层以外的权力呢?

comsci

举个例子: 地球,地球上由200多个国家选举出一个代表地球联合体的议会,那么现在地球联合体遇到一个问题,地球这颗星球上面的矿产资源快要采掘完了....那么地球议会全体投票,一致通过一项带有法律性质的议案,既批准地球上的国家用各种技术手段在地球以外开采矿产资源和其它资源........

&

- Oracle Profile 使用详解

daizj

oracleprofile资源限制

Oracle Profile 使用详解 转

一、目的:

Oracle系统中的profile可以用来对用户所能使用的数据库资源进行限制,使用Create Profile命令创建一个Profile,用它来实现对数据库资源的限制使用,如果把该profile分配给用户,则该用户所能使用的数据库资源都在该profile的限制之内。

二、条件:

创建profile必须要有CREATE PROFIL

- How HipChat Stores And Indexes Billions Of Messages Using ElasticSearch & Redis

dengkane

elasticsearchLucene

This article is from an interview with Zuhaib Siddique, a production engineer at HipChat, makers of group chat and IM for teams.

HipChat started in an unusual space, one you might not

- 循环小示例,菲波拉契序列,循环解一元二次方程以及switch示例程序

dcj3sjt126com

c算法

# include <stdio.h>

int main(void)

{

int n;

int i;

int f1, f2, f3;

f1 = 1;

f2 = 1;

printf("请输入您需要求的想的序列:");

scanf("%d", &n);

for (i=3; i<n; i

- macbook的lamp环境

dcj3sjt126com

lamp

sudo vim /etc/apache2/httpd.conf

/Library/WebServer/Documents

是默认的网站根目录

重启Mac上的Apache服务

这个命令很早以前就查过了,但是每次使用的时候还是要在网上查:

停止服务:sudo /usr/sbin/apachectl stop

开启服务:s

- java ArrayList源码 下

shuizhaosi888

ArrayList源码

版本 jdk-7u71-windows-x64

JavaSE7 ArrayList源码上:http://flyouwith.iteye.com/blog/2166890

/**

* 从这个列表中移除所有c中包含元素

*/

public boolean removeAll(Collection<?> c) {

- Spring Security(08)——intercept-url配置

234390216

Spring Securityintercept-url访问权限访问协议请求方法

intercept-url配置

目录

1.1 指定拦截的url

1.2 指定访问权限

1.3 指定访问协议

1.4 指定请求方法

1.1 &n

- Linux环境下的oracle安装

jayung

oracle

linux系统下的oracle安装

本文档是Linux(redhat6.x、centos6.x、redhat7.x) 64位操作系统安装Oracle 11g(Oracle Database 11g Enterprise Edition Release 11.2.0.4.0 - 64bit Production),本文基于各种网络资料精心整理而成,共享给有需要的朋友。如有问题可联系:QQ:52-7

- hotspot虚拟机

leichenlei

javaHotSpotjvm虚拟机文档

JVM参数

http://docs.oracle.com/javase/6/docs/technotes/guides/vm/index.html

JVM工具

http://docs.oracle.com/javase/6/docs/technotes/tools/index.html

JVM垃圾回收

http://www.oracle.com

- 读《Node.js项目实践:构建可扩展的Web应用》 ——引编程慢慢变成系统化的“砌砖活”

noaighost

Webnode.js

读《Node.js项目实践:构建可扩展的Web应用》

——引编程慢慢变成系统化的“砌砖活”

眼里的Node.JS

初初接触node是一年前的事,那时候年少不更事。还在纠结什么语言可以编写出牛逼的程序,想必每个码农都会经历这个月经性的问题:微信用什么语言写的?facebook为什么推荐系统这么智能,用什么语言写的?dota2的外挂这么牛逼,用什么语言写的?……用什么语言写这句话,困扰人也是阻碍

- 快速开发Android应用

rensanning

android

Android应用开发过程中,经常会遇到很多常见的类似问题,解决这些问题需要花时间,其实很多问题已经有了成熟的解决方案,比如很多第三方的开源lib,参考

Android Libraries 和

Android UI/UX Libraries。

编码越少,Bug越少,效率自然会高。

但可能由于 根本没听说过、听说过但没用过、特殊原因不能用、自己已经有了解决方案等等原因,这些成熟的解决

- 理解Java中的弱引用

tomcat_oracle

java工作面试

不久之前,我

面试了一些求职Java高级开发工程师的应聘者。我常常会面试他们说,“你能给我介绍一些Java中得弱引用吗?”,如果面试者这样说,“嗯,是不是垃圾回收有关的?”,我就会基本满意了,我并不期待回答是一篇诘究本末的论文描述。 然而事与愿违,我很吃惊的发现,在将近20多个有着平均5年开发经验和高学历背景的应聘者中,居然只有两个人知道弱引用的存在,但是在这两个人之中只有一个人真正了

- 标签输出html标签" target="_blank">关于标签输出html标签

xshdch

jsp

http://back-888888.iteye.com/blog/1181202

关于<c:out value=""/>标签的使用,其中有一个属性是escapeXml默认是true(将html标签当做转移字符,直接显示不在浏览器上面进行解析),当设置escapeXml属性值为false的时候就是不过滤xml,这样就能在浏览器上解析html标签,

&nb