新手入门:感知器

感知机定义:

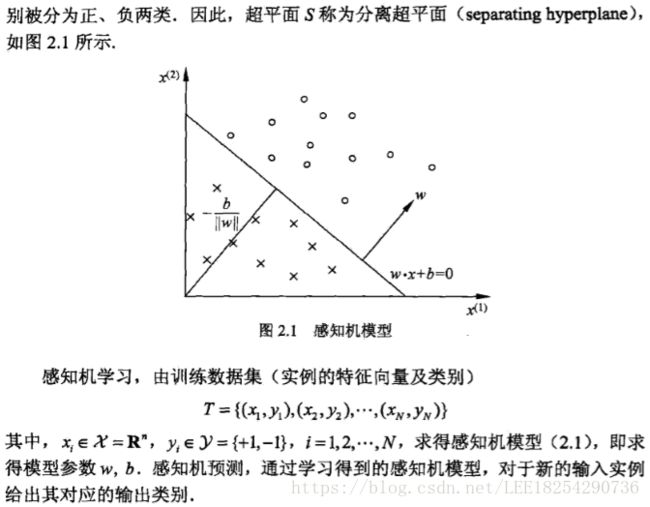

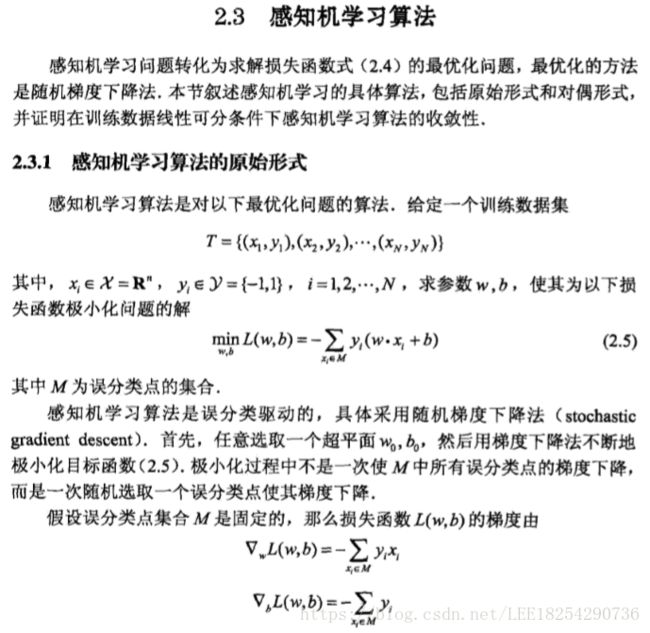

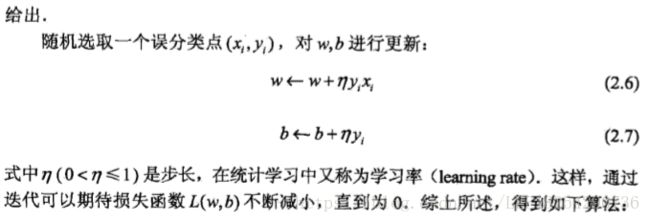

二分类线性分类模型,其输入为实例的特征向量,输出为实例的类别,取+1或者-1值。

简单来说,就是在平面坐标轴画一条直线,把点分为两类。

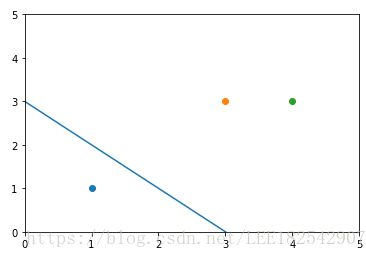

例如下面的图:

下面是运行程序,只考虑了最简单的模型的实现,针对上面的例题

# -*- coding: utf-8 -*-

"""

Created on Mon Aug 27 15:11:52 2018

@author: zlee

@感知机学习算法的原始形式

"""

import matplotlib.pyplot as plt

from pylab import plot

import numpy as np

#将要进行处理的点数据集合

x = [[3,3],[4,3],[1,1]]

y = [1,1,-1]

#方程的系数

w=[0,0]

b=0

alpha = 1

sign = 0

#sgn函数

def sgn(x):

if x > 0:

return 1

else :

return -1

#进行求解超平面

while sign == 0 :

sign = 1

for i in range(0,len(x)):

while (sgn(np.dot(w,x[i]) + b) != y[i]):

w[0] = w[0] + alpha * y[i] * x[i][0]

w[1] = w[1] + alpha * y[i] * x[i][1]

b = b + alpha * y[i]

sign = 0

print(w)

print(b)

ascent = -w[0]/w[1]#斜率

intercept = -b/w[1]#截距

x = np.linspace(0,5,50)

y = ascent * x + intercept

#折线图绘制函数

plt.axis([0,5,0,5])#设置边界范围

plt.scatter(1,1)#画出点

plt.scatter(3,3)

plt.scatter(4,3)

plt.plot(x,y)#连成线

plt.show()

可以看到w为[1,1],b为-3.

神经网络的基础模型:输入层,隐含层,输出层。

下面是最简单的拓扑模型

这个图代表输入输出两层神经元的简单连接。这里有n个神经元代表输入口。

总的加权和就是每个点Xi与其权重Wi的乘积,如下式所示:

我们一般采用符号函数sgn(x)来当作单层感知器的传递函数,即输出:

即可转化为:

单层感知器其局限性:

因为处理函数是线性的,所以中间怎么处理都是线性的,最后的结果能表示的范围也是很小的,它毕竟不是非线性的。

由于它只有一层功能神经元,所以学习能力非常有限。

为此我们引入激活函数,来加入非线性的函数处理,这样最后的处理结果可以变化为多种非线性的结果,拟合效果更加好。

单层感知机不能表示异或逻辑:

https://blog.csdn.net/panda07100/article/details/38580993

我们通常将多层感知机这样的多层结构称之为是神经网络