hadoop详细安装及配置

一、下载

http://hadoop.apache.org/ hadoop官网

二、解压

注:使用管理员权限解压

三、配置环境变量

添加HADOOP_HOME配置:自己安装hadoop路径,我的是D:\hadoop-3.0.3

在Path中添加如下:自己安装hadoop路径/bin,如:D:/hadoop-3.0.3/bin

四、hadoop需要jdk支持,jdk路径不能有空格,如有空格,可以这样,如:”D:\Program Files"\Java\jdk1.8.0_25

五、hadoop路径下创建data用于数据存储,再在data下创建datanode目录和namenode目录

六、hadoop配置

四个hadoop路径/etc/hadoop/core-site.xml,etc/hadoop/mapred-site.xml,etc/hadoop/hdfs-site.xml,etc/hadoop/yarn-site.xml

1.core-site.xml

fs.default.name

hdfs://localhost:9000

myeclipse上配置hadoop时,localhost需写成自己的IP

2.mapred-site.xml

mapreduce.framework.name

yarn

3.hdfs-site.xm

dfs.replication

1

dfs.permissions

false

dfs.namenode.name.dir

/D:/hadoop-3.0.3/data/namenode

fs.checkpoint.dir

/D:/hadoop-3.0.3/data/snn

fs.checkpoint.edits.dir

/D:/hadoop-3.0.3/data/snn

dfs.datanode.data.dir

/D:/hadoop-3.0.3/data/datanode

4.yarn-site.xml

yarn.nodemanager.aux-services

mapreduce_shuffle

yarn.nodemanager.auxservices.mapreduce.shuffle.class

org.apache.hadoop.mapred.ShuffleHandler

七、修改D:/hadoop-3.0.3/etc/hadoop/hadoop-env.cmd配置,找到set JAVA_HOME=%JAVA_HOME%替换为set JAVA_HOME="D:\Program Files"\Java\jdk1.8.0_25

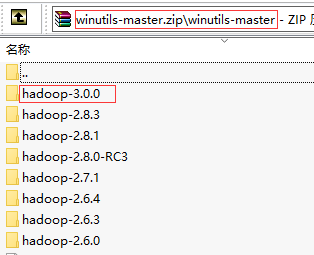

八、winutils中对应的hadoop版本中的bin替换自己hadoop安装目录下的bin

找到对应的版本下的bin替换hadoop中的bin

配置完成

九、启动服务

1.cmd中,D:\hadoop-3.0.3\bin> hdfs namenode -format

执行后,data下的namenode和datanode下会有current等文件,我当时安装的是hadoop3.1.1,用的winutils中的hadoop3.0.0,datanode总是没有启动没有数据,换成hadoop3.0.3,使用wintuils的hadoop3.0.0后,就可以了。

2.D:\hadoop-3.0.3\sbin启动start-all.cmd服务,会看到

- Hadoop Namenode

- Hadoop datanode

- YARN Resourc Manager

- YARN Node Manager

十、HDFS应用

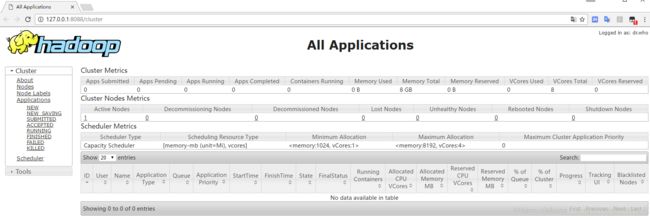

1、通过http://127.0.0.1:8088/即可查看集群所有节点状态:

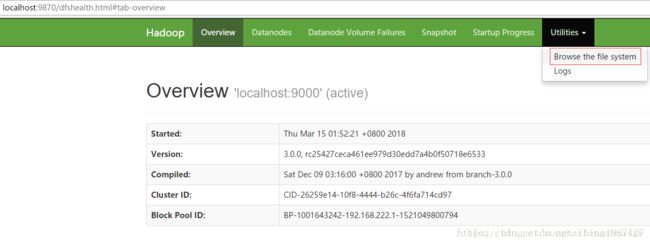

2、访问http://localhost:9870/即可查看文件管理页面:

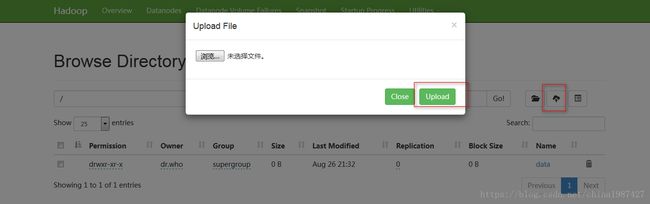

a.进入文件系统

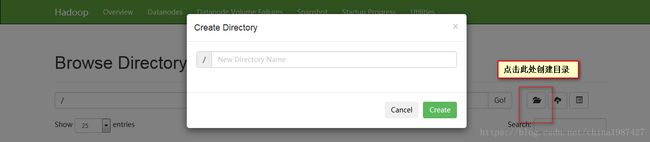

b.创建目录

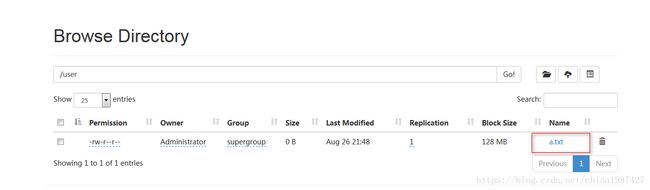

c.上传成功

注:在之前的版本中文件管理的端口是50070,在3.0.0中替换为了9870端口

d.使用hadoop命令进行文件操作

mkdir命令创建目录:hadoop fs -mkdir hdfs://ip:9000/user

put命令上传文件:hadoop fs -put D:/a.txt hdfs://ip:9000/user/

ls命令查看指定目录文件列表:hadoop fs -ls hdfs://ip:9000/user/