python3.6爬取凤凰网新闻-爬虫框架式思维

一、序言

先前几篇爬虫的代码,是简单的脚本代码。在爬取小网页觉得挺简单、高效,但涉及复杂网页的时候,就要考虑成熟的爬虫框架与分布式。本篇博客作为无框架式爬虫和有框架式爬虫的一个过渡,介绍具有框架式思维的爬虫^_^。

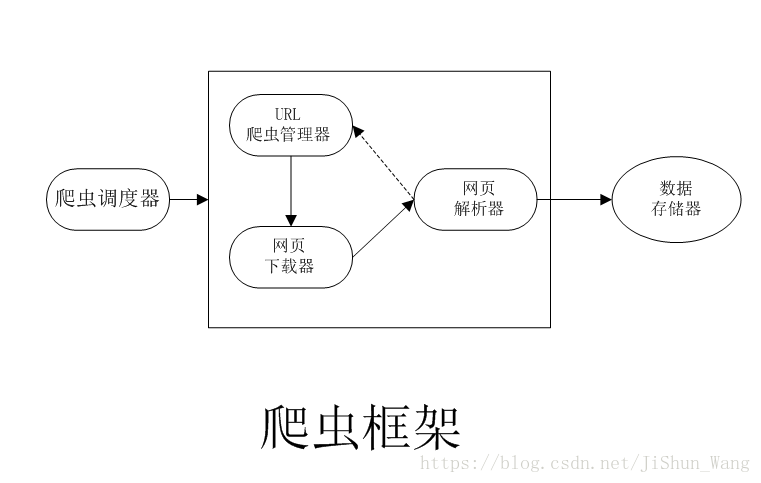

二、框架结构图

通常爬虫分为五个部分,分别为:爬虫调度器、URL管理器、网页下载器、网页解析器与数据存储器。各部分的作用如下:

| 模块名称 | 作用 |

|---|---|

| 爬虫调度器 | 统筹调度其他四个模块之间的协调工作,可以理解为爬虫框架的司令部。 |

| URL管理器 | 管理URL链接,维护新URL集合(未爬取的链接)与旧URL集合(已爬取的链接); 同时提供获取新URL链接的接口。 |

| 网页下载器 | 从URL管理器中获取未爬取的链接,并下载网页。 |

| 网页解析器 | 将网页下载器下载的网页进行解析,从中提取新的链接给URL管理器,将提取的有效数据返回给数据存储器。 |

| 数据存储器 | 将网页解析出的有效数据进行存储。 |

三、物种管理器介绍

通常写爬虫,我们先分析url,写出url管理器模块;然后写网页下载器,这个比较简单;根据url网页内容写出网页解析器模块;根据解析器的有效数据类型,选择合适的存储方式文件或者数据库。

(一)URL管理器

该模块主要维护两个变量:以爬取的URL集合和未爬取的URL集合。之所以选择集合是因为集合中元素不能重复的特点,这就给url进行了一个去重。

该模块的主要接口有:

- 判断是否有待取的URL,方法定义为has_new_url()。

- 添加新的URL到未爬取的集合中,方法定义为:add_new_url(url),add_new_urls(urls)。

- 获取未爬取的URL,方法定义为get_new_url()。

- 获取未爬取的URL集合大小,方法定义为new_url_size()。

- 获取已爬取的URL集合大小,方法定义为old_url_size()。

(二)网页下载器

该模块主要用到的库为requests,当然大家也可以根据自己需要选择urllib库等。具有的接口为:download(url)。

(三)网页解析器

用于解析的库主要用到BeautifulSoup、lxml等。提供一个parser对外的接口。

(四)数据存储器

数据存储器主要包括两个方法:store_data(data)用于将解析出来的有效数据存储到内存;output_html()用于将存储的数据输出到指定的文件或者数据库。

(五)爬虫调度器

该模块首先要初始化其他四个模块,通过crawl(root_url)方法将起始链接传入URL管理器,然后按照调度器流程执行各个模块,协调工作。

四、实战演示

介绍了爬虫框架基本的结构以及每个模块的作用和基本方法,我们拿一个网站实战演练下。选取的网站为凤凰网站的任意一个新闻链接(链接为文本,不能为视频和图片),提取其新闻标题和内容(内容格式不讲究)。我们将

http://news.ifeng.com/a/20180429/57980009_0.shtml作为root_url。

该网页的尾部有其他新闻,我们在网页解析器里面将这些链接提取出来进行爬取。

1.首先,我们根据上述所述,编写UrlManager.py(URL管理器)。

#coding = utf-8

class UrlManager(object):

def __init__(self):

self.new_urls = set() #未爬取URL集合

self.old_urls = set()#未爬取URL集合

def has_new_url(self):

'''判断是否有未爬取的URL

:return:

'''

return self.new_url_size() != 0

def get_new_url(self):

'''获取一个未爬取的URL

:return

'''

new_url = self.new_urls.pop()

self.old_urls.add(new_url)

return new_url

def add_new_url(self, url):

'''

将新的URL添加到未爬取的URL集合中

:param url:单个URL

:return:

'''

if url is None:

return

if url not in self.new_urls and url not in self.old_urls:

self.new_urls.add(url)

def add_new_urls(self, urls):

'''

将新的URL添加到未爬取的URL集合中

:param urls:url 集合

:return:

'''

if urls is None or len(urls) == 0:

return

for url in urls:

self.add_new_url(url)

def new_url_size(self):

'''

获取未爬取URL集合的大小

:return:

'''

return len(self.new_urls)

def old_url_size(self):

'''

获取已爬取URL集合的大小

:return:

'''

return len(self.old_urls)2.编写网页下载器HtmlDownloader.py

# coding:utf-8

import requests

class HtmlDownloader(object):

def download(self, url):

if url is None:

return None

user_agent = 'Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/55.0.2883.87 UBrowser/6.2.3964.2 Safari/537.36'

headers = {'User_Agent':user_agent}

try:

r = requests.get(url, headers=headers)

except Exception as e:

print(e)

if r.status_code==200:

r.encoding = 'utf-8'

return r.text

return None3.编写网页解析器

我们首先打开上述root_url网页,查找新闻标题与内容所在标记位置:

新闻内容所在位置,看下图。

所以,网页解析器HtmlParser.py代码如下:

#coding:utf-8

import re

import urllib

from bs4 import BeautifulSoup

class HtmlParser(object):

def parser(self, page_url, html_cont):

'''

用于解析网页内容,抽取URL和数据

:param page_url:下载页面的URL

:param html_cont:下载的网页内容

:return:返回URL和数据

'''

if page_url is None or html_cont is None:

return

soup = BeautifulSoup(html_cont, 'html.parser')

new_urls = self._get_new_urls(page_url, soup)

new_data = self._get_new_data(page_url, soup)

return new_urls, new_data

def _get_new_urls(self, page_url, soup):

'''

抽取新的URL集合

:param page_url:下载页面的URL

:param soup:soup

:return:返回新的URL集合

'''

new_urls = set()

#抽取符合要求的a标记

links = soup.find_all('a',href=re.compile(r'http://news.+\.shtml'))

for link in links:

#提取href属性

new_url = link['href']

#拼接成完整网址

new_full_url = urllib.parse.urljoin(page_url, new_url)

new_urls.add(new_full_url)

return new_urls

def _get_new_data(self, page_url, soup):

'''抽取有效数据

:param page_url:下载页面的URL

:param soup:soup

:return:返回有效数据

'''

try:

data = {}

print('抓取'+str(page_url))

data['url'] = page_url

title = soup.find('h1',{'id':'artical_topic'}).text

data['title'] = title

summary = soup.find('div',{'id':'main_content'}).text

#获取tag中包含的所有新闻文本内容,将结果作为Unicode字符串返回

data['summary'] = summary

return data

except:

print("链接不符合")

return None

4.编写数据存储器DataOutput.py,咱们姑且用json文件存储爬取的数据吧。

代码如下:

# coding:utf-8

import codecs, json

class DataOutput(object):

def __init__(self):

self.datas = []

def store_data(self, data):

if data is None:

return

self.datas.append(data)

def output_html(self):

fout = codecs.open('news.json','w',encoding='utf-8')

json.dump(self.datas,fp=fout,indent=4,ensure_ascii=False)#将所有数据写入文件。

SpiderMan.py5.爬虫调度器SpiderMan.py

# coding:utf-8

from DataOutput import DataOutput

from HtmlDownloader import HtmlDownloader

from HtmlParser import HtmlParser

from UrlManager import UrlManager

class SpiderMan(object):

def __init__(self):

self.manager = UrlManager()

self.downloader = HtmlDownloader()

self.parser = HtmlParser()

self.output = DataOutput()

def crawl(self, root_url):

#添加入口URL

self.manager.add_new_url(root_url)

#判断url管理器中是否有新的url,同时判断抓取多少url

while(self.manager.has_new_url() and self.manager.old_url_size()<100):

# try:

#从URL管理器获取新的url

new_url = self.manager.get_new_url()

#HTML下载器下载网页

html = self.downloader.download(new_url)

#HEML解析器抽取网页数据

new_urls, data = self.parser.parser(new_url, html)

#将抽取的url添加到URL管理器中

self.manager.add_new_urls(new_urls)

#数据存储器存储文件

self.output.store_data(data)

print("已经抓取%s个链接"%self.manager.old_url_size())

# except Exception as e:

# print(e)

# print("Crawl failed")

#数据存储器将文件输出成指定格式

self.output.output_html()

if __name__ == "__main__":

Spider_man = SpiderMan()

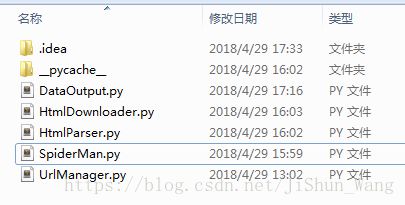

Spider_man.crawl('http://news.ifeng.com/a/20180429/57980009_0.shtml')我们将上述文件放到同一个文件夹:

然后就可以运行调度器py文件,设置爬取链接为100个,

程序运行效果。

最后我们看下news.json文件

五、结束语

本篇博客的重点是理解爬虫框架,大家可以根据自己的需要修改程序,使之符合自己的需求。

最后依然希望大家多多关注,后续更新更精彩。