RedHat6.5上安装Hadoop集群

版本号:RedHat6.5 JDK1.8 Hadoop2.7.3

hadoop 说明:从版本2开始加入了Yarn这个资源管理器,Yarn并不需要单独安装。只要在机器上安装了JDK就可以直接安装Hadoop,单纯安装Hadoop并不依赖Zookeeper之类的其他东西。

基础环境准备:

RedHat6.5安装:RHEL 6.5系统安装配置图解教程(rhel-server-6.5)

RedHat如何关闭防火墙 : http://blog.csdn.net/chongxin1/article/details/76072758

JDK安装:http://blog.csdn.net/chongxin1/article/details/68957808

1、下载hadoop 2.7.3

官网下载地址:https://dist.apache.org/repos/dist/release/hadoop/common/hadoop-2.7.3/hadoop-2.7.3.tar.gz

百度网盘下载:链接:http://pan.baidu.com/s/1eSAF7sm 密码:vdfp

2、安装3个虚拟机及配置SSH免登录

2.1安装3个机器和SSH服务

由于在这里我使用的rhel-server-6.5-x86_64-dvd.iso,安装的时候自带了ssh服务,所以省去装SSH服务。

RedHat6.5安装可参考:RHEL 6.5系统安装配置图解教程(rhel-server-6.5)

输出 ssh localhost 是否已安装ssh服务,例如Ubuntu就需要安装openssh服务。

安装3个机器,机器名称分别叫master、slave1、slave2(说明机器名不这么叫可以,待会用hostname命令修改也行)。

此处我使用的VMware虚拟机软件,直接采用克隆模式,克隆出两台新的机器。

如图:

这一步需要注意一下:

克隆完之后:

说明:为了免去后面一系列授权的麻烦,这里直接使用root账户登录和操作了。

使用ifconfig命令,查看这3个机器的IP。我的机器名和ip的对应关系是:

192.168.168.200 master

192.168.168.201 slave1

192.168.168.202 slave2

把3台机器的IP地址按上述对应关系进行配置即可。

2.2检查机器名称

为了后续操作方便,确保机器的hostname是我们想要的。拿192.168.168.200这台机器为例,用root账户登录,然后使用hostname命令查看机器名称

如图:

发现,这个机器名称不是我们想要的。不过这个好办, 我给它改个名称,命令是:

hostname master #立即生效

如图:

类似的,将其他两个机器,分别改名为slave1和slave2。

将HOSTNAME后面的值改为想要设置的主机名,然后重启即可。

类似的,将其他两个机器,分别改名为slave1和slave2。

2.3 修改/etc/hosts文件

修改这3台机器的/etc/hosts文件,在文件中添加以下内容:

192.168.168.200 master

192.168.168.201 slave1

192.168.168.202 slave2

sudo gedit /etc/hosts

如图:

配置完成后使用ping命令检查这3个机器是否相互ping得通,以master为例,在什么执行命令:

ping slave1

如图:

执行命令:

ping slave2

如图:

ping得通,说明机器是互联的,而且hosts配置也正确。

2.4配置每台机器的无密码登陆(SSH)

给3个机器生成秘钥文件

以master为例,执行命令,生成空字符串的秘钥(后面要使用公钥),命令是:

- [root@master .ssh]# ssh-keygen -t rsa -P ''

如图:

因为我现在用的是root账户,所以秘钥文件保存到了/root/.ssh/目录内,可以使用命令查看,命令是:

- ls /root/.ssh/

如图:

使用同样的方法为slave1和slave2生成秘钥(命令完全相同,不用做如何修改):

- [root@slave1 ~]# ssh-keygen -t rsa -P ''

- [root@slave2 ~]# ssh-keygen -t rsa -P ''

登录master机器,输入命令:

- [root@master ~]# cd /root/.ssh

- [root@master .ssh]# cp id_rsa.pub authorized_keys

将id_rsa.pub公钥拷贝重命名为authorized_keys文件。

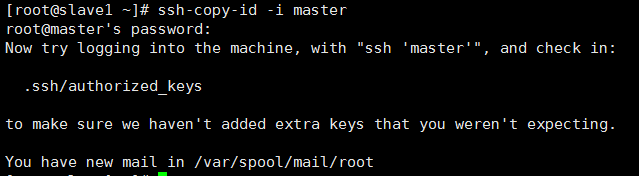

登录slave1和slave2机器,将其他主机的公钥文件内容都拷贝到master主机上的authorized_keys文件中,命令如下:

- #登录slave1,将公钥拷贝到master的authorized_keys中

- [root@slave1 ~]# ssh-copy-id -i master

- #登录slave2,将公钥拷贝到master的authorized_keys中

- [root@slave2 ~]# ssh-copy-id -i master

授权authorized_keys文件

登录master,在.ssh目录下输入命令:

- [root@master .ssh]# cd /root/.ssh

- [root@master .ssh]# chmod 600 authorized_keys

将authorized_keys文件复制到其他机器

- [root@master .ssh]# scp /root/.ssh/authorized_keys root@slave1:/root/.ssh/authorized_keys

- [root@master .ssh]# scp /root/.ssh/authorized_keys root@slave2:/root/.ssh/authorized_keys

注意第一次ssh登录时需要输入密码,再次访问时即可免密码登录。

测试连接成功的情况:

在每台机器上机器上运行:

- [root@master ~]# ssh master date

- 2017年 12月 10日 星期日 20:58:31 CST

- [root@master ~]# ssh slave1 date

- 2017年 12月 10日 星期日 20:58:31 CST

- [root@master ~]# ssh slave2 date

- 2017年 12月 10日 星期日 20:58:43 CST

至此,免密码登录已经设定完成!

3安装hadoop

说明,为了省去一系列获取管理员权限,授权等繁琐操作,精简教程,这里都是使用root账户登录并且使用root权限进行操作。

3.1 必须首先安装JDK

3.2安装hadoop

3.2.1 上传文件并解压缩

在/usr/local目录下新建一个名为hadoop的目录,并将下载得到的hadoop-2.7.3.tar.gz上传到该目录下,如图:

进入到该目录,执行命令:

mkdir /usr/local/hadoop

cd /usr/local/hadoop

执行解压命令:

tar -xvf hadoop-2.7.3.tar.gz

3.2.2新建几个目录

在/root目录下新建几个目录,复制粘贴执行下面的命令:

mkdir /usr/local/hadoop

mkdir /usr/local/hadoop/tmp

mkdir /usr/local/hadoop/var

mkdir /usr/local/hadoop/dfs

mkdir /usr/local/hadoop/dfs/name

mkdir /usr/local/hadoop/dfs/data

3.2.3 修改etc/hadoop中的一系列配置文件

修改/usr/local/hadoop/hadoop-2.7.3/etc/hadoop目录内的一系列文件。

3.2.3.1 修改core-site.xml

修改/usr/local/hadoop/hadoop-2.7.3/etc/hadoop/core-site.xml文件

在

hadoop.tmp.dir /usr/local/hadoop/tmp Abase for other temporary directories. fs.default.name hdfs://master:9000

3.2.3.2 修改hadoop-env.sh

修改/usr/local/hadoop/hadoop-2.7.3/etc/hadoop/hadoop-env.sh文件

将export JAVA_HOME=${JAVA_HOME}

修改为:

export JAVA_HOME=/usr/local/java/jdk1.8

说明:修改为自己的JDK路径

3.2.3.3 修改hdfs-site.xml

修改/usr/local/hadoop/hadoop-2.7.3/etc/hadoop/hdfs-site.xml文件

在

dfs.name.dir /usr/local/hadoop/dfs/name Path on the local filesystem where theNameNode stores the namespace and transactions logs persistently. dfs.data.dir /usr/local/hadoop/dfs/data Comma separated list of paths on the localfilesystem of a DataNode where it should store its blocks. dfs.replication 2 dfs.permissions false need not permissions

说明:dfs.permissions配置为false后,可以允许不要检查权限就生成dfs上的文件,方便倒是方便了,但是你需要防止误删除,请将它设置为true,或者直接将该property节点删除,因为默认就是true。

3.2.3.4 新建并且修改mapred-site.xml

在该版本中,有一个名为mapred-site.xml.template的文件,复制该文件,然后改名为mapred-site.xml,命令是:

- cp /usr/local/hadoop/hadoop-2.7.3/etc/hadoop/mapred-site.xml.template

- /usr/local/hadoop/hadoop-2.7.3/etc/hadoop/mapred-site.xml

修改这个新建的mapred-site.xml文件,在

mapred.job.tracker master:49001 mapred.local.dir /usr/local/hadoop/var mapreduce.framework.name yarn -

3.2.3.5 修改slaves文件

修改/usr/local/hadoop/hadoop-2.7.3/etc/hadoop/slaves文件,将里面的localhost删除,添加如下内容:

3.2.3.6 修改yarn-site.xml文件

修改/usr/local/hadoop/hadoop-2.7.3/etc/hadoop/yarn-site.xml文件,

在

yarn.resourcemanager.hostname master The address of the applications manager interface in the RM. yarn.resourcemanager.address ${yarn.resourcemanager.hostname}:8032 The address of the scheduler interface. yarn.resourcemanager.scheduler.address ${yarn.resourcemanager.hostname}:8030 The http address of the RM web application. yarn.resourcemanager.webapp.address ${yarn.resourcemanager.hostname}:8088 The https adddress of the RM web application. yarn.resourcemanager.webapp.https.address ${yarn.resourcemanager.hostname}:8090 yarn.resourcemanager.resource-tracker.address ${yarn.resourcemanager.hostname}:8031 The address of the RM admin interface. yarn.resourcemanager.admin.address ${yarn.resourcemanager.hostname}:8033 yarn.nodemanager.aux-services mapreduce_shuffle yarn.scheduler.maximum-allocation-mb 2048 每个节点可用内存,单位MB,默认8182MB yarn.nodemanager.vmem-pmem-ratio 2.1 yarn.nodemanager.resource.memory-mb 2048 yarn.nodemanager.vmem-check-enabled false

说明:yarn.nodemanager.vmem-check-enabled这个的意思是忽略虚拟内存的检查,如果你是安装在虚拟机上,这个配置很有用,配上去之后后续操作不容易出问题。如果是实体机上,并且内存够多,可以将这个配置去掉。

3.3配置环境变量

修改相应的配置文件:

sudo gedit /etc/profile

增加如下内容:

- #set Hadoop enviroment

- export HADOOP_HOME=/usr/local/hadoop/hadoop-2.7.3

- export PATH=$HADOOP_HOME/bin:$HADOOP_HOME/sbin:$PATH

- export HADOOP_CONF_DIR=$HADOOP_HOME/etc/hadoop

- export YARN_CONF_DIR=$HADOOP_HOME/etc/hadoop

使配置文件立即生效

source /etc/profile

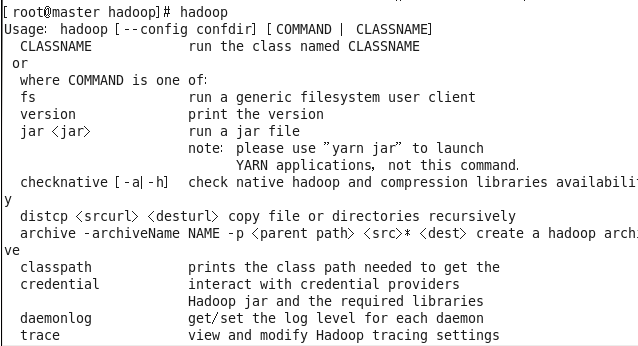

输入命令:hadoop 即可验证是否生效:

3.4 slave节点的Hadoop安装

SLAVE节点:

(1)复制master节点的hadoop文件夹到slave上:

scp -r /usr/local/hadoop root@slave1:/usr/local

scp -r /usr/local/hadoop root@slave2:/usr/local

(2)修改/etc/profile:

过程如 3.3配置master 一样

4启动hadoop

4.1在namenode上执行初始化

因为master是namenode,slave1和slave2都是datanode,所以只需要对master进行初始化操作,也就是对hdfs进行格式化。

进入到master这台机器的/usr/local/hadoop/hadoop-2.7.3/bin目录,也就是执行命令:

cd /usr/local/hadoop/hadoop-2.7.3/bin

执行初始化脚本,也就是执行命令:

./hadoop namenode -format

如图:

稍等几秒,不报错的话,即可执行成功,如图:

格式化成功后,可以在看到在/usr/local/hadoop/dfs/name/目录多了一个current目录,而且该目录内有一系列文件

4.2在namenode上执行启动命令

因为master是namenode,slave1和slave2都是datanode,所以只需要再master上执行启动命令即可。

进入到master这台机器的/usr/local/hadoop/hadoop-2.7.3/sbin目录,也就是执行命令:

cd /usr/local/hadoop/hadoop-2.7.3/sbin

执行初始化脚本,也就是执行命令:

./start-all.sh

第一次执行上面的启动命令,会需要我们进行交互操作,在问答界面上输入yes回车

如图:

5测试hadoop

master是我们的namanode,该机器的IP是192.168.168.200,在浏览器访问如下地址:

http://192.168.168.200:50070

在浏览器里访问如下地址:http://192.168.168.200:8088

自动跳转到了cluster页面

如图:

参考资料:http://blog.csdn.net/pucao_cug/article/details/71698903