Tensorflow学习之MNIST数据集

前言:

最近有段时间没学习了,主要是MNIST数据集这一节的代码很多错误,比较难调试,而且每次报的错误还不一样,在网上百度又尝试了好多种解决办法最后才解决,挺烦的。还有就是自己本来选的人工智能方向,但是导师在这个方向貌似资源比较少,估计开学了就准备换个硬件方向了,一直都在怀疑自己还应不应该继续学Tensflow。最后就是,自己这段时间超级想买个Ipad Pro,也不知道是怎么会使,感觉跟有毒一样,本来钱就少但是就是想买,就天天在看能不能等到便宜的Ipad Pro。总是有很多事情影响学习啊!!!

言归正传

本节学习的内容:搭建神经网络,在 minist 数据集上训练模型,输出手写数字识别准确率。

mnist 数据集

包含7万张黑底白字手写数字图片,其中55000张为训练集,5000张为验证集,10000张为测试集。每张图片大小为 28x28 像素,图片中纯黑色的像素值为0,纯白色像素值为1。数据集的标签是长度为10的一维数组,数组中每个元素索引号表示对应数字出现的概率。我们将 mnist 数据集中的数据喂入神经网络之前,把数据集中的每张图像的像素用长度是 784 的一维数组来代替,这样再将这个数组作为神经网络的输入特征喂入神经网络。

使用 input_data 模块中的 read_data_sets() 函数加载 minist 数据集:

from tensorflow.examples.tutorials.mnist import input_data

mnist = input_data.read_data_sets('./data/', one_hot = True)在 read_data_sets() 函数中两个参数,第一个参数表示数据集存放路径,第二个参数表示数据集的存取形式。当第二个参数为 True 时,表示以独热码形式存取数据集。read_data_sets() 函数运行时,会检查指定路径内是否已经有数据集,若指定路径中没有数据集,则会自动下载,并将 mnist 数据集分为训练集 train、验证集 validation 和测试集 test 存放。

在 Tensorflow 中用以下函数返回子集样本数:

返回训练集、验证集和测试集的样本数

print "train data size : ", mnist.train.num_examples

print "validation data size : ", mnist.validation.num_examples

print "test data size : ", mnist.test.num_examples

输出结果:

train data size : 55000

validation data size : 5000

test data size : 10000使用 train.labels 函数返回 mnist 数据集标签

例如:

在 mnist 数据集中,若想要查看训练集中第0张图片的标签,则使用函数 mnist.train.labels[0]

输出结果:array([0.,0.,0.,0.,0.,0.,1.,0.,0.,0])

使用 train.images 函数返回 mnist 数据集图片像素值

例如:

在 mnist 数据集中,若想要查看训练集中第 0 张图片像素值,则使用函数 mnist.train.images[0]

使用 mnist.train.next_batch() 函数将数据输入神经网络

例如:

BATCH_SIZE = 200

xs, ys = mnist.train.next_batch(BATCH_SIZE)

BATCH_SIZE = 200

xs, ys = mnist.train.next_batch(BATCH_SIZE)

print "xs shape : ", xs.shape

print "ys shape : ", ys.shape

输出结果:xs.shape(200, 784)

输出结果:ys.shape(200, 10)

其中,mnist.train.next_batch() 函数包含一个参数 BATCH_SIZE,表示随即从训练集中抽取 BATCH_SIZE 个样本输入神经网络,并将样本的像素值和标签分别赋给 xs 和 ys。

在本例中,BATCH_SIZE 设置为200,表示一次将200个样本的像素值和标签分别赋值给 xs 和 ys ,故 xs 的形状为(200,784),对应的ys的形状为(200,10)。

实现 “Mnist 数据集手写数字识别” 的常用函数:

(1)tf.get_collection(" ") 函数表示从 collection 集合中取出全部变量生成一个列表

(2)tf.add() 函数表示将参数列表中的对应元素相加

(3)tf.cast(x, dtype) 函数表示将参数 x 转换为指定数据类型

(4)tf.equal() 函数表示对比两个矩阵或者向量的元素。若对应元素相等,则返回 True;若对应元素不相等,则返回 False。

(5)tf.reduce_mean(x, axis) 函数表示求取矩阵或者张量指定维度的平均值。若不指定第二个参数,则在所有元素中取平均值;若指定第二个参数为 0 ,则再第一位元素上取平均值,即每一列求平均值;若指定第二个参数为 1,则在第二维元素上取平均值,即每一行的平均值。

(6)tf.argmax(x, axis) 函数表示返回指定维度 axis 下,参数 x 中最大值索引号。

(7)os.path.join() 函数表示把参数字符串按照路径命名规则拼接。

(8).split() 函数表示按照指定“拆分符”对字符串拆分,返回拆分列表。

'./model/mnist_model-1001'.split('/')[-1].split('-')[-1]在这个例子中,共进行两次拆分。第一个拆分符为 ’/‘ ,返回拆分结果,并提取结果中索引号为 -1 的元素即倒数第一个元素;第二个拆分符为 ’-‘ ,返回拆分结果,并提取列表索引为 -1 的元素,返回值为1001。

具体内容参考https://www.cnblogs.com/huchong/p/7349886.html

(9)tf.Graph().as_default() 函数表示将当前图设置为默认图,并返回一个上下文管理器。该函数一般与 with 关键字搭配使用,应用于将已经定义好的神经网络在计算图中复现。

例如:

with tf.Graph().as_default() as g , 表示将 Graph() 内定义的节点加入到计算图 g 中。

神经网络模型的保存

在反向传播过程中,一般会间隔一定轮数保存一次神经网络模型,并产生三个文件(保存当前图结构的 .meta 文件、保存当前参数名的 .indx 文件、保存当前参数的 .data 文件 ),在 Tensorflow 中:

saver = tf.train.Saver()

with tf.Session as sess:

for i in range (STEPS):

if i % 轮数 == 0:

saver.save(sess, op.path.join(MODEL_SAVE_PATH, MODEL_NAME), global_step = global_step)其中 tf.train.Saver() 用来实例化 saver 对象。上述代码表示,神经网络每循环规定的轮数,将神经网络模型中的所有参数等信息保存到指定的路径中,并在存放网络模型的文件夹名称中注明保存模型时的训练轮数。

神经网络模型的加载

在测试网络效果时,需要训练好的神经网络模型加载,在 Tensorflow 中这样表示:

with tf.Session() as sess:

ckpt = tf.train.get_checkpoint_state(存储路径)

if ckpt and ckpt.model_checkpoint_path:

saver.restore(sess, ckpt.model_checkpoint_path)在 with 结构中进行加载保存的神经网络模型,若 ckpt 和保存的模型在指定路径中存在,则将保存的神经网络模型加载到当前会话中。

加载模型中参数的滑动平均值

在保存模型时,若模型中采用滑动平均,则参数的滑动平均值会保存在相应文件中。通过实例化 saver 对象,实现参数滑动平均值的加载,在 Tensorflow 中如下表示:

ema = tf.train.ExponentialMovingAverage(滑动平均基数)

ema_restore = ema.variables_to_restore()

saver = tf.train.Saver(ema_restore)神经网络模型准确率的评估方法

在网络评估时,一般通过计算在一组数据上的识别准确率,评估神经网络的效果。在 Tensorflow 中这样表示:

correct_prediction = tf.equal(tf.argmax(y, 1), tf.argmax(y_, 1))

accuracy = tf.reduce_mean(tf.cast(correct_prediction, tf.float32))在上述中,y 表示在一组数据(即 batch_size 个数据)上神经网络模型的预测结果,y 的形状为 [batch_size, 10] 每一行表示一张图片的识别结果。通过 tf.argmax() 函数取出每张图片对应向量中最大元素对应的索引值,组成长度为输入数据 batch_size 个的一维数组。通过 tf.equal() 函数判断预测结果张量和实际标签张量的每个维度是否相等,若相等则返回 True,不相等则返回 False。通过 tf.cast() 函数将得到的布尔型数值转化为实数型,再通过 tf.reduce_mean() 函数求平均值,最终得到神经网络模型在本组数据上的准确率。

实现手写体 mnist 数据集的识别任务,共分为三个模块文件,分别是描述网络结构的前向传播过程文件(mnist_forward.py)、描述网络参数优化方法的反向传播过程文件(mnist_backward.py)、验证模型准确率的测试过程文件(mnist_test.py)

前向传播过程文件

正则化 regularization

当在前向传播过程中,设置正则化参数 regularization 为1时,则表明在反向传播过程中优化模型参数时,需要在损失函数中加入正则化项。

结构如下:

首先,需要在前向传播过程中加入

if regularizer ! = None: tf.add_to_collection('losses', tf.contrib.layers.l2_regularizer(regularizer)(w))其次,需要在反向传播过程中加入

ce = tf.nn.sparse_softmax_cross_entropy_with_logits(logits = y,labels = tf.argmax(y_, 1))

cem = tf.reduce_mean(ce)

loss = cem + tf.add_n(tf.get_collection('losses'))上述代码可知,在前向传播过程中,规定网络输入节点为784个(代表每张输入图片的像素个数)、隐藏层节点500个,输出节点10个(表示输出位数字0-9的十分类)。由输入层到隐藏层的参数 w1 形状为[784,500],由隐藏层到输出层的参数 w2 形状为[500,10],参数满足截断正态分布,并使用正则化,将每个参数的正则化损失加到总损失中。由输入层到隐藏层的偏置 b1 形状为长度500的一维数组,由隐藏层到输出层的偏置 b2 形状为长度10的一维数组,初始化值为全0。前向传播结构第一层为输入 x 与参数 w1 矩阵相乘加上偏置 b1,在经过 relu 函数,得到隐藏层输出 y1 .前向传播结构第二层为隐藏层输出 y1 与参数 w2 矩阵相乘加上偏置 b2,得到输出 y。由于输出 y 要经过 softmax 函数,使其符合概率分布,故输出 y 不经过 relu 函数。

反向传播过程文件

反向传播过程实现利用训练数据集对神经网络模型训练,通过降低损失函数值,实现网络模型参数的优化,从而得到准确率高且泛化能力强的神经网络模型。

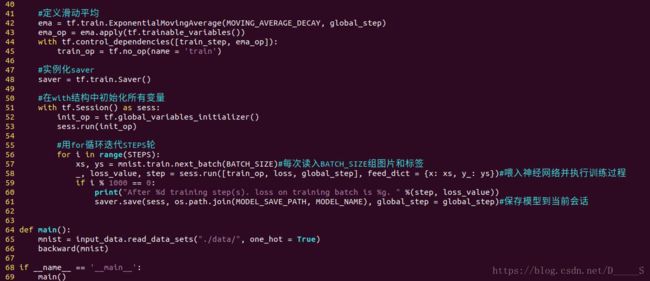

实现手写体 mnist 数据集的识别任务反向传播过程如下:

由上述代码可知,在反向传播过程中,首先引入 Tensorflow、input_data、前向传播和 os 模块,定义每轮喂入神经网络的图片数、初始学习率、学习率衰减率、正则化系数、训练轮数、模型保存路径以及模型保存名称等相关信息。在反向传播函数 backward 中,首先读入 mnist,用 placehloder 给训练数据 x 和标签 y_ 占位,调用 mnist_forward 文件中的前向传播过程 forward() 函数,并设置正则化,计算训练数据集上的预测结果 y,并给当前计算轮数计数器赋值,设定为不可训练类型。接着,调用包含所有参数正则化损失函数 loss,并设定指数衰减学习率 learning_rate。然后,使用梯度衰减算法对模型优化,降低损失函数,并定义参数的滑动平均。最后,在 with 结构中,实现所有参数初始化,每次喂入 batch_size 组训练数据和对应标签,循环迭代 steps 轮,并每隔 1000 轮打印出依次损失函数信息,并将当前会话加载到指定路径。最后,通过主函数 main() ,加载指定路径下的训练数据集,并调用规定的 backward() 函数训练模型。

测试过程文件

当训练完模型后,给神经网络模型输入测试集验证网络的准确性和泛化性。注意,所用的测试集和训练集时相互独立的。

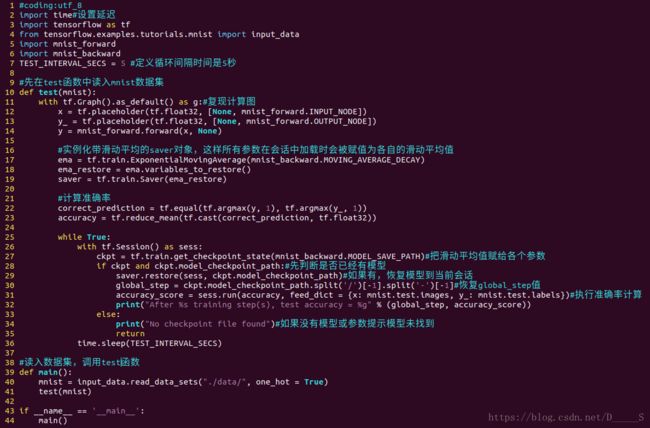

实现手写体 mnist 数据集的识别任务测试传播过程如下:

在上述代码中,首先需要引入 time 模块、Tensorflow、input_data、前向传播、反向传播和 os 模块,并规定程序5秒的循环间隔时间。接着,定义测试函数 test(),读入 mnist 数据集,利用 tf.Graph() 复现之前定义的计算图,利用 placeholder 给训练数据 x 和标签 y_ 占位,调用前向传播文件中的传播过程 forward() 函数,计算训练数据集上的预测结果 y。接着,实例化具有滑动平均的 saver 对象,从而在会话被加载时模型中的所有参数被赋值为各自的滑动平均值,增强模型的稳定性,然后计算模型在测试集上的准确率。在 with 结构中,加载指定路线下的 ckpt,若模型存在,则加载模型到当前会话,在测试数据集上进行准确率验证,并打印处当前轮数下的准确率,若模型不存在,则打印出“当前模型不存在”的字样,从而 test() 函数完成。通过主函数 main(),加载指定路径下的测试数据集,并调用规定的 test 函数,进行模型在测试集上的准确率验证。

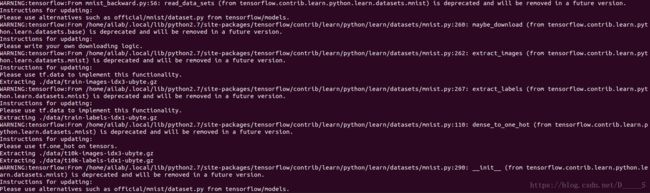

运行以上三个文件,可以得到结果:

从终端显示的结果可以看出,随着训练轮数增加,网络模型的损失函数值在不断减小,并且在测试集上的的准确率在不断提升,有较好的泛化能力。

后记:

这次整个程序比之前的要复杂,错误的地方也比之前要多

比如

这样的 warning 经过在网上的百度,得知是 python 版本的问题,新版本已经没有这个提示了。

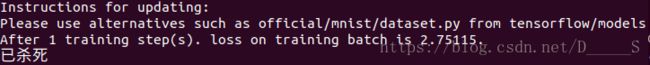

还有

显示运行的程序已经被杀死了,百度了很久都没有解决,最后多运行了两次就自然而然的成功了。