爬虫 --- 小试牛刀

一、python 连接测试URL

- 运行环境: python3.7 win7x64

- 使用工具: VS Code

- python 第三方库: requests (自行安装 >>> cmd --->pip install requests, 具体不做介绍)

- requests 库简介

requests 库的网页请求函数

| 函数 |

说明 |

| get(url [, timeout=n]) |

对应HTTP的GET方式,设定请求超时时间为n秒 |

| post(url, data={'key':'value'}) |

对应HTTP的POST方式,字典用于传输客户数据 |

| delete(url) |

对应HTTP的DELETE方式 |

| head(url) |

对应HTTP的HEAD方式 |

| options(url) |

对应HTTP的OPTIONS方式 |

| put(url, data={'key':'value'}) |

对应HTTP的PUT方式,字典用于传输客户数据 |

其中,最常用的是get方法,它能够获得url的请求,并返回一个response对象作为响应。有了响应对象,就能为所欲为了,你觉得呢 ^x^

response对象的属性

| 属性 |

说明 |

| status_code |

HTTP请求的返回状态(???咨询一下) |

| encoding |

HTTP响应内容的编码方式 |

| text |

HTTP响应内容的字符串形式 |

| content |

HTTP响应内容的二进制形式 |

response对象的方法

| 方法 |

说明 |

| json() |

若http响应内容中包含json格式数据, 则解析json数据 |

| raise_for_status() |

若http返回的状态码不是200, 则产生异常 |

5. 好了,我们开工 >>>

① 导入库

② 设定url, 并使用get方法请求页面得到响应

url = "http://www.baidu.com"

r = get(url, timeout=3)

print("获得响应的状态码:", r.status_code)

print("响应内容的编码方式:", r.encoding)

运行结果:

获得响应的状态码: 200

响应内容的编码方式: ISO-8859-1

③ 获取网页内容

url_text = r.text

print("网页内容:", r.text)

print("网页内容长度:", len(url_text))

运行结果:

网页内容:

... 京ICPè¯030173å· ...

网页内容长度: 2381

惊不惊讶? 激不激动? 好不好玩? >>> 好吧,如果看到我上面 标蓝 加粗 的不明字体,你可能会 》》》问 》》》为什么?

还记得上面的编码方式吗?没错,就是他!!!

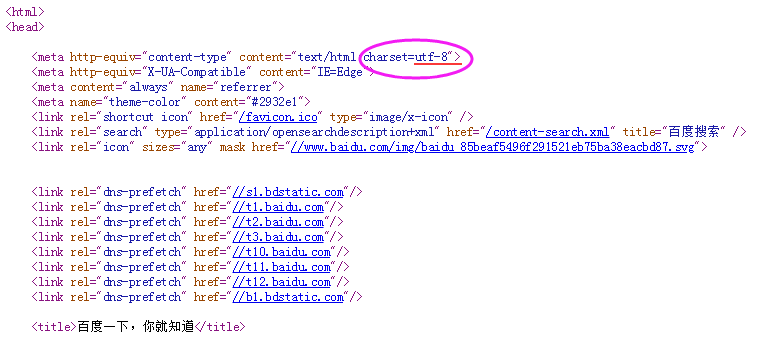

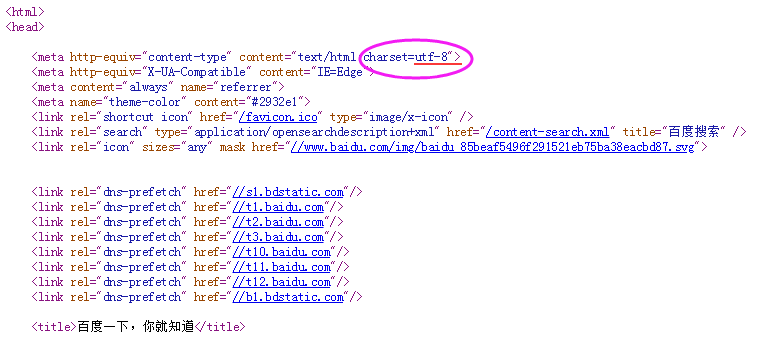

这是因为HTML代码也有自己的编码方式,我们需要使用相同的编码方式。下图是HTML语言的编码方式设置

知道了原因,那就好搞了!

④ 重新获取网页内容

r.encoding = "utf-8"

url_text = r.text

print("网页内容:", r.text)

print("网页内容长度:", len(url_text))

运行结果:

网页内容:

... 意见反馈 京ICP证030173号

网页内容长度: 2287

很明显,这次可以了 ^v^

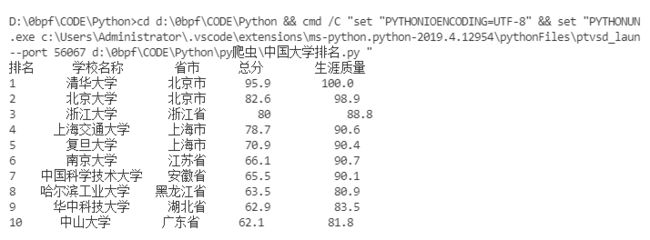

二、python 疯狂连接URL

- 使用上述的连接测试 "经验", 找个网站进行疯狂连接

- 在此,选取搜狗网站

- 上代码

url = "http://www.sogou.com" # 搜狗

for i in range(200):

print("Test %d:" % (i+1), end=" ")

response = get(url, timeout=5)

# 判断连接状态

if response.status_code == 200:

print("Conncect successful!")

else:

print("Conncect UNsuccessful!")

运行结果:

Test 1: Conncect successful!

Test 2: Conncect successful!

Test 3: Conncect successful!

Test 4: Conncect successful!

Test 5: Conncect successful!

................

Test 199: Conncect successful!

Test 200: Conncect successful!

结果有200行,我就不 一 一 输出了。试一下呗,你也可以的哦 ^_^

三、获取网页的各个属性标签内容

(我也不知道这个标题什么意思, 感觉很牛但看不懂, 才怪呢!你肯定看得懂!)

这里,选取一个很厉害的网站做演示

URL = https://www.runoob.com/

步骤说明:

1. 找个url, 上面有了, 其实随便一个都是OK的

2. 抓取网页内容,这个上面有详解,不难

3. 本次使用 BeautifulSoup 第三方库,需要自行下载【详情介绍】

4. 开工

前面提供了 URL,现在抓取网页内容

1 # -*- encoding:utf-8 -*-

2 from requests import get

3 def getText(url):

4 try:

5 r = get(url, timeout=5)

6 r.raise_for_status()

7 r.encoding = 'utf-8'

8 return r.text

9 except Exception as e:

10 print("Error:", e)

11 return ''

然后再引入 beautifulsoup库,不过与其他的库有点不一样,别写错了哟

from bs4 import BeautifulSoup

之后创建一个 beautifulsoup 对象

1 url = "https://www.runoob.com/"

2 html = getText(url)

3 soup = BeautifulSoup(html)

好了,现在想要干嘛就干嘛 ↓↓↓

① 获取 head 标签

print("head:", soup.head)

print("head:", len(soup.head))

由于结果比较多,就只输出第二个结果

head: 33

② 获取 body 标签

print("body:", soup.body)

print("body:", len(soup.body))

由于结果比较多,就只输出第二个结果

body: 39

③ 获取 title 标签

print("title:", soup.title)

title:

菜鸟教程 - 学的不仅是技术,更是梦想!

④ 获取 title 的内容

print("title_string:", soup.title.string)

title_string: 菜鸟教程 - 学的不仅是技术,更是梦想!

⑤ 查找特定 id 的内容

print("special_id:", soup.find(id='cd-login'))

special_id: