教你如何在树莓派上搭建语音识别服务

最近项目原因需要我完成一个在树莓派上的离线语音识别,忙活了近一周,起初用了开源的PocketSphinx,但是不得不说,识别率低的惊人,甚至可以说有些字词根本没法识别,除非你自己制作声学模型,不然这玩意儿就是个摆设。

接下来,根据我的摸索,教大家如何在树莓派上搭建语音识别模块。

首先,前往讯飞开放平台下载SDK,平台选择Linux。你需要注册相关信息,最后你所下载的SDK中会自动填入你的key。

因为科大讯飞官方在新版本SDK移除了树莓派的支持,我把以前的版本上传了,供大家使用:

https://github.com/Qianlitp/RaspberryPiSDK

解压后如图

![]()

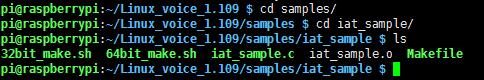

进入目录,里面有如下的文件:

![]()

我们这里直接选择进入官方所给的例子进行运行:

关键点,因为这个是Linux系统的版本,和树莓派不一样,我们需要修改一下库文件的引用路径:

首先,编辑32bit_make.sh:

sudo vim 32bit_make.sh,将内容修改为以下:

保存退出后,继续,sudo vim Makefile,修改下面划红线的位置为如图:

好了,接下来执行source 32bit_make.sh

有可能会出现权限相关的问题,建议直接从主文件递归给权限:

sudo chmod -R 774 Linux_voice_1.109

接着,在Linux_voice_1.109/bin目录下会生成一个可执行文件:

![]()

这里选0会直接识别,识别的语音为官方所给的测试语音文件,保存在当前目录的wav文件夹下,识别结果为中美数控。选1则会使用用户词表,文件为当前目录下的userwords.txt,识别结果为中美速控,原因大家自己思考。

好了,现在识别解决了,我们来解决录音的问题

我试过很多在linux下的录音软件,不是不能设置详细的参数,就是无法控制录音时间。比如sox,这个软件很好,但是我看了帮助文档发现,要停止录音必须手动Ctrl+C。

不过问题还是被我解决了:

sudo apt-get install alsa-oss

安装完以后,执行:

arecord -d 3 -r 16000 -c 1 -t wav -f S16_LE test.wav

-d : 录音时间(s)

-r : 频率

-c : 音轨

-t : 文件类型

-f : 格式

因为科大讯飞要求单音轨,16000HZ,16bit的采样,支持wav或者pcm

录音结束后,文件保存在当前目录,将它移动到bin/wav/下,并且修改文件名替换掉以前的文件。

或者你直接可以在sample/iat_sample/下修改C文件源代码,改变音频文件位置和文件名(很简单的,打开C文件,找到传路径的地方,改一下就好,改完记得重新编译)。

我们再次执行bin/iat_sample,成功识别。

在这里我只是讲述了如何在树莓派上将语音识别SDK简单跑起来,更多的改善大家可以自己解决。

有错误的地方还望大家指正。

我提供的SDK已经申请过认证,无限制次数使用,大家可用于学习和测试开发。