TensorFlow入门第四课——TensorBoard可视化

一、TensorBoard简介

训练神经网络十分复杂,有时需要几天甚至几周的时间。为了更好地管理、调试和优化神经网络的训练过程, TensorFlow 提供了 一个可视化工具 TensorBoard 。 TensorBoard 可以有效地展示 TensorFlow 在运行过程中的计算图、各种指标随着时间的变化趋势以及训练中使用到的图像等信息。

TensorBoard 是 TensorFlow 的可视化工具 ,它可以通过 TensorFlow 程序运行过程中输出的日志文件可视化 TensorFlow 程序的运行状态。 TensorBoard 和 TensorFlow 程序跑在不同的进程中,TensorBoard 会自动读取最新的 TensorFlow 日志文件,并呈现当前 TensorFlow程序运行的最新状态。

TensorBoard 不需要额外的安装过程,TensorFlow 安装完成时, TensorBoard 会自动安装 。

二、TensorBoard可视化网络结构

下面的是从一个非常简单的神经网络里截取的一部分:

# 命名空间

with tf.name_scope('input'):

# 定义两个占位符

x = tf.placeholder(tf.float32,[None,784],name='x-input')

y = tf.placeholder(tf.float32,[None,10],name='y-input')

..........

writer = tf.summary.FileWriter('logs/',tf.get_default_graph()) #在当前文件夹里新建logs文件夹(如果没有logs文件夹),并把图存入)

............

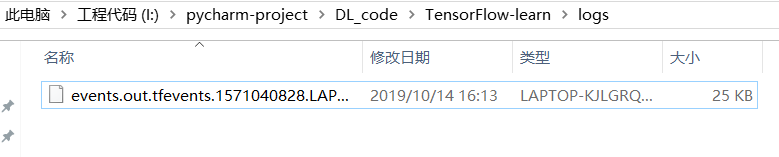

接着运行这个完整的神经网络程序,等程序运行结束,在当前文件夹里会出现一个文件夹logs,并且在该文件夹中有一个文件,该文件就是tensorboard的文件。

我们需要运行这个文件才可以看到可视化的内容。

首先,打开命令行(cmd),需要改变路径至该文件所在的盘符,否则会执行失败。然后运行:

tensorboard --logdir=I:\pycharm-project\DL_code\TensorFlow-learn\logs

后面是该文件的路径。接着回车运行,会看到返回一个网址:

将该网址复制进浏览器打开(推荐Google浏览器)即可。

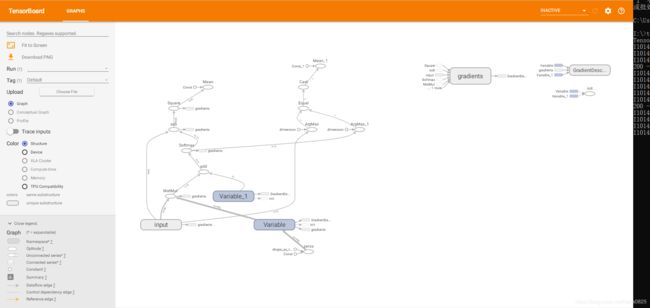

打开后是这样的:

在界面的上方,展示的内容是“ GRAPHS ”,表示图中可视化的内容是 TensorFlow 的计算图 。打开 TensorBoard 界面会默认进入 GRAPHS 界面,在该界面中可以看到上面程序 TensorFlow 计算图的可视化结果。点开 “ INACTIVE "选项可以看到 TensorBoard 能够可视化的其他内容 ,“INACTIVE”选项中列出的是当前没有可视化数据的项目 。,除了可视化 TensorFlow计算图之外,TensorBoard 还提供了 SCALARS 、 IMAGES 、 AUDIO 、 DIST阳BUTIONS 、HISTOGRAMS 、 PROJECTOR 、 TEXT 和 PROFILE 项目 。

TensorFlow 会将所有的计算以图的形式组织起来。TensorBoard 可视化得到的图不仅是将TensorFlow计算图中的节点和边直接可视化,它会根据每个 TensorFlow 计算节点的命名空间来整理可视化得到的效果图,使得神经网络的整体结构不会被过多的细节所淹没。除了显示 TensorFlow计算图的结构, TensorBoard 还可以展示 TensorFlow 计算节点上的其他信息。

节点的排列可能会比较乱,这导致主要的计算节点可能被埋没在大量信息量不大的节点中,使得可视化得到的效果图很难理解 。为了更好地组织可视化效果图中的计算节点, TensorBoard 支持通过 TensorFlow 命名空间来整理可视化效果图上的节点 。在 TensorBoard 的默认视图中, TensorFlow 计算图中同一个命名空间下的所有节点会被缩略成一个节点,只有顶层命名空间中的节点才会被显示在 TensorBoard 可视化效果图上。

除了 tf.name_scope 函数, tf.variable_scope 函数也提供了命名 空间管理的功能。这两个函数在大部分情况下是等价的 ,唯一的区别是在使用 tf.get_variable 函数时。

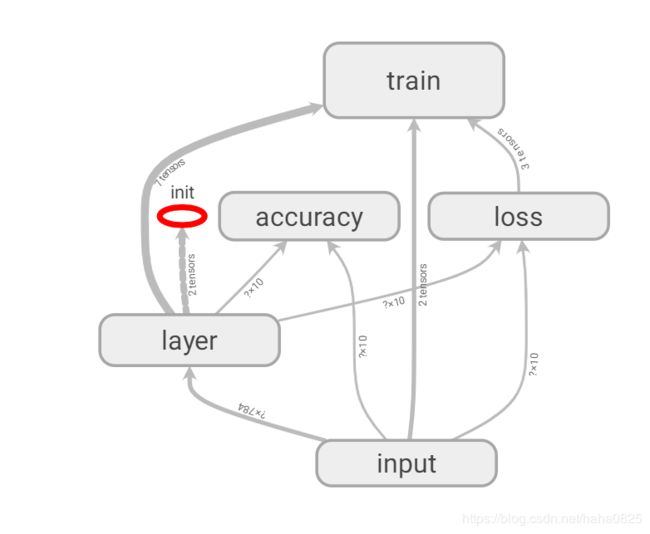

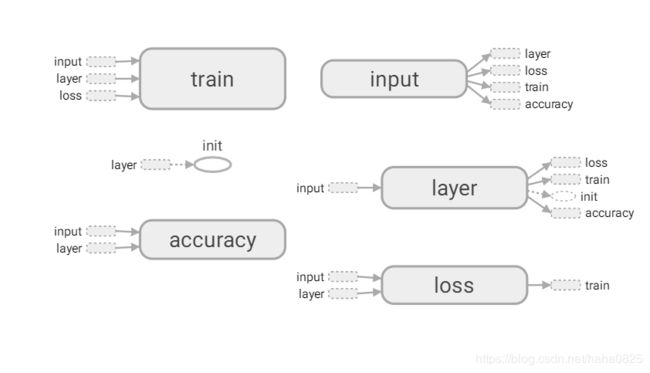

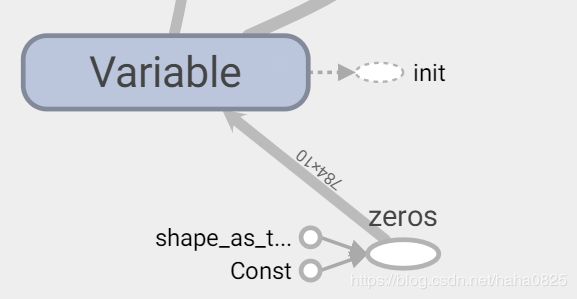

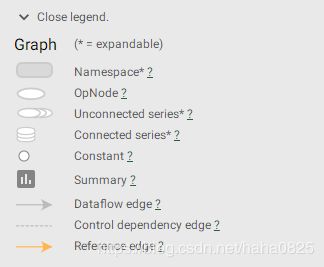

在可视化图中:

长方体为命名空间;椭圆为op,圆为常量,虚边表达了计算之间的依赖关系,实边为数据流动。

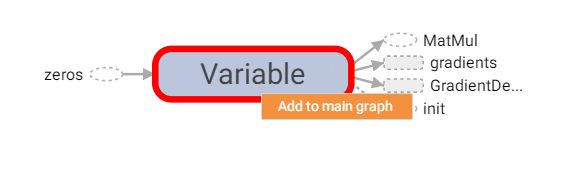

点击某个命名空间,图中的它的位置都会显示,右上角为它的属性:

双击命名空间,会展开它的具体的内容;再双击就折叠起来:

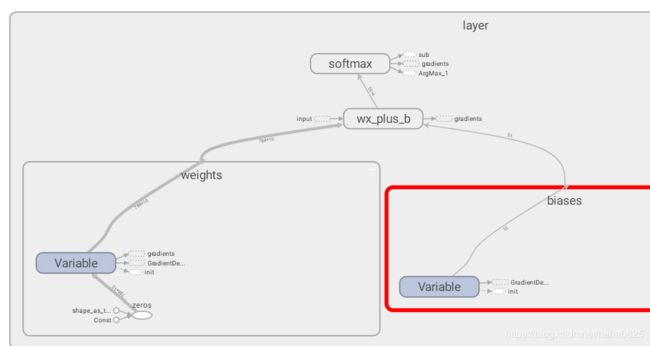

最后,整理一个比较整洁的可视化图:

# 命名空间

with tf.name_scope('input'):

# 定义两个占位符

x = tf.placeholder(tf.float32,[None,784],name='x-input')

y = tf.placeholder(tf.float32,[None,10],name='y-input')

with tf.name_scope('layer'):

with tf.name_scope('weights'):

W = tf.Variable(tf.zeros([784,10]))

with tf.name_scope('biases'):

b = tf.Variable(tf.zeros([10]))

with tf.name_scope('wx_plus_b'):

wx_plus_b = tf.matmul(x,W)+b

with tf.name_scope('softmax'):

prediction = tf.nn.softmax(wx_plus_b)

with tf.name_scope('loss'):

loss = tf.reduce_mean(tf.square(y-prediction))

with tf.name_scope('train'):

train_step = tf.train.GradientDescentOptimizer(0.2).minimize(loss)

tf.global_variables_initializer().run()

with tf.name_scope('accuracy'):

with tf.name_scope('correct_prediction'):

correct_prediction = tf.equal(tf.arg_max(y,1),tf.arg_max(prediction,1))

with tf.name_scope('accuracy'):

# 准确率

accuracy = tf.reduce_mean(tf.cast(correct_prediction,tf.float32))

writer = tf.summary.FileWriter('logs/',tf.get_default_graph())

三、TensorBoard可视化网络运行

# Tensor Board可视化网络运行

import tensorflow as tf

from tensorflow.examples.tutorials.mnist import input_data

mnist = input_data.read_data_sets("MNIST_data",one_hot=True) # 载入数据放在当前路径

sess = tf.InteractiveSession()

batch_size = 100 # 每个批次的大小

# n_batch = mnist.train.num_example # 一共有多少批次

n_batch = 5000

# 参数概要

def variable_summaries(var):

with tf.name_scope('summaries'):

mean = tf.reduce_mean(var)

tf.summary.scalar('mean',mean) # 平均值

with tf.name_scope('stddev'):

stddev = tf.sqrt(tf.reduce_mean(tf.square(var-mean)))

tf.summary.scalar('stddev',stddev) # 标准差

tf.summary.scalar('max',tf.reduce_max(var)) # 最大值

tf.summary.scalar('min',tf.reduce_min(var)) # 最小值

tf.summary.histogram('histogram',var) # 直方图

# tf.summary.scalar('a',b):记录b的值并给b命名为a

# 命名空间

with tf.name_scope('input'):

# 定义两个占位符

x = tf.placeholder(tf.float32,[None,784],name='x-input')

y = tf.placeholder(tf.float32,[None,10],name='y-input')

with tf.name_scope('layer'):

with tf.name_scope('weights'):

W = tf.Variable(tf.zeros([784,10]))

variable_summaries(W)

with tf.name_scope('biases'):

b = tf.Variable(tf.zeros([10]))

variable_summaries(b)

with tf.name_scope('wx_plus_b'):

wx_plus_b = tf.matmul(x,W)+b

with tf.name_scope('softmax'):

prediction = tf.nn.softmax(wx_plus_b)

with tf.name_scope('loss'):

loss = tf.reduce_mean(tf.square(y-prediction))

tf.summary.scalar('loss',loss) # loss的值就一个不需要调用variable_summaries函数

with tf.name_scope('train'):

train_step = tf.train.GradientDescentOptimizer(0.2).minimize(loss)

tf.global_variables_initializer().run()

with tf.name_scope('accuracy'):

with tf.name_scope('correct_prediction'):

correct_prediction = tf.equal(tf.arg_max(y,1),tf.arg_max(prediction,1))

with tf.name_scope('accuracy'):

# 准确率

accuracy = tf.reduce_mean(tf.cast(correct_prediction,tf.float32))

tf.summary.scalar('accuracy',accuracy)

writer = tf.summary.FileWriter('logs/',tf.get_default_graph()) #在当前文件夹里新建logs文件夹(如果没有logs文件夹),并把图存入)

# 合并所有summary

merged = tf.summary.merge_all()

for epoch in range(51): #训练50次

for batch in range(n_batch): # 循环总共的批次

batch_xs, batch_ys = mnist.train.next_batch(batch_size)

summary,_ = sess.run([merged,train_step],feed_dict={x:batch_xs,y:batch_ys})

writer.add_summary(summary,epoch) # 将summary写入logs文件夹

test_acc = sess.run(accuracy, feed_dict={x: mnist.test.images, y: mnist.test.labels}) # 训练一批输出一次准确率

train_acc = sess.run(accuracy, feed_dict={x: mnist.train.images, y: mnist.train.labels})

print("Iter" + str(epoch) + ",Testing Accuracy" + str(test_acc) + ",Training Accuracy" + str(train_acc))

首先定义一个函数用于参数的处理,包括平均值、标准差、最大值、最小值和直方图。

然后在参数使用的部分调用该函数。

最后合并所有的summary。

运行之后得到的tensorboard可视化图是这样的:

就其中的accuracy来说:

我们可以通过左侧的‘Smoothing’调整它的平滑度:

我们鼠标停在某个点的时候,会跳出一些信息,包括:它的值、它是第几步以及它的时间

如果想要看到更多的点,可以使用下面这种方式:

for i in range(2001):

batch_xs, batch_ys = mnist.train.next_batch(100)

summary,_ = sess.run([merged,train_step],feed_dict={x:batch_xs,y:batch_ys})

writer.add_summary(summary,i)

if i%500 == 0:

print(sess.run(accuracy,feed_dict={x:mnist.test.images,y:mnist.test.labels}))

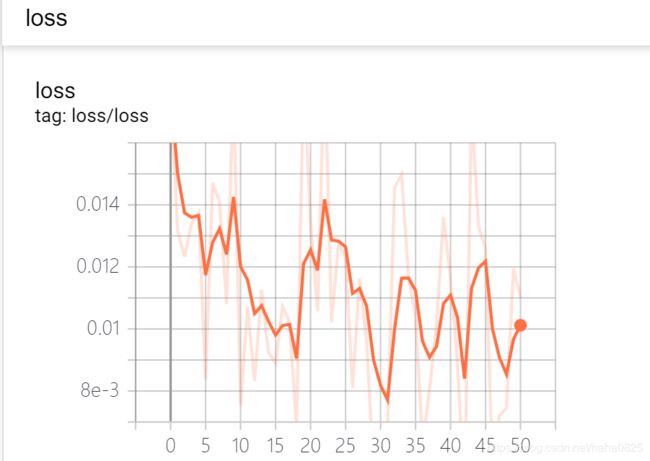

对于loss部分:

可以看到震荡比较剧烈,这说明可能学习率设置有点大了。比较平滑的下降才是最好的情况。

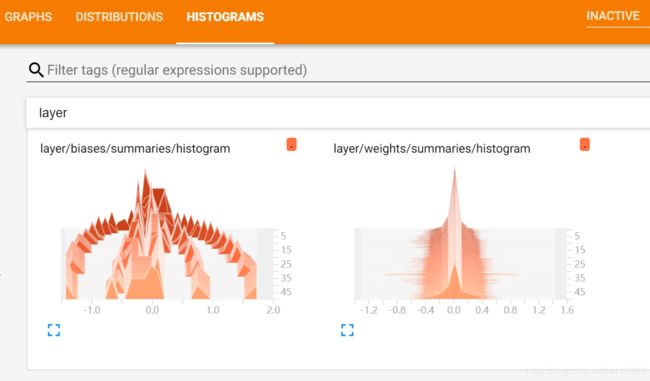

下面是分布图:

左边的是偏差b的分布图,右边是权重W的分布图。

中间颜色比较深说明分布该位置比较多。

四、TensorBoard可视化

import tensorflow as tf

from tensorflow.examples.tutorials.mnist import input_data

from tensorflow.contrib.tensorboard.plugins import projector

# 载入数据集

mnist = input_data.read_data_sets("MNIST_data/",one_hot=True)

# 运行次数

max_step = 1001

# 图片数量

image_num = 3000

# 文件路径

DIR = "I:/pycharm-project/DL_code/TensorFlow-learn/tensorboard/"

# 定义会话

sess = tf.Session()

# 载入图片

embedding = tf.Variable(tf.stack(mnist.test.images[:image_num]),trainable=False,name='embedding')

# 第0张到第3000张图片打包,然后存放在embedding中

# 参数概要

def variable_summaries(var):

with tf.name_scope('summaries'):

mean = tf.reduce_mean(var)

tf.summary.scalar('mean',mean) # 平均值

with tf.name_scope('stddev'):

stddev = tf.sqrt(tf.reduce_mean(tf.square(var-mean)))

tf.summary.scalar('stddev',stddev) # 标准差

tf.summary.scalar('max',tf.reduce_max(var)) # 最大值

tf.summary.scalar('min',tf.reduce_min(var)) # 最小值

tf.summary.histogram('histogram',var) # 直方图

# tf.summary.scalar('a',b):记录b的值并给b命名为a

# 命名空间

with tf.name_scope('input'):

# 定义两个占位符

x = tf.placeholder(tf.float32,[None,784],name='x-input')

y = tf.placeholder(tf.float32,[None,10],name='y-input')

# 显示图片

with tf.name_scope('input_reshape'):

image_shaped_input = tf.reshape(x,[-1,28,28,1])

# 改变x的形状,-1:None,代表不确定的值,28,28:784转为28行28列,1:维度是1,(黑白的图片所以是1,彩色的就是3)

tf.summary.image('input',image_shaped_input,10)

with tf.name_scope('layer'):

with tf.name_scope('weights'):

W = tf.Variable(tf.zeros([784,10]))

variable_summaries(W)

with tf.name_scope('biases'):

b = tf.Variable(tf.zeros([10]))

variable_summaries(b)

with tf.name_scope('wx_plus_b'):

wx_plus_b = tf.matmul(x,W)+b

with tf.name_scope('softmax'):

prediction = tf.nn.softmax(wx_plus_b)

with tf.name_scope('loss'):

loss = tf.reduce_mean(tf.square(y-prediction))

tf.summary.scalar('loss',loss) # loss的值就一个不需要调用variable_summaries函数

with tf.name_scope('train'):

train_step = tf.train.GradientDescentOptimizer(0.2).minimize(loss)

# 变量初始化

sess.run(tf.global_variables_initializer())

with tf.name_scope('accuracy'):

with tf.name_scope('correct_prediction'):

correct_prediction = tf.equal(tf.arg_max(y,1),tf.arg_max(prediction,1))

with tf.name_scope('accuracy'):

# 准确率

accuracy = tf.reduce_mean(tf.cast(correct_prediction,tf.float32))

tf.summary.scalar('accuracy',accuracy)

# writer = tf.summary.FileWriter('logs/',tf.get_default_graph())

# 产生metadata文件

if tf.gfile.Exists(DIR + 'projector/projector/metadata.tsv'):

tf.gfile.DeleteRecursively(DIR + 'projector/projector/metadata.tsv')

# 检测在该路径下有没有这个文件(metadata.tsv)存在,有的话就删除。

with open(DIR + 'projector/projector/metadata.tsv','w') as f:

labels = sess.run(tf.argmax(mnist.test.labels[:],1)) #将labels取出

for i in range(image_num):

f.write(str(labels[i]) + '\n')

# 将labels从第0个到2999个,共3000个写入这个文件(metadata.tsv),每写一个就换行

# 合并所有的summary

merged = tf.summary.merge_all()

projector_writer = tf.summary.FileWriter(DIR + 'projector/projector',sess.graph)

saver = tf.train.Saver() # 保存网络模型

# 配置文件,固定写法

config = projector.ProjectorConfig()

embed = config.embeddings.add()

embed.tensor_name = embedding.name

embed.metadata_path = DIR + 'projector/projector/metadata.tsv' # 文件路径

embed.sprite.image_path = DIR + 'projector/data/mnist_10k_sprite.png' # 图片路径

embed.sprite.single_image_dim.extend([28,28]) # 按照28*28 切分图像

projector.visualize_embeddings(projector_writer,config)

for i in range(max_step):

# 每个批次100个样本

batch_xs, batch_ys = mnist.train.next_batch(100)

# 配置文件,固定写法

run_options = tf.RunOptions(trace_level=tf.RunOptions.FULL_TRACE)

run_metadata = tf.RunMetadata()

summary,_ = sess.run([merged,train_step],feed_dict={x:batch_xs,y:batch_ys},options=run_options,run_metadata=run_metadata)

# 配置文件,固定写法

projector_writer.add_run_metadata(run_metadata,'step%03d' % i)

projector_writer.add_summary(summary,i)

if i%100 == 0:

acc = sess.run(accuracy,feed_dict={x:mnist.test.images,y:mnist.test.labels})

print("Iter" + str(i) + ",Testing Accuracy=" + str(acc))

# 训练好的模型保存下来

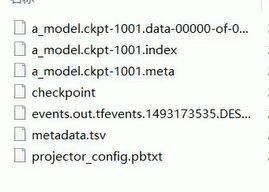

saver.save(sess,DIR + 'projector/projector/a_model.ckpt',global_step=max_steps)

projector_writer.close()

sess.close()

其中stack函数的意思是:默认的情况下,axis=0,此时是直接合并元素,axis=1时按列合并。

运行后,在projector文件夹中会出现一系列文件:

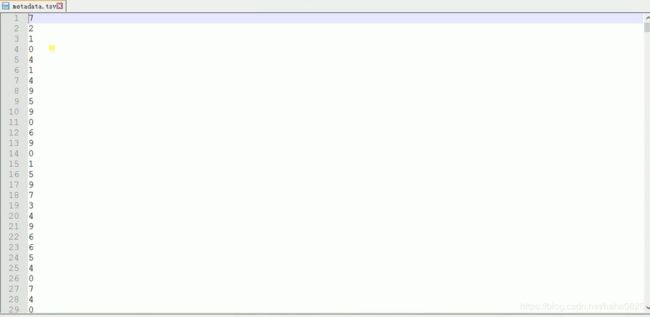

其中metadata.tsv中存放的是标签:

接着打开命令行,盘符移到当前I盘,运行tensorboard,将返回的网址在浏览器打开。

IMAGES中存放的是数据图片:

在EMBEDDINGS中是我们的训练集:

我们可以在左边栏选择显示颜色:

点击Re-run就开始训练了:

这个3D图是可以拖拽旋转的。可以看到不是100%正确,这是很正常的,有些数字写的不规范。