Solr集群架构概述及delta-import详细配置

背景

由于项目原因,重新熟悉了下Solr,版本为3.6,搭建了主从Solr服务,并使用DIH从RDBMS数据源增量更新索引。

其实也没什么技术含量,就是简单做个总结,分别从部署架构和增量更新两个方面说明下。

Solr Replication

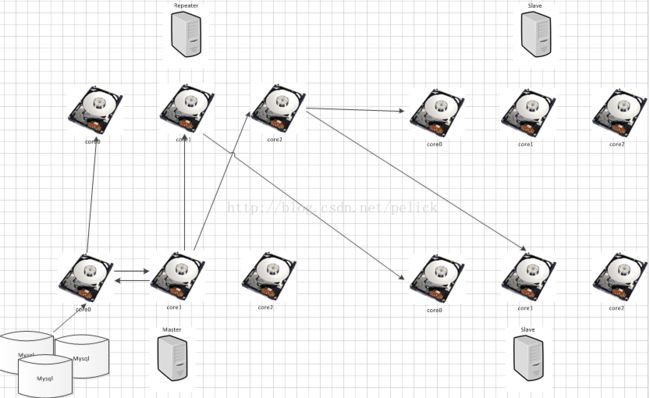

solr的主从其实是他的replication集群,从本质上说是通过ReplicationHandler来实现的,除了solr server之间可以互相同步之外,每个solr实例内部的core之间也是可以实现同步的,而能自身同步自身的实例称为Repeater,它的存在是为了分担master的同步开销,即由它来同步master里需要向外同步的core,然后所有的slave都从Repeater处同步相应的core。

具体配置方面,master的solrconfig.xml里的requestHandler配置为:

startup

commit

optimize

schema.xml,stopword.dic,db-data-config.xml,dataimport.properties

00:01:00

http://yf-rd-crm-cdc-db06.yf01.baidu.com:8888/solr/core0/replication

00:00:20

internal

5000

10000

如果对solr的搜索还有分片和负载均衡的要求,可以参考下solr4.0之后支持的SolrCloud,适合 high scale, fault tolerant, distributed indexing and search capabilities。我没有选择SolrCloud,主要原因是数据量也不是很大,不需要分片。本来想参考SolrCloud,看能不能为请求的负载均衡提供些什么优势,后来还是放弃了,负载这块在solrj的搜索服务里简单做了下轮训。网上看到也有人用Nginx为多个Tomcat容器做负载均衡,不过这个出发点和架构上的层次又有些不一样。

Solr DataImportHandler

DataImportHandler可以为solr的索引配置数据源,我的数据源是mysql,基本配置可以参考SolrDoc里的内容。不重复。

主要的坑在需要在web.xml里添加下面这个配置

org.apache.solr.handler.dataimport.scheduler.ApplicationListener

具体DIH相关的配置再详细列一下,首先在solrconfig.xml里配置Handler:

db-data-config.xml

#################################################

# #

# dataimport scheduler properties #

# #

#################################################

# 是否同步功能

# 1 - 开启 ; 否则不开启

syncEnabled=1

# 需要同步的solr core

syncCores=core0

# solr server名称或ip地址

# 默认为localhost

server=localhost

# solr server端口

# 默认80

port=8888

# webapp name

webapp=solr

# application context

# webapp=metadata-search

# 同步URL参数

params=/dataimport?command=delta-import&clean=false&commit=true

# 调度区间

# 默认30分钟

interval=1org.apache.solr.handler.dataimport.scheduler.ApplicationListenerSolr Server服务架构

结合Solr更新、主从和内部的一些主要模块,画了一个服务架构图如下。

(全文完)