Hadoop单机模式和伪分布式搭建教程CentOS

转载于http://blog.csdn.net/zhshulin/article/details/50410403#t6

按原作者方法,安装成功

首先说明一下:采用的是新装的CentOS的环境,利用xshell进行远程操作来搭建Hadoop单机模式,伪分布式和完全分布式的文档。环节都是一环套一环,有先后顺序存在。本人是在win8.1 64位系统环境下,并且安装的Cent OS也是64位,故所有相关软件都是64位的。此教程只要照着做,都可以完成,祝大家成功!

系统和软件以及版本说明:

系统和软件

VMWare Workstation11

XShell5

Cent OS 6.5 (64位)

Hadoop 2.6.0

Openjdk 1.7

1. 准备工作

1.1. 软件准备

1、安装VMWare

2、在VMWare上安装CentOS6.5操作系统

3、安装XShell5,用来远程登录系统

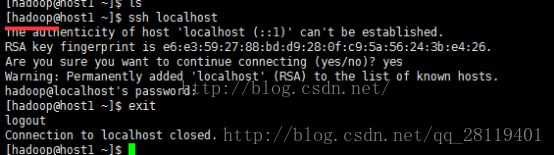

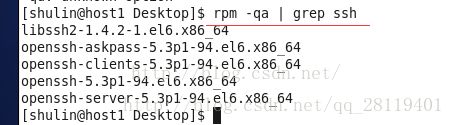

4、通过rpm -qa | grep ssh 检查cent os 是否安装了ssh server和ssh client ,然后使用ssh localhost测试一下SSH是否可用。

如果没有安装那么使用下面的命令安装:

`yum install openssh-clients

yum install openssh-server

`

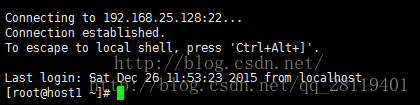

5、使用XShell远程登录服务器,接下来的操作就在XShell上通过命令行来执行了。虚拟机中的服务器可以过ifconfig这个命令来获取分配的ip地址(这个地址可能随着虚拟机的重启会发生变化)。

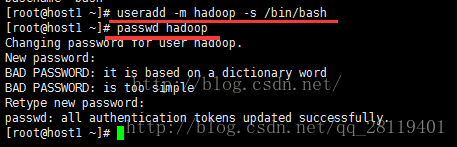

1.2. 创建hadoop用户

当前虚拟机中没有安装任何软件,那么我们的目的是搭建一个Hadoop单机模式,那么首先需要在集群中建立一个hadoop用户,用来启动Hadoop的进程,这样避免使用root用户启动进程,这也是比较规范的服务器用户管理,所以下面先创建hadoop用户:

`useradd -m hadoop -s /bin/bash

passwd hadoop #为hadoop用户设置密码,我们设置为hadoop,方便`

接下来的安装过程中会涉及到root用户和hadoop用户的切换,请大家注意!!!

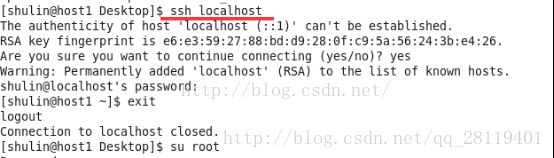

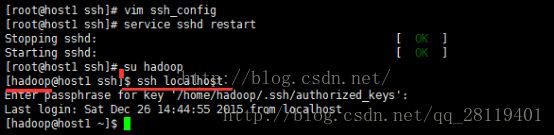

1.3. 配置SSH无密码访问

在准备工作中我们已经安装配置了SSH客户端和服务器,集群和单节点模式都需要到SSH,Hadoop中namenode需要启动集群中的所有机器的Hadoop守护进程,而这个过程需要通过SSH登录来实现。而Hadoop并没有提供SSH输入密码的登录形式,因此为了保证可以顺利登录每台机器,需要将所有机器配置为namenode可以无密码登录它们。实际中配置失败也可以运行,但是每次输入密码是非常麻烦的,所以我们需要配置SSH的无密码访问(注意无密码访问是为hadoop用户配置的,故以下操作需要在hadoop用户下完成):

cd ~/.ssh/ # 若没有该目录,请先执行一次ssh localhost

ssh-keygen -t dsa # 会有提示,都按回车就可以

cat id_dsa.pub >> authorized_keys # 加入授权

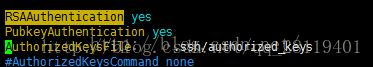

chmod 600 ./authorized_keys # 修改文件权限,如果不改,无法通过,原因好像是cent os的权限验证比较严格3.在root用户下修改/etc/ssh/sshd_config文件(取消以下三个变量的注释)

vim /etc/ssh/sshd_config service sshd restart 4.切换到hdoop用户,接下来,输入ssh localhost测试一下无密码登录,直接enter就可以,无需密码

1.4. 安装JAVA环境

Java 环境可选择 Oracle 的 JDK,或是 OpenJDK,现在一般 Linux 系统默认安装的基本是 OpenJDK,如 CentOS 6.4 就默认安装了 OpenJDK 1.7。按 http://wiki.apache.org/hadoop/HadoopJavaVersions 中说的,Hadoop 在 OpenJDK 1.7 下运行是没问题的。需要注意的是,CentOS 6.4 中默认安装的只是 Java JRE,而不是 JDK,为了开发方便,我们还是需要通过 yum 进行安装 JDK,安装过程中会让输入 [y/N],输入 y 即可:

yum install java-1.7.0-openjdk java-1.7.0-openjdk-devel通过上述命令安装 OpenJDK,默认安装位置为 /usr/lib/jvm/java-1.7.0-openjdk(该路径可以通过执行 rpm -ql java-1.7.0-openjdk-devel | grep ‘/bin/javac’ 命令确定,执行后会输出一个路径,除去路径末尾的 “/bin/javac”,剩下的就是正确的路径了)。OpenJDK 安装后就可以直接使用 java、javac 等命令了。为了方便,我们配置一下环境变量。

设置全局环境变量:

vim /etc/profile 再最后加入以下语句,设置JAVA_HOME

export JAVA_HOME=/usr/lib/jvm/java-1.7.0-openjdk-1.7.0.85.x86_64

export PATH=$JAVA_HOME/bin:$PATH

export CLASSPATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar

source /etc/profile #使变量生效

echo $JAVA_HOME #检验设置是否正确这样我们就可以在任意目录下使用java 、javac命令了。

2. 单机模式安装

1) 通过xftp将本地hadoop安装包和mds文件发送到服务器/home/hadoop目录下,然后验证tar包的完整性;若文件不完整则这两个值一般差别很大,可以简单对比下前几个字符跟后几个字符是否相等即可,如下图所示,如果两个值不一样,请务必重新下载。

"font-size:18px;">cat hadoop-2.6.0.tar.gz.mds | grep 'MD5'

md5sum hadoop-2.6.0.tar.gz | tr "a-z" "A-Z"</span>

Hadoop下载地址:

http://archive.apache.org/dist/hadoop/core/

2) 使用root账号,进入/home/hadoop目录下,解压安装文件到/usr/local/hadoop下

tar -zxvf hadoop-2.6.0.tar.gz -C /usr/local 3) 修改权限

mv hadoop-2.6.0/ hadoop/ #更改文件夹名称

chown -R hadoop:hadoop ./hadoop #修改权限 4) 验证单机模式是否安装成功,进入/usr/local/hadoop/bin目录下,执行./hadoop -version

5) 执行一个小例子

Hadoop 默认模式为非分布式模式,无需进行其他配置即可运行。非分布式即单 Java 进程,方便进行调试。

现在我们可以执行例子来感受下 Hadoop 的运行。Hadoop 附带了丰富的例子(运行./bin/hadoop jar ./share/hadoop/mapreduce/hadoop-mapreduce-examples-2.6.0.jar 可以看到所有例子),包括 wordcount、terasort、join、grep 等。

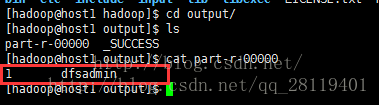

在此我们选择运行 grep 例子,我们将 input 文件夹中的所有文件作为输入,筛选当中符合正则表达式 dfs[a-z.]+ 的单词并统计出现的次数,最后输出结果到 output 文件夹中。

cd /usr/local/hadoop

mkdir ./input

cp ./etc/hadoop/*.xml ./input # 将配置文件作为输入文件

./bin/hadoop jar ./share/hadoop/mapreduce/hadoop-mapreduce-examples-*.jar grep ./input ./output 'dfs[a-z.]+'

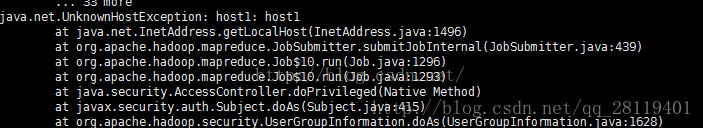

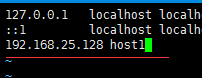

cat ./output/* # 查看运行结果 这是由于找不到这个主机,是因为我们的主机叫host1,而/etc/hosts文件中并没有这个主机名的映射,添加一下然后再运行上述命令:

执行成功后如下所示,输出了作业的相关信息,输出的结果是符合正则的单词 dfsadmin 出现了1次。

6) 为了便于Hadoop的操作,我们在为hadoop用户添加环境变量,让用户可以在任何地方执行hadoop命令,我们修改~/.bashrc文件配置,在最后添加以下命令,并且使生效(source ~/.bashrc):

export HADOOP_HOME=/usr/local/hadoop

export HADOOP_INSTALL=$HADOOP_HOME

export HADOOP_MAPRED_HOME=$HADOOP_HOME

export HADOOP_COMMON_HOME=$HADOOP_HOME

export HADOOP_HDFS_HOME=$HADOOP_HOME

export YARN_HOME=$HADOOP_HOME

export HADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/native

export PATH=$PATH:$HADOOP_HOME/sbin:$HADOOP_HOME/bin 3. 伪分布式安装

前提:已经安装完成单机模式。

伪分布式只需要在单机模式的基础上改两个配置文件并且格式化namenode即可。

vim /usr/local/hadoop/etc/hadoop/core-site.xml

(core-site.xml的配置项可以在这里查找:http://hadoop.apache.org/docs/r2.6.0/hadoop-project-dist/hadoop-common/core-default.xml)

添加如下配置:

<property>

<name>hadoop.tmp.dirname>

<value>file:/usr/local/hadoop/tmpvalue>

property>

<property>

<name>fs.defaultFSname>

<value>hdfs://host1:9000value>

property> Hdfs-site.xml可以在这里查找(http://hadoop.apache.org/docs/r2.6.0/hadoop-project-dist/hadoop-hdfs/hdfs-default.xml)

<property>

<name>dfs.replicationname>

<value>1value>

property>

<property>

<name>dfs.namenode.name.dirname>

<value>file:/usr/local/hadoop/tmp/dfs/namevalue>

property>

<property>

<name>dfs.datanode.data.dirname>

<value>file:/usr/local/hadoop/tmp/dfs/datavalue>

property>

分别修改/usr/local/hadoop/etc/hadoop下的hadoop-env.sh和yarn-env.sh:

export JAVA_HOME=/usr/lib/jvm/java-1.7.0-openjdk-1.7.0.85.x86_64

export HADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/native

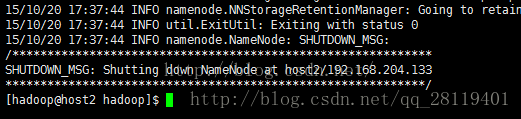

export HADOOP_OPTS="-Djava.library.path=$HADOOP_HOME/lib"格式化namenode:

hdfs namenode -format 成功的话,会看到 successfully formatted 的提示,且倒数第5行的提示如下,Exitting with status 0 表示成功,若为 Exitting with status 1 则是出错。若出错,请仔细检查之前步骤。

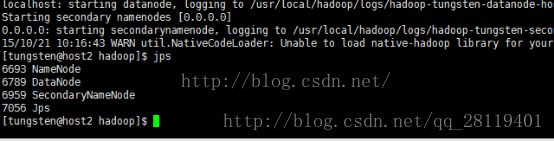

start-dfs.sh #启动hdfs