第3章 下载缓存

缓存还是不缓存,这是一个问题

3.1 缓存还是不缓存

当爬取目的不是为了获取即时的,最新的数据时,可以使用缓存。缓存之后可以离线进行数据分析等。一个可行的方案是,了解到需要爬取的数据会在多久开始更新,设置定期清理缓存功能。

3.2 未链接爬虫添加缓存支持

考虑到要为下载函数添加检查缓存功能,又想保留download()的纯粹下载网页功能。

将之前的download函数重构为一个类.

import requests

from urllib.parse import urlparse

import time

class Downloader(object):

def __init__(self,retries=3,user_agent='wswp',proxies=None,cache={}):#缓存默认为一个字典

self.retries=retries

self.user_agent='wswp'

self.proxies=proxies

self.cache=cache

def __cal__(self,url):

domain=urlparse(url).netloc#获取url域名

result=cache.get('domain')

if result and 500<=result['code']:

result=None

if result is None:

result=download(url)

cache[domain]=result

return result['html']

def download(self,url):

try:

print('downloading: ',url)

headers={user_agent:self.user_agent}

resp=requests.get(url,headers=headers,proxies=self.proxies)

html=resp.text

if resp.status_code>400:#对于http状态码大于400的响应,会将错误信息存在resp.text中,而不会引发异常

print('Download Error:',r.text)

html=None

if 500<=resp.status_code<600 and retries:

print('Download again:',url)

retries-=1

return download(url)

except requests.exception.RequestException as e:#对于状态码下于400的响应错误,会引发异常,直接except

return {'html':None,'code':500}#便于获取缓存时,和其他error统一处理

return {'html':html,'code':resp.status_code}

3.3磁盘缓存

3.3.1文件名合法考虑

考虑非法符号

这些字符为非法字符::*?"<>| ,使用re检查

filename=re.sub(r'[\\:\*\?"<>|]','_',filename)

考虑文件名长度

文件名长度最大为255个字符,因此这里作如下限制:(针对windows系统)

filename='\\'.join(segment[:255] for segment in filename.split('/'))

url转文件名函数

#url解析器

In [21]: url='http://example.python-scraping.com/places/default/view/Aland-Islands-2'

In [22]: from urllib.parse import urlparse

In [23]: urlparse(url)

Out[23]: ParseResult(scheme='http', netloc='example.python-scraping.com', path='/places/default/view/Aland-Islands-2', params='', query='', fragment='')

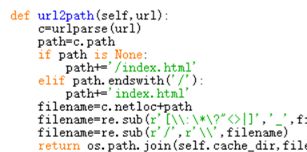

def url2path(self,url):

con=urlparse(url)

filename=con.netloc+con.path

filename=re.sub(r'[\\:\*\?"<>|]','_',filename)

filename='\\'.join(segment[:250] for segment in filename.split('/'))

path=os.path.join(self.cache_dir,filename)

接下来定义一个缓存类(字典鸭子:重构字典)

修改该类的getitem()和setitem()

import re,os

from urllib.parse import urlparse

import json,zlib

class DiskCache(object):

def __init__(self,cache_dir='D:\study\python\python_crawler\data\cache',

iscompress=True,encoding='utf-8'):#iscompress解压标志,默认为True

self.cache_dir=cache_dir

self.encoding=encoding

def __getitem__(self,url):

path=url2path(url)

mode='rb'if self.compress else 'r'

with open(path,mode) as fp:

if compress:

json_data=zlib.dempress(fp.read()).decode(self.encoding)

result=json.load(json_data)

else:

result=json.load(f.read())

return result

def __setitem__(self,url,result):

path=url2path(url)

dirname=os.path.dirname(path)#写入文件前判断父文件夹是否存在

if not os.path.exists(dirname):

os.makedirs(dirname)

mode ='wb' if self.compress else 'w'

with open(url2path,mode) as fp:

date=json.dumps(result)

if self.compress:

data=zlib.compress(bytes(data,self.encoding))

fp.write(data)

def url2path(self,url):

con=urlparse(url)

filename=con.netloc+con.path

filename=re.sub(r'[\\:\*\?"<>|]','_',filename)

filename='\\'.join(segment[:250] for segment in filename.split('/'))

path=os.path.join(self.cache_dir,filename)

缓存前:

64.83803725242615

缓存后:

2.2727208137512207

重复爬取时,速度提升巨大。

3.3.2 节省磁盘空间

在写入文件前,将序列化字符串通过zlib压缩即可

改进方法:

link_crawler()增加参数 iscompress

压缩流程:

1.python对象-》序列化字符串(通过json或picke模块转换)

2.序列化字符串-》二进制文件(通过bytes())

3.将zlib.compress(data)写入文件

解压流程:

1,zlib.decompress(fp.read()).decoding(encoding)

DiskCache中的getitem(),setitem()做些许变化

getitem():

3.3.3清理过期数据

在存入缓存的时候将过期时间也存入结果集合result

getitem()部分:

expire_date=p_data.get('expire_date')

#print('过期时间:',expire_date)

if expire_date and datetime.strptime(expire_date,'%Y-%m-%dT%H:%M:%S')<=datetime.now():

raise KeyError(url,'has expired')

seltitem()部分:

expire_date=(datetime.now()+self.expires).isoformat(timespec='seconds')#将过期的日期存入结果集合

print('过期时间:',expire_date)

result['expire_date']=expire_date

3.3.5 磁盘缓存缺点

【问题】缓存下载时,若出现某次缓存失败,下次重新缓存就可能会报错

【解决方案】检查缓存,若不为空则清空,再重新缓存

之前的url2path中,对于filename的‘使合法处理’可能导致:

多个url映射为同一个文件名

3.4 键值对存储缓存

Redis

3.4.1安装Redis

Redis是一个开源的使用ANSI C语言编写、支持网络、可基于内存亦可持久化的日志型、Key-Value数据库,并提供多种语言的API

安装好redis服务之后,打开python命令行:

In [1]: import redis

In [2]: r=redis.StrictRedis()

In [3]: r.set('name','anchor')

Out[3]: True

In [4]: r.get('name')

Out[4]: b'anchor'

即完成了一个键值对的存储

3.4.2 redis缓存实现

import json

from datetime import datetime,timedelta

from redis import StrictRedis

import zlib

'''使用redis的好处:

1,不占用本地内存

2,不需要大费周章解决文件名的相关问题

3,使用起来实在太方便

'''

class RedisCache:

def __init__(self,client=None,expires=timedelta(days=30),encoding='utf-8',

iscompress=True):

self.client=(StrictRedis(host='localhost',port=6379,db=0)

if client is None else client)

self.expires=expires

self.encoding=encoding

self.iscompress=iscompress

def __getitem__(self,url):

record=self.client.get(url)

if record:

if self.iscompress:

try:

record=zlib.decompress(record)

except zlib.error:

raise KeyError(url+'缓存有错误')

return json.loads(record.decode(self.encoding))

else:

raise KeyError('cache '+url+'does not exists')

def __setitem__(self,url,result):

data=bytes(json.dumps(result),self.encoding)#保证result是序列化字符串并且保持编码一致性

if self.iscompress:

data=zlib.compress(data)

self.client.setex(url,self.expires,data)#redis会自动将过期的缓存清理掉