首先给大家道歉,很长一段时间没有写文章了。

今天我们继续学习爬虫的课程,之前我们接触了urllib,urllib2的方法应用。其实在现在的市场上,urllib的方法已经很少使用,但是作为新手入门是个很好的切入点,为学习之后的知识点做铺垫。客气话少说,直接开撸。

Requests: 让HTTP为人类服务

Requests 唯一的一个非转基因的 Python HTTP 库,人类可以安全享用。

警告:非专业人员使用其他 HTTP 库会导致危险的副作用,其中包括:安全缺陷症、冗余代码症、重新发明轮子症、啃文档症、抑郁、头疼、甚至死亡(如有生命危险,概不负责)。诺,这就是 Requests 的威力,当然这也是python库的威力(python库是最多的,其他语言无法比拟的)。

ok,让我们先看一下Requests的简单案例:

import requests

print(requests.get("http://www.baidu.com").text)

上面简写的代码就可以完成爬取百度源码的任务,是不是超乎你的想象。下面就让我们开水学习requests。

一、安装requests

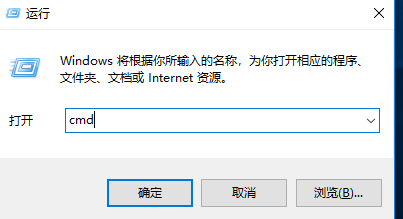

我们是在windows下面运行,按Ctrl+R打开命令行,输入cmd回车

之后在命令行输入pip install requests。稍等片刻,就可以肆无忌惮的使用这个库。

二、requests的使用

1、requests的各种请求方法

import requests

requests.get("http://www.baidu.com")

requests.post("http://www.baidu.com")

requests.delete("http://www.baidu.com")

requests.put("http://www.baidu.com")

requests.head("http://www.baidu.com")

requests.options("http://www.baidu.com")

1.1、GET请求

1.1.1无参数GET请求

import requests

response = requests.get("http://www.baidu.com")

print(response.text)

向url发送请求,得到响应数据,在上述例子中get方法里面只有url参数。

1.1.2、带参数GET请求

- 1、请求参数在url中

比如,我们在百度搜索框输入黄鹂,想要得到搜索后的数据

import requests

response = requests.get("http://www.baidu.com/s?ie=utf-8&wd=黄鹂")

print(response.text)

OK,这就是把参数直接放入url中。

- 2、请求体包含参数

首先先将参数包含在dict中,发起请求参数时param参数指定为dict。

import requests

param = {

"wd": "黄鹂"

}

response = requests.get("http://www.baidu.com/s?", params = param)

print(response.text)

结果同上,上述就可以得到我们想要的数据

1.2 POST请求

1.2.1 发送表单格式的数据

import requests

param = {

"wd": "黄鹂"

}

response = requests.post("http://www.baidu.com/s?", data = param)

print(response.text)

1.2.2 发送JSON数据

import requests, json

param = {

"wd": "黄鹂"

}

response = requests.post("http://www.baidu.com/s?", data = json.dumps(param))

print(response.text)

1.2.3 发送文件数据

import requests, json

file = {

"file": open("huangliniao.jpg", "rb")

}

response = requests.post("http://image.baidu.com/?fr=shitu",files = file)

print(response.text)

1.3 获取数据的格式

import requests

response = requests.get("http://httpbin.org/get")

#输出文本数据

print(response.text)

#输出二进制数据

print(response.content)

#输出json数据

print(response.json())

举个栗子(爬取刘亦菲图片并保存到本地)

import requests

response = requests.get("http://i.shangc.net/2017/1231/20171231023951903.jpg")

print(response.content)

with open("liuyifei.jpg", "wb") as f:

f.write(response.content)

1.4 设置headers

import requests

# 设置User-Agent浏览器信息

headers = {

"User-Agent": "Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/63.0.3239.132 Safari/537.36"

}

# 设置请求头信息

response = requests.get('https://www.jianshu.com/u/d5030633f94a', headers=headers)

#print(response.text)

with open("jianshu.html", "wb") as f:

f.write(response.content)

1.5 获取和发送cookies

1.5.1 获取有道翻译cookies值

import requests

response = requests.get("http://fanyi.youdao.com")

for i in response.cookies:

print(i.name + "--" + i.value)

1.5.2 发送cookies到 有道翻译

import requests

url = "http://fanyi.youdao.com"

cookies = {"i.name":"i.value"}

response1 = requests.get(url = url, cookies = cookies)

print(response1.text)

当然上述两段代码可以在同一个文件下运行

1.6 session会话保存

import requests

session = requests.Session()

session.get('http://httpbin.org/cookies/set/number/12345')

response = session.get('http://httpbin.org/cookies')

print(response.text)

1.7 设置代理

1.7.1 普通代理

import requests

proxies = {

"http": "http://127.0.0.1:9743",

"https": "https://127.0.0.1:9743",

}

response = requests.get("https://www.taobao.com", proxies=proxies)

print(response.read())

1.7.2 账号密码代理

import requests

proxies = {

"http": "http://user:[email protected]:9743/",

}

response = requests.get("https://www.taobao.com", proxies=proxies)

print(response.read())

1.7.3 设置socks代理

import requests

proxies = {

'http': 'socks5://127.0.0.1:9742',

'https': 'socks5://127.0.0.1:9742'

}

response = requests.get("https://www.taobao.com", proxies=proxies)

print(response.status_code)

status_code 的意思是状态码,表示相应的状态

1.8 异常处理

import requests

from requests.exceptions import ReadTimeout, ConnectionError, RequestException

try:

response = requests.get("http://www.baidu.com", timeout=0.5)

print(response.status_code)

except ReadTimeout:

# 超时异常

print('Timeout')

except ConnectionError:

# 连接异常

print('Connection error')

except RequestException:

# 请求异常

print('Error')