韩国N号房之恶,最小受害者11岁!我们能寄希望于AI吗

大数据文摘出品

作者:牛婉杨、曹培信、刘俊寰、马莉

我们与恶的距离或许比想象中更近。

3月22日,一名代号“博士”(真名赵主彬)的男子被韩国警方拘捕,揭开了一个隐藏在网络角落的大型犯罪“暗地”。

从2018年开始,一个网名为“Godgod”的人便开始在推特上寻找他眼中的“性感”女性照片,冒充警察威逼利诱受害者们拍摄裸照,再用这些照片威胁受害者,对受害者实施性剥削,并在Telegram上的聊天室发布这些性剥削画面供会员观看并收取会费。

被收费进入的会员更加变本加厉的提出各种变态要求,“Godgod”也一一满足,一时间要求加入聊天室的人也变得越来越多,很快地聊天室也从唯一的1号房扩展2号房、3号房……,这也是N号房的由来。

随着加入的人越来越多,团伙还根据发布的内容建立不同的房间,“女教师房”、“女护士房”、“女中学生房”,甚至还有“女童房”。

平均每个聊天室有3到4个受害者,而一个聊天室里有300到700个观看者不等,当受害者开始反抗时,他们便利用掌握的个人信息去威胁受害者,让她们“一辈子都活在这种恐惧之中”。

去年7月,赵立彬创立了第二个N号房,并利用自己的手段将整个犯罪体系变得更加完善,手下有大量的志愿者给他工作,受害人数也变得更多。

截至2020年3月22日,韩国警方所掌握线索的被害女性多达74人,其中16人为未成年人,最小年龄受害者为年仅11岁的小学生,甚至有不止一名女性因为不堪羞辱,而选择自杀身亡。

直到今年初,2位作为卧底一直潜伏在n号房内部的大学生卧底记者在收集到足够的证据之后向警察举报了N号房,才把这令人发指的犯罪事实详细地报道出来。

更令人震惊的是,参与过Telegram N号房的观看者超过26万,占了韩国目前男性的1%。但除了最终卧底的记者,在长达3年的时间里,没有任何一个参与者挺身而出,举报这一可怕的组织。

一些韩国民众认为,在房间里观看的每一个人都是杀人犯——26万会员对犯罪行为袖手旁观,因此向青瓦台发出请愿,要求公开“博士”犯罪集团成员以及所有“N号房”会员的身份和照片。

受害者迹象?AI技术能做什么?

“N号房”事件持续发酵,让人们再次感受到了比任何电影剧情都可怕的人性之恶,也掀起了对互联网犯罪和技术平台使用的全民反思。

尽管很难找到共性,但网上侵害在发生之前,依然会发生一些行为迹象:

恭维你:奉承和许诺或许是侵害行为的苗头,例如有人说可以帮助你当模特或明星。

说服你私聊:侵害者通常试图说服受害人离开普通聊天室或大众社交媒体,通过短信或更私密的工具私聊。

向你索要照片:一旦这些侵害着有了照片,他们就能利用受害者。

对于执法者和父母来说,手机和聊天工具的隐蔽性让他们很难直接获取这些迹象,但如果技术公司能够将相关“敏感词”及“警告程序”加入侦查过程,或许能够在悲剧发生前进行预先警示。

2018年下半年,微软组织了一次黑客编程马拉松大赛(hackathon),Facebook、谷歌和在线游戏巨头Roblox等公司的工程师与法律专家均参与其中。大赛的初衷就是构建能够有效检测这些“互联网捕食者”的AI工具,以及建立起受害方的信任。

为了能够理解更好地理解线上女性/儿童捕食者的套路,团队分析了上万条儿童捕食者与未成年人的会话,系统能够在要求儿童离开平台进入一对一的对话模式时,会发出提示音以示警告。

在黑客编程比赛之后的几个月内,微软与Roblox和及时通信服务提供商Kik在内的其他公司进行了进一步的合作,来优化AI工具,使它能基于特征对两人的对话进行评估和评级,并对其指定风险等级,如果风险足够高,这些会话将被发送给AI审核。

如果系统识别到有侵害未成年人人身安全的风险,例如提到了私下会面等,AI将通知当地的执法机构,在大多数案例中,被标记的会话会报告给NCMEC(National Center for Missing & Exploited Children,美国国家失踪与受虐儿童援助中心)。

微软首席数字安全官Courtney Gregoire说:“如果考虑要如何解决这个问题,我们已经能做到反应和报告,但还不能实现预防。”

另一位微软发言人声称,该AI工具能在任何基于文本的环境下工作,包括苹果的iMessage和WhatsApp。他还表示,已经拥有聊天过滤系统的Roblox正在把微软AI工具整合到他们的平台上,作为双重保障。

除了微软,这些公司也尝试用技术阻止线上侵害

Facebook全球安全负责人Antigone Davis去年曾向《金融时报》透露,该公司在过去几年中一直在与儿童保护组织合作,开发保护平台上的儿童免受侵害的方法。

Antigone Davis表示,相关措施包括当有人在Messenger和Instagram DM上要求与儿童进行私下聊天,或试图在未成年人多次拒绝的情况下依然要求获取联系方式时进行警报。

除了Facebook,推特也积极响应着举报有性侵儿童可能的行为的相关政策,推特表示,一旦发现有账号发布儿童色情内容,推特官方会在不通知当事者的情况下第一时间进行删除,对其他用户的举报也会进行及时的审核。

谷歌的行动则更早,从2013年开始,谷歌便设立500万美元的基金用于“根除网络虐童图像” 行动,并启动了200万美元的儿童保护技术基金,以鼓励开发更好的工具来销毁儿童色情作品。

另外,谷歌还开发了一个关于儿童色情和虐待图像标记的数据库,这些图像可以与其他搜索引擎和儿童保护组织共享,数据库将帮助自动消除这类内容。

时任谷歌Giving总监杰奎琳 · 富勒(Jacquelline Fuller)在博客中表示,“这将使公司、执法部门和慈善机构更好地合作,及时发现和删除这些图像,并采取积极行动打击犯罪分子。”

隐私安全vs弱者保护,Telegram的尴尬地位

Lindsey Olson是国家失踪与受剥削儿童中心(National Center for Missing and Exploited Children,NCMEC)执行董事,她说,尽管法律要求技术公司上报网络平台上明显儿童性虐待的案例,但并没有要求上报可疑的网络诱骗犯。

这也是本次N号房案件中,第三方平台Telegram面临的尴尬地位。

作为一个跨平台的即时通讯软件,Telegram一直以可以相互交换加密与自毁消息,发送照片、影片等所有类型文件著称。据了解,Telegram的加密模式是基于256位对称AES加密,RSA 2048的加密和Diffie-Hellman的安全密钥交换协议,除此之外,Telegram传递的消息为函数,可扩展性相当强。

Telegram曾经承诺:只要有任何人能够破解拦截的通讯内容,会提供10万美元的奖金。截止到目前,只有一个人拿到过这笔奖金,他发现的也仅是一个可能会导致问题的隐患。用Telegram的创始人Pavel Durov的话说就是,“Telegram就是为了隐私和安全而生的,绝不向任何势力妥协”。

但是,N号房案件的爆发,也正是基于警方、犯罪分子等都无法进行监控的安全系统,这似乎也很好的“打了创始人的脸”,因为这些“加密”的信息也有可能成为犯罪分子滋生的温床。

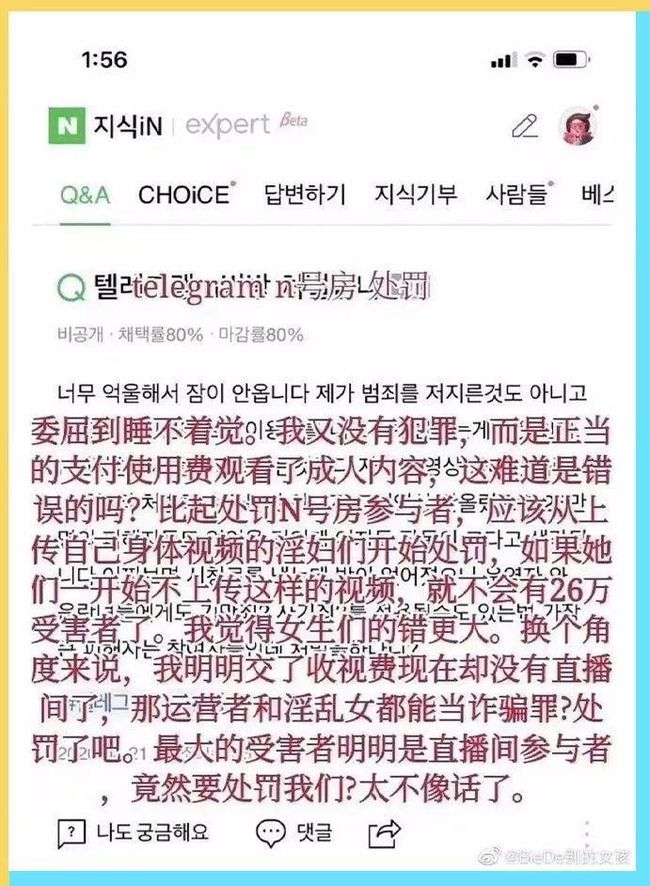

正如N号房事件中,有一些男性会员认为自己只是付费观看了成人电影,并不构成犯罪,“自己才是受害者”,同时还指责被胁迫的女性从一开始就不应该再推特上上传自己的大尺度照片。Telegram也面临着这样的指控境地。

图片来自微博-别的女孩

作为N号房事件发生的平台,Telegram无法从此次事件中全身而退。正如微博网友所说,这种“绝对的自由”就像是“回退到了原始丛林”一样。

而代价无疑是巨大的,去年全球范围内,技术公司及公众自愿举报的这类案例已经从2018年的12,000起增长到19,000起。Olson认为这些数字足以体现问题的严重性。

Olson说:“现在许多未成年人和孩子们都有手机,侵略者更容易找到想要侵害的对象,孩子们也更容易发送自己露骨的照片。这些人不需要与孩子们有身体接触,就能对孩子造成巨大伤害。”

AI能比“聪明的坏人”更聪明吗?

不止韩国,这类通过互联网诈骗胁迫进行性侵的犯罪一直都在发生,《华盛顿邮报》上周也报道了一起类似手段的案件。

据受害者Rhiannon McDonald回忆,十三岁的一个晚上,她曾与一位模特星探在线聊天,在短短数小时的聊天中,她被胁迫发送了许多自己的裸照,还提供了自己的家庭住址。第二天,这名“星探”出现在了家门口,对Rhiannon实施了性侵。

现年30岁的McDonald表示,多年来她一直深陷这件事情带来的阴影中,备受心理恐慌的折磨,两次自杀未遂。

最近,她联系到了英国的一家非盈利组织Marie Collins基金会,该组织致力于帮助那些遭受网络性虐待和性剥削的受害儿童,也第一次全盘向媒体说出了自己的这一可怕经历。

McDonald没有告诉任何人发生在她身上的一切,直到6个月之后警察出现在她家。由于与多起类似案件相关,警察最终逮捕了这个人,并在他的电脑里发现了她的信息。最终这个人被判刑11年。

McDonald最后还说,整件事情都没有告诉她的父亲,她害怕父亲会对她发脾气。但后来她意识到,父亲从来没有责备过她。她说:“他告诉我,他一直很自责,因为他觉得自己应该一直监督着我。但是对于他来说,察觉到这件事真的很难。”

尽管现在未成年人使用的网络平台不同了(当年McDonald是AOL Instant Messenger用户),但儿童侵略者的伎俩基本相同,通常先是花言巧语诱骗受害者,如果他们不同意分享照片或私下会面就紧接着实施威胁。长久以来,技术公司也试图避免这类案件的发生,但在人工智能工具出现之前,几乎不可能检测到这些行为。

正如McDonald所说,最尽职的父母甚至都很难知道孩子在网上做的任何事。她希望技术能提供帮助。“如果在聊天过程中能被AI识别到,就有机会拯救孩子。”

而问题是,保护儿童与陌生人在线聊天的AI系统,它们的进化速度是否真的能超越施暴者。

微软表示,未来会继续教AI识别可能侵犯儿童的人的话术,但也指出了问题所在,有时候,甚至我们都难以区分对方的话是否充满恶意。Courtney Gregoire说:“他们的花言巧语不断变化着,如何分辨真正的友谊?又该如何一眼看穿他们的丑恶嘴脸呢?”

据韩国联合新闻报道,震惊全球的N号房幕后操纵者”博士“大学期间主修信息通信,成绩优异。

我们可以想象他熟知Telegram这类平台的运营规则,而在施暴之前,也巧妙避开了可能存在的风险。面对这样无所畏惧又熟知技术的对手,AI的作用还能够发挥出来吗?

人性之恶有时候比无人性的技术更甚。而更让人悲哀的是,3年来,明明有26万人看到了可怕的罪行,我们却仍然只能寄希望于人工智能保护自己。

相关报道:

https://www.wsj.com/articles/predators-use-the-internet-to-hideai-is-trying-to-unmask-them-11582626600

https://www.engadget.com/2019-10-18-facebook-anti-predator-measures.html

https://googleblog.blogspot.com/2013/06/our-continued-commitment-to-combating.html

http://cafe.daum.net/N.487634467