人脑拆机三部曲:为什么我支持马斯克,而人类应该畏惧人工智能

“在人工智能一片叫好的合唱中,总偶尔有两三个不和谐的声音。这不和谐的代表在名人界是霍金,在企业界是伊隆·马斯克。人工智能圈内对霍金的反驳多是其为外行,不理解人工智能的最新发展。对伊隆·马斯克的反驳则温柔得多,因为其公司特斯拉是人工智能的大户与前沿,是业内人士,不能以外行来简单驳斥。”

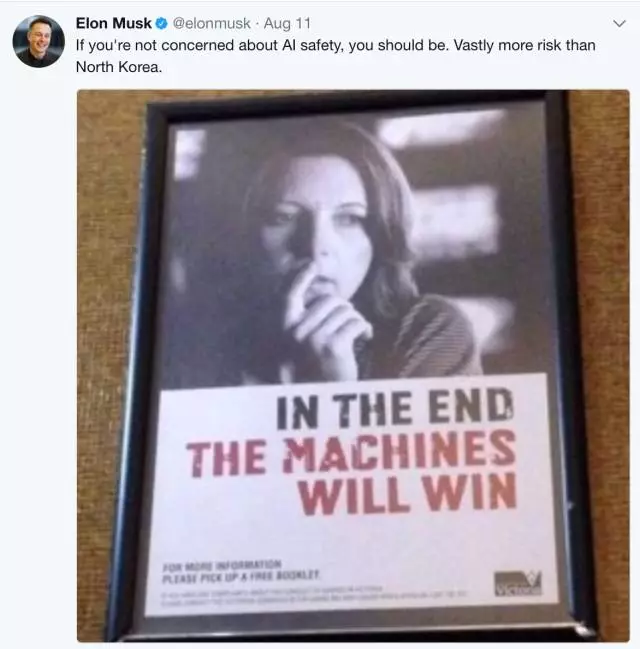

这是比特大陆芯片研发总监谢丹向新智元投来的稿件的开头。仿佛是为了配合这段话,马斯克在推特上又更新了状态,这次他说:如果你还没开始担心人工智能的安全问题,那该开始担心了。人工智能比朝鲜“更危险”。

照片下面,几个大字分外鲜明:最终,机器会获胜。

本文作者谢丹,比特大陆芯片研发总监。美国硅谷8年芯片研发经验,后担任某初创企业研发总监,直至其上市。业界称履历某地区所有芯片设计企业的CTO;成功Tape-out数款芯片,工艺制程从0.35um至16nm;全定制、单元库、定制模块、图形芯片、交换机芯片等多种设计领域的资深专家。

在人工智能一片叫好的合唱中,总偶尔有两三个不和谐的声音。这不和谐的代表在名人界是霍金,在企业界是伊隆·马斯克。人工智能圈内对霍金的反驳多是其为外行,不理解人工智能的最新发展。对伊隆·马斯克的反驳则温柔得多,因为其公司特斯拉是人工智能的大户与前沿,是业内人士,不能以外行来简单驳斥。

其实,马斯克和霍金还有个共同点:他们都是学物理的,他们的思维更多是物理学背景的思维。物理学的思维模式和学数学/计算机科学不太一样,物理学家一贯觉得自己眼界远些。在我看来,最近马斯克在推特上被围攻,真是物理学与CS关系的常见现象。

马斯克在他的访谈中多次把自己的成功和远见归功于物理学思维方式,即第一原理思维。比如他的访谈中提到:我们运用「第一原理思维」而不是「比较思维」去思考问题是非常重要的。我们在生活中总是倾向于比较——别人已经做过了或者正在做这件事情,我们就也去做。这样的结果是只能产生细小的迭代发展。「第一原理」的思考方式是用物理学的角度看待世界的方法,也就是说一层层剥开事物的表象,看到里面的本质,然后再从本质一层层往上走。这要消耗大量的脑力。

如何看待人工智能,在物理学的角度看,我们可以参考自然界的智能:人的智能。我们来拆拆人脑智能这个机器,看看造就它的基本原因是什么?简单分析下来,还是三个因素:硬件、软件和大数据。

区分人以及黑猩猩的基因并不多,而且大多是身体结构上的。黑猩猩属与人类有最近的共同祖先,研究指出人类和黑猩猩属有99.4%的基因一模一样,智商相当于人类5~7岁。这次进化分叉后直立人从大约8百万年到百万年间多次走出非洲但多次灭绝,直到20万年前的一次成功出走。DNA分析现代人类都有着共同祖先,是大约15-20万年前一男一女的后代,即所谓夏娃和亚当理论。我觉得20万年前这个时间点可以算做人类的硬件ready的充分点:即从这个点之后,人类大脑硬件有了突破,智能相对其它生物有了强大的生物竞争优势。

人类学家和生物学家一直想找到这个突破后面的机制,目前尚未找到。但是我们至少看到很强的证据:无论你怎么培养/教育黑猩猩,甚至在多代的教育下,黑猩猩依然无法超过6-7岁的智力水准。因此,我觉得这个约束来自人类大脑的约束,是硬件的约束。

从20万年前进入到2万年前,人类逐渐从强大竞争优势变成了压倒性竞争优势,人更多的战争来自人与人之间,而不是人与自然生物之间了。现代人的任何一支分支在某个地理都是处于该区域的生态链最高层。这段时间应该有另外一个飞跃,这个飞跃很可能是来自于人类大脑硬件的能力充分发挥。很多人类学家认为,这个因素可能是语言,有人认为是农业、宗教等。我们可以认为,因为复杂语言的出现,人的大脑智能得以快速的提升,可以认为是大脑软件的成功。

更近的一次人类智能大飞跃,则比较清楚明确了:文字。在5000年前左右,人类开始出现文字,文字不仅可以将思想传播从父传到子,而且可以在群体内以及群体间传播。人类的知识/智能在这之后基本就是一条方向线的发展,这个阶段可以算是知识的积累。换句话说:这是个大数据驱动的人类智能的发展。

所以,总结下,人类智能的发展大致是二十万年前硬件ready(大脑的基因),2万年前软件ready(复杂语言的行成),5千年前开始大数据驱动(文字的形成)。

我们再来看看人工智能在最近的飞跃发展,人工智能到了哪一步?

随着学术界深度神经网络在图像和声音的效果体现以及2016年李世石与阿尔法狗世纪之战,我们基本可以说,这是硬件和软件都ready 了。特别是围棋的突破,它的意义有两个:第一,它和图像与声音这两个学术界重重研究不同, 这基本是个新功能,它的成功表明了人工智能的普适性。第二,围棋是业界公认无法靠硬件突破的,所以它的成功可以标杆是软件的ready。(因为在人工智能成功之前,我们不知道到底是硬件限制还是软件限制)

为什么这两点这么重要?因为半导体有一个摩尔定律:每18个月性能增倍。这个翻译过来,就是每5年性能提高10倍。

在深度学习之前,电脑围棋的段位大致在业余四段,行业内(围棋界和计算机界)认为要达到世界冠军水准大约需要20年。但是深度学习引入之后,2016年就战胜了李世石,软件提前了二十年的硬件发展。也就是说,这深度学习让硬件可能提高了差不多一万倍的效率。

然后在一年之后,新版的阿尔法狗就基本能让柯洁三子了。(澄清:阿尔法狗和柯洁从未下过让子棋,但是新版阿尔法狗可以让旧版三子,柯洁私下说过让两子自己会输,而且柯洁和阿尔法之战完全无胜机,这是差三子水准的表现)。当然,这次飞跃的原因是阿尔法狗几千万局自我对局后的结果,也就是大数据驱动的智能上升。

所以在围棋这个单一智能的表现上,人工智能从硬、件软件和大数据全面体现了其超越性。这其中,软件和大数据的威力更是超出预期。深度学习软件使得围棋能力提高了万倍的效率,那么大数据提高了多少呢?围棋在阿尔法狗之前的十年大约从业余初段升到业余四段,这是个相差两子强三子弱的水平差。在一年之后的新版阿尔法狗能让一年前版本三子,也就是说大数据一年的提高相当于硬件10年100倍的硬件提升。

在人类围棋的历史上,导致围棋智能上升三子大概有两次:一次是日本道策采用手割的原理,对围棋子力的量化分析;一次是吴清源和木谷实提出的新布局理论,从全局地与势的棋子配合进行局面分析。这两次本身可能只有两子的提高,但是之后众人的完善则能造成3子的进步。从围棋产生到道策大约是2000年的对局积累,从道策到新布局是近三百多年的对局积累,而阿尔法狗只花了一年。道策之前大约有几千局对局棋谱,认真分析了大约几百局;新布局之前大约有十几万的对局棋谱,认真分析了的大约几千局;阿尔法狗通过数千万的对局,认真分析多少不知。这似乎也表明智能的提升一个等级,数据至少要一百倍以上的差异啊。

三子在围棋界中有个梗:围棋之神能让我三子。意思是任何一个时代最强大的棋手,在被问到与围棋之神的差距时,都会回答大概三子吧。所以,当谷歌告诉中国棋院和柯洁新版阿尔法狗能让旧版三子时,柯洁被吓呆了。可惜,当神来时,中国棋院的选择是分先下,称之谓捍卫人类尊严。这样被碾压,不知道是怎么捍卫了人类尊严。如果真进行了让两子和让三子的比赛,或许真能逼出阿尔法狗的最强手段,让我们能一窥神的境界吧。阿尔法狗在更多对局下还能再长三子的棋力吗?因为阿尔法狗不再继续研究围棋,我们无法知道了。从大数据上说,估计阿尔法狗至少还需要再100倍以上数十亿次对局的棋谱,才有可能。这个成本在目前太大了,估计没有什么意义。

在金融、自动驾驶、图像识别、围棋、语音识别、语言翻译、疾病诊断等各个智能领域,现在人工智能基本都到了这样的地步:比大多数普通人强,接近专家水准,比顶尖专家差。这可能是因为这些领域中的大数据不可能像围棋这么容易快速获得、游戏胜负规则不是围棋这样能简单易判断造成的。但是,假设有更强大的硬件,更简明规则/更优化的软件,更长时间积累的大数据,理论上,人工智能的进化是无限的。

在现在这个点,约束人工智能大规模布置的原因是什么?其实已经基本不是硬件而是成本了。要建一套顶尖的人工智能,目前至少需要投资硬件、软件、人员等1-10亿美元以上。所以最开始被广泛布置人工智能的金融、搜索结果优化、自动驾驶等,都是能带来巨大市场回报的。不过摩尔定律:每10年芯片降低100倍的价格,可以想象下10年20年后人工智能的领域将会扩展到百倍万倍更小得多的市场领域,应用场景无限广泛。

更强大硬件、更优化软件以及更直接大量的数据,人工智能在每个方面的进步速度都远远地超过我们。就像所有人类发明的机器一样,任何一个功能一旦被超越,人类再没有机会反超回去了。

假设说,人工智能只是能替代更多的工作,我们对其是不需要恐惧的。AI代替人类工作这种担忧,就和自动化代替人类工作一样,会被人类社会通过各种手段逐渐化解。现代科技的机械化和自动化大大地提高人类生活品质,从而导致人类社会文化的大繁荣,人类在现代社会中音乐文学艺术影视等非生产性的从业人数比例是一直上升的。即使少部分人会受到影响,人类社会整体在人工智能发展中是会收益巨大的。

对于人工智能把人类变成奴隶的担忧,也基本不可能出现。因为无论是做为动力的蒸汽机还是做为智能的人工智能,都有着一样的弱点:功能极强大但转化效率极低。单位能耗下的智能不仅与人类相差遥远,而且估计可能永远无法超越人类。人工智能和所有机器一样存在着能源获得的约束、易被破坏、功能单一等不可克服的缺点。而且人类做为一个整体,智能是非常睿智的,对于邪恶的人工智能这种可能,相信人类是能够找到预防和隔离的办法的。

其实人工智能真正的危险应该来自:邪恶个人控制的人工智能。当20年后,要开发一套新功能的人工智能只需要几万美元,各种调试软件的办法更加成熟,数据无比丰富。一个疯狂科学家(mad scientist)是很可能通过人工智能对社会带来强大的破坏性。这本来就是现代科技与现代社会的弱点:毁灭与建设的成本对比是不断下降的。比如911 恐怖袭击后,为了防止下一个911,投入的成本与恐怖分子投入的成本比例估计是上万倍了。

假设疯狂者把人工智能应用在设计传染性更强死亡率更高的病毒、寻求人群密度更高的恐怖袭击、能自己行走自己寻找目标的人工智能自杀炸弹、更挑动人群情绪的钓鱼谣言、能更有效洗人头脑的广告宣传、散布偏见与仇恨的思想、研发制造原子核武器等等。这种邪恶个人控制下的人工智能,才是各个政府与社会最头痛的,我们如何防止最可怕的后果,才是人类社会最大的风险。

人工智能不能毁灭人类,但是人可能毁灭人类。正是对此后果的畏惧,才使得马斯克投入大量资金去研发航天火箭。防止某些人毁灭人类,或许隔离才是最有效的措施,人类现在能看到的最严密的隔离大概就是星球间的间距吧。(如果是人工智能毁灭了人类,星球间的间距根本无法阻止人工智能的进击)

这是马斯克的远见还是他的杞人忧天,我们大多数人有生之年就可能看到结果的。

文章转自新智元公众号,原文链接