推荐系统系列:NFM模型理论和代码实现

一、前言

发表于2017年的推荐类文章,主要采用的是串行结构即将FM中的一次项和二次项结果输入给DNN部分,典型的串行结构还包括PNN和AFM等都会在接下来进行介绍,本文的论文地址为:https://arxiv.org/pdf/1708.05027.pdf

二、算法原理

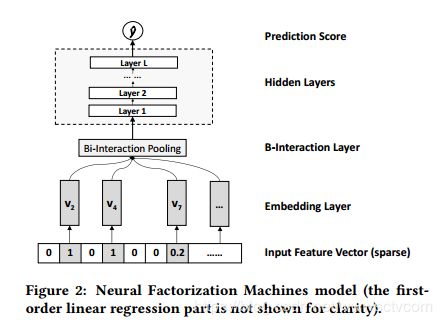

(1)模型的整体框架如图所示:主要包含输入的embedding,其次是一个Bi-Interaction Pooling层,随后是一个DNN部分对结果进行预测;

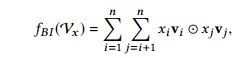

(2)首先介绍Bi-Interaction Pooling,这一部分主要是采用的哈达玛积;

如论文中所述:哈达玛积的相乘方式如下公式;

![]()

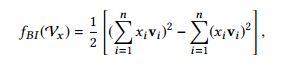

随后通过化简可以得到:

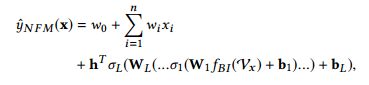

(3)随后经过一个DNN部分可以得到如下的结果:

(4)总结一下所有的,可以将整个过程表示为如下公式所述,其实还是很简单的;

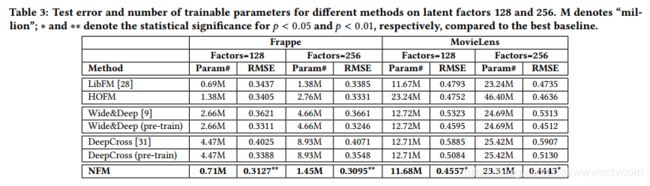

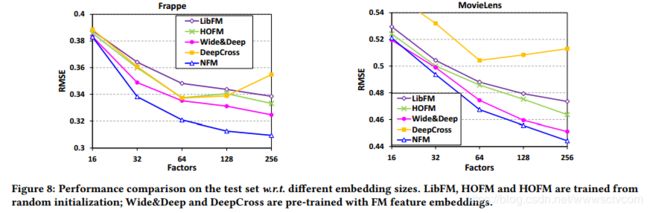

三、实验效果

四、代码实现

代码部分只实现比较核心(Bi-Interaction Pooling)的部分,其他部分的地方需要自己补充,这里总感觉和FM很相似;主要区别就是这里的输出直接连接的是DNN,所以是串行结构和并行结构还是有区别的;

from tensorflow.python.keras.layers import Layer

import tensorflow as tf

class bi_interaction(Layer):

def __init__(self, **kwargs):

super(bi_interaction, self).__init__(**kwargs)

def build(self, input_shape):

super(bi_interaction, self).build(input_shape)

def call(self, inputs):

concat_embed_value = inputs

square_of_sum = tf.square(tf.reduce_sum(concat_embed_value, axis=1, keep_dims=True))

sum_of_square = tf.reduce_sum(concat_embed_value * concat_embed_value, axis=1, keep_dims=True)

cross = 0.5 * (square_of_sum - sum_of_square)

return cross#(batch , 1, embed_size)