Python静态网页爬虫项目实战

本爬虫是基于《Python爬虫开发与项目实战》一书实现的,基于现在的网页版本进行更新,可以成功抓取数据。

爬虫基础架构和流程

《Python爬虫开发与项目实战》一书中的介绍和图

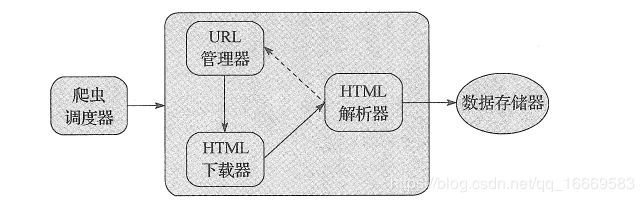

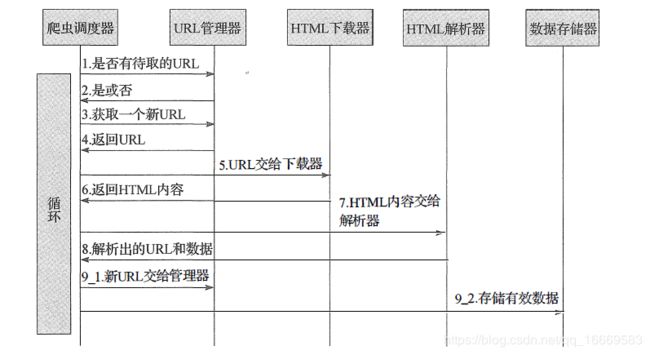

首先介绍爬虫的基础架构和流程如下图所示:

基础爬虫框架主要包括五大模块, 分别为爬虫调度器、URL 管理器、HTML 下载器、 HTML解析器、数据存储器。功能分析如下:

已爬虫调度器主要负责统筹其他四个模块的协调工作。

- URL管理器负责管理URL链接 9 维护已经爬取的URL集合和未爬取的URL集合,提供获取新URL链接的接口。

- HTML下载器用于从URL管理器中获取未爬取的URL链接并下载HTML网页。

- HTML解析器用千从HTML下载器中获取已经下载的HTML网页,并从中解析出新的URL链接交给URL管理器, 解析出有效数据交给数据存储器。

- 数据存储器用于将HTML解析器解析出来的数据通过文件或者数据库的形式存储起来。下而通过图6-3展示一下爬虫框架的动态运行流程, 方便大家理解。

(1)URL管理器

URL 管理器主要包括两个变量, 一个是已爬取 URL的集合, 另 个是未爬取 URL的集合。采用 Python 中的 set 类型, 主要是使用 set 的去重复功能, 防止链接重复爬取, 因为爬取链接重复时容易造成死循环。链接去重复在 Python 爬虫开发中是必备的功能,解决方案主要有三种: 1) 内存去重 2) 关系数据库去重 3) 缓存数据库去重。大型成熟的爬虫基本上采用缓存数据库的去重方案,尽可能避免内存大小的限制,又比关系型数据库去重性能高很多。由于基础爬虫的爬取数量较小, 因此我们使用 Python 中 set 这个内存去重方式。

#coding:utf-8

class UrlManager(object):

def __init__(self):

#未爬取URL集合

self.new_urls = set()

#已爬取URL集合

self.old_urls = set()

def has_new_url(self):

"""

判断是否有未爬取的URL

:return:

"""

return self.new_url_size() != 0

def get_new_url(self):

"""

获取一个未爬取的URL

:return:

"""

new_url = self.new_urls.pop()

self.old_urls.add(new_url)

return new_url

def add_new_url(self, url):

"""

将新的URL添加到未爬取的URL集合

:param url: 单个URL

:return:

"""

if url is None:

return

if url not in self.new_urls and url not in self.old_urls:

self.new_urls.add(url)

def add_new_urls(self, urls):

"""

将新的URL集合合并到未爬取集合中

:param urls: url集合

:return:

"""

if urls is None or len(urls) == 0:

return

for url in urls:

self.add_new_url(url)

def new_url_size(self):

"""

未爬取URL集合大小

:return:

"""

return len(self.new_urls)

def old_url_size(self):

"""

获取已经爬取URL集合大小

:return:

"""

return len(self.old_urls)(2) HTML下载器

HTML下载器用来下载网页,这时候需要注意网页的编码,以保证下载的网页没有乱码。下载器需要用到Requests模块, 里面只需要实现一个接口即可: download(url)。 程序HtmlDownloader. py代码如下:

#coding:utf-8

import requests

class HtmlDownloader(object):

def download(self, url):

if url is None:

return None

user_agent = 'Mozilla/4.0 (compatible; MSIE 5.5; Windows NT)'

headers = {'User-Agent': user_agent}

r = requests.get(url, headers = headers)

if r.status_code == 200:

r.encoding = 'utf-8'

return r.text

return None(3) HTML解析器

HTML解析器使用Beautifu1Soup4进行HTML解析。需要解析的部分主要分为提取相关词条页面的URL和提取当前词条的标题和摘要信息。

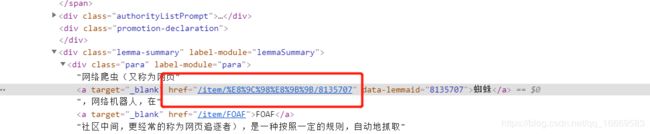

针对不同的网站需要自己去查看网页结构,本博客以百度百科为例:

此外,我们还需要从当前网页中提取超链接以便于进一步抓取,查看网页结构可以得到:

对于这种标签我们可以使用正则表达式匹配

soup.find_all('a', href = re.compile(r'/item/\w+'))完整代码如下:

#coding:utf-8

import re

import urlparse

from bs4 import BeautifulSoup

class HtmlParser(object):

def parser(self, page_url, html_cont):

"""

用于解析网页内容

:param page_url: 下载页面url

:param html_cont: 下载页面内容

:return:

"""

if page_url is None or html_cont is None:

return

soup = BeautifulSoup(html_cont, 'html.parser')

new_urls = self._get_new_urls(page_url, soup)

new_data = self._get_new_data(page_url, soup)

return new_urls, new_data

def _get_new_urls(self, page_url, soup):

"""

抽取新的URL集合

:param page_url: 下载页URL

:param soup: soup对象

:return:

"""

new_urls = set()

#抽取符合要求的a标记

links = soup.find_all('a', href = re.compile(r'/item/\w+'))

for link in links:

#提取href属性

new_url = link['href']

#拼接完整url

new_full_url = urlparse.urljoin(page_url, new_url)

new_urls.add(new_full_url)

return new_urls

def _get_new_data(self, page_url, soup):

"""

抽取有效数据

:param page_url: 页面URL

:param soup: soup对象

:return:

"""

data = {}

data['url'] = page_url

title = soup.find('dd', class_='lemmaWgt-lemmaTitle-title').find('h1')

data['title'] = title.get_text()

summary = soup.find('div', class_='lemma-summary')

data['summary'] = summary.get_text()

return data(4)数据存储

#coding : utf-8

import codecs

class DataOutput(object):

def __init__(self):

self.datas = []

def store_data(self, data):

if data is None:

return

self.datas.append(data)

def output_html(self):

fout = codecs.open('baike.html', 'w', encoding='utf-8')

fout.write("")

fout.write("")

fout.write("")

for data in self.datas:

fout.write("")

fout.write("%s " % data['url'])

fout.write("%s " % data['title'])

fout.write("%s " % data['summary'])

fout.write(" ")

self.datas.remove(data)

fout.write("

")

fout.write("")

fout.write("")

fout.close()(5)爬虫调度器(主函数)

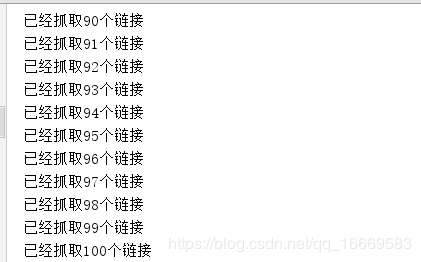

以上已经对URL管理器、 HTML下载器、 HTML解析器和数据存储器等模块进行了实现, 接下来编写爬虫调度器以协调管理这些模块。 爬虫调度器首先要做的是初始化各个模块, 然后通过crawl(root—url)方法传入入口URL, 方法内部实现按照运行流程控制各个模块的工作。 爬虫调度器SpiderMain. py的程序如下:

# coding:utf-8

from UrlManager import UrlManager

from HtmlParser import HtmlParser

from HtmlDownloader import HtmlDownloader

from DataOutput import DataOutput

class SpiderMain(object):

def __init__(self):

self.manager = UrlManager()

self.downloader = HtmlDownloader()

self.parser = HtmlParser()

self.output = DataOutput()

def crawl(self, root_url):

#添加入口yrl

self.manager.add_new_url(root_url)

#判断url管理器中是否有新的url,同时判断抓取了多少个url

while (self.manager.has_new_url() and self.manager.old_url_size() < 100):

try:

#从URL管理器获取新的url

new_url = self.manager.get_new_url()

#HTML下载器下载网页

html = self.downloader.download(new_url)

#HTML解析器抽取网页数据

new_urls, data = self.parser.parser(new_url, html)

#将抽取的url添加到url管理器

self.manager.add_new_urls(new_urls)

# 数据存储器存储文件

self.output.store_data(data)

print('已经抓取%s个链接' % self.manager.old_url_size())

except Exception, e:

print("crawl failed")

self.output.output_html()

if __name__=="__main__":

spider_main = SpiderMain()

spider_main.crawl("https://baike.baidu.com/item/%E7%BD%91%E7%BB%9C%E7%88%AC%E8%99%AB/5162711?fromtitle=%E8%9C%98%E8%9B%9B&fromid=8135707")爬取结果如下: