OpenVINO的安装和使用

- 环境安装

python 3.6

Pip

make-3.16.0

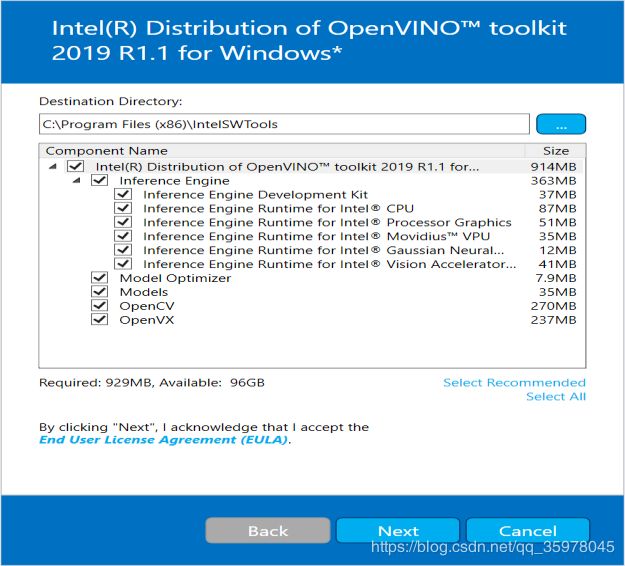

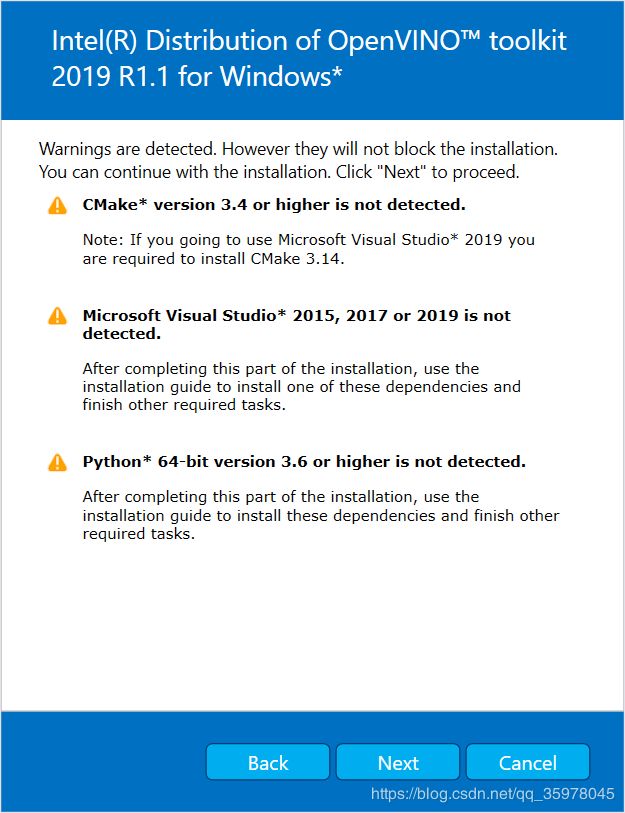

Openvino 安装

官方文档

https://docs.openvinotoolkit.org/2019_R2/_docs_install_guides_installing_openvino_windows.html#set-the-environment-variables

![]()

注意安装的时候不要改变他的路径,不然好多目录找不到

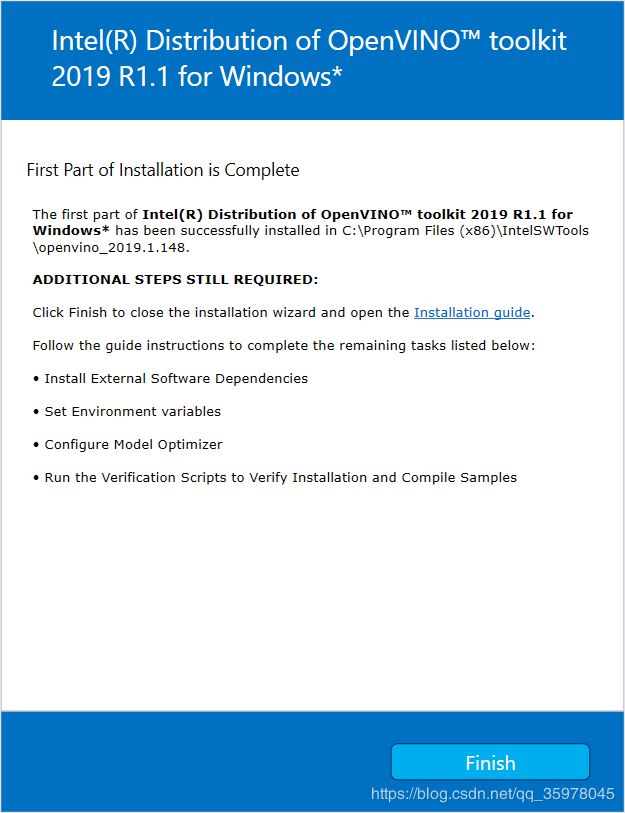

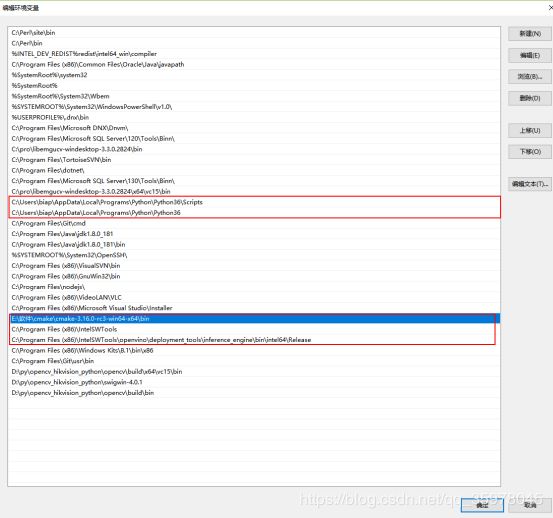

安装完成后配置环境变量:

重启后打开命令窗体

cd C:\Program Files (x86)\IntelSWTools\openvino\deployment_tools\model_optimizer\install_prerequisites

install_prerequisites.bat

cd C:\Program Files (x86)\IntelSWTools\openvino\deployment_tools\model_optimizer\install_prerequisites

install_prerequisites_tf.bat

- 模型转换

模型转换 tensorFlow 的pd 转换成IR

python “C:\Program Files (x86)\IntelSWTools\openvino\deployment_tools\model_optimizer\mo_tf.py” --input_model="E:\TF\graph.pb" --output_dir="TF" --data_type="FP32" --batch=1

模型转换 tensorFlow 的pd 转换成IR

python “C:\Program Files (x86)\IntelSWTools\openvino\deployment_tools\model_optimizer\mo_tf.py” --input_model="E:\TF\graph.pb" --output_dir="TF" --data_type="FP32" --batch=1

转换成NCS的IR模型 神经棒用的

python “C:\Program Files (x86)\IntelSWTools\openvino\deployment_tools\model_optimizer\mo_tf.py” --input_model frozen_inference_graph.pb --output_dir lrmodels/FP16 --data_type FP16 --batch 1

python "C:\Program Files (x86)\IntelSWTools\openvino\deployment_tools\model_optimizer\mo_tf.py" --input_model "E:\TF\graph.pb" --output_dir="TF" --input_shape=[1,512,512,3]

注意: --input_shape=[1,512,512,3] 512和训练的对应

可能出现的问题

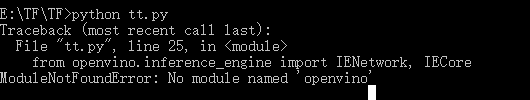

找不到模块

把C:\Program Files (x86)\IntelSWTools\openvino_2019.3.334\python\python3.6 添加到python 环境中

2.找不到引用

添加系统环境变量

C:\Program Files (x86)\IntelSWTools\

openvino\deployment_tools\inference_engine\bin\intel64\Release

SSD 转换成IE模型

https://docs.openvinotoolkit.org/latest/_docs_MO_DG_prepare_model_convert_model_Convert_Model_From_TensorFlow.html

python “C:\Program Files (x86)\IntelSWTools\openvino\deployment_tools\model_optimizer\mo_tf.py” --input_model frozen_inference_graph.pb --tensorflow_use_custom_operations_config="C:\Program Files (x86)\IntelSWTools\openvino\deployment_tools\model_optimizer\extensions\front\tf\ssd_v2_support.json" --tensorflow_object_detection_api_pipeline_config="pipeline.config" --input_shape=[1,300,300,3] --output_dir lrmodels/FP16 --data_type FP16

ssd_v2_support.json 要对应训练的版本