hadoop分布式系统基础架构学习

什么是Hadoop?

Hadoop是一个由Apache基金会所开发的分布式系统基础架构。

用户可以在不了解分布式底层细节的情况下,开发分布式程序。充分利用集群的威力进行高速运算和存储。

Hadoop实现了一个分布式文件系统(Hadoop Distributed File System),简称HDFS。HDFS有高容错性的特点,并且设计用来部署在低廉的(low-cost)硬件上;而且它提供高吞吐量(high throughput)来访问应用程序的数据,适合那些有着超大数据集(large data set)的应用程序。HDFS放宽了(relax)POSIX的要求,可以以流的形式访问(streaming access)文件系统中的数据。

Hadoop的框架最核心的设计就是:HDFS和MapReduce。HDFS为海量的数据提供了存储,而MapReduce则为海量的数据提供了计算

Hadoop的优点:

Hadoop是一个能够对大量数据进行分布式处理的软件框架。 Hadoop 以一种可靠、高效、可伸缩的方式进行数据处理。

Hadoop 是可靠的,因为它假设计算元素和存储会失败,因此它维护多个工作数据副本,确保能够针对失败的节点重新分布处理。

Hadoop 是高效的,因为它以并行的方式工作,通过并行处理加快处理速度。

Hadoop 还是可伸缩的,能够处理 PB 级数据。

此外,Hadoop 依赖于社区服务,因此它的成本比较低,任何人都可以使用。

Hadoop是一个能够让用户轻松架构和使用的分布式计算平台。用户可以轻松地在Hadoop上开发和运行处理海量数据的应用程序。它主要有以下几个优点:

高可靠性。Hadoop按位存储和处理数据的能力值得人们信赖。

高扩展性。Hadoop是在可用的计算机集簇间分配数据并完成计算任务的,这些集簇可以方便地扩展到数以千计的节点中。

高效性。Hadoop能够在节点之间动态地移动数据,并保证各个节点的动态平衡,因此处理速度非常快。

高容错性。Hadoop能够自动保存数据的多个副本,并且能够自动将失败的任务重新分配。

低成本。与一体机、商用数据仓库以及QlikView、Yonghong Z-Suite等数据集市相比,hadoop是开源的,项目的软件成本因此会大大降低。

Hadoop带有用Java语言编写的框架,因此运行在 Linux 生产平台上是非常理想的。Hadoop 上的应用程序也可以使用其他语言编写,比如 C++。

hadoop大数据处理的意义

Hadoop得以在大数据处理应用中广泛应用得益于其自身在数据提取、变形和加载(ETL)方面上的天然优势。Hadoop的分布式架构,将大数据处理引擎尽可能的靠近存储,对例如像ETL这样的批处理操作相对合适,因为类似这样操作的批处理结果可以直接走向存储。Hadoop的MapReduce功能实现了将单个任务打碎,并将碎片任务(Map)发送到多个节点上,之后再以单个数据集的形式加载(Reduce)到数据仓库里。

HDFS的主要模块

1.NameNode:

- 功能:是整个文件系统的管理节点。维护整个文件系统的文件目录数,文件/目录的源数据和每个文件对应的数据快列表。用于接受用户的请求。

2.DataNode:

- 是HA(高可用性)的一个解决方案,是备用镜像,但不支持热设备

一、Hadoop单机版测试

1.建立hadoop用户,设置密码

[root@server1 ~]# useradd hadoop

[root@server1 ~]# id hadoop

uid=1000(hadoop) gid=1000(hadoop) groups=1000(hadoop)

[root@server1 ~]# passwd hadoop

2.安装hadoop及jdk并制作软链接

[root@server1 ~]# ls

hadoop-3.0.3.tar.gz jdk-8u181-linux-x64.tar.gz

[root@server1 ~]# mv * /home/hadoop/

[root@server1 ~]# su - hadoop

[hadoop@server1 ~]$ ls

hadoop-3.0.3.tar.gz jdk-8u181-linux-x64.tar.gz

[hadoop@server1 ~]$ tar zxf hadoop-3.0.3.tar.gz

[hadoop@server1 ~]$ ln -s hadoop-3.0.3 hadoop

[hadoop@server1 ~]$ tar zxf jdk-8u181-linux-x64.tar.gz

[hadoop@server1 ~]$ ln -s jdk1.8.0_181/ java

[hadoop@server1 ~]$ ls

hadoop hadoop-3.0.3.tar.gz jdk1.8.0_181

hadoop-3.0.3 java jdk-8u181-linux-x64.tar.gz

3.配置java的环境变量

[hadoop@server1 ~]$ cd /home/hadoop/hadoop/etc/hadoop/

[hadoop@server1 hadoop]$ vim hadoop-env.sh

54 export JAVA_HOME=/home/hadoop/java

[hadoop@server1 hadoop]$ cd

[hadoop@server1 ~]$ vim .bash_profile

PATH=$PATH:$HOME/.local/bin:$HOME/bin:$HOME/java/bin

[hadoop@server1 ~]$ source .bash_profile

[hadoop@server1 ~]$ jps 测试java的环境变量

11690 Jps

4.测试

[hadoop@server1 ~]$ cd hadoop

[hadoop@server1 hadoop]$ mkdir input

[hadoop@server1 hadoop]$ cd input/

[hadoop@server1 input]$ ls

[hadoop@server1 input]$ cd ..

[hadoop@server1 hadoop]$ cp etc/hadoop/*.xml input

[hadoop@server1 hadoop]$ ls input/

capacity-scheduler.xml hdfs-site.xml kms-site.xml

core-site.xml httpfs-site.xml mapred-site.xml

hadoop-policy.xml kms-acls.xml yarn-site.xml

[hadoop@server1 hadoop]$ bin/hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-3.0.3.jar grep input output 'dfs[a-z.]+'

[hadoop@server1 hadoop]$ ls

bin include lib LICENSE.txt output sbin

etc input libexec NOTICE.txt README.txt share

[hadoop@server1 hadoop]$ cd output/

[hadoop@server1 output]$ ls

part-r-00000 _SUCCESS

[hadoop@server1 output]$ cat *

1 dfsadmin

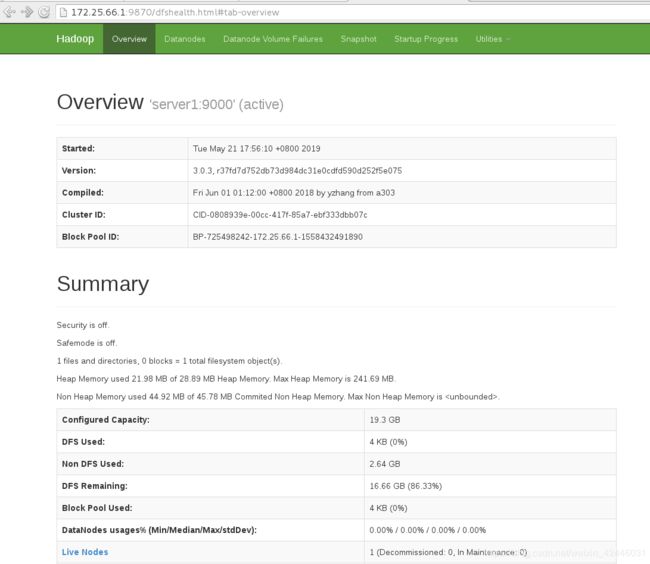

二、伪分布式Hadoop

1.编辑hadoop配置文件

[hadoop@server1 ~]$ cd hadoop

[hadoop@server1 hadoop]$ cd etc/hadoop/

[hadoop@server1 hadoop]$ vim core-site.xml

fs.defaultFS

hdfs://172.25.66.1:9000

[hadoop@server1 hadoop]$ vim hdfs-site.xml

dfs.replication

1 自己充当节点

2.生成密钥做免密连接

[hadoop@server1 hadoop]$ ssh-keygen

[hadoop@server1 hadoop]$ ssh-copy-id localhost

3.格式化并且开启服务

[hadoop@server1 hadoop]$ bin/hdfs namenode -format

[hadoop@server1 hadoop]$ cd sbin/

[hadoop@server1 sbin]$ ./start-dfs.sh

Starting namenodes on [server1]

Starting datanodes

Starting secondary namenodes [server1]

[hadoop@server1 sbin]$ jps

12592 SecondaryNameNode

12279 NameNode

12391 DataNode

5.测试:创建目录,上传文件

[hadoop@server1 hadoop]$ bin/hdfs dfs -mkdir -p /user/hadoop

[hadoop@server1 hadoop]$ bin/hdfs dfs -ls

[hadoop@server1 hadoop]$ bin/hdfs dfs -put input

[hadoop@server1 hadoop]$ bin/hdfs dfs -ls

Found 1 items

drwxr-xr-x - hadoop supergroup 0 2019-05-21 18:12 input

[hadoop@server1 hadoop]$

删除input和output文件

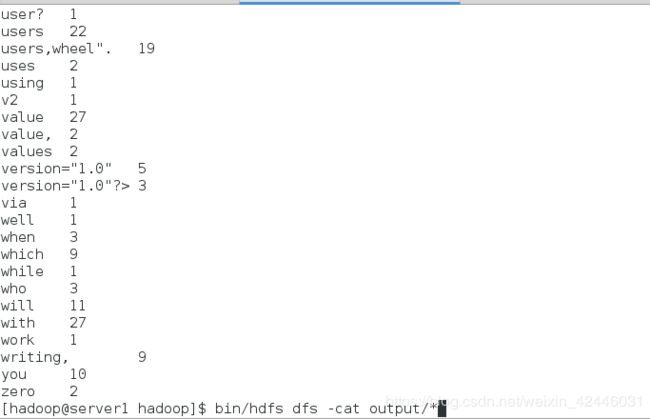

[hadoop@server1 hadoop]$ bin/hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-3.0.3.jar wordcount input output

[hadoop@server1 hadoop]$ rm -fr input/

[hadoop@server1 hadoop]$ rm -fr output/

[hadoop@server1 hadoop]$ bin/hdfs dfs -get output

[hadoop@server1 hadoop]$ cd output/

[hadoop@server1 output]$ ls

part-r-00000 _SUCCESS

我们可以发现当我们删除本地的input和output后本地文件时没有了,但是hadoop分布式文件系统中人然存在,网页上可以看到,我们也可以通过get的方法下载ouput等

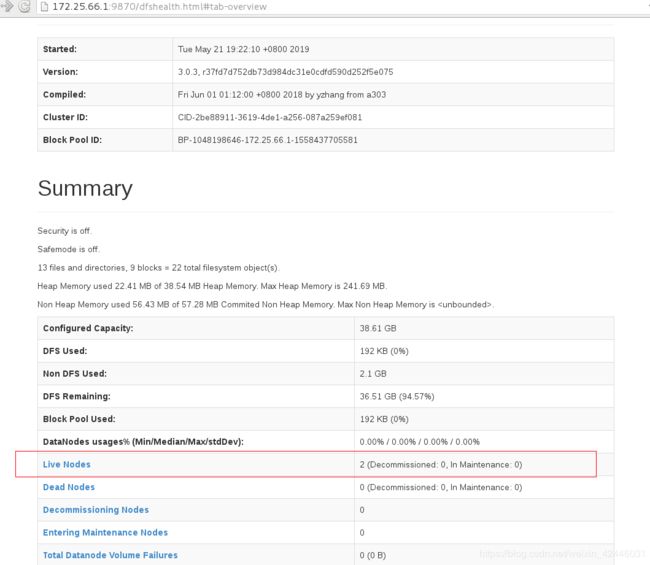

三、分布式

1.首先关闭服务,清除原来的

[hadoop@server1 ~]$ cd hadoop

[hadoop@server1 hadoop]$ sbin/stop-dfs.sh

Stopping namenodes on [server1]

Stopping datanodes

Stopping secondary namenodes [server1]

[hadoop@server1 hadoop]$ cd /tmp/

[hadoop@server1 tmp]$ ls

hadoop hadoop-hadoop hsperfdata_hadoop

[hadoop@server1 tmp]$ rm -fr *

2.开启两个虚拟机server2和server3做Datanode

在hadoop的datanode必须是完全同步的,那么我们可以用一个简单的办法使他们做到完全同步,那就是使用nfs文件系统

[root@server2 ~]# useradd hadoop

[root@server3 ~]# useradd hadoop

server1-3安装nfs-utils

[root@server1 ~]# yum install -y nfs-utils

[root@server2 ~]# yum install -y nfs-utils

[root@server3 ~]# yum install -y nfs-utils

[root@server1 ~]# systemctl start rpcbind

[root@server2 ~]# systemctl start rpcbind

[root@server3 ~]# systemctl start rpcbind

3.server1开启nfs服务,进行配置

[root@server1 ~]# systemctl start nfs-server

[root@server1 ~]# vim /etc/exports

/home/hadoop *(rw,anonuid=1000,anongid=1000)

[root@server1 ~]# exportfs -rv

exporting *:/home/hadoop

[root@server1 ~]# showmount -e

Export list for server1:

/home/hadoop *

4.server2,server3挂载server1分享的文件目录

[root@server2 ~]# mount 172.25.66.1:/home/hadoop /home/hadoop/

[root@server2 ~]# df

Filesystem 1K-blocks Used Available Use% Mounted on

/dev/mapper/rhel-root 20240384 1098904 19141480 6% /

devtmpfs 497244 0 497244 0% /dev

tmpfs 508264 0 508264 0% /dev/shm

tmpfs 508264 13072 495192 3% /run

tmpfs 508264 0 508264 0% /sys/fs/cgroup

/dev/sda1 201380 119172 82208 60% /boot

tmpfs 101656 0 101656 0% /run/user/0

172.25.66.1:/home/hadoop 20240384 2796800 17443584 14% /home/hadoop

[root@server3 ~]# mount 172.25.66.1:/home/hadoop/ /home/hadoop/

5.测试不同节点之间的免密登陆(挂载则不用密码)

[root@server1 ~]# su - hadoop

[hadoop@server1 ~]$ ssh 172.25.66.2

[hadoop@server2 ~]$ logout

Connection to 172.25.66.2 closed.

[hadoop@server1 ~]$ ssh 172.25.66.3

The authenticity of host '172.25.66.3 (172.25.66.3)' can't be established.

ECDSA key fingerprint is 75:d4:75:9c:83:30:28:73:4d:23:a8:21:58:08:f2:60.

Are you sure you want to continue connecting (yes/no)? yes

Warning: Permanently added '172.25.66.3' (ECDSA) to the list of known hosts.

[hadoop@server3 ~]$ logout

Connection to 172.25.66.3 closed.

[hadoop@server1 ~]$

6.编辑hadoop的配置文件

[hadoop@server1 ~]$ cd hadoop/etc/hadoop/

[hadoop@server1 hadoop]$ vim core-site.xml

fs.defaultFS

hdfs://172.25.66.1:9000

[hadoop@server1 hadoop]$ vim hdfs-site.xml

dfs.replication

2 改为两个节点

[hadoop@server1 hadoop]$ cat workers

172.25.66.2

172.25.66.3

[hadoop@server2 ~]$ cd hadoop/etc/hadoop/

[hadoop@server2 hadoop]$ cat workers

172.25.66.2

172.25.66.3

发现nfs成功,一台服务器配置,则其他的就都配置了

7.格式化,并且启动服务

[hadoop@server1 hadoop]$ pwd

/home/hadoop/hadoop

[hadoop@server1 hadoop]$ bin/hdfs namenode -format

[hadoop@server1 hadoop]$ sbin/start-dfs.sh

Starting namenodes on [server1]

Starting datanodes

Starting secondary namenodes [server1]

[hadoop@server1 hadoop]$ jps

15314 SecondaryNameNode 出现SecondaryNameNode

15428 Jps

15096 NameNode

从节点可以看到datanode信息

[hadoop@server2 hadoop]$ jps

12771 DataNode

12835 Jps

[hadoop@server3 ~]$ jps

2705 Jps

2610 DataNode

[hadoop@server1 hadoop]$ bin/hdfs dfs -mkdir -p /user/hadoop

[hadoop@server1 hadoop]$ bin/hdfs dfs -mkdir input

[hadoop@server1 hadoop]$ bin/hdfs dfs -ls

Found 1 items

drwxr-xr-x - hadoop supergroup 0 2019-05-21 20:48 input

[hadoop@server1 hadoop]$ bin/hdfs dfs -put etc/hadoop/*.xml input

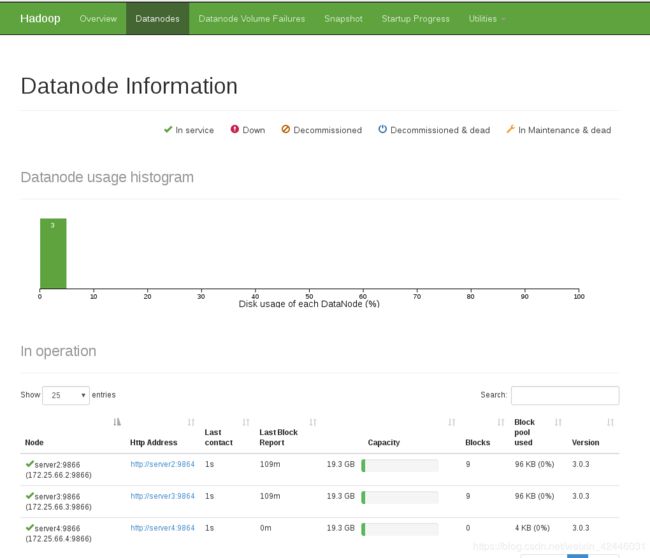

server4节点添加

[root@server4 ~]# useradd hadoop

[root@server4 ~]# passwd hadoop

Changing password for user hadoop.

New password:

BAD PASSWORD: The password is shorter than 8 characters

Retype new password:

passwd: all authentication tokens updated successfully.

[root@server4 ~]# yum install -y nfs-utils

[root@server4 ~]# systemctl start rpcbind

[root@server4 ~]# mount 172.25.66.1:/home/hadoop/ /home/hadoop/

[root@server4 ~]# su - hadoop

[hadoop@server4 ~]$ cd hadoop/etc/hadoop/

[hadoop@server4 hadoop]$ vim workers

[hadoop@server4 hadoop]$ cat workers

172.25.66.2

172.25.66.3

172.25.66.4

[hadoop@server4 hadoop]$ sbin/hadoop-daemon.sh start datanode

WARNING: Use of this script to start HDFS daemons is deprecated.

WARNING: Attempting to execute replacement "hdfs --daemon start" instead.

[hadoop@server4 hadoop]$ jps

3672 Jps

3610 DataNode