- Python从0到100(三十九):数据提取之正则(文末免费送书)

是Dream呀

pythonmysql开发语言

前言:零基础学Python:Python从0到100最新最全教程。想做这件事情很久了,这次我更新了自己所写过的所有博客,汇集成了Python从0到100,共一百节课,帮助大家一个月时间里从零基础到学习Python基础语法、Python爬虫、Web开发、计算机视觉、机器学习、神经网络以及人工智能相关知识,成为学习学习和学业的先行者!欢迎大家订阅专栏:零基础学Python:Python从0到100最新

- (九万字)面向2025年BOSS直聘人工智能算法工程师高频面试题解析

快撑死的鱼

人工智能回归pythonpytorch

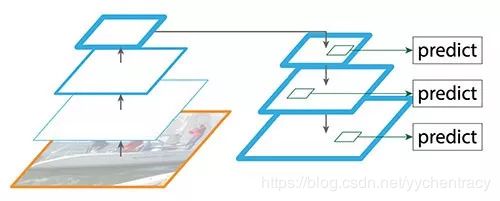

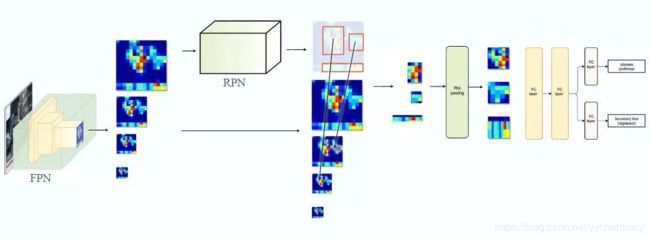

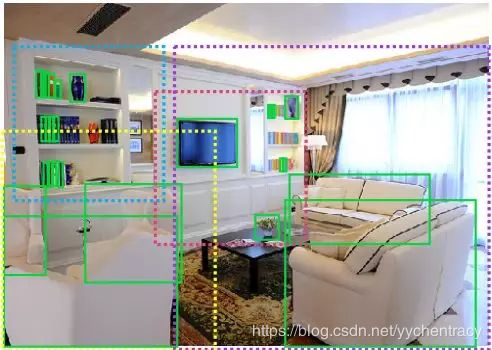

面向2025年BOSS直聘人工智能算法工程师高频面试题解析1.机器学习(ML)理论解析机器学习是让计算机从数据中学习规律的一套方法论,包含监督学习、无监督学习和强化学习等范式。在监督学习中,给定带标签的数据,算法尝试学习从输入到输出的映射关系;无监督学习则在缺乏标签的情况下挖掘数据内在结构;强化学习则让智能体通过与环境交互、依据奖赏反馈来改进策略(Q-learning-Wikipedia)。机器学

- Centos7 搭建 Jupyter + Nginx 服务

某龙兄

pythonnginxlinuxcentos

JupyterNotebook(此前被称为IPythonnotebook)是一个交互式笔记本,支持运行40多种编程语言。JupyterNotebook的本质是一个Web应用程序,便于创建和共享文学化程序文档,支持实时代码,数学方程,可视化和markdown。用途包括:数据清理和转换,数值模拟,统计建模,机器学习等等。本文讲述如何搭建Jupyter+Nginx服务,仅供学习与交流,请勿用于商业用途一

- 人工智能与机器学习入门:基尼系数(Gini Index)和基于熵(Entropy)

基尼系数基于熵机器学习入门

在决策树应用一文中,在构建决策分类树应用决策算法时,介绍了基尼系数(GiniIndex)和基于熵(Entropy)两种算法。本文通过实例来更加深入的介绍一下这两个算法。仍然以简单的数据为例:id喜欢颜色是否有喉结身高性别1绿否165女2蓝是170男3粉否172女4绿是175男基尼系数分别对喜欢颜色是否有喉结求基尼系数如下:喜欢的颜色id喜欢颜色性别1绿女2蓝男3粉女4绿男对于姓别女分类而言,数据如

- 深度学习之目标检测的常用标注工具

铭瑾熙

人工智能机器学习深度学习深度学习目标检测目标跟踪

1LabelImgLabelImg是一款开源的图像标注工具,标签可用于分类和目标检测,它是用Python编写的,并使用Qt作为其图形界面,简单好用。注释以PASCALVOC格式保存为XML文件,这是ImageNet使用的格式。此外,它还支持COCO数据集格式。2labelmelabelme是一款开源的图像/视频标注工具,标签可用于目标检测、分割和分类。灵感是来自于MIT开源的一款标注工具Label

- 利用Beautiful Soup和Pandas进行网页数据抓取与清洗处理实战

傻啦嘿哟

pandas

目录一、准备工作二、抓取网页数据三、数据清洗四、数据处理五、保存数据六、完整代码示例七、总结在数据分析和机器学习的项目中,数据的获取、清洗和处理是非常关键的步骤。今天,我们将通过一个实战案例,演示如何利用Python中的BeautifulSoup库进行网页数据抓取,并使用Pandas库进行数据清洗和处理。这个案例不仅适合初学者,也能帮助有一定经验的朋友快速掌握这两个强大的工具。一、准备工作在开始之

- 鸢尾花分类项目 GUI

编织幻境的妖

分类数据挖掘人工智能

1.机器学习的定义机器学习是一门人工智能的分支,专注于开发算法和统计模型,使计算机能够在没有明确编程的情况下从数据中自动学习和改进。通过识别数据中的模式和规律,机器学习系统可以做出预测或决策。常见的应用包括图像识别、语音识别、推荐系统等。2.为什么使用鸢尾花数据集(Irisdataset)鸢尾花数据集是一个经典的多类分类问题数据集,由英国统计学家和遗传学家RonaldFisher在1936年引入。

- 改进YOLO系列 | YOLOv5/v7 引入 Dynamic Snake Convolution | 动态蛇形卷积

wei子

YOLO目标跟踪人工智能

改进YOLO系列:动态蛇形卷积(DynamicSnakeConvolution,DSC)简介YOLO系列目标检测算法以其速度和精度著称,但对于细长目标例如血管、道路等,其性能仍有提升空间。动态蛇形卷积(DSC)是YOLOv5/v7中引入的一种改进,旨在更好地处理细长目标。DSC原理DSC的核心思想是使用类似蛇形运动的卷积核来提取细长目标的特征。具体来说,DSC卷积核沿着一系列控制点移动,并根据每个

- 《神经网络与深度学习》(邱锡鹏) 内容概要【不含数学推导】

code_stream

#机器学习神经网络

第1章绪论基本概念:介绍了人工智能的发展历程及不同阶段的特点,如符号主义、连接主义、行为主义等。还阐述了深度学习在人工智能领域的重要地位和发展现状,以及其在图像、语音、自然语言处理等多个领域的成功应用。术语解释人工智能:旨在让机器模拟人类智能的技术和科学。深度学习:一种基于对数据进行表征学习的方法,通过构建具有很多层的神经网络模型,自动从大量数据中学习复杂的模式和特征。第2章机器学习概述基本概念:

- 图像识别与应用

狂踹瘸子那条好脚

python

图像识别作为人工智能领域的重要分支,近年来取得了显著进展,其中卷积神经网络(CNN)功不可没。CNN凭借其强大的特征提取能力,在图像分类、目标检测、人脸识别等任务中表现出色,成为图像识别领域的核心技术。一、卷积神经网络:图像识别的利器CNN是一种专门处理网格状数据的深度学习模型,其结构设计灵感来源于生物视觉系统。与全连接神经网络不同,CNN通过卷积层、池化层等结构,能够有效提取图像的局部特征,并逐

- Python中的 redis keyspace 通知_python 操作redis psubscribe(‘__keyspace@0__ ‘)

2301_82243733

程序员python学习面试

最后Python崛起并且风靡,因为优点多、应用领域广、被大牛们认可。学习Python门槛很低,但它的晋级路线很多,通过它你能进入机器学习、数据挖掘、大数据,CS等更加高级的领域。Python可以做网络应用,可以做科学计算,数据分析,可以做网络爬虫,可以做机器学习、自然语言处理、可以写游戏、可以做桌面应用…Python可以做的很多,你需要学好基础,再选择明确的方向。这里给大家分享一份全套的Pytho

- DeepSeek原理介绍以及对网络安全行业的影响

AI拉呱

Deepseek人工智能

大家好,我是AI拉呱,一个专注于人工智领域与网络安全方面的博主,现任资深算法研究员一职,兼职硕士研究生导师;热爱机器学习和深度学习算法应用,深耕大语言模型微调、量化、私域部署。曾获多次获得AI竞赛大奖,拥有多项发明专利和学术论文。对于AI算法有自己独特见解和经验。曾辅导十几位非计算机学生转行到算法岗位就业。关注评审分享一起学习更多知识。1.DeepSeek公司介绍1.1DeepSeek是什么:wh

- FOKS-TROT: 一个高效、易用的全功能开源知识图谱生成工具

柳旖岭

FOKS-TROT:一个高效、易用的全功能开源知识图谱生成工具项目简介FOKS-TROT是一个基于Python的全功能开源知识图谱生成工具,旨在帮助研究人员和开发者快速构建具有丰富信息的知识图谱。该项目由hkx3upper在GitCode上开发并维护。通过FOKS-TROT,您可以轻松地将各种数据源(如文本文件、数据库、API)转换为结构化的知识图谱,并对其进行可视化分析和机器学习任务。此外,该工

- 基于python深度学习遥感影像地物分类与目标识别、分割实践技术应用

xiao5kou4chang6kai4

深度学习遥感勘测python深度学习分类

专题一:深度学习发展与机器学习深度学习的历史发展过程机器学习,深度学习等任务的基本处理流程梯度下降算法讲解不同初始化,学习率对梯度下降算法的实例分析从机器学习到深度学习算法专题二深度卷积网络、卷积神经网络、卷积运算的基本原理池化操作,全连接层,以及分类器的作用BP反向传播算法的理解一个简单CNN模型代码理解特征图,卷积核可视化分析专题三TensorFlow与keras介绍与入门TensorFlow

- LLM与知识图谱融合:智能运维知识库构建

AI天才研究院

DeepSeekR1&大数据AI人工智能大模型AI大模型企业级应用开发实战AI实战计算科学神经计算深度学习神经网络大数据人工智能大型语言模型AIAGILLMJavaPython架构设计AgentRPA

1.背景介绍随着信息技术的飞速发展,IT运维管理面临着越来越大的挑战。海量的设备、复杂的网络环境、日益增长的数据量,使得传统的运维方式难以满足需求。为了提高运维效率和质量,智能运维应运而生。智能运维的核心是将人工智能技术应用于运维领域,通过机器学习、深度学习等算法,实现自动化、智能化的运维管理。其中,大语言模型(LLM)和知识图谱是两个重要的技术方向。LLM能够理解和生成自然语言,可以用于构建智能

- 机器学习·文本数据读写处理

AAA顶置摸鱼

python深度学习机器学习人工智能数据处理

前言在自然语言处理的第一步,需要面对的是各种各样以不同形式表现的文本数据,比如,txt、Excel中的表格数据,还有无法直接打开的pkl文件等。针对这些不同类型的数据,可以基于Python中的基本功能函数或者调用某些库进行读写以及作一些基本的处理。一、文本数据读写方法1.读写TXT文件读取方法:read():读取整个文件,返回字符串。readline():逐行读取,返回字符串。readlines(

- 用 TensorFlow 搭建简单的手写数字识别模型

lozhyf

工作面试学习tensorflow人工智能python

一、引言手写数字识别是机器学习领域中一个经典且基础的问题,它在很多实际场景中都有广泛的应用,比如邮政系统中的邮件分拣、银行支票金额识别等。TensorFlow是一个强大的开源机器学习框架,由Google开发并维护,它提供了丰富的工具和接口,能帮助我们快速搭建和训练深度学习模型。在这篇博客中,我们将使用TensorFlow构建一个简单的神经网络模型,用于识别手写数字。二、环境准备在开始之前,你需要安

- yolov8人脸识别与脸部关键点检测(代码+原理)

QQ_1309399183

计算机视觉实战项目集锦YOLO人工智能人脸识别yolo人脸检测

YOLOv8脸部识别是一个基于YOLOv8算法的人脸检测项目,旨在实现快速、准确地检测图像和视频中的人脸。该项目是对YOLOv8算法的扩展和优化,专门用于人脸检测任务。YOLOv8是一种基于深度学习的目标检测算法,通过将目标检测问题转化为一个回归问题,可以实现实时的目标检测。YOLOv8Face项目在YOLOv8的基础上进行了改进,使其更加适用于人脸检测。以下是YOLOv8Face项目的一些特点和

- 【机器学习】基于3D CNN通过CT图像分类预测肺炎

MUKAMO

AIPython应用机器学习深度学习人工智能神经网络3DCNN

1.引言1.1.研究背景在医学诊断中,医生通过分析CT影像来预测疾病时,面临一些挑战和局限性:图像信息的广度与复杂性:CT扫描生成的大量图像对医生来说既是信息的宝库也是处理上的负担。每组CT数据可能包含数百张切片,医生必须迅速审阅这些图像,以便捕捉到病变的微小细节。这种庞大的信息量要求医生在有限的时间内做出精准诊断,但同时也增加了漏诊或误诊的风险。部分容积效应也可能模糊小病变的边界,使得准确诊断变

- TensorFlow LiteRT 概览

姚家湾

tensorflow人工智能python

LiteRT(简称LiteRuntime,以前称为TensorFlowLite)是Google面向设备端AI的高性能运行时。您可以找到适用于各种机器学习/AI任务的LiteRT就绪模型,也可以使用AIEdge转换和优化工具将TensorFlow、PyTorch和JAX模型转换为TFLite格式并运行。主要特性针对设备端机器学习进行了优化:LiteRT解决了五项关键的ODML约束条件:延迟时间(无需

- 机器学习(1)安装Pytorch

CoderIsArt

机器学习与深度学习机器学习pytorch人工智能

1.安装命令pip3installtorchtorchvisiontorchaudio--index-urlhttps://download.pytorch.org/whl/cu1182.安装过程Log:Lookinginindexes:https://download.pytorch.org/whl/cu118CollectingtorchDownloadinghttps://download.

- 27岁大龄转码秋招惨败,朋友劝我转Java来得及吗?还是继续走前端或机器学习?

程序员yt

java机器学习开发语言

今天给大家分享的是一位粉丝的提问,27岁大龄转码秋招惨败,朋友劝我转Java来得及吗?还是继续走前端或机器学习?接下来把粉丝的具体提问和我的回复分享给大家,希望也能给一些类似情况的小伙伴一些启发和帮助。同学提问:211建筑本科,22年毕业后gap一年转码去了英国读的QS100的it的水硕(24年12月份毕业),转码后对就业形势认知不足,时间全花在课业上,八股文和算法准备的不充足,秋招算是惨败。读研

- 【核心算法篇七】《DeepSeek异常检测:孤立森林与AutoEncoder对比》

再见孙悟空_

「2025DeepSeek技术全景实战」算法分布式docker计算机视觉人工智能自然语言处理DeepSeek

大家好,今天我们来深入探讨一下《DeepSeek异常检测:孤立森林与AutoEncoder对比》这篇技术博客。我们将从核心内容、原理、应用场景等多个方面进行详细解析,力求让大家对这两种异常检测方法有一个全面而深入的理解。一、引言在数据科学和机器学习领域,异常检测(AnomalyDetection)是一个非常重要的任务。它的目标是从数据集中识别出那些与大多数数据显著不同的异常点。这些异常点可能是由于

- 吐血整理!模型热加载能力大比拼,谁才是真正王者?

盼达思文体科创

经验分享

吐血整理!模型热加载能力大比拼,谁才是真正王者?引言你是否在开发过程中,为了模型更新而频繁重启服务,浪费大量时间?又是否疑惑为什么有些模型加载速度快如闪电,而有些却慢得像蜗牛?今天就带你深入了解模型热加载能力的支持对比,让你不再为模型加载问题而烦恼!核心内容模型热加载概念科普场景化描述:想象一下,你正在运营一个基于机器学习模型的在线推荐系统。当你训练出了一个新的、性能更好的模型时,如果不能进行热加

- Python从0到100(四):Python中的运算符介绍(补充)

是Dream呀

pythonjava数据库

前言:零基础学Python:Python从0到100最新最全教程。想做这件事情很久了,这次我更新了自己所写过的所有博客,汇集成了Python从0到100,共一百节课,帮助大家一个月时间里从零基础到学习Python基础语法、Python爬虫、Web开发、计算机视觉、机器学习、神经网络以及人工智能相关知识,成为学习学习和学业的先行者!欢迎大家订阅专栏:零基础学Python:Python从0到100最新

- Python从0到100(三十五):beautifulsoup的学习

是Dream呀

Dream的茶话会pythonbeautifulsoup学习

前言:零基础学Python:Python从0到100最新最全教程。想做这件事情很久了,这次我更新了自己所写过的所有博客,汇集成了Python从0到100,共一百节课,帮助大家一个月时间里从零基础到学习Python基础语法、Python爬虫、Web开发、计算机视觉、机器学习、神经网络以及人工智能相关知识,成为学习学习和学业的先行者!欢迎大家订阅专栏:零基础学Python:Python从0到100最新

- 《深入浅出AI》前言知识:深度学习基础总结

GoAI

深入浅出AI人工智能深度学习机器学习cnnrnn生成对抗网络神经网络

个人主页:GoAI|公众号:GoAI的学习小屋|交流群:704932595|个人简介:掘金签约作者、百度飞桨PPDE、领航团团长、开源特训营导师、CSDN、阿里云社区人工智能领域博客专家、新星计划计算机视觉方向导师等,专注大数据与人工智能知识分享。AI学习星球推荐:GoAI的学习社区知识星球是一个致力于提供《机器学习|深度学习|CV|NLP|大模型|多模态|AIGC》各个最新AI方向综述、论文等成

- 人工智能与机器学习入门:决策树应用

决策树机器学习入门

在人工智能与机器学习入门:使用Kaggle完成Titanic推断学习一文中,给出了使用Kaggle进行机器学习入门的方法,本文基于上文的需求。尝试使用决策树模型来训练数据,并进行test数据集的测试。什么是决策树决策树,简单来讲可以认为是一个大的ifelse判断树,有了决策树后,测试集中的数据便可以使用该决策树进行判断了。比如根据Titanic的训练数据构造了上次决策树后,便可以根据测试数据的性别

- 深度学习torch之19种优化算法(optimizer)解析

@Mr_LiuYang

论文阅读深度学习optimizerAdam学习率调整优化算法

提示:有谬误请指正摘要本博客详细介绍了多种常见的深度学习优化算法,包括经典的LBFGS、Rprop、Adagrad、RMSprop、Adadelta、ASGD、Adamax、Adam、AdamW、NAdam、RAdam以及SparseAdam等,通过对这些算法的公式和参数说明进行详细解析,博客旨在为机器学习工程师和研究人员提供清晰的理论指导,帮助读者选择合适的优化算法提升模型训练效率。父类定义Op

- 《机器学习数学基础》补充资料:四元数、点积和叉积

CS创新实验室

机器学习数学基础机器学习人工智能机器学习数学基础

《机器学习数学基础》第1章1.4节介绍了内积、点积的有关概念,特别辨析了内积空间、欧几里得空间;第4章4.1.1节介绍了叉积的有关概念;4.1.2节介绍了张量积(也称外积)的概念。以上这些内容,在不同资料中,所用术语的含义会有所差别,读者阅读的时候,不妨注意,一般资料中,都是在欧几里得空间探讨有关问题,并且是在三维的欧氏空间中,其实质所指即相同。但是,如果不是在欧氏空间中,各概念、术语则不能混用。

- Linux的Initrd机制

被触发

linux

Linux 的 initrd 技术是一个非常普遍使用的机制,linux2.6 内核的 initrd 的文件格式由原来的文件系统镜像文件转变成了 cpio 格式,变化不仅反映在文件格式上, linux 内核对这两种格式的 initrd 的处理有着截然的不同。本文首先介绍了什么是 initrd 技术,然后分别介绍了 Linux2.4 内核和 2.6 内核的 initrd 的处理流程。最后通过对 Lin

- maven本地仓库路径修改

bitcarter

maven

默认maven本地仓库路径:C:\Users\Administrator\.m2

修改maven本地仓库路径方法:

1.打开E:\maven\apache-maven-2.2.1\conf\settings.xml

2.找到

- XSD和XML中的命名空间

darrenzhu

xmlxsdschemanamespace命名空间

http://www.360doc.com/content/12/0418/10/9437165_204585479.shtml

http://blog.csdn.net/wanghuan203/article/details/9203621

http://blog.csdn.net/wanghuan203/article/details/9204337

http://www.cn

- Java 求素数运算

周凡杨

java算法素数

网络上对求素数之解数不胜数,我在此总结归纳一下,同时对一些编码,加以改进,效率有成倍热提高。

第一种:

原理: 6N(+-)1法 任何一个自然数,总可以表示成为如下的形式之一: 6N,6N+1,6N+2,6N+3,6N+4,6N+5 (N=0,1,2,…)

- java 单例模式

g21121

java

想必单例模式大家都不会陌生,有如下两种方式来实现单例模式:

class Singleton {

private static Singleton instance=new Singleton();

private Singleton(){}

static Singleton getInstance() {

return instance;

}

- Linux下Mysql源码安装

510888780

mysql

1.假设已经有mysql-5.6.23-linux-glibc2.5-x86_64.tar.gz

(1)创建mysql的安装目录及数据库存放目录

解压缩下载的源码包,目录结构,特殊指定的目录除外:

- 32位和64位操作系统

墙头上一根草

32位和64位操作系统

32位和64位操作系统是指:CPU一次处理数据的能力是32位还是64位。现在市场上的CPU一般都是64位的,但是这些CPU并不是真正意义上的64 位CPU,里面依然保留了大部分32位的技术,只是进行了部分64位的改进。32位和64位的区别还涉及了内存的寻址方面,32位系统的最大寻址空间是2 的32次方= 4294967296(bit)= 4(GB)左右,而64位系统的最大寻址空间的寻址空间则达到了

- 我的spring学习笔记10-轻量级_Spring框架

aijuans

Spring 3

一、问题提问:

→ 请简单介绍一下什么是轻量级?

轻量级(Leightweight)是相对于一些重量级的容器来说的,比如Spring的核心是一个轻量级的容器,Spring的核心包在文件容量上只有不到1M大小,使用Spring核心包所需要的资源也是很少的,您甚至可以在小型设备中使用Spring。

- mongodb 环境搭建及简单CURD

antlove

WebInstallcurdNoSQLmongo

一 搭建mongodb环境

1. 在mongo官网下载mongodb

2. 在本地创建目录 "D:\Program Files\mongodb-win32-i386-2.6.4\data\db"

3. 运行mongodb服务 [mongod.exe --dbpath "D:\Program Files\mongodb-win32-i386-2.6.4\data\

- 数据字典和动态视图

百合不是茶

oracle数据字典动态视图系统和对象权限

数据字典(data dictionary)是 Oracle 数据库的一个重要组成部分,这是一组用于记录数据库信息的只读(read-only)表。随着数据库的启动而启动,数据库关闭时数据字典也关闭 数据字典中包含

数据库中所有方案对象(schema object)的定义(包括表,视图,索引,簇,同义词,序列,过程,函数,包,触发器等等)

数据库为一

- 多线程编程一般规则

bijian1013

javathread多线程java多线程

如果两个工两个以上的线程都修改一个对象,那么把执行修改的方法定义为被同步的,如果对象更新影响到只读方法,那么只读方法也要定义成同步的。

不要滥用同步。如果在一个对象内的不同的方法访问的不是同一个数据,就不要将方法设置为synchronized的。

- 将文件或目录拷贝到另一个Linux系统的命令scp

bijian1013

linuxunixscp

一.功能说明 scp就是security copy,用于将文件或者目录从一个Linux系统拷贝到另一个Linux系统下。scp传输数据用的是SSH协议,保证了数据传输的安全,其格式如下: scp 远程用户名@IP地址:文件的绝对路径

- 【持久化框架MyBatis3五】MyBatis3一对多关联查询

bit1129

Mybatis3

以教员和课程为例介绍一对多关联关系,在这里认为一个教员可以叫多门课程,而一门课程只有1个教员教,这种关系在实际中不太常见,通过教员和课程是多对多的关系。

示例数据:

地址表:

CREATE TABLE ADDRESSES

(

ADDR_ID INT(11) NOT NULL AUTO_INCREMENT,

STREET VAR

- cookie状态判断引发的查找问题

bitcarter

formcgi

先说一下我们的业务背景:

1.前台将图片和文本通过form表单提交到后台,图片我们都做了base64的编码,并且前台图片进行了压缩

2.form中action是一个cgi服务

3.后台cgi服务同时供PC,H5,APP

4.后台cgi中调用公共的cookie状态判断方法(公共的,大家都用,几年了没有问题)

问题:(折腾两天。。。。)

1.PC端cgi服务正常调用,cookie判断没

- 通过Nginx,Tomcat访问日志(access log)记录请求耗时

ronin47

一、Nginx通过$upstream_response_time $request_time统计请求和后台服务响应时间

nginx.conf使用配置方式:

log_format main '$remote_addr - $remote_user [$time_local] "$request" ''$status $body_bytes_sent "$http_r

- java-67- n个骰子的点数。 把n个骰子扔在地上,所有骰子朝上一面的点数之和为S。输入n,打印出S的所有可能的值出现的概率。

bylijinnan

java

public class ProbabilityOfDice {

/**

* Q67 n个骰子的点数

* 把n个骰子扔在地上,所有骰子朝上一面的点数之和为S。输入n,打印出S的所有可能的值出现的概率。

* 在以下求解过程中,我们把骰子看作是有序的。

* 例如当n=2时,我们认为(1,2)和(2,1)是两种不同的情况

*/

private stati

- 看别人的博客,觉得心情很好

Cb123456

博客心情

以为写博客,就是总结,就和日记一样吧,同时也在督促自己。今天看了好长时间博客:

职业规划:

http://www.iteye.com/blogs/subjects/zhiyeguihua

android学习:

1.http://byandby.i

- [JWFD开源工作流]尝试用原生代码引擎实现循环反馈拓扑分析

comsci

工作流

我们已经不满足于仅仅跳跃一次,通过对引擎的升级,今天我测试了一下循环反馈模式,大概跑了200圈,引擎报一个溢出错误

在一个流程图的结束节点中嵌入一段方程,每次引擎运行到这个节点的时候,通过实时编译器GM模块,计算这个方程,计算结果与预设值进行比较,符合条件则跳跃到开始节点,继续新一轮拓扑分析,直到遇到

- JS常用的事件及方法

cwqcwqmax9

js

事件 描述

onactivate 当对象设置为活动元素时触发。

onafterupdate 当成功更新数据源对象中的关联对象后在数据绑定对象上触发。

onbeforeactivate 对象要被设置为当前元素前立即触发。

onbeforecut 当选中区从文档中删除之前在源对象触发。

onbeforedeactivate 在 activeElement 从当前对象变为父文档其它对象之前立即

- 正则表达式验证日期格式

dashuaifu

正则表达式IT其它java其它

正则表达式验证日期格式

function isDate(d){

var v = d.match(/^(\d{4})-(\d{1,2})-(\d{1,2})$/i);

if(!v) {

this.focus();

return false;

}

}

<input value="2000-8-8" onblu

- Yii CModel.rules() 方法 、validate预定义完整列表、以及说说验证

dcj3sjt126com

yii

public array rules () {return} array 要调用 validate() 时应用的有效性规则。 返回属性的有效性规则。声明验证规则,应重写此方法。 每个规则是数组具有以下结构:array('attribute list', 'validator name', 'on'=>'scenario name', ...validation

- UITextAttributeTextColor = deprecated in iOS 7.0

dcj3sjt126com

ios

In this lesson we used the key "UITextAttributeTextColor" to change the color of the UINavigationBar appearance to white. This prompts a warning "first deprecated in iOS 7.0."

Ins

- 判断一个数是质数的几种方法

EmmaZhao

Mathpython

质数也叫素数,是只能被1和它本身整除的正整数,最小的质数是2,目前发现的最大的质数是p=2^57885161-1【注1】。

判断一个数是质数的最简单的方法如下:

def isPrime1(n):

for i in range(2, n):

if n % i == 0:

return False

return True

但是在上面的方法中有一些冗余的计算,所以

- SpringSecurity工作原理小解读

坏我一锅粥

SpringSecurity

SecurityContextPersistenceFilter

ConcurrentSessionFilter

WebAsyncManagerIntegrationFilter

HeaderWriterFilter

CsrfFilter

LogoutFilter

Use

- JS实现自适应宽度的Tag切换

ini

JavaScripthtmlWebcsshtml5

效果体验:http://hovertree.com/texiao/js/3.htm

该效果使用纯JavaScript代码,实现TAB页切换效果,TAB标签根据内容自适应宽度,点击TAB标签切换内容页。

HTML文件代码:

<!DOCTYPE html>

<html xmlns="http://www.w3.org/1999/xhtml"

- Hbase Rest API : 数据查询

kane_xie

RESThbase

hbase(hadoop)是用java编写的,有些语言(例如python)能够对它提供良好的支持,但也有很多语言使用起来并不是那么方便,比如c#只能通过thrift访问。Rest就能很好的解决这个问题。Hbase的org.apache.hadoop.hbase.rest包提供了rest接口,它内嵌了jetty作为servlet容器。

启动命令:./bin/hbase rest s

- JQuery实现鼠标拖动元素移动位置(源码+注释)

明子健

jqueryjs源码拖动鼠标

欢迎讨论指正!

print.html代码:

<!DOCTYPE html>

<html>

<head>

<meta http-equiv=Content-Type content="text/html;charset=utf-8">

<title>发票打印</title>

&l

- Postgresql 连表更新字段语法 update

qifeifei

PostgreSQL

下面这段sql本来目的是想更新条件下的数据,可是这段sql却更新了整个表的数据。sql如下:

UPDATE tops_visa.visa_order

SET op_audit_abort_pass_date = now()

FROM

tops_visa.visa_order as t1

INNER JOIN tops_visa.visa_visitor as t2

ON t1.

- 将redis,memcache结合使用的方案?

tcrct

rediscache

公司架构上使用了阿里云的服务,由于阿里的kvstore收费相当高,打算自建,自建后就需要自己维护,所以就有了一个想法,针对kvstore(redis)及ocs(memcache)的特点,想自己开发一个cache层,将需要用到list,set,map等redis方法的继续使用redis来完成,将整条记录放在memcache下,即findbyid,save等时就memcache,其它就对应使用redi

- 开发中遇到的诡异的bug

wudixiaotie

bug

今天我们服务器组遇到个问题:

我们的服务是从Kafka里面取出数据,然后把offset存储到ssdb中,每个topic和partition都对应ssdb中不同的key,服务启动之后,每次kafka数据更新我们这边收到消息,然后存储之后就发现ssdb的值偶尔是-2,这就奇怪了,最开始我们是在代码中打印存储的日志,发现没什么问题,后来去查看ssdb的日志,才发现里面每次set的时候都会对同一个key