Kafka的学习和使用

Kafka的学习和使用

本文是基于CentOS 7.3系统环境,进行Kafka的学习和使用

- CentOS 7.3

一、Kafka的简介

1.1 Kafka基本概念

(1) 什么是Kafka

Kafka是一个分布式的基于发布/订阅模式的消息队列,主要应用于大数据实时处理领域

(2) Kafka的作用

- 解耦和异步

将强依赖的两个数据上下游系统,通过消息队列进行解耦,可以实现上下游的异步通信 - 削峰

缓解数据上下游两个系统的流速差

1.2 Kafka基础架构

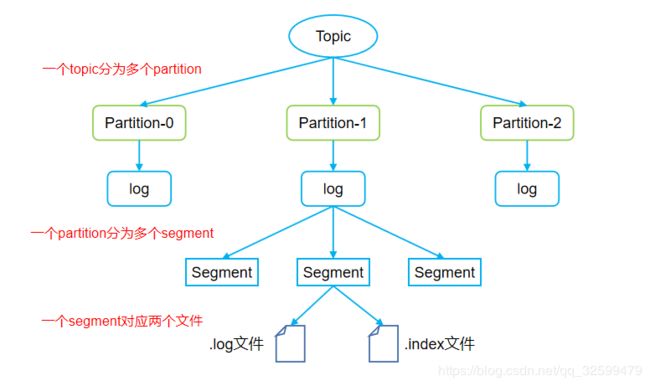

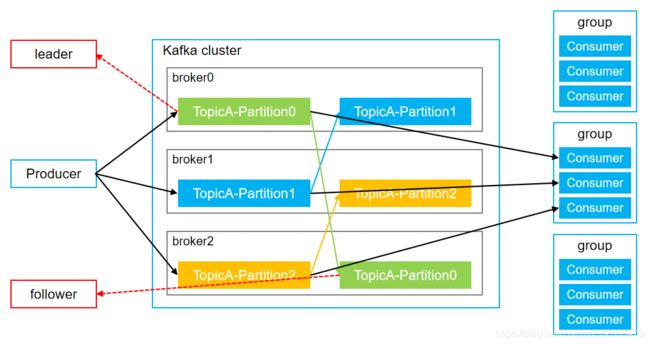

- 为了方便横向扩展,并提高吞吐量,一个topic分为多个partition

- 配合分区的设计,提出消费者组的概念,组内每个消费者并行消费

- 为提高可用性,为每个partition增加若干副本,类似于NameNode HA

- Producer

消息生产者,就是向kafka broker发消息的客户端 - Consumer

消息消费者,向kafka broker取消息的客户端 - Consumer Group (CG)

消费者组,由多个consumer组成。消费者组内每个消费者负责消费不同分区的数据,一个分区只能由一个消费者消费;消费者组之间互不影响。所有的消费者都属于某个消费者组,即消费者组是逻辑上的一个订阅者 - Broker

一台kafka服务器就是一个broker。一个集群由多个broker组成。一个broker可以容纳多个topic - Topic

可以理解为一个队列,生产者和消费者面向的都是一个topic - Partition

为了实现扩展性,一个非常大的topic可以分布到多个broker(即服务器)上,一个topic可以分为多个partition,每个partition是一个有序的队列 - Replica

副本,为保证集群中的某个节点发生故障时, 该节点上的partition数据不丢失,且kafka仍然能够继续工作,kafka提供了副本机制,一个topic的每个分区都有若干个副本,一个leader和若干个follower - leader

每个分区多个副本的“主”,生产者发送数据的对象,以及消费者消费数据的对象都是leader - follower

每个分区多个副本中的“从”,实时从leader中同步数据,保持和leader数据的同步。leader发生故障时,某个follower会成为新的follower

1.3 Kafka工作流程

- kafka中消息是以topic进行分类的,生产者生成消息,消费者消费消息,都是面向topic的

- topic是逻辑上的概念,而partition是物理上的概念,每个partition对应于一个log文件,该log文件中存储的就是producer生产的数据。

- Producer生产的数据会被不断追加到该log文件末端,且每条数据都有自己的offset。

- 消费者组中的每个消费者,都会实时记录自己消费到了哪个offset,以便出错恢复时,从上次的位置继续消费。

1.4 Kafka文件存储机制

- 由于生产者生产的消息会不断追加到log文件末尾,为防止log文件过大导致数据定位效率低下,Kafka采取了分片和索引机制,将每个partition分为多个segment

- 每个segment对应两个文件——“.index”文件和“.log”文件。这些文件位于一个文件夹下,该文件夹的命名规则为:topic名称+分区序号。例如,first这个topic有三个分区,则其对应的文件夹为first-0,first-1,first-2

1.5 Kafka生产者

1.5.1 分区策略

(1) 分区的原因

- 方便在集群中扩展

每个Partition可以通过调整以适应它所在的机器,而一个topic又可以有多个Partition组成,因此整个集群就可以适应任意大小的数据了 - 可以提高并发

因为可以以Partition为单位读写了

(2) 分区的原则

我们需要将producer发送的数据封装成一个ProducerRecord对象。

- 指明 partition 的情况下,直接将指明的值直接作为 partiton 值

- 没有指明 partition 值但有 key 的情况下,将 key 的 hash 值与 topic 的 partition 数进行取余得到 partition 值

- 既没有 partition 值又没有 key 值的情况下,第一次调用时随机生成一个整数(后面每次调用在这个整数上自增),将这个值与 topic 可用的 partition 总数取余得到 partition 值,也就是常说的 round-robin 算法

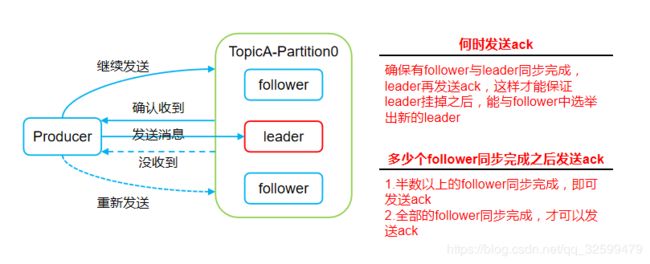

1.5.2 数据可靠性保证

为保证producer发送的数据,能可靠的发送到指定的topic,topic的每个partition收到producer发送的数据后,都需要向producer发送ack(acknowledgement确认收到),如果producer收到ack,就会进行下一轮的发送,否则重新发送数据。

(1) 副本数据同步策略

| 方策略 | 优点 | 缺点 |

|---|---|---|

| 半数以上完成同步,就发送ack | 延迟低 | 选举新的leader时,容忍n台节点的故障,需要2n+1个副本 |

| 全部完成同步,就发送ack | 选举新的leader时,容忍n台节点的故障,需要n+1个副本 | 延迟高 |

Kafka选择了第二种方案,原因如下:

- 同样为了容忍n台节点的故障,第一种方案需要2n+1个副本,而第二种方案只需要n+1个副本,而Kafka的每个分区都有大量的数据,第一种方案会造成大量数据的冗余。

- 虽然第二种方案的网络延迟会比较高,但网络延迟对Kafka的影响较小。

(2) ISR2

采用第二种方案之后,设想以下情景:leader收到数据,所有follower都开始同步数据,但有一个follower,因为某种故障,迟迟不能与leader进行同步,那leader就要一直等下去,直到它完成同步,才能发送ack。这个问题怎么解决呢?

Leader维护了一个动态的in-sync replica set (ISR),意为和leader保持同步的follower集合。当ISR中的follower完成数据的同步之后,leader就会给producer发送ack。如果follower长时间未向leader同步数据,则该follower将被踢出ISR,该时间阈值由replica.lag.time.max.ms参数设定。Leader发生故障之后,就会从ISR中选举新的leader。

(3) ack应答机制

对于某些不太重要的数据,对数据的可靠性要求不是很高,能够容忍数据的少量丢失,所以没必要等ISR中的follower全部接收成功。

所以Kafka为用户提供了三种可靠性级别,用户根据对可靠性和延迟的要求进行权衡,选择以下的配置。

acks参数配置

- 0

producer不等待broker的ack,这一操作提供了一个最低的延迟,broker一接收到还没有写入磁盘就已经返回,当broker故障时有可能丢失数据; - 1

producer等待broker的ack,partition的leader落盘成功后返回ack,如果在follower同步成功之前leader故障,那么将会丢失数据; - -1(all)

producer等待broker的ack,partition的leader和follower全部落盘成功后才返回ack。但是如果在follower同步完成后,broker发送ack之前,leader发生故障,那么会造成数据重复。

(4)故障处理细节

- follower故障

follower发生故障后会被临时踢出ISR,待该follower恢复后,follower会读取本地磁盘记录的上次的HW,并将log文件高于HW的部分截取掉,从HW开始向leader进行同步。等该follower的LEO大于等于该Partition的HW,即follower追上leader之后,就可以重新加入ISR了。 - leader故障

leader发生故障之后,会从ISR中选出一个新的leader,之后,为保证多个副本之间的数据一致性,其余的follower会先将各自的log文件高于HW的部分截掉,然后从新的leader同步数据。

注意:这只能保证副本之间的数据一致性,并不能保证数据不丢失或者不重复。

1.5.3 Exactly Once语义

将服务器的ACK级别设置为-1,可以保证Producer到Server之间不会丢失数据,即At Least Once语义。相对的,将服务器ACK级别设置为0,可以保证生产者每条消息只会被发送一次,即At Most Once语义。

At Least Once可以保证数据不丢失,但是不能保证数据不重复;相对的,At Least Once可以保证数据不重复,但是不能保证数据不丢失。但是,对于一些非常重要的信息,比如说交易数据,下游数据消费者要求数据既不重复也不丢失,即Exactly Once语义。在0.11版本以前的Kafka,对此是无能为力的,只能保证数据不丢失,再在下游消费者对数据做全局去重。对于多个下游应用的情况,每个都需要单独做全局去重,这就对性能造成了很大影响。

0.11版本的Kafka,引入了一项重大特性:幂等性。所谓的幂等性就是指Producer不论向Server发送多少次重复数据,Server端都只会持久化一条。 幂等性结合At Least Once语义,就构成了Kafka的Exactly Once语义。即:At Least Once + 幂等性 = Exactly Once

要启用幂等性,只需要将Producer的参数中enable.idempotence设置为true即可。Kafka的幂等性实现其实就是将原来下游需要做的去重放在了数据上游。开启幂等性的Producer在初始化的时候会被分配一个PID,发往同一Partition的消息会附带Sequence Number。而Broker端会对

但是PID重启就会变化,同时不同的Partition也具有不同主键,所以幂等性无法保证跨分区跨会话的Exactly Once。

1.6 Kafka消费者

1.6.1 消费方式

consumer采用pull(拉)模式从broker中读取数据。

push(推)模式很难适应消费速率不同的消费者,因为消息发送速率是由broker决定的。它的目标是尽可能以最快速度传递消息,但是这样很容易造成consumer来不及处理消息,典型的表现就是拒绝服务以及网络拥塞。而pull模式则可以根据consumer的消费能力以适当的速率消费消息。

pull模式不足之处是,如果kafka没有数据,消费者可能会陷入循环中,一直返回空数据。针对这一点,Kafka的消费者在消费数据时会传入一个时长参数timeout,如果当前没有数据可供消费,consumer会等待一段时间之后再返回,这段时长即为timeout。

1.6.2 分区分配策略

一个consumer group中有多个consumer,一个 topic有多个partition,所以必然会涉及到partition的分配问题,即确定那个partition由哪个consumer来消费。

Kafka有两种分配策略,一是roundrobin,一是range。

1.6.3 offset的维护

由于consumer在消费过程中可能会出现断电宕机等故障,consumer恢复后,需要从故障前的位置的继续消费,所以consumer需要实时记录自己消费到了哪个offset,以便故障恢复后继续消费。

Kafka 0.9版本之前,consumer默认将offset保存在Zookeeper中,从0.9版本开始,consumer默认将offset保存在Kafka一个内置的topic中,该topic为__consumer_offsets。

二、Kafka的安装和使用

2.1 Kafka安装

tar -xzvf kafka_2.11-0.11.0.0.tgz -C /opt/module

cd /opt/module

mv kafka_2.11-0.11.0.0/ kafka

2.2 修改配置文件

vi /opt/module/kafka/config/server.properties

# 修改如下内容

# The id of the broker. This must be set to a unique integer for each broker.

broker.id=1

# Switch to enable topic deletion or not, default value is false

delete.topic.enable=true

# A comma seperated list of directories under which to store log files

log.dirs=/opt/module/kafka/logs

# root directory for all kafka znodes.

zookeeper.connect=hadoop101:2181,hadoop102:2181,hadoop103:2181

2.3 配置环境变量

cd /etc/profile.d

vi kafka.sh

# 添加如下内容

#KAFKA_HOME

export KAFKA_HOME=/opt/module/kafka

export PATH=$PATH:$KAFKA_HOME/bin

保存退出,并重新打开一个终端,配置文件则会生效

2.4 启动kafka

首先保证已经启动了zookeeper集群

cd /opt/module/kafka

bin/kafka-server-start.sh -daemon config/server.properties

2.5 停止kafka

cd /opt/module/kafka

bin/kafka-server-stop.sh

2.6 查看当前服务器中的所有topic

bin/kafka-topics.sh --zookeeper hadoop101:2181 --list

2.6 创建topic

bin/kafka-topics.sh --zookeeper hadoop101:2181 --create --replication-factor 3 --partitions 1 --topic first

2.7 查看topic详情

bin/kafka-topics.sh --zookeeper hadoop101:2181 --describe --topic first

2.8 修改topic分区数量

bin/kafka-topics.sh --zookeeper hadoop101:2181 --alter --topic first --partitions 6

2.9 删除topic

bin/kafka-topics.sh --zookeeper hadoop101:2181 --delete --topic first

2.10 发送消息

bin/kafka-console-producer.sh --broker-list hadoop101:9092 --topic first

hello world

xuzheng

2.11 消费消息

bin/kafka-console-consumer.sh --bootstrap-server hadoop101:9092 --from-beginning --topic first

三、Kafka的API

3.1 Producer API

3.1.1 消息发送流程

Kafka的Producer发送消息采用的是异步发送的方式。在消息发送的过程中,涉及到了两个线程——main线程和Sender线程,以及一个线程共享变量——RecordAccumulator。main线程将消息发送给RecordAccumulator,Sender线程不断从RecordAccumulator中拉取消息发送到Kafka broker。

相关参数

- batch.size

只有数据积累到batch.size之后,sender才会发送数据 - linger.ms

如果数据迟迟未达到batch.size,sender等待linger.time之后就会发送数据

3.1.2 异步发送API

(1)不带回调函数的发送消息

package com.inspur.producer;

import org.apache.kafka.clients.producer.KafkaProducer;

import org.apache.kafka.clients.producer.Producer;

import org.apache.kafka.clients.producer.ProducerRecord;

import java.util.Properties;

import java.util.concurrent.Future;

public class ProducerWithOutCallback {

public static void main(String[] args) {

Properties props = new Properties();

props.put("bootstrap.servers", "hadoop101:9092");

props.put("acks", "all");

props.put("retries", 1);

props.put("batch.size", 16384);

props.put("linger.ms", 1);

props.put("buffer.memory", 33554432);

props.put("key.serializer", "org.apache.kafka.common.serialization.StringSerializer");

props.put("value.serializer", "org.apache.kafka.common.serialization.StringSerializer");

Producer producer = new KafkaProducer<String, String>(props);

for (int i = 0; i < 10; i++) {

Future future = producer.send(new ProducerRecord<String, String>("first", "message" + i));

}

}

}

(2)带回调函数的发送消息

package com.inspur.producer;

import org.apache.kafka.clients.producer.*;

import java.util.Properties;

import java.util.concurrent.Future;

public class ProducerWithCallback {

public static void main(String[] args) {

Properties props = new Properties();

props.put("bootstrap.servers", "192.168.10.101:9092");

props.put("acks", "all");

props.put("retries", 1);

props.put("batch.size", 16384);

props.put("linger.ms", 1);

props.put("buffer.memory", 33554432);

props.put("key.serializer", "org.apache.kafka.common.serialization.StringSerializer");

props.put("value.serializer", "org.apache.kafka.common.serialization.StringSerializer");

Producer<String, String> producer = new KafkaProducer<String, String>(props);

for (int i = 0; i < 10; i++) {

producer.send(new ProducerRecord<String, String>("first", "call" + i), new Callback() {

public void onCompletion(RecordMetadata recordMetadata, Exception e) {

System.out.println(recordMetadata.toString() + "发送成功,在第" + recordMetadata.partition() + "偏移量" + recordMetadata.offset());

}

});

}

}

}

3.2 Consumer API

3.2.1 自动提交offset

package com.inspur.consumer;

import org.apache.kafka.clients.consumer.Consumer;

import org.apache.kafka.clients.consumer.ConsumerRecord;

import org.apache.kafka.clients.consumer.ConsumerRecords;

import org.apache.kafka.clients.consumer.KafkaConsumer;

import java.util.Collections;

import java.util.Properties;

public class AutoCommitConsumer {

public static void main(String[] args) {

Properties props = new Properties();

props.put("bootstrap.servers", "192.168.10.101:9092");

props.put("group.id", "test");

props.put("enable.auto.commit", "true");

props.put("auto.commit.interval.ms", "1000");

props.put("key.deserializer", "org.apache.kafka.common.serialization.StringDeserializer");

props.put("value.deserializer", "org.apache.kafka.common.serialization.StringDeserializer");

Consumer<String, String> consumer = new KafkaConsumer<String, String>(props);

consumer.subscribe(Collections.singleton("first"));

while (true){

ConsumerRecords<String, String> records = consumer.poll(1000);

for (ConsumerRecord<String, String> record : records){

System.out.println(record.value());

}

}

}

}

3.2.2 手动同步提交offset

package com.inspur.consumer;

import org.apache.kafka.clients.consumer.Consumer;

import org.apache.kafka.clients.consumer.ConsumerRecord;

import org.apache.kafka.clients.consumer.ConsumerRecords;

import org.apache.kafka.clients.consumer.KafkaConsumer;

import java.util.Collections;

import java.util.Properties;

public class SyncCommitConsumer {

public static void main(String[] args) {

Properties props = new Properties();

props.put("bootstrap.servers", "192.168.10.101:9092");

props.put("group.id", "test");

props.put("key.deserializer", "org.apache.kafka.common.serialization.StringDeserializer");

props.put("value.deserializer", "org.apache.kafka.common.serialization.StringDeserializer");

Consumer<String, String> consumer = new KafkaConsumer<String, String>(props);

consumer.subscribe(Collections.singleton("first"));

while (true){

ConsumerRecords<String, String> records = consumer.poll(1000);

for (ConsumerRecord<String, String> record : records){

System.out.println(record.value());

}

consumer.commitSync();

}

}

}

3.2.3 手动异步提交offset

package com.inspur.consumer;

import org.apache.kafka.clients.consumer.*;

import org.apache.kafka.common.TopicPartition;

import java.util.Collections;

import java.util.Map;

import java.util.Properties;

public class AyncCommitConsumer {

public static void main(String[] args) {

Properties props = new Properties();

props.put("bootstrap.servers", "192.168.10.101:9092");

props.put("group.id", "test");

props.put("key.deserializer", "org.apache.kafka.common.serialization.StringDeserializer");

props.put("value.deserializer", "org.apache.kafka.common.serialization.StringDeserializer");

Consumer<String, String> consumer = new KafkaConsumer<String, String>(props);

consumer.subscribe(Collections.singleton("first"));

while (true){

ConsumerRecords<String, String> records = consumer.poll(1000);

for (ConsumerRecord<String, String> record : records){

System.out.println(record.value());

}

consumer.commitAsync(new OffsetCommitCallback() {

public void onComplete(Map<TopicPartition, OffsetAndMetadata> map, Exception e) {

System.out.println("提交完成");

}

});

}

}

}

四、Flume对接kafka

4.1 配置flume(flume-kafka.conf)

# define

a1.sources = r1

a1.sinks = k1

a1.channels = c1

# source

a1.sources.r1.type = exec

a1.sources.r1.command = tail -F -c +0 /opt/module/flume/data/flume.log

a1.sources.r1.shell = /bin/bash -c

# sink

a1.sinks.k1.type = org.apache.flume.sink.kafka.KafkaSink

a1.sinks.k1.kafka.bootstrap.servers = hadoop101:9092,hadoop102:9092,hadoop103:9092

a1.sinks.k1.kafka.topic = first

a1.sinks.k1.kafka.flumeBatchSize = 20

a1.sinks.k1.kafka.producer.acks = 1

a1.sinks.k1.kafka.producer.linger.ms = 1

# channel

a1.channels.c1.type = memory

a1.channels.c1.capacity = 1000

a1.channels.c1.transactionCapacity = 100

# bind

a1.sources.r1.channels = c1

a1.sinks.k1.channel = c1

4.2 启动flume

bin/flume-ng agent -c conf/ -n a1 -f jobs/flume-kafka.conf

4.3 启动kafka消费者

bin/kafka-console-consumer.sh --bootstrap-server hadoop101:9092 --from-beginning --topic first

4.4 向flume.log里追加数据

cd /opt/module/flume/data

cat >> flume.log

ddddddddd