- GWO优化kmeans

2301_78492934

机器学习算法人工智能matlabkmeans聚类

GWO(灰狼优化器)是一种群体智能优化算法,它模拟了灰狼的社会结构和狩猎行为。GWO算法通过模拟灰狼的等级制度、狩猎策略和搜索机制来寻找问题的最优解。而K-means是一种经典的聚类算法,用于将数据点划分为K个簇。将GWO优化算法应用于K-means聚类中,主要是为了解决K-means算法对初始簇中心敏感和容易陷入局部最优解的问题。以下是GWO优化K-means的原理和过程的详细介绍:1.GWO算

- 高斯混合模型聚类(GMM)matlab实现

唐维康

高斯混合模型聚类

GaussianMixtureModel,就是假设数据服从MixtureGaussianDistribution,换句话说,数据可以看作是从数个GaussianDistribution中生成出来的。实际上,我们在K-means和K-medoids两篇文章中用到的那个例子就是由三个Gaussian分布从随机选取出来的。实际上,从中心极限定理可以看出,Gaussian分布(也叫做正态(Normal)分

- 聚类分析入门:使用Python和K-means算法进行数据聚类

Evaporator Core

python

文章标题:聚类分析入门:使用Python和K-means算法进行数据聚类简介聚类分析是机器学习中的一个重要任务,它涉及将数据集中的样本分成多个类别或簇,使得同一簇内的样本相似度较高,不同簇之间的样本相似度较低。K-means算法是一种常用的聚类算法,它通过迭代优化簇的中心点来实现聚类。本文将介绍如何使用Python编程语言和Scikit-learn库实现K-means算法,以及如何对数据进行聚类分

- 基于聚类的点云背景分离算法python代码

love6a6

算法聚类python

点云背景分离是一个常用的计算机视觉任务,它旨在从点云数据中分离出感兴趣的物体。聚类是一种常用的方法,可以通过将相似的点聚集在一起来完成背景分离。下面是一个简单的基于K-Means聚类的点云背景分离的Python代码示例,使用的是scikit-learn库:importnumpyasnpfromsklearn.clusterimportKMeansfromsklearn.preprocessingi

- 多元统计分析课程论文-聚类效果评价

talle2021

数据分析机器学习聚类数据挖掘机器学习

数据集来源:UnsupervisedLearningonCountryData(kaggle.com)代码参考:Clustering:PCA|K-Means-DBSCAN-Hierarchical||Kaggle基于特征合成降维和主成分分析法降维的国家数据集聚类效果评价目录1.特征合成降维2.PCA降维3.K-Means聚类3.1对特征合成降维的数据聚类分析3.2对PCA降维的数据聚类分析摘要:本

- c++下使用Open3D进行DBSCAN聚类

Patient patient.

聚类c++DBSCANOpen3d

c++下使用Open3D进行DBSCAN聚类#include#include#includeusingnamespaceopen3d;usingnamespacestd;intmain(intargc,char*argv[]){//读取点云std::shared_ptrcloud(newgeometry::PointCloud);open3d::io::ReadPointCloud("C:/Use

- open3d k-means 聚类

云杂项

open3d持续更新kmeans聚类算法计算机视觉python机器学习

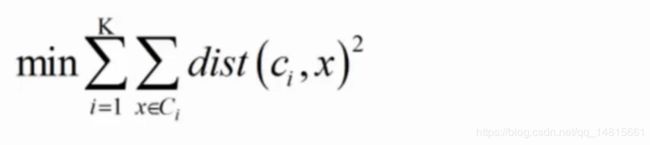

k-means聚类一、算法原理1、介绍2、算法步骤二、代码1、机器学习生成`kmeans`聚类2、点云学习生成聚类三、结果1、原点云2、机器学习生成`kmeans`聚类3、点云学习生成聚类四、相关链接一、算法原理1、介绍K-means聚类算法是一种无监督学习算法,主要用于数据聚类。该算法的主要目标是找到一个数据点的划分,使得每个数据点与其所在簇的质心(即该簇所有数据点的均值)之间的平方距离之和最小

- Open3d dbscan聚类算法cluster_dbscan

mm_exploration

python+Open3dpythonopen3d

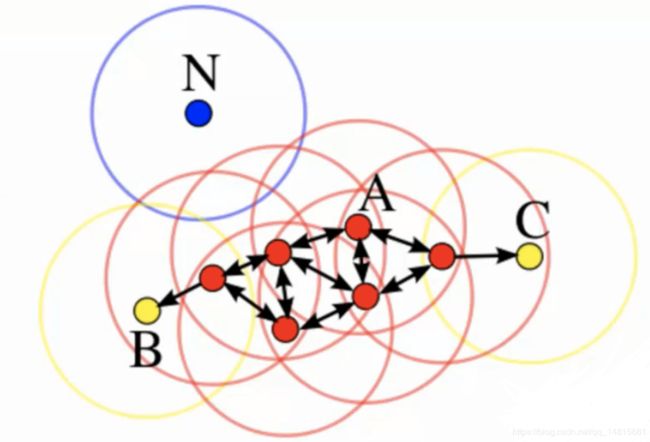

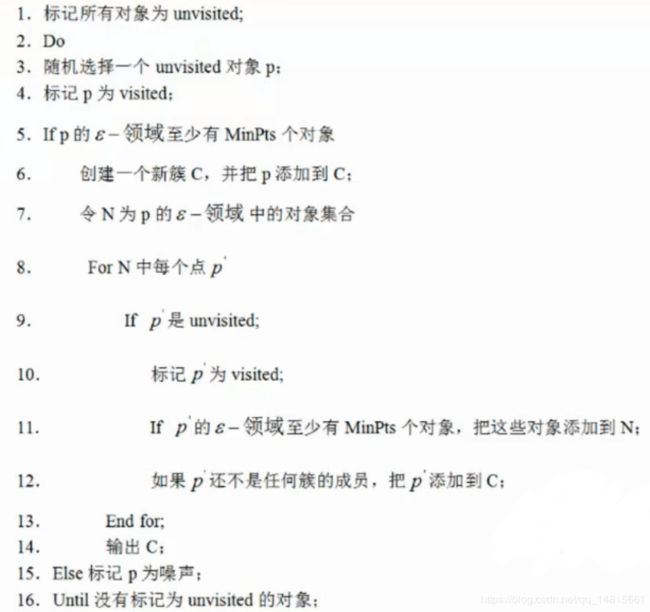

目录一、dbscan聚类算法介绍二、cluster_dbscan函数解析三、代码实现一、dbscan聚类算法介绍下面这篇文章介绍的非常详细,如果有兴趣消息了解算法的,可以移步到这里:https://blog.csdn.net/weixin_50514171/article/details/127195711dbscan是一种基于密度的聚类算法,根据点周围的密度,将点进行聚类划分。几个概念(半径ep

- open3d 点云聚类dbscan

Mr.Q

open3d聚类python

关键代码:labels=np.array(pcd.cluster_dbscan(eps=0.02,min_points=10,print_progress=True))point_cloud_dbscan_clustering.pyimportopen3daso3dimportnumpyasnpimportmatplotlib.pyplotaspltif__name__=="__main__":#

- open3d DBSCAN 聚类

云杂项

open3d持续更新聚类计算机视觉3d算法python

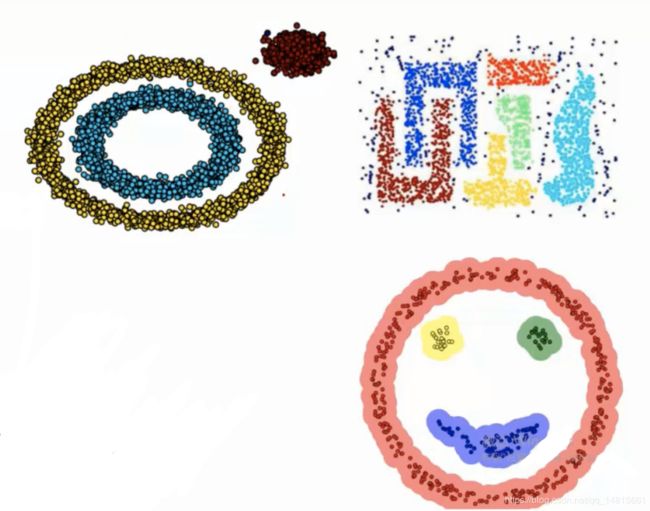

DBSCAN聚类一、算法原理1.密度聚类2、主要函数二、代码三、结果四、相关数据一、算法原理1.密度聚类介绍基于密度的噪声应用空间聚类(DBSCAN):是一种无监督的ML聚类算法。无监督的意思是它不使用预先标记的目标来聚类数据点。聚类是指试图将相似的数据点分组到人工确定的组或簇中。另一方面,DBSCAN不要求我们指定集群的数量,避免了异常值,并且在任意形状和大小的集群中工作得非常好。它没有质心,聚

- K-means(K均值聚类算法)算法笔记

Longlongaaago

机器学习机器学习kmeans算法

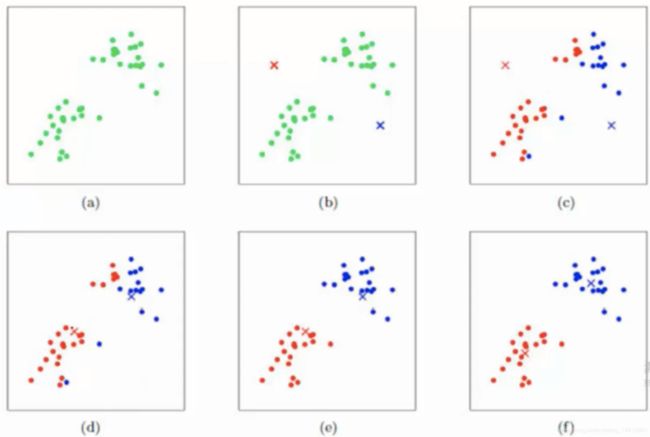

K-means(K均值聚类算法)算法笔记K-means算法,是比较简单的无监督的算法,通过设定好初始的类别k,然后不断循环迭代,将给定的数据自动分为K个类别。事实上,大家都知道K-means是怎么算的,但实际上,它是GMM(高斯混合模型)的一个特例,其而GMM是基于EM算法得来的,所以本文,将对K-means算法的算法思想进行分析。算法流程K-means算法的算法流程非常简单,可以从下图进行讲解(

- k-means 选择K的demo

你有啥子事

#!/usr/bin/envpython#-*-coding:utf-8-*-#@Time:2018/10/12下午5:29#@Author:liuchengwei#@Site:#@File:demo.py#@Software:PyCharmimportsysifsys.version[0]=='2':reload(sys)sys.setdefaultencoding("utf-8")fromge

- 2019-04-15派森学习第147天

每日派森

想要实现E-ACO的程序。先实现根据论文中的公式计算K-means的K值,在此之前写出给定K值后进行K-means聚类的程序。给定K=5后,聚类情况:K-means考虑到派工中的实际情况,维修站驻守的工人人数也不会太多,直接可以把工人人数设置为k。

- 数学建模:K-means聚类手肘法确定k值(含python实现)

图学习的小张

数学建模kmeans聚类

原理 当K-means聚类的k值不被指定时,可以通过手肘法来估计聚类数量。 在聚类的过程中,随着聚类数的增大,样本划分会变得更加精细,每个类别的聚合程度更高,那么误差平方和(SSE)会逐渐变小,误差平方和即该类重心与其内部成员位置距离的平方和。SSE是手肘法的核心指标,其公式为:SSE=∑i=1k∑p∈C∣p−mi∣2SSE=\sum_{i=1}^{k}\sum_{p\inC}|p-m_i|^

- 网络数据的K-means聚类算法

fpga和matlab

MATLAB板块5:网络通信★MATLAB算法仿真经验网络kmeans聚类

随着Internet的大规模普及、信息处理技术和数据处理技术的发展及企业信息化程度的提高,各种网络资源以爆炸式速度迅猛增长,现存的网络资源以数据库存储的形式为主,数据的形式以半结构化和结构化的形式存储。但是在网络技术迅猛发达的今天,数据库中的数据量更是以惊人的速度发展,就形成了数据量很大而对于有用的信息的发掘和利用成为一大难题的现象,也成为现在研究的热点问题。如何从激增的数据背后找到有价值的信息,

- 全连接神经网络实现手写数字识别

zeronose

codetips深度学习机器学习

可能我的学弟学妹们会搜到这篇文章,此时的你们正在为作业发愁,哈哈其他实现手写数字识别的方法:1.聚类(K-means)实现手写数字识别2.KNN实现手写数字识别3.卷积神经网络(CNN)实现手写数字识别4.聚类(K-means)实现手写数字识别-2实验数据是老师收集了所有人的手写数字图片,且经过处理将图像生成了.txt文件,如何生成点击这,如下图2.代码实现fromkeras.utilsimpor

- 机器学习原型聚类

黄粱梦醒

1.原型聚类原型聚类即“基于原型的聚类”(prototype-basedclustering),原型表示模板的意思,就是通过参考一个模板向量或模板分布的方式来完成聚类的过程,常见的K-Means便是基于簇中心来实现聚类,混合高斯聚类则是基于簇分布来实现聚类。1.2kmeans1.2.1基本原理K-means是一种常见的聚类算法,也叫k均值或k平均。通过迭代的方式,每次迭代都将数据集中的各个点划分到

- 机器学习原理到Python代码实现之K-Means

神仙盼盼

机器学习基于python的算法设计机器学习pythonkmeans

K-Means聚类算法该文章作为机器学习的第四篇文章,主要介绍的是K-Means聚类算法,这是我们介绍的第一个无监督算法,在这里我们将对什么是无监督,为什么要有无监督等也会有一些介绍,算法不难,大家且看且思考。难度系数:⭐更多相关工作请参考:Github算法介绍K-Means算法是一种无监督的聚类分析算法,通过迭代过程将数据划分为K个聚类。该算法以距离作为数据对象间相似度的衡量标准,将数据对象分配

- 【Matlab】聚类方法_基于DBSCAN的密度聚类

敲代码两年半的练习生

聚类matlab

【Matlab】聚类方法_基于DBSCAN的密度聚类1.基本思想2.数据集介绍3.文件结构4.详细代码及注释5.运行结果1.基本思想基于DBSCAN的密度聚类的基本思想是:对于任意一个点,如果在它的ε-邻域(ε-Neighborhood)内至少有MinPts个点,那么这些点就可以被划分到同一个簇中。其中,ε是半径,MinPts是最小点数。DBSCAN算法将数据点分为三类:核心点、边界点和噪声点。核

- 159基于matlab的基于密度的噪声应用空间聚类(DBSCAN)算法对点进行聚类

顶呱呱程序

matlab工程应用算法matlab聚类无监督学习基于密度的噪声应用空间聚类

基于matlab的基于密度的噪声应用空间聚类(DBSCAN)算法对点进行聚类,聚类结果效果好,DBSCAN不要求我们指定集群的数量,避免了异常值,并且在任意形状和大小的集群中工作得非常好。它没有质心,聚类簇是通过将相邻的点连接在一起的过程形成的。优于kmeans。程序已调通,可直接运行。159基于密度的噪声应用空间聚类无监督学习(xiaohongshu.com)

- 【计算机视觉】计算机视觉与深度学习-10-生成网络-北邮鲁鹏老师课程笔记

暖焱

#深度学习计算机视觉机器学习

计算机视觉与深度学习-10-生成网络-北邮鲁鹏老师课程笔记无监督学习聚类K-means降维线性降维主成分分析非线性降维自编码特征学习密度估计贝叶斯决策生成模型生成模型的应用生成模型分类密度估计参考密度估计分类显示的密度估计PixelRNNandPixelCNNVariationalAutoencoders(VAE)隐式的密度估计GANPixelRNNandPixelCNNPixelRNN与Pixe

- 统计-聚类:K means 和 K nearest

PriscillaBai

K值选择原理:1目前尚没有明确的方法选择最佳,所以需要多尝试2K值低,会受离群值的影响3K值高,会导致一些小样本量的样本没有话语权K-means原理:1选择K值。2如果K=3,就随机选择3个母点3计算每个点到这三个母点的距离d4找到距离d的最小值,这个点就属于哪一类5重复很多很多次,直至不再变化了,此时数据就被分成K=3类Knearest原理:1.将数据映射成PCA的格式2.随机找一个母点imag

- 机器学习系列——(二十)密度聚类

飞影铠甲

机器学习机器学习聚类支持向量机

引言在机器学习的无监督学习领域,聚类算法是一种关键的技术,用于发现数据集中的内在结构和模式。与传统的基于距离的聚类方法(如K-Means)不同,密度聚类关注于数据分布的密度,旨在识别被低密度区域分隔的高密度区域。这种方法在处理具有复杂形状和大小的聚类时表现出色,尤其擅长于识别噪声和异常值。本文将详细介绍密度聚类的概念、主要算法及其应用。一、概述密度聚类基于一个核心思想:聚类可以通过连接密度相似的点

- 聚类分析实验报告

平凡女生的创作

聚类分析在市场细分中的目的是构建细分市场,基本思想是“物以类聚”,辨别事物在某些特征上的相似性或相异性,并按照这些特性将事物划分为几个类别,是在同一类别中的事物有较大的相似性,不同类别中的事物有较大的差异。本文介绍的是聚类分析方法中的非层次聚类法——K-Means聚类法,也称快速聚类法。适用于大样本的聚类分析,可以节省运算时间。该实验的数据来源于上一个因子分析实验的结果(三列FAC)。实验目的实验

- 优化算法应用(四)优化聚类算法

stronghorse

一.目标描述聚类算法是一类无监督机器学习算法,即在使用该算法时不需要知道数据的标签,而是通过数据各个维度之间的某些特征对数据集进行划分。现在已有的聚类算法很多,划分方式也多种多样。这里主要是针对使用聚类中心来直接划分聚类的算法进行优化,同时对不适用聚类中心直接划分的聚类算法优化方式进行一个探究。将使用以下两个聚类算法来进行说明。1.k均值聚类(k-means)2.密度峰值聚类(dpc)二.优化k均

- 【机器学习】Kmeans如何选择k值

TwcatL_tree

机器学习人工智能深度学习机器学习kmeans人工智能

确定K值是K-means聚类分析的一个重要步骤。不同的K值可能会产生不同的聚类结果,因此选择合适的K值非常重要。以下是一些常见的方法来选择K值:手肘法:该方法基于绘制聚类内误差平方和(SSE)与K值之间的关系图。随着K值的增加,SSE会逐渐降低,但降低幅度逐渐减小。手肘法的目标就是找到SSE下降的速度开始变慢的“拐点”,这个点就是最佳的K值。轮廓系数法:该方法基于每个数据点与它所属的聚类中心的距离

- 机器学习系列——(十八)K-means聚类

飞影铠甲

机器学习机器学习kmeans聚类

引言在众多机器学习技术中,K-means聚类以其简洁高效著称,成为了数据分析师和算法工程师手中的利器。无论是在市场细分、社交网络分析,还是图像处理等领域,K-means都扮演着至关重要的角色。本文旨在深入解析K-means聚类的原理、实现方式、优缺点及其应用,以期为读者提供全面而深入的理解。一、K-means聚类简介K-means是一种基于划分的聚类算法,它的目标是将n个对象根据属性分为k个簇,使

- 图像聚类

顽皮的石头7788121

(1)利用主成分分析后选取主成分利用k-means算法进行聚类(2)提取图像的灰度直方图,利用直方图作为特征向量聚类。(有些类似层次聚类,通过小区间合并依次聚类)(3)像素聚类,使用滑窗方式求取局部均值,利用相关均值矩阵进行聚类。(4)谱聚类:首先计算n个图像数据的相似性矩阵,矩阵中每个元素表示两个元素之间的相似度。通过相似度矩阵构建谱矩阵(具体通过拉普拉斯矩阵实现),对普矩阵进行特征分解得到特征

- sklearn-第五节(K-means算法)

~一段浮华

sklearn算法kmeans

1.k-means聚类算法思想kmeans算法又名k均值算法,K-means算法中的k表示的是聚类为k个簇,means代表取每一个聚类中数据值的均值作为该簇的中心,或者称为质心,即用每一个的类的质心对该簇进行描述。其算法思想大致为:先从样本集中随机选取k个样本作为簇中心,并计算所有样本与这k个“簇中心”的距离,对于每一个样本,将其划分到与其距离最近的“簇中心”所在的簇中,对于新的簇计算各个簇的新的

- 机器学习本科课程 实验6 聚类实验

11egativ1ty

机器学习本科课程机器学习聚类人工智能

第一题:使用sklearn的DBSCAN和AgglomerativeClustering完成聚类实验内容:使用sklearn的DBSCAN和AgglomerativeClustering在两个数据集上完成聚类任务对聚类结果可视化对比外部指标FMI和NMI1.导入模块importnumpyasnpimportmatplotlib.pyplotasplt%matplotlibinlineimportw

- VMware Workstation 11 或者 VMware Player 7安装MAC OS X 10.10 Yosemite

iwindyforest

vmwaremac os10.10workstationplayer

最近尝试了下VMware下安装MacOS 系统,

安装过程中发现网上可供参考的文章都是VMware Workstation 10以下, MacOS X 10.9以下的文章,

只能提供大概的思路, 但是实际安装起来由于版本问题, 走了不少弯路, 所以我尝试写以下总结, 希望能给有兴趣安装OSX的人提供一点帮助。

写在前面的话:

其实安装好后发现, 由于我的th

- 关于《基于模型驱动的B/S在线开发平台》源代码开源的疑虑?

deathwknight

JavaScriptjava框架

本人从学习Java开发到现在已有10年整,从一个要自学 java买成javascript的小菜鸟,成长为只会java和javascript语言的老菜鸟(个人邮箱:

[email protected])

一路走来,跌跌撞撞。用自己的三年多业余时间,瞎搞一个小东西(基于模型驱动的B/S在线开发平台,非MVC框架、非代码生成)。希望与大家一起分享,同时有许些疑虑,希望有人可以交流下

平台

- 如何把maven项目转成web项目

Kai_Ge

mavenMyEclipse

创建Web工程,使用eclipse ee创建maven web工程 1.右键项目,选择Project Facets,点击Convert to faceted from 2.更改Dynamic Web Module的Version为2.5.(3.0为Java7的,Tomcat6不支持). 如果提示错误,可能需要在Java Compiler设置Compiler compl

- 主管???

Array_06

工作

转载:http://www.blogjava.net/fastzch/archive/2010/11/25/339054.html

很久以前跟同事参加的培训,同事整理得很详细,必须得转!

前段时间,公司有组织中高阶主管及其培养干部进行了为期三天的管理训练培训。三天的课程下来,虽然内容较多,因对老师三天来的课程内容深有感触,故借着整理学习心得的机会,将三天来的培训课程做了一个

- python内置函数大全

2002wmj

python

最近一直在看python的document,打算在基础方面重点看一下python的keyword、Build-in Function、Build-in Constants、Build-in Types、Build-in Exception这四个方面,其实在看的时候发现整个《The Python Standard Library》章节都是很不错的,其中描述了很多不错的主题。先把Build-in Fu

- JSP页面通过JQUERY合并行

357029540

JavaScriptjquery

在写程序的过程中我们难免会遇到在页面上合并单元行的情况,如图所示

如果对于会的同学可能很简单,但是对没有思路的同学来说还是比较麻烦的,提供一下用JQUERY实现的参考代码

function mergeCell(){

var trs = $("#table tr");

&nb

- Java基础

冰天百华

java基础

学习函数式编程

package base;

import java.text.DecimalFormat;

public class Main {

public static void main(String[] args) {

// Integer a = 4;

// Double aa = (double)a / 100000;

// Decimal

- unix时间戳相互转换

adminjun

转换unix时间戳

如何在不同编程语言中获取现在的Unix时间戳(Unix timestamp)? Java time JavaScript Math.round(new Date().getTime()/1000)

getTime()返回数值的单位是毫秒 Microsoft .NET / C# epoch = (DateTime.Now.ToUniversalTime().Ticks - 62135

- 作为一个合格程序员该做的事

aijuans

程序员

作为一个合格程序员每天该做的事 1、总结自己一天任务的完成情况 最好的方式是写工作日志,把自己今天完成了什么事情,遇见了什么问题都记录下来,日后翻看好处多多

2、考虑自己明天应该做的主要工作 把明天要做的事情列出来,并按照优先级排列,第二天应该把自己效率最高的时间分配给最重要的工作

3、考虑自己一天工作中失误的地方,并想出避免下一次再犯的方法 出错不要紧,最重

- 由html5视频播放引发的总结

ayaoxinchao

html5视频video

前言

项目中存在视频播放的功能,前期设计是以flash播放器播放视频的。但是现在由于需要兼容苹果的设备,必须采用html5的方式来播放视频。我就出于兴趣对html5播放视频做了简单的了解,不了解不知道,水真是很深。本文所记录的知识一些浅尝辄止的知识,说起来很惭愧。

视频结构

本该直接介绍html5的<video>的,但鉴于本人对视频

- 解决httpclient访问自签名https报javax.net.ssl.SSLHandshakeException: sun.security.validat

bewithme

httpclient

如果你构建了一个https协议的站点,而此站点的安全证书并不是合法的第三方证书颁发机构所签发,那么你用httpclient去访问此站点会报如下错误

javax.net.ssl.SSLHandshakeException: sun.security.validator.ValidatorException: PKIX path bu

- Jedis连接池的入门级使用

bijian1013

redisredis数据库jedis

Jedis连接池操作步骤如下:

a.获取Jedis实例需要从JedisPool中获取;

b.用完Jedis实例需要返还给JedisPool;

c.如果Jedis在使用过程中出错,则也需要还给JedisPool;

packag

- 变与不变

bingyingao

不变变亲情永恒

变与不变

周末骑车转到了五年前租住的小区,曾经最爱吃的西北面馆、江西水饺、手工拉面早已不在,

各种店铺都换了好几茬,这些是变的。

三年前还很流行的一款手机在今天看起来已经落后的不像样子。

三年前还运行的好好的一家公司,今天也已经不复存在。

一座座高楼拔地而起,

- 【Scala十】Scala核心四:集合框架之List

bit1129

scala

Spark的RDD作为一个分布式不可变的数据集合,它提供的转换操作,很多是借鉴于Scala的集合框架提供的一些函数,因此,有必要对Scala的集合进行详细的了解

1. 泛型集合都是协变的,对于List而言,如果B是A的子类,那么List[B]也是List[A]的子类,即可以把List[B]的实例赋值给List[A]变量

2. 给变量赋值(注意val关键字,a,b

- Nested Functions in C

bookjovi

cclosure

Nested Functions 又称closure,属于functional language中的概念,一直以为C中是不支持closure的,现在看来我错了,不过C标准中是不支持的,而GCC支持。

既然GCC支持了closure,那么 lexical scoping自然也支持了,同时在C中label也是可以在nested functions中自由跳转的

- Java-Collections Framework学习与总结-WeakHashMap

BrokenDreams

Collections

总结这个类之前,首先看一下Java引用的相关知识。Java的引用分为四种:强引用、软引用、弱引用和虚引用。

强引用:就是常见的代码中的引用,如Object o = new Object();存在强引用的对象不会被垃圾收集

- 读《研磨设计模式》-代码笔记-解释器模式-Interpret

bylijinnan

java设计模式

声明: 本文只为方便我个人查阅和理解,详细的分析以及源代码请移步 原作者的博客http://chjavach.iteye.com/

package design.pattern;

/*

* 解释器(Interpreter)模式的意图是可以按照自己定义的组合规则集合来组合可执行对象

*

* 代码示例实现XML里面1.读取单个元素的值 2.读取单个属性的值

* 多

- After Effects操作&快捷键

cherishLC

After Effects

1、快捷键官方文档

中文版:https://helpx.adobe.com/cn/after-effects/using/keyboard-shortcuts-reference.html

英文版:https://helpx.adobe.com/after-effects/using/keyboard-shortcuts-reference.html

2、常用快捷键

- Maven 常用命令

crabdave

maven

Maven 常用命令

mvn archetype:generate

mvn install

mvn clean

mvn clean complie

mvn clean test

mvn clean install

mvn clean package

mvn test

mvn package

mvn site

mvn dependency:res

- shell bad substitution

daizj

shell脚本

#!/bin/sh

/data/script/common/run_cmd.exp 192.168.13.168 "impala-shell -islave4 -q 'insert OVERWRITE table imeis.${tableName} select ${selectFields}, ds, fnv_hash(concat(cast(ds as string), im

- Java SE 第二讲(原生数据类型 Primitive Data Type)

dcj3sjt126com

java

Java SE 第二讲:

1. Windows: notepad, editplus, ultraedit, gvim

Linux: vi, vim, gedit

2. Java 中的数据类型分为两大类:

1)原生数据类型 (Primitive Data Type)

2)引用类型(对象类型) (R

- CGridView中实现批量删除

dcj3sjt126com

PHPyii

1,CGridView中的columns添加

array(

'selectableRows' => 2,

'footer' => '<button type="button" onclick="GetCheckbox();" style=&

- Java中泛型的各种使用

dyy_gusi

java泛型

Java中的泛型的使用:1.普通的泛型使用

在使用类的时候后面的<>中的类型就是我们确定的类型。

public class MyClass1<T> {//此处定义的泛型是T

private T var;

public T getVar() {

return var;

}

public void setVa

- Web开发技术十年发展历程

gcq511120594

Web浏览器数据挖掘

回顾web开发技术这十年发展历程:

Ajax

03年的时候我上六年级,那时候网吧刚在小县城的角落萌生。传奇,大话西游第一代网游一时风靡。我抱着试一试的心态给了网吧老板两块钱想申请个号玩玩,然后接下来的一个小时我一直在,注,册,账,号。

彼时网吧用的512k的带宽,注册的时候,填了一堆信息,提交,页面跳转,嘣,”您填写的信息有误,请重填”。然后跳转回注册页面,以此循环。我现在时常想,如果当时a

- openSession()与getCurrentSession()区别:

hetongfei

javaDAOHibernate

来自 http://blog.csdn.net/dy511/article/details/6166134

1.getCurrentSession创建的session会和绑定到当前线程,而openSession不会。

2. getCurrentSession创建的线程会在事务回滚或事物提交后自动关闭,而openSession必须手动关闭。

这里getCurrentSession本地事务(本地

- 第一章 安装Nginx+Lua开发环境

jinnianshilongnian

nginxluaopenresty

首先我们选择使用OpenResty,其是由Nginx核心加很多第三方模块组成,其最大的亮点是默认集成了Lua开发环境,使得Nginx可以作为一个Web Server使用。借助于Nginx的事件驱动模型和非阻塞IO,可以实现高性能的Web应用程序。而且OpenResty提供了大量组件如Mysql、Redis、Memcached等等,使在Nginx上开发Web应用更方便更简单。目前在京东如实时价格、秒

- HSQLDB In-Process方式访问内存数据库

liyonghui160com

HSQLDB一大特色就是能够在内存中建立数据库,当然它也能将这些内存数据库保存到文件中以便实现真正的持久化。

先睹为快!

下面是一个In-Process方式访问内存数据库的代码示例:

下面代码需要引入hsqldb.jar包 (hsqldb-2.2.8)

import java.s

- Java线程的5个使用技巧

pda158

java数据结构

Java线程有哪些不太为人所知的技巧与用法? 萝卜白菜各有所爱。像我就喜欢Java。学无止境,这也是我喜欢它的一个原因。日常

工作中你所用到的工具,通常都有些你从来没有了解过的东西,比方说某个方法或者是一些有趣的用法。比如说线程。没错,就是线程。或者确切说是Thread这个类。当我们在构建高可扩展性系统的时候,通常会面临各种各样的并发编程的问题,不过我们现在所要讲的可能会略有不同。

- 开发资源大整合:编程语言篇——JavaScript(1)

shoothao

JavaScript

概述:本系列的资源整合来自于github中各个领域的大牛,来收藏你感兴趣的东西吧。

程序包管理器

管理javascript库并提供对这些库的快速使用与打包的服务。

Bower - 用于web的程序包管理。

component - 用于客户端的程序包管理,构建更好的web应用程序。

spm - 全新的静态的文件包管

- 避免使用终结函数

vahoa.ma

javajvmC++

终结函数(finalizer)通常是不可预测的,常常也是很危险的,一般情况下不是必要的。使用终结函数会导致不稳定的行为、更差的性能,以及带来移植性问题。不要把终结函数当做C++中的析构函数(destructors)的对应物。

我自己总结了一下这一条的综合性结论是这样的:

1)在涉及使用资源,使用完毕后要释放资源的情形下,首先要用一个显示的方