Spark基础环境搭建——local本地模式

Spark环境搭建

提前声明:

1.我们选择目前企业中使用最多的稳定版Spark2.2.0

2.为了方便浏览和更改配置信息,我们把主机名更换为node01,node02.....

local本地模式

<1> 安装

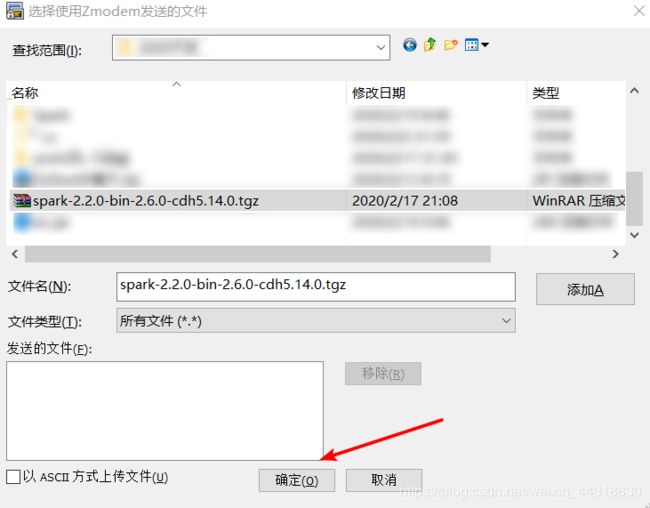

我们需要下载Spark的安装包。

下载地址:http://spark.apache.org/downloads.html

cd /export/servers

tar spark-2.2.0-bin-2.6.0-cdh5.14.0.tgz

mv spark-2.2.0-bin-2.6.0-cdh5.14.0 spark

- 注意:

如果有权限问题,可以修改为root,方便学习时操作,实际中使用运维分配的用户和权限即可。

chown -R root /export/servers/spark

chgrp -R root /export/servers/spark

- 解压目录说明

bin 可执行脚本

conf 配置文件

data 示例程序使用数据

examples 示例程序

jars 依赖 jar 包

python pythonAPI

R R 语言 API

sbin 集群管理命令

yarn 整合yarn需要的文件

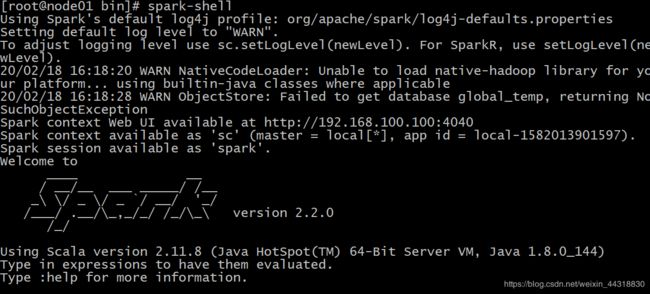

<2>启动spark-shell

<1>直接使用./spark-shell

表示使用local 模式启动,在本机启动一个SparkSubmit进程

<2>还可指定参数 --master,如:

spark-shell --master local[N] 表示在本地模拟N个线程来运行当前任务

spark-shell --master local[*] 表示使用当前机器上所有可用的资源

<3>不携带参数默认就是

spark-shell --master local[*]

<4>后续还可以使用–master指定集群地址,表示把任务提交到集群上运行,如

./spark-shell --master spark://node01:7077,node02:7077

<5>退出spark-shell

使用 :quit

ok,说了那么多概念,接下来让我们来感受一下Spark的具体使用~

<3>初体验-读取本地文件

让我们来准备点数据

vim /root/words.txt

hello me you her

hello you her

hello her

hello

spark-shell进入到命令行后程序后,输入下面的代码

val textFile = sc.textFile("file:///root/words.txt")

val counts = textFile.flatMap(_.split(" ")).map((_, 1)).reduceByKey(_ + _)

counts.collect //收集结果

// 预期结果: Array[(String, Int)] = Array((you,2), (hello,4), (me,1), (her,3))

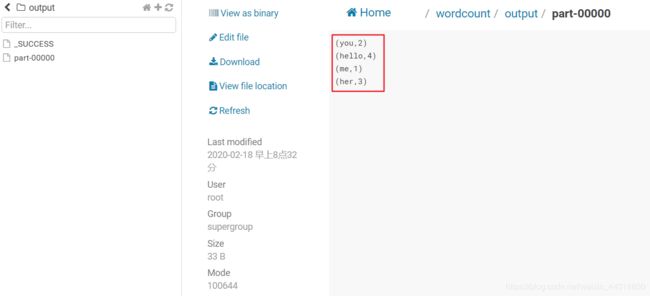

<4>初体验-读取HDFS文件

- 准备数据

上传文件到hdfs

hadoop fs -put /root/words.txt /wordcount/input/words.txt

目录如果不存在可以创建

hadoop fs -mkdir -p /wordcount/input

结束后删除测试文件夹即可

hadoop fs -rm -r /wordcount

在Spark的shell窗口中输入

val textFile = sc.textFile("hdfs://node01:8020/wordcount/input/words.txt")

val counts = textFile.flatMap(_.split(" ")).map((_, 1)).reduceByKey(_ + _)

counts.saveAsTextFile("hdfs://node01:8020/wordcount/output")

待到程序执行完毕,我们进入到HDFS的UI界面进行查看

看到上述的场景,说明我们的程序以及环境搭建是没有问题的。

好了,本次的分享就到这里,喜欢的小伙伴们记得点赞加关注哟~

![]()