将自己的数据导入SAE神经网络(替换样例中mnist数据集的方法)

如何将自己需要处理的数据导入神经网络

前些日子看了一下稀疏编码器,然后在网上找了一份稀疏编码器的源码。源码是以经典的mnist数据集为例,而我则为如何把自己想编码的数据导入网络而伤透了脑筋。

之后看到一篇博主的博客。发现Python还可以接受.mat格式的文件。凑巧刚刚学了MATLAB,所以较为轻松的解决了数据导入的问题,现将方法记录于此。

1.建立.mat文件(博主用的MATLAB2016a)

首先将文本文档中的数据导入然后将数据赋值给一个变量:

f=importdata('12726.txt'); %将你的数据从电子文件(表格也可以)加载到matlab中 x=f.data([1:784],2);%将f中data的第二列数据输入给x

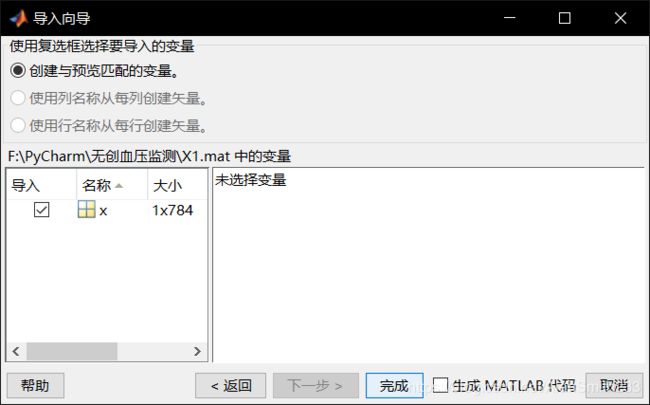

右击工作空间中的x变量可以选择另存为,我将它命名为X1。之后将.mat文件复制到与程序所在的文件夹,然后利用下段代码就可以将.mat文件中的数据导入到神经网络中。X1文件如下:

2.将.mat文件中的数据导入神经网络

利用下面的代码可以将准备好的mat文件导入到网络中

load_fn = 'X1.mat' #X1.mat为需要导入的文件名

load_data = sio.loadmat(load_fn) #利用loadmat方法将.mat中的数据导入到变量中

mnist = load_data['x'] #读取mat文件中属性x中的数据

由于博主懒得一一改下面的mnist变量名,索性直接将数据赋给了mnist

3.源码

源码如下:(注释掉的部分为以mnist数据集为例的代码)

# coding=utf-8

'''

Created on 2019年10月24日

@author: Alan

'''

import tensorflow as tf

import numpy as np

import matplotlib.pyplot as plt

import scipy.io as sio

# 导入 MNIST 数据

#from tensorflow.examples.tutorials.mnist import input_data

#mnist = input_data.read_data_sets("/tmp/data/", one_hot=True)

load_fn = 'X1.mat'

load_data = sio.loadmat(load_fn)

mnist = load_data['A'] #读取相应属性的数据

# 参数

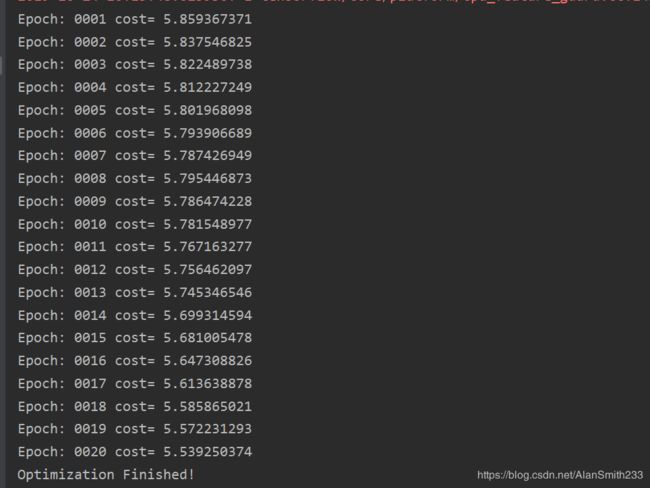

learning_rate = 0.01 # 学习速率

training_epochs = 20 # 训练批次

batch_size = 256 # 随机选择训练数据大小

display_step = 1 # 展示步骤

examples_to_show = 10 # 显示示例图片数量

# 网络参数

# 我这里采用了三层编码,实际针对mnist数据,隐层两层,分别为256,128效果最好

n_hidden_1 = 512 # 第一隐层神经元数量

n_hidden_2 = 256 # 第二

n_hidden_3 = 128 # 第三

n_input = 784 # 输入

# tf Graph输入

X = tf.placeholder("float", [None, n_input])

# 权重初始化

weights = {

'encoder_h1': tf.Variable(tf.random_normal([n_input, n_hidden_1])),

'encoder_h2': tf.Variable(tf.random_normal([n_hidden_1, n_hidden_2])),

'encoder_h3': tf.Variable(tf.random_normal([n_hidden_2, n_hidden_3])),

'decoder_h1': tf.Variable(tf.random_normal([n_hidden_3, n_hidden_2])),

'decoder_h2': tf.Variable(tf.random_normal([n_hidden_2, n_hidden_1])),

'decoder_h3': tf.Variable(tf.random_normal([n_hidden_1, n_input])),

}

# 偏置值初始化

biases = {

'encoder_b1': tf.Variable(tf.random_normal([n_hidden_1])),

'encoder_b2': tf.Variable(tf.random_normal([n_hidden_2])),

'encoder_b3': tf.Variable(tf.random_normal([n_hidden_3])),

'decoder_b1': tf.Variable(tf.random_normal([n_hidden_2])),

'decoder_b2': tf.Variable(tf.random_normal([n_hidden_1])),

'decoder_b3': tf.Variable(tf.random_normal([n_input])),

}

# 开始编码

def encoder(x):

# sigmoid激活函数,layer = x*weights['encoder_h1']+biases['encoder_b1']

layer_1 = tf.nn.sigmoid(tf.add(tf.matmul(x, weights['encoder_h1']),

biases['encoder_b1']))

layer_2 = tf.nn.sigmoid(tf.add(tf.matmul(layer_1, weights['encoder_h2']),

biases['encoder_b2']))

layer_3 = tf.nn.sigmoid(tf.add(tf.matmul(layer_2, weights['encoder_h3']),

biases['encoder_b3']))

return layer_3

# 开始解码

def decoder(x):

# sigmoid激活函数,layer = x*weights['decoder_h1']+biases['decoder_b1']

layer_1 = tf.nn.sigmoid(tf.add(tf.matmul(x, weights['decoder_h1']),

biases['decoder_b1']))

layer_2 = tf.nn.sigmoid(tf.add(tf.matmul(layer_1, weights['decoder_h2']),

biases['decoder_b2']))

layer_3 = tf.nn.sigmoid(tf.add(tf.matmul(layer_2, weights['decoder_h3']),

biases['decoder_b3']))

return layer_3

# 构造模型

encoder_op = encoder(X) #调用encoder函数以X作为输入值,将返回值传递给encoder_op

encoder_result = encoder_op

decoder_op = decoder(encoder_op) #调用decoder函数以encoder的返回值作为输入值,将返回值传递给decoder_op

# 预测

y_pred = decoder_op

# 实际输入数据当作标签

y_true = X

# 定义代价函数和优化器,最小化平方误差,这里可以根据实际修改误差模型

cost = tf.reduce_mean(tf.pow(y_true - y_pred, 2))

optimizer = tf.train.RMSPropOptimizer(learning_rate).minimize(cost)

# 初始化变量

init = tf.initialize_all_variables();

# 运行Graph

with tf.Session() as sess:

sess.run(init)

# 总的batch

#total_batch = int(mnist.train.num_examples / batch_size)

total_batch = 3

# 开始训练

for epoch in range(training_epochs):

for i in range(total_batch):

#batch_xs, batch_ys = mnist.train.next_batch(batch_size)

batch_xs = mnist

_, c = sess.run([optimizer, cost], feed_dict={X: batch_xs})

# 展示每次训练结果

if epoch % display_step == 0:

print("Epoch:", '%04d' % (epoch + 1),

"cost=", "{:.9f}".format(c))

print("Optimization Finished!")

# Applying encode and decode over test set

# 显示编码结果和解码后结果

encodes = sess.run(

encoder_result, feed_dict={X: mnist})

encode_decode = sess.run(

y_pred, feed_dict={X: mnist})

np.set_printoptions(suppress=True) #不以科学计数法输出

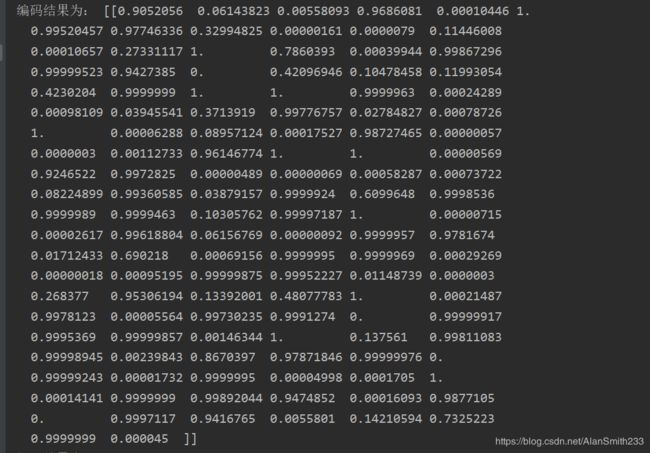

print('编码结果为:',encodes)

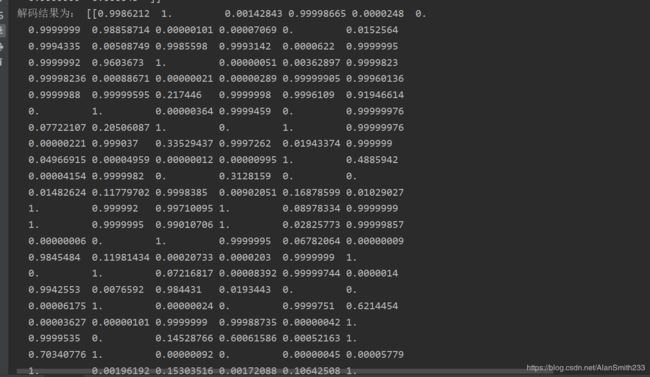

print('解码结果为:',encode_decode)

# #对比原始图片重建图片

# f, a = plt.subplots(2, 10, figsize=(10, 2))

# for i in range(examples_to_show):

# a[0][i].imshow(np.reshape(mnist.test.images[i], (28, 28)))

# a[1][i].imshow(np.reshape(encode_decode[i], (28, 28)))

# f.show()

# plt.draw()

# plt.waitforbuttonpress()