批量归一化,优化与凸优化

批量归一化

- 1.对全连接层做批量归一化

位置:全连接层中的仿射变换和激活函数之间。

- 2.对卷积层做批量归⼀化

位置:卷积计算之后、应⽤激活函数之前。

- 3.预测时的批量归⼀化

训练:以batch为单位,对每个batch计算均值和方差。

预测:用移动平均估算整个训练数据集的样本均值和方差。

pytorch中的nn模块定义的BatchNorm1d和BatchNorm2d分别用于全连接层和卷积层。

优化与深度学习

-

优化与估计

尽管优化方法可以最小化深度学习中的损失函数值,但本质上优化方法达到的目标与深度学习的目标并不相同。

- 优化方法目标:训练集损失函数值

- 深度学习目标:测试集损失函数值(泛化性)

- 优化在深度学习中的挑战

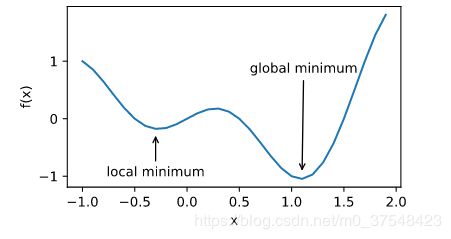

1. 局部最小值

2. 鞍点(一阶导数为0的点)

3. 梯度消失

-

凸函数的性质

- 无局部极小值

- 与凸集的关系

- 二阶条件