CS231N的学习历程(1)

今天重新开始看CS231N(虽然之前也就看了4集)还是被大佬的英语给催眠了,英语还是不够好,每个单词单个出现还是能看得懂,但是他说完我就忘记了他之前说了什么。。。。看PPT大概先是讲了KNN的内容,所以做个笔记,学习一下KNN的相关内容。虽然大佬貌似说这个算法貌似不常用(好像是因为不需要学习,你看,不学习就要被淘汰,还能不能好好地让人逛王者峡谷了)。

K-NearestNeighbor(KNN)又称临近算法,或者说K最近邻(kNN,k-NearestNeighbor)分类算法是数据挖掘分类技术中最简单的方法之一。所谓K最近邻,就是k个最近的邻居的意思,说的是每个样本都可以用它最接近的k个邻居来代表。(emmmm百度都说你最简单了,你还不学习,怪不得被淘汰)。

kNN算法的核心思想是如果一个样本在特征空间中的k个最相邻的样本中的大多数属于某一个类别,则该样本也属于这个类别,并具有这个类别上样本的特性。该方法在确定分类决策上只依据最邻近的一个或者几个样本的类别来决定待分样本所属的类别。 kNN方法在类别决策时,只与极少量的相邻样本有关。由于kNN方法主要靠周围有限的邻近的样本,而不是靠判别类域的方法来确定所属类别的,因此对于类域的交叉或重叠较多的待分样本集来说,kNN方法较其他方法更为适合。

这是KNN的介绍 ,简单地说,就是给一组不同的分类,这时候有一个未知的分类X,那么它属于哪一个分类,就由它周边的元素的种类决定,假设周围有N个元素,分属A,B两个种类,那么现在选择X最近的K个元素,计算K个元素里面A,B的比例大小,哪个比例大,那么X就属于哪个。

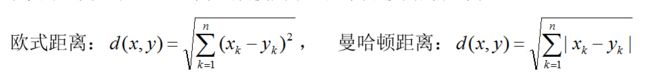

不过也不一定是距离最近,选择的范围有两种,一种是以欧式距离来选取范围,另一种是曼哈顿距离来选择范围。

(其实还有别的距离算法,这里先不列的,目前学习能力还用不到别的更厉害的距离算法。。。。。先理解为住吧,毕竟只是一个菜鸟。)

KNN步骤:

- 计算测试数据与各个训练数据之间的距离;

- 按照距离的递增关系进行排序;

- 选取距离最小的K个点;

- 确定前K个点所在类别的出现频率;

- 返回前K个点中出现频率最高的类别作为测试数据的预测分类。

KNN实例:

KNN:

from numpy import * #no need to add numpy before function

import operator

##creat data set and its lable

def creatDataSet():

group = array([[1.0,2.0],[1.2,0.1],[0.1,1.4],[0.3,3.5]])

labels = ['A','A','B','B']

return group,labels

###classify by KNN

def classify(input,dataSet,label,k):

dataSize = dataSet.shape[0]

###calculate Euclidean Metric

diff = tile(input,(dataSize,1)) - dataSet

sqdiff = diff ** 2

squareDist = sum(sqdiff,axis=1)

dist = squareDist ** 0.5

##sort the distant

sortedDistIndex = argsort(dist) #sort from the biggest to the smallest and return the index

classCount = {}

for i in range(k):

voteLabel = label[sortedDistIndex[i]]

#count the same label's num

classCount[voteLabel] = classCount.get(voteLabel,0) + 1

maxCount = 0

#select the category that appears most frequently

for key,value in classCount.items():

if value > maxCount:

maxCount = value

classes = key

return classesMain函数:

import KNN

from numpy import *

dataSet,labels = KNN.creatDataSet()

input = array([1.1,0.3])

K = 3

output = KNN.classify(input,dataSet,labels,K)

print("test data: ",input,"output data: ",output)输出结果:

![]()

(有点困,明天再补充)