- hadoop常用命令

我要用代码向我喜欢的女孩表白

hadoopnpm大数据

Yarn查看提交到资源调度器的任务(任何用yarn资源的都可以看,比如spark、tez、mapreduce)看正在运行的yarn任务yarnapplication-list杀死对应的yarn任务yarnapplication-kill{application_Id}(id可以通过-list看到)hdfs查看hdfs目录hdfsdfs-ls/(查看本集群的目录)hdfsdfs-lshdfs://i

- 厦门租房信息分析展示(pycharm+python爬虫+pyspark+pyecharts)(踩坑记录)

吃西红柿的鸡蛋

大数据hadoopsparkpython

厦门租房信息分析展示(pycharm+python爬虫+pyspark+pyecharts)(踩坑记录)项目地址http://dblab.xmu.edu.cn/blog/2307/踩坑:Spark分析文件rent_analyse.py改变Spark读取csv文件的写法sparkContext=SparkContext("local","rent_analyse")sqlContext=SQLCon

- Hadoop 和 Spark 的内存管理机制分析

王子良.

经验分享hadoopspark大数据

欢迎来到我的博客!非常高兴能在这里与您相遇。在这里,您不仅能获得有趣的技术分享,还能感受到轻松愉快的氛围。无论您是编程新手,还是资深开发者,都能在这里找到属于您的知识宝藏,学习和成长。博客内容包括:Java核心技术与微服务:涵盖Java基础、JVM、并发编程、Redis、Kafka、Spring等,帮助您全面掌握企业级开发技术。大数据技术:涵盖Hadoop(HDFS)、Hive、Spark、Fli

- 大数据学习(五):如何使用 Livy提交spark批量任务--转载

zuoseve01

livy

Livy是一个开源的REST接口,用于与Spark进行交互,它同时支持提交执行代码段和完整的程序。Livy封装了spark-submit并支持远端执行。启动服务器执行以下命令,启动livy服务器。./bin/livy-server这里假设spark使用yarn模式,所以所有文件路径都默认位于HDFS中。如果是本地开发模式的话,直接使用本地文件即可(注意必须配置livy.conf文件,设置livy.

- Spark Livy 指南及livy部署访问实践

house.zhang

大数据-Spark大数据

背景:ApacheSpark是一个比较流行的大数据框架、广泛运用于数据处理、数据分析、机器学习中,它提供了两种方式进行数据处理,一是交互式处理:比如用户使用spark-shell,编写交互式代码编译成spark作业提交到集群上去执行;二是批处理,通过spark-submit提交打包好的spark应用jar到集群中进行执行。这两种运行方式都需要安装spark客户端配置好yarn集群信息,并打通集群网

- 大数据学习(四):Livy的安装配置及pyspark的会话执行

猪笨是念来过倒

大数据pyspark

一个基于Spark的开源REST服务,它能够通过REST的方式将代码片段或是序列化的二进制代码提交到Spark集群中去执行。它提供了以下这些基本功能:提交Scala、Python或是R代码片段到远端的Spark集群上执行;提交Java、Scala、Python所编写的Spark作业到远端的Spark集群上执行;提交批处理应用在集群中运行。从Livy所提供的基本功能可以看到Livy涵盖了原生Spar

- 探索数据科学新边界:Apache Livy 开源项目详解

毕艾琳

探索数据科学新边界:ApacheLivy开源项目详解incubator-livyApacheLivyisanopensourceRESTinterfaceforinteractingwithApacheSparkfromanywhere.项目地址:https://gitcode.com/gh_mirrors/in/incubator-livyApacheLivy是一个为ApacheSpark提供的

- 大数据公司 Databricks 详解

Bj陈默

大数据

Databricks是一家在大数据和人工智能领域具有重要影响力的美国企业软件公司,以下是关于它的详细技术解析:1.起源与背景:Databricks成立于2013年,由来自加州大学伯克利分校AMP实验室的Spark大数据处理系统的多位创始人联合创立,包括AliGhodsi、AndyKonwinski、IonStoica、PatrickWendell、ReynoldXin、MateiZaharia、A

- 全面解读 Databricks:从架构、引擎到优化策略

克里斯蒂亚诺罗纳尔多阿维罗

架构spark大数据

导语:Databricks是一家由ApacheSpark创始团队成员创立的公司,同时也是一个统一分析平台,帮助企业构建数据湖与数据仓库一体化(Lakehouse)的架构。在Databricks平台上,数据工程、数据科学与数据分析团队能够协作使用Spark、DeltaLake、MLflow等工具高效处理数据与构建机器学习应用。本文将深入介绍Databricks的平台概念、架构特点、优化机制、功能特性

- 使用 Hadoop 实现大数据的高效存储与查询

王子良.

经验分享大数据hadoop分布式

欢迎来到我的博客!非常高兴能在这里与您相遇。在这里,您不仅能获得有趣的技术分享,还能感受到轻松愉快的氛围。无论您是编程新手,还是资深开发者,都能在这里找到属于您的知识宝藏,学习和成长。博客内容包括:Java核心技术与微服务:涵盖Java基础、JVM、并发编程、Redis、Kafka、Spring等,帮助您全面掌握企业级开发技术。大数据技术:涵盖Hadoop(HDFS)、Hive、Spark、Fli

- Spark 源码分析(一) SparkRpc中序列化与反序列化Serializer的抽象类解读 (正在更新中~)别人能写出来的,你也能行!多学习别人的思路,形成自己的思路,高薪工作奔你而来!

小白的大数据历程

Spark源码解析开发语言spark大数据分布式scala

后一篇链接在这接上一章请先看解读序列化抽象类第一部分(这是一个链接)目录接上一章请先看解读序列化抽象类第一部分2.Java序列化实现类JavaSerializer(1)JavaSerializationStream类代码实际例子1:序列化(2)JavaDeserializationStream代码实际例子2:反序列化Spark源码下类图在学习过程中,抓住主要问题,请思考问题为什么Kryo序列化更加

- Spark 源码分析(一) SparkRpc中序列化与反序列化Serializer的抽象类解读 (java序列化部分完结,正在更新RpcEnv部分~)

小白的大数据历程

Spark源码解析sparkjavapython

目录(3)JavaSerializerInstance定义了一个Java序列化实例(1)构造方法参数(2)方法1:serializeStream(3)方法2:deserializeStreamdefaultClassLoader(4)方法3:deserializeStreamloader(5)方法4:serialize(6)方法5:deserializeloader(7)方法6:deseriali

- 大数据-257 离线数仓 - 数据质量监控 监控方法 Griffin架构

武子康

大数据离线数仓大数据数据仓库java后端hadoophive

点一下关注吧!!!非常感谢!!持续更新!!!Java篇开始了!目前开始更新MyBatis,一起深入浅出!目前已经更新到了:Hadoop(已更完)HDFS(已更完)MapReduce(已更完)Hive(已更完)Flume(已更完)Sqoop(已更完)Zookeeper(已更完)HBase(已更完)Redis(已更完)Kafka(已更完)Spark(已更完)Flink(已更完)ClickHouse(已

- pyspark 中删除hdfs的文件夹

TDengine (老段)

大数据sparkhadoophdfsmapreduce

在pyspark中保存rdd的内存到文件的时候,会遇到文件夹已经存在而失败,所以如果文件夹已经存在,需要先删除。搜索了下资料,发现pyspark并没有提供直接管理hdfs文件系统的功能。寻找到一个删除的方法,是通过调用shell命令hadoopfs-rm-f来删除,这个方法感觉不怎么好,所以继续找。后来通过查找hadoophdfs的源代码发现hdfs是通过java的包org.appache.had

- Python 爬虫:获取网页数据的 5 种方法

王子良.

经验分享pythonpython开发语言爬虫

欢迎来到我的博客!非常高兴能在这里与您相遇。在这里,您不仅能获得有趣的技术分享,还能感受到轻松愉快的氛围。无论您是编程新手,还是资深开发者,都能在这里找到属于您的知识宝藏,学习和成长。博客内容包括:Java核心技术与微服务:涵盖Java基础、JVM、并发编程、Redis、Kafka、Spring等,帮助您全面掌握企业级开发技术。大数据技术:涵盖Hadoop(HDFS)、Hive、Spark、Fli

- python捕获异常

青云游子

python

try:name="aaa"id="aaa"exceptExceptionase:print("任务报错")print(str(e))print(str(traceback.print_exc()))spark.sql("""insertintotabledim.aaaselect'1','666','{name}','{id}',null,null,null,null,current_times

- Spark任务提交流程

尘世壹俗人

大数据Spark技术大数据

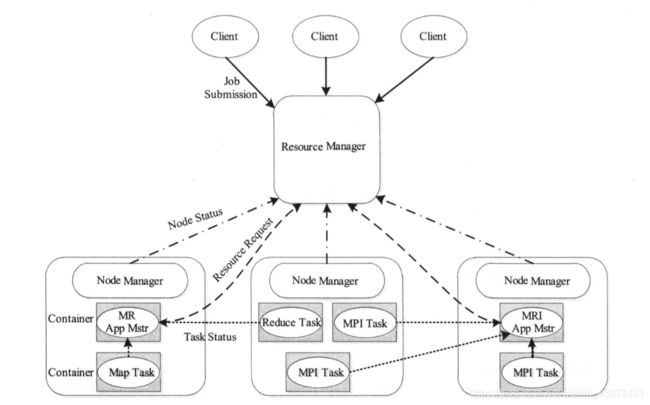

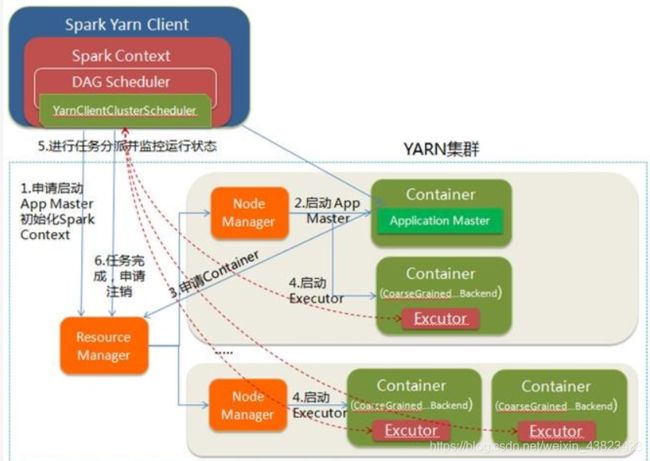

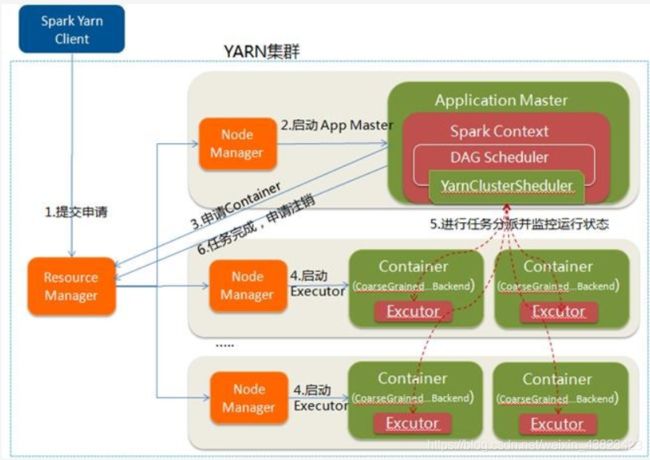

当包含在applicationmaster中的spark-driver启动后,会与资源调度平台交互获取其他执行器资源,并通过反向注册通知对应的node节点启动执行容器。此外,还会根据程序的执行规划生成两个非常重要的东西,一个是根据spark任务执行计划生成n个ADG有向无环图,另一个是根据有向无环图生成对应的taskset,也可以统称为stage,ADG和taskset由于宽窄依赖以及程序的复杂度

- spark读取、写入Clickhouse以及遇到的问题

Alex_81D

大数据基础大数据从入门到精通clickhousespark

最近需要处理Clickhouse里面的数据,经过上网查找总结一下spark读写Clickhouse的工具类已经遇到的问题点。具体Clickhouse的讲解本篇不做讲解,后面专门讲解这个。一、clickhouse代码操作话不多说直接看代码1.引入依赖:ru.yandex.clickhouseclickhouse-jdbc0.2.40.2.4这个版本用的比较多一点2.spark对象创建valspark

- 2024年最新Python:Page Object设计模式_python page object,BTAJ大厂最新面试题汇集

m0_60707708

程序员python设计模式开发语言

最后硬核资料:关注即可领取PPT模板、简历模板、行业经典书籍PDF。技术互助:技术群大佬指点迷津,你的问题可能不是问题,求资源在群里喊一声。面试题库:由技术群里的小伙伴们共同投稿,热乎的大厂面试真题,持续更新中。知识体系:含编程语言、算法、大数据生态圈组件(Mysql、Hive、Spark、Flink)、数据仓库、Python、前端等等。网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是

- 2024年总结:大转向

年度总结

本文于2025年1月2号首发于公众号“狗哥琐话”。2024年是个打工人苦命年,我看到几乎每个人都比以往辛苦。这让我想起了六字真言,钱难赚屎难吃。职业转向今年我在职业上尝试做了一个转向,具体的结果可能需要比较长的时间来检验我选择是否正确,所以转向的细节我就不全部展开了,可以确定是我依然会专注在Infra和BigData,比如今年我发布了SparkSQL和FlinkSQL的IDEA提效插件。那么我为什

- Java爬虫——使用Spark进行数据清晰

Future_yzx

java爬虫spark

1.依赖引入 org.apache.spark spark-core_2.13 3.5.3 org.apache.spark spark-sql_2.13 3.5.32.数据加载从MySQL数据库中加载jobTest表中的数据,使用Spark的JDBC功能连接到数据库。代码片段://数据库连接信息StringjdbcUrl="jdbc:mysql://82.157.185.251:3306/

- 万字详解数仓分层设计架构 ODS-DWD-DWS-ADS

_Jordan

自己写的数据仓库

参考:万字详解数仓分层设计架构ODS-DWD-DWS-ADS数据分层的意义1、清晰数据结构2、数据血缘追踪3、数据复用,减少重复开发4、把复杂问题简单化5、屏蔽原始数据的(影响),屏蔽业务的影响ETL操作1、数据抽取2、数据清洗3、数据转换4、数据加载数据中台包含的内容很多,对应到具体工作中的话,它可以包含下面的这些内容:系统架构:以Hadoop、Spark等组件为中心的架构体系数据架构:顶层设计

- Java 大视界 -- Java 开发 Spark 应用:RDD 操作与数据转换

一只蜗牛儿

javaspark开发语言

ApacheSpark是一个强大的分布式计算框架,提供了高效的数据处理能力,广泛应用于大数据分析与机器学习。Spark提供了多种高级API,支持批处理和流处理。Spark提供了两种主要的数据抽象:RDD(弹性分布式数据集)和DataFrame。本文将重点介绍如何使用Java开发Spark应用,并深入探讨RDD的操作与数据转换。一、Spark环境搭建首先,确保您的环境中安装了Java和Spark。您

- Spring Boot 和微服务:快速入门指南

王子良.

Java经验分享springboot微服务后端

欢迎来到我的博客!非常高兴能在这里与您相遇。在这里,您不仅能获得有趣的技术分享,还能感受到轻松愉快的氛围。无论您是编程新手,还是资深开发者,都能在这里找到属于您的知识宝藏,学习和成长。博客内容包括:Java核心技术与微服务:涵盖Java基础、JVM、并发编程、Redis、Kafka、Spring等,帮助您全面掌握企业级开发技术。大数据技术:涵盖Hadoop(HDFS)、Hive、Spark、Fli

- CDP中的Hive3之Hive Metastore(HMS)

对许

#Hive#Sparkhivecdp

CDP中的Hive3之HiveMetastore(HMS)1、CDP中的HMS2、HMS表的存储(转换)3、HWC授权1、CDP中的HMSCDP中的HiveMetastore(HMS)是一种服务,用于在后端RDBMS(例如MySQL或PostgreSQL)中存储与ApacheHive和其他服务相关的元数据。Impala、Spark、Hive和其他服务共享元存储。与HMS的连接包括HiveServe

- 【YashanDB知识库】Hive 命令工具insert崖山数据库报错

数据库

本文内容来自YashanDB官网,原文内容请见https://www.yashandb.com/newsinfo/7919217.html?templateId=171...【问题分类】功能兼容【关键字】spark30041、不兼容【问题描述】本项目的架构是hadoop+hive+yashandb使用崖山数据库,初始化所有的原数据表和数据新建表之后,插入数据时候报错,hadoopcode30041

- 初学者如何用 Python 写第一个爬虫?

王子良.

python经验分享python开发语言爬虫

欢迎来到我的博客!非常高兴能在这里与您相遇。在这里,您不仅能获得有趣的技术分享,还能感受到轻松愉快的氛围。无论您是编程新手,还是资深开发者,都能在这里找到属于您的知识宝藏,学习和成长。博客内容包括:Java核心技术与微服务:涵盖Java基础、JVM、并发编程、Redis、Kafka、Spring等,帮助您全面掌握企业级开发技术。大数据技术:涵盖Hadoop(HDFS)、Hive、Spark、Fli

- Apache PAIMON 学习

潇锐killer

学习

参考:ApachePAIMON:实时数据湖技术框架及其实践数据湖不仅仅是一个存储不同类数据的技术手段,更是提高数据分析效率、支持数据驱动决策、加速AI发展的基础设施。新一代实时数据湖技术,ApachePAIMON兼容ApacheFlink、Spark等主流计算引擎,并支持流批一体化处理、快速查询和性能优化,成为加速AI转型的重要工具。ApachePAIMON是一个支持大规模实时数据更新的存储和分析

- 应急救援路径规划中的蚁群算法与路径评价研究【附代码】

拉勾科研工作室

算法

数据科学与大数据专业|数据分析与模型构建|数据驱动决策✨专业领域:数据挖掘与清洗大数据处理与存储技术机器学习与深度学习模型数据可视化与报告生成分布式计算与云计算数据安全与隐私保护擅长工具:Python/R/Matlab数据分析与建模Hadoop/Spark大数据处理平台SQL数据库管理与优化Tableau/PowerBI数据可视化工具TensorFlow/PyTorch深度学习框架✅具体问题可以私

- Java 大视界 -- Java 开发 Spark 应用:RDD 操作与数据转换(四)

青云交

大数据新视界Java大视界SparkRDD数据转换大数据数据分区性能优化社交网络java

亲爱的朋友们,热烈欢迎你们来到青云交的博客!能与你们在此邂逅,我满心欢喜,深感无比荣幸。在这个瞬息万变的时代,我们每个人都在苦苦追寻一处能让心灵安然栖息的港湾。而我的博客,正是这样一个温暖美好的所在。在这里,你们不仅能够收获既富有趣味又极为实用的内容知识,还可以毫无拘束地畅所欲言,尽情分享自己独特的见解。我真诚地期待着你们的到来,愿我们能在这片小小的天地里共同成长,共同进步。本博客的精华专栏:大数

- JVM StackMapTable 属性的作用及理解

lijingyao8206

jvm字节码Class文件StackMapTable

在Java 6版本之后JVM引入了栈图(Stack Map Table)概念。为了提高验证过程的效率,在字节码规范中添加了Stack Map Table属性,以下简称栈图,其方法的code属性中存储了局部变量和操作数的类型验证以及字节码的偏移量。也就是一个method需要且仅对应一个Stack Map Table。在Java 7版

- 回调函数调用方法

百合不是茶

java

最近在看大神写的代码时,.发现其中使用了很多的回调 ,以前只是在学习的时候经常用到 ,现在写个笔记 记录一下

代码很简单:

MainDemo :调用方法 得到方法的返回结果

- [时间机器]制造时间机器需要一些材料

comsci

制造

根据我的计算和推测,要完全实现制造一台时间机器,需要某些我们这个世界不存在的物质

和材料...

甚至可以这样说,这种材料和物质,我们在反应堆中也无法获得......

- 开口埋怨不如闭口做事

邓集海

邓集海 做人 做事 工作

“开口埋怨,不如闭口做事。”不是名人名言,而是一个普通父亲对儿子的训导。但是,因为这句训导,这位普通父亲却造就了一个名人儿子。这位普通父亲造就的名人儿子,叫张明正。 张明正出身贫寒,读书时成绩差,常挨老师批评。高中毕业,张明正连普通大学的分数线都没上。高考成绩出来后,平时开口怨这怨那的张明正,不从自身找原因,而是不停地埋怨自己家庭条件不好、埋怨父母没有给他创造良好的学习环境。

- jQuery插件开发全解析,类级别与对象级别开发

IT独行者

jquery开发插件 函数

jQuery插件的开发包括两种: 一种是类级别的插件开发,即给

jQuery添加新的全局函数,相当于给

jQuery类本身添加方法。

jQuery的全局函数就是属于

jQuery命名空间的函数,另一种是对象级别的插件开发,即给

jQuery对象添加方法。下面就两种函数的开发做详细的说明。

1

、类级别的插件开发 类级别的插件开发最直接的理解就是给jQuer

- Rome解析Rss

413277409

Rome解析Rss

import java.net.URL;

import java.util.List;

import org.junit.Test;

import com.sun.syndication.feed.synd.SyndCategory;

import com.sun.syndication.feed.synd.S

- RSA加密解密

无量

加密解密rsa

RSA加密解密代码

代码有待整理

package com.tongbanjie.commons.util;

import java.security.Key;

import java.security.KeyFactory;

import java.security.KeyPair;

import java.security.KeyPairGenerat

- linux 软件安装遇到的问题

aichenglong

linux遇到的问题ftp

1 ftp配置中遇到的问题

500 OOPS: cannot change directory

出现该问题的原因:是SELinux安装机制的问题.只要disable SELinux就可以了

修改方法:1 修改/etc/selinux/config 中SELINUX=disabled

2 source /etc

- 面试心得

alafqq

面试

最近面试了好几家公司。记录下;

支付宝,面试我的人胖胖的,看着人挺好的;博彦外包的职位,面试失败;

阿里金融,面试官人也挺和善,只不过我让他吐血了。。。

由于印象比较深,记录下;

1,自我介绍

2,说下八种基本类型;(算上string。楼主才答了3种,哈哈,string其实不是基本类型,是引用类型)

3,什么是包装类,包装类的优点;

4,平时看过什么书?NND,什么书都没看过。。照样

- java的多态性探讨

百合不是茶

java

java的多态性是指main方法在调用属性的时候类可以对这一属性做出反应的情况

//package 1;

class A{

public void test(){

System.out.println("A");

}

}

class D extends A{

public void test(){

S

- 网络编程基础篇之JavaScript-学习笔记

bijian1013

JavaScript

1.documentWrite

<html>

<head>

<script language="JavaScript">

document.write("这是电脑网络学校");

document.close();

</script>

</h

- 探索JUnit4扩展:深入Rule

bijian1013

JUnitRule单元测试

本文将进一步探究Rule的应用,展示如何使用Rule来替代@BeforeClass,@AfterClass,@Before和@After的功能。

在上一篇中提到,可以使用Rule替代现有的大部分Runner扩展,而且也不提倡对Runner中的withBefores(),withAfte

- [CSS]CSS浮动十五条规则

bit1129

css

这些浮动规则,主要是参考CSS权威指南关于浮动规则的总结,然后添加一些简单的例子以验证和理解这些规则。

1. 所有的页面元素都可以浮动 2. 一个元素浮动后,会成为块级元素,比如<span>,a, strong等都会变成块级元素 3.一个元素左浮动,会向最近的块级父元素的左上角移动,直到浮动元素的左外边界碰到块级父元素的左内边界;如果这个块级父元素已经有浮动元素停靠了

- 【Kafka六】Kafka Producer和Consumer多Broker、多Partition场景

bit1129

partition

0.Kafka服务器配置

3个broker

1个topic,6个partition,副本因子是2

2个consumer,每个consumer三个线程并发读取

1. Producer

package kafka.examples.multibrokers.producers;

import java.util.Properties;

import java.util.

- zabbix_agentd.conf配置文件详解

ronin47

zabbix 配置文件

Aliaskey的别名,例如 Alias=ttlsa.userid:vfs.file.regexp[/etc/passwd,^ttlsa:.:([0-9]+),,,,\1], 或者ttlsa的用户ID。你可以使用key:vfs.file.regexp[/etc/passwd,^ttlsa:.: ([0-9]+),,,,\1],也可以使用ttlsa.userid。备注: 别名不能重复,但是可以有多个

- java--19.用矩阵求Fibonacci数列的第N项

bylijinnan

fibonacci

参考了网上的思路,写了个Java版的:

public class Fibonacci {

final static int[] A={1,1,1,0};

public static void main(String[] args) {

int n=7;

for(int i=0;i<=n;i++){

int f=fibonac

- Netty源码学习-LengthFieldBasedFrameDecoder

bylijinnan

javanetty

先看看LengthFieldBasedFrameDecoder的官方API

http://docs.jboss.org/netty/3.1/api/org/jboss/netty/handler/codec/frame/LengthFieldBasedFrameDecoder.html

API举例说明了LengthFieldBasedFrameDecoder的解析机制,如下:

实

- AES加密解密

chicony

加密解密

AES加解密算法,使用Base64做转码以及辅助加密:

package com.wintv.common;

import javax.crypto.Cipher;

import javax.crypto.spec.IvParameterSpec;

import javax.crypto.spec.SecretKeySpec;

import sun.misc.BASE64Decod

- 文件编码格式转换

ctrain

编码格式

package com.test;

import java.io.File;

import java.io.FileInputStream;

import java.io.FileOutputStream;

import java.io.IOException;

import java.io.InputStream;

import java.io.OutputStream;

- mysql 在linux客户端插入数据中文乱码

daizj

mysql中文乱码

1、查看系统客户端,数据库,连接层的编码

查看方法: http://daizj.iteye.com/blog/2174993

进入mysql,通过如下命令查看数据库编码方式: mysql> show variables like 'character_set_%'; +--------------------------+------

- 好代码是廉价的代码

dcj3sjt126com

程序员读书

长久以来我一直主张:好代码是廉价的代码。

当我跟做开发的同事说出这话时,他们的第一反应是一种惊愕,然后是将近一个星期的嘲笑,把它当作一个笑话来讲。 当他们走近看我的表情、知道我是认真的时,才收敛一点。

当最初的惊愕消退后,他们会用一些这样的话来反驳: “好代码不廉价,好代码是采用经过数十年计算机科学研究和积累得出的最佳实践设计模式和方法论建立起来的精心制作的程序代码。”

我只

- Android网络请求库——android-async-http

dcj3sjt126com

android

在iOS开发中有大名鼎鼎的ASIHttpRequest库,用来处理网络请求操作,今天要介绍的是一个在Android上同样强大的网络请求库android-async-http,目前非常火的应用Instagram和Pinterest的Android版就是用的这个网络请求库。这个网络请求库是基于Apache HttpClient库之上的一个异步网络请求处理库,网络处理均基于Android的非UI线程,通

- ORACLE 复习笔记之SQL语句的优化

eksliang

SQL优化Oracle sql语句优化SQL语句的优化

转载请出自出处:http://eksliang.iteye.com/blog/2097999

SQL语句的优化总结如下

sql语句的优化可以按照如下六个步骤进行:

合理使用索引

避免或者简化排序

消除对大表的扫描

避免复杂的通配符匹配

调整子查询的性能

EXISTS和IN运算符

下面我就按照上面这六个步骤分别进行总结:

- 浅析:Android 嵌套滑动机制(NestedScrolling)

gg163

android移动开发滑动机制嵌套

谷歌在发布安卓 Lollipop版本之后,为了更好的用户体验,Google为Android的滑动机制提供了NestedScrolling特性

NestedScrolling的特性可以体现在哪里呢?<!--[if !supportLineBreakNewLine]--><!--[endif]-->

比如你使用了Toolbar,下面一个ScrollView,向上滚

- 使用hovertree菜单作为后台导航

hvt

JavaScriptjquery.nethovertreeasp.net

hovertree是一个jquery菜单插件,官方网址:http://keleyi.com/jq/hovertree/ ,可以登录该网址体验效果。

0.1.3版本:http://keleyi.com/jq/hovertree/demo/demo.0.1.3.htm

hovertree插件包含文件:

http://keleyi.com/jq/hovertree/css

- SVG 教程 (二)矩形

天梯梦

svg

SVG <rect> SVG Shapes

SVG有一些预定义的形状元素,可被开发者使用和操作:

矩形 <rect>

圆形 <circle>

椭圆 <ellipse>

线 <line>

折线 <polyline>

多边形 <polygon>

路径 <path>

- 一个简单的队列

luyulong

java数据结构队列

public class MyQueue {

private long[] arr;

private int front;

private int end;

// 有效数据的大小

private int elements;

public MyQueue() {

arr = new long[10];

elements = 0;

front

- 基础数据结构和算法九:Binary Search Tree

sunwinner

Algorithm

A binary search tree (BST) is a binary tree where each node has a Comparable key (and an associated value) and satisfies the restriction that the key in any node is larger than the keys in all

- 项目出现的一些问题和体会

Steven-Walker

DAOWebservlet

第一篇博客不知道要写点什么,就先来点近阶段的感悟吧。

这几天学了servlet和数据库等知识,就参照老方的视频写了一个简单的增删改查的,完成了最简单的一些功能,使用了三层架构。

dao层完成的是对数据库具体的功能实现,service层调用了dao层的实现方法,具体对servlet提供支持。

&

- 高手问答:Java老A带你全面提升Java单兵作战能力!

ITeye管理员

java

本期特邀《Java特种兵》作者:谢宇,CSDN论坛ID: xieyuooo 针对JAVA问题给予大家解答,欢迎网友积极提问,与专家一起讨论!

作者简介:

淘宝网资深Java工程师,CSDN超人气博主,人称“胖哥”。

CSDN博客地址:

http://blog.csdn.net/xieyuooo

作者在进入大学前是一个不折不扣的计算机白痴,曾经被人笑话过不懂鼠标是什么,