[CVPR2020论文(目标跟踪方向)]Probabilistic Regression for Visual Tracking(PrDiMP)——附录部分

这周先更新一下PrDiMP论文的附录部分,大家可以结合正文一起看~

附录

A、KL散度损失的推导

在这里,我们推导来源于预测的分布![]() 和ground-truth密度

和ground-truth密度![]() 之间的KL散度的损失(8)。从KL散度的定义开始,然后将(6)插入,我们获得了,

之间的KL散度的损失(8)。从KL散度的定义开始,然后将(6)插入,我们获得了,

在最后一行,我们丢弃了第一项(![]() 的负熵),然后用(6)代替

的负熵),然后用(6)代替![]() 。

。

B、目标中心回归模块

在本节中,我们对PrDiMP中为目标中心回归所采用的优化模块进行详细的描述和推导。优化模块的目标就是预测目标中心回归部分的权重![]() ,

,

其中,![]() 是输入图片,

是输入图片,![]() 是图像坐标,

是图像坐标,![]() 是主干特征提取器(见4.2节)。权重

是主干特征提取器(见4.2节)。权重![]() 从一套训练图片

从一套训练图片![]() 和相关联的目标边界框标注

和相关联的目标边界框标注![]() 学习。如同DiMP一样,这些图片是在训练时从每个序列的间隔中采样得到的。在跟踪的过程中,图片

学习。如同DiMP一样,这些图片是在训练时从每个序列的间隔中采样得到的。在跟踪的过程中,图片![]() 通过对第一帧图像数据增强来获得,然后通过存储空间的逐步更新来获得。

通过对第一帧图像数据增强来获得,然后通过存储空间的逐步更新来获得。

在DiMP中,优化模块通过将最速梯度下降算法引入最小二乘目标函数中推导得到。然而,本文算法所采用的损失函数不是最小二乘方法。因此,我们用二次牛顿近似来代替高斯牛顿近似,从而为最速梯度下降算法计算步长。我们推导出所有操作的闭式解,确保优化模块作为一系列深度神经网络层的简单整合。

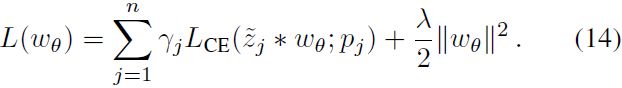

与我们的离线训练目标函数相似,我们令优化模块基于学习损失(8)来最小化KL散度。我们还添加了![]() 正则化项,从而能够一般化到未见的帧。因此loss计算如下,

正则化项,从而能够一般化到未见的帧。因此loss计算如下,

非负标量![]() 和

和![]() 分别控制正则化项和样本

分别控制正则化项和样本![]() 的影响。为了便利,我们同样做了下面的定义,

的影响。为了便利,我们同样做了下面的定义,

注意到,我们使用下标![]() 来表示空间网格位置

来表示空间网格位置![]() 。(15b)-(15d)中的值要么是

。(15b)-(15d)中的值要么是![]() 维(

维(![]() )的向量,要么是2维图

)的向量,要么是2维图![]() 。

。

在(14),逐个样本损失![]() 是原始KL散度目标函数的网格近似(9)。不失一般性,我们假设

是原始KL散度目标函数的网格近似(9)。不失一般性,我们假设![]() ,获得

,获得

其中,![]() 表示全1向量。需要注意的是网格假设因此和常用于分类的SoftMax交叉熵损失有关联。

表示全1向量。需要注意的是网格假设因此和常用于分类的SoftMax交叉熵损失有关联。

为了推导优化模块,我们采用最速下降方法,但是采用上述的牛顿近似。于是产生了下面的优化方法,

其中,![]() 和

和![]() 是

是![]() (14)在当前权重估计

(14)在当前权重估计![]() 处的梯度和Hessian矩阵。为了实现(17),我们通过推导二者的闭式解来计算这些值。

处的梯度和Hessian矩阵。为了实现(17),我们通过推导二者的闭式解来计算这些值。

首先,我们可以简单的计算(16)关于![]() 的梯度和hessian,

的梯度和hessian,

其中,![]() 是

是![]() 的SoftMax(见15d)。利用(18a)和链式法则,我们可以计算(14)的梯度,

的SoftMax(见15d)。利用(18a)和链式法则,我们可以计算(14)的梯度,

我们将线性卷积操作![]() 的转置表示为

的转置表示为![]() ,后者与雅克比矩阵

,后者与雅克比矩阵![]() 的转置相关联。关于

的转置相关联。关于![]() 的再一次微分,使用(18b)、链式法则和

的再一次微分,使用(18b)、链式法则和![]() 关于

关于![]() 的线性,我们获得(14)的Hessian矩阵,

的线性,我们获得(14)的Hessian矩阵,

其中,![]() 表示单位矩阵。我们就通过下面的乘积获得了(17)中步长分母的简单表达,

表示单位矩阵。我们就通过下面的乘积获得了(17)中步长分母的简单表达,

其中,![]() 表示元素乘积。我们在Algorithm1中总结了整个优化过程。

表示元素乘积。我们在Algorithm1中总结了整个优化过程。

C、详细结果

C.1.LaSOT

除了success plot,还评估了normalized precision plot![]() :预测的目标中心点位置和ground-truth之间的归一化距离(和目标大小有关)小于阈值

:预测的目标中心点位置和ground-truth之间的归一化距离(和目标大小有关)小于阈值![]() 的帧所占的百分比。

的帧所占的百分比。

C.2.GOT10k

C.3.OTB-100

C.4.NFS

D、预测分布的可视化

在本节中,我们提供PrDiMP中目标中心回归和边界框回归分支的预测概率分布的可视化。如图4一样,我们可视化了输出。两个具有挑战性的序列的例子如图5所示。在标准跟踪时,目标中心回归(第二列)的预测分布![]() 通过在以上一帧目标位置为中心的搜索区域上利用全卷积中心回归分支来计算。

通过在以上一帧目标位置为中心的搜索区域上利用全卷积中心回归分支来计算。

为了可视化边界框回归分支所预测的概率分布![]() ,我们在网格中评估了密度。注意到边界框

,我们在网格中评估了密度。注意到边界框![]() 是4维的,因此我们不能将整个分布以2维热力图的形式可视化。所以我们绘制了密度的两个切片,如下展示了边界框位置和大小的变化。边界框为

是4维的,因此我们不能将整个分布以2维热力图的形式可视化。所以我们绘制了密度的两个切片,如下展示了边界框位置和大小的变化。边界框为![]() ,其中

,其中![]() 是中心点坐标,

是中心点坐标,![]() 是宽和高,

是宽和高,![]() 是常量参考尺寸。后者设置我目标大小的当前估计值。边界框中心(图5的第三列)的分布通过在中心坐标

是常量参考尺寸。后者设置我目标大小的当前估计值。边界框中心(图5的第三列)的分布通过在中心坐标![]() 的稠密网格中预测密度值

的稠密网格中预测密度值![]() 来获得,同时保持尺寸

来获得,同时保持尺寸![]() 在当前目标估计时为常量。为了可视化边界框大小(第四列),我们在log坐标

在当前目标估计时为常量。为了可视化边界框大小(第四列),我们在log坐标![]() 的稠密网格中评估了

的稠密网格中评估了![]() ,同时保持边界框以当前目标估计

,同时保持边界框以当前目标估计![]() 为中心。

为中心。

图5 分别由目标中心回归和边界框回归分支预测的概率密度![]() 和

和![]() 的可视化结果。我们对两个具有挑战性的序列可视化了结果,捕捉不确定性对于这两个序列来说是十分重要的。

的可视化结果。我们对两个具有挑战性的序列可视化了结果,捕捉不确定性对于这两个序列来说是十分重要的。

在图5中,目标中心密度显示在相对于上一目标位置![]() 的范围内。边界框中心密度在

的范围内。边界框中心密度在![]() 和

和![]() 范围内绘制。边界框尺寸的分布从估计目标尺寸

范围内绘制。边界框尺寸的分布从估计目标尺寸![]() 的1/3到3倍来绘制,即

的1/3到3倍来绘制,即![]() 。可视化结果如上图所示。左图展示了一只猫和它的镜像图片。由于它们的相似性和位置上的接近,在跟多帧中很难预测猫的准确边界框。在这些情况中,预测的分布就可以捕捉这些不确定性。例如,在第四行,两个清晰的模式被预测到了,这两种模式对应于将边界框与真实的猫对齐或与反射的边缘对齐。此外,最后一行是失败的情况,边界框扩张了。然而,注意到尺寸概率分布(右边一栏)是高度不确定的。因此这个信息就可以用于展示估计的边界框尺寸是否可信。

。可视化结果如上图所示。左图展示了一只猫和它的镜像图片。由于它们的相似性和位置上的接近,在跟多帧中很难预测猫的准确边界框。在这些情况中,预测的分布就可以捕捉这些不确定性。例如,在第四行,两个清晰的模式被预测到了,这两种模式对应于将边界框与真实的猫对齐或与反射的边缘对齐。此外,最后一行是失败的情况,边界框扩张了。然而,注意到尺寸概率分布(右边一栏)是高度不确定的。因此这个信息就可以用于展示估计的边界框尺寸是否可信。

图5右侧展示了有多个干扰物时的情况。对场景有更广阔视野的目标中心回归能够捕捉到不确定情况下的干扰项的存在。在最后一行中,跟踪器跳到了干扰物体上去。然而,在目标中心回归分布中有个很强的二级模式,可以显示真实的物体。因此,估计的分布能够准确的捕捉模糊情况下的不确定性。此外,在4-7行,目标物体非常小,并且周围有很多相似物体。这使得边界框回归变得非常困难,即使是对于人来说。当遇到这些问题时,我们的网络能够预测灵活的分布,为边界框位置和尺寸反映有价值的不确定性。

![[CVPR2020论文(目标跟踪方向)]Probabilistic Regression for Visual Tracking(PrDiMP)——附录部分_第1张图片](http://img.e-com-net.com/image/info8/6bda5e416cea494ba6a4d9eee8beeef5.jpg)

![[CVPR2020论文(目标跟踪方向)]Probabilistic Regression for Visual Tracking(PrDiMP)——附录部分_第2张图片](http://img.e-com-net.com/image/info8/ca92f79482cd48b98065e7f2700a7a1f.jpg)

![[CVPR2020论文(目标跟踪方向)]Probabilistic Regression for Visual Tracking(PrDiMP)——附录部分_第3张图片](http://img.e-com-net.com/image/info8/e8c1d0f086554407a749f1f1a95b9d10.jpg)

![[CVPR2020论文(目标跟踪方向)]Probabilistic Regression for Visual Tracking(PrDiMP)——附录部分_第4张图片](http://img.e-com-net.com/image/info8/be6f02a409914b05bfce45253decd005.jpg)

![[CVPR2020论文(目标跟踪方向)]Probabilistic Regression for Visual Tracking(PrDiMP)——附录部分_第5张图片](http://img.e-com-net.com/image/info8/2a9b39c8a2124e96a7f0eb5304815e71.jpg)

![[CVPR2020论文(目标跟踪方向)]Probabilistic Regression for Visual Tracking(PrDiMP)——附录部分_第6张图片](http://img.e-com-net.com/image/info8/774c01ffeaf141e3b7ee7915caecd4b3.jpg)

![[CVPR2020论文(目标跟踪方向)]Probabilistic Regression for Visual Tracking(PrDiMP)——附录部分_第7张图片](http://img.e-com-net.com/image/info8/85fc696635694924a3842df0a141162e.jpg)

![[CVPR2020论文(目标跟踪方向)]Probabilistic Regression for Visual Tracking(PrDiMP)——附录部分_第8张图片](http://img.e-com-net.com/image/info8/ba31161cbd504cd4a8aa902314e8f7d5.jpg)

![[CVPR2020论文(目标跟踪方向)]Probabilistic Regression for Visual Tracking(PrDiMP)——附录部分_第9张图片](http://img.e-com-net.com/image/info8/741307e40a9d4bb8aaab24e112ed5981.jpg)