resnet学习笔记

ResNet的残差结构

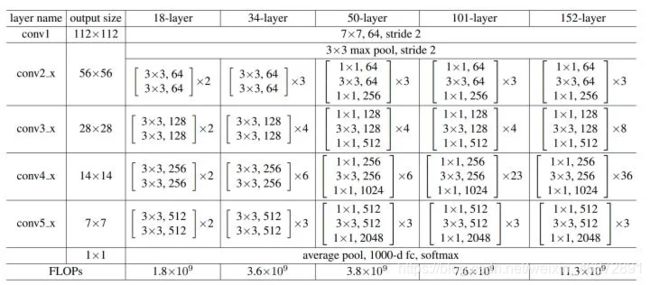

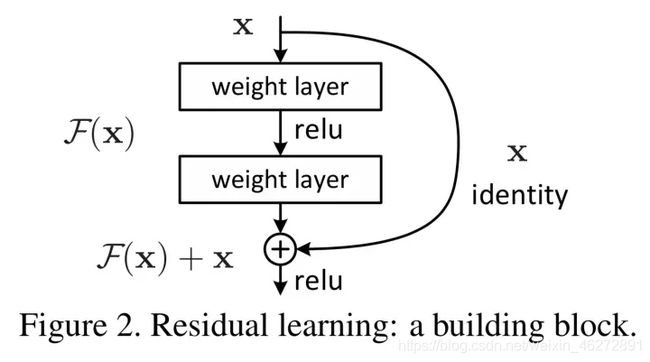

ResNet旨在解决网络层数加深之后训练难度增大的现象。提出了residual模块,包含两个3x3卷积和一个shortcut connection。shortcut connection可以有效的缓解反向传播时由于深度过深而导致的梯度消失现象,这使得网络加深之后性能不会变差。具有短路连接的ResNet可以看作是许多不同深度而共享参数的网络集成,网络的数目虽层数的增加而成指数增加。

ResNet的关键点

1.利用残差结构让网络更深、收敛速度更快、优化更容易,同时参数相对于之前的模型更少、复杂度更低。

2.ResNet大量使用了批量归一层,而不是Dropout。

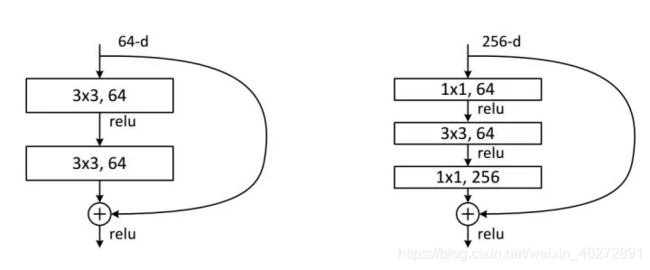

3.对于很深的网络(超过50层),ResNet使用了更高效的瓶颈结构,极大程度上降低了参数的计算量。

为了解决退化问题,我们引入了一个新的深度学习残差学习block,在这里,对于一个堆积层结构(几层堆叠而成)当我们输入 x x x时,其学到的特征记为 H ( x ) H(x) H(x),现在我们其希望可以学习到残差 F ( x ) = H ( x ) − x F(x)=H(x)-x F(x)=H(x)−x,这样其实原始的学习特征是 F ( x ) + x F(x)+x F(x)+x,之所以这样是因为残差学习相比于原始特征直接学习更加容易。当残差为0时,此时堆积层仅仅做了恒等映射,至少网络性能不会下降,实际上残差不会为0,这也会使得在堆积层在输入特征学习的基础上学习到新的特征,从而拥有更好的性能。

残差结构为什么有效果

1.自适应深度:

网络退化问题就体现了多层网络难以拟合恒等映射这种情况,也就是说 H ( x ) H(x) H(x)难以拟合 x x x,但是使用了残差结构之后,拟合恒等映射变得很容易,直接把网络参数全部学习到为0,只留下那个恒等映射的跨连接层即可。于是当网络不需要这么深时,中间的恒等映射就可以多一点,反之即可以少一点。

2.差分放大器:

假设最优 H ( x ) H(x) H(x)更接近于恒等映射,那么网络更容易发现除恒等映射之外的微小波动。

3.模型集成:

整个ResNet类似于多个网络的集成,原因是删除ResNet的部分网络结构不影响整个网络的性能

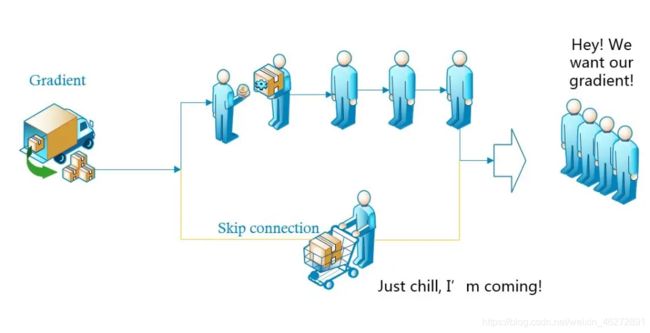

4.缓解梯度消失:

针对一个残差结构输入 x x x求导就可以知道,由于跨层连接的·存在,总梯度在 F ( x ) F(x) F(x)对 x x x的倒数的基础上还会加1。

左边来了一辆装满了“梯度”商品的货车,来领商品的客人一般都要排队一个个拿才可以,如果排队的人太多,后面的人就没有了。于是这时候派了一个人走了“快捷通道”,到货车上领了一部分“梯度”,直接送给后面的人,这样后面排队的客人就能拿到更多的“梯度”。

瓶颈(利用1x1卷积)的好处

对比计算两种结构的参数量可以知道,使用1x1的卷积比使用两个3x3的卷积,计算量不到原来的6%。

最后我们来看一下ResNet的网络设计结构

pytorch实现ResNet代码

import torch.nn as nn

__all__ = ['ResNet50', 'ResNet101', 'ResNet152']

def Conv1(in_planes, places, stride=2):

return nn.Sequential(

nn.Conv2d(in_channels=in_planes,out_channels=places,kernel_size=7,stride=stride,padding=3, bias=False),

nn.BatchNorm2d(places),

nn.ReLU(inplace=True),

nn.MaxPool2d(kernel_size=3, stride=2, padding=1)

)

class Bottleneck(nn.Module):

def __init__(self,in_places,places, stride=1,downsampling=False, expansion = 4):

super(Bottleneck,self).__init__()

self.expansion = expansion

self.downsampling = downsampling

self.bottleneck = nn.Sequential(

nn.Conv2d(in_channels=in_places,out_channels=places,kernel_size=1,stride=1, bias=False),

nn.BatchNorm2d(places),

nn.ReLU(inplace=True),

nn.Conv2d(in_channels=places, out_channels=places, kernel_size=3, stride=stride, padding=1, bias=False),

nn.BatchNorm2d(places),

nn.ReLU(inplace=True),

nn.Conv2d(in_channels=places, out_channels=places*self.expansion, kernel_size=1, stride=1, bias=False),

nn.BatchNorm2d(places*self.expansion),

)

if self.downsampling:

self.downsample = nn.Sequential(

nn.Conv2d(in_channels=in_places, out_channels=places*self.expansion, kernel_size=1, stride=stride, bias=False),

nn.BatchNorm2d(places*self.expansion)

)

self.relu = nn.ReLU(inplace=True)

def forward(self, x):

residual = x

out = self.bottleneck(x)

if self.downsampling:

residual = self.downsample(x)

out += residual

out = self.relu(out)

return out

class ResNet(nn.Module):

def __init__(self,blocks, num_classes=1000, expansion = 4):

super(ResNet,self).__init__()

self.expansion = expansion

self.conv1 = Conv1(in_planes=3, places=64)

self.layer1 = self.make_layer(in_places=64, places=64, block=blocks[0], stride=1)

self.layer2 = self.make_layer(in_places=256, places=128, block=blocks[1], stride=2)

self.layer3 = self.make_layer(in_places=512, places=256, block=blocks[2], stride=2)

self.layer4 = self.make_layer(in_places=1024, places=512, block=blocks[3], stride=2)

self.avgpool = nn.AvgPool2d(7, stride=1)

self.fc = nn.Linear(2048, num_classes)

for m in self.modules():

if isinstance(m, nn.Conv2d):

nn.init.kaiming_normal_(m.weight, mode='fan_out', nonlinearity='relu')

elif isinstance(m, nn.BatchNorm2d):

nn.init.constant_(m.weight, 1)

nn.init.constant_(m.bias, 0)

def make_layer(self, in_places, places, block, stride):

layers = []

layers.append(Bottleneck(in_places, places,stride, downsampling =True))

for i in range(1, block):

layers.append(Bottleneck(places*self.expansion, places))

return nn.Sequential(*layers)

def forward(self, x):

x = self.conv1(x)

x = self.layer1(x)

x = self.layer2(x)

x = self.layer3(x)

x = self.layer4(x)

x = self.avgpool(x)

x = x.view(x.size(0), -1)

x = self.fc(x)

return x

def ResNet50():

return ResNet([3, 4, 6, 3])

def ResNet101():

return ResNet([3, 4, 23, 3])

def ResNet152():

return ResNet([3, 8, 36, 3])

if __name__=='__main__':

# model = torchvision.models.resnet50()

model = ResNet101()

print(model)

这是打印出的ResNet101的结果,也可以打印出ResNet50和ResNet152的模型结构,可以直接运行现在的代码,只需要改一下输出网络的名字

D:\anaconda\envs\gpupytorch\python.exe E:/resnet101/resnet.py

ResNet(

(conv1): Sequential(

(0): Conv2d(3, 64, kernel_size=(7, 7), stride=(2, 2), padding=(3, 3), bias=False)

(1): BatchNorm2d(64, eps=1e-05, momentum=0.1, affine=True, track_running_stats=True)

(2): ReLU(inplace=True)

(3): MaxPool2d(kernel_size=3, stride=2, padding=1, dilation=1, ceil_mode=False)

)

(layer1): Sequential(

(0): Bottleneck(

(bottleneck): Sequential(

(0): Conv2d(64, 64, kernel_size=(1, 1), stride=(1, 1), bias=False)

(1): BatchNorm2d(64, eps=1e-05, momentum=0.1, affine=True, track_running_stats=True)

(2): ReLU(inplace=True)

(3): Conv2d(64, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1), bias=False)

(4): BatchNorm2d(64, eps=1e-05, momentum=0.1, affine=True, track_running_stats=True)

(5): ReLU(inplace=True)

(6): Conv2d(64, 256, kernel_size=(1, 1), stride=(1, 1), bias=False)

(7): BatchNorm2d(256, eps=1e-05, momentum=0.1, affine=True, track_running_stats=True)

)

(downsample): Sequential(

(0): Conv2d(64, 256, kernel_size=(1, 1), stride=(1, 1), bias=False)

(1): BatchNorm2d(256, eps=1e-05, momentum=0.1, affine=True, track_running_stats=True)

)

(relu): ReLU(inplace=True)

)

(1): Bottleneck(

(bottleneck): Sequential(

(0): Conv2d(256, 64, kernel_size=(1, 1), stride=(1, 1), bias=False)

(1): BatchNorm2d(64, eps=1e-05, momentum=0.1, affine=True, track_running_stats=True)

(2): ReLU(inplace=True)

(3): Conv2d(64, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1), bias=False)

(4): BatchNorm2d(64, eps=1e-05, momentum=0.1, affine=True, track_running_stats=True)

(5): ReLU(inplace=True)

(6): Conv2d(64, 256, kernel_size=(1, 1), stride=(1, 1), bias=False)

(7): BatchNorm2d(256, eps=1e-05, momentum=0.1, affine=True, track_running_stats=True)

)

(relu): ReLU(inplace=True)

)

(2): Bottleneck(

(bottleneck): Sequential(

(0): Conv2d(256, 64, kernel_size=(1, 1), stride=(1, 1), bias=False)

(1): BatchNorm2d(64, eps=1e-05, momentum=0.1, affine=True, track_running_stats=True)

(2): ReLU(inplace=True)

(3): Conv2d(64, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1), bias=False)

(4): BatchNorm2d(64, eps=1e-05, momentum=0.1, affine=True, track_running_stats=True)

(5): ReLU(inplace=True)

(6): Conv2d(64, 256, kernel_size=(1, 1), stride=(1, 1), bias=False)

(7): BatchNorm2d(256, eps=1e-05, momentum=0.1, affine=True, track_running_stats=True)

)

(relu): ReLU(inplace=True)

)

)

这个结果比较长,这里我就没有都粘贴出来,有兴趣可以自己将代码运行一遍,可以更加直观的看到网络。

深度学习的发展从LeNet到AlexNet,再到VGGNet和GoogLeNet,网络的深度在不断加深,经验表明,网络深度有着至关重要的影响,层数深的网络可以提取出图片的低层、中层和高层特征。但是当网络足够深,仅仅在后面堆叠更多层会带来梯度爆炸梯度消失,backprop无法把梯度更新到前面的网络层,导致前面的层参数无法更新。和退化,即当层数堆叠过多会导致优化困难,训练误差和测试误差更大(不是过拟合导致的预测误差大)

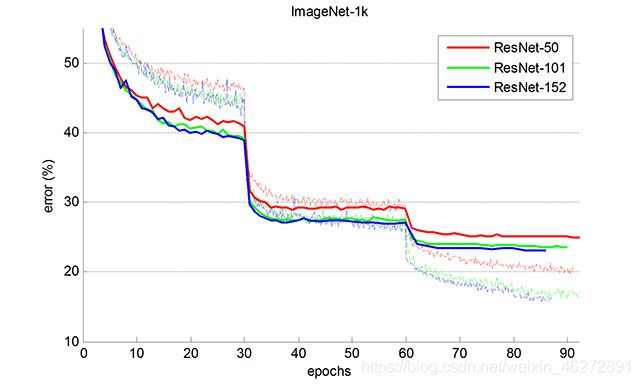

最后直观感受一下上述代码的三种网络的性能,

这是我直接找到的图片,并非自己的训练得出的结果和结论,可供了解。

如果有不对的地方,希望批评指正。